Hadoop 2.2 & HBase 0.96 Maven 依赖总结

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。 通过网上的资料,得知Hbase 0.9

由于Hbase 0.94对Hadoop 2.x的支持不是非常好,故直接添加Hbase 0.94的jar依赖可能会导致问题。 但是直接添加Hbase0.96的依赖,由于官方并没有发布Hbase 0.96的jar包,通过maven编译项目的时候会出现找不到jar包导致编译失败。

通过网上的资料,得知Hbase 0.94后版本,直接添加Hbase-Client的依赖,通过查询得知需要以下依赖:

[html]

view plaincopy

- dependency>

- groupId>commons-iogroupId>

- artifactId>commons-ioartifactId>

- version>1.3.2version>

- dependency>

- dependency>

- groupId>commons-logginggroupId>

- artifactId>commons-loggingartifactId>

- version>1.1.3version>

- dependency>

- dependency>

- groupId>log4jgroupId>

- artifactId>log4jartifactId>

- version>1.2.17version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-clientartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>com.google.protobufgroupId>

- artifactId>protobuf-javaartifactId>

- version>2.5.0version>

- dependency>

- dependency>

- groupId>io.nettygroupId>

- artifactId>nettyartifactId>

- version>3.6.6.Finalversion>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-commonartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.hbasegroupId>

- artifactId>hbase-protocolartifactId>

- version>0.96.1-hadoop2version>

- dependency>

- dependency>

- groupId>org.apache.zookeepergroupId>

- artifactId>zookeeperartifactId>

- version>3.4.5version>

- dependency>

- dependency>

- groupId>org.cloudera.htracegroupId>

- artifactId>htrace-coreartifactId>

- version>2.01version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-mapper-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-core-aslartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-jaxrsartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.codehaus.jacksongroupId>

- artifactId>jackson-xcartifactId>

- version>1.9.13version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-apiartifactId>

- version>1.6.4version>

- dependency>

- dependency>

- groupId>org.slf4jgroupId>

- artifactId>slf4j-log4j12artifactId>

- version>1.6.4version>

- dependency>

若要使用org.apache.hadoop.hbase.mapreduce的API,需要加上:

最后,把Hadoop的依赖也贴上来,以防自己忘记:

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1359

1359

52

52

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet Wenn Sie Hadoop zur Verarbeitung großer Datenmengen verwenden, stoßen Sie häufig auf einige Java-Ausnahmefehler, die sich auf die Ausführung von Aufgaben auswirken und zum Scheitern der Datenverarbeitung führen können. In diesem Artikel werden einige häufige Hadoop-Fehler vorgestellt und Möglichkeiten aufgezeigt, mit ihnen umzugehen und sie zu vermeiden. Java.lang.OutOfMemoryErrorOutOfMemoryError ist ein Fehler, der durch unzureichenden Speicher der Java Virtual Machine verursacht wird. Wenn Hadoop ist

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Mit dem Aufkommen des Big-Data-Zeitalters sind Datenverarbeitung und -speicherung immer wichtiger geworden und die effiziente Verwaltung und Analyse großer Datenmengen ist für Unternehmen zu einer Herausforderung geworden. Hadoop und HBase, zwei Projekte der Apache Foundation, bieten eine Lösung für die Speicherung und Analyse großer Datenmengen. In diesem Artikel wird erläutert, wie Sie Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen verwenden. 1. Einführung in Hadoop und HBase Hadoop ist ein verteiltes Open-Source-Speicher- und Computersystem, das dies kann

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Da die Datenmenge weiter zunimmt, sind herkömmliche Datenverarbeitungsmethoden den Herausforderungen des Big-Data-Zeitalters nicht mehr gewachsen. Hadoop ist ein Open-Source-Framework für verteiltes Computing, das das Leistungsengpassproblem löst, das durch Einzelknotenserver bei der Verarbeitung großer Datenmengen verursacht wird, indem große Datenmengen verteilt gespeichert und verarbeitet werden. PHP ist eine Skriptsprache, die in der Webentwicklung weit verbreitet ist und die Vorteile einer schnellen Entwicklung und einfachen Wartung bietet. In diesem Artikel wird die Verwendung von PHP und Hadoop für die Verarbeitung großer Datenmengen vorgestellt. Was ist HadoopHadoop ist

Welche Münze ist AMP?

Feb 24, 2024 pm 09:16 PM

Welche Münze ist AMP?

Feb 24, 2024 pm 09:16 PM

Was ist AMP Coin? Der AMP-Token wurde 2015 vom Synereo-Team als Haupthandelswährung der Synereo-Plattform erstellt. Ziel des AMP-Tokens ist es, Benutzern durch vielfältige Funktionen und Verwendungsmöglichkeiten ein besseres digitales Wirtschaftserlebnis zu bieten. Zweck des AMP-Tokens Der AMP-Token hat mehrere Rollen und Funktionen in der Synereo-Plattform. Erstens können Benutzer im Rahmen des Kryptowährungs-Belohnungssystems der Plattform AMP-Belohnungen verdienen, indem sie Inhalte teilen und bewerben, ein Mechanismus, der Benutzer dazu ermutigt, aktiver an den Aktivitäten der Plattform teilzunehmen. AMP-Tokens können auch zur Bewerbung und Verbreitung von Inhalten auf der Synereo-Plattform verwendet werden. Benutzer können die Sichtbarkeit ihrer Inhalte auf der Plattform erhöhen, indem sie AMP-Tokens verwenden, um mehr Zuschauer zum Ansehen und Teilen zu bewegen

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Java-Big-Data-Technologie-Stack: Verstehen Sie die Anwendung von Java im Bereich Big Data wie Hadoop, Spark, Kafka usw. Da die Datenmenge weiter zunimmt, ist die Big-Data-Technologie im heutigen Internetzeitalter zu einem heißen Thema geworden. Im Bereich Big Data hören wir oft die Namen Hadoop, Spark, Kafka und andere Technologien. Diese Technologien spielen eine entscheidende Rolle, und Java spielt als weit verbreitete Programmiersprache auch im Bereich Big Data eine große Rolle. Dieser Artikel konzentriert sich auf die Anwendung von Java im Großen und Ganzen

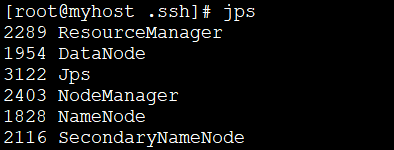

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

1: Installieren Sie JDK1. Führen Sie den folgenden Befehl aus, um das JDK1.8-Installationspaket herunterzuladen. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2. Führen Sie den folgenden Befehl aus, um das heruntergeladene JDK1.8-Installationspaket zu dekomprimieren . tar-zxvfjdk-8u151-linux-x64.tar.gz3. Verschieben Sie das JDK-Paket und benennen Sie es um. mvjdk1.8.0_151//usr/java84. Konfigurieren Sie Java-Umgebungsvariablen. Echo'

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Da die Datenmenge weiter zunimmt, ist die Datenverarbeitung in großem Maßstab zu einem Problem geworden, dem sich Unternehmen stellen und das sie lösen müssen. Herkömmliche relationale Datenbanken können diesen Bedarf nicht mehr decken. Für die Speicherung und Analyse großer Datenmengen sind verteilte Computerplattformen wie Hadoop, Spark und Flink die beste Wahl. Im Auswahlprozess von Datenverarbeitungstools erfreut sich PHP als einfach zu entwickelnde und zu wartende Sprache bei Entwicklern immer größerer Beliebtheit. In diesem Artikel werden wir untersuchen, wie und wie PHP für die Verarbeitung großer Datenmengen genutzt werden kann

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Im aktuellen Internetzeitalter ist die Verarbeitung großer Datenmengen ein Problem, mit dem sich jedes Unternehmen und jede Institution auseinandersetzen muss. Als weit verbreitete Programmiersprache muss PHP auch in der Datenverarbeitung mit der Zeit gehen. Um große Datenmengen effizienter zu verarbeiten, hat die PHP-Entwicklung einige Big-Data-Verarbeitungstools wie Spark und Hadoop eingeführt. Spark ist eine Open-Source-Datenverarbeitungs-Engine, die für die verteilte Verarbeitung großer Datenmengen verwendet werden kann. Das größte Merkmal von Spark ist seine schnelle Datenverarbeitungsgeschwindigkeit und effiziente Datenspeicherung.