Adding Filter in Hadoop Mapper Class

There is my solutions to tackle the disk spaces shortage problem I described in the previous post. The core principle of the solution is to reduce the number of output records at Mapper stage; the method I used is Filter , adding a filter,

There is my solutions to tackle the disk spaces shortage problem I described in the previous post. The core principle of the solution is to reduce the number of output records at Mapper stage; the method I used is Filter, adding a filter, which I will explain later, to decrease the output records of Mapper, which in turn significantly decrease the Mapper’s Spill records, and fundamentally decrease the disk space usages. After applying the filter, with 30,661 records. some 200MB data set as inputs, the total Spill Records is 25,471,725, and it only takes about 509MB disk spaces!

Followed Filter

And now I’m going to reveal what’s kinda Filter it looks like, and how did I accomplish that filter. The true face of the FILTER is called Followed Filter, it filters users from computing co-followed combinations if their followed number does not satisfy a certain number, called Followed Threshold.

Followed Filter is used to reduce the co-followed combinations at Mapper stage. Say we set the followed threshold to 100, meaning users who doesn’t own 100 fans(be followed by 100 other users) will be ignored during co-followed combinations computing stage(to get the actual number of the threshold we need analyze statistics of user’s followed number of our data set).

Reason

Choosing followed filter is reasonable because how many user follows is a metric of user’s popularity/famousness.

HOW

In order to accomplish it, we need:

First, counting user’s followed number among our data set, which needs a new MapReduce Job;

Second, choosing a followed threshold after analyze the statistics perspective of followed number data set got in first step;

Third, using DistrbutedCache of Hadoop to cache users who satisfy the filter to all Mappers;

Forth, adding followed filter to Mapper class, only users satisfy filter condition will be passed into co-followed combination computing phrase;

Fifth, adding co-followed filter/threshold in Reducer side if necessary.

Outcomes

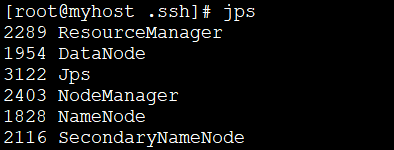

Here is the Hadoop Job Summary, after applying the followed filter with followed threshold of 1000, that means only users who are followed by 1000 users will have the opportunity to co-followed combinations, compared with the Job Summary in my previous post, most all metrics have significant improvements:

| Counter | Map | Reduce | Total |

| Bytes Written | 0 | 1,798,185 | 1,798,185 |

| Bytes Read | 203,401,876 | 0 | 203,401,876 |

| FILE_BYTES_READ | 405,219,906 | 52,107,486 | 457,327,392 |

| HDFS_BYTES_READ | 203,402,751 | 0 | 203,402,751 |

| FILE_BYTES_WRITTEN | 457,707,759 | 52,161,704 | 509,869,463 |

| HDFS_BYTES_WRITTEN | 0 | 1,798,185 | 1,798,185 |

| Reduce input groups | 0 | 373,680 | 373,680 |

| Map output materialized bytes | 52,107,522 | 0 | 52,107,522 |

| Combine output records | 22,202,756 | 0 | 22,202,756 |

| Map input records | 30,661 | 0 | 30,661 |

| Reduce shuffle bytes | 0 | 52,107,522 | 52,107,522 |

| Physical memory (bytes) snapshot | 2,646,589,440 | 116,408,320 | 2,762,997,760 |

| Reduce output records | 0 | 373,680 | 373,680 |

| Spilled Records | 22,866,351 | 2,605,374 | 25,471,725 |

| Map output bytes | 2,115,139,050 | 0 | 2,115,139,050 |

| Total committed heap usage (bytes) | 2,813,853,696 | 84,738,048 | 2,898,591,744 |

| CPU time spent (ms) | 5,766,680 | 11,210 | 5,777,890 |

| Virtual memory (bytes) snapshot | 9,600,737,280 | 1,375,002,624 | 10,975,739,904 |

| SPLIT_RAW_BYTES | 875 | 0 | 875 |

| Map output records | 117,507,725 | 0 | 117,507,725 |

| Combine input records | 137,105,107 | 0 | 137,105,107 |

| Reduce input records | 0 | 2,605,374 | 2,605,374 |

P.S.

Frankly Speaking, chances are I am on the wrong way to Hadoop Programming, since I’m palying Pesudo Distribution Hadoop with my personal computer, which has 4 CUPs and 4G RAM, in real Hadoop Cluster disk spaces might never be a trouble, and all the tuning work I have done may turn into meaningless efforts. Before the Followed Filter, I also did some Hadoop tuning like customed Writable class, RawComparator, block size and io.sort.mb, etc.

---EOF---

原文地址:Adding Filter in Hadoop Mapper Class, 感谢原作者分享。

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet Wenn Sie Hadoop zur Verarbeitung großer Datenmengen verwenden, stoßen Sie häufig auf einige Java-Ausnahmefehler, die sich auf die Ausführung von Aufgaben auswirken und zum Scheitern der Datenverarbeitung führen können. In diesem Artikel werden einige häufige Hadoop-Fehler vorgestellt und Möglichkeiten aufgezeigt, mit ihnen umzugehen und sie zu vermeiden. Java.lang.OutOfMemoryErrorOutOfMemoryError ist ein Fehler, der durch unzureichenden Speicher der Java Virtual Machine verursacht wird. Wenn Hadoop ist

So lösen Sie das Problem, dass leere Mapper automatisch in das Idee-SpringBoot-Projekt eingefügt werden

May 17, 2023 pm 06:49 PM

So lösen Sie das Problem, dass leere Mapper automatisch in das Idee-SpringBoot-Projekt eingefügt werden

May 17, 2023 pm 06:49 PM

Wenn im SpringBoot-Projekt MyBatis als Persistenzschicht-Framework verwendet wird, kann es bei Verwendung der automatischen Injektion zu dem Problem kommen, dass der Mapper eine Nullzeiger-Ausnahme meldet. Dies liegt daran, dass SpringBoot die Mapper-Schnittstelle von MyBatis während der automatischen Injektion nicht korrekt identifizieren kann und einige zusätzliche Konfigurationen erfordert. Es gibt zwei Möglichkeiten, dieses Problem zu lösen: 1. Fügen Sie der Mapper-Schnittstelle die Annotation @Mapper hinzu, um SpringBoot mitzuteilen, dass es sich bei dieser Schnittstelle um eine Mapper-Schnittstelle handelt und ein Proxy erforderlich ist. Ein Beispiel lautet wie folgt: @MapperpublicinterfaceUserMapper{//...}2

![So beheben Sie den Fehler „[Vue-Warnung]: Fehler beim Auflösen des Filters'.](https://img.php.cn/upload/article/000/887/227/169243040583797.jpg?x-oss-process=image/resize,m_fill,h_207,w_330) So beheben Sie den Fehler „[Vue-Warnung]: Fehler beim Auflösen des Filters'.

Aug 19, 2023 pm 03:33 PM

So beheben Sie den Fehler „[Vue-Warnung]: Fehler beim Auflösen des Filters'.

Aug 19, 2023 pm 03:33 PM

Methoden zur Behebung des Fehlers „[Vuewarn]:Failedtoresolvefilter“ Während des Entwicklungsprozesses mit Vue stoßen wir manchmal auf eine Fehlermeldung: „[Vuewarn]:Failedtoresolvefilter“. Diese Fehlermeldung tritt normalerweise auf, wenn wir in der Vorlage einen undefinierten Filter verwenden. In diesem Artikel wird erläutert, wie dieser Fehler behoben werden kann, und es werden entsprechende Codebeispiele aufgeführt. Wenn wir in Vue sind

Wie gibt Springboot den Mapper-Datei-Scanpfad in Mybatis an?

May 17, 2023 pm 10:25 PM

Wie gibt Springboot den Mapper-Datei-Scanpfad in Mybatis an?

May 17, 2023 pm 10:25 PM

Geben Sie alle Mapper-Zuordnungsdateien im Mapper-Datei-Scanpfad in mybatis mybatis.mapper-locations=classpath*:com/springboot/mapper/*.xml oder Mapper-Zuordnungsdateien unter der Ressource mybatis.mapper-locations=classpath*:mapper/** an. /*.xmlmybatis konfiguriert mehrere Scanpfade, aber es ist sehr chaotisch: Ich habe das Projekt kürzlich demontiert und bin auf ein kleines Problem gestoßen:

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Mit dem Aufkommen des Big-Data-Zeitalters sind Datenverarbeitung und -speicherung immer wichtiger geworden und die effiziente Verwaltung und Analyse großer Datenmengen ist für Unternehmen zu einer Herausforderung geworden. Hadoop und HBase, zwei Projekte der Apache Foundation, bieten eine Lösung für die Speicherung und Analyse großer Datenmengen. In diesem Artikel wird erläutert, wie Sie Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen verwenden. 1. Einführung in Hadoop und HBase Hadoop ist ein verteiltes Open-Source-Speicher- und Computersystem, das dies kann

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Da die Datenmenge weiter zunimmt, sind herkömmliche Datenverarbeitungsmethoden den Herausforderungen des Big-Data-Zeitalters nicht mehr gewachsen. Hadoop ist ein Open-Source-Framework für verteiltes Computing, das das Leistungsengpassproblem löst, das durch Einzelknotenserver bei der Verarbeitung großer Datenmengen verursacht wird, indem große Datenmengen verteilt gespeichert und verarbeitet werden. PHP ist eine Skriptsprache, die in der Webentwicklung weit verbreitet ist und die Vorteile einer schnellen Entwicklung und einfachen Wartung bietet. In diesem Artikel wird die Verwendung von PHP und Hadoop für die Verarbeitung großer Datenmengen vorgestellt. Was ist HadoopHadoop ist

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Java-Big-Data-Technologie-Stack: Verstehen Sie die Anwendung von Java im Bereich Big Data wie Hadoop, Spark, Kafka usw. Da die Datenmenge weiter zunimmt, ist die Big-Data-Technologie im heutigen Internetzeitalter zu einem heißen Thema geworden. Im Bereich Big Data hören wir oft die Namen Hadoop, Spark, Kafka und andere Technologien. Diese Technologien spielen eine entscheidende Rolle, und Java spielt als weit verbreitete Programmiersprache auch im Bereich Big Data eine große Rolle. Dieser Artikel konzentriert sich auf die Anwendung von Java im Großen und Ganzen

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

1: Installieren Sie JDK1. Führen Sie den folgenden Befehl aus, um das JDK1.8-Installationspaket herunterzuladen. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2. Führen Sie den folgenden Befehl aus, um das heruntergeladene JDK1.8-Installationspaket zu dekomprimieren . tar-zxvfjdk-8u151-linux-x64.tar.gz3. Verschieben Sie das JDK-Paket und benennen Sie es um. mvjdk1.8.0_151//usr/java84. Konfigurieren Sie Java-Umgebungsvariablen. Echo'