Mongodb 数据架构与表结构建模 分享

下面是我之前在公司内进行的有关Mongodb 数据架构与表结构建模的分享PPT。 Mongodb Data model schema design 主要从 Instance dbs collections document 四个层面来进行分享。 只看PPT会有些粗略,周末会加上详细解说做成视频,进行分享。 原文地址:Mongod

下面是我之前在公司内进行的有关Mongodb 数据架构与表结构建模的分享PPT。

Mongodb Data model & schema design

主要从

- Instance

- dbs

- collections

- document

四个层面来进行分享。

只看PPT会有些粗略,周末会加上详细解说做成视频,进行分享。

原文地址:Mongodb 数据架构与表结构建模 分享, 感谢原作者分享。

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

KI-Startups wechselten gemeinsam ihre Jobs zu OpenAI, und das Sicherheitsteam formierte sich neu, nachdem Ilya gegangen war!

Jun 08, 2024 pm 01:00 PM

KI-Startups wechselten gemeinsam ihre Jobs zu OpenAI, und das Sicherheitsteam formierte sich neu, nachdem Ilya gegangen war!

Jun 08, 2024 pm 01:00 PM

Letzte Woche wurde OpenAI inmitten der Welle interner Kündigungen und externer Kritik von internen und externen Problemen geplagt: - Der Verstoß gegen die Schwester der Witwe löste weltweit hitzige Diskussionen aus - Mitarbeiter, die „Overlord-Klauseln“ unterzeichneten, wurden einer nach dem anderen entlarvt – Internetnutzer listeten Ultramans „ Sieben Todsünden“ – Gerüchtebekämpfung: Laut durchgesickerten Informationen und Dokumenten, die Vox erhalten hat, war sich die leitende Führung von OpenAI, darunter Altman, dieser Eigenkapitalrückgewinnungsbestimmungen wohl bewusst und hat ihnen zugestimmt. Darüber hinaus steht OpenAI vor einem ernsten und dringenden Problem – der KI-Sicherheit. Die jüngsten Abgänge von fünf sicherheitsrelevanten Mitarbeitern, darunter zwei der prominentesten Mitarbeiter, und die Auflösung des „Super Alignment“-Teams haben die Sicherheitsprobleme von OpenAI erneut ins Rampenlicht gerückt. Das Fortune-Magazin berichtete, dass OpenA

Wie steil ist die Lernkurve der Golang-Framework-Architektur?

Jun 05, 2024 pm 06:59 PM

Wie steil ist die Lernkurve der Golang-Framework-Architektur?

Jun 05, 2024 pm 06:59 PM

Die Lernkurve der Go-Framework-Architektur hängt von der Vertrautheit mit der Go-Sprache und der Backend-Entwicklung sowie der Komplexität des gewählten Frameworks ab: einem guten Verständnis der Grundlagen der Go-Sprache. Es ist hilfreich, Erfahrung in der Backend-Entwicklung zu haben. Frameworks mit unterschiedlicher Komplexität führen zu unterschiedlichen Lernkurven.

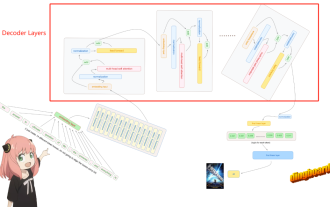

Handzerreißen von Llama3 Schicht 1: Implementierung von llama3 von Grund auf

Jun 01, 2024 pm 05:45 PM

Handzerreißen von Llama3 Schicht 1: Implementierung von llama3 von Grund auf

Jun 01, 2024 pm 05:45 PM

1. Architektur von Llama3 In dieser Artikelserie implementieren wir llama3 von Grund auf. Die Gesamtarchitektur von Llama3: Stellen Sie sich die Modellparameter von Llama3 vor: Werfen wir einen Blick auf die tatsächlichen Werte dieser Parameter im Llama3-Modell. Bild [1] Kontextfenster (Kontextfenster) Beim Instanziieren der LlaMa-Klasse definiert die Variable max_seq_len das Kontextfenster. Es gibt andere Parameter in der Klasse, aber dieser Parameter steht in direktem Zusammenhang mit dem Transformatormodell. Die max_seq_len beträgt hier 8K. Bild [2] Wortschatzgröße und AufmerksamkeitL

Das 70B-Modell generiert 1.000 Token in Sekunden, das Umschreiben des Codes übertrifft GPT-4o, vom Cursor-Team, einem von OpenAI investierten Code-Artefakt

Jun 13, 2024 pm 03:47 PM

Das 70B-Modell generiert 1.000 Token in Sekunden, das Umschreiben des Codes übertrifft GPT-4o, vom Cursor-Team, einem von OpenAI investierten Code-Artefakt

Jun 13, 2024 pm 03:47 PM

Beim Modell 70B können 1000 Token in Sekunden generiert werden, was fast 4000 Zeichen entspricht! Die Forscher haben Llama3 verfeinert und einen Beschleunigungsalgorithmus eingeführt. Im Vergleich zur nativen Version ist die Geschwindigkeit 13-mal höher! Es ist nicht nur schnell, seine Leistung bei Code-Rewriting-Aufgaben übertrifft sogar GPT-4o. Diese Errungenschaft stammt von anysphere, dem Team hinter dem beliebten KI-Programmierartefakt Cursor, und auch OpenAI beteiligte sich an der Investition. Sie müssen wissen, dass bei Groq, einem bekannten Framework zur schnellen Inferenzbeschleunigung, die Inferenzgeschwindigkeit von 70BLlama3 nur mehr als 300 Token pro Sekunde beträgt. Aufgrund der Geschwindigkeit von Cursor kann man sagen, dass eine nahezu sofortige vollständige Bearbeitung der Codedatei möglich ist. Manche Leute nennen es einen guten Kerl, wenn man Curs sagt

Rezension! Fassen Sie umfassend die wichtige Rolle von Basismodellen bei der Förderung des autonomen Fahrens zusammen

Jun 11, 2024 pm 05:29 PM

Rezension! Fassen Sie umfassend die wichtige Rolle von Basismodellen bei der Förderung des autonomen Fahrens zusammen

Jun 11, 2024 pm 05:29 PM

Oben geschrieben und das persönliche Verständnis des Autors: Mit der Entwicklung und den Durchbrüchen der Deep-Learning-Technologie haben kürzlich groß angelegte Grundlagenmodelle (Foundation Models) bedeutende Ergebnisse in den Bereichen natürlicher Sprachverarbeitung und Computer Vision erzielt. Große Entwicklungsperspektiven bietet auch die Anwendung von Basismodellen beim autonomen Fahren, die das Verständnis und die Argumentation von Szenarien verbessern können. Durch Vortraining mit umfangreichen Sprach- und visuellen Daten kann das Basismodell verschiedene Elemente in autonomen Fahrszenarien verstehen und interpretieren und Schlussfolgerungen ziehen, indem es Sprach- und Aktionsbefehle für die Entscheidungsfindung und Planung im Fahrbetrieb bereitstellt. Das Basismodell kann durch Datenergänzung mit einem Verständnis des Fahrszenarios ergänzt werden, um jene seltenen realisierbaren Merkmale in Long-Tail-Verteilungen bereitzustellen, die bei routinemäßigem Fahren und bei der Datenerfassung unwahrscheinlich anzutreffen sind.

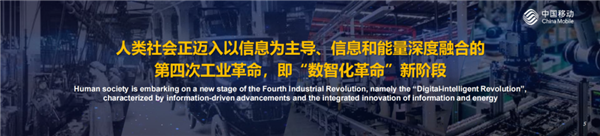

China Mobile: Die Menschheit tritt in die vierte industrielle Revolution ein und kündigte offiziell „drei Pläne' an

Jun 27, 2024 am 10:29 AM

China Mobile: Die Menschheit tritt in die vierte industrielle Revolution ein und kündigte offiziell „drei Pläne' an

Jun 27, 2024 am 10:29 AM

Laut Nachrichten vom 26. Juni hielt Yang Jie, Vorsitzender von China Mobile, bei der Eröffnungszeremonie der World Mobile Communications Conference Shanghai (MWC Shanghai) 2024 eine Rede. Er sagte, dass die menschliche Gesellschaft derzeit in die vierte industrielle Revolution eintritt, die von Informationen dominiert und tief in Informationen und Energie integriert ist, d. h. die „Revolution der digitalen Intelligenz“, und dass sich die Bildung neuer Produktivkräfte beschleunigt. Yang Jie glaubt, dass jede Runde der industriellen Revolution darauf basiert, von der „Mechanisierungsrevolution“, angetrieben durch Dampfmaschinen, über die „Elektrifizierungsrevolution“, angetrieben durch Elektrizität und Verbrennungsmotoren, bis hin zur „Informationsrevolution“, angetrieben durch Computer und das Internet „Information und „Energie“ ist die Hauptlinie, die Produktivitätsentwicklung bringt

Ein amerikanischer Professor trainierte mit seiner zweijährigen Tochter ein KI-Modell für den Auftritt in „Science'! Junge Menschen nutzen am Kopf angebrachte Kameras, um neue KI zu trainieren

Jun 03, 2024 am 10:08 AM

Ein amerikanischer Professor trainierte mit seiner zweijährigen Tochter ein KI-Modell für den Auftritt in „Science'! Junge Menschen nutzen am Kopf angebrachte Kameras, um neue KI zu trainieren

Jun 03, 2024 am 10:08 AM

Unglaublich: Um ein KI-Modell zu trainieren, befestigte ein Professor der State University of New York seiner Tochter eine GoPro-ähnliche Kamera an den Kopf! Obwohl es unglaublich klingt, ist das Verhalten dieses Professors tatsächlich begründet. Um das komplexe neuronale Netzwerk hinter LLM zu trainieren, sind umfangreiche Daten erforderlich. Ist unser aktueller LLM-Ausbildungsprozess unbedingt der einfachste und effizienteste Weg? Sicherlich nicht! Wissenschaftler haben herausgefunden, dass das Gehirn von Kleinkindern wie ein Schwamm Wasser aufnimmt und so schnell ein zusammenhängendes Weltbild bildet. Obwohl LLM zeitweise erstaunliche Leistungen erbringt, werden menschliche Kinder mit der Zeit schlauer und kreativer als das Modell! Das Geheimnis, dass Kinder die Sprache besser trainieren. Wenn Wissenschaftler über die Lösung verwirrt sind,

Die Insidergeschichte des Suchalgorithmus von Google wurde enthüllt und 2.500 Seiten mit Dokumenten mit echten Namen wurden durchgesickert! Such-Ranking-Lügen aufgedeckt

Jun 11, 2024 am 09:14 AM

Die Insidergeschichte des Suchalgorithmus von Google wurde enthüllt und 2.500 Seiten mit Dokumenten mit echten Namen wurden durchgesickert! Such-Ranking-Lügen aufgedeckt

Jun 11, 2024 am 09:14 AM

Kürzlich wurden 2.500 Seiten interner Google-Dokumente durchgesickert und enthüllten, wie die Suche, „der mächtigste Schiedsrichter im Internet“, funktioniert. Der Mitbegründer und CEO von SparkToro ist eine anonyme Person. Er veröffentlichte einen Blog-Beitrag auf seiner persönlichen Website, in dem er behauptete, dass „eine anonyme Person mit mir Tausende von Seiten durchgesickerter Google Search API-Dokumentation geteilt hat, die jeder im SEO lesen sollte.“ ! „RandFishkin ist seit vielen Jahren der führende Sprecher im Bereich SEO (Suchmaschinenoptimierung), und er hat das Konzept der „Website-Autorität“ (DomainRating) vorgeschlagen. Da er auf diesem Gebiet hohes Ansehen genießt, RandFishkin