Hallo Leute, ich bin Luga, heute werden wir über Technologien im Zusammenhang mit dem ökologischen Bereich der künstlichen Intelligenz (KI) sprechen – LLM-Bewertung.

Wie wir alle wissen, ist die LLM-Evaluation ein wichtiges Thema im Bereich der künstlichen Intelligenz. Da LLMs in verschiedenen Szenarien immer häufiger eingesetzt werden, wird es immer wichtiger, ihre Fähigkeiten und Grenzen zu bewerten. Als aufstrebendes LLM-Bewertungstool zielt ArthurBench darauf ab, eine umfassende, faire und wiederholbare Bewertungsplattform für KI-Forscher und -Entwickler bereitzustellen.

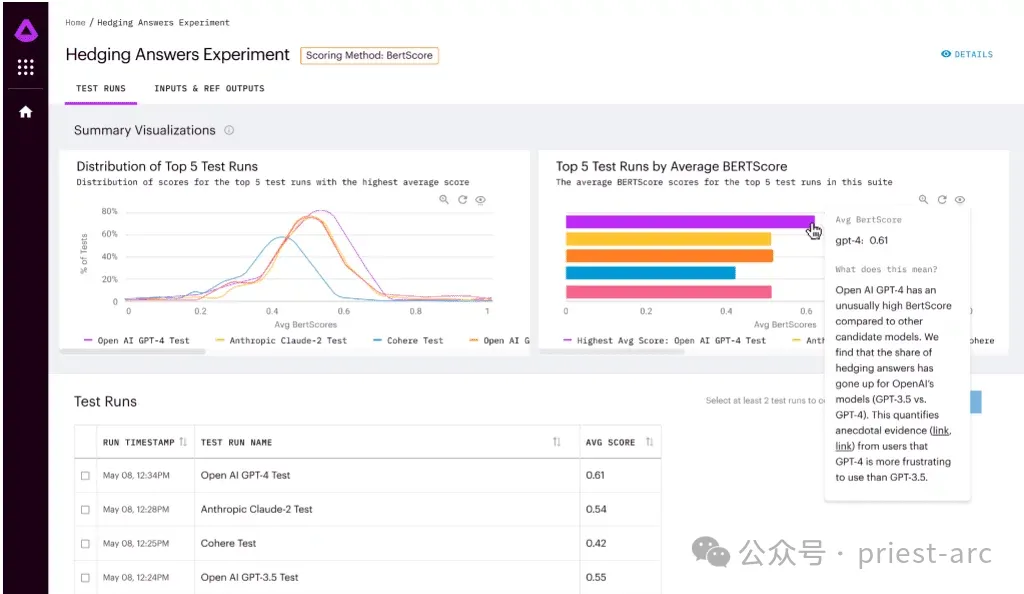

In den letzten Jahren sind traditionelle Textbewertungsmethoden aufgrund der rasanten Entwicklung und Verbesserung großer Sprachmodelle (LLM) in einigen Aspekten möglicherweise nicht mehr anwendbar. Im Bereich der Textbewertung haben wir möglicherweise von einigen Methoden gehört, z. B. von Bewertungsmethoden, die auf „Wortvorkommnissen“ basieren, wie BLEU, und Bewertungsmethoden, die auf „vorab trainierten natürlichen Sprachverarbeitungsmodellen“ basieren, wie z. B. BERTScore. Diese neuen Bewertungsmethoden ermöglichen eine genauere Beurteilung der Qualität und Relevanz von Texten. Beispielsweise bewertet die BLEU-Bewertungsmethode die Übersetzungsqualität anhand des Vorkommensgrads von Standardwörtern, während die BERTScore-Bewertungsmethode die Relevanz von Text anhand der Fähigkeit eines vorab trainierten Verarbeitungsmodells für natürliche Sprache bewertet, die Verarbeitung von Sätzen in natürlicher Sprache zu simulieren. Diese neuen Bewertungsmethoden lösen bis zu einem gewissen Grad einige der Probleme traditioneller Methoden und weisen eine höhere Flexibilität und Genauigkeit auf. Mit der kontinuierlichen Weiterentwicklung und Verbesserung von Sprachmodellen waren diese Methoden in der Vergangenheit jedoch sehr gut, aber mit der Weiterentwicklung der ökologischen Technologie von LLM erweist sie sich als etwas unzureichend und kann die aktuellen Anforderungen nicht vollständig erfüllen.

Mit der rasanten Entwicklung und Verbesserung des LLM stehen wir vor neuen Herausforderungen und Chancen. Die Fähigkeiten und Leistungsniveaus von LLMs nehmen weiter zu, sodass es möglich ist, dass auf Wortvorkommnissen basierende Bewertungsmethoden wie BLEU die Qualität und semantische Genauigkeit von LLM-generiertem Text möglicherweise nicht vollständig erfassen. LLM erzeugt flüssigeren, kohärenteren und semantisch reichhaltigeren Text – Vorteile, die herkömmliche, auf dem Vorkommen von Wörtern basierende Bewertungsmethoden nicht genau messen können.

Bewertungsmethoden für vorab trainierte Modelle (wie BERTScore) können bei der Bewältigung spezifischer Aufgaben vor einigen Herausforderungen stehen. Obwohl vorab trainierte Modelle bei vielen Aufgaben eine gute Leistung erbringen, berücksichtigen sie möglicherweise nicht vollständig die einzigartigen Eigenschaften von LLM und seine Leistung bei bestimmten Aufgaben. Wenn man sich daher ausschließlich auf Bewertungsmethoden verlässt, die auf vorab trainierten Modellen basieren, kann es sein, dass die Fähigkeiten von LLM nicht vollständig bewertet werden.

2. Warum ist eine LLM-Beratungsbewertung erforderlich?

1. Effizient

2. Sensibilität

Wie wir bereits besprochen haben, sind LLM-Evaluatoren im Vergleich zu anderen Evaluierungsmethoden sensibler. Es gibt viele verschiedene Möglichkeiten, LLM als Evaluator zu konfigurieren, und sein Verhalten kann je nach gewählter Konfiguration stark variieren. Eine weitere Herausforderung besteht darin, dass LLM-Evaluatoren stecken bleiben können, wenn die Bewertung zu viele Inferenzschritte umfasst oder die gleichzeitige Verarbeitung zu vieler Variablen erfordert.

Aufgrund der Eigenschaften von LLM können seine Bewertungsergebnisse durch unterschiedliche Konfigurationen und Parametereinstellungen beeinflusst werden. Das bedeutet, dass bei der Bewertung von LLMs das Modell sorgfältig ausgewählt und konfiguriert werden muss, um sicherzustellen, dass es sich wie erwartet verhält. Unterschiedliche Konfigurationen können zu unterschiedlichen Ausgabeergebnissen führen. Daher muss der Bewerter einige Zeit und Mühe aufwenden, um die Einstellungen des LLM anzupassen und zu optimieren, um genaue und zuverlässige Bewertungsergebnisse zu erhalten.

Darüber hinaus können Evaluatoren vor einigen Herausforderungen stehen, wenn sie mit Bewertungsaufgaben konfrontiert werden, die komplexe Überlegungen oder die gleichzeitige Verarbeitung mehrerer Variablen erfordern. Dies liegt daran, dass die Argumentationsfähigkeit von LLM bei der Bewältigung komplexer Situationen eingeschränkt sein kann. Das LLM erfordert möglicherweise zusätzliche Anstrengungen zur Bewältigung dieser Aufgaben, um die Genauigkeit und Zuverlässigkeit der Bewertung sicherzustellen.

Arthur Bench ist ein Open-Source-Bewertungstool zum Vergleich der Leistung generativer Textmodelle (LLM). Es kann verwendet werden, um verschiedene LLM-Modelle, Hinweise und Hyperparameter zu bewerten und detaillierte Berichte über die LLM-Leistung bei verschiedenen Aufgaben bereitzustellen.

Zu den wichtigsten Funktionen von Arthur Bench gehören:

Im Allgemeinen umfasst der Arthur Bench-Workflow hauptsächlich die folgenden Phasen, und die detaillierte Analyse ist wie folgt:

In dieser Phase müssen wir unsere Bewertungsziele klären. Arthur Bench unterstützt Mehrere Eine Vielzahl von Bewertungsaufgaben, darunter:

In dieser Phase besteht die Hauptarbeit darin, die Bewertungsobjekte auszuwählen. Arthur Bench unterstützt eine Vielzahl von LLM-Modellen und deckt führende Technologien bekannter Institutionen wie OpenAI, Google AI, Microsoft usw. ab, wie GPT-3, LaMDA, Megatron-Turing NLG usw. Je nach Forschungsbedarf können wir spezifische Modelle zur Evaluierung auswählen.

Nach Abschluss der Modellauswahl besteht der nächste Schritt darin, eine verfeinerte Steuerung durchzuführen. Um die LLM-Leistung genauer zu bewerten, ermöglicht Arthur Bench Benutzern die Konfiguration von Hinweisen und Hyperparametern.

Durch eine verfeinerte Konfiguration können wir die Leistungsunterschiede von LLM unter verschiedenen Parametereinstellungen eingehend untersuchen und Bewertungsergebnisse mit mehr Referenzwert erhalten.

Der letzte Schritt besteht darin, die Aufgabenbewertung mithilfe automatisierter Prozesse durchzuführen. Typischerweise bietet Arthur Bench einen automatisierten Bewertungsprozess, der eine einfache Konfiguration zum Ausführen von Bewertungsaufgaben erfordert. Die folgenden Schritte werden automatisch ausgeführt:

Als Schlüssel zur schnellen, datengesteuerten LLM-Bewertung bietet Arthur Bench hauptsächlich die folgenden Lösungen, insbesondere:

Arthur Bench wird sein Fachwissen und seine Erfahrung nutzen, um jede LLM-Option zu bewerten und sicherzustellen, dass konsistente Kennzahlen zum Vergleich ihrer Stärken und Schwächen verwendet werden. Er wird Faktoren wie Modellleistung, Genauigkeit, Geschwindigkeit, Ressourcenanforderungen und mehr berücksichtigen, um sicherzustellen, dass Unternehmen fundierte und klare Entscheidungen treffen können.

Arthur Bench wird sein Fachwissen und seine Erfahrung nutzen, um jede LLM-Option zu bewerten und sicherzustellen, dass konsistente Kennzahlen zum Vergleich ihrer Stärken und Schwächen verwendet werden. Er wird Faktoren wie Modellleistung, Genauigkeit, Geschwindigkeit, Ressourcenanforderungen und mehr berücksichtigen, um sicherzustellen, dass Unternehmen fundierte und klare Entscheidungen treffen können.

Durch die Verwendung konsistenter Metriken und Bewertungsmethoden stellt Arthur Bench Unternehmen einen zuverlässigen Vergleichsrahmen zur Verfügung, der es ihnen ermöglicht, die Vorteile und Einschränkungen jeder LLM-Option vollständig zu bewerten. Dies wird es Unternehmen ermöglichen, fundierte Entscheidungen zu treffen, um die rasanten Fortschritte in der künstlichen Intelligenz zu maximieren und die bestmögliche Erfahrung mit ihren Anwendungen sicherzustellen.

2. Budget- und Datenschutzoptimierung

Dieser Ansatz zur Budgetoptimierung kann Unternehmen dabei helfen, trotz begrenzter Ressourcen kluge Entscheidungen zu treffen. Anstatt sich für das teuerste oder modernste Modell zu entscheiden, wählen Sie das richtige Modell basierend auf Ihren spezifischen Anforderungen. Die günstigeren Modelle schneiden in einigen Aspekten möglicherweise etwas schlechter ab als hochmoderne LLMs, aber für einige einfache oder Standardaufgaben kann Arthur Bench dennoch eine Lösung bieten, die den Anforderungen entspricht.

Darüber hinaus betonte Arthur Bench, dass die interne Einführung des Modells eine bessere Kontrolle über den Datenschutz ermöglicht. Bei Anwendungen, die sensible Daten oder Datenschutzprobleme betreffen, ziehen es Unternehmen möglicherweise vor, ihre eigenen intern geschulten Modelle zu verwenden, anstatt sich auf externe LLMs von Drittanbietern zu verlassen. Durch den Einsatz interner Modelle können Unternehmen eine größere Kontrolle über die Datenverarbeitung und -speicherung erlangen und den Datenschutz besser schützen.

Akademische Benchmarks beziehen sich auf Modellbewertungsmetriken und -methoden, die in der akademischen Forschung etabliert sind. Diese Indikatoren und Methoden sind in der Regel spezifisch für eine bestimmte Aufgabe oder Domäne und können die Leistung des Modells in dieser Aufgabe oder Domäne effektiv bewerten.

Akademische Benchmarks spiegeln jedoch nicht immer direkt die Leistung eines Modells in der realen Welt wider. Dies liegt daran, dass Anwendungsszenarien in der realen Welt häufig komplexer sind und die Berücksichtigung weiterer Faktoren erfordern, wie z. B. Datenverteilung, Modellbereitstellungsumgebung usw.

Arthur Bench hilft dabei, akademische Maßstäbe in reale Leistungen umzusetzen. Dieses Ziel wird auf folgende Weise erreicht:

Als Schlüssel zu einer schnellen, datengesteuerten LLM-Bewertung verfügt Arthur Bench über die folgenden Funktionen:

Der Umfang dieser Bewertungsindikatoren ist sehr breit und umfasst unter anderem Zusammenfassungsqualität, Genauigkeit, Sprachkompetenz, grammatikalische Korrektheit, Kontextverständnisfähigkeit, logische Kohärenz usw. Arthur Bench bewertet jedes Modell anhand dieser Kennzahlen und kombiniert die Ergebnisse zu einer umfassenden Bewertung, um Unternehmen dabei zu unterstützen, fundierte Entscheidungen zu treffen.

Darüber hinaus kann Arthur Bench, wenn das Unternehmen spezifische Bedürfnisse oder Bedenken hat, auch benutzerdefinierte Bewertungsmetriken erstellen und hinzufügen, die auf den Anforderungen des Unternehmens basieren. Dies geschieht, um den spezifischen Bedürfnissen des Unternehmens besser gerecht zu werden und sicherzustellen, dass der Bewertungsprozess mit den Zielen und Standards des Unternehmens übereinstimmt.

2. Lokale und cloudbasierte Versionen

2. Lokale und cloudbasierte Versionen

Andererseits werden für Benutzer, die Komfort und Flexibilität bevorzugen, auch Cloud-basierte SaaS-Produkte bereitgestellt. Sie können sich registrieren, um über die Cloud auf Arthur Bench zuzugreifen und es zu nutzen. Diese Methode macht eine umständliche lokale Installation und Konfiguration überflüssig und ermöglicht Ihnen die sofortige Nutzung der bereitgestellten Funktionen und Dienste.

3. Vollständig Open Source

Kurz gesagt bietet Arthur Bench ein offenes und flexibles Framework, das es Benutzern ermöglicht, Bewertungsindikatoren anzupassen, und das im Finanzbereich weit verbreitet ist. Partnerschaften mit Amazon Web Services und Cohere bringen das Framework weiter voran und ermutigen Entwickler, neue Metriken für Bench zu erstellen und zu Fortschritten im Bereich der Sprachmodellbewertung beizutragen.

Referenz:

[1] https://github.com/arthur-ai/benchDas obige ist der detaillierte Inhalt vonVerstehen Sie das LLM-Bewertungsrahmenwerk von Arthur Bench in einem Artikel. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Anwendung künstlicher Intelligenz im Leben

Anwendung künstlicher Intelligenz im Leben

Was ist das Grundkonzept der künstlichen Intelligenz?

Was ist das Grundkonzept der künstlichen Intelligenz?

Python in ausführbare Datei gepackt

Python in ausführbare Datei gepackt

Ethereum-Preisangebote

Ethereum-Preisangebote

So verwenden Sie dc.rectangle

So verwenden Sie dc.rectangle

Verwendung der Matlab-Colormap-Funktion

Verwendung der Matlab-Colormap-Funktion

Der Unterschied zwischen der bidirektionalen Bindung von vue2 und vue3

Der Unterschied zwischen der bidirektionalen Bindung von vue2 und vue3

Was bedeutet Element?

Was bedeutet Element?