Die beste Kombination aus Java-Framework und Big-Data-Analyse

Für eine effektive Big-Data-Analyse gibt es mehrere empfohlene Optionen für Java-Frameworks: Apache Spark: Distributed-Computing-Framework für die schnelle und umfangreiche Verarbeitung von Daten. Apache Hadoop: Ein verteiltes Dateisystem und Datenverarbeitungs-Framework zum Speichern und Verwalten riesiger Datenmengen. Apache Flink: Ein verteiltes Stream-Verarbeitungsframework für die Echtzeitanalyse sich schnell bewegender Datenströme. Apache Storm: Ein verteiltes fehlertolerantes Stream-Verarbeitungsframework zur Verarbeitung komplexer Ereignisse.

Die beste Kombination aus Java-Framework und Big-Data-Analyse

Einführung

Big-Data-Analyse ist zu einem unverzichtbaren Bestandteil moderner Unternehmen geworden. Um große Datenmengen effektiv verarbeiten und analysieren zu können, ist die Wahl des richtigen Java-Frameworks entscheidend. In diesem Artikel wird die beste Kombination aus Java-Frameworks und Big-Data-Analyse untersucht und deren Anwendung anhand praktischer Fälle demonstriert.

Java Framework

Beim Umgang mit großen Datenmengen kann die Auswahl des richtigen Java-Frameworks die Effizienz und Leistung erheblich verbessern. Hier sind einige empfohlene Optionen:

- Apache Spark: Ein verteiltes Computer-Framework für die schnelle und umfassende Verarbeitung großer Datenmengen.

- Apache Hadoop: Ein verteiltes Dateisystem und Datenverarbeitungs-Framework zum Speichern und Verwalten riesiger Datenmengen.

- Apache Flink: Ein verteiltes Stream-Verarbeitungsframework für die Echtzeitanalyse sich schnell bewegender Datenströme.

- Apache Storm: Ein verteiltes fehlertolerantes Stream-Verarbeitungs-Framework zur Verarbeitung komplexer Ereignisse.

Praktischer Fall

Verwendung von Spark für Big-Data-Analysen

Das folgende Beispiel zeigt, wie Sie Spark zum Lesen und Schreiben von Daten und zum Durchführen von Analyseaufgaben verwenden:

import org.apache.spark.sql.SparkSession;

public class SparkExample {

public static void main(String[] args) {

SparkSession spark = SparkSession.builder().appName("SparkExample").getOrCreate();

// 读取 CSV 数据文件

DataFrame df = spark.read().csv("data.csv");

// 执行分析操作

df.groupBy("column_name").count().show();

// 写入结果到文件

df.write().csv("output.csv");

}

}Verwenden Sie Hadoop zum Speichern und Verwalten von Daten

Das folgende Beispiel zeigt, wie Sie Hadoop zum Speichern von Daten in HDFS verwenden:

import org.apache.hadoop.conf.Configuration;

import org.apache.hadoop.fs.FSDataOutputStream;

import org.apache.hadoop.fs.FileSystem;

import org.apache.hadoop.fs.Path;

public class HadoopExample {

public static void main(String[] args) {

Configuration conf = new Configuration();

FileSystem fs = FileSystem.get(conf);

Path path = new Path("hdfs://path/to/data.csv");

FSDataOutputStream out = fs.create(path);

// 写入数据到文件

out.write("data to be stored".getBytes());

out.close();

}

}Flink für Echtzeit-Stream-Verarbeitung verwenden

Das folgende Beispiel zeigt, wie Sie Flink zum Streamen von Echtzeit-Datenströmen verwenden:

import org.apache.flink.api.common.functions.FlatMapFunction;

import org.apache.flink.streaming.api.datastream.DataStream;

import org.apache.flink.streaming.api.environment.StreamExecutionEnvironment;

public class FlinkExample {

public static void main(String[] args) throws Exception {

StreamExecutionEnvironment env = StreamExecutionEnvironment.getExecutionEnvironment();

// 创建源,产生实时数据流

DataStream<String> inputStream = env.fromElements("data1", "data2", "data3");

// 执行流处理操作

inputStream.flatMap((FlatMapFunction<String, String>) (s, collector) -> collector.collect(s))

.print();

env.execute();

}

}Fazit

Java Framework und Big Data Der beste Analysemix hängt von den spezifischen Anforderungen und Anwendungsfällen ab. Durch die Wahl des richtigen Frameworks können Unternehmen Big Data effektiv verarbeiten und analysieren, wertvolle Erkenntnisse gewinnen und die Entscheidungsfindung verbessern.

Das obige ist der detaillierte Inhalt vonDie beste Kombination aus Java-Framework und Big-Data-Analyse. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1384

1384

52

52

Perfekte Zahl in Java

Aug 30, 2024 pm 04:28 PM

Perfekte Zahl in Java

Aug 30, 2024 pm 04:28 PM

Leitfaden zur perfekten Zahl in Java. Hier besprechen wir die Definition, Wie prüft man die perfekte Zahl in Java?, Beispiele mit Code-Implementierung.

Weka in Java

Aug 30, 2024 pm 04:28 PM

Weka in Java

Aug 30, 2024 pm 04:28 PM

Leitfaden für Weka in Java. Hier besprechen wir die Einführung, die Verwendung von Weka Java, die Art der Plattform und die Vorteile anhand von Beispielen.

Smith-Nummer in Java

Aug 30, 2024 pm 04:28 PM

Smith-Nummer in Java

Aug 30, 2024 pm 04:28 PM

Leitfaden zur Smith-Zahl in Java. Hier besprechen wir die Definition: Wie überprüft man die Smith-Nummer in Java? Beispiel mit Code-Implementierung.

Fragen zum Java Spring-Interview

Aug 30, 2024 pm 04:29 PM

Fragen zum Java Spring-Interview

Aug 30, 2024 pm 04:29 PM

In diesem Artikel haben wir die am häufigsten gestellten Fragen zu Java Spring-Interviews mit ihren detaillierten Antworten zusammengestellt. Damit Sie das Interview knacken können.

Brechen oder aus Java 8 Stream foreach zurückkehren?

Feb 07, 2025 pm 12:09 PM

Brechen oder aus Java 8 Stream foreach zurückkehren?

Feb 07, 2025 pm 12:09 PM

Java 8 führt die Stream -API ein und bietet eine leistungsstarke und ausdrucksstarke Möglichkeit, Datensammlungen zu verarbeiten. Eine häufige Frage bei der Verwendung von Stream lautet jedoch: Wie kann man von einem Foreach -Betrieb brechen oder zurückkehren? Herkömmliche Schleifen ermöglichen eine frühzeitige Unterbrechung oder Rückkehr, aber die Stream's foreach -Methode unterstützt diese Methode nicht direkt. In diesem Artikel werden die Gründe erläutert und alternative Methoden zur Implementierung vorzeitiger Beendigung in Strahlverarbeitungssystemen erforscht. Weitere Lektüre: Java Stream API -Verbesserungen Stream foreach verstehen Die Foreach -Methode ist ein Terminalbetrieb, der einen Vorgang für jedes Element im Stream ausführt. Seine Designabsicht ist

Zeitstempel für Datum in Java

Aug 30, 2024 pm 04:28 PM

Zeitstempel für Datum in Java

Aug 30, 2024 pm 04:28 PM

Anleitung zum TimeStamp to Date in Java. Hier diskutieren wir auch die Einführung und wie man Zeitstempel in Java in ein Datum konvertiert, zusammen mit Beispielen.

Java -Programm, um das Kapselvolumen zu finden

Feb 07, 2025 am 11:37 AM

Java -Programm, um das Kapselvolumen zu finden

Feb 07, 2025 am 11:37 AM

Kapseln sind dreidimensionale geometrische Figuren, die aus einem Zylinder und einer Hemisphäre an beiden Enden bestehen. Das Volumen der Kapsel kann berechnet werden, indem das Volumen des Zylinders und das Volumen der Hemisphäre an beiden Enden hinzugefügt werden. In diesem Tutorial wird erörtert, wie das Volumen einer bestimmten Kapsel in Java mit verschiedenen Methoden berechnet wird. Kapselvolumenformel Die Formel für das Kapselvolumen lautet wie folgt: Kapselvolumen = zylindrisches Volumenvolumen Zwei Hemisphäre Volumen In, R: Der Radius der Hemisphäre. H: Die Höhe des Zylinders (ohne die Hemisphäre). Beispiel 1 eingeben Radius = 5 Einheiten Höhe = 10 Einheiten Ausgabe Volumen = 1570,8 Kubikeinheiten erklären Berechnen Sie das Volumen mithilfe der Formel: Volumen = π × R2 × H (4

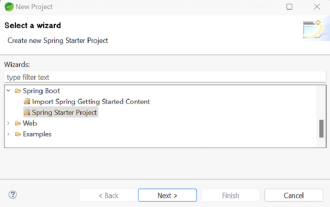

Wie führe ich Ihre erste Spring -Boot -Anwendung in der Spring Tool Suite aus?

Feb 07, 2025 pm 12:11 PM

Wie führe ich Ihre erste Spring -Boot -Anwendung in der Spring Tool Suite aus?

Feb 07, 2025 pm 12:11 PM

Spring Boot vereinfacht die Schaffung robuster, skalierbarer und produktionsbereiteter Java-Anwendungen, wodurch die Java-Entwicklung revolutioniert wird. Der Ansatz "Übereinkommen über Konfiguration", der dem Feder -Ökosystem inhärent ist, minimiert das manuelle Setup, Allo