Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

DenserRadar: 4D-Millimeterwellenradar-Punktwolkendetektor basierend auf einer dichten LiDAR-Punktwolke

DenserRadar: 4D-Millimeterwellenradar-Punktwolkendetektor basierend auf einer dichten LiDAR-Punktwolke

DenserRadar: 4D-Millimeterwellenradar-Punktwolkendetektor basierend auf einer dichten LiDAR-Punktwolke

Originaltitel: DenserRadar: Ein 4D-Millimeterwellen-Radar-Punktwolkendetektor basierend auf dichten LiDAR-Punktwolken

Papierlink: https://arxiv.org/pdf/2405.05131

Autorenzugehörigkeit: Tsinghua University

Idee für die Abschlussarbeit:

4D-Millimeterwellenradar (mmWave) hat sich mit seiner Robustheit in extremen Umgebungen, seinem großen Erfassungsbereich und der Fähigkeit, Geschwindigkeit und Höhe zu messen, als nützlich in autonomen Fahrsystemen in Grenzsituationen (Kurven-) erwiesen. Fall) hat ein erhebliches Potenzial zur Verbesserung der Wahrnehmung. Die inhärente Spärlichkeit und das Rauschen von 4D-Millimeterwellenradar-Punktwolken schränken jedoch ihre weitere Entwicklung und praktische Anwendung ein. In diesem Artikel wird ein neuartiger 4D-Millimeterwellen-Radarpunktwolkendetektor vorgestellt, der hochauflösende dichte Radarpunktwolken nutzt. Unsere Methode erstellt aus zusammengefügten LiDAR-Punktwolken eine dichte 3D-Bodenwahrheit über den besetzten Raum und verwendet ein speziell entwickeltes Netzwerk namens DenserRadar. Die vorgeschlagene Methode übertrifft bestehende wahrscheinlichkeitsbasierte und lernbasierte Millimeterwellenradar-Punktwolkendetektoren hinsichtlich Punktwolkendichte und Genauigkeit und erzielt bessere Ergebnisse im K-Radar-Datensatz.

Hauptbeiträge:

Bei dieser Arbeit handelt es sich um den ersten 4D-Millimeterwellenradar-Punktwolkendetektor, der durch dichte 3D-Datenraum-Bodenwahrheit überwacht wird, die durch Zusammenfügen von Multi-Frame-LiDAR-Punktwolken erzeugt wird, wodurch der erfasste Millimeter verdichtet wird Wellenradar-Punktwolke.

Dieses Papier schlägt einen innovativen Prozess zur Generierung der 3D-Bodenwahrheit im dichten Schnee-Datenraum sowie das Zusammenfügen dichter LiDAR-Punktwolken des K-Radar-Datensatzes vor. Diese Punktwolken liefern umfassende Szenen-Bodenwahrheiten und werden nach der Veröffentlichung verfügbar sein weitere Forschung.

Aufgrund des speziellen Designs des DenserRadar-Netzwerks ist der Algorithmus in diesem Artikel den bestehenden CFAR-Typ- und lernbasierten Millimeterwellenradar-Punktwolkenerkennungsmethoden hinsichtlich der Dichte und Genauigkeit von Punktwolken überlegen.

Webdesign:

Autonome Fahrtechnologie zielt darauf ab, ein sicheres, bequemes und komfortables Transporterlebnis zu bieten, und ihre Entwicklungsgeschwindigkeit ist beeindruckend. Um autonomes Fahren auf hohem Niveau zu erreichen, ist die Fähigkeit, komplexe Umgebungen wahrzunehmen und zu positionieren, unabdingbar. Daher stoßen die Sensoren autonomer Fahrzeuge, darunter Kameras, Lidar (LiDAR) und Millimeterwellenradar, sowie die zugehörigen Algorithmen auf immer größeres Forschungsinteresse.

Aufgrund seiner Vorteile wie kompakter Größe, hoher Kosteneffizienz, Allwetteranpassungsfähigkeit, Geschwindigkeitsmessfähigkeit und großem Erfassungsbereich [1] wird Millimeterwellenradar (mmWave) häufig im Bereich des autonomen Fahrens eingesetzt. Jüngste Fortschritte in der MIMO-Antennentechnologie (Multiple-Input-Multiple-Output) haben die Höhenauflösung weiter verbessert und die Entstehung von 4D-Millimeterwellenradar ermöglicht. Daher wird 4D-Millimeterwellenradar zunehmend als eine entscheidende Verbesserung der Wahrnehmungs- und Positionierungsfähigkeiten beim autonomen Fahren angesehen, insbesondere in anspruchsvollen Randszenen wie Regen, Schnee und Nebel. Wie der Name schon sagt, kann das 4D-Millimeterwellenradar vier Dimensionen von Zielinformationen messen: Entfernung, Azimut, Höhe und Doppler-Geschwindigkeit und bietet so eine umfassende Sensorlösung.

Allerdings hinkt die Qualität von 4D-Millimeterwellenradar-Punktwolken deutlich hinter Lidar-Punktwolken hinterher. Erstens haben 4D-Millimeterwellenradar-Punktwolken Probleme mit der geringen Auflösung, insbesondere bei der Winkelmessung. Diese Einschränkung ist hauptsächlich auf die Antennenkonfiguration und die Ankunftsrichtungsschätzung (DOA) des mmWave-Radars zurückzuführen [2]. Zweitens sind 4D-Millimeterwellenradar-Punktwolken viel spärlicher als Lidar-Punktwolken. Drittens enthalten 4D-Millimeterwellenradar-Punktwolken aufgrund von Mehrwegeeffekten, Signalinterferenzen und Bodenreflexionen häufig eine große Anzahl von Störpunkten. All diese Mängel behindern den Einsatz von 4D-Millimeterwellenradar beim autonomen Fahren.

Die Qualität von 4D-Millimeterwellenradar-Punktwolken wird nicht nur durch die Hardware, sondern auch durch Signalverarbeitungsalgorithmen begrenzt [3]. Insbesondere die Erkennung realer Ziele anhand von Rohradargrammen oder Tensoren zur Generierung von Punktwolken kann die Qualität erheblich beeinträchtigen. Traditionell werden der False Alarm Rate (CFAR)-Detektor und seine Varianten [4], [5] häufig zur Erkennung von Millimeterwellenradar-Punktwolken eingesetzt. Als wahrscheinlichkeitsbasierter Algorithmus können CFAR-Detektoren jedoch bei der Erkennung von Objekten unterschiedlicher Größe auf Probleme stoßen, da diese Objekte nicht unabhängig und identisch verteilt sind [6], was in autonomen Fahrszenarien häufig vorkommt.

Um die mit 4D-Millimeterwellenradar verbundenen Qualitätsprobleme bei Punktwolken anzugehen, schlägt dieses Papier einen lernbasierten 4D-Millimeterwellenradar-Punktwolkendetektor vor, der durch dichte Bodenwahrheitsinformationen überwacht wird, die aus Lidar-Punktwolken generiert werden. Zunächst werden in dieser Arbeit mehrere Rahmen vorverarbeiteter LiDAR-Punktwolken zusammengefügt, um eine dichte 3D-Belegungsgrundwahrheit zu generieren. In diesem Artikel wird dann das DenserRadar-Netzwerk vorgestellt, das die Merkmale des ursprünglichen 4D-Millimeterwellenradar-Tensors extrahiert und eine dichtere und genauere 4D-Millimeterwellenradar-Punktwolke erzeugt. Das Netzwerk nutzt eine gewichtete Hybridverlustfunktion zusammen mit anderen neuartigen Designelementen, um Merkmale mit mehreren Auflösungen zu erfassen und Punktwolken mit besserer Auflösung als herkömmliche Techniken zu erzeugen. Vergleichende Experimente mit dem K-Radar-Datensatz [7] belegen die Wirksamkeit dieser Methode.

Der Algorithmus dieses Artikels ist in Abbildung 1 dargestellt. In diesem Artikel wird zunächst ein Verfahren zur Generierung der Bodenwahrheit entworfen, um die Bodenwahrheit des dichten 3D-besetzten Raums als Überwachungsinformationen durch Zusammenfügen von Lidar-Punktwolkendaten mit mehreren Frames zu erhalten. Anschließend wird das DenserRadar-Netzwerk eingerichtet, dessen Aufgabe darin besteht, Daten aus der ursprünglichen 4D-Millimeterwelle zu generieren Erkennung von Millimeterwellen-Radarpunktwolken in Radartensordaten.

Abbildung 1. Übersicht über den gesamten Algorithmus.

Abbildung 2. Flussdiagramm zur Wahrheitswertgenerierung.

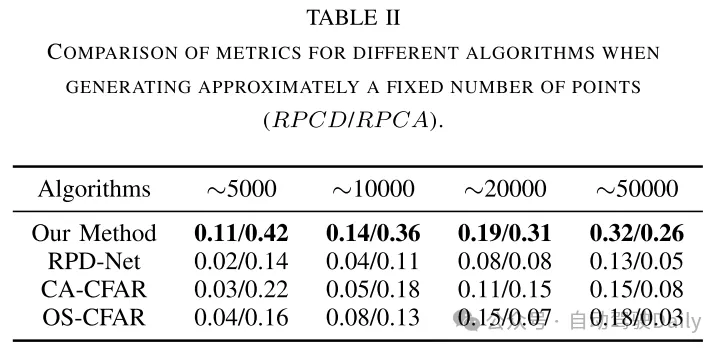

Experimentelle Ergebnisse:

Abbildung 4. Qualitativer Punktwolkenvergleich zwischen dem DenserRadar-Algorithmus und dem CA-CFAR-Algorithmus in diesem Artikel, mit Bildern und echten Punktwolken im dichten 3D-besetzten Raum als Referenz. Jeder Pfeil im Diagramm repräsentiert eine Länge von 10 Metern.

Zusammenfassung:

Dieses Papier stellt DenserRadar vor, ein neuartiges 4D-Millimeterwellenradar-Punktwolkenerkennungsnetzwerk, und einen innovativen Prozess zur Generierung dichter Bodenwahrheit. Experimentelle Ergebnisse und Ablationsstudien belegen die Wirksamkeit unserer Netzwerkarchitektur und Methodik zur Generierung der Grundwahrheit. Diese Forschung hat das Potenzial, die Wahrnehmungs- und Lokalisierungsfähigkeiten autonomer Fahrsysteme zu verbessern, insbesondere in anspruchsvollen Edge-Case-Szenarien.

Das obige ist der detaillierte Inhalt vonDenserRadar: 4D-Millimeterwellenradar-Punktwolkendetektor basierend auf einer dichten LiDAR-Punktwolke. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1667

1667

14

14

1426

1426

52

52

1328

1328

25

25

1273

1273

29

29

1255

1255

24

24

4K-HD-Bilder ganz einfach verstehen! Dieses große multimodale Modell analysiert automatisch den Inhalt von Webplakaten und ist damit für Mitarbeiter sehr praktisch.

Apr 23, 2024 am 08:04 AM

4K-HD-Bilder ganz einfach verstehen! Dieses große multimodale Modell analysiert automatisch den Inhalt von Webplakaten und ist damit für Mitarbeiter sehr praktisch.

Apr 23, 2024 am 08:04 AM

Ein großes Modell, das den Inhalt von PDFs, Webseiten, Postern und Excel-Diagrammen automatisch analysieren kann, ist für Mitarbeiter nicht besonders praktisch. Das von Shanghai AILab, der Chinesischen Universität Hongkong und anderen Forschungseinrichtungen vorgeschlagene Modell InternLM-XComposer2-4KHD (abgekürzt IXC2-4KHD) macht dies Wirklichkeit. Im Vergleich zu anderen multimodalen großen Modellen, deren Auflösungsgrenze nicht mehr als 1500 x 1500 beträgt, erhöht diese Arbeit das maximale Eingabebild multimodaler großer Modelle auf eine Auflösung von über 4K (3840 x 1600) und unterstützt jedes Seitenverhältnis und 336 Pixel bis 4K Dynamische Auflösungsänderungen. Drei Tage nach seiner Veröffentlichung stand das Modell an der Spitze der Beliebtheitsliste der visuellen Frage-Antwort-Modelle von HuggingFace. Einfach zu bedienen

CVPR 2024 |. LiDAR-Diffusionsmodell für die fotorealistische Szenengenerierung

Apr 24, 2024 pm 04:28 PM

CVPR 2024 |. LiDAR-Diffusionsmodell für die fotorealistische Szenengenerierung

Apr 24, 2024 pm 04:28 PM

Originaltitel: TowardsRealisticSceneGenerationwithLiDARDiffusionModels Papier-Link: https://hancyran.github.io/assets/paper/lidar_diffusion.pdf Code-Link: https://lidar-diffusion.github.io Autorenzugehörigkeit: CMU Toyota Research Institute University of Southern California Paper Ideen: Diffusionsmodelle (DMs) zeichnen sich durch fotorealistische Bildsynthese aus, ihre Anpassung an die Lidar-Szenengenerierung stellt jedoch erhebliche Herausforderungen dar. Dies liegt hauptsächlich daran, dass DMs, die im Punktraum arbeiten, Schwierigkeiten haben

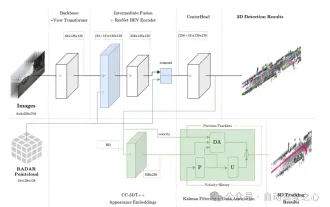

Die Leistung der RV-Fusion ist erstaunlich! RCBEVDet: Radar hat auch Frühling, das neueste SOTA!

Apr 02, 2024 am 11:49 AM

Die Leistung der RV-Fusion ist erstaunlich! RCBEVDet: Radar hat auch Frühling, das neueste SOTA!

Apr 02, 2024 am 11:49 AM

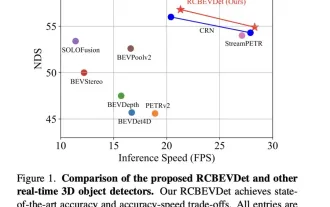

Wie oben geschrieben und nach persönlichem Verständnis des Autors liegt der Schwerpunkt dieses Diskussionspapiers auf der Anwendung der 3D-Zielerkennungstechnologie im Prozess des autonomen Fahrens. Obwohl die Entwicklung der Umgebungskameratechnologie hochauflösende semantische Informationen für die 3D-Objekterkennung liefert, ist diese Methode durch Probleme wie die Unfähigkeit, Tiefeninformationen genau zu erfassen, und schlechte Leistung bei schlechtem Wetter oder schlechten Lichtverhältnissen eingeschränkt. Als Reaktion auf dieses Problem wurde in der Diskussion eine neue Multimode-3D-Zielerkennungsmethode RCBEVDet vorgeschlagen, die Rundumsichtkameras und kostengünstige Millimeterwellenradarsensoren kombiniert. Diese Methode bietet umfangreichere semantische Informationen und eine Lösung für Probleme wie schlechte Leistung bei schlechtem Wetter oder schlechten Lichtverhältnissen, indem sie Informationen von mehreren Sensoren umfassend nutzt. Als Reaktion auf dieses Problem wurde in der Diskussion eine Methode vorgeschlagen, die Surround-View-Kameras kombiniert

Neue Ideen für die LiDAR-Simulation |. LidarDM: Hilft bei der Generierung einer 4D-Welt, Simulationskiller~

Apr 12, 2024 am 11:46 AM

Neue Ideen für die LiDAR-Simulation |. LidarDM: Hilft bei der Generierung einer 4D-Welt, Simulationskiller~

Apr 12, 2024 am 11:46 AM

Originaltitel: LidarDM: GenerativeLiDARSimulationinaGeneratedWorld Papier-Link: https://arxiv.org/pdf/2404.02903.pdf Code-Link: https://github.com/vzyrianov/lidardm Autorenzugehörigkeit: University of Illinois, Massachusetts Institute of Technology Papier-Idee: Einführung in diesen Artikel LidarDM, ein neuartiges Lidar-Generierungsmodell, mit dem realistische, Layout-bewusste, physikalisch glaubwürdige und zeitlich kohärente Lidar-Videos erstellt werden können. LidarDM verfügt über zwei beispiellose Funktionen in der generativen Lidar-Modellierung: (1)

Jenseits von BEVFormer! CR3DT: RV-Fusion hilft bei der 3D-Erkennung und -Verfolgung neuer SOTA (ETH)

Apr 24, 2024 pm 06:07 PM

Jenseits von BEVFormer! CR3DT: RV-Fusion hilft bei der 3D-Erkennung und -Verfolgung neuer SOTA (ETH)

Apr 24, 2024 pm 06:07 PM

Oben geschrieben und nach persönlichem Verständnis des Autors. In diesem Artikel wird eine Kamera-Millimeterwellen-Radar-Fusionsmethode (CR3DT) für die 3D-Zielerkennung und die Verfolgung mehrerer Ziele vorgestellt. Die Lidar-basierte Methode hat in diesem Bereich einen hohen Standard gesetzt, ihre hohe Rechenleistung und ihre hohen Kosten haben jedoch die Entwicklung dieser Lösung im Bereich des autonomen Fahrens eingeschränkt Kosten Es ist relativ niedrig und hat die Aufmerksamkeit vieler Wissenschaftler auf sich gezogen, aber aufgrund seiner schlechten Ergebnisse. Daher wird die Fusion von Kameras und Millimeterwellenradar zu einer vielversprechenden Lösung. Unter dem bestehenden Kamera-Framework BEVDet führt der Autor die räumlichen und Geschwindigkeitsinformationen des Millimeterwellenradars zusammen und kombiniert sie mit dem CC-3DT++-Tracking-Kopf, um die Genauigkeit der 3D-Zielerkennung und -verfolgung deutlich zu verbessern.

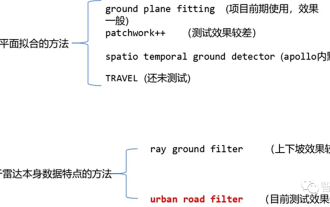

„Eingehende Analyse': Erkundung des LiDAR-Punktwolken-Segmentierungsalgorithmus beim autonomen Fahren

Apr 23, 2023 pm 04:46 PM

„Eingehende Analyse': Erkundung des LiDAR-Punktwolken-Segmentierungsalgorithmus beim autonomen Fahren

Apr 23, 2023 pm 04:46 PM

Derzeit gibt es zwei gängige Algorithmen zur Segmentierung von Laserpunktwolken: Methoden, die auf der Ebenenanpassung basieren, und Methoden, die auf den Eigenschaften von Laserpunktwolkendaten basieren. Die Details lauten wie folgt: Punktwolken-Bodensegmentierungsalgorithmus 01 Methode basierend auf der Ebenenanpassung – Idee des GroundPlaneFitting-Algorithmus: Eine einfache Verarbeitungsmethode besteht darin, den Raum in mehrere Unterebenen entlang der x-Richtung (der Richtung der Vorderseite des Autos) zu unterteilen. , und dann den Ground Plane Fitting Algorithm (GPF) verwenden, ergibt eine Bodensegmentierungsmethode, die steile Hänge bewältigen kann. Diese Methode dient dazu, eine globale Ebene in eine einzelne Punktwolke einzupassen. Sie funktioniert besser, wenn die Anzahl der Punktwolken spärlich ist, kann es leicht zu Fehlerkennungen und falschen Erkennungen kommen, z. B. bei 16 Linien Lidar. Algorithmus-Pseudocode: Der Pseudocode-Algorithmusprozess ist das Endergebnis der Segmentierung für eine gegebene Punktwolke P.

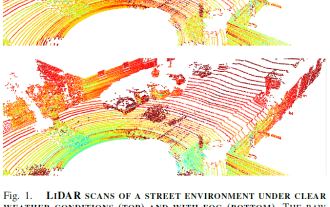

LiDAR-Sensortechnologielösung unter extremen Wetterbedingungen

May 10, 2023 pm 04:07 PM

LiDAR-Sensortechnologielösung unter extremen Wetterbedingungen

May 10, 2023 pm 04:07 PM

01Zusammenfassung Selbstfahrende Autos sind auf verschiedene Sensoren angewiesen, um Informationen über die Umgebung zu sammeln. Da das Verhalten des Fahrzeugs umweltbewusst geplant wird, ist seine Zuverlässigkeit aus Sicherheitsgründen von entscheidender Bedeutung. Aktive Lidar-Sensoren sind in der Lage, genaue 3D-Darstellungen von Szenen zu erstellen, was sie zu einer wertvollen Ergänzung für das Umweltbewusstsein autonomer Fahrzeuge macht. Die Leistung von LiDAR ändert sich bei widrigen Wetterbedingungen wie Nebel, Schnee oder Regen aufgrund von Lichtstreuung und Okklusion. Diese Einschränkung hat in letzter Zeit umfangreiche Forschungen zu Methoden zur Abmilderung der Verschlechterung der Wahrnehmungsleistung angeregt. In diesem Artikel werden verschiedene Aspekte der LiDAR-basierten Umweltsensorik zur Bewältigung widriger Wetterbedingungen gesammelt, analysiert und diskutiert. und diskutiert Themen wie die Verfügbarkeit geeigneter Daten, die Verarbeitung und Entrauschung von Rohpunktwolken, robuste Wahrnehmungsalgorithmen und Sensorfusion zur Linderung

Einführung in die in Java implementierte Radarsignalverarbeitungstechnologie

Jun 18, 2023 am 10:15 AM

Einführung in die in Java implementierte Radarsignalverarbeitungstechnologie

Jun 18, 2023 am 10:15 AM

Einleitung: Mit der kontinuierlichen Weiterentwicklung moderner Wissenschaft und Technologie wird die Radarsignalverarbeitungstechnologie immer häufiger eingesetzt. Java ist derzeit eine der beliebtesten Programmiersprachen und wird häufig bei der Implementierung von Radarsignalverarbeitungsalgorithmen verwendet. In diesem Artikel wird die in Java implementierte Radarsignalverarbeitungstechnologie vorgestellt. 1. Einführung in die Radarsignalverarbeitungstechnologie Die Radarsignalverarbeitungstechnologie kann als Kern und Seele der Entwicklung von Radarsystemen bezeichnet werden und ist die Schlüsseltechnologie zur Verwirklichung der Automatisierung und Digitalisierung von Radarsystemen. Die Radarsignalverarbeitungstechnologie umfasst Wellenformverarbeitung, Filterung, Impulskomprimierung und adaptive Strahlformung.