Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das Team der Universität Beihang hat die gesamte Erde in ein neuronales Netzwerk eingebunden und ein globales Fernerkundungsbilderzeugungsmodell eingeführt

Das Team der Universität Beihang hat die gesamte Erde in ein neuronales Netzwerk eingebunden und ein globales Fernerkundungsbilderzeugungsmodell eingeführt

Das Team der Universität Beihang hat die gesamte Erde in ein neuronales Netzwerk eingebunden und ein globales Fernerkundungsbilderzeugungsmodell eingeführt

Das Forschungsteam der Beihang-Universität nutzte ein Diffusionsmodell, um die Erde zu „replizieren“?

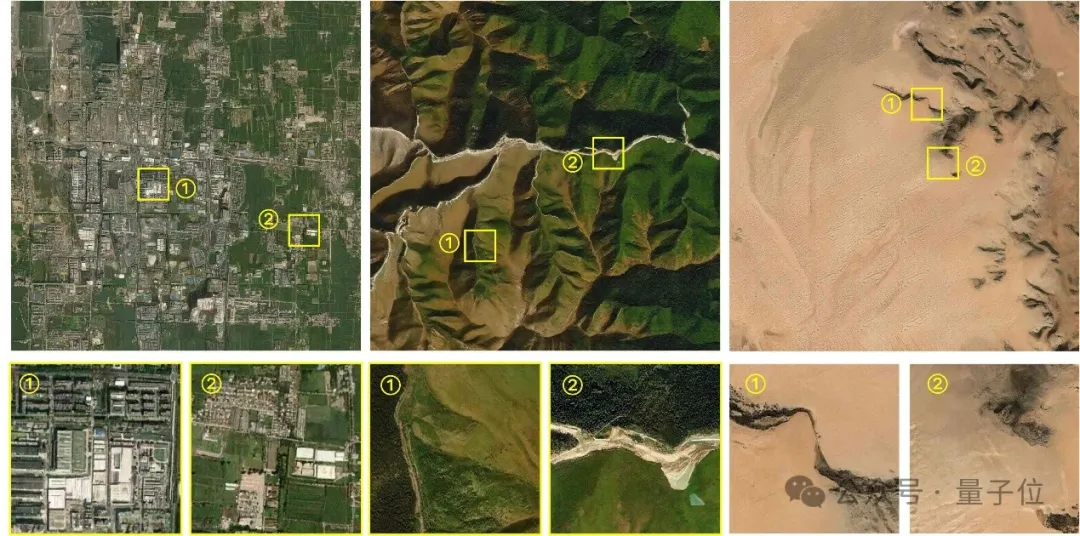

An jedem Ort auf der Welt kann das Modell Fernerkundungsbilder mit mehreren Auflösungen erzeugen und so reichhaltige und vielfältige „Parallelszenen“ erzeugen.

Und komplexe geografische Merkmale wie Gelände, Klima, Vegetation usw. werden berücksichtigt.

Inspiriert von Google Earth „lud“ das Forschungsteam von Beihang Satellitenfernerkundungsbilder der gesamten Erde aus der Vogelperspektive in ein tiefes neuronales Netzwerk.

Basierend auf einem solchen Netzwerk entwickelte das Team MetaEarth, ein globales Top-Down-Modell zur visuellen Generierung.

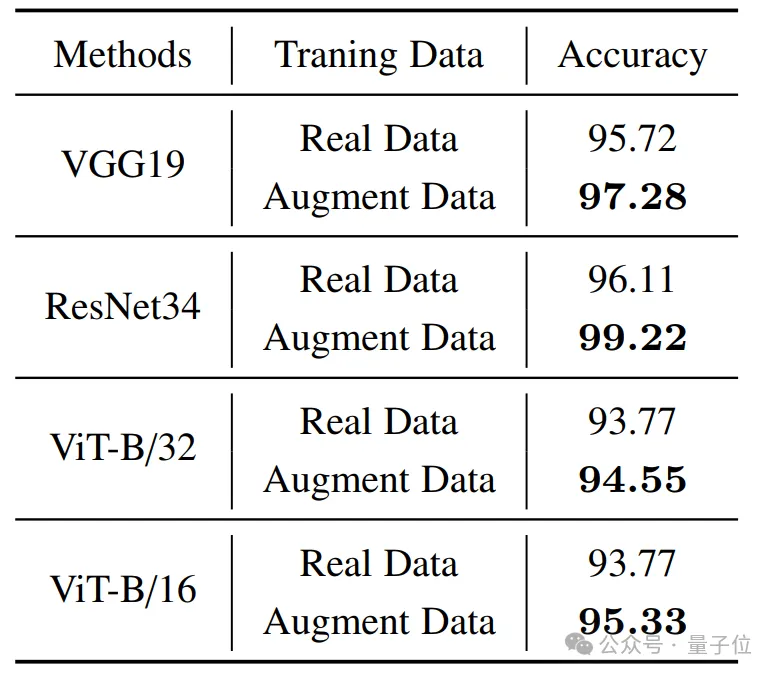

MetaEarth verfügt über 600 Millionen Parameter und kann Fernerkundungsbilder mit mehreren Auflösungen erzeugen, die unbegrenzt sind und jeden geografischen Standort auf der Welt abdecken.

Ein globales Fernerkundungsbildgenerierungsmodell

Im Vergleich zu früheren Untersuchungen ist der Aufbau eines weltweiten Basismodells zur visuellen Generierung anspruchsvoller und viele Schwierigkeiten wurden dabei überwunden.

Die Modellkapazität ist eine Herausforderung, da die Erde über eine Vielzahl geografischer Merkmale wie Städte, Wälder, Wüsten, Ozeane, Gletscher und Schneefelder verfügt, die vom Modell verstanden und dargestellt werden müssen.

Selbst die gleiche Art von künstlichen Merkmalen weist in verschiedenen Breitengraden, Klimazonen und kulturellen Umgebungen große Unterschiede auf, was hohe Anforderungen an die Kapazität des generierten Modells stellt.

MetaEarth hat diese Schwierigkeit erfolgreich gelöst und eine hochauflösende und groß angelegte Szenengenerierung an verschiedenen Standorten und Landformen erreicht.

Darüber hinaus ist auch die Erzeugung von Fernerkundungsbildern mit steuerbarer Auflösung eine Herausforderung.

Da bei der Overhead-Bildaufnahme die Anzeige von Bodenmerkmalen stark von der Auflösung abhängt, gibt es offensichtliche Unterschiede bei verschiedenen Bildauflösungen. Es ist schwierig, sie mit der angegebenen Auflösung (Meter/Pixel) genau zu erzeugen Fähigkeit.

Wenn MetaEarth Bilder mit unterschiedlichen Auflösungen generiert, können Oberflächenmerkmale genau und angemessen dargestellt werden, und die Korrelationen zwischen verschiedenen Auflösungen werden ebenfalls genau abgebildet.

Zur Unterstützung des Modelltrainings sammelte das Team einen großen Fernerkundungsbilddatensatz, der Bilder mit mehreren räumlichen Auflösungen und deren geografische Informationen (Breitengrad, Längengrad und Auflösung) enthält, die die meisten Regionen der Welt abdecken.

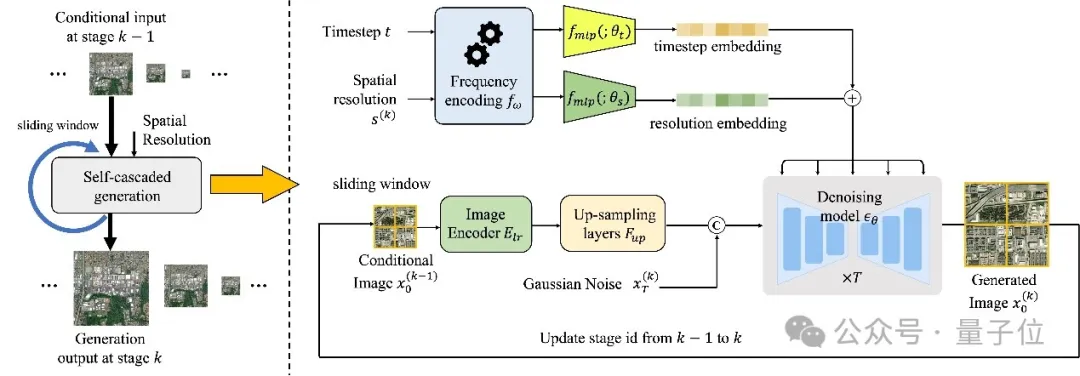

In dieser Studie schlagen die Autoren ein auflösungsgesteuertes, selbstkaskadierendes Generierungsframework vor.

△Der Gesamtrahmen von MetaEarth

Unter diesem Rahmen kann nur ein einziges Modell verwendet werden, um eine Bildgenerierung mit mehreren Auflösungen für einen bestimmten geografischen Standort zu erreichen und auf jeder Ebene reichhaltige und vielfältige „Parallelbilder“ zu erstellen Auflösung. Szenen".

Konkret handelt es sich hierbei um ein Codec-strukturiertes Rauschunterdrückungsnetzwerk, das die Kodierung von bedingten Bildern mit niedriger Auflösung und räumlicher Auflösung mit der Zeitschritt-Einbettung des Rauschunterdrückungsprozesses kombiniert, um das Rauschen in jedem Zeitschritt vorherzusagen und die Bilderzeugung zu implementieren.

Um unbegrenzte Bilder beliebiger Größe zu generieren, hat der Autor außerdem eine speichereffiziente Methode zur Erzeugung von Schiebefenstern und eine Strategie zur Rauschabtastung entwickelt.

Diese Strategie unterteilt das generierte Bild als Bedingung in überlappende Bildblöcke und verwendet eine spezielle Rauschabtaststrategie, um ähnliche Inhalte in den gemeinsamen Bereichen benachbarter Bildblöcke zu generieren und so Verbindungslücken zu vermeiden.

Darüber hinaus ermöglicht diese Rauschabtaststrategie dem Modell auch, weniger Videospeicherressourcen zu verbrauchen, wenn unbegrenzte Bilder beliebiger Größe generiert werden.

Teamprofil

Der Autor dieser Studie ist vom „Learning, Vision and Remote Sensing Laboratory, LEVIR Lab“ (LEarning, Vision and Remote Sensing Laboratory, LEVIR Lab) der Universität Beihang. Das Labor wird von Professor geleitet Shi Zhenwei, ein national angesehener junger Gelehrter.

Professor Zou Zhengxia, ein ehemaliger Doktorand von Professor Shi Zhenwei, Postdoktorand an der University of Michigan und derzeitiges Mitglied des Labors, ist der korrespondierende Autor dieses Artikels.

Papieradresse: https://www.php.cn/link/31bb2feb402ac789507479daf9713b00

Projekthomepage: https://www.php.cn/link/a0098fd07 db76 92267fca4f4169c9ba2

Das obige ist der detaillierte Inhalt vonDas Team der Universität Beihang hat die gesamte Erde in ein neuronales Netzwerk eingebunden und ein globales Fernerkundungsbilderzeugungsmodell eingeführt. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1673

1673

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

In diesem Artikel wird das Problem der genauen Erkennung von Objekten aus verschiedenen Blickwinkeln (z. B. Perspektive und Vogelperspektive) beim autonomen Fahren untersucht, insbesondere wie die Transformation von Merkmalen aus der Perspektive (PV) in den Raum aus der Vogelperspektive (BEV) effektiv ist implementiert über das Modul Visual Transformation (VT). Bestehende Methoden lassen sich grob in zwei Strategien unterteilen: 2D-zu-3D- und 3D-zu-2D-Konvertierung. 2D-zu-3D-Methoden verbessern dichte 2D-Merkmale durch die Vorhersage von Tiefenwahrscheinlichkeiten, aber die inhärente Unsicherheit von Tiefenvorhersagen, insbesondere in entfernten Regionen, kann zu Ungenauigkeiten führen. Während 3D-zu-2D-Methoden normalerweise 3D-Abfragen verwenden, um 2D-Features abzutasten und die Aufmerksamkeitsgewichte der Korrespondenz zwischen 3D- und 2D-Features über einen Transformer zu lernen, erhöht sich die Rechen- und Bereitstellungszeit.

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

Das Neueste von der Universität Oxford! Mickey: 2D-Bildabgleich in 3D SOTA! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Das Neueste von der Universität Oxford! Mickey: 2D-Bildabgleich in 3D SOTA! (CVPR\'24)

Apr 23, 2024 pm 01:20 PM

Projektlink vorne geschrieben: https://nianticlabs.github.io/mickey/ Anhand zweier Bilder kann die Kameraposition zwischen ihnen geschätzt werden, indem die Korrespondenz zwischen den Bildern hergestellt wird. Normalerweise handelt es sich bei diesen Entsprechungen um 2D-zu-2D-Entsprechungen, und unsere geschätzten Posen sind maßstabsunabhängig. Einige Anwendungen, wie z. B. Instant Augmented Reality jederzeit und überall, erfordern eine Posenschätzung von Skalenmetriken und sind daher auf externe Tiefenschätzer angewiesen, um die Skalierung wiederherzustellen. In diesem Artikel wird MicKey vorgeschlagen, ein Keypoint-Matching-Prozess, mit dem metrische Korrespondenzen im 3D-Kameraraum vorhergesagt werden können. Durch das Erlernen des 3D-Koordinatenabgleichs zwischen Bildern können wir auf metrische Relativwerte schließen