Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das Weltmodell verbreitet sich auch! Der ausgebildete Agent erweist sich als ziemlich gut

Das Weltmodell verbreitet sich auch! Der ausgebildete Agent erweist sich als ziemlich gut

Das Weltmodell verbreitet sich auch! Der ausgebildete Agent erweist sich als ziemlich gut

Weltmodelle bieten eine Möglichkeit, Reinforcement-Learning-Agenten auf sichere und probeneffiziente Weise zu trainieren. In letzter Zeit operieren Weltmodelle hauptsächlich mit diskreten latenten Variablensequenzen, um die Umweltdynamik zu simulieren.

Diese Methode der Komprimierung in kompakte diskrete Darstellungen ignoriert jedoch möglicherweise visuelle Details, die für das verstärkende Lernen wichtig sind. Andererseits sind Diffusionsmodelle zur vorherrschenden Methode zur Bilderzeugung geworden, was diskrete latente Modelle vor Herausforderungen stellt.

Angetrieben durch diesen Paradigmenwechsel schlugen Forscher der Universität Genf, der Universität Edinburgh und Microsoft Research gemeinsam einen Reinforcement-Learning-Agenten vor, der in einem Diffusionsweltmodell trainiert wurde – DIAMOND (DIffusion As a Model Of eNvironment Dreams).

- Papieradresse: https://arxiv.org/abs/2405.12399

- Projektadresse: https://github.com/eloialonso/ Diamant

- Papiertitel: Diffusion for World Modeling: Visual Details Matter in Atari

Auf dem Atari 100k-Benchmark erreichte DIAMOND+ einen durchschnittlichen Human Normalized Score (HNS) von 1,46. Dies bedeutet, dass ein im Weltmodell geschulter Agent vollständig auf der SOTA-Ebene eines im Weltmodell geschulten Agenten trainiert werden kann. Diese Studie liefert eine Stabilitätsanalyse, um zu veranschaulichen, dass DIAMOND-Designentscheidungen notwendig sind, um die langfristige effiziente Stabilität des diffusiven Weltmodells sicherzustellen.

Zusätzlich zu den Vorteilen der Arbeit im Bildraum ermöglicht es, dass das diffuse Weltmodell zu einer direkten Darstellung der Umgebung wird und so ein tieferes Verständnis des Weltmodells und des Agentenverhaltens ermöglicht. Die Studie ergab insbesondere, dass Leistungsverbesserungen in bestimmten Spielen auf eine bessere Modellierung wichtiger visueller Details zurückzuführen sind.

Einführung in die Methode

Als nächstes stellt dieser Artikel DIAMOND vor, einen Reinforcement-Learning-Agenten, der in einem Diffusionsweltmodell trainiert wurde. Konkret stützen wir uns dabei auf die in Abschnitt 2.2 eingeführten Drift- und Diffusionskoeffizienten f und g, die einer bestimmten Wahl des Diffusionsparadigmas entsprechen. Darüber hinaus wurde in dieser Studie auch die EDM-Formulierung basierend auf Karras et al. gewählt.

Definieren Sie zunächst einen Störungskern  , wobei

, wobei  eine reellwertige Funktion in Bezug auf die Diffusionszeit ist, die als Rauschplan bezeichnet wird. Dies entspricht der Einstellung der Drift- und Diffusionskoeffizienten auf

eine reellwertige Funktion in Bezug auf die Diffusionszeit ist, die als Rauschplan bezeichnet wird. Dies entspricht der Einstellung der Drift- und Diffusionskoeffizienten auf  und

und  .

.

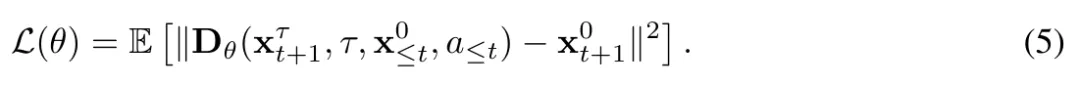

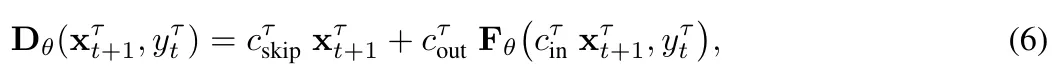

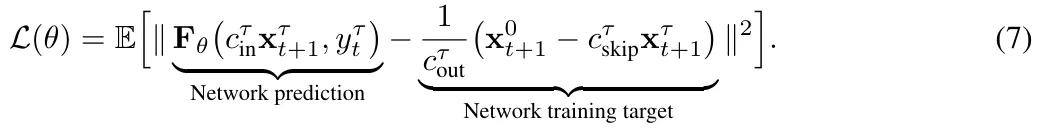

Verwenden Sie dann die von Karras et al. (2022) eingeführte Netzwerkvorverarbeitung und parametrisieren Sie  in Gleichung (5) als gewichtete Summe aus verrauschten Beobachtungen und vorhergesagten Werten des neuronalen Netzwerks:

in Gleichung (5) als gewichtete Summe aus verrauschten Beobachtungen und vorhergesagten Werten des neuronalen Netzwerks:

Formel erhalten (6)

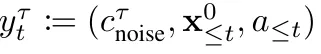

wobei der prägnanten Definition halber alle Bedingungsvariablen einschließt.

Präprozessorauswahl. Die Präprozessoren  und

und  werden ausgewählt, um die Einheitsvarianz des Netzwerkeingangs und -ausgangs bei jedem Rauschpegel

werden ausgewählt, um die Einheitsvarianz des Netzwerkeingangs und -ausgangs bei jedem Rauschpegel  aufrechtzuerhalten.

aufrechtzuerhalten.  ist die empirische Umrechnung des Geräuschpegels,

ist die empirische Umrechnung des Geräuschpegels,  ergibt sich aus

ergibt sich aus  und der Standardabweichung der Datenverteilung

und der Standardabweichung der Datenverteilung  und die Formel lautet

und die Formel lautet

Durch die Kombination der Formeln 5 und 6 erhalten wir das  Trainingsziel:

Trainingsziel:

Diese Studie konditioniert das Modell, indem sie Standard-U-Net 2D verwendet, um das Vektorfeld zu erstellen  und einen Puffer mit den letzten L Beobachtungen und Aktionen beibehält. Als nächstes verketteten sie diese vergangenen Beobachtungen kanalweise mit der nächsten verrauschten Beobachtung und speisten die Aktionen über eine adaptive Gruppennormalisierungsschicht in den Restblock von U-Net ein. Wie in Abschnitt 2.3 und Anhang A erläutert, gibt es viele mögliche Stichprobenmethoden, um die nächste Beobachtung aus einem trainierten Diffusionsmodell zu generieren. Während die von der Studie veröffentlichte Codebasis mehrere Stichprobenschemata unterstützt, ergab die Studie, dass Euler-Methoden effektiv sind, ohne dass zusätzliche NFE (Anzahl der Funktionsauswertungen) erforderlich sind und die unnötige Komplexität von Samplern höherer Ordnung oder Zufallsstichproben vermieden wird.

und einen Puffer mit den letzten L Beobachtungen und Aktionen beibehält. Als nächstes verketteten sie diese vergangenen Beobachtungen kanalweise mit der nächsten verrauschten Beobachtung und speisten die Aktionen über eine adaptive Gruppennormalisierungsschicht in den Restblock von U-Net ein. Wie in Abschnitt 2.3 und Anhang A erläutert, gibt es viele mögliche Stichprobenmethoden, um die nächste Beobachtung aus einem trainierten Diffusionsmodell zu generieren. Während die von der Studie veröffentlichte Codebasis mehrere Stichprobenschemata unterstützt, ergab die Studie, dass Euler-Methoden effektiv sind, ohne dass zusätzliche NFE (Anzahl der Funktionsauswertungen) erforderlich sind und die unnötige Komplexität von Samplern höherer Ordnung oder Zufallsstichproben vermieden wird.

Experimente

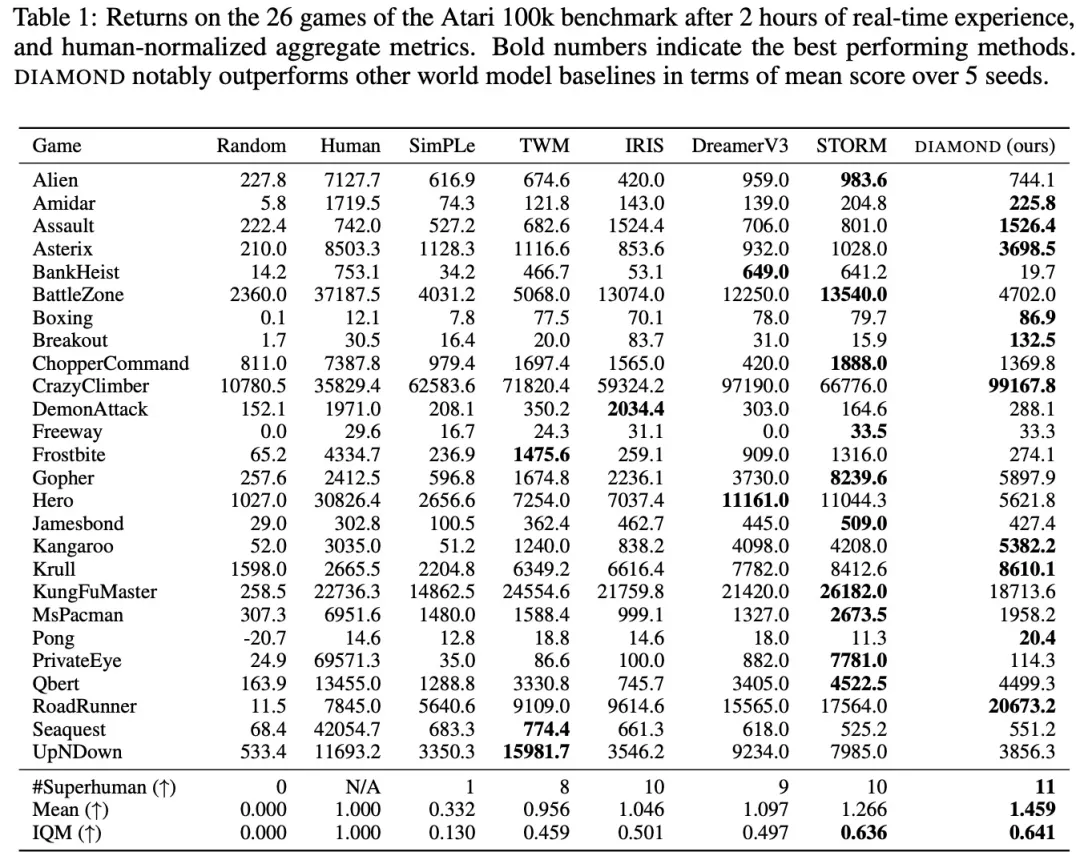

Um DIAMOND vollständig zu bewerten, verwendete die Studie den etablierten Atari 100k-Benchmark, der 26 Spiele umfasst, um die breiten Fähigkeiten des Agenten zu testen. Für jedes Spiel durfte der Agent nur 100.000 Aktionen in der Umgebung ausführen, was in etwa 2 Stunden menschlicher Spielzeit entspricht, um zu lernen, wie man das Spiel spielt, bevor es bewertet wird. Als Referenz: Ein Atari-Agent ohne Einschränkungen wird typischerweise für 50 Millionen Schritte trainiert, was einer 500-fachen Steigerung der Erfahrung entspricht. Die Forscher trainierten DIAMOND bei jedem Spiel von Grund auf mit 5 zufälligen Samen. Jeder Lauf verbrauchte etwa 12 GB VRAM und dauerte etwa 2,9 Tage auf einer einzelnen Nvidia RTX 4090 (insgesamt 1,03 GPU-Jahre).

Tabelle 1 vergleicht verschiedene Ergebnisse für die Schulung eines Agenten im Weltmodell:

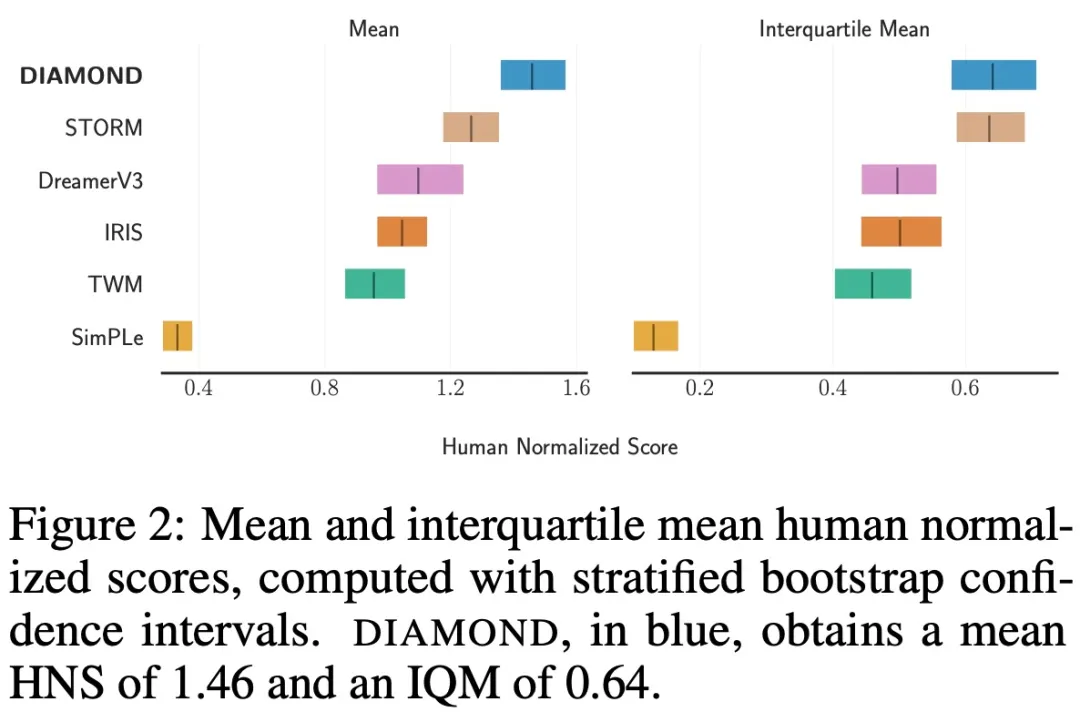

Der Mittelwert und die IQM-Konfidenzintervalle (Interquartilmittel) sind in Abbildung 2 dargestellt:

Die Ergebnisse zeigen, dass DIAMOND bei Benchmarks stark abschneidet, menschliche Spieler in 11 Spielen übertrifft und einen HNS-Wert von 1,46 erreicht, ein neuer Rekord für einen Agenten, der vollständig nach einem Weltmodell ausgebildet wurde. Die Studie ergab außerdem, dass DIAMOND besonders gut in Umgebungen funktioniert, in denen die Erfassung von Details erforderlich ist, wie z. B. Asterix, Breakout und Road Runner.

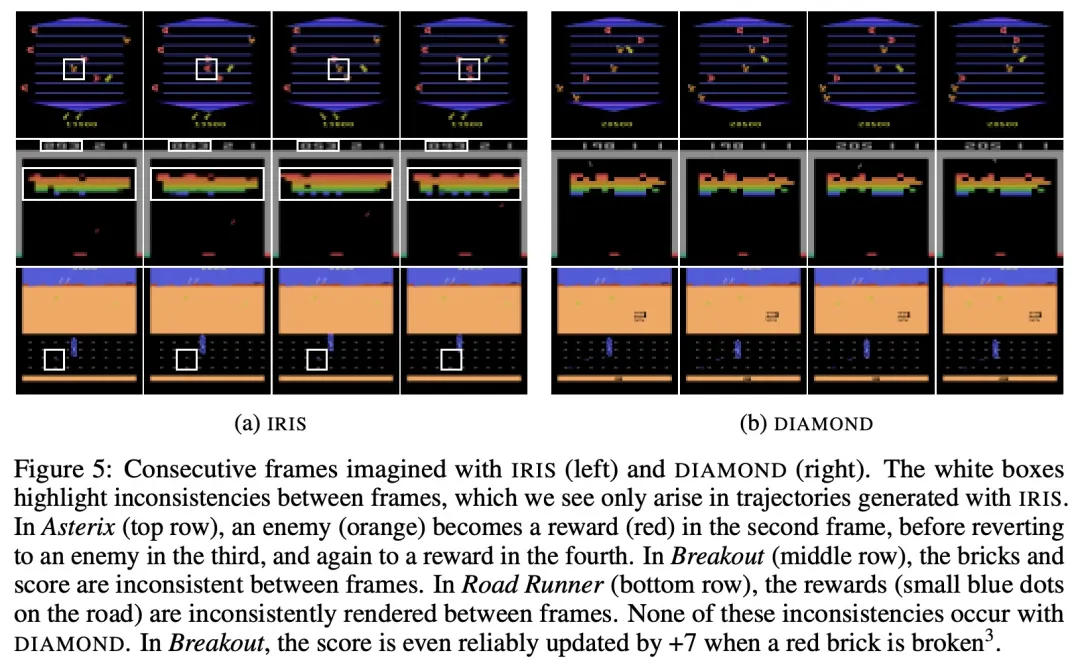

Um die Stabilität der Diffusionsvariablen zu untersuchen, analysierte diese Studie die durch Autoregression erzeugte imaginäre Flugbahn, wie in Abbildung 3 unten dargestellt:

Die Studie ergab, dass es Situationen gibt, in denen iterative Löser erforderlich sind, um den Stichprobenprozess in bestimmte Modi zu lenken, wie zum Beispiel das in Abbildung 4 dargestellte Boxspiel:

dargestellt in Abbildung 5 im Vergleich zur Flugbahn Die von IRIS vorgestellten Flugbahnen haben im Allgemeinen eine höhere visuelle Qualität und stimmen besser mit der realen Umgebung überein.

Interessierte Leser können den Originaltext des Artikels lesen, um mehr über den Forschungsinhalt zu erfahren.

Das obige ist der detaillierte Inhalt vonDas Weltmodell verbreitet sich auch! Der ausgebildete Agent erweist sich als ziemlich gut. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1670

1670

14

14

1428

1428

52

52

1329

1329

25

25

1276

1276

29

29

1256

1256

24

24

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

Open Source! Jenseits von ZoeDepth! DepthFM: Schnelle und genaue monokulare Tiefenschätzung!

Apr 03, 2024 pm 12:04 PM

0.Was bewirkt dieser Artikel? Wir schlagen DepthFM vor: ein vielseitiges und schnelles generatives monokulares Tiefenschätzungsmodell auf dem neuesten Stand der Technik. Zusätzlich zu herkömmlichen Tiefenschätzungsaufgaben demonstriert DepthFM auch hochmoderne Fähigkeiten bei nachgelagerten Aufgaben wie dem Tiefen-Inpainting. DepthFM ist effizient und kann Tiefenkarten innerhalb weniger Inferenzschritte synthetisieren. Lassen Sie uns diese Arbeit gemeinsam lesen ~ 1. Titel der Papierinformationen: DepthFM: FastMonocularDepthEstimationwithFlowMatching Autor: MingGui, JohannesS.Fischer, UlrichPrestel, PingchuanMa, Dmytr

Verzichten Sie auf die Encoder-Decoder-Architektur und verwenden Sie das Diffusionsmodell zur Kantenerkennung, das effektiver ist. Die National University of Defense Technology hat DiffusionEdge vorgeschlagen

Feb 07, 2024 pm 10:12 PM

Verzichten Sie auf die Encoder-Decoder-Architektur und verwenden Sie das Diffusionsmodell zur Kantenerkennung, das effektiver ist. Die National University of Defense Technology hat DiffusionEdge vorgeschlagen

Feb 07, 2024 pm 10:12 PM

Aktuelle Deep-Edge-Erkennungsnetzwerke verwenden normalerweise eine Encoder-Decoder-Architektur, die Up- und Down-Sampling-Module enthält, um mehrstufige Merkmale besser zu extrahieren. Diese Struktur schränkt jedoch die Ausgabe genauer und detaillierter Kantenerkennungsergebnisse des Netzwerks ein. Als Antwort auf dieses Problem bietet ein Papier zu AAAI2024 eine neue Lösung. Titel der Abschlussarbeit: DiffusionEdge:DiffusionProbabilisticModelforCrispEdgeDetection Autoren: Ye Yunfan (Nationale Universität für Verteidigungstechnologie), Xu Kai (Nationale Universität für Verteidigungstechnologie), Huang Yuxing (Nationale Universität für Verteidigungstechnologie), Yi Renjiao (Nationale Universität für Verteidigungstechnologie), Cai Zhiping (National University of Defense Technology) Link zum Papier: https://ar

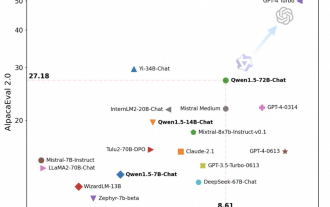

Tongyi Qianwen ist wieder Open Source, Qwen1.5 bietet sechs Volumenmodelle und seine Leistung übertrifft GPT3.5

Feb 07, 2024 pm 10:15 PM

Tongyi Qianwen ist wieder Open Source, Qwen1.5 bietet sechs Volumenmodelle und seine Leistung übertrifft GPT3.5

Feb 07, 2024 pm 10:15 PM

Pünktlich zum Frühlingsfest ist Version 1.5 des Tongyi Qianwen Large Model (Qwen) online. Heute Morgen erregten die Neuigkeiten über die neue Version die Aufmerksamkeit der KI-Community. Die neue Version des großen Modells umfasst sechs Modellgrößen: 0,5B, 1,8B, 4B, 7B, 14B und 72B. Unter ihnen übertrifft die Leistung der stärksten Version GPT3.5 und Mistral-Medium. Diese Version umfasst das Basismodell und das Chat-Modell und bietet Unterstützung für mehrere Sprachen. Das Tongyi Qianwen-Team von Alibaba gab an, dass die entsprechende Technologie auch auf der offiziellen Website von Tongyi Qianwen und der Tongyi Qianwen App eingeführt wurde. Darüber hinaus bietet die heutige Version von Qwen 1.5 auch die folgenden Highlights: Unterstützt eine Kontextlänge von 32 KB und öffnet den Prüfpunkt des Base+Chat-Modells.

Große Modelle können ebenfalls in Scheiben geschnitten werden, und Microsoft SliceGPT erhöht die Recheneffizienz von LLAMA-2 erheblich

Jan 31, 2024 am 11:39 AM

Große Modelle können ebenfalls in Scheiben geschnitten werden, und Microsoft SliceGPT erhöht die Recheneffizienz von LLAMA-2 erheblich

Jan 31, 2024 am 11:39 AM

Große Sprachmodelle (LLMs) verfügen typischerweise über Milliarden von Parametern und werden auf Billionen von Token trainiert. Die Schulung und Bereitstellung solcher Modelle ist jedoch sehr teuer. Um den Rechenaufwand zu reduzieren, werden häufig verschiedene Modellkomprimierungstechniken eingesetzt. Diese Modellkomprimierungstechniken können im Allgemeinen in vier Kategorien unterteilt werden: Destillation, Tensorzerlegung (einschließlich Faktorisierung mit niedrigem Rang), Bereinigung und Quantisierung. Pruning-Methoden gibt es schon seit einiger Zeit, aber viele erfordern nach dem Pruning eine Feinabstimmung der Wiederherstellung (Recovery Fine-Tuning, RFT), um die Leistung aufrechtzuerhalten, was den gesamten Prozess kostspielig und schwierig zu skalieren macht. Forscher der ETH Zürich und von Microsoft haben eine Lösung für dieses Problem namens SliceGPT vorgeschlagen. Die Kernidee dieser Methode besteht darin, die Einbettung des Netzwerks durch das Löschen von Zeilen und Spalten in der Gewichtsmatrix zu reduzieren.

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

LLaVA-1.6, das mit Gemini Pro gleichzieht und die Argumentations- und OCR-Fähigkeiten verbessert, ist zu leistungsstark

Feb 01, 2024 pm 04:51 PM

LLaVA-1.6, das mit Gemini Pro gleichzieht und die Argumentations- und OCR-Fähigkeiten verbessert, ist zu leistungsstark

Feb 01, 2024 pm 04:51 PM

Im April letzten Jahres veröffentlichten Forscher der University of Wisconsin-Madison, Microsoft Research und der Columbia University gemeinsam LLaVA (Large Language and Vision Assistant). Obwohl LLaVA nur mit einem kleinen multimodalen Befehlsdatensatz trainiert wird, zeigt es bei einigen Proben sehr ähnliche Inferenzergebnisse wie GPT-4. Im Oktober brachten sie dann LLaVA-1.5 auf den Markt, das den SOTA in 11 Benchmarks mit einfachen Modifikationen am ursprünglichen LLaVA aktualisierte. Die Ergebnisse dieses Upgrades sind sehr aufregend und bringen neue Durchbrüche auf dem Gebiet der multimodalen KI-Assistenten. Das Forschungsteam kündigte die Einführung der LLaVA-1.6-Version an, die auf Argumentation, OCR und zielt

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Die Kuaishou-Version von Sora „Ke Ling' steht zum Testen offen: Sie generiert über 120 Sekunden Videos, versteht die Physik besser und kann komplexe Bewegungen genau modellieren

Jun 11, 2024 am 09:51 AM

Was? Wird Zootopia durch heimische KI in die Realität umgesetzt? Zusammen mit dem Video wird ein neues groß angelegtes inländisches Videogenerationsmodell namens „Keling“ vorgestellt. Sora geht einen ähnlichen technischen Weg und kombiniert eine Reihe selbst entwickelter technologischer Innovationen, um Videos zu produzieren, die nicht nur große und vernünftige Bewegungen aufweisen, sondern auch die Eigenschaften der physischen Welt simulieren und über starke konzeptionelle Kombinationsfähigkeiten und Vorstellungskraft verfügen. Den Daten zufolge unterstützt Keling die Erstellung ultralanger Videos von bis zu 2 Minuten mit 30 Bildern pro Sekunde, mit Auflösungen von bis zu 1080p und unterstützt mehrere Seitenverhältnisse. Ein weiterer wichtiger Punkt ist, dass es sich bei Keling nicht um eine vom Labor veröffentlichte Demo oder Video-Ergebnisdemonstration handelt, sondern um eine Anwendung auf Produktebene, die von Kuaishou, einem führenden Anbieter im Bereich Kurzvideos, gestartet wurde. Darüber hinaus liegt das Hauptaugenmerk darauf, pragmatisch zu sein, keine Blankoschecks auszustellen und sofort nach der Veröffentlichung online zu gehen. Das große Modell von Ke Ling wurde bereits in Kuaiying veröffentlicht.

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Die Vitalität der Superintelligenz erwacht! Aber mit der Einführung der sich selbst aktualisierenden KI müssen sich Mütter keine Sorgen mehr über Datenengpässe machen

Apr 29, 2024 pm 06:55 PM

Ich weine zu Tode. Die Daten im Internet reichen überhaupt nicht aus. Das Trainingsmodell sieht aus wie „Die Tribute von Panem“, und KI-Forscher auf der ganzen Welt machen sich Gedanken darüber, wie sie diese datenhungrigen Esser ernähren sollen. Dieses Problem tritt insbesondere bei multimodalen Aufgaben auf. Zu einer Zeit, als sie ratlos waren, nutzte ein Start-up-Team der Abteilung der Renmin-Universität von China sein eigenes neues Modell, um als erstes in China einen „modellgenerierten Datenfeed selbst“ in die Realität umzusetzen. Darüber hinaus handelt es sich um einen zweigleisigen Ansatz auf der Verständnisseite und der Generierungsseite. Beide Seiten können hochwertige, multimodale neue Daten generieren und Datenrückmeldungen an das Modell selbst liefern. Was ist ein Modell? Awaker 1.0, ein großes multimodales Modell, das gerade im Zhongguancun-Forum erschienen ist. Wer ist das Team? Sophon-Motor. Gegründet von Gao Yizhao, einem Doktoranden an der Hillhouse School of Artificial Intelligence der Renmin University.