Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

OpenAI stellt den Dienst ein und große inländische Modelle sind kostenlos verfügbar! Der Entwickler-Token ist frei implementiert

OpenAI stellt den Dienst ein und große inländische Modelle sind kostenlos verfügbar! Der Entwickler-Token ist frei implementiert

OpenAI stellt den Dienst ein und große inländische Modelle sind kostenlos verfügbar! Der Entwickler-Token ist frei implementiert

Von nun an ist „Token-Freiheit“ für Entwickler kein Traum mehr und sie können ohne Sorgen tolle Anwendungen entwickeln.

Portal „Token Free“, Direktzugriff mit einem Klick:

cloud.siliconflow.cn/s/free

Große Modell-Token-Fabrik

Sofortige Aktualisierung, extrem schnelle Ausgabe, erschwinglicher Preis

Da es Token Factory heißt, sind alle Modelle, die Benutzern gefallen, direkt in Silicon Cloud zu finden.

In letzter Zeit ist die große Modell-Community recht lebhaft, und Open-Source-Modelle aktualisieren SOTA ständig und dominieren abwechselnd die Liste.

Silicon Fluid hat diese großen Modelle schnellstmöglich in die Silicon Cloud hochgeladen, darunter das leistungsstärkste Open-Source-Code-Generierungsmodell DeepSeek-Coder-V2, große Sprachmodelle, die Llama3 Qwen2, GLM-4-9B-Chat und DeepSeek übertreffen Modelle der V2-Serie. Es unterstützt auch Vincent-Grafikmodelle wie Stable Diffusion 3 Medium und InstantID.

Es ist erwähnenswert, dass SiliconCloud für Modelle, die extrem schwierig bereitzustellen sind, wie DeepSeek V2, neben der offiziellen Plattform die einzige Cloud-Service-Plattform ist, die diese großen Open-Source-Modelle unterstützt.

Angesichts der Notwendigkeit, in verschiedenen Anwendungsszenarien ein geeignetes großes Modell auszuwählen, können Entwickler in SiliconCloud frei wechseln.

Eine solche Open-Source-Plattform zur Aggregation großer Modelle hat Entwicklern viele Annehmlichkeiten geboten, reicht aber bei weitem nicht aus. Als weltweit führendes AI-Infra-Team setzt sich Silicon Flow dafür ein, die Kosten für die Bereitstellung großer Modelle um 10.000 zu senken mal.

Um dieses Ziel zu erreichen, besteht die zentrale Herausforderung darin, die Inferenzgeschwindigkeit großer Modelle deutlich zu verbessern. Inwieweit hat SiliconCloud dies erreicht?

Besuchen Sie das Bild oben, um die Reaktionsgeschwindigkeit von Qwen2-72B-Instruct auf SiliconCloud zu erleben.

Die Bildgenerierungszeit von SD3 Medium, das gerade als Open Source verfügbar ist, beträgt etwa 1 Sekunde.

Die Reaktionsgeschwindigkeit dieser großen Open-Source-Modelle ist schneller geworden, die Leistung bei gleicher Rechenleistung ist höher und der Preis ist natürlich gesunken.

Der Preis der großen Modell-API auf Silicon Cloud ist ebenfalls (sehr) günstiger. Selbst für Qwen2-72B zeigt die offizielle Website, dass es nur 4,13 Yuan / 1 Mio. Token kostet. Neue Benutzer können außerdem 20 Millionen Token kostenlos genießen.

Entwicklerkommentare: „Es ist so schnell, dass man nie mehr zurückkehren kann“

Sobald SiliconCloud veröffentlicht wurde, teilten viele Entwickler ihre Erfahrungen auf wichtigen sozialen Plattformen. Einige „Leitungswasser“-Benutzer kommentierten Folgendes:

Auf Zhihu lobte der Experte für maschinelle Lernsysteme @方佳瑞 die Ausgabegeschwindigkeit von SiliconCloud: „Nachdem ich es lange verwendet habe, kann ich die Reaktionsgeschwindigkeit anderer großer Modellhersteller nicht ertragen.“ die Webseite.“

Weibo-Benutzer @ Zhu William II sagte, dass mehrere andere Plattformen es nicht wagen, Qwen2-Modelle mit großen Parametern bereitzustellen, aber SiliconCloud hat sie alle bereitgestellt Es ist sehr schnell und sehr billig, also wird er definitiv zahlen.

Er erwähnte auch, dass Das Endprodukt des großen Modells Token ist. In Zukunft wird die Token-Produktion von Token-Fabriken wie Silicon-based Liquidity oder großen Modellunternehmen oder Cloud-Anbietern wie OpenAI und Alibaba Cloud durchgeführt.

Außerdem empfehlen X-Benutzer SiliconCloud wärmstens. Die Erfahrung ist so reibungslos, insbesondere das rücksichtsvolle und erstklassige Kundendienstteam.

Bewertung des offiziellen WeChat-Account-Bloggers: SiliconCloud hat die beste Erfahrung unter ähnlichen Produkten in China.

Diese Bewertungen haben eine offensichtliche Gemeinsamkeit: Sie alle erwähnten die Geschwindigkeit der SiliconCloud-Plattform. Warum reagiert es so schnell?

Die Antwort ist einfach: Das Silicon Flow-Team hat viel an der Leistungsoptimierung gearbeitet.

Bereits im Jahr 2016 widmete sich das OneFlow-Team, der Vorgänger von Flow auf Siliziumbasis, der großen Modellinfrastruktur und war das einzige Unternehmerteam der Welt, das ein allgemeines Deep-Learning-Framework entwickelte. Sie gründeten erneut ein Unternehmen und übernahmen die Führung bei der Entwicklung einer leistungsstarken Inferenz-Engine für große Modelle. In einigen Szenarien kann der Durchsatz großer Modelle dadurch um das Zehnfache beschleunigt werden Die Engine wurde auch in die Silicon Cloud-Plattform integriert.

Mit anderen Worten: Entwicklern die Nutzung großer Modelldienste mit schnellerer Ausgabe und erschwinglichen Preisen zu ermöglichen, ist die Spezialität des Teams für siliziumbasierte Mobilgeräte.

Nachdem Token kostenlos ist, sind phänomenale Anwendungen noch in weiter Ferne? 🔜 Sie verbrennen zu schnell Geld und können es sich nicht leisten.

Mit der kontinuierlichen Iteration großer inländischer Open-Source-Modelle reichen die von Qwen2 und DeepSeek V2 repräsentierten Modelle aus, um Superanwendungen zu unterstützen. Noch wichtiger ist, dass das Aufkommen der „Token-Fabrik SiliconCloud“ die Sorgen von Super-Individuen lösen kann, die sie nicht mehr haben Sorgen Sie sich um Anwendungen Anstelle der Kosten für Rechenleistung, die durch Forschung und Entwicklung und groß angelegte Werbung verursacht werden, müssen Sie sich nur auf die Umsetzung von Produktideen und die Erstellung generativer KI-Anwendungen konzentrieren, die Benutzer benötigen. Man kann sagen, dass jetzt der beste „Goldgräber“-Moment für superindividuelle Entwickler und Produktmanager ist, und SiliconCloud, ein nützliches Goldgräber-Tool, wurde für Sie vorbereitet.Noch eine Erinnerung: Qwen2 (7B), GLM4 (9B) und andere Top-Open-Source-Großmodelle sind dauerhaft kostenlos.

Willkommen bei Token Factory SiliconCloud:

cloud.siliconflow.cn/s/free

Das obige ist der detaillierte Inhalt vonOpenAI stellt den Dienst ein und große inländische Modelle sind kostenlos verfügbar! Der Entwickler-Token ist frei implementiert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1670

1670

14

14

1428

1428

52

52

1329

1329

25

25

1274

1274

29

29

1256

1256

24

24

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Aber vielleicht kann er den alten Mann im Park nicht besiegen? Die Olympischen Spiele in Paris sind in vollem Gange und Tischtennis hat viel Aufmerksamkeit erregt. Gleichzeitig haben Roboter auch beim Tischtennisspielen neue Durchbrüche erzielt. Gerade hat DeepMind den ersten lernenden Roboteragenten vorgeschlagen, der das Niveau menschlicher Amateurspieler im Tischtennis-Wettkampf erreichen kann. Papieradresse: https://arxiv.org/pdf/2408.03906 Wie gut ist der DeepMind-Roboter beim Tischtennisspielen? Vermutlich auf Augenhöhe mit menschlichen Amateurspielern: Sowohl Vorhand als auch Rückhand: Der Gegner nutzt unterschiedliche Spielstile, und auch der Roboter hält aus: Aufschlagannahme mit unterschiedlichem Spin: Allerdings scheint die Intensität des Spiels nicht so intensiv zu sein wie Der alte Mann im Park. Für Roboter, Tischtennis

Die erste mechanische Klaue! Yuanluobao trat auf der Weltroboterkonferenz 2024 auf und stellte den ersten Schachroboter vor, der das Haus betreten kann

Aug 21, 2024 pm 07:33 PM

Die erste mechanische Klaue! Yuanluobao trat auf der Weltroboterkonferenz 2024 auf und stellte den ersten Schachroboter vor, der das Haus betreten kann

Aug 21, 2024 pm 07:33 PM

Am 21. August fand in Peking die Weltroboterkonferenz 2024 im großen Stil statt. Die Heimrobotermarke „Yuanluobot SenseRobot“ von SenseTime hat ihre gesamte Produktfamilie vorgestellt und kürzlich den Yuanluobot AI-Schachspielroboter – Chess Professional Edition (im Folgenden als „Yuanluobot SenseRobot“ bezeichnet) herausgebracht und ist damit der weltweit erste A-Schachroboter für heim. Als drittes schachspielendes Roboterprodukt von Yuanluobo hat der neue Guoxiang-Roboter eine Vielzahl spezieller technischer Verbesserungen und Innovationen in den Bereichen KI und Maschinenbau erfahren und erstmals die Fähigkeit erkannt, dreidimensionale Schachfiguren aufzunehmen B. durch mechanische Klauen an einem Heimroboter, und führen Sie Mensch-Maschine-Funktionen aus, z. B. Schach spielen, jeder spielt Schach, Überprüfung der Notation usw.

Claude ist auch faul geworden! Netizen: Lernen Sie, sich einen Urlaub zu gönnen

Sep 02, 2024 pm 01:56 PM

Claude ist auch faul geworden! Netizen: Lernen Sie, sich einen Urlaub zu gönnen

Sep 02, 2024 pm 01:56 PM

Der Schulstart steht vor der Tür und nicht nur die Schüler, die bald ins neue Semester starten, sollten auf sich selbst aufpassen, sondern auch die großen KI-Modelle. Vor einiger Zeit war Reddit voller Internetnutzer, die sich darüber beschwerten, dass Claude faul werde. „Sein Niveau ist stark gesunken, es kommt oft zu Pausen und sogar die Ausgabe wird sehr kurz. In der ersten Woche der Veröffentlichung konnte es ein komplettes 4-seitiges Dokument auf einmal übersetzen, aber jetzt kann es nicht einmal eine halbe Seite ausgeben.“ !

Auf der Weltroboterkonferenz wurde dieser Haushaltsroboter, der „die Hoffnung auf eine zukünftige Altenpflege' in sich trägt, umzingelt

Aug 22, 2024 pm 10:35 PM

Auf der Weltroboterkonferenz wurde dieser Haushaltsroboter, der „die Hoffnung auf eine zukünftige Altenpflege' in sich trägt, umzingelt

Aug 22, 2024 pm 10:35 PM

Auf der World Robot Conference in Peking ist die Präsentation humanoider Roboter zum absoluten Mittelpunkt der Szene geworden. Am Stand von Stardust Intelligent führte der KI-Roboterassistent S1 drei große Darbietungen mit Hackbrett, Kampfkunst und Kalligraphie auf Ein Ausstellungsbereich, der sowohl Literatur als auch Kampfkunst umfasst, zog eine große Anzahl von Fachpublikum und Medien an. Durch das elegante Spiel auf den elastischen Saiten demonstriert der S1 eine feine Bedienung und absolute Kontrolle mit Geschwindigkeit, Kraft und Präzision. CCTV News führte einen Sonderbericht über das Nachahmungslernen und die intelligente Steuerung hinter „Kalligraphie“ durch. Firmengründer Lai Jie erklärte, dass hinter den seidenweichen Bewegungen die Hardware-Seite die beste Kraftkontrolle und die menschenähnlichsten Körperindikatoren (Geschwindigkeit, Belastung) anstrebt. usw.), aber auf der KI-Seite werden die realen Bewegungsdaten von Menschen gesammelt, sodass der Roboter stärker werden kann, wenn er auf eine schwierige Situation stößt, und lernen kann, sich schnell weiterzuentwickeln. Und agil

Bekanntgabe der ACL 2024 Awards: Eines der besten Papers zum Thema Oracle Deciphering von HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Bekanntgabe der ACL 2024 Awards: Eines der besten Papers zum Thema Oracle Deciphering von HuaTech, GloVe Time Test Award

Aug 15, 2024 pm 04:37 PM

Bei dieser ACL-Konferenz haben die Teilnehmer viel gewonnen. Die sechstägige ACL2024 findet in Bangkok, Thailand, statt. ACL ist die führende internationale Konferenz im Bereich Computerlinguistik und Verarbeitung natürlicher Sprache. Sie wird von der International Association for Computational Linguistics organisiert und findet jährlich statt. ACL steht seit jeher an erster Stelle, wenn es um akademischen Einfluss im Bereich NLP geht, und ist außerdem eine von der CCF-A empfohlene Konferenz. Die diesjährige ACL-Konferenz ist die 62. und hat mehr als 400 innovative Arbeiten im Bereich NLP eingereicht. Gestern Nachmittag gab die Konferenz den besten Vortrag und weitere Auszeichnungen bekannt. Diesmal gibt es 7 Best Paper Awards (zwei davon unveröffentlicht), 1 Best Theme Paper Award und 35 Outstanding Paper Awards. Die Konferenz verlieh außerdem drei Resource Paper Awards (ResourceAward) und einen Social Impact Award (

Das Team von Li Feifei schlug ReKep vor, um Robotern räumliche Intelligenz zu verleihen und GPT-4o zu integrieren

Sep 03, 2024 pm 05:18 PM

Das Team von Li Feifei schlug ReKep vor, um Robotern räumliche Intelligenz zu verleihen und GPT-4o zu integrieren

Sep 03, 2024 pm 05:18 PM

Tiefe Integration von Vision und Roboterlernen. Wenn zwei Roboterhände reibungslos zusammenarbeiten, um Kleidung zu falten, Tee einzuschenken und Schuhe zu packen, gepaart mit dem humanoiden 1X-Roboter NEO, der in letzter Zeit für Schlagzeilen gesorgt hat, haben Sie vielleicht das Gefühl: Wir scheinen in das Zeitalter der Roboter einzutreten. Tatsächlich sind diese seidigen Bewegungen das Produkt fortschrittlicher Robotertechnologie + exquisitem Rahmendesign + multimodaler großer Modelle. Wir wissen, dass nützliche Roboter oft komplexe und exquisite Interaktionen mit der Umgebung erfordern und die Umgebung als Einschränkungen im räumlichen und zeitlichen Bereich dargestellt werden kann. Wenn Sie beispielsweise möchten, dass ein Roboter Tee einschenkt, muss der Roboter zunächst den Griff der Teekanne ergreifen und sie aufrecht halten, ohne den Tee zu verschütten, und ihn dann sanft bewegen, bis die Öffnung der Kanne mit der Öffnung der Tasse übereinstimmt , und neigen Sie dann die Teekanne in einem bestimmten Winkel. Das

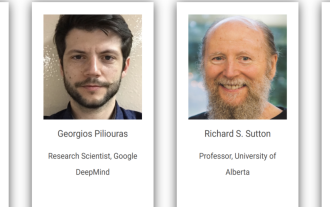

Distributed Artificial Intelligence Conference DAI 2024 Call for Papers: Agent Day, Richard Sutton, der Vater des Reinforcement Learning, wird teilnehmen! Yan Shuicheng, Sergey Levine und DeepMind-Wissenschaftler werden Grundsatzreden halten

Aug 22, 2024 pm 08:02 PM

Distributed Artificial Intelligence Conference DAI 2024 Call for Papers: Agent Day, Richard Sutton, der Vater des Reinforcement Learning, wird teilnehmen! Yan Shuicheng, Sergey Levine und DeepMind-Wissenschaftler werden Grundsatzreden halten

Aug 22, 2024 pm 08:02 PM

Einleitung zur Konferenz Mit der rasanten Entwicklung von Wissenschaft und Technologie ist künstliche Intelligenz zu einer wichtigen Kraft bei der Förderung des sozialen Fortschritts geworden. In dieser Zeit haben wir das Glück, die Innovation und Anwendung der verteilten künstlichen Intelligenz (DAI) mitzuerleben und daran teilzuhaben. Verteilte Künstliche Intelligenz ist ein wichtiger Zweig des Gebiets der Künstlichen Intelligenz, der in den letzten Jahren immer mehr Aufmerksamkeit erregt hat. Durch die Kombination des leistungsstarken Sprachverständnisses und der Generierungsfähigkeiten großer Modelle sind plötzlich Agenten aufgetaucht, die auf natürlichen Sprachinteraktionen, Wissensbegründung, Aufgabenplanung usw. basieren. AIAgent übernimmt das große Sprachmodell und ist zu einem heißen Thema im aktuellen KI-Kreis geworden. Au

Hongmeng Smart Travel S9 und die umfassende Einführungskonferenz für neue Produkte wurden gemeinsam mit einer Reihe neuer Blockbuster-Produkte veröffentlicht

Aug 08, 2024 am 07:02 AM

Hongmeng Smart Travel S9 und die umfassende Einführungskonferenz für neue Produkte wurden gemeinsam mit einer Reihe neuer Blockbuster-Produkte veröffentlicht

Aug 08, 2024 am 07:02 AM

Heute Nachmittag begrüßte Hongmeng Zhixing offiziell neue Marken und neue Autos. Am 6. August veranstaltete Huawei die Hongmeng Smart Xingxing S9 und die Huawei-Konferenz zur Einführung neuer Produkte mit umfassendem Szenario und brachte die Panorama-Smart-Flaggschiff-Limousine Xiangjie S9, das neue M7Pro und Huawei novaFlip, MatePad Pro 12,2 Zoll, das neue MatePad Air und Huawei Bisheng mit Mit vielen neuen Smart-Produkten für alle Szenarien, darunter die Laserdrucker der X1-Serie, FreeBuds6i, WATCHFIT3 und der Smart Screen S5Pro, von Smart Travel über Smart Office bis hin zu Smart Wear baut Huawei weiterhin ein Smart-Ökosystem für alle Szenarien auf, um Verbrauchern ein Smart-Erlebnis zu bieten Internet von allem. Hongmeng Zhixing: Huawei arbeitet mit chinesischen Partnern aus der Automobilindustrie zusammen, um die Modernisierung der Smart-Car-Industrie voranzutreiben