Sur la base de données cliniques limitées, des centaines d'algorithmes médicaux ont été approuvés. Les scientifiques se demandent qui devrait tester les outils et comment le faire au mieux.

Qui teste les systèmes d'IA médicale ?

Les applications médicales basées sur l'IA, comme celle que Singh développe, sont souvent considérées comme des dispositifs médicaux par les organismes de réglementation des médicaments, notamment la FDA américaine et l'Agence britannique de réglementation des médicaments et des produits de santé. Par conséquent, les normes d’examen et d’autorisation d’utilisation sont généralement moins strictes que celles applicables aux produits pharmaceutiques. Seul un petit sous-ensemble de dispositifs, ceux qui peuvent présenter un risque élevé pour les patients, nécessitent des données d'essais cliniques pour être approuvés.

Beaucoup de gens pensent que le seuil est trop bas. Lorsque Gary Weissman, médecin de soins intensifs à l'Université de Pennsylvanie à Philadelphie, a examiné les appareils d'IA approuvés par la FDA dans son domaine, il a constaté que sur les dix appareils qu'il a identifiés, seuls trois citent des données publiées dans leur autorisation. Seuls quatre d'entre eux ont mentionné une évaluation de la sécurité, et aucun n'incluait une évaluation des biais, qui analyse si les résultats de l'outil sont équitables pour différents groupes de patients. "Le problème est que ces appareils peuvent avoir un impact sur les soins au chevet du patient", a-t-il déclaré. "La vie des patients peut dépendre de ces décisions.

Le manque de données rend difficile pour les hôpitaux et les systèmes de santé de décider d'utiliser ou non ces technologies." Dans une situation difficile. Dans certains cas, des incitations financières entrent en jeu. Aux États-Unis, par exemple, les régimes d’assurance maladie remboursent déjà aux hôpitaux l’utilisation de certains dispositifs médicaux d’IA, ce qui les rend financièrement attractifs. Ces institutions peuvent également être enclines à adopter des outils d’IA qui promettent des économies de coûts, même s’ils n’améliorent pas nécessairement les soins aux patients.

Ouyang a déclaré que ces incitations pourraient empêcher les entreprises d’IA d’investir dans les essais cliniques. « De nombreuses entreprises commerciales peuvent imaginer qu’elles vont travailler plus dur pour s’assurer que leurs outils d’IA sont remboursables », a-t-il déclaré.

La situation peut varier selon les marchés. Au Royaume-Uni, par exemple, un plan national de santé financé par le gouvernement pourrait fixer des seuils de preuve plus élevés avant que les centres médicaux puissent acheter des produits spécifiques, a déclaré Xiaoxuan Liu, chercheur clinicien à l'Université de Birmingham qui étudie l'innovation responsable en matière d'intelligence artificielle. une incitation à mener des essais cliniques. "

Une fois qu'un hôpital achète un produit d'IA, il n'a pas besoin de procéder à des tests supplémentaires et peut l'utiliser immédiatement comme les autres logiciels. Cependant, certaines agences reconnaissent que l’approbation réglementaire ne garantit pas que le dispositif sera réellement bénéfique. Ils ont donc choisi de le tester eux-mêmes. Actuellement, bon nombre de ces efforts sont menés et financés par des centres médicaux universitaires, a déclaré Ouyang.

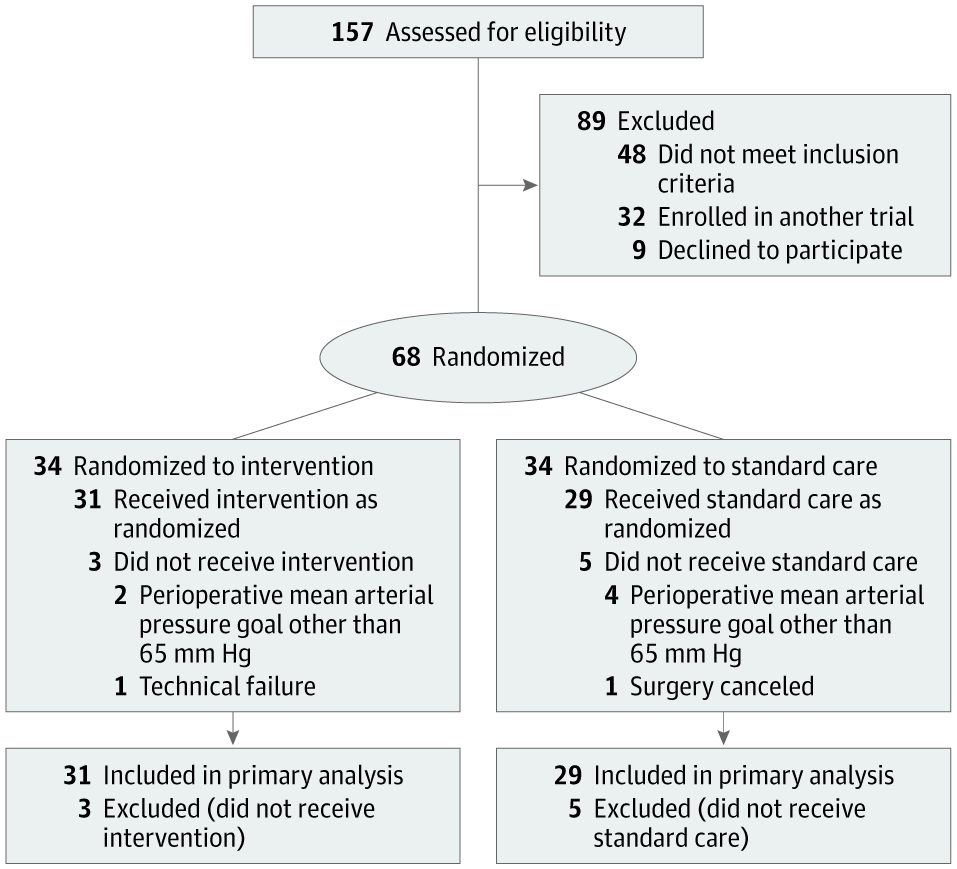

Alexander Vlaar, directeur médical des soins intensifs au centre médical universitaire d'Amsterdam, et Denise Veelo, anesthésiste dans la même institution, ont lancé une telle initiative en 2017. Leur objectif était de tester un algorithme conçu pour prédire la survenue d’une hypotension lors d’une intervention chirurgicale. Cette condition, connue sous le nom d'hypotension peropératoire, peut entraîner des complications potentiellement mortelles telles que des lésions du muscle cardiaque, une crise cardiaque et une insuffisance rénale aiguë, voire la mort.

L'algorithme, développé par Edwards Lifesciences, basé en Californie, utilise les données de forme d'onde artérielle – les lignes rouges avec des pics et des creux affichées sur les moniteurs des services d'urgence ou des unités de soins intensifs. La méthode peut prédire l’hypotension quelques minutes avant qu’elle ne se produise, permettant ainsi une intervention précoce.

Actuellement, la plupart des outils d'IA médicale aident les professionnels de la santé à effectuer le dépistage, le diagnostic ou la planification du traitement. Les patients ne savent peut-être pas que ces technologies sont testées ou utilisées régulièrement dans le cadre de leurs soins, et aucun pays n’exige actuellement que les prestataires de soins de santé le divulguent.

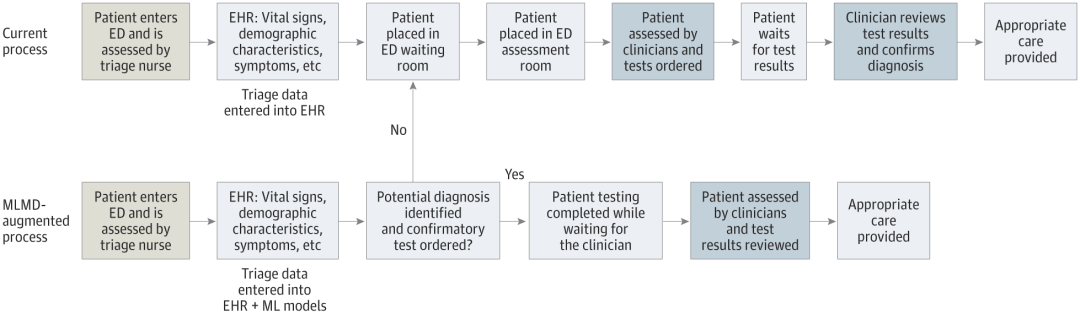

Le débat se poursuit sur ce qu’il faut dire aux patients sur la technologie de l’intelligence artificielle. Certaines de ces applications ont placé la question du consentement du patient sous le feu des projecteurs pour les développeurs. C'est le cas d'un dispositif d'intelligence artificielle que l'équipe de Singh développe pour rationaliser les soins aux enfants dans la salle d'urgence du SickKids.

Ce qui est étonnamment différent de cette technologie, c'est qu'elle soustrait le clinicien à l'ensemble du processus, permettant à l'enfant (ou à son parent ou tuteur) d'être l'utilisateur final.

« Cet outil permet de recueillir des données de triage d'urgence, de faire des prédictions et de donner aux parents leur approbation directe – oui ou non – si leur enfant peut être testé », a déclaré Singh. Cela réduit le fardeau du clinicien et accélère l’ensemble du processus. Mais cela entraîne également de nombreux problèmes sans précédent. Qui est responsable si quelque chose ne va pas pour le patient ? Qui paie si des tests inutiles sont effectués ?

„Wir müssen die Einverständniserklärung der Familien auf automatisierte Weise einholen“, sagte Singh, und die Einwilligung muss zuverlässig und authentisch sein. „Das kann nicht so sein, wie wenn man sich in den sozialen Medien anmeldet, 20 Seiten Kleingedrucktes hat und einfach auf „Akzeptieren“ klickt.

Während Singh und seine Kollegen auf die Finanzierung warten, um Studien an Patienten zu starten, arbeitet das Team mit der Rechtsabteilung zusammen Experten und Beauftragung der Regulierungsbehörde des Landes, Health Canada, mit der Prüfung ihrer Vorschläge und der Abwägung regulatorischer Auswirkungen. Derzeit „ist die Regulierungslandschaft ein bisschen wie im Wilden Westen“, sagte Anna Goldenberg, Informatikerin und Co-Vorsitzende der SickKids Children's Medical Artificial Intelligence Initiative.

Medizinische Einrichtungen setzen KI-Tools umsichtig ein und führen autonome Tests durch.

Kostenfaktoren haben Forscher und medizinische Einrichtungen dazu veranlasst, nach Alternativen zu suchen.

Große medizinische Einrichtungen haben weniger Schwierigkeiten, während kleine Einrichtungen vor größeren Herausforderungen stehen.

Mayo Clinic testet KI-Tool für den Einsatz in kommunalen Gesundheitseinrichtungen.

Die Health AI Alliance hat ein Garantielabor zur Bewertung des Modells eingerichtet.

Duke University bietet interne Testfunktionen zur lokalen Verifizierung von KI-Modellen.

Radiologin Nina Kottler betont die Bedeutung der lokalen Verifizierung.

Menschliche Faktoren müssen beachtet werden, um die Genauigkeit der künstlichen Intelligenz und der Endbenutzer sicherzustellen.

Referenzinhalt: https://www.nature.com/articles/d41586-024-02675-0

Das obige ist der detaillierte Inhalt vonDer Standpunkt der Natur: Die Erprobung künstlicher Intelligenz in der Medizin ist im Chaos. Was ist zu tun?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Welche Methoden gibt es zur Erkennung von ASP-Schwachstellen?

Welche Methoden gibt es zur Erkennung von ASP-Schwachstellen?

Einführung in die Bedeutung eines ungültigen Passworts

Einführung in die Bedeutung eines ungültigen Passworts

Tool zur Abfrage von Website-Subdomains

Tool zur Abfrage von Website-Subdomains

Win10 unterstützt die Festplattenlayoutlösung der Uefi-Firmware nicht

Win10 unterstützt die Festplattenlayoutlösung der Uefi-Firmware nicht

Was sind die Parameter des Festzeltes?

Was sind die Parameter des Festzeltes?

Kann Chatgpt in China verwendet werden?

Kann Chatgpt in China verwendet werden?

So öffnen Sie die WeChat-HTML-Datei

So öffnen Sie die WeChat-HTML-Datei

Y460-Grafikkartenumschaltung

Y460-Grafikkartenumschaltung