Nachrichtenempfehlungen mit großsprachigen Modellen erklären

der Spiegel untersucht mithilfe von großsprachigen Modellen (LLMs), um die Empfehlungen von Nachrichtenartikeln zu verbessern. In einem Offline -Experiment wurde die Fähigkeit eines LLM bewertet, das Leserinteresse auf der Grundlage der Leserhistorie vorherzusagen.

Methodik:

Leserumfragedaten lieferten eine Grundwahrheit der Präferenzen. Die Lesegeschichte und die Artikelinteresse jedes Teilnehmers wurden verwendet. Der Claude 3.5 Sonnet LLM von Anthropic, der als Empfehlungsmotor fungierte, erhielt die Geschichte eines jeden Lesers (Titel und Zusammenfassung), um das Interesse an neuen Artikeln vorherzusagen (erzielte 0-1000). Ein JSON -Ausgangsformat sorgte für strukturierte Ergebnisse. Die Vorhersagen des LLM wurden mit den tatsächlichen Umfragebewertungen verglichen. Eine detaillierte Methodik ist in:

verfügbarEin Ansatz mit gemischten Methoden zur Offline-Bewertung von Nachrichten Empfehlungssystemen

Schlüsselergebnisse:

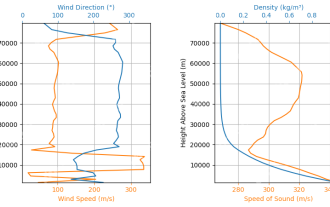

beeindruckende Ergebnisse wurden erzielt. Precision@5 erreichte 56%-Bei der Empfehlung von 5 Artikeln gehörten fast 3 der am besten bewerteten Artikel eines Benutzers. Für 24% der Benutzer wurden 4 oder 5 Top -Artikel korrekt vorhergesagt; Für weitere 41%waren 3 von 5 korrekt. Dies übertrifft zufällige Empfehlungen (38,8%), beliebtenbasierte Empfehlungen (42,1%) und einen früheren Einbettungsansatz (45,4%).

Das Diagramm zeigt die Leistungsaufhebung des LLM -Ansatzes gegenüber anderen Methoden.

Das Diagramm zeigt die Leistungsaufhebung des LLM -Ansatzes gegenüber anderen Methoden.

Spearman-Korrelation, eine zweite Metrik, erreichte 0,41 und übertraf den Einbettungsansatz im Wesentlichen (0,17), was auf ein überlegenes Verständnis der Präferenzstärke hinweist.

Spearman-Korrelation, eine zweite Metrik, erreichte 0,41 und übertraf den Einbettungsansatz im Wesentlichen (0,17), was auf ein überlegenes Verständnis der Präferenzstärke hinweist.

Erklärung:

Die Erklärung des LLM ist ein wesentlicher Vorteil. Ein Beispiel zeigt, wie das System Lesemuster analysiert und Empfehlungen rechtfertigt:

<code>User has 221 articles in reading history Top 5 Predicted by Claude: ... (List of articles with scores and actual ratings) Claude's Analysis: ... (Analysis of reading patterns and scoring rationale)</code>

Diese Transparenz verbessert das Vertrauen und die Personalisierung.

Herausforderungen und zukünftige Anweisungen:

hohe API -Kosten (0,21 USD pro Benutzer) und Verarbeitungsgeschwindigkeit (mehrere Sekunden pro Benutzer) stellen Skalierbarkeitsprobleme auf. Die Erkundung von Open-Source-Modellen und sofortiger Engineering kann diese mildern. Die Einbeziehung zusätzlicher Daten (Lesezeit, Artikelpopularität) könnte die Leistung weiter verbessern.

Schlussfolgerung:

Die starke Vorhersagekraft und Erklärung von LLMs machen sie für die Nachrichtenempfehlung wertvoll. Über Empfehlungen hinaus bieten sie neue Möglichkeiten zur Analyse von Benutzern und Inhaltsreisen und ermöglichen personalisierte Zusammenfassungen und Erkenntnisse.

ANERKENNUNG

Diese Forschung verwendete anonymisierte, aggregierte Benutzerdaten. Eine weitere Diskussion ist über LinkedIn willkommen.

referenzen

[1] Dairui, Liu & Yang, Boming & Du, Honghui & Greene, Derek & Hurley, Neil & Lawlor, Aonghus & Dong, Ruihai & Li, Irene. (2024). Recprompt: Ein selbstverstimmendes Aufforderungs-Framework für Nachrichtenempfehlungen mit großer Sprachmodellen.

Das obige ist der detaillierte Inhalt vonNachrichtenempfehlungen mit großsprachigen Modellen erklären. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1673

1673

14

14

1429

1429

52

52

1333

1333

25

25

1278

1278

29

29

1257

1257

24

24

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Wie baue ich multimodale KI -Agenten mit AGNO -Framework auf?

Apr 23, 2025 am 11:30 AM

Während der Arbeit an Agentic AI navigieren Entwickler häufig die Kompromisse zwischen Geschwindigkeit, Flexibilität und Ressourceneffizienz. Ich habe den Agenten-KI-Framework untersucht und bin auf Agno gestoßen (früher war es phi-

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

OpenAI-Verschiebungen Fokus mit GPT-4.1, priorisiert die Codierung und Kosteneffizienz

Apr 16, 2025 am 11:37 AM

Die Veröffentlichung umfasst drei verschiedene Modelle, GPT-4.1, GPT-4.1 Mini und GPT-4.1-Nano, die einen Zug zu aufgabenspezifischen Optimierungen innerhalb der Landschaft des Großsprachenmodells signalisieren. Diese Modelle ersetzen nicht sofort benutzergerichtete Schnittstellen wie

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

Wie füge ich eine Spalte in SQL hinzu? - Analytics Vidhya

Apr 17, 2025 am 11:43 AM

SQL -Änderungstabellanweisung: Dynamisches Hinzufügen von Spalten zu Ihrer Datenbank Im Datenmanagement ist die Anpassungsfähigkeit von SQL von entscheidender Bedeutung. Müssen Sie Ihre Datenbankstruktur im laufenden Flug anpassen? Die Änderungstabelleerklärung ist Ihre Lösung. Diese Anleitung Details Hinzufügen von Colu

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NG

Apr 15, 2025 am 11:32 AM

Neuer kurzer Kurs zum Einbetten von Modellen von Andrew NG

Apr 15, 2025 am 11:32 AM

Schalte die Kraft des Einbettungsmodelle frei: einen tiefen Eintauchen in den neuen Kurs von Andrew Ng Stellen Sie sich eine Zukunft vor, in der Maschinen Ihre Fragen mit perfekter Genauigkeit verstehen und beantworten. Dies ist keine Science -Fiction; Dank der Fortschritte in der KI wird es zu einem R

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Raketenstartsimulation und -analyse unter Verwendung von Rocketpy - Analytics Vidhya

Apr 19, 2025 am 11:12 AM

Simulieren Raketenstarts mit Rocketpy: Eine umfassende Anleitung Dieser Artikel führt Sie durch die Simulation von Rocketpy-Starts mit hoher Leistung mit Rocketpy, einer leistungsstarken Python-Bibliothek. Wir werden alles abdecken, von der Definition von Raketenkomponenten bis zur Analyse von Simula

Google enthüllt die umfassendste Agentenstrategie bei Cloud nächsten 2025

Apr 15, 2025 am 11:14 AM

Google enthüllt die umfassendste Agentenstrategie bei Cloud nächsten 2025

Apr 15, 2025 am 11:14 AM

Gemini als Grundlage der KI -Strategie von Google Gemini ist der Eckpfeiler der AI -Agentenstrategie von Google und nutzt seine erweiterten multimodalen Funktionen, um Antworten auf Text, Bilder, Audio, Video und Code zu verarbeiten und zu generieren. Entwickelt von Deepm

Open Source Humanoide Roboter, die Sie 3D selbst ausdrucken können: Umarme Gesicht kauft Pollenroboter

Apr 15, 2025 am 11:25 AM

Open Source Humanoide Roboter, die Sie 3D selbst ausdrucken können: Umarme Gesicht kauft Pollenroboter

Apr 15, 2025 am 11:25 AM

"Super froh, Ihnen mitteilen zu können, dass wir Pollenroboter erwerben, um Open-Source-Roboter in die Welt zu bringen", sagte Hugging Face auf X.

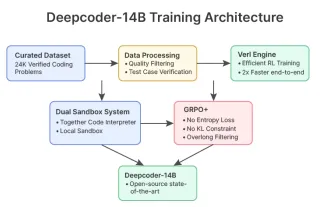

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

DeepCoder-14b: Der Open-Source-Wettbewerb mit O3-Mini und O1

Apr 26, 2025 am 09:07 AM

In einer bedeutenden Entwicklung für die KI-Community haben Agentica und gemeinsam KI ein Open-Source-KI-Codierungsmodell namens DeepCoder-14b veröffentlicht. Angebotsfunktionen der Codegenerierung mit geschlossenen Wettbewerbern wie OpenAI,