Dieser Artikel befasst sich mit den praktischen Aspekten der Feinabstimmungsmodelle (LLMs), die sich auf Codex konzentrieren und als Hauptbeispiele angeben. Es ist der dritte in einer Serie, die GPT-Modelle erforscht und auf früheren Diskussionen über die Voraussetzung und Skalierung aufgebaut wird.

Feinabstimmung ist von entscheidender Bedeutung, da sie zwar viel vielseitig sind, während sie häufig auf spezifische Aufgaben zugeschnitten sind. Darüber hinaus können selbst leistungsstarke Modelle wie GPT-3 mit komplexen Anweisungen und der Aufrechterhaltung von Sicherheits- und ethischen Standards zu kämpfen haben. Dies erfordert Feinabstimmungsstrategien.

Der Artikel zeigt zwei wichtige Herausforderungen der Feinabstimmung: Anpassung an neue Modalitäten (wie die Anpassung von Codex an die Codegenerierung) und das Ausrichten des Modells mit den menschlichen Präferenzen (wie von InstructGPT gezeigt). Beide erfordern sorgfältige Berücksichtigung der Datenerfassung, der Modellarchitektur, der objektiven Funktionen und der Bewertungsmetriken.

Codex: Feinabstimmung für die Codegenerierung

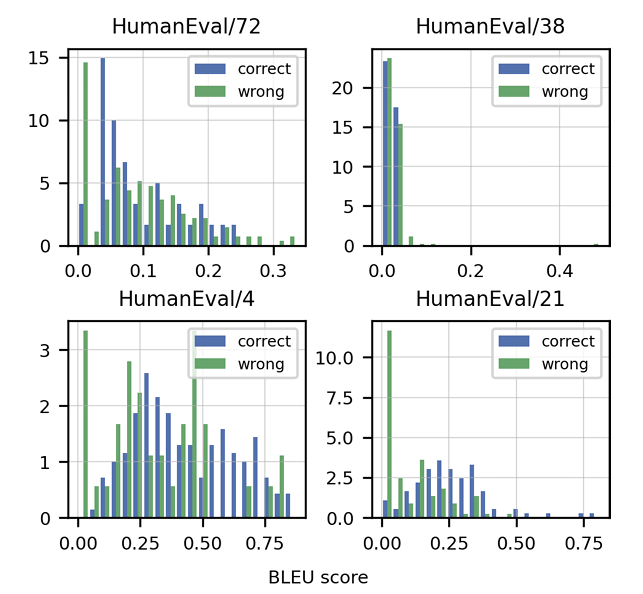

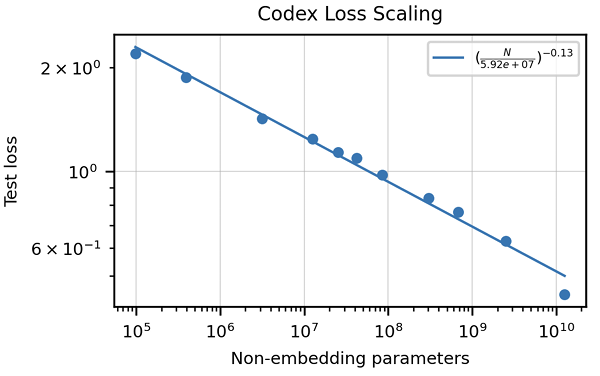

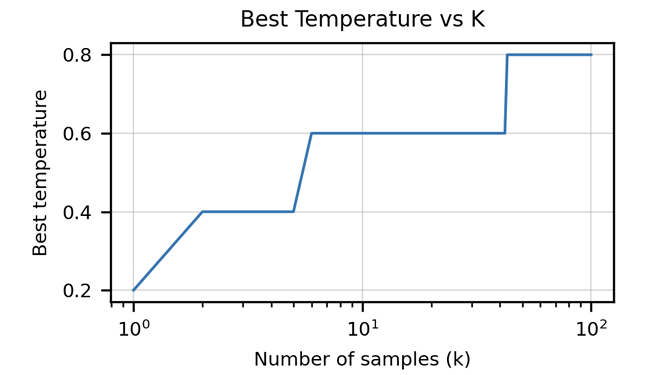

Der Artikel betont die Unzulänglichkeit traditioneller Metriken wie Bleu -Score zur Bewertung der Codegenerierung. Es führt "funktionale Korrektheit" und die pass@k Metrik ein und bietet eine robustere Bewertungsmethode. Die Schaffung des Humaner-Datensatzes, der handgeschriebene Programmierprobleme mit Unit-Tests umfasst, wird ebenfalls hervorgehoben. Datenreinigungsstrategien, die für Codespezifikationen spezifisch sind, werden zusammen mit der Bedeutung der Anpassung von Tokenisierern für die Behandlung der einzigartigen Eigenschaften von Programmiersprachen (z. B. Whitespace -Codierung) erörtert. Der Artikel zeigt Ergebnisse, die die überlegene Leistung von Codex im Vergleich zu GPT-3 auf Humaneval belegen und untersucht die Auswirkungen von Modellgröße und -temperatur auf die Leistung.

lehrgpt und chatgpt: Ausrichtung auf menschliche Einstellungen

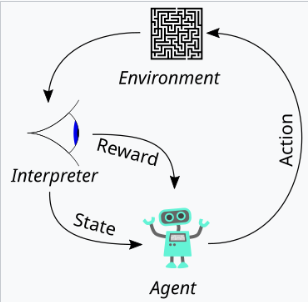

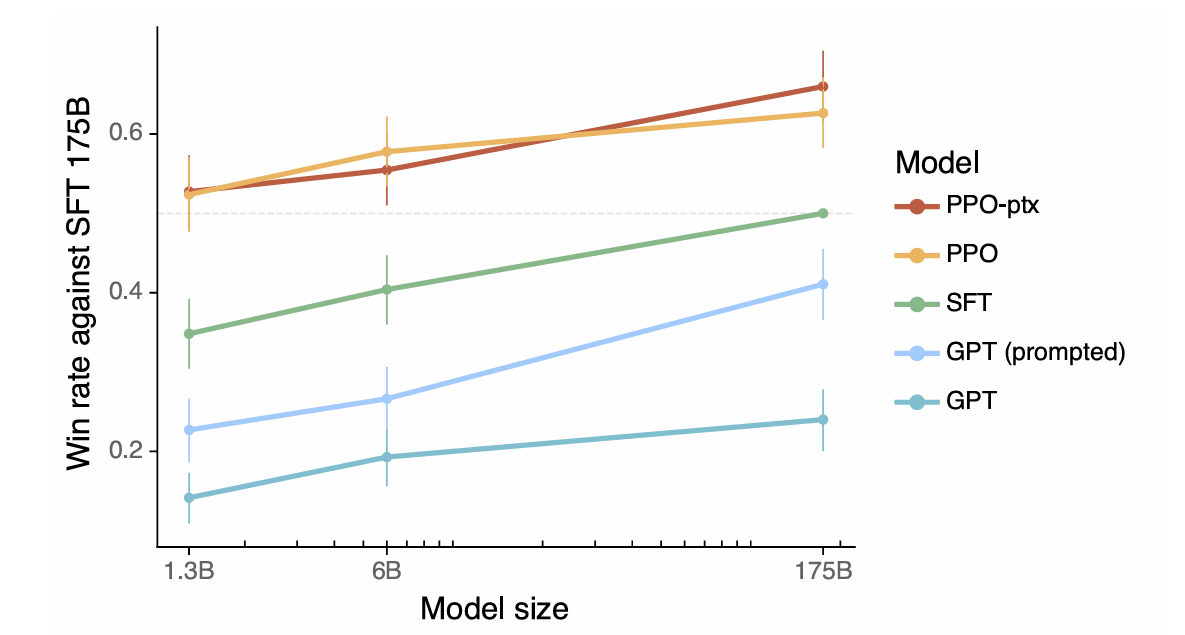

Der Artikel definiert die Ausrichtung als das Modell, das Hilfsbereitschaft, Ehrlichkeit und Harmlosigkeit aufweist. Es erklärt, wie diese Eigenschaften in messbare Aspekte wie Anweisungen, Halluzinationsrate und Vorspannung/Toxizität übersetzt werden. Die Verwendung des Verstärkungslernens aus dem menschlichen Feedback (RLHF) ist detailliert, wobei die drei Stufen dargelegt werden: Sammeln menschlicher Feedback, Schulung eines Belohnungsmodells und Optimierung der Richtlinie mithilfe der proximalen Richtlinienoptimierung (PPO). Der Artikel unterstreicht die Bedeutung der Datenqualitätskontrolle im Prozess der Erfassung des Menschen. Ergebnisse, die die verbesserte Ausrichtung, die verringerte Halluzination und die Abschwächung von Leistungsregressionen vorstellen, werden vorgestellt.

Zusammenfassung und Best Practices

Der Artikel schließt mit der Zusammenfassung der wichtigsten Überlegungen für die Feinabstimmung LLMs, einschließlich der Definition des gewünschten Verhaltens, der Bewertung der Leistung, des Sammelns und Reinigens von Daten, Anpassung der Modellarchitektur und milderung potenzieller negativer Konsequenzen. Es fördert eine sorgfältige Berücksichtigung der Hyperparameterabstimmung und betont die iterative Natur des Feinabstimmungsprozesses.

Das obige ist der detaillierte Inhalt vonVerständnis der Entwicklung von ChatGPT: Teil 3- Erkenntnisse aus Codex und InstructGPT. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

So verlangsamen Sie Videos auf Douyin

So verlangsamen Sie Videos auf Douyin

So erstellen Sie einen neuen Ordner in Pycharm

So erstellen Sie einen neuen Ordner in Pycharm

Welche Office-Software gibt es?

Welche Office-Software gibt es?

So ändern Sie die Größe von Bildern in PS

So ändern Sie die Größe von Bildern in PS

So lösen Sie das Problem, dass der Zugriff beim Starten von Windows 10 verweigert wird

So lösen Sie das Problem, dass der Zugriff beim Starten von Windows 10 verweigert wird

Die Leistung von Mikrocomputern hängt hauptsächlich davon ab

Die Leistung von Mikrocomputern hängt hauptsächlich davon ab

Der Unterschied zwischen a++ und ++a

Der Unterschied zwischen a++ und ++a

So verwenden Sie die datediff-Funktion

So verwenden Sie die datediff-Funktion