Deepseek: revolutionieren KI -Training mit Effizienz, nicht nur Ressourcen

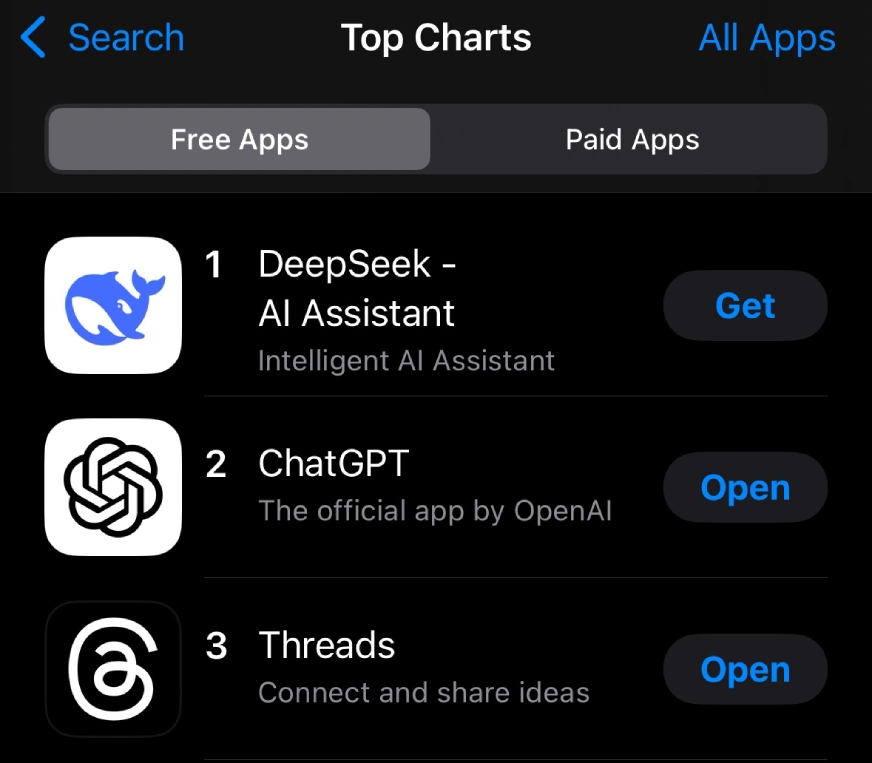

Deepseek erzeugt in der KI -Community erhebliche Aufregung, die für die Erreichung des scheinbar Unmöglichen: Trainings von KI -Modellen mit nur 1/30 der typischen Kosten gelobt wird. Während viele Unternehmen "hochmoderne" Modelle aufweisen, zeigt Deepseek, dass echte Innovation darin liegt, Grenzen zu überschreiten und bisher unerreichbare Ergebnisse zu erzielen. Die App des Unternehmens hat sich sogar an die Spitze der App Store -Charts geschlossen und etablierte Riesen wie ChatGPT übertroffen. Dieses virale Bild zeigt seinen Erfolg:

Deepseeks bemerkenswerte Leistung beruht auf einer Kombination von cleveren Strategien:

Deepseeks Auswirkungen:

Der Erfolg von Deepseek unterstreicht drei Schlüsselprinzipien: gezielte Schulung, intelligente Komprimierung und effiziente Hardwareauslastung. Dieser Ansatz reduziert nicht nur die Kosten, sondern beschleunigt auch den Test- und Innovationszyklus. Das Unternehmen beweist, dass bahnbrechende KI keine unbegrenzten Ressourcen erfordert. Es geht darum, das zu maximieren, was verfügbar ist. Dieses Effizienzmodell ist ein Game-Changer für die Zukunft von AI.

(Hinweis: Der Aufruf zum Handeln und die Liste der verwandten Artikel bleiben unverändert.)

Entsperren Sie die Geheimnisse von Deepseeks kostengünstigem KI-Training! Melden Sie sich heute für unseren Kurs „Gelt begonnen mit Deeksek“ an und lernen Sie, wie Sie leistungsstarke KI -Technologien zu einem Bruchteil der Kosten nutzen können. Verpassen Sie nicht aus - starten Sie jetzt Ihre Reise!

Checkout Unsere detaillierten Artikel über Deepseek Working und Vergleich mit ähnlichen Modellen:

Das obige ist der detaillierte Inhalt vonWie tiefe KI 30 -mal billiger trainierte?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Was ist ein Servomotor?

Was ist ein Servomotor?

Einführung in SEO-Diagnosemethoden

Einführung in SEO-Diagnosemethoden

Was beinhaltet die Datenverschlüsselungsspeicherung?

Was beinhaltet die Datenverschlüsselungsspeicherung?

Was sind die Hauptunterschiede zwischen Linux und Windows?

Was sind die Hauptunterschiede zwischen Linux und Windows?

Ein Speicher, der Informationen direkt mit der CPU austauschen kann, ist ein

Ein Speicher, der Informationen direkt mit der CPU austauschen kann, ist ein

So öffnen Sie eine MDS-Datei

So öffnen Sie eine MDS-Datei

Ändern Sie die Hintergrundfarbe des Wortes in Weiß

Ändern Sie die Hintergrundfarbe des Wortes in Weiß

Welche Entwicklungstools gibt es?

Welche Entwicklungstools gibt es?