Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

LLAMA.CPP -Tutorial: Ein vollständiger Leitfaden zur effizienten LLM -Inferenz und -implementierung

LLAMA.CPP -Tutorial: Ein vollständiger Leitfaden zur effizienten LLM -Inferenz und -implementierung

LLAMA.CPP -Tutorial: Ein vollständiger Leitfaden zur effizienten LLM -Inferenz und -implementierung

llama.cpp: Eine leichte, tragbare Alternative für Großsprachenmodellinferenz

Großsprachige Modelle (LLMs) verändern die Branchen und führen Anwendungen von Kundendienst -Chatbots zu erweiterten Datenanalyse -Tools. Ihre weit verbreitete Akzeptanz wird jedoch häufig durch die Notwendigkeit leistungsstarker Hardware und schnellen Reaktionszeiten behindert. Diese Modelle erfordern in der Regel ausgefeilte Hardware und umfangreiche Abhängigkeiten, wodurch sie sich für die Bereitstellung in ressourcenbezogenen Umgebungen schwierig machen. Lama.cpp (oder llama c) bietet eine Lösung, die eine leichtere, tragbare Alternative zu schwereren Rahmenbedingungen bietet.

llama.cpp Logo (Quelle)

entwickelt von Georgi Gerganov, Lama.cpp implementiert die Llama -Architektur von Meta in c/c effizient. Es verfügt über eine lebendige Open-Source-Community mit über 900 Mitwirkenden, 69.000 Github-Sternen und 2.600 Veröffentlichungen.

wichtige Vorteile von llama.cpp für LLM -Inferenz

- Universelle Kompatibilität: Sein CPU-First-Design vereinfacht die Integration über verschiedene Programmierumgebungen und Plattformen hinweg.

- Feature-Reichtum: Während sich die Funktionen auf Kernfunktionen auf niedriger Ebene konzentriert, spiegelt es Langchains hochrangige Fähigkeiten wider und rationalisiert die Entwicklung (obwohl Skalierbarkeit eine zukünftige Überlegung sein kann).

- Zieloptimierung: Konzentration auf die Lama -Architektur (unter Verwendung von Formaten wie GGML und GGUF) führt zu signifikanten Effizienzgewinnen.

Dieses Tutorial führt Sie durch ein Beispiel für die Textgenerierung mit llama.cpp, beginnend mit den Grundlagen, dem Workflow und der Branchenanwendungen.

llama.cpp Architecture

llama.cpps Foundation sind die ursprünglichen Lama -Modelle, die auf der Transformer -Architektur basieren. Die Entwickler umfassten mehrere Verbesserungen aus Modellen wie Palm:

architektonische Unterschiede zwischen Transformatoren und Lama (von Umar Jamil)

wichtige architektonische Unterscheidungen umfassen:

- Vornormalisierung (GPT3): verbessert die Trainingsstabilität mit RMSNORM.

- Swiglu -Aktivierungsfunktion (Palm): ersetzt Relu für Leistungsverbesserungen.

- Rotationsinbettdings (GPT-NEO): fügt Seil hinzu, nachdem absolute Positionseinbettungen entfernt wurden.

Einrichten der Umgebung

Voraussetzungen:

- python (für pip)

- llama-cpp-python (Python-Bindung für llama.cpp)

Erstellen einer virtuellen Umgebung

Um Installationskonflikte zu vermeiden, erstellen Sie eine virtuelle Umgebung mit Conda:

conda create --name llama-cpp-env conda activate llama-cpp-env

Installieren Sie die Bibliothek:

pip install llama-cpp-python # or pip install llama-cpp-python==0.1.48

Überprüfen Sie die Installation, indem Sie ein einfaches Python -Skript (llama_cpp_script.py) mit: from llama_cpp import Llama erstellen und ausführen. Ein Importfehler zeigt ein Problem an.

Lama.CPP Basics

verstehen Die Kernklasse nimmt mehrere Parameter vor (siehe offizielle Dokumentation für eine vollständige Liste): Llama

- : Pfad zur Modelldatei.

model_path - : Eingabeaufforderung.

prompt - : cpu oder gpu.

device - : Maximale Token erzeugt.

max_tokens - : Liste der Zeichenfolgen, um die Erzeugung zu stoppen.

stop - : steuert Zufälligkeit (0-1).

temperature - : kontrolliert die Vielfalt von Vorhersagen.

top_p - : Eingabeaufforderung in die Ausgabe (true/false).

echo

from llama_cpp import Llama my_llama_model = Llama(model_path="./MY_AWESOME_MODEL") # ... (rest of the parameter definitions and model call) ...

Dieses Projekt verwendet die GGUF-Version von Zephyr-7b-beta vom Umarmungsgesicht.

Zephyrmodell aus dem Umarmungsgesicht (Quelle)

Projektstruktur: [Bild zeigt Projektstruktur]Modellbelastung:

from llama_cpp import Llama my_model_path = "./model/zephyr-7b-beta.Q4_0.gguf" CONTEXT_SIZE = 512 zephyr_model = Llama(model_path=my_model_path, n_ctx=CONTEXT_SIZE)

def generate_text_from_prompt(user_prompt, max_tokens=100, temperature=0.3, top_p=0.1, echo=True, stop=["Q", "\n"]):

# ... (model call and response handling) ...

if __name__ == "__main__":

my_prompt = "What do you think about the inclusion policies in Tech companies?"

response = generate_text_from_prompt(my_prompt)

print(response) # or print(response["choices"][0]["text"].strip()) for just the textBeispiel: ETP4AFRICA verwendet Lama.cpp für seine Bildungs-App, die von Portabilität und Geschwindigkeit profitiert und die Codierungshilfe in Echtzeit ermöglicht.

Schlussfolgerung

Dieses Tutorial bot eine umfassende Anleitung zum Einrichten und Verwenden von LLAMA.CPP für LLM -Inferenz. Es umfasste Umgebungsaufbau, grundlegende Nutzung, ein Beispiel für die Textgenerierung und ein Anwendungsszenario in der realen Welt. Weitere Erforschung von Langchain und Pytorch wird ermutigt.

faqs

(FAQs bleiben mit der ursprünglichen Eingabe gleich, nur für eine bessere Lesbarkeit formatiert)

Das obige ist der detaillierte Inhalt vonLLAMA.CPP -Tutorial: Ein vollständiger Leitfaden zur effizienten LLM -Inferenz und -implementierung. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex

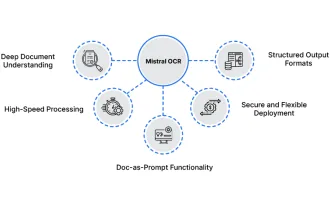

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

Mistral OCR: revolutionäre retrieval-ausgereifte Generation mit multimodalem Dokumentverständnis RAG-Systeme (Abrufen-Augment-Augmented Generation) haben erheblich fortschrittliche KI