Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Mistral 7B Tutorial: Eine Schritt-für-Schritt-Anleitung zur Verwendung und der Feinabstimmung Mistral 7B

Mistral 7B Tutorial: Eine Schritt-für-Schritt-Anleitung zur Verwendung und der Feinabstimmung Mistral 7B

Mistral 7B Tutorial: Eine Schritt-für-Schritt-Anleitung zur Verwendung und der Feinabstimmung Mistral 7B

Dieses Tutorial bietet einen umfassenden Leitfaden zur Verwendung und Feinabstimmung des Mistral 7B-Sprachmodells für natürliche Sprachverarbeitungsaufgaben. Sie erfahren

Zugriff auf Mistral 7BMistral 7b ist über verschiedene Plattformen zugänglich, darunter das Gesicht, die Scheitelpunkt -AI, die Replikate, der Sagemaker -Jumpstart und die Baseten. Dieses Tutorial konzentriert sich auf die Verwendung von Kaggle's "Models" -Funktion für optimierten Zugriff und beseitigt die Notwendigkeit manueller Downloads.

Dieser Abschnitt zeigt das Laden des Modells aus Kaggle und Durchführung von Inferenz. Es sind wichtige Bibliotheksaktualisierungen von entscheidender Bedeutung, um Fehler zu verhindern:

<code>!pip install -q -U transformers !pip install -q -U accelerate !pip install -q -U bitsandbytes</code>

<code>from transformers import AutoTokenizer, AutoModelForCausalLM, BitsAndBytesConfig, pipeline

import torch

bnb_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_quant_type="nf4",

bnb_4bit_use_double_quant=True,

)</code>

- Klicken Sie im rechten Bereich auf "Modelle hinzufügen".

- Suche nach "Mistral 7b", wählen Sie "7B-V0.1-HF" und fügen Sie es hinzu.

- Beachten Sie den Verzeichnispfad.

: transformers

<code>model_name = "/kaggle/input/mistral/pytorch/7b-v0.1-hf/1"

tokenizer = AutoTokenizer.from_pretrained(model_name)

model = AutoModelForCausalLM.from_pretrained(

model_name,

load_in_4bit=True,

quantization_config=bnb_config,

torch_dtype=torch.bfloat16,

device_map="auto",

trust_remote_code=True,

)</code> vereinfacht: pipeline

<code>pipe = pipeline(

"text-generation",

model=model,

tokenizer = tokenizer,

torch_dtype=torch.bfloat16,

device_map="auto"

)</code>

<code>prompt = "As a data scientist, can you explain the concept of regularization in machine learning?"

sequences = pipe(

prompt,

do_sample=True,

max_new_tokens=100,

temperature=0.7,

top_k=50,

top_p=0.95,

num_return_sequences=1,

)

print(sequences[0]['generated_text'])</code>Dieser Abschnitt führt Sie durch die Feinabstimmung Mistral 7b im Datensatz

unter Verwendung von Techniken wie PEFT, 4-Bit-Quantisierung und Qlora. Das Tutorial bezieht sich auch auf einen Leitfaden zu Feinabstimmungslama 2 für einen weiteren Kontext. guanaco-llama2-1k

notwendige Bibliotheken sind installiert:

<code>%%capture %pip install -U bitsandbytes %pip install -U transformers %pip install -U peft %pip install -U accelerate %pip install -U trl</code>

<code>from transformers import AutoModelForCausalLM, AutoTokenizer, BitsAndBytesConfig,HfArgumentParser,TrainingArguments,pipeline, logging from peft import LoraConfig, PeftModel, prepare_model_for_kbit_training, get_peft_model import os,torch, wandb from datasets import load_dataset from trl import SFTTrainer</code>

<code>from kaggle_secrets import UserSecretsClient

user_secrets = UserSecretsClient()

secret_hf = user_secrets.get_secret("HUGGINGFACE_TOKEN")

secret_wandb = user_secrets.get_secret("wandb")</code>

<code>!huggingface-cli login --token $secret_hf

wandb.login(key = secret_wandb)

run = wandb.init(

project='Fine tuning mistral 7B',

job_type="training",

anonymous="allow"

)</code>

<code>base_model = "/kaggle/input/mistral/pytorch/7b-v0.1-hf/1" dataset_name = "mlabonne/guanaco-llama2-1k" new_model = "mistral_7b_guanaco"</code>

Der Datensatz ist geladen und ein Beispiel wird angezeigt:

<code>dataset = load_dataset(dataset_name, split="train") dataset["text"][100]</code>

Das Modell ist mit 4-Bit-Genauigkeit geladen:

<code>bnb_config = BitsAndBytesConfig(

load_in_4bit= True,

bnb_4bit_quant_type= "nf4",

bnb_4bit_compute_dtype= torch.bfloat16,

bnb_4bit_use_double_quant= False,

)

model = AutoModelForCausalLM.from_pretrained(

base_model,

load_in_4bit=True,

quantization_config=bnb_config,

torch_dtype=torch.bfloat16,

device_map="auto",

trust_remote_code=True,

)

model.config.use_cache = False

model.config.pretraining_tp = 1

model.gradient_checkpointing_enable()</code>Der Tokenizer ist geladen und konfiguriert:

<code>tokenizer = AutoTokenizer.from_pretrained(base_model, trust_remote_code=True) tokenizer.padding_side = 'right' tokenizer.pad_token = tokenizer.eos_token tokenizer.add_eos_token = True tokenizer.add_bos_token, tokenizer.add_eos_token</code>

Ein Lora-Adapter wird für eine effiziente Feinabstimmung hinzugefügt:

<code>model = prepare_model_for_kbit_training(model)

peft_config = LoraConfig(

lora_alpha=16,

lora_dropout=0.1,

r=64,

bias="none",

task_type="CAUSAL_LM",

target_modules=["q_proj", "k_proj", "v_proj", "o_proj","gate_proj"]

)

model = get_peft_model(model, peft_config)</code>Trainingsargumente werden definiert:

<code>training_arguments = TrainingArguments(

output_,

num_train_epochs=1,

per_device_train_batch_size=4,

gradient_accumulation_steps=1,

optim="paged_adamw_32bit",

save_steps=25,

logging_steps=25,

learning_rate=2e-4,

weight_decay=0.001,

fp16=False,

bf16=False,

max_grad_norm=0.3,

max_steps=-1,

warmup_ratio=0.03,

group_by_length=True,

lr_scheduler_type="constant",

report_to="wandb"

)</code>Der SftTrainer ist konfiguriert und das Training wird eingeleitet:

<code>!pip install -q -U transformers !pip install -q -U accelerate !pip install -q -U bitsandbytes</code>

Speichern und Schieben des Modells

Das fein abgestimmte Modell wird gerettet und auf den umarmenden Gesichtszentrum gedrückt:

<code>from transformers import AutoTokenizer, AutoModelForCausalLM, BitsAndBytesConfig, pipeline

import torch

bnb_config = BitsAndBytesConfig(

load_in_4bit=True,

bnb_4bit_quant_type="nf4",

bnb_4bit_use_double_quant=True,

)</code>Modellbewertung

Modellleistung wird unter Verwendung von Gewichten und Verzerrungen bewertet. Inferenzbeispiele werden bereitgestellt.

Zusammenführen des Adapters

Der Adapter wird mit dem Basismodell zusammengeführt, und das resultierende Modell wird zum Umarmungsgesicht gedrückt.

Zugriff auf das fein abgestimmte Modell

Das fusionierte Modell ist vom Umarmungsgesicht geladen und die Schlussfolgerung wird demonstriert.

Schlussfolgerung

Das Tutorial schließt mit einer Zusammenfassung der Funktionen von Mistral 7B und einer Zusammenfassung der Schritte, die mit dem Zugriff auf, Feinabstimmung und Bereitstellung des Modells verbunden sind. Ressourcen und FAQs sind ebenfalls enthalten. Der Schwerpunkt liegt auf der Bereitstellung eines praktischen Leitfadens für Benutzer, die mit diesem leistungsstarken Sprachmodell arbeiten können.

Das obige ist der detaillierte Inhalt vonMistral 7B Tutorial: Eine Schritt-für-Schritt-Anleitung zur Verwendung und der Feinabstimmung Mistral 7B. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex

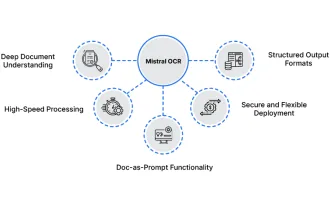

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

Mistral OCR: revolutionäre retrieval-ausgereifte Generation mit multimodalem Dokumentverständnis RAG-Systeme (Abrufen-Augment-Augmented Generation) haben erheblich fortschrittliche KI