Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Zweisprachiger Kraftpaket -Exaone 3.5 setzt neue KI -Standards fest

Zweisprachiger Kraftpaket -Exaone 3.5 setzt neue KI -Standards fest

Zweisprachiger Kraftpaket -Exaone 3.5 setzt neue KI -Standards fest

lg ai Forschung enthüllt Exaone 3.5: ein leistungsstarkes, mehrsprachiges großes Sprachmodell. Diese neueste Iteration bietet verbesserte KI -Fähigkeiten und -Angängigkeit, die im Dezember 2024 veröffentlicht wurde. Exaone 3.5 bietet drei verschiedene Modellgrößen: 2,4 Milliarden, 7,8 Milliarden und 32 Milliarden Parameter, die jeweils für unterschiedliche Leistungsanforderungen optimiert wurden - von mobilen Anwendungen bis zu rechnerten Aufgaben. Seine zweisprachigen Kenntnisse in englischer und koreanischer Bedeutung, kombiniert mit verbessertem Anweisungsverfolgung und einem lang Kontextverständnis, positioniert es als vielseitiges Werkzeug für verschiedene Sektoren.

Key -Lernpunkte

- Erfassen Sie die Architektur- und Designauswahl hinter Exaone 3.5, einschließlich des Decodierer-Transformatormodells und der erweiterten Kontextfunktionen.

- Erforschen Sie seine zweisprachigen Stärken (Englisch und Koreanisch) und seine Anpassungsfähigkeit an mehrsprachige Umgebungen.

- Verstehen Sie den zweistufigen Trainingsprozess und zeigen, wie feinstabort die Anlehnung und das lang Kontextverständnis verfeinert.

- Erfahren Sie mehr über fortgeschrittene Trainingsmethoden wie Datendekontamination und direkte Präferenzoptimierung (DPO).

- Analysieren Sie die Leistung von Exaone 3.5 in verschiedenen realen Anwendungen, Langkontextverarbeitung und allgemeinen Domänenaufgaben.

*Dieser Artikel ist Teil des Blogathons *** Data Science.

Inhaltsverzeichnis

- Wie argumentationsbasierte LLMs funktionieren?

- exaone 3.5 Modellarchitektur

- architektonische Innovationen in Exaone 3.5

- DIPO -Vorzugsoptimierung (DEC -Präferenzoptimierung) Verständnis

- Die Datendekontaminationsprozess

- Performance Benchmarks

- Ausführen von Exaone 3.5 (7 Milliarden Parametermodell) auf Google Colab über Ollama

- Modelltests mit verschiedenen Eingabeaufforderungen

- Anwendungsbeispiele mit realer Welt

- Schlussfolgerung

- häufig gestellte Fragen

Wie argumentationsbasierte LLMs funktionieren?

argumentationsbasierte LLMs wie Exaone 3.5, Excel bei komplexen Aufgaben, die logisches Denken, Problemlösung und Mustererkennung erfordern. Aufbauend auf fortschrittlichen transformatorbasierten Netzwerken verarbeiten sie effizient sequentielle Daten und umfangreiche Kontexte. Auf massiven Datensätzen trainiert, identifizieren sie Beziehungen innerhalb von Informationen, generieren genaue Antworten, Lösung von Problemen und genau folgende Anweisungen.

Techniken wie beaufsichtigte Feinabstimmungen (SFT) und DIPO-Präferenzoptimierung (DPO) verfeinern ihre menschlichen Argumentationsfunktionen in verschiedenen Anwendungen, von einfachen bis komplexen Entscheidungsfindung.

exaone 3.5 Modellarchitektur

exaone 3.5 verwendet eine Nur-Decoder-Transformatorarchitektur, ein Standard für das moderne LLM-Design, das für seine Effizienz bei der Verarbeitung sequentieller Daten bekannt ist. Diese Architektur ist für den Anweisungen optimiert, um ein effektives Verständnis und die Ausführung von Benutzerbefehlen zu gewährleisten. Schlüsselspezifikationen in seinen drei Varianten (2,4B, 7,8B und 32B Parameter) sind:

- Maximale Kontextlänge : 32.768 Token

- Ebenen : 32

- Feedforward Dimension : 14.336

architektonische Innovationen in Exaone 3.5

exaone 3.5 enthält signifikante architektonische Verbesserungen, die die erweiterte Kontextverarbeitung verbessern und genaue, benutzergerichtete Ausgaben sicherstellen. Diese Innovationen definieren die Effizienz- und Leistungsstandards in LLMs neu.

- Erweiterte Kontextlänge : Eine wesentlich erhöhte maximale Kontextlänge (32.768 Token) ermöglicht eine effektive Verarbeitung größerer Texte, ohne die Kohärenz zu beeinträchtigen.

- zweistufiges Training: exaone 3.5 verwendet einen zweistufigen Trainingsprozess: allgemeine Training, gefolgt von aufgabenspezifischer Feinabstimmungen für ein langes Verständnis des lang Kontextes. Pre-Training beseitigt Duplikate und persönlich identifizierbare Informationen, steigern die Leistung und die Reduzierung der Infrastrukturkosten. Nach dem Training, SFT und DPO verbessern die Anweisungen und die Ausrichtung der Benutzerpräferenz.

- Dekontaminationsprozess: Ein strenger Dekontaminationsprozess beseitigt voreingenommene Daten aus dem Trainingssatz, um unvoreingenommene Bewertungen zu gewährleisten. Dies beinhaltet einen iterativen Vergleich von Trainingsdaten mit Bewertungsdatensätzen.

DIPO -Vorzugsoptimierung (DEC -Präferenzoptimierung)

VerständnisDPO ist ein neuer Algorithmus für die Feinabstimmung von LLMs, indem sie sie direkt auf menschliche Präferenzen ausrichten und die Komplexität des traditionellen Verstärkungslernens umgehen. Im Gegensatz zu RLHF, das eine komplizierte Belohnungsmodellierung erfordert, vereinfacht DPO den Prozess mit einem einfachen Klassifizierungsverlust, um die Modellantworten anhand der Benutzerpräferenzen zu optimieren. Dies führt zu stabilem, effizientem und rechenintensivem Training. Beachten Sie, dass DPO einen Präferenzdatensatz benötigt, der Tripletts enthält (Eingabeaufforderung, gewählte Antwort, abgelehnte Antwort).

Die Datendekontaminationsprozess

Datendekontamination ist ein entscheidender Prozess zur Verbesserung der Verallgemeinerung des Modells, indem kontaminierte Beispiele aus dem Trainingsdatensatz entfernt werden. Web-Crawled-Daten enthalten häufig Tests mit Testeinstellungen, was zu voreingenommenen Bewertungen führt. Exaone 3.5 verwendet eine Matching-Methode auf Substring-Ebene, um diese kontaminierten Proben zu identifizieren und zu entfernen.

Diese architektonischen Verbesserungen ermöglichen es Exaone 3.5, in realen Anwendungen zu übertreffen und gleichzeitig eine starke Leistung über Benchmarks zu erhalten.

Performance Benchmarks

exaone 3.5 Modellbewertungen werden in drei Gruppen eingeteilt:

- reale Anwendungsfälle: Bewertet die Fähigkeit des Modells, praktische Benutzeranfragen zu verstehen und auf reagierte.

- Langkontextverarbeitung: Bewertet die Fähigkeit des Modells, Informationen aus erweiterten Texten zu verarbeiten und zu extrahieren.

- Allgemeine Domänenaufgaben: testet die Fähigkeiten in Mathematik, Codierung und wissensbasierten Aufgaben.

Die Ergebnisse zeigen die starke Leistung von Exaone 3.5 in allen drei Kategorien und übertreffen oft vergleichbare Modelle.

Ausführen von Exaone 3.5 (7 Milliarden Parametermodell) auf Google Colab über Ollama

In diesem Abschnitt wird das Einrichten und Abfragen des 7B -Parameter -Exaone 3.5 -Modells auf Google Colab mit ullama eingerichtet und abfragen.

(Schritte 1-4: Code-Beispiele für Installation, OLLAMA-Setup, Modell-Download und Abfragen finden Sie im Originaltext und bleiben hier unverändert.)

Modelltests mit verschiedenen Eingabeaufforderungen

(Beispiele für das Testen des Modells mit verschiedenen Eingabeaufforderungen, einschließlich "Nadel im Heuheuge" und "Ancestral Trace" -Andienungen, werden im Originaltext bereitgestellt und bleiben hier unverändert.)

Anwendungsbeispiele mit realer Welt

" Schlussfolgerung

exaone 3.5 stellt einen signifikanten Sprung in der LLM -Technologie dar und bietet drei skalierbare Modellgrößen für verschiedene Anwendungen. Die fortschrittliche Architektur, die starke Anleitung und mehrsprachige Fähigkeiten machen es zu einem wertvollen Instrument für Forscher und Unternehmen. Seine starke Leistung über Benchmarks in Verbindung mit ethischen KI -Entwicklungspraktiken verfestigt sich seine Position als führender LLM.(wichtige Abschnitte und häufig gestellte Fragen bleiben gegenüber dem Originaltext unverändert.)

Hinweis:

Bild -URLs bleiben unverändert.Das obige ist der detaillierte Inhalt vonZweisprachiger Kraftpaket -Exaone 3.5 setzt neue KI -Standards fest. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google: Wettervorhersage mit Gencast Mini Demo

Mar 16, 2025 pm 01:46 PM

Gencast von Google Deepmind: Eine revolutionäre KI für die Wettervorhersage Die Wettervorhersage wurde einer dramatischen Transformation unterzogen, die sich von rudimentären Beobachtungen zu ausgefeilten AI-angetriebenen Vorhersagen überschreitet. Google DeepMinds Gencast, ein Bodenbrei

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

O1 gegen GPT-4O: Ist OpenAIs neues Modell besser als GPT-4O?

Mar 16, 2025 am 11:47 AM

Openais O1: Ein 12-tägiger Geschenkbummel beginnt mit ihrem bisher mächtigsten Modell Die Ankunft im Dezember bringt eine globale Verlangsamung, Schneeflocken in einigen Teilen der Welt, aber Openai fängt gerade erst an. Sam Altman und sein Team starten ein 12-tägiges Geschenk Ex

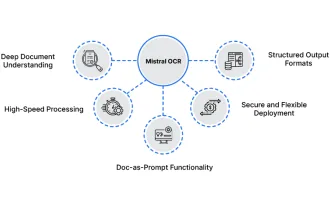

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

Mistral OCR: revolutionäre retrieval-ausgereifte Generation mit multimodalem Dokumentverständnis RAG-Systeme (Abrufen-Augment-Augmented Generation) haben erheblich fortschrittliche KI