Modernbert: Ein leistungsstarkes und effizientes NLP -Modell

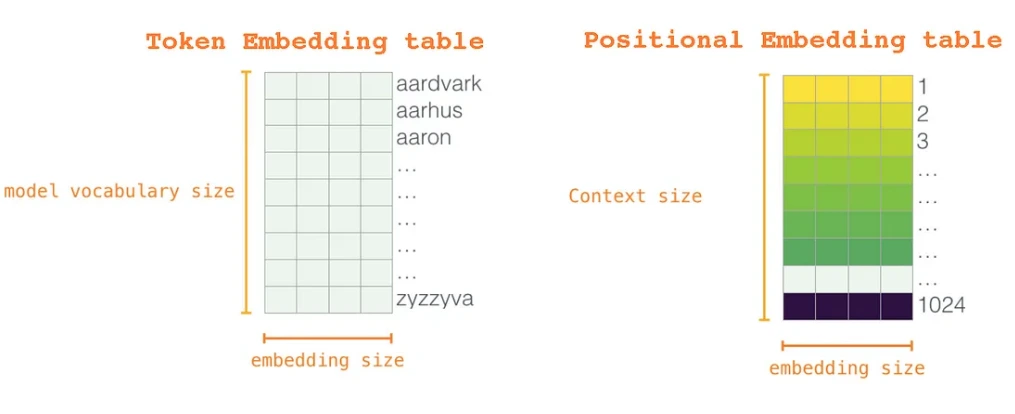

Modernbert verbessert die ursprüngliche Bert -Architektur erheblich und bietet eine verbesserte Leistung und Effizienz für verschiedene Aufgaben der natürlichen Sprachverarbeitung (NLP). Dieses fortschrittliche Modell umfasst modernste Architekturverbesserungen und innovative Trainingsmethoden und erweitert seine Fähigkeiten für Entwickler im Bereich des maschinellen Lernens. Die erweiterte Kontextlänge von 8.192 Token-ein wesentlicher Anstieg traditioneller Modelle-setzt sich für die Bewältigung komplexer Herausforderungen wie dem Abrufen von Langdokumenten und dem Verständnis des Codeverständnisses mit bemerkenswerter Genauigkeit. Diese Effizienz in Verbindung mit reduziertem Speicherverbrauch macht Modernbert ideal zur Optimierung von NLP-Anwendungen, von hoch entwickelten Suchmaschinen bis hin zu KI-angetriebenen Codierungsumgebungen.

Modernberts überlegene Leistung ergibt sich aus mehreren wichtigen Innovationen:

| Feature | ModernBERT | BERT |

|---|---|---|

| Context Length | 8,192 tokens | 512 tokens |

| Positional Embeddings | Rotary Positional Embeddings (RoPE) | Traditional absolute positional embeddings |

| Activation Function | GeGLU | GELU |

| Training Data | 2 trillion tokens (diverse sources including code) | Primarily Wikipedia |

| Model Sizes | Base (139M parameters), Large (395M parameters) | Base (110M parameters), Large (340M parameters) |

| Speed & Efficiency | Significantly faster training and inference | Slower, especially with longer sequences |

Die Funktionen von Modernbert erstrecken sich auf verschiedene Anwendungen:

Ein vereinfachtes Lappensystem unter Verwendung von Modernbert -Einbettungen und Weaviate wird nachstehend demonstriert. (Hinweis: Dieser Abschnitt erfordert die Installation mehrerer Bibliotheken und ein umarmendes Gesichtskonto mit einem Autorisierungs -Token. Der Code setzt auch den Zugriff auf einen geeigneten Datensatz und einen OpenAI -API -Schlüssel aus.) Der vollständige Code wird hier für die Kürze ausgelassen, veranschaulicht jedoch die Integration von Modernbert zum Einbetten der Generation und des Abrufens innerhalb einer Rag -Pipeline.

Modernbert präsentiert einen erheblichen Fortschritt in der NLP und kombiniert eine verbesserte Leistung mit verbesserter Effizienz. Die Fähigkeit, lange Sequenzen und seine vielfältigen Trainingsdaten zu bewältigen, machen es zu einem vielseitigen Tool für zahlreiche Anwendungen. Die Integration innovativer Techniken wie Rope und Geglu positioniert Modernbert als führendes Modell für die Anpassung komplexer NLP und Code-bezogene Aufgaben.

(Hinweis: Die Bild -URLs bleiben unverändert.)

Das obige ist der detaillierte Inhalt vonVerschiebung des Potenzials von Lumpen mit Modernbert. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Der Unterschied zwischen PD-Schnellladen und allgemeinem Schnellladen

Der Unterschied zwischen PD-Schnellladen und allgemeinem Schnellladen

So geben Sie den Drucker in Win10 frei

So geben Sie den Drucker in Win10 frei

WAN-Zugriffseinstellungen

WAN-Zugriffseinstellungen

Java-Export Excel

Java-Export Excel

Virtuelle Mobiltelefonnummer, um den Bestätigungscode zu erhalten

Virtuelle Mobiltelefonnummer, um den Bestätigungscode zu erhalten

Der Unterschied zwischen leichtgewichtigen Anwendungsservern und Cloud-Servern

Der Unterschied zwischen leichtgewichtigen Anwendungsservern und Cloud-Servern

Vollständige Sammlung von HTML-Tags

Vollständige Sammlung von HTML-Tags

Die Rolle des Index

Die Rolle des Index