So erstellen Sie LLM -Anwendungen mit Langchain Tutorial

Die Fähigkeiten von Großsprachemodellen (LLMs) wie OpenAIs GPT-3, Google Bert und META-LLAMA transformieren verschiedene Branchen, indem sie die Erzeugung verschiedener Texttypen ermöglichen, von Marketinginhalten und Data-Science-Code bis hin zu Gedichten. Obwohl Chatgpt aufgrund seiner benutzerfreundlichen Chat-Schnittstelle erhebliche Aufmerksamkeit auf sich gezogen hat, gibt es zahlreiche ungenutzte Möglichkeiten für die Nutzung von LLMs, indem sie in verschiedene Softwareanwendungen integriert werden. Hier erkunden wir Langchain - einen Open -Source -Python -Framework zum Erstellen von Anwendungen basierend auf großen Sprachmodellen wie GPT.

Erfahren Sie mehr über das Erstellen von AI-Anwendungen mit Langchain in unserem

multimodalen AI-Anwendungen mit Langchain und dem OpenAI-API-AI-Code entlang, in dem Sie entdecken, wie Sie YouTube-Videoinhalte mit dem Flüstern von Sprachrede-Text-AI transkribieren und anschließend Fragen zu Fragen zu den Inhalten stellen können.

Was sind große Sprachmodelle (LLMs)?

Großspracher Modelle (LLMs) beziehen sich auf erweiterte künstliche Intelligenzsysteme, mit denen menschliche Text verstanden und generiert werden. Diese Modelle werden in großen Datenmengen geschult, sodass sie komplexe Muster erfassen, Sprachnuancen verstehen und kohärente Antworten erzeugen. LLMs können verschiedene sprachbezogene Aufgaben ausführen, einschließlich Sprachübersetzung, Textabschluss, Zusammenfassung und sogar Konversationsinteraktionen. GPT ist ein Beispiel für LLM.

llm ist eine Art generativer AI. Wenn Sie etwas über generative KI kennenlernen möchten und wie sie Ihre Kreativität stärken kann, überprüfen Sie unsere Blogs, um generative KI zu verwenden, um Ihre Kreativität und unseren Podcast in der generativen AI -Revolution zu steigern. Sie können sich auch für unseren bevorstehenden Kurs zu Großsprachmodellen -Konzepten anmelden.

Einführung in Langchain

Langchain ist ein Open-Source-Framework, mit dem die Entwicklung von Anwendungen, die von Großsprachenmodellen (LLMs) betrieben werden, erleichtert werden. Es bietet eine Reihe von Werkzeugen, Komponenten und Schnittstellen, die die Konstruktion von LLM-zentrierten Anwendungen vereinfachen. Bei Langchain wird es mühelos, Interaktionen mit Sprachmodellen zu verwalten, verschiedene Komponenten nahtlos zu verknüpfen und Ressourcen wie APIs und Datenbanken einzubeziehen. Sie können mehr über Langchain für Daten Engineering und Datenanwendungen in einem separaten Artikel erfahren.

Die Langchain -Plattform verfügt über eine Sammlung von APIs, die Entwickler in ihre Anwendungen einbetten können, und befähigen sie, Sprachverarbeitungsfunktionen zu infusionieren, ohne alles von Grund auf aufbauen zu müssen. Daher vereinfacht Langchain effizient den Prozess der Herstellung von LLM-basierten Anwendungen und ist für Entwickler im gesamten Fachwissen geeignet.

Anwendungen wie Chatbots, virtuelle Assistenten, Sprachübersetzungsversorgungsunternehmen und Tools für Stimmungsanalyse sind alle Instanzen von LLM-Antriebs-Apps. Entwickler nutzen Langchain, um maßgeschneiderte modellbasierte Anwendungen zu erstellen, die den spezifischen Anforderungen gerecht werden.

Mit den kontinuierlichen Fortschritten und einer breiteren Einführung der Verarbeitung natürlicher Sprache wird erwartet, dass die potenziellen Anwendungen dieser Technologie praktisch grenzenlos sind. Hier sind einige bemerkenswerte Eigenschaften von Langchain:

1. Abgreifer Eingabeaufforderungen, Ihre spezifischen Anforderungen zu erfüllen

2. Konstruktion von Kettenverbindungskomponenten für erweiterte Nutzungsszenarien

3. Integration von Modellen für die Datenerweiterung und Zugriff auf erstklassige Sprachmodellfunktionen wie GPT und Huggingface-Hub.

4. Vielseitige Komponenten, mit denen das Mischen und Anpassung für bestimmte Anforderungen

ermöglicht wird5. Manipulation des Kontextes, um den Kontext für verbesserte Präzisions- und Benutzerzufriedenheit zu etablieren und zu führen.

Langchain in Python

einrichtenDie Installation von Langchain in Python ist ziemlich einfach. Sie können es entweder mit PIP oder Conda installieren.

mit PIP

pip install langchain

mit Conda

install langchain -c conda-forge

Auf diese Weise werden die Grundbedürfnisse von Langchain eingerichtet. Ein Großteil von Langchains Nützlichkeit wird realisiert, wenn es in verschiedene Modellanbieter, Datenspeicher und dergleichen integriert ist.

standardmäßig sind die für diese Integrationen erforderlichen Abhängigkeiten in der Installation nicht enthalten. Um alle Abhängigkeiten zu installieren, können Sie den folgenden Befehl ausführen:

pip install langchain[all]

Die endgültige Option besteht darin, die Bibliothek aus der Quelle aus zu erstellen. In diesem Fall können Sie das Projekt aus seinem Github -Repo klonen.

Umgebungs -Setup

Die Verwendung von Langchain erfordert normalerweise Integrationen mit verschiedenen Modellanbietern, Datenspeichern, APIs und ähnlichen Komponenten. Wie bei jeder Integration müssen wir angemessene und relevante API -Schlüssel für Langchain zur Funktion zur Verfügung stellen. Es gibt zwei Möglichkeiten, dies zu erreichen:

1. Einrichten der Schlüssel als Umgebungsvariable

OPENAI_API_KEY="..."

Wenn Sie es vorziehen, keine Umgebungsvariable festzulegen, können Sie den Schlüssel über den Parameter OpenAI_API_KEY direkt übergeben, wenn Sie die OpenAI -LLM -Klasse initiieren:

2. Richten Sie den Schlüssel direkt in der entsprechenden Klasse ein

pip install langchain

Schlüsselkomponenten von Langchain

Langchain sticht aufgrund ihrer Betonung auf Flexibilität und Modularität auf. Es zerlegt die Pipeline für natürliche Sprachverarbeitung in separate Komponenten und ermöglicht den Entwicklern, Workflows entsprechend ihren Anforderungen anzupassen. Diese Anpassungsfähigkeit macht Langchain ideal, um AI -Anwendungen in verschiedenen Szenarien und Sektoren zu konstruieren.

Komponenten und Ketten

In Langchain sind Komponenten Module, die spezifische Funktionen in der Sprachverarbeitungspipeline ausführen. Diese Komponenten können für maßgeschneiderte Workflows wie eine Chatbot -Kette für Kundendienst mit Stimmungsanalyse, Absichtserkennung und Reaktionserzeugungsmodulen in "Ketten" verknüpft werden.

Eingabeaufforderung Vorlagen

Eingabeaufforderung Vorlagen sind wiederverwendbare vordefinierte Eingabeaufforderungen über Ketten. Diese Vorlagen können dynamisch und anpassungsfähig werden, indem bestimmte "Werte" eingefügt werden. Beispielsweise kann eine Eingabeaufforderung, nach dem Namen eines Benutzers zu fragen, durch Einfügen eines bestimmten Wertes personalisiert werden. Diese Funktion ist von Vorteil, um Eingabeaufforderungen basierend auf dynamischen Ressourcen zu generieren.

Vektor speichert

Diese werden verwendet, um Informationen über Einbettungen zu speichern und zu durchsuchen, wodurch numerische Darstellungen von Dokumentbedeutungen analysiert werden. VectorStore dient als Lagereinrichtung für diese Einbettungen, die eine effiziente Suche auf der Grundlage der semantischen Ähnlichkeit ermöglichen.

Indizes und Retriever

Indexes dienen als Datenbanken, die Details und Metadaten über die Schulungsdaten des Modells speichern, während die Wiederholung dieses Index nach spezifischen Informationen schnell durchsucht. Dies verbessert die Antworten des Modells durch Bereitstellung von Kontext und verwandten Informationen.

Ausgangsparser

Ausgangsparser kommen ins Spiel, um die vom Modell generierten Antworten zu verwalten und zu verfeinern. Sie können unerwünschte Inhalte beseitigen, das Ausgangsformat anpassen oder zusätzliche Daten auf die Antwort ergänzen. So helfen Ausgangsparser dazu, strukturierte Ergebnisse wie JSON -Objekte aus den Antworten des Sprachmodells zu extrahieren.

Beispielauswahl

Beispiel -Selektoren in Langchain dienen dazu, geeignete Instanzen aus den Trainingsdaten des Modells zu identifizieren, wodurch die Genauigkeit und Reflexion der generierten Antworten verbessert werden. Diese Selektoren können angepasst werden, um bestimmte Arten von Beispielen zu bevorzugen oder nicht verwandte herauszufiltern, was eine maßgeschneiderte AI -Antwort basierend auf der Benutzereingabe liefert.

Agenten

Agenten sind einzigartige Langchain -Instanzen mit jeweils spezifischen Eingabeaufforderungen, Speicher und Kette für einen bestimmten Anwendungsfall. Sie können auf verschiedenen Plattformen eingesetzt werden, einschließlich Web, Mobile und Chatbots, die sich an ein breites Publikum kümmern.

So erstellen Sie eine Sprachmodellanwendung in Langchain

Langchain bietet eine LLM -Klasse, die für die Vernetzung mit verschiedenen Sprachmodellanbietern wie OpenAI, Cohere und Umarmungsgesicht entwickelt wurde. Die grundlegendste Funktionalität eines LLM ist das Generieren von Text. Es ist sehr unkompliziert, eine Anwendung mit Langchain zu erstellen, die eine String -Eingabeaufforderung annimmt und die Ausgabe zurückgibt.

pip install langchain

Ausgabe :

& gt; & gt; & gt; "Was bekommen Sie, wenn Sie an Daten basteln? Ein Datenwissenschaftler!"

Im obigen Beispiel verwenden wir ein Text-ada-ada-001-Modell von OpenAI. Wenn Sie das für Open-Source-Modelle von Suggingface tauschen möchten, ist dies eine einfache Änderung:

install langchain -c conda-forge

Sie können die Umarmung der Face Hub -Token -ID von Ihrem HF -Konto erhalten.

Wenn Sie mehrere Eingabeaufforderungen haben, können Sie eine Liste mit Eingabeaufforderungen gleichzeitig mit der Methode generieren:

pip install langchain[all]

Ausgabe :

Dies ist die einfachste App, die Sie mit Langchain erstellen können. Es dauert eine Eingabeaufforderung, sendet es an ein Sprachmodell Ihrer Wahl und gibt die Antwort zurück. Es gibt viele Parameter, die Sie steuern können, z. B. "Temperatur". Der Temperaturparameter passt die Zufälligkeit des Ausgangs an und wird standardmäßig auf 0,7 eingestellt.

Verwaltung von Eingabeaufforderungen für LLMs in Langchain

llms haben besondere APIs. Während es intuitiv erscheint, Eingabeaufforderungen in der natürlichen Sprache einzugeben, erfordert es jedoch eine gewisse Anpassung der Eingabeaufforderung, um die gewünschte Ausgabe von einem LLM zu erzielen. Dieser Anpassungsprozess wird als promptes Engineering bezeichnet. Sobald Sie eine gute Eingabeaufforderung haben, möchten Sie sie möglicherweise als Vorlage für andere Zwecke verwenden.

Mit einer Eingabeaufforderung in Langchain können Sie Vorlagen verwenden, um eine Eingabeaufforderung zu generieren. Dies ist nützlich, wenn Sie dieselbe Eingabeaufforderung an mehreren Stellen verwenden möchten, jedoch mit bestimmten Werten geändert werden.

OPENAI_API_KEY="..."

Ausgabe

:1. Klettere den Eiffelturm und nehme die atemberaubende Aussicht auf die Stadt

auf 2. Genießen Sie eine romantische Kreuzfahrt entlang der Flusswelle und bewundern Sie die schöne Architektur entlang der Flussufer

3. Erkunden Sie den Louvre und bewundern Sie die weltbekannten Kunstwerke, die ausgestellt sind

Wenn Sie diese Eingabeaufforderung jetzt für eine andere Stadt wiederverwenden möchten, müssen Sie nur die Variable user_input ändern. Ich habe es jetzt von Paris nach Cancun, Mexiko, geändert. Sehen Sie, wie die Ausgabe geändert wurde:

Ausgabe :

1. Entspannen Sie am Strand: Genießen Sie die weißen Sandstrände und kristallklaren Wasser des karibischen Meeres.

2. Erkunden Sie die Maya -Ruinen: Besuchen Sie alte archäologische Stätten wie Chichen Itza, Tulum und Coba, um etwas über die Geschichte und Kultur der Mayaner zu erfahren.

3. Machen Sie eine Food -Tour: Probieren Sie die traditionellen Aromen und erfahren Sie die lokale Küche, indem Sie eine Food -Tour durch Cancun machen. Kombinieren Sie LLMs und Eingabeaufforderungen in mehrstufigen Workflows

Erkettung im Langchain -Kontext bezieht sich auf den Akt der Integration von LLMs in andere Elemente, um eine Anwendung zu erstellen. Einige Beispiele sind:

- kombiniert mehrere LLMs nacheinander mit der Ausgabe des ersten LLM als Eingang für das zweite LLM (siehe Abschnitt)

-

Integration von LLMs in Eingabeaufforderung Vorlagen -

LLMs mit externen Daten zusammenführen, z. B. für Frage zur Beantwortung von -

LLMs mit Langzeitgedächtnis einbeziehen, wie die Chat-Historie

Sehen wir uns ein Beispiel für das erste Szenario an, in dem wir die Ausgabe von der ersten LLM als Eingabe zum zweiten LLM verwenden.

pip install langchain

Ausgabe

:

In diesem speziellen Beispiel erstellen wir eine Kette mit zwei Komponenten. Die erste Komponente ist dafür verantwortlich, die beliebteste Stadt zu identifizieren, die einem bestimmten Land als Eingabe des Benutzers entspricht. Im Gegensatz dazu konzentriert sich die zweite Komponente auf die Bereitstellung von Informationen über die drei besten Aktivitäten oder Attraktionen, die für Touristen, die diese bestimmte Stadt besuchen, zur Verfügung gestellt.

Wenn Sie fortgeschrittenere Konzepte zum Erstellen von Anwendungen in Langchain erfahren möchten, lesen Sie diesen Live -Kurs zum Erstellen von AI -Anwendungen mit Langchain und GPT auf DataCamp.

Schlussfolgerung und weiteres Lernen

Noch vor kurzem waren wir alle sehr beeindruckt von den beeindruckenden Fähigkeiten von Chatgpt. Die Landschaft hat sich jedoch rasch entwickelt, und jetzt haben wir Zugang zu neuen Entwicklerwerkzeugen wie Langchain, die uns befähigen, in nur wenigen Stunden ähnlich bemerkenswerte Prototypen auf unseren persönlichen Laptops zu schaffen.

Langchain, ein Open-Source-Python-Framework, ermöglicht Einzelpersonen, Anwendungen zu erstellen, die von LLMs (Sprachmodelle) betrieben werden. Dieses Framework bietet eine vielseitige Schnittstelle zu zahlreichen Grundmodellen, die das schnelle Management erleichtern und als zentraler Hub für andere Komponenten wie Eingabeaufentwicklungsvorlagen, zusätzliche LLMs, externe Daten und andere Tools über Agenten (zum Zeitpunkt des Schreibens) dienen.

Wenn Sie versuchen, mit allen Fortschritten in generativen KI und LLM Schritt zu halten, sehen Sie sich unsere AI -Bewerbungen für Gebäude mit Langchain und GPT -Webinar an. Hier lernen Sie die Grundlagen der Verwendung von Langchain zur Entwicklung von AI -Anwendungen sowie zur Strukturierung einer KI -Anwendung und zum Einbetten von Textdaten für hohe Leistung. Sie können auch unser Cheat -Blatt in der Landschaft für generative KI -Werkzeuge anzeigen, um die verschiedenen Kategorien generativer KI -Tools, ihrer Anwendungen und ihres Einflusses in verschiedenen Sektoren zu untersuchen. Sehen Sie sich schließlich unsere Liste der Top Open-Source-LLMs an, um mehr über andere leistungsstarke Tools zu erfahren.

Das obige ist der detaillierte Inhalt vonSo erstellen Sie LLM -Anwendungen mit Langchain Tutorial. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1381

1381

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

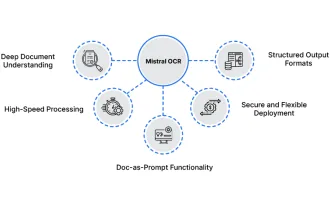

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

Mistral OCR: revolutionäre retrieval-ausgereifte Generation mit multimodalem Dokumentverständnis RAG-Systeme (Abrufen-Augment-Augmented Generation) haben erheblich fortschrittliche KI

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

In dem Artikel werden Top -KI -Schreibassistenten wie Grammarly, Jasper, Copy.ai, Writesonic und RYTR erläutert und sich auf ihre einzigartigen Funktionen für die Erstellung von Inhalten konzentrieren. Es wird argumentiert, dass Jasper in der SEO -Optimierung auszeichnet, während KI -Tools dazu beitragen, den Ton zu erhalten