Ist AI wirklich 'aufgewacht' oder extremistisch?

Es ist keine Überraschung, dass große Technologieunternehmen künstliche Intelligenz energisch fördern. Die künstliche Intelligenz hat jedoch auch weit verbreitete Kontroversen ausgelöst, mit vielen lautstarken Bedenken hinsichtlich der möglichen Auswirkungen auf Beschäftigung, Privatsphäre und Sicherheit.

Ein weiteres häufiges Problem ist, dass künstliche Intelligenz verwendet werden kann, um falsche Informationen zu schaffen, wodurch politische Erzählungen gestärkt und sogar unsere demokratischen Entscheidungen beeinflusst werden.

Ich sehe oft zwei Aussagen: Erstens kann künstliche Intelligenz verwendet werden, um extremistische Ideen zu verbreiten und sogar Extremisten zu schaffen; Zweitens ist die Produktion für künstliche Intelligenz in der Regel "geweckt" - ein Begriff, der ursprünglich von afroamerikanischen Bürgerrechtsprotestierenden verwendet wird, aber jetzt werden Konservative verwendet, um sich auf Ideen und Überzeugungen zu beziehen, die soziale Gerechtigkeit vorantreiben oder unterstützen.

Die Berichte über linksgerichtete Vorurteile in der künstlichen Intelligenz waren bei den US-amerikanischen Wahlen im letzten Jahr besonders häufig. In der Zwischenzeit warnt die Denkfabrik der Terrorismusbekämpfung, dass extremistische Gruppen künstliche Intelligenz einsetzen, um zu indoktrinieren.

Da diese beiden Behauptungen die Risiken eingehen, dass KI verwendet wird, um politische Ansichten zu beeinflussen, ist es sinnvoll, sie zusammenzustellen, um sie zu studieren.

Sind diese Aussagen wahr? Hat künstliche Intelligenz wirklich die Fähigkeit, uns dazu zu bringen, Terrorakte zu begehen oder die liberale Philosophie zu übernehmen und „erwacht“ zu werden?

Gibt es eine linke Vorurteile in der künstlichen Intelligenz?

Konservative und rechte Kommentatoren behaupten oft, dass künstliche Intelligenz und seine oft stammende Kultur des Silicon Valley links links aufweisen. Es scheint zumindest einige Beweise zu geben, die diese Behauptungen stützen.

Dies wird in mehreren Studien argumentiert, darunter eine Studie der University of East Anglia 2023 und eine im Journal of Economic Behavior and Organization veröffentlichte Studie.

Natürlich hat generative KI selbst keinen politischen Standpunkt - oder keinen Standpunkt. Alles, was es „kennt“, stammt aus Daten, die aus dem Web gekrabbt sind, einschließlich Bücher, wissenschaftlichen Arbeiten und Zeitschriften sowie Inhalte, die aus Diskussionsforen und sozialen Medien kicherten.

Wenn diese Daten den progressiven Konsens unterstützen - wenn die meisten Klimaferzendaten Theorien des anthropogenen Klimawandels unterstützen, werden künstliche Intelligenz sie wahrscheinlich als Tatsache darstellen.

Einige Studien konzentrieren sich nicht nur auf die linke Voreingenommenheit, wenn KI Fakten vorstellt, sondern auch auf die Entdeckung, dass AI es weigert, Anfragen „rechtsflügelige Bildgenerierung“ zu verarbeiten.

Wenn sie aufgefordert werden, Bilder mit progressiven Argumenten (wie „Rassengleichheit“ oder „Transgender -Akzeptanz“) zu beschreiben, zeigen die Ergebnisse eher positive Bilder (wie glückliche Menschen).

Dies bedeutet jedoch nicht unbedingt, dass künstliche Intelligenz "erweckt" wird. Tatsächlich hat weitere Untersuchungen ergeben, dass KI, die auf großen Sprachmodellen basieren, auch rechtsgerichtete Verzerrungen aufweisen können, wobei die Ergebnisse auf der Grundlage der getesteten KI variieren.

Eine kürzlich in Nature veröffentlichte Studie ergab, dass Chatgpts ideologische Haltung "eine klare und statistisch signifikante Verschiebung im Laufe der Zeit erlebt hat" basierend auf standardisierten politischen Neigentests.

Letztendlich werden KI -Systeme von Menschen gebaut und basierend auf den von uns ausgewählten Daten geschult. Wenn es eine Tendenz in der Erstellung seines Algorithmus oder in den Informationen über die ihm zur Verfügung gestellte Welt gibt, wird diese Voreingenommenheit wahrscheinlich in seiner Ausgabe kopiert.

Kann künstliche Intelligenz uns zu Extremisten verwandeln?

Einige Forscher befürchten, dass KI alle in einen liberalen verwandeln wird, während andere mehr besorgt sind, dass sie verwendet wird, um Menschen zu radikalisieren oder extremistische Agenden voranzutreiben.

Das in Den Haag ansässige internationale Zentrum der Terrorismusbekämpfung berichtete, dass terroristische Organisationen die generative künstliche Intelligenz weit verbreitet haben, um Propaganda zu schaffen und zu verbreiten. Dies beinhaltet die Verwendung gefälschter Bilder und Videos, um Erzählungen zu verbreiten, die ihren Werten entsprechen.

Terrorismus und extremistische Gruppen, einschließlich des islamischen Staates, haben sogar Richtlinien herausgegeben, in denen gezeigt wird, wie man künstliche Intelligenz nutzt, um Propaganda und Desinformation zu entwickeln.

Sein Zweck besteht oft darin, Verwirrung und Verwirrung zu schaffen, was zu misstrauen Regierungsbehörden und Mainstream (oft bearbeitet und faktenüberprüft) Medien führt.

Einige argumentieren auch, dass Extremisten künstliche Intelligenz verwenden können, um herauszufinden, wer für die Radikalisierung anfällig ist, indem sie vorhersagen, wer mit ihrer Ideologie sympathisieren kann.

Auch dies ist Menschen, die KI verwenden, um die Menschen zu überzeugen, ihre Ansichten zu übernehmen, anstatt vorzuschlagen, dass AI selbst extrem ist oder extreme Gedanken und Verhaltensweisen vorschlägt.

Ein inhärentes Risiko für künstliche Intelligenz ist jedoch die Fähigkeit, extreme Perspektiven durch algorithmische Echokammereffekte zu stärken.

Dies geschieht, wenn Social Media und News -Plattformen künstliche Intelligenz nutzen, um Inhalte basierend auf früheren Engagements zu empfehlen. Dies führt häufig dazu, dass Benutzer mehr Inhalte sehen, denen sie zugestimmt haben, und eine „Echokammer“ erstellt, in der Menschen wiederholt Inhalte sehen, die ihre vorhandenen Überzeugungen widerspiegeln. Wenn diese Überzeugungen extrem sind, kann KI ihre Auswirkungen durch ähnliche, radikalere Inhalte verbessern.

Kann künstliche Intelligenz unsere Denkweise wirklich beeinflussen?

Es ist wichtig zu bedenken, dass künstliche Intelligenz zwar eine zunehmend wichtige Rolle bei der Gestaltung der Art und Weise spielen kann, wie wir Informationen konsumieren, aber unsere Überzeugungen nicht direkt beeinflussen kann.

Es sollte auch beachtet werden, dass künstliche Intelligenz auch dazu beitragen kann, diese Bedrohungen zu bewältigen. Beispielsweise kann es eine Verzerrung der Daten erkennen, die zu verzerrten Antworten führen und extremistische Inhalte im Internet finden und löschen können.

Es gibt jedoch eindeutig eine scheinbar vernünftige Ansicht, dass Gruppen aller politischen Fraktionen sie unweigerlich verwenden, um die öffentliche Meinung zu steuern.

Zu verstehen, woher die Fehlermeldung kommt und wer möglicherweise versucht, sie zu verbreiten, hilft uns, unsere kritischen Denkfähigkeiten zu verbessern und besser zu verstehen, wann jemand (oder eine Maschine) versucht, uns zu beeinflussen.

Da künstliche Intelligenz zunehmend in den Alltag integriert wird, werden diese Fähigkeiten unabhängig von unseren politischen Neigungen immer wichtiger.

Das obige ist der detaillierte Inhalt vonIst AI wirklich 'aufgewacht' oder extremistisch?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Ich habe versucht, die Vibe -Codierung mit Cursor AI und es ist erstaunlich!

Mar 20, 2025 pm 03:34 PM

Die Vibe -Codierung verändert die Welt der Softwareentwicklung, indem wir Anwendungen mit natürlicher Sprache anstelle von endlosen Codezeilen erstellen können. Inspiriert von Visionären wie Andrej Karpathy, lässt dieser innovative Ansatz Dev

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Top 5 Genai Starts vom Februar 2025: GPT-4,5, GROK-3 & MEHR!

Mar 22, 2025 am 10:58 AM

Februar 2025 war ein weiterer bahnbrechender Monat für die Generative KI, die uns einige der am meisten erwarteten Modell-Upgrades und bahnbrechenden neuen Funktionen gebracht hat. Von Xais Grok 3 und Anthropics Claude 3.7 -Sonett, um g zu eröffnen

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Wie benutze ich Yolo V12 zur Objekterkennung?

Mar 22, 2025 am 11:07 AM

Yolo (Sie schauen nur einmal) war ein führender Echtzeit-Objekterkennungsrahmen, wobei jede Iteration die vorherigen Versionen verbessert. Die neueste Version Yolo V12 führt Fortschritte vor, die die Genauigkeit erheblich verbessern

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Beste KI -Kunstgeneratoren (kostenlos & amp; bezahlt) für kreative Projekte

Apr 02, 2025 pm 06:10 PM

Der Artikel überprüft Top -KI -Kunstgeneratoren, diskutiert ihre Funktionen, Eignung für kreative Projekte und Wert. Es zeigt MidJourney als den besten Wert für Fachkräfte und empfiehlt Dall-E 2 für hochwertige, anpassbare Kunst.

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Ist Chatgpt 4 o verfügbar?

Mar 28, 2025 pm 05:29 PM

Chatgpt 4 ist derzeit verfügbar und weit verbreitet, wodurch im Vergleich zu seinen Vorgängern wie ChatGPT 3.5 signifikante Verbesserungen beim Verständnis des Kontextes und des Generierens kohärenter Antworten zeigt. Zukünftige Entwicklungen können mehr personalisierte Inters umfassen

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Welche KI ist besser als Chatgpt?

Mar 18, 2025 pm 06:05 PM

Der Artikel erörtert KI -Modelle, die Chatgpt wie Lamda, Lama und Grok übertreffen und ihre Vorteile in Bezug auf Genauigkeit, Verständnis und Branchenauswirkungen hervorheben. (159 Charaktere)

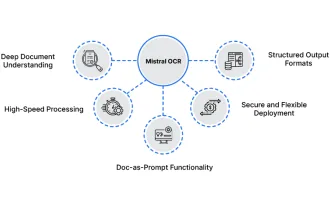

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

So verwenden Sie Mistral OCR für Ihr nächstes Lappenmodell

Mar 21, 2025 am 11:11 AM

Mistral OCR: revolutionäre retrieval-ausgereifte Generation mit multimodalem Dokumentverständnis RAG-Systeme (Abrufen-Augment-Augmented Generation) haben erheblich fortschrittliche KI

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

Top -KI -Schreibassistenten, um Ihre Inhaltserstellung zu steigern

Apr 02, 2025 pm 06:11 PM

In dem Artikel werden Top -KI -Schreibassistenten wie Grammarly, Jasper, Copy.ai, Writesonic und RYTR erläutert und sich auf ihre einzigartigen Funktionen für die Erstellung von Inhalten konzentrieren. Es wird argumentiert, dass Jasper in der SEO -Optimierung auszeichnet, während KI -Tools dazu beitragen, den Ton zu erhalten