海量日记入库

海量日志入库

日志目录下有10个日志文件,每个文件压缩后大约60M左右,文件后缀是.gz,如a.gz、b.gz等,文件中行的内容是id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

id=2112112,[email protected],等等其它,

现在是想把这个目录下的每个文件的所有内容insert到数据库中,数据库中的表,是通过email分表的,大约是log_1,log_2,一直到log_1000的分表的,请问下详细的解决方案,比如说怎么样能保证到每个文件在很快的时间内入库,使得脚本执行更有效率

先贴一段代码

<br /> <?php<br /> error_reporting(E_ALL & ~E_NOTICE);<br /> //接收参数<br /> $mysql_host = XX.XX.XX.XX;<br /> $mysql_user = XXX;<br /> $mysql_pass = XX;<br /> $mysql_port = 3306;<br /> $mysql_db = 'test'; <br /> $table_pre = 'log_';<br /> $gz_log_file = a.gz;<br /> //脚本执行日志<br /> $exec_log = '/data_log/record.txt'; <br /> file_put_contents ($exec_log,'*****************************************START***********************************'."\r\n",FILE_APPEND );<br /> file_put_contents ($exec_log,'param is mysql_host='.$mysql_host.' mysql_user='.$mysql_user.' mysql_pass='.$mysql_pass.' mysql_port='.$mysql_port.' mysql_db='.$mysql_db.' table_pre='.$table_pre.' gz_log_file='.$gz_log_file.' start_time='.date("Y-m-d H:i:s")."\r\n",FILE_APPEND ); <br /> //读日志入库 <br /> $z_handle = gzopen($gz_log_file,'r');<br /> $time_start = microtime_float();<br /> $mysql_value_ary = array();<br /> //链接数据库<br /> $conn = mysql_connect("$mysql_host:$mysql_port",$mysql_user,$mysql_pass);<br /> if (!$conn) {<br /> file_put_contents ($exec_log,'Could not connect database error, error='.mysql_error()."\r\n",FILE_APPEND ); <br /> exit;<br /> }<br /> $selec_db = mysql_select_db($mysql_db);<br /> if(!$selec_db){<br /> file_put_contents ($exec_log,'select database error, database='.$mysql_db."\r\n",FILE_APPEND ); <br /> exit;<br /> }<br /> while(!gzeof($z_handle)){<br /> $each_gz_line = gzgets($z_handle, 4096);<br /> $line_to_array = explode("\t",$each_gz_line);<br /> //过滤无效日志<br /> if(!empty($line_to_array[3]) && !empty($line_to_array[2]) && !empty($line_to_array[4])){<br /> $insert_value = "('".$line_to_array[3]."','".$line_to_array[2]."','".$line_to_array[1]."','".$line_to_array[4]."','".$line_to_array[0]."') ";<br /> $insert_sql = "insert into $table_name (uid,email,ip,ctime) values $insert_value ";<br /> $table_id = abs(crc32($line_to_array[2]) % 1000);<br /> $table_name = $table_pre.$table_id;<br /> $result = mysql_query($insert_sql); <br /> if(!$result){<br /> //如果插入错误,则记录日志<br /> file_put_contents ($exec_log,'table_name='.$table_name.' email='.$line_to_array[2]."\r\n",FILE_APPEND ); <br /> }<br /> }<br /> }<br /> $time_end = microtime_float();<br /> $diff = $time_end - $time_start;<br /> file_put_contents ($exec_log,'success to insert database,log_file is '.$gz_log_file.' time-consuming is='.$diff."s \r\n",FILE_APPEND );<br /> file_put_contents ($exec_log,'*******************************************END***********************************'."\r\n",FILE_APPEND );<br /> gzclose($z_handle); <br />上面的代码执行起来,很慢,不可忍受,请大牛帮忙

------解决方案--------------------

表类型修改为:InnoDB,然后用事务实施,

还不行的话,换load file

------解决方案--------------------

对于innodb,开事物应该不会更慢,因为就算不开,每一条语句也都是一个事物,所以如果是只开启一个事物,最后commit一次,应该会比每条语句都begin一下,commit一下要快的(但我记得开了事物也不会快多少);但myisam在只有一个插入线程执行,并且表内总数据量比较小的场合下,肯定比innodb要快的,尤其是只有60M数据的环境下

load data infile 绝对会快很多,但你文件得先转换成另一个"xxx \t xxx"的形式,然后再load data infile,应该比一条条插入能快几倍

------解决方案--------------------

load data吧,load进去以后比对一下条数,别搞什么事务。出错几率很低的,即使出错了,删除以后重新导入也快。PS,这数据不叫海量数据。

------解决方案--------------------

不知道为什么要放在数据库中

按你的描述,数据文件展开后,每个在 60*20M左右,甚至更高

你一条一条的插入,不慢才怪呢

------解决方案--------------------

历史数据入库,只是一次性工作。无所谓“效率”

你可以直接将文件导入 text 字段后,再由 update 指令拆分

如果不打算修改日志处理方式,那么将日志增量追加入库也只是一个定期工作(周期至少大于等于1天)

同样也没效率的概念

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Ich kann mich nicht als Stamm bei MySQL anmelden

Apr 08, 2025 pm 04:54 PM

Ich kann mich nicht als Stamm bei MySQL anmelden

Apr 08, 2025 pm 04:54 PM

Die Hauptgründe, warum Sie sich bei MySQL nicht als Root anmelden können, sind Berechtigungsprobleme, Konfigurationsdateifehler, Kennwort inkonsistent, Socket -Dateiprobleme oder Firewall -Interception. Die Lösung umfasst: Überprüfen Sie, ob der Parameter Bind-Address in der Konfigurationsdatei korrekt konfiguriert ist. Überprüfen Sie, ob die Root -Benutzerberechtigungen geändert oder gelöscht und zurückgesetzt wurden. Stellen Sie sicher, dass das Passwort korrekt ist, einschließlich Fall- und Sonderzeichen. Überprüfen Sie die Einstellungen und Pfade der Socket -Dateiberechtigte. Überprüfen Sie, ob die Firewall Verbindungen zum MySQL -Server blockiert.

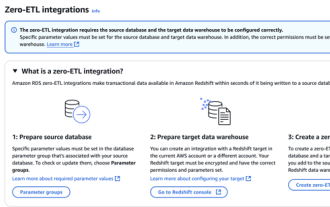

RDS MySQL -Integration mit RedShift Zero ETL

Apr 08, 2025 pm 07:06 PM

RDS MySQL -Integration mit RedShift Zero ETL

Apr 08, 2025 pm 07:06 PM

Vereinfachung der Datenintegration: AmazonRDSMYSQL und Redshifts Null ETL-Integration Die effiziente Datenintegration steht im Mittelpunkt einer datengesteuerten Organisation. Herkömmliche ETL-Prozesse (Extrakt, Konvertierung, Last) sind komplex und zeitaufwändig, insbesondere bei der Integration von Datenbanken (wie AmazonRDSMysQL) in Data Warehouses (wie Rotverschiebung). AWS bietet jedoch keine ETL-Integrationslösungen, die diese Situation vollständig verändert haben und eine vereinfachte Lösung für die Datenmigration von RDSMysQL zu Rotverschiebung bietet. Dieser Artikel wird in die Integration von RDSMYSQL Null ETL mit RedShift eintauchen und erklärt, wie es funktioniert und welche Vorteile es Dateningenieuren und Entwicklern bringt.

Muss MySQL bezahlen?

Apr 08, 2025 pm 05:36 PM

Muss MySQL bezahlen?

Apr 08, 2025 pm 05:36 PM

MySQL hat eine kostenlose Community -Version und eine kostenpflichtige Enterprise -Version. Die Community -Version kann kostenlos verwendet und geändert werden, die Unterstützung ist jedoch begrenzt und für Anwendungen mit geringen Stabilitätsanforderungen und starken technischen Funktionen geeignet. Die Enterprise Edition bietet umfassende kommerzielle Unterstützung für Anwendungen, die eine stabile, zuverlässige Hochleistungsdatenbank erfordern und bereit sind, Unterstützung zu bezahlen. Zu den Faktoren, die bei der Auswahl einer Version berücksichtigt werden, gehören Kritikalität, Budgetierung und technische Fähigkeiten von Anwendungen. Es gibt keine perfekte Option, nur die am besten geeignete Option, und Sie müssen die spezifische Situation sorgfältig auswählen.

Die Abfrageoptimierung in MySQL ist für die Verbesserung der Datenbankleistung von wesentlicher Bedeutung, insbesondere im Umgang mit großen Datensätzen

Apr 08, 2025 pm 07:12 PM

Die Abfrageoptimierung in MySQL ist für die Verbesserung der Datenbankleistung von wesentlicher Bedeutung, insbesondere im Umgang mit großen Datensätzen

Apr 08, 2025 pm 07:12 PM

1. Verwenden Sie den richtigen Index, um das Abrufen von Daten zu beschleunigen, indem die Menge der skanierten Datenmenge ausgewählt wird. Wenn Sie mehrmals eine Spalte einer Tabelle nachschlagen, erstellen Sie einen Index für diese Spalte. Wenn Sie oder Ihre App Daten aus mehreren Spalten gemäß den Kriterien benötigen, erstellen Sie einen zusammengesetzten Index 2. Vermeiden Sie aus. Auswählen * Nur die erforderlichen Spalten. Wenn Sie alle unerwünschten Spalten auswählen, konsumiert dies nur mehr Serverspeicher und veranlasst den Server bei hoher Last oder Frequenzzeiten, beispielsweise die Auswahl Ihrer Tabelle, wie beispielsweise die Spalten wie innovata und updated_at und Zeitsteuer und dann zu entfernen.

Die Beziehung zwischen MySQL -Benutzer und Datenbank

Apr 08, 2025 pm 07:15 PM

Die Beziehung zwischen MySQL -Benutzer und Datenbank

Apr 08, 2025 pm 07:15 PM

In der MySQL -Datenbank wird die Beziehung zwischen dem Benutzer und der Datenbank durch Berechtigungen und Tabellen definiert. Der Benutzer verfügt über einen Benutzernamen und ein Passwort, um auf die Datenbank zuzugreifen. Die Berechtigungen werden über den Zuschussbefehl erteilt, während die Tabelle durch den Befehl create table erstellt wird. Um eine Beziehung zwischen einem Benutzer und einer Datenbank herzustellen, müssen Sie eine Datenbank erstellen, einen Benutzer erstellen und dann Berechtigungen erfüllen.

MySQL, ob die Tabellenverriegelungstabelle geändert werden soll

Apr 08, 2025 pm 05:06 PM

MySQL, ob die Tabellenverriegelungstabelle geändert werden soll

Apr 08, 2025 pm 05:06 PM

Wenn MySQL -Modifys -Tabellenstruktur verwendet werden, werden normalerweise Metadatenverriegelungen verwendet, wodurch die Tabelle gesperrt wird. Um die Auswirkungen von Schlösser zu verringern, können die folgenden Maßnahmen ergriffen werden: 1. Halten Sie Tabellen mit Online -DDL verfügbar; 2. Führen Sie komplexe Modifikationen in Chargen durch; 3.. Arbeiten während kleiner oder absendlicher Perioden; 4. Verwenden Sie PT-OSC-Tools, um eine feinere Kontrolle zu erreichen.

Kann MySQL auf Android laufen?

Apr 08, 2025 pm 05:03 PM

Kann MySQL auf Android laufen?

Apr 08, 2025 pm 05:03 PM

MySQL kann nicht direkt auf Android ausgeführt werden, kann jedoch indirekt mit den folgenden Methoden implementiert werden: Die Verwendung der Leichtgewichtsdatenbank SQLite, die auf dem Android -System basiert, benötigt keinen separaten Server und verfügt über eine kleine Ressourcennutzung, die für Anwendungen für Mobilgeräte sehr geeignet ist. Stellen Sie sich remote eine Verbindung zum MySQL -Server her und stellen Sie über das Netzwerk zum Lesen und Schreiben von Daten über das Netzwerk eine Verbindung zur MySQL -Datenbank auf dem Remote -Server her. Es gibt jedoch Nachteile wie starke Netzwerkabhängigkeiten, Sicherheitsprobleme und Serverkosten.

Wie optimieren Sie die MySQL-Leistung für Hochlastanwendungen?

Apr 08, 2025 pm 06:03 PM

Wie optimieren Sie die MySQL-Leistung für Hochlastanwendungen?

Apr 08, 2025 pm 06:03 PM

Die MySQL-Datenbankleistung Optimierungshandbuch In ressourcenintensiven Anwendungen spielt die MySQL-Datenbank eine entscheidende Rolle und ist für die Verwaltung massiver Transaktionen verantwortlich. Mit der Erweiterung der Anwendung werden jedoch die Datenbankleistung Engpässe häufig zu einer Einschränkung. In diesem Artikel werden eine Reihe effektiver Strategien zur Leistungsoptimierung von MySQL -Leistung untersucht, um sicherzustellen, dass Ihre Anwendung unter hohen Lasten effizient und reaktionsschnell bleibt. Wir werden tatsächliche Fälle kombinieren, um eingehende Schlüsseltechnologien wie Indexierung, Abfrageoptimierung, Datenbankdesign und Caching zu erklären. 1. Das Design der Datenbankarchitektur und die optimierte Datenbankarchitektur sind der Eckpfeiler der MySQL -Leistungsoptimierung. Hier sind einige Kernprinzipien: Die Auswahl des richtigen Datentyps und die Auswahl des kleinsten Datentyps, der den Anforderungen entspricht, kann nicht nur Speicherplatz speichern, sondern auch die Datenverarbeitungsgeschwindigkeit verbessern.