Die derzeit heißeste Technologie ist definitiv künstliche Intelligenz.

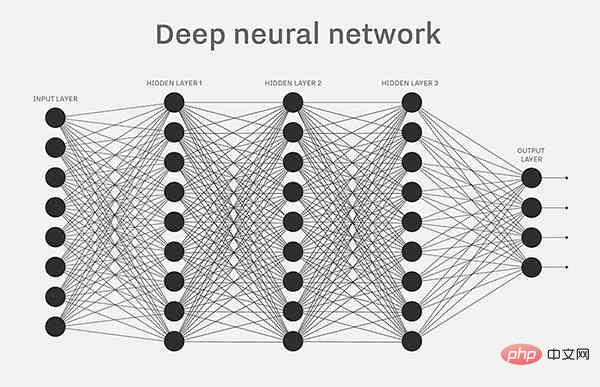

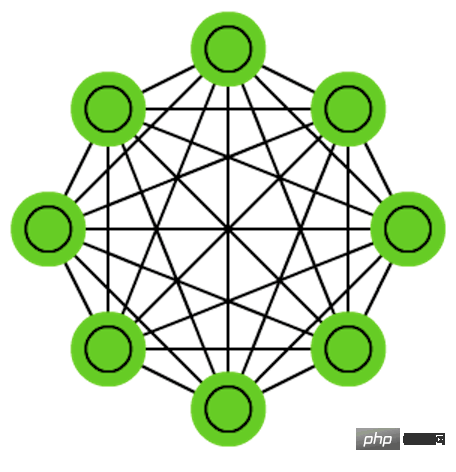

Das zugrunde liegende Modell der künstlichen Intelligenz ist das „Neuronale Netzwerk“. Viele komplexe Anwendungen (wie Mustererkennung, automatische Steuerung) und fortgeschrittene Modelle (wie Deep Learning) basieren darauf. Das Erlernen künstlicher Intelligenz muss damit beginnen.

1. Perceptron

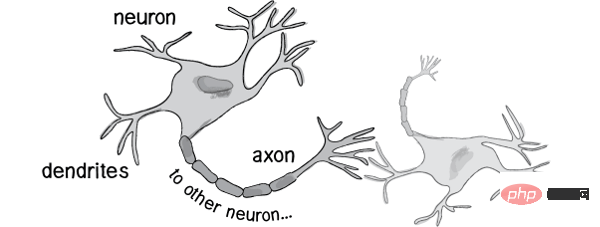

Historisch gesehen haben Wissenschaftler immer gehofft, das menschliche Gehirn zu simulieren und etwas zu erschaffen, das denken kann . Maschine. Warum können Menschen denken? Wissenschaftler haben herausgefunden, dass der Grund im neuronalen Netzwerk des Körpers liegt.

1. Äußere Reize werden über Nervenenden in elektrische Signale umgewandelt und an Nervenzellen (auch Neuronen genannt) weitergeleitet.

2. Unzählige Neuronen bilden das Nervenzentrum.

3. Das Nervenzentrum synthetisiert verschiedene Signale und trifft Urteile.

4. Der menschliche Körper reagiert auf äußere Reize gemäß den Anweisungen des Nervenzentrums.

2. Gewichte und Schwellenwerte

Wenn Sie dies sehen, werden Sie sich sicherlich fragen: Wenn einige Faktoren festgelegt sind und andere nicht, was ist das Ergebnis? Zum Beispiel ist das Wetter am Wochenende schön und die Tickets sind nicht teuer, aber Xiao Ming findet keinen Begleiter. Sollte er trotzdem zu Besuch kommen?

In der Realität sind Faktoren selten gleich wichtig: Einige sind entscheidend, andere zweitrangig. Daher können diesen Faktoren Gewichtungen zugewiesen werden, die ihre unterschiedliche Bedeutung widerspiegeln.

Wetter: Gewicht ist 8

Begleiter: Gewicht ist 4

Preis: Gewicht ist 4

Das obige Gewicht zeigt an, dass das Wetter der entscheidende Faktor ist, Begleiter und Preis sind zweitrangige Faktoren.

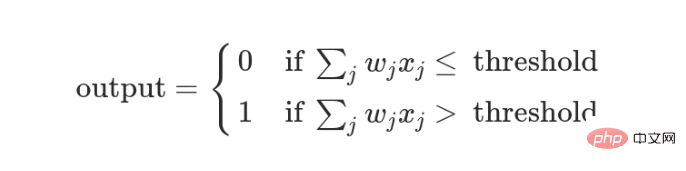

Wenn alle drei Faktoren 1 sind, beträgt ihre Summe multipliziert mit den Gewichten 8 + 4 + 4 = 16. Wenn die Wetter- und Preisfaktoren 1 und der Begleitfaktor 0 sind, beträgt die Summe 8 + 0 + 4 = 12. Zu diesem Zeitpunkt müssen Sie auch einen Schwellenwert (Schwellenwert) angeben. Wenn die Summe größer als der Schwellenwert ist, gibt das Perzeptron 1 aus, andernfalls gibt es 0 aus. Angenommen, der Schwellenwert ist 8, dann 12 > 8, Xiao Ming entscheidet sich für einen Besuch. Die Höhe der Schwelle stellt die Stärke des Willens dar. Je niedriger die Schwelle, desto mehr möchten Sie gehen. Je höher die Schwelle, desto weniger möchten Sie gehen.

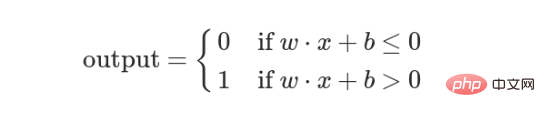

Der obige Entscheidungsprozess wird mathematisch wie folgt ausgedrückt.

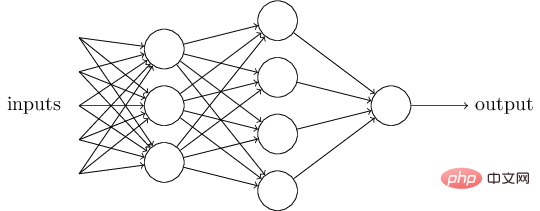

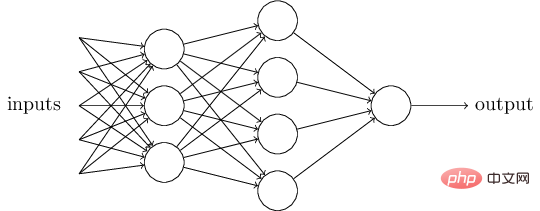

3. Entscheidungsmodell

Ein einzelnes Perzeptron stellt ein einfaches Entscheidungsmodell dar, das sofort einsatzbereit ist. In der realen Welt ist das eigentliche Entscheidungsmodell viel komplexer und ein mehrschichtiges Netzwerk bestehend aus mehreren Perzeptronen.

In der obigen Abbildung empfängt das Perzeptron der unteren Schicht externe Eingaben, trifft eine Beurteilung und sendet dann ein Signal als Eingabe des Perzeptrons der oberen Schicht, bis das Endergebnis vorliegt erhalten. (Hinweis: Es gibt immer noch nur einen Ausgang des Perzeptrons, dieser kann jedoch an mehrere Ziele gesendet werden.)

In diesem Bild sind die Signale unidirektional, d. h. der Ausgang des Perzeptrons der unteren Schicht ist immer die Ausgabe des Perzeptrons der oberen Schicht. In der Realität kann es zu einer zyklischen Übertragung kommen, das heißt, A wird an B, B an C und C an A weitergeleitet. Dies wird als „rekurrentes neuronales Netzwerk“ bezeichnet

4. Vektorisierung

Um die anschließende Diskussion zu erleichtern, müssen einige mathematische Verarbeitungen am obigen Modell durchgeführt werden.

Externe Faktoren x1, x2, x3 werden als Vektoren

Gewichte w1, w2, w3 werden auch als Vektoren (w1, w2) geschrieben , w3), Die Abkürzung lautet w

Definieren Sie die Operation w⋅x = ∑ wx, dh die Punktoperation von w und x, die gleich der Summe der Produkte von Faktoren und Gewichten ist

Definieren Sie b gleich dem negativen Schwellenwert b = -threshold

Das Perzeptronmodell wird wie folgt.

5. Der Betriebsprozess eines neuronalen Netzwerks

Um ein neuronales Netzwerk aufzubauen, müssen drei Bedingungen erfüllt sein.

1. Eingabe und Ausgabe

2. Gewicht (w) und Schwellenwert (b)

Die Struktur des mehrschichtigen Perzeptrons Angenommen, Sie müssen das oben angezeigte Bild im Voraus zeichnen

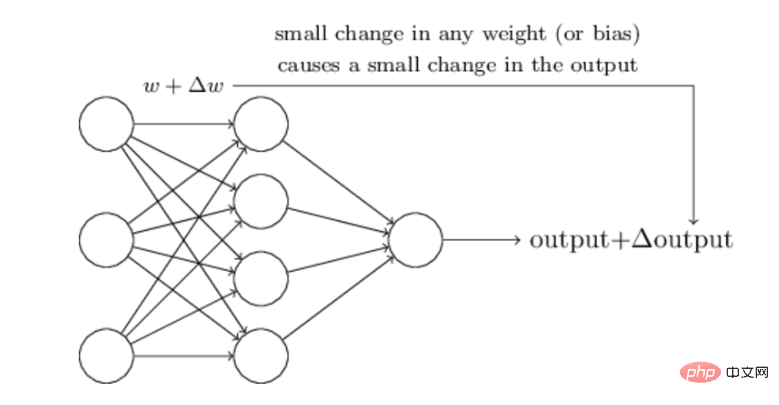

Unter diesen besteht der schwierigste Teil darin, das Gewicht (w) und den Schwellenwert (b) zu bestimmen. Bisher wurden diese beiden Werte subjektiv angegeben, aber in Wirklichkeit ist es schwierig, ihre Werte abzuschätzen, und es muss einen Weg geben, die Antwort herauszufinden.

Unter diesen besteht der schwierigste Teil darin, das Gewicht (w) und den Schwellenwert (b) zu bestimmen. Bisher wurden diese beiden Werte subjektiv angegeben, aber in Wirklichkeit ist es schwierig, ihre Werte abzuschätzen, und es muss einen Weg geben, die Antwort herauszufinden.

Diese Methode ist Versuch und Irrtum. Unter Beibehaltung anderer Parameter werden kleine Änderungen von w (oder b) als Δw (oder Δb) aufgezeichnet und dann die Änderungen in der Ausgabe beobachtet. Wiederholen Sie diesen Vorgang, bis wir die Menge von w und b erhalten, die der genauesten Ausgabe entspricht, also dem gewünschten Wert. Dieser Vorgang wird Modelltraining genannt.

Das neuronale Netzwerk funktioniert also wie folgt.

1. Bestimmen Sie die Eingabe und Ausgabe

2. Finden Sie einen oder mehrere Algorithmen, die die Ausgabe aus der Eingabe erhalten können

3 Antworten Der Datensatz wird zum Trainieren des Modells und zum Schätzen von w und b verwendet.

4 Sobald die neuen Daten generiert und in das Modell eingegeben wurden, können die Ergebnisse erhalten und gleichzeitig w und b korrigiert werden Zeit

6. Ausgabekontinuität

Das obige Modell hat ein ungelöstes Problem, die Ausgabe hat nur zwei Ergebnisse: 0 und 1. Das Modell erfordert jedoch kleine Änderungen in w oder b, was zu Änderungen in der Ausgabe führt. Wenn Sie nur 0 und 1 ausgeben, wäre dies zu unempfindlich und die Genauigkeit des Trainings kann nicht garantiert werden. Daher muss die „Ausgabe“ in eine kontinuierliche Funktion umgewandelt werden. Dies erfordert eine kleine einfache mathematische Modifikation.

Notieren Sie zunächst das Berechnungsergebnis des Perzeptrons wx + b als z.

z = wx + b

Berechnen Sie dann die folgende Formel und notieren Sie das Ergebnis als σ(z).

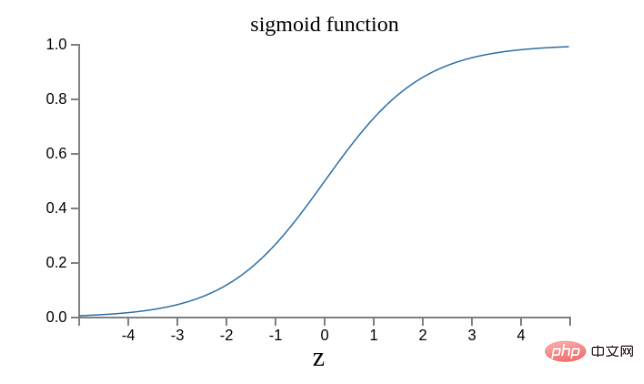

σ(z) = 1 / (1 + e^(-z))

Dies liegt daran, dass z → +∞ (was auf eine starke Perzeptron-Übereinstimmung hinweist), wenn z in die positive Unendlichkeit geht ), dann ist σ(z) → 1; wenn z zur negativen Unendlichkeit z → -∞ tendiert (was auf eine starke Perzeptron-Fehlanpassung hinweist), dann ist σ(z) → 0. Mit anderen Worten: Solange σ(z) als Ausgabeergebnis verwendet wird, wird die Ausgabe zu einer Kontinuitätsfunktion.

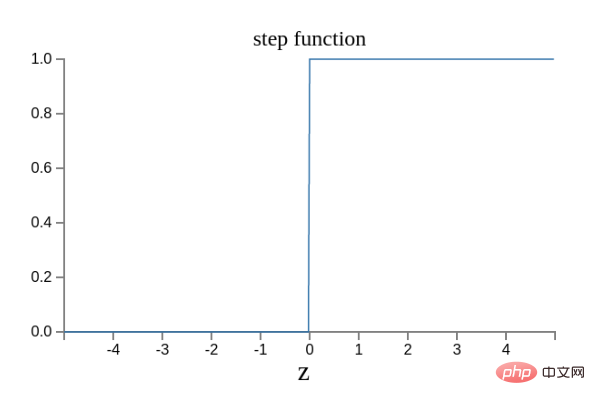

Die ursprüngliche Ausgabekurve ist wie folgt.

Das ist nun:

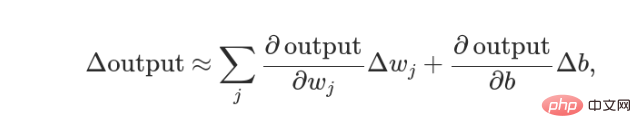

Tatsächlich kann auch bewiesen werden, dass Δσ die folgende Formel erfüllt.

Das heißt, es besteht eine lineare Beziehung zwischen Δσ, Δw und Δb, und die Änderungsrate ist eine partielle Ableitung. Dies ist hilfreich, um die Werte von w und b genau zu berechnen.

Das obige ist der detaillierte Inhalt vonEinführung in die Grundlagen des Algorithmus neuronaler Netze. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Algorithmus zum Ersetzen von Seiten

Algorithmus zum Ersetzen von Seiten

Douyin-Level-Preisliste 1-75

Douyin-Level-Preisliste 1-75

So legen Sie die Pfadumgebungsvariable fest

So legen Sie die Pfadumgebungsvariable fest

Was ist der Baidu-Index?

Was ist der Baidu-Index?

Was sind die Hauptmerkmale von Computern?

Was sind die Hauptmerkmale von Computern?

So machen Sie Screenshots am Computer

So machen Sie Screenshots am Computer

So schalten Sie die Firewall aus

So schalten Sie die Firewall aus

So lösen Sie das Problem, dass in Win7 kein neuer Ordner erstellt werden kann

So lösen Sie das Problem, dass in Win7 kein neuer Ordner erstellt werden kann

Was ist Pr

Was ist Pr