Hadoop wird für verteiltes Rechnen verwendet, was ist das?

Was ist Hadoop?

(1)Hadoop ist ein Open-Source-Framework, das verteilte Anwendungen schreiben und ausführen kann, um große Datenmengen zu verarbeiten Datenanalyse Das Design ist nicht für den Online-Transaktionsverarbeitungsmodus geeignet, bei dem mehrere Datensätze zufällig gelesen und geschrieben werden. (Empfohlenes Lernen: Web-Front-End-Video-Tutorial)

Hadoop=HDFS (Dateisystem, Datenspeichertechnologie bezogen) + Mapreduce (Datenverarbeitung), die Datenquelle von Hadoop kann sein Jede Form bietet im Vergleich zu relationalen Datenbanken eine bessere Leistung bei der Verarbeitung halbstrukturierter und unstrukturierter Daten und flexiblere Verarbeitungsmöglichkeiten. Unabhängig von der Datenform werden sie letztendlich in Schlüssel/Werte umgewandelt Grunddaten.

Verwenden Sie funktionale Ausdrücke in Mapreduce anstelle von SQL, während Mapreduce für relationale Datenbanken stattdessen das Open-Source-Tool Hive verwendet.

(2)Hadoop ist eine verteilte Computerlösung.

Was kann Hadoop?

Hadoop ist gut in der Protokollanalyse und Facebook verwendet Hive für die Protokollanalyse. Im Jahr 2009 verwendeten 30 % der Nicht-Programmierer bei Facebook HiveQL für die Datenanalyse; wird auch für die benutzerdefinierte Filterung bei Suchanfragen verwendet; Pig kann auch für die erweiterte Datenverarbeitung verwendet werden, einschließlich der Entdeckung von Personen, die Sie möglicherweise auf Twitter und LinkedIn kennen, wodurch ein Empfehlungseffekt ähnlich der kollaborativen Filterung von Amazon.com erzielt werden kann.

Die Produktempfehlungen von Taobao sind ebenfalls verfügbar! Bei Yahoo! 40 % der Hadoop-Jobs werden mit Pig ausgeführt, einschließlich Spam-Identifizierung und -Filterung sowie Modellierung von Benutzerfunktionen.

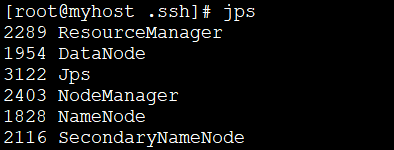

Unten befindet sich das Hadoop Distributed File System (HDFS), das Dateien auf allen Speicherknoten im Hadoop-Cluster speichert.

Die obere Schicht von HDFS ist die MapReduce-Engine, die aus JobTrackern und TaskTrackern besteht. Durch die Einführung des verteilten Kerndateisystems HDFS und der MapReduce-Verarbeitung der verteilten Hadoop-Computing-Plattform sowie des Data-Warehouse-Tools Hive und der verteilten Datenbank Hbase deckt es im Wesentlichen den gesamten technischen Kern der verteilten Hadoop-Plattform ab.

Das obige ist der detaillierte Inhalt vonHadoop wird für verteiltes Rechnen verwendet, was ist das?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet Wenn Sie Hadoop zur Verarbeitung großer Datenmengen verwenden, stoßen Sie häufig auf einige Java-Ausnahmefehler, die sich auf die Ausführung von Aufgaben auswirken und zum Scheitern der Datenverarbeitung führen können. In diesem Artikel werden einige häufige Hadoop-Fehler vorgestellt und Möglichkeiten aufgezeigt, mit ihnen umzugehen und sie zu vermeiden. Java.lang.OutOfMemoryErrorOutOfMemoryError ist ein Fehler, der durch unzureichenden Speicher der Java Virtual Machine verursacht wird. Wenn Hadoop ist

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Mit dem Aufkommen des Big-Data-Zeitalters sind Datenverarbeitung und -speicherung immer wichtiger geworden und die effiziente Verwaltung und Analyse großer Datenmengen ist für Unternehmen zu einer Herausforderung geworden. Hadoop und HBase, zwei Projekte der Apache Foundation, bieten eine Lösung für die Speicherung und Analyse großer Datenmengen. In diesem Artikel wird erläutert, wie Sie Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen verwenden. 1. Einführung in Hadoop und HBase Hadoop ist ein verteiltes Open-Source-Speicher- und Computersystem, das dies kann

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Da die Datenmenge weiter zunimmt, sind herkömmliche Datenverarbeitungsmethoden den Herausforderungen des Big-Data-Zeitalters nicht mehr gewachsen. Hadoop ist ein Open-Source-Framework für verteiltes Computing, das das Leistungsengpassproblem löst, das durch Einzelknotenserver bei der Verarbeitung großer Datenmengen verursacht wird, indem große Datenmengen verteilt gespeichert und verarbeitet werden. PHP ist eine Skriptsprache, die in der Webentwicklung weit verbreitet ist und die Vorteile einer schnellen Entwicklung und einfachen Wartung bietet. In diesem Artikel wird die Verwendung von PHP und Hadoop für die Verarbeitung großer Datenmengen vorgestellt. Was ist HadoopHadoop ist

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Java-Big-Data-Technologie-Stack: Verstehen Sie die Anwendung von Java im Bereich Big Data wie Hadoop, Spark, Kafka usw. Da die Datenmenge weiter zunimmt, ist die Big-Data-Technologie im heutigen Internetzeitalter zu einem heißen Thema geworden. Im Bereich Big Data hören wir oft die Namen Hadoop, Spark, Kafka und andere Technologien. Diese Technologien spielen eine entscheidende Rolle, und Java spielt als weit verbreitete Programmiersprache auch im Bereich Big Data eine große Rolle. Dieser Artikel konzentriert sich auf die Anwendung von Java im Großen und Ganzen

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

1: Installieren Sie JDK1. Führen Sie den folgenden Befehl aus, um das JDK1.8-Installationspaket herunterzuladen. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2. Führen Sie den folgenden Befehl aus, um das heruntergeladene JDK1.8-Installationspaket zu dekomprimieren . tar-zxvfjdk-8u151-linux-x64.tar.gz3. Verschieben Sie das JDK-Paket und benennen Sie es um. mvjdk1.8.0_151//usr/java84. Konfigurieren Sie Java-Umgebungsvariablen. Echo'

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Da die Datenmenge weiter zunimmt, ist die Datenverarbeitung in großem Maßstab zu einem Problem geworden, dem sich Unternehmen stellen und das sie lösen müssen. Herkömmliche relationale Datenbanken können diesen Bedarf nicht mehr decken. Für die Speicherung und Analyse großer Datenmengen sind verteilte Computerplattformen wie Hadoop, Spark und Flink die beste Wahl. Im Auswahlprozess von Datenverarbeitungstools erfreut sich PHP als einfach zu entwickelnde und zu wartende Sprache bei Entwicklern immer größerer Beliebtheit. In diesem Artikel werden wir untersuchen, wie und wie PHP für die Verarbeitung großer Datenmengen genutzt werden kann

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Im aktuellen Internetzeitalter ist die Verarbeitung großer Datenmengen ein Problem, mit dem sich jedes Unternehmen und jede Institution auseinandersetzen muss. Als weit verbreitete Programmiersprache muss PHP auch in der Datenverarbeitung mit der Zeit gehen. Um große Datenmengen effizienter zu verarbeiten, hat die PHP-Entwicklung einige Big-Data-Verarbeitungstools wie Spark und Hadoop eingeführt. Spark ist eine Open-Source-Datenverarbeitungs-Engine, die für die verteilte Verarbeitung großer Datenmengen verwendet werden kann. Das größte Merkmal von Spark ist seine schnelle Datenverarbeitungsgeschwindigkeit und effiziente Datenspeicherung.

Vergleichs- und Anwendungsszenarien von Redis und Hadoop

Jun 21, 2023 am 08:28 AM

Vergleichs- und Anwendungsszenarien von Redis und Hadoop

Jun 21, 2023 am 08:28 AM

Redis und Hadoop sind beide häufig verwendete Systeme zur verteilten Datenspeicherung und -verarbeitung. Es gibt jedoch offensichtliche Unterschiede zwischen den beiden hinsichtlich Design, Leistung, Nutzungsszenarien usw. In diesem Artikel werden wir die Unterschiede zwischen Redis und Hadoop im Detail vergleichen und ihre anwendbaren Szenarien untersuchen. Redis-Übersicht Redis ist ein speicherbasiertes Open-Source-Datenspeichersystem, das mehrere Datenstrukturen und effiziente Lese- und Schreibvorgänge unterstützt. Zu den Hauptfunktionen von Redis gehören: Speicher: Redis