Backend-Entwicklung

Backend-Entwicklung

PHP-Tutorial

PHP-Tutorial

Beherrschen Sie die wichtigsten Methoden zum Crawlen von Webseiten mit PHP

Beherrschen Sie die wichtigsten Methoden zum Crawlen von Webseiten mit PHP

Beherrschen Sie die wichtigsten Methoden zum Crawlen von Webseiten mit PHP

Der Hauptprozess besteht darin, die gesamte Webseite abzurufen und sie dann mit regulären Ausdrücken abzugleichen (kritisch).

Bei den wichtigsten Methoden zum Crawlen von PHP-Seiten gibt es mehrere Methoden, die auf den Erfahrungen von Online-Senioren basieren, aber noch nicht verwendet werden. Speichern Sie sie also und probieren Sie sie später aus.

1.file()-Funktion

2.file_get_contents()-Funktion

3.fopen()->fread()->fclose()-Modus

4.curl-Methode (ich verwende diese hauptsächlich)

5.fsockopen()-Funktions-Socket-Modus

6 /projects/ snoopy/)

7.file() function

<?php //定义url $url='[http://t.qq.com](http://t.qq.com/)';//fiel函数读取内容数组 $lines_array=file($url);//拆分数组为字符串 $lines_string=implode('',$lines_array);//输出内容 echo $lines_string;

2. Verwenden Sie die file_get_contents-Methode, um sie zu implementieren, was relativ einfach ist.

Die Verwendung von file_get_contents und fopen muss Leerzeichen allow_url_fopen ermöglichen. Methode: Bearbeiten Sie php.ini und legen Sie allow_url_fopen = On fest. Wenn „allow_url_fopen“ deaktiviert ist, können weder fopen noch file_get_contents Remote-Dateien öffnen.

$url="[http://news.sina.com.cn/c/nd/2016-10-23/doc-ifxwztru6951143.shtml](http://news.sina.com.cn/c/nd/2016-10-23/doc-ifxwztru6951143.shtml)";

$html=file_get_contents($url);

//如果出现中文乱码使用下面代码`

//$getcontent = iconv("gb2312", "utf-8",$html);

echo"<textarea style='width:800px;height:600px;'>".$html."</textarea>";Modus Ich habe es noch nicht benutzt, als ich es gesehen habe. fopen()->fread()->fclose()

<?php

//定义url

$url='[http://t.qq.com](http://t.qq.com/)';//fopen以二进制方式打开

$handle=fopen($url,"rb");//变量初始化

$lines_string="";//循环读取数据

do{

$data=fread($handle,1024);

if(strlen($data)==0) {`

break;

}

$lines_string.=$data;

}while(true);//关闭fopen句柄,释放资源

fclose($handle);//输出内容

echo $lines_string;<?php

header("Content-Type: text/html;charset=utf-8");

date_default_timezone_set('PRC');

$url = "https://***********ycare";//要爬取的网址

$res = curl_get_contents($url);//curl封装方法

preg_match_all('/<script>(.*?)<\/script>/',$res,$arr_all);//这个网页中数据通过js包过来,所以直接抓js就可以

preg_match_all('/"id"\:"(.*?)",/',$arr_all[1][1],$arr1);//从js块中匹配要的数据

$list = array_unique($arr1[1]);//(可省)保证不重复

//以下则是同理,循环则可

for($i=0;$i<=6;$i=$i+2){

$detail_url = 'ht*****em/'.$list[$i];

$detail_res = curl_get_contents($detail_url);

preg_match_all('/<script>(.*?)<\/script>/',$detail_res,$arr_detail);

preg_match('/"desc"\:"(.*?)",/',$arr_detail[1][1],$arr_content);

***

***

***

$ret=curl_post('http://**********cms.php',$result);//此脚本未放在服务器上,原因大家懂就好哈。

}

function curl_get_contents($url,$cookie='',$referer='',$timeout=300,$ishead=0) {

$curl = curl_init();

curl_setopt($curl, CURLOPT_RETURNTRANSFER,1);

curl_setopt($curl, CURLOPT_FOLLOWLOCATION,1);

curl_setopt($curl, CURLOPT_URL,$url);

curl_setopt($curl, CURLOPT_TIMEOUT,$timeout);

curl_setopt($curl, CURLOPT_USERAGENT,'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36');

if($cookie)

{

curl_setopt( $curl, CURLOPT_COOKIE,$cookie);

}

if($referer)

{

curl_setopt ($curl,CURLOPT_REFERER,$referer);

}

$ssl = substr($url, 0, 8) == "https://" ? TRUE : FALSE;

if ($ssl)

{

curl_setopt($curl, CURLOPT_SSL_VERIFYHOST, false);

curl_setopt($curl, CURLOPT_SSL_VERIFYPEER, false);

}

$res = curl_exec($curl);

return $res;

curl_close($curl);

}

//curl post数据到服务器

function curl_post($url,$data){

$ch = curl_init();

curl_setopt($ch,CURLOPT_RETURNTRANSFER,1);

//curl_setopt($ch,CURLOPT_FOLLOWLOCATION, 1);

curl_setopt($ch, CURLOPT_SSL_VERIFYPEER, FALSE);

curl_setopt($ch,CURLOPT_USERAGENT,'Mozilla/5.0 (Windows NT 6.1; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/65.0.3325.181 Safari/537.36');

curl_setopt($ch,CURLOPT_URL,$url);

curl_setopt($ch,CURLOPT_POST,true);

curl_setopt($ch,CURLOPT_POSTFIELDS,$data);

$output = curl_exec($ch);

curl_close($ch);

return $output;

}

?>Funktion Socket-Modus (habe ihn noch nicht verwendet, Sie können ihn in Zukunft ausprobieren)fsockopen()

<?php

$fp = fsockopen("t.qq.com", 80, $errno, $errstr, 30);

if (!$fp) {

echo "$errstr ($errno)<br />\n";

} else {

$out = "GET / HTTP/1.1\r\n";

$out .= "Host: t.qq.com\r\n";

$out .= "Connection: Close\r\n\r\n";

fwrite($fp, $out);

while (!feof($fp)) {

echo fgets($fp, 128);

}

fclose($fp);

}<?php //引入snoopy的类文件 require('Snoopy.class.php'); //初始化snoopy类 $snoopy=new Snoopy; $url="[http://t.qq.com](http://t.qq.com/)"; //开始采集内容` $snoopy->fetch($url); //保存采集内容到$lines_string $lines_string=$snoopy->results; //输出内容,嘿嘿,大家也可以保存在自己的服务器上 echo $lines_string;

Empfohlene verwandte Lerninhalte:

Das obige ist der detaillierte Inhalt vonBeherrschen Sie die wichtigsten Methoden zum Crawlen von Webseiten mit PHP. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1393

1393

52

52

1205

1205

24

24

PHP 8.4 Installations- und Upgrade-Anleitung für Ubuntu und Debian

Dec 24, 2024 pm 04:42 PM

PHP 8.4 Installations- und Upgrade-Anleitung für Ubuntu und Debian

Dec 24, 2024 pm 04:42 PM

PHP 8.4 bringt mehrere neue Funktionen, Sicherheitsverbesserungen und Leistungsverbesserungen mit einer beträchtlichen Menge an veralteten und entfernten Funktionen. In dieser Anleitung wird erklärt, wie Sie PHP 8.4 installieren oder auf PHP 8.4 auf Ubuntu, Debian oder deren Derivaten aktualisieren. Obwohl es möglich ist, PHP aus dem Quellcode zu kompilieren, ist die Installation aus einem APT-Repository wie unten erläutert oft schneller und sicherer, da diese Repositorys in Zukunft die neuesten Fehlerbehebungen und Sicherheitsupdates bereitstellen.

7 PHP-Funktionen, die ich leider vorher nicht kannte

Nov 13, 2024 am 09:42 AM

7 PHP-Funktionen, die ich leider vorher nicht kannte

Nov 13, 2024 am 09:42 AM

Wenn Sie ein erfahrener PHP-Entwickler sind, haben Sie möglicherweise das Gefühl, dass Sie dort waren und dies bereits getan haben. Sie haben eine beträchtliche Anzahl von Anwendungen entwickelt, Millionen von Codezeilen debuggt und eine Reihe von Skripten optimiert, um op zu erreichen

So richten Sie Visual Studio-Code (VS-Code) für die PHP-Entwicklung ein

Dec 20, 2024 am 11:31 AM

So richten Sie Visual Studio-Code (VS-Code) für die PHP-Entwicklung ein

Dec 20, 2024 am 11:31 AM

Visual Studio Code, auch bekannt als VS Code, ist ein kostenloser Quellcode-Editor – oder eine integrierte Entwicklungsumgebung (IDE) –, die für alle gängigen Betriebssysteme verfügbar ist. Mit einer großen Sammlung von Erweiterungen für viele Programmiersprachen kann VS Code c

Erklären Sie JSON Web Tokens (JWT) und ihren Anwendungsfall in PHP -APIs.

Apr 05, 2025 am 12:04 AM

Erklären Sie JSON Web Tokens (JWT) und ihren Anwendungsfall in PHP -APIs.

Apr 05, 2025 am 12:04 AM

JWT ist ein offener Standard, der auf JSON basiert und zur sicheren Übertragung von Informationen zwischen Parteien verwendet wird, hauptsächlich für die Identitätsauthentifizierung und den Informationsaustausch. 1. JWT besteht aus drei Teilen: Header, Nutzlast und Signatur. 2. Das Arbeitsprinzip von JWT enthält drei Schritte: Generierung von JWT, Überprüfung von JWT und Parsingnayload. 3. Bei Verwendung von JWT zur Authentifizierung in PHP kann JWT generiert und überprüft werden, und die Funktionen und Berechtigungsinformationen der Benutzer können in die erweiterte Verwendung aufgenommen werden. 4. Häufige Fehler sind Signaturüberprüfungsfehler, Token -Ablauf und übergroße Nutzlast. Zu Debugging -Fähigkeiten gehört die Verwendung von Debugging -Tools und Protokollierung. 5. Leistungsoptimierung und Best Practices umfassen die Verwendung geeigneter Signaturalgorithmen, das Einstellen von Gültigkeitsperioden angemessen.

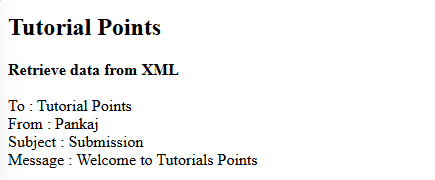

Wie analysiert und verarbeitet man HTML/XML in PHP?

Feb 07, 2025 am 11:57 AM

Wie analysiert und verarbeitet man HTML/XML in PHP?

Feb 07, 2025 am 11:57 AM

Dieses Tutorial zeigt, wie XML -Dokumente mit PHP effizient verarbeitet werden. XML (Extensible Markup-Sprache) ist eine vielseitige textbasierte Markup-Sprache, die sowohl für die Lesbarkeit des Menschen als auch für die Analyse von Maschinen entwickelt wurde. Es wird üblicherweise für die Datenspeicherung ein verwendet und wird häufig verwendet

PHP -Programm zum Zählen von Vokalen in einer Zeichenfolge

Feb 07, 2025 pm 12:12 PM

PHP -Programm zum Zählen von Vokalen in einer Zeichenfolge

Feb 07, 2025 pm 12:12 PM

Eine Zeichenfolge ist eine Folge von Zeichen, einschließlich Buchstaben, Zahlen und Symbolen. In diesem Tutorial wird lernen, wie Sie die Anzahl der Vokale in einer bestimmten Zeichenfolge in PHP unter Verwendung verschiedener Methoden berechnen. Die Vokale auf Englisch sind a, e, i, o, u und sie können Großbuchstaben oder Kleinbuchstaben sein. Was ist ein Vokal? Vokale sind alphabetische Zeichen, die eine spezifische Aussprache darstellen. Es gibt fünf Vokale in Englisch, einschließlich Großbuchstaben und Kleinbuchstaben: a, e, ich, o, u Beispiel 1 Eingabe: String = "TutorialPoint" Ausgabe: 6 erklären Die Vokale in der String "TutorialPoint" sind u, o, i, a, o, ich. Insgesamt gibt es 6 Yuan

Erklären Sie die späte statische Bindung in PHP (statisch: :).

Apr 03, 2025 am 12:04 AM

Erklären Sie die späte statische Bindung in PHP (statisch: :).

Apr 03, 2025 am 12:04 AM

Statische Bindung (statisch: :) implementiert die späte statische Bindung (LSB) in PHP, sodass das Aufrufen von Klassen in statischen Kontexten anstatt Klassen zu definieren. 1) Der Analyseprozess wird zur Laufzeit durchgeführt.

Was sind PHP Magic -Methoden (__construct, __Destruct, __call, __get, __set usw.) und geben Sie Anwendungsfälle an?

Apr 03, 2025 am 12:03 AM

Was sind PHP Magic -Methoden (__construct, __Destruct, __call, __get, __set usw.) und geben Sie Anwendungsfälle an?

Apr 03, 2025 am 12:03 AM

Was sind die magischen Methoden von PHP? Zu den magischen Methoden von PHP gehören: 1. \ _ \ _ Konstrukt, verwendet, um Objekte zu initialisieren; 2. \ _ \ _ Destruct, verwendet zur Reinigung von Ressourcen; 3. \ _ \ _ Call, behandeln Sie nicht existierende Methodenaufrufe; 4. \ _ \ _ GET, Implementieren Sie den dynamischen Attributzugriff; 5. \ _ \ _ Setzen Sie dynamische Attributeinstellungen. Diese Methoden werden in bestimmten Situationen automatisch aufgerufen, wodurch die Code -Flexibilität und -Effizienz verbessert werden.