Welche Rolle spielt HDFS in Hadoop?

Die Rolle von HDFS in Hadoop besteht darin, Speicher für große Datenmengen bereitzustellen und einen Datenzugriff mit hohem Durchsatz zu ermöglichen. HDFS ist für den Einsatz auf kostengünstiger Hardware konzipiert und bietet einen hohen Durchsatz für den Zugriff auf Anwendungsdaten. Geeignet für Anwendungen mit sehr großen Datenmengen.

Hadoop ist eine verteilte Systeminfrastruktur, die von der Apache Foundation entwickelt wurde. Benutzer können verteilte Programme entwickeln, ohne die zugrunde liegenden Details der Verteilung zu verstehen. Nutzen Sie die Leistungsfähigkeit von Clustern für Hochgeschwindigkeits-Computing und -Speicherung voll aus.

Hadoop implementiert ein verteiltes Dateisystem (Hadoop Distributed File System), eine seiner Komponenten ist HDFS.

HDFS ist äußerst fehlertolerant und für den Einsatz auf kostengünstiger Hardware konzipiert. Es bietet einen hohen Durchsatz für den Zugriff auf Anwendungsdaten und eignet sich für Anwendungen mit extrem großen Datenmengen. HDFS lockert die POSIX-Anforderungen und kann in Form eines Streaming-Zugriffs auf Daten im Dateisystem zugreifen.

Das Kerndesign des Hadoop-Frameworks ist: HDFS und MapReduce. HDFS bietet Speicher für große Datenmengen, während MapReduce die Berechnung großer Datenmengen ermöglicht.

HDFS

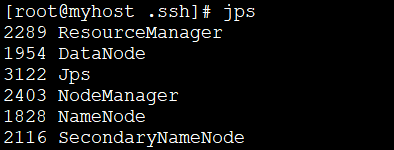

Für externe Clients sieht HDFS wie ein traditionelles hierarchisches Dateisystem aus. Dateien können erstellt, gelöscht, verschoben oder umbenannt werden und vieles mehr. Die Architektur von HDFS basiert jedoch auf einem bestimmten Satz von Knoten (siehe Abbildung 1), der durch seine eigenen Eigenschaften bestimmt wird. Zu diesen Knoten gehören der NameNode (nur einer), der Metadatendienste innerhalb von HDFS bereitstellt, und der DataNode, der Speicherblöcke für HDFS bereitstellt. Dies ist ein Nachteil (Single Point of Failure) der HDFS 1.x-Versionen, da nur ein NameNode vorhanden ist. In der Hadoop 2.x-Version können zwei NameNodes vorhanden sein, wodurch das Problem des Ausfalls eines einzelnen Knotens gelöst wird.

In HDFS gespeicherte Dateien werden in Blöcke unterteilt und diese Blöcke werden dann auf mehrere Computer (DataNodes) kopiert. Dies unterscheidet sich stark von der herkömmlichen RAID-Architektur. Die Größe der Blöcke (standardmäßig 64 MB für 1.x und 128 MB für 2.x) und die Anzahl der kopierten Blöcke werden vom Client beim Erstellen der Datei festgelegt. Der NameNode steuert alle Dateioperationen. Die gesamte Kommunikation innerhalb von HDFS basiert auf dem Standard-TCP/IP-Protokoll.

Weitere Informationen zu diesem Thema finden Sie auf: Chinesische PHP-Website!

Das obige ist der detaillierte Inhalt vonWelche Rolle spielt HDFS in Hadoop?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet

Jun 24, 2023 pm 01:06 PM

Java-Fehler: Hadoop-Fehler, wie man damit umgeht und sie vermeidet Wenn Sie Hadoop zur Verarbeitung großer Datenmengen verwenden, stoßen Sie häufig auf einige Java-Ausnahmefehler, die sich auf die Ausführung von Aufgaben auswirken und zum Scheitern der Datenverarbeitung führen können. In diesem Artikel werden einige häufige Hadoop-Fehler vorgestellt und Möglichkeiten aufgezeigt, mit ihnen umzugehen und sie zu vermeiden. Java.lang.OutOfMemoryErrorOutOfMemoryError ist ein Fehler, der durch unzureichenden Speicher der Java Virtual Machine verursacht wird. Wenn Hadoop ist

Was ist der HDFS-Befehl?

Mar 14, 2023 pm 03:51 PM

Was ist der HDFS-Befehl?

Mar 14, 2023 pm 03:51 PM

Der Befehl „hdfs“ bezieht sich auf den Befehl „hdfs“: 1. Befehl „ls“; copyFromLocal-Befehl; 8. get-Befehl; 9. copyToLocal-Befehl usw.

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Verwendung von Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen

Jun 22, 2023 am 10:21 AM

Mit dem Aufkommen des Big-Data-Zeitalters sind Datenverarbeitung und -speicherung immer wichtiger geworden und die effiziente Verwaltung und Analyse großer Datenmengen ist für Unternehmen zu einer Herausforderung geworden. Hadoop und HBase, zwei Projekte der Apache Foundation, bieten eine Lösung für die Speicherung und Analyse großer Datenmengen. In diesem Artikel wird erläutert, wie Sie Hadoop und HBase in Beego für die Speicherung und Abfrage großer Datenmengen verwenden. 1. Einführung in Hadoop und HBase Hadoop ist ein verteiltes Open-Source-Speicher- und Computersystem, das dies kann

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Wie man PHP und Hadoop für die Big-Data-Verarbeitung verwendet

Jun 19, 2023 pm 02:24 PM

Da die Datenmenge weiter zunimmt, sind herkömmliche Datenverarbeitungsmethoden den Herausforderungen des Big-Data-Zeitalters nicht mehr gewachsen. Hadoop ist ein Open-Source-Framework für verteiltes Computing, das das Leistungsengpassproblem löst, das durch Einzelknotenserver bei der Verarbeitung großer Datenmengen verursacht wird, indem große Datenmengen verteilt gespeichert und verarbeitet werden. PHP ist eine Skriptsprache, die in der Webentwicklung weit verbreitet ist und die Vorteile einer schnellen Entwicklung und einfachen Wartung bietet. In diesem Artikel wird die Verwendung von PHP und Hadoop für die Verarbeitung großer Datenmengen vorgestellt. Was ist HadoopHadoop ist

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Entdecken Sie die Anwendung von Java im Bereich Big Data: Verständnis von Hadoop, Spark, Kafka und anderen Technologie-Stacks

Dec 26, 2023 pm 02:57 PM

Java-Big-Data-Technologie-Stack: Verstehen Sie die Anwendung von Java im Bereich Big Data wie Hadoop, Spark, Kafka usw. Da die Datenmenge weiter zunimmt, ist die Big-Data-Technologie im heutigen Internetzeitalter zu einem heißen Thema geworden. Im Bereich Big Data hören wir oft die Namen Hadoop, Spark, Kafka und andere Technologien. Diese Technologien spielen eine entscheidende Rolle, und Java spielt als weit verbreitete Programmiersprache auch im Bereich Big Data eine große Rolle. Dieser Artikel konzentriert sich auf die Anwendung von Java im Großen und Ganzen

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

So installieren Sie Hadoop unter Linux

May 18, 2023 pm 08:19 PM

1: Installieren Sie JDK1. Führen Sie den folgenden Befehl aus, um das JDK1.8-Installationspaket herunterzuladen. wget--no-check-certificatehttps://repo.huaweicloud.com/java/jdk/8u151-b12/jdk-8u151-linux-x64.tar.gz2. Führen Sie den folgenden Befehl aus, um das heruntergeladene JDK1.8-Installationspaket zu dekomprimieren . tar-zxvfjdk-8u151-linux-x64.tar.gz3. Verschieben Sie das JDK-Paket und benennen Sie es um. mvjdk1.8.0_151//usr/java84. Konfigurieren Sie Java-Umgebungsvariablen. Echo'

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Verwenden Sie PHP, um eine groß angelegte Datenverarbeitung zu erreichen: Hadoop, Spark, Flink usw.

May 11, 2023 pm 04:13 PM

Da die Datenmenge weiter zunimmt, ist die Datenverarbeitung in großem Maßstab zu einem Problem geworden, dem sich Unternehmen stellen und das sie lösen müssen. Herkömmliche relationale Datenbanken können diesen Bedarf nicht mehr decken. Für die Speicherung und Analyse großer Datenmengen sind verteilte Computerplattformen wie Hadoop, Spark und Flink die beste Wahl. Im Auswahlprozess von Datenverarbeitungstools erfreut sich PHP als einfach zu entwickelnde und zu wartende Sprache bei Entwicklern immer größerer Beliebtheit. In diesem Artikel werden wir untersuchen, wie und wie PHP für die Verarbeitung großer Datenmengen genutzt werden kann

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Datenverarbeitungs-Engines in PHP (Spark, Hadoop usw.)

Jun 23, 2023 am 09:43 AM

Im aktuellen Internetzeitalter ist die Verarbeitung großer Datenmengen ein Problem, mit dem sich jedes Unternehmen und jede Institution auseinandersetzen muss. Als weit verbreitete Programmiersprache muss PHP auch in der Datenverarbeitung mit der Zeit gehen. Um große Datenmengen effizienter zu verarbeiten, hat die PHP-Entwicklung einige Big-Data-Verarbeitungstools wie Spark und Hadoop eingeführt. Spark ist eine Open-Source-Datenverarbeitungs-Engine, die für die verteilte Verarbeitung großer Datenmengen verwendet werden kann. Das größte Merkmal von Spark ist seine schnelle Datenverarbeitungsgeschwindigkeit und effiziente Datenspeicherung.