Unterschiede: 1. OpenStack ist ein Tool zur Verwaltung von IT-Ressourcen, während Docker eine Anwendungscontainer-Engine ist. 2. OpenStack ist etwas in der IaaS-Ebene und Docker ist etwas, das IaaS und PaaS umfasst OpenStack ist groß, während Docker nur wenig Platz einnimmt.

Die Betriebsumgebung dieses Tutorials: Linux5.9.8-System, Docker-1.13.1-Version, Dell G3-Computer.

ist ein Tool zur Verwaltung von IT-Ressourcen. Der Unterschied zu den Desktop-Versionen von VirtualBox und VMware besteht darin, dass diese Software nur virtuelle Maschinen auf ihrer eigenen Maschine verwalten kann, während OpenStack virtuelle Maschinen auf einer Reihe von Servern verwalten kann.

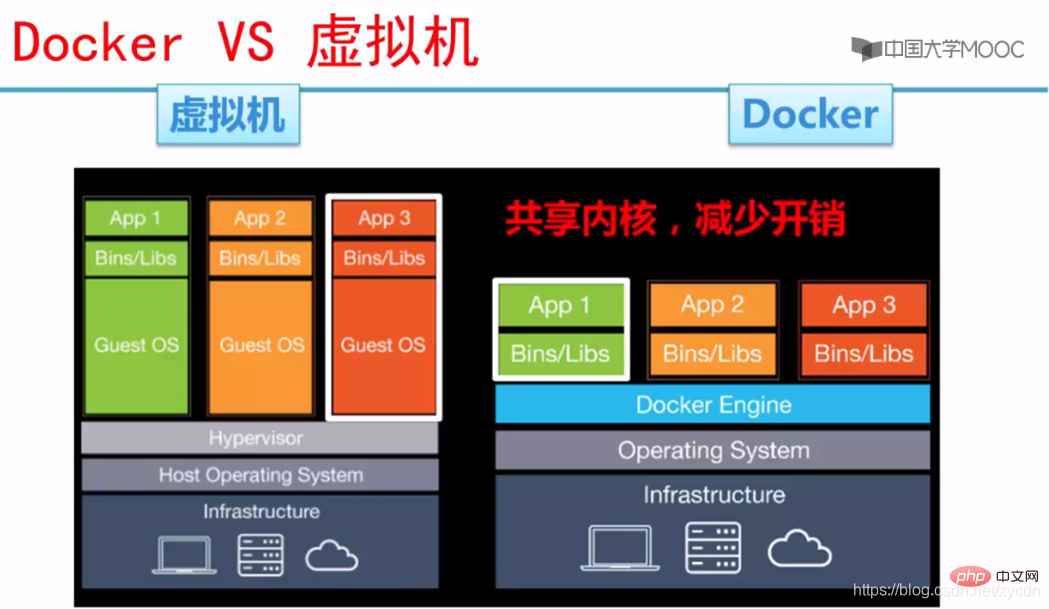

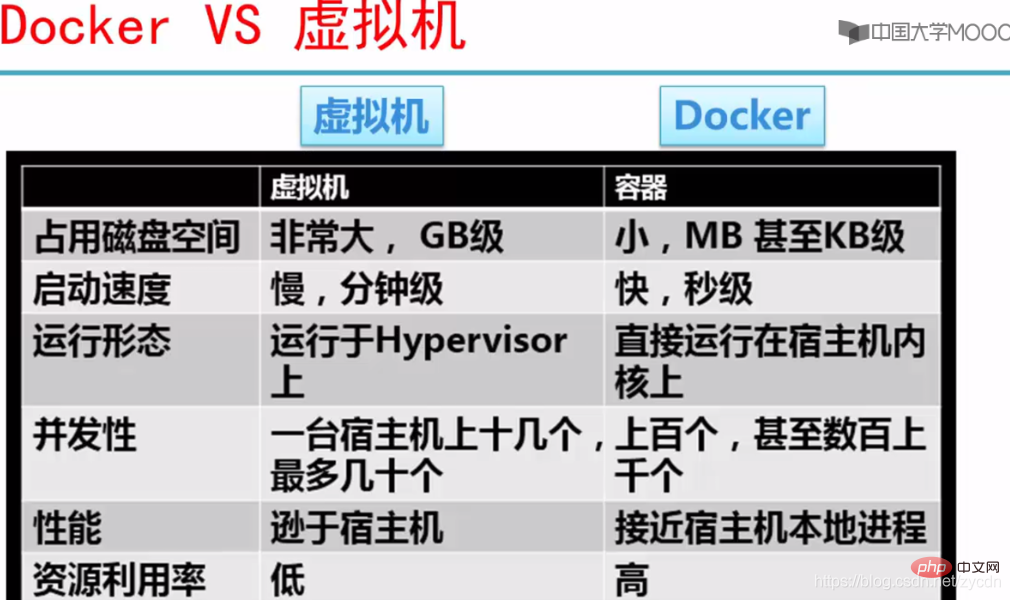

Eine Open-Source-Anwendungscontainer-Engine. Jede virtuelle Maschine von Docker ist tatsächlich ein Prozess im Host-Betriebssystem. Entwickler können ihre eigenen Anwendungen in Container packen und sie dann zu Docker-Anwendungen auf anderen Maschinen migrieren, was eine schnelle Bereitstellung ermöglicht.

OpenStack ist eine Sache der IaaS-Ebene, es integriert eine Reihe von Servern und erstellt und verwaltet dann frei viele virtuelle Maschinen auf diesen Servern. Natürlich möchten Sie noch nicht die CPUs mehrerer Server zu einer leistungsstärkeren virtuellen Maschine zusammenfassen.

Docker und Docker-basierter Schwarm bzw. Kubernetes wollen in puncto Virtualisierung grundsätzlich das Gleiche tun wie Openstack, verbrauchen aber weniger Hardware-Ressourcen als virtuelle Maschinen wie kvm. Aber er hat auch einige Bereitstellungsstandardisierungen vorgenommen, sodass Docker etwas ist, das IaaS und PaaS umfasst, oder die ursprüngliche strikte Schichtung von IaaS und PaaS durchbricht, was diese Begriffe oder die Leute, die diese Begriffe sagen, einschließlich mir, etwas chaotisch macht. Aber es ist so einfach und effektiv.

Empfohlenes Lernen: „Docker-Video-Tutorial“

Das obige ist der detaillierte Inhalt vonWas ist der Unterschied zwischen OpenStack und Docker?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Der Unterschied zwischen k8s und Docker

Der Unterschied zwischen k8s und Docker

Was sind die Cloud-Betriebssysteme?

Was sind die Cloud-Betriebssysteme?

Mit welchen Methoden kann Docker in den Container gelangen?

Mit welchen Methoden kann Docker in den Container gelangen?

Was soll ich tun, wenn der Docker-Container nicht auf das externe Netzwerk zugreifen kann?

Was soll ich tun, wenn der Docker-Container nicht auf das externe Netzwerk zugreifen kann?

Wozu dient das Docker-Image?

Wozu dient das Docker-Image?

ps ausgewählten Bereich löschen

ps ausgewählten Bereich löschen

ERR_CONNECTION_REFUSED

ERR_CONNECTION_REFUSED

Sie benötigen die Erlaubnis des Administrators, um Änderungen an dieser Datei vorzunehmen

Sie benötigen die Erlaubnis des Administrators, um Änderungen an dieser Datei vorzunehmen