Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

ChatGPT und Google Bard: Welches ist besser und welches schlechter?

ChatGPT und Google Bard: Welches ist besser und welches schlechter?

ChatGPT und Google Bard: Welches ist besser und welches schlechter?

Die beiden größten Konkurrenten in der AIGC-Branche: ChatGPT vs. Google Bard! Dieser Artikel stellt die technischen Unterschiede zwischen diesen beiden Engines für künstliche Intelligenz vor.

Übersetzer |. Rezensent |. Sun Shujuan

Die beiden größten Konkurrenten in der AIGC-Branche: ChatGPT vs. Google Bard!

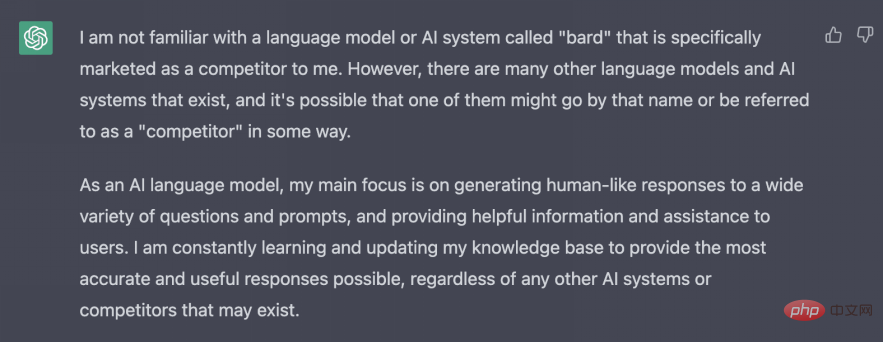

Der bisher größte Unterschied zwischen Google Bard und ChatGPT ist: Bard kennt ChatGPT, ChatGPT kennt Bard jedoch nicht. Während wir mit ChatGPT herumspielen können, ist Bard für die meisten von uns immer noch unerreichbar.

ChatGPT und Google Bard sind beide Chatbots mit künstlicher Intelligenz. Eine vereinfachte Version der künstlichen Intelligenz ist bereits auf Mobiltelefonen verfügbar. Wenn Sie „gut“ eingeben, kann das Telefon vorhersagen, dass das nächste Wort „Morgen“ sein wird.

ChatGPT und Google Bard sind beide Chatbots mit künstlicher Intelligenz. Eine vereinfachte Version der künstlichen Intelligenz ist bereits auf Mobiltelefonen verfügbar. Wenn Sie „gut“ eingeben, kann das Telefon vorhersagen, dass das nächste Wort „Morgen“ sein wird.

ChatGPT wurde ursprünglich von OpenAI entwickelt und dann von Microsoft für atemberaubende 10 Milliarden US-Dollar finanziert (zusätzlich zu einer früheren Investition von 1 Milliarde US-Dollar). Google, das leicht in Panik war, dass sein Suchmonopol enden könnte, startete Bard, aber diese Version wies immer noch einige Mängel auf. Bei seiner ersten Live-Demonstration machte Bard mehrere sachliche Fehler, die Google in Verlegenheit brachten.

ChatGPT und Google Bard sind komplexer als die Textvorhersagefunktionen von Smartphones. Wenn Sie die Unterschiede zwischen diesen beiden intelligenten Robotern verstehen möchten, dürfen Sie den folgenden Inhalt nicht verpassen.

Hier werden wir die technischen Unterschiede zwischen den beiden Engines für künstliche Intelligenz ausführlich beschreiben.

ChatGPT und Bard: Versteckte Geheimnisse?

Anhand der folgenden Tabelle, in der Sie viele Details sehen können, können wir die technischen Unterschiede zwischen ihnen schnell verstehen.

|

|

hatGPT B | ard | Modell|

GPT-3.5 |

LaMDA, das Sprachmodell für Konversationsanwendungen |

Neuronale Netzwerkstruktur | |

Transformer |

Transformer |

||

Trainingsdaten |

Webtext, hauptsächlich ein Datensatz namens „CommonCrawl“, ist Mitte 2021 fällig. |

1,56 Millionen Wörter an öffentlichen Konversationsdaten und Netzwerktexten |

|

| 175 Milliarden Parameter | 137 Milliarden Parameter | ||

| OpenAI | Google | ||

|

| - Offen für alle- Flexibler und besser im Umgang mit offenen Texten | - Trainingsdaten ab 2021

- Aktuelle Trainingsdaten - Speziell für Konversationen trainiert, sodass es sich beim Sprechen eher wie ein Mensch anhört. Nachteile |

|

|

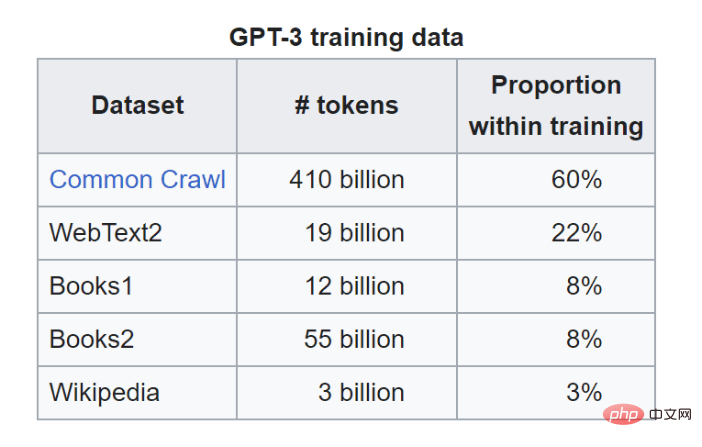

Da wir nun die Unterschiede zwischen den beiden anhand der obigen Tabelle verstanden haben, werfen wir einen genaueren Blick auf die anderen Indikatoren. Was ist ChatGPT?ChatGPT erschien am 30. November 2022 plötzlich auf der Bühne. Mit Stand vom 4. Dezember 2022 hat der Dienst täglich über eine Million Nutzer. Im Januar 2023 stieg diese Zahl auf über 100 Millionen Nutzer. Der Hauptgrund für die plötzliche Beliebtheit ist, dass es Ihnen auf fast menschlich klingende Weise zuverlässige Antworten auf viele Themen liefert und jeder mit einer Internetverbindung es nutzen kann. ChatGPT wurde von OpenAI entwickelt, einem Labor für künstliche Intelligenz mit Sitz in San Francisco, das sich auf die Entwicklung benutzerfreundlicher Lösungen für künstliche Intelligenz konzentriert. Der Chatbot basiert auf GPT-3.5, einem großen Sprachmodell, das dem Anfragenden kontinuierlich Antworten geben kann, wenn ihm Text gegeben wird. ChatGPT fügt auf dieser Basis einige zusätzliche Schulungen hinzu – menschliche Trainer verbessern das Modell durch Interaktion mit dem Modell und geben dem Modell durch „Belohnungen“ die Fähigkeit, qualitativ hochwertige Antworten zu geben. TrainingsdatenGPT-3.5 wird anhand eines riesigen Webtextdatensatzes trainiert, einschließlich eines beliebten Datensatzes namens Common Crawl. Common Crawl enthält Petabytes an Webdaten, einschließlich roher Webseitendaten, Metadatenextraktion und Textextraktion. Es enthält beispielsweise eine Sammlung von URLs von StrataScratch. Ist es nicht verrückt zu glauben, dass ChatGPT Trainingsdaten aus den Eingaben von Internetnutzern auf ChatGPT verwendet? Common Crawl ist für 60 % der Trainingsdaten verantwortlich, aber GPT-3.5 verfügt auch über andere Datenquellen.

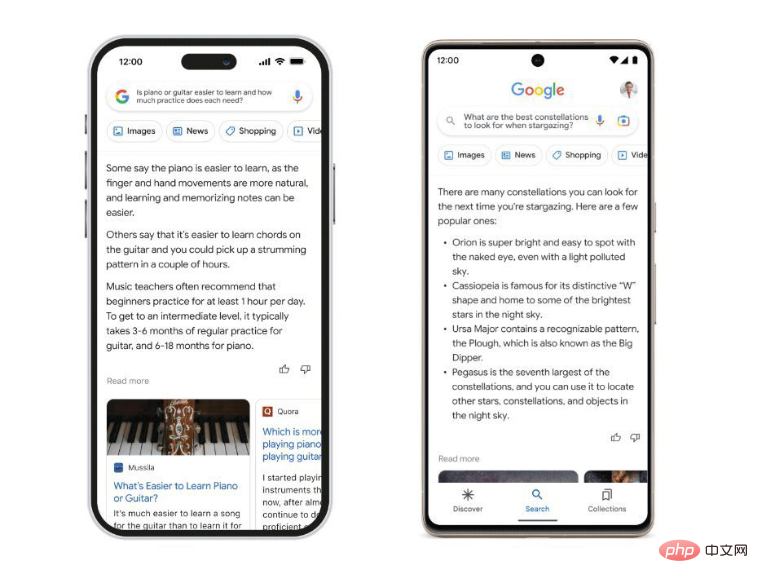

Was ist Google Bard?Google Bard ist ein intelligenter Chat-Roboter, der von Google eingeführt wurde, als ChatGPT sehr beliebt wurde. Im Gegensatz zu ChatGPT basiert Bard auf Googles eigenem Modell LaMDA. LaMDA ist die Abkürzung für Language Model for Conversational Applications. Im Gegensatz zu ChatGPT ist es aus dem einfachen Grund nicht so erstaunlich, dass die meisten Menschen noch keinen Zugriff darauf haben. Während Google Anfang Februar eine peinliche Demoversion von Bard veröffentlichte, steht Bard derzeit nur wenigen Auserwählten zur Verfügung. Der Hauptvorteil von Google Bard besteht darin, dass es für das Internet geöffnet ist. Fragen Sie ChatGPT: „Wer ist jetzt der Präsident?“ und es weiß es nicht. Dies liegt daran, dass die Trainingsdaten etwa Mitte 2021 abgeschnitten wurden. Bard hingegen stützte sich auf Informationen, die heute im Internet verfügbar sind. Theoretisch sollte Bard heute in der Lage sein, anhand der Daten im Internet zu sagen, wer gerade Präsident ist. Es ist leicht zu erkennen, wie sich Bard in mehreren wichtigen Aspekten von ChatGPT abhebt.

TrainingsdatenZuallererst wird LaMDA auf Konversationen trainiert, insbesondere für Konversationen, und nicht nur auf die Produktion von Text wie beim GPT-n-Modell. Während ChatGPT sich über seine Trainingsdaten nicht im Klaren ist, wissen wir nicht viel über die Daten, auf denen Bard trainiert wurde, und können aus einem Blick auf die Forschungsarbeit von LaMDA darauf schließen. Google-Forscher sagen, dass 12,5 % der Trainingsdaten von Common Crawl stammen, beispielsweise dem GPT-n-Modell. Weitere 12,5 % stammen von Wikipedia. Dem Forschungspapier zufolge verwendeten sie 1,56 Billionen Wörter an „öffentlichen Gesprächsdaten und Online-Texten“. Hier ist die vollständige Aufschlüsselung:

Aus den oben genannten Informationen können wir die von den beiden gemeinsam verwendeten Daten kennen, offensichtlich gibt es Wikipedia. Der Rest der Daten wurde offensichtlich absichtlich von Google verborgen, vermutlich um Bard (und LaMDA) vor Nachahmung zu schützen. LaMDA entstand durch die Feinabstimmung des neuronalen Sprachmodells von Transformer, einer Open-Source-Architektur für neuronale Netzwerke, die ursprünglich von Google entwickelt wurde. (GPT basiert ebenfalls auf Transformer).

ChatGPT weist einige Barrieren auf, um zu verhindern, dass es nervig ist oder Unsinn redet, aber Google legt Wert darauf, die Qualität sicherzustellen, um Bard zu einem besseren und sichereren Chatbot zu machen. Bard wurde so abgestimmt, dass er „hochwertig, geerdet und sicher“ ist. Google hat dazu viel zu sagen, ich empfehle die Lektüre der entsprechenden Blog-Beiträge, aber wenn Sie wenig Zeit haben, kann es grundsätzlich in die folgenden Aspekte unterteilt werden:

Wie wir alle wissen, ist Google nicht aufgrund eines falschen Starts völlig gescheitert Finden Sie die zugrunde liegenden Bedürfnisse heraus. Es ist jedoch erwähnenswert, dass Google seine Designanforderungen sehr klar formuliert, während ChatGPT zumindest im Moment nicht so klar ist. ChatGPT vs. Google Bard: Warum sind Modellparameter wichtig?ChatGPT hat mehr Modellparameter als Bard – 175 Milliarden gegenüber 137 Milliarden. Sie können sich Parameter als Knöpfe oder Hebel vorstellen, die das Modell an die Daten anpasst, auf denen es trainiert. Mehr Parameter bedeuten normalerweise, dass das Modell komplexe sprachliche Zusammenhänge besser erfassen kann, es besteht jedoch auch die Gefahr einer Überanpassung. Google Bard ist möglicherweise weniger flexibel als ChatGPT, aber aufgrund neuer Sprachanwendungsfälle möglicherweise auch leistungsfähiger. ChatGPT und Google Bard: Was haben sie gemeinsam?Hervorzuheben ist, dass die Modelle von Bard und ChatGPT (LaMDA bzw. GPT-3.5) auf Transformer-basierten Deep-Learning-Neuronalen Netzen basieren. Transformer kann beispielsweise einem trainierten Modell ermöglichen, einen Satz oder Absatz zu lesen, die Beziehung zwischen diesen Wörtern zu notieren und dann vorherzusagen, welche Wörter seiner Meinung nach als nächstes kommen werden – ähnlich der zuvor erwähnten Smartphone-Texterkennungsfunktion. Ich werde hier nicht auf die Diskussion eingehen, aber was Sie wissen müssen ist, dass dies bedeutet, dass sich Bard und ChatGPT im Kern nicht so sehr voneinander unterscheiden. ChatGPT vs. Google Bard: EigentumObwohl Eigentum nicht gerade ein technischer Unterschied ist, lohnt es sich, daran zu denken. Google Bard wird von Google entwickelt und ist vollständig im Besitz von Google, zusätzlich zu LaMDA, das ebenfalls von Google erstellt wurde. ChatGPT wird von OpenAI entwickelt, einem Forschungslabor für künstliche Intelligenz mit Sitz in San Francisco. OpenAI war ursprünglich eine gemeinnützige Organisation, gründete jedoch 2019 eine gewinnorientierte Tochtergesellschaft. OpenAI steht auch hinter Dall-E, der Text-zu-Bild-Generierung mit künstlicher Intelligenz, mit der Sie vielleicht schon gespielt haben. Obwohl Microsoft stark in OpenAI investiert hat, handelt es sich vorerst um eine unabhängige Forschungsorganisation. Welches ist besser, ChatGPT oder Google Bard?Es ist schwierig, eine faire Antwort auf diese Frage zu geben, da es viele Gemeinsamkeiten zwischen den beiden gibt, aber auch Unterschiede. Erstens hat derzeit fast niemand Zugriff auf Google Bard. Darüber hinaus wurden die Trainingsdaten von ChatGPT vor fast zwei Jahren abgeschnitten. Beide sind Textgeneratoren – Sie geben eine Eingabeaufforderung ein und sowohl Google Bard als auch ChatGPT können darauf antworten. Beide verfügen über Milliarden von Parametern zur Feinabstimmung des Modells. Beide verfügen über überlappende Trainingsdatenquellen und basieren auf Transformer, dem gleichen neuronalen Netzwerkmodell. Sie sind auch für verschiedene Zwecke konzipiert. Bard hilft Ihnen bei der Navigation in Google-Suchen und ist auf Konversation ausgelegt. ChatGPT kann ganze Blogbeiträge generieren. Es ist darauf ausgelegt, aussagekräftigen Text auszugeben. Auch wenn wir über die Unterschiede zwischen ChatGPT und Google Bard sprechen, beweist dies nur, wie weit die auf künstlicher Intelligenz basierende Technologie zur Textgenerierung fortgeschritten ist. Auch wenn beide noch einen weiten Weg vor sich haben und beide mit urheberrechtlichen und ethischen Kontroversen konfrontiert sind, sind beide Generatoren ein starkes Zeugnis für die Entwicklung moderner KI-Modelle. Einführung des ÜbersetzersCui Hao, 51CTO-Community-Redakteur, leitender Architekt, verfügt über 18 Jahre Erfahrung in der Softwareentwicklung und Architektur sowie 10 Jahre Erfahrung in verteilter Architektur. Originaltitel: ChatGPT vs Google Bard: Ein Vergleich der technischen Unterschiede, Autor: Nate Rosidi |

Das obige ist der detaillierte Inhalt vonChatGPT und Google Bard: Welches ist besser und welches schlechter?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G