Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

ChatGPT Waterloo: Weit verbreitetes Kontoverbot; von Italien verboten

ChatGPT Waterloo: Weit verbreitetes Kontoverbot; von Italien verboten

ChatGPT Waterloo: Weit verbreitetes Kontoverbot; von Italien verboten

ChatGPT scheint eine Krise zu erleben.

Am 31. März beschwerten sich zahlreiche Nutzer auf sozialen Plattformen darüber, dass sie sich nicht mehr mit ihrem eigenen Geld in das ChatGPT-Konto einloggen konnten. Noch peinlicher war, dass sie kein neues Konto registrieren konnten. Wie immer mehr Benutzer enthüllten, wurde festgestellt, dass der Vorfall mit der Kontosperrung am 30. März begonnen hatte und sich schnell ausbreitete.

Am 1. April sagten immer mehr Menschen, dass ihre Konten gesperrt seien, und die Leute auf großen Plattformen und in Gruppenchats beeilten sich, sich gegenseitig „Notizen“ zu machen, um eine Sperrung zu verhindern. Zu diesem Zeitpunkt blieben die ursprünglich nutzbaren Plus-Konten nicht verschont und wurden nacheinander ungültig, und einige Datensätze konnten in der Rechnung nicht überprüft werden.

Seltsamerweise schienen die groß angelegten Kontosperrungen auch am 3. April nicht aufgehört zu haben und schrieben auf sozialen Plattformen: „ChatGPT sperrt Konten in großem Umfang.“ Eine große Anzahl von Benutzern berichtete, dass sich die stillen Kontosperren dieses Mal hauptsächlich auf Asien konzentrierten. Gleichzeitig gab OpenAI keine Warnung oder Reaktion darauf heraus.

In Bezug auf die Compliance wurde ChatGPT ebenfalls einer neuen Prüfung unterzogen. Die Website Record gab bekannt, dass die italienische Datenschutzbehörde offiziell ein vorübergehendes Verbot der Nutzung von ChatGPT angekündigt und ihre Muttergesellschaft OpenAI strikt aufgefordert hat, die Verarbeitung italienischer Benutzerinformationen einzustellen. Italien hat den ersten Schuss zum Verbot von ChatGPT „abgefeuert“!

Zu den Gründen für das Verbot von ChatGPT gab die italienische Datenschutzbehörde an, dass OpenAI nicht nur illegal eine große Menge personenbezogener Daten italienischer Benutzer gesammelt habe, sondern, was noch schlimmer sei, dass OpenAI keinen Mechanismus zur Altersüberprüfung eingerichtet habe von ChatGPT-Benutzern, um zu verhindern, dass Minderjährige auf illegale Materialien zugreifen.

Die italienische Datenschutzbehörde erklärte weiter, dass OpenAI 20 Tage Zeit hat, sich gegen den Diebstahl von Informationen zu wehren, andernfalls kann ihm wegen Verstoßes gegen die Datenschutz-Grundverordnung der EU eine Geldstrafe von bis zu 20 Millionen Euro oder 4 % des Jahresumsatzes des Unternehmens auferlegt werden. Nicht nur im Hinblick auf Bußgelder: Sobald OpenAI nicht im Detail erklären kann, ob es Maßnahmen zum Schutz der Benutzerdaten ergriffen hat, erhöht sich zwangsläufig die Wahrscheinlichkeit, dass EU-Länder ChatGPT verbieten.

Nachdem Italien ChatGPT verboten hatte, schaltete OpenAI ChatGPT in Italien sofort offline, um zu erklären, dass die Arbeit des Unternehmens darin bestand, personenbezogene Daten beim Training künstlicher Intelligenzsysteme wie ChatGPT zu reduzieren wird eher die Welt verstehen als Einzelpersonen. Das Unternehmen hat keine Vorschriften verletzt und freut sich sehr auf die Zusammenarbeit mit der italienischen Datenschutzbehörde.

ChatGPT ist zweifellos ein zweischneidiges Schwert

Es ist unbestreitbar, dass die Entstehung von ChatGPT eine neue Runde der Informationsrevolution auslösen und der Menschheit mehr Nutzen bringen wird. Allerdings hat alles zwei Seiten, und die Gesellschaft freut sich darauf Die Vorteile, die ChatGPT für die Menschheit mit sich bringt. Wenn sich eine beispiellose Chance bietet, sollten Sie auch bedenken, welche Sicherheitsrisiken ihre Entstehung mit sich bringt. Schließlich sind in nur zwei bis drei Monaten nach und nach Sicherheitsrisiken durch die Nutzung von ChatGPT aufgetreten.

Benutzer können die Chat-Aufzeichnungen anderer Benutzer anzeigen

ChatGPT zeigt seit seiner Einführung ein „perfektes“ Bild, aber als die Anzahl der Benutzer allmählich zunahm, wurden nach und nach einige Sicherheitsrisiken sichtbar.

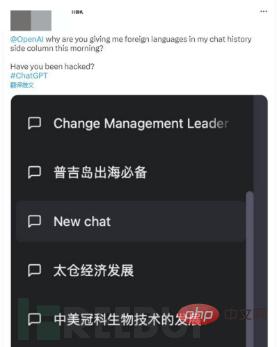

Anfang März 2023 gaben einige Benutzer bekannt, dass die Chat-Aufzeichnungen anderer Personen in ihren Chat-Listen angezeigt wurden. ChatGPT hatte eine Zeit lang Benutzerdaten durchsickern lassen und große Social-Media-Listen besetzt. Am Ende hatte es der CEO der Muttergesellschaft OpenAI, Sam Altman dringend einen Tweet zu posten, um den Benutzern zu erklären, dass der Fehler, der dazu führte, dass der ChatGPT-Chatverlauf des Benutzers durchgesickert ist, nur ein Fehler in der Open-Source-Codebasis war.

Obwohl OpenAI nach dem Durchsickern von Benutzer-Chat-Aufzeichnungen gegenüber den Medien bereitwillig zugab, dass in ChatGPT eine Sicherheitslücke bestand, und die Chat-Verlaufsfunktion sofort abschaltete, betonte es immer, dass nur der Titel des Chat-Verlaufs vorhanden sei Durchgesickert. Benutzer können die tatsächlichen Chats anderer Personen nicht sehen.

Den von OpenAI offengelegten Informationen zufolge werden Benutzerkonversationsinhalte automatisch in der Cloud gespeichert und es besteht die Möglichkeit, dass sie von Dritten gestohlen werden. In Kombination mit diesem Leck historischer Chat-Aufzeichnungen haben immer mehr Sicherheitsforscher damit begonnen Erwägen Sie ernsthaft die Entstehung von ChatGPT. Ob Informationssicherheitsprobleme zufällig sind.

Samsungs Nutzung von ChatGPT hat zum Verlust vertraulicher Daten geführt

Eine Welle nach der anderen. Letzte Woche enthüllten südkoreanische Medien, dass der Technologieriese Samsung Electronics weniger als 20 Tage nach der Einführung von ChatGPT drei Lecks interner vertraulicher Daten ausgesetzt war. (2 Fälle betrafen Halbleiterausrüstung und 1 Fall bezog sich auf den Inhalt interner Besprechungen).

Es wird berichtet, dass diese vertraulichen Informationen von Samsung Electronics möglicherweise in die ChatGPT-Datenbank importiert wurden und jederzeit Gefahr laufen, verloren zu gehen.

Detaillierte Beschreibung der drei Vorfälle:

- Mitarbeiter der Samsung DS Equipment Solutions-Abteilung stellten beim Betrieb von Halbleitertestgeräten zum Herunterladen von Software einige Probleme beim Kopieren fest. Daher fügten sie den problematischen Code in ChatGPT ein und versuchten, dies jedoch zu verhindern kann ChatGPT gestatten, vertrauliche Informationen von Samsung als Schulungsmaterial zu verwenden.

- Ein anderer Mitarbeiter der DS Device Solutions-Abteilung versuchte, ChatGPT zu verwenden, um ihm bei der Optimierung eines Codeabschnitts zu helfen, sodass er die Ausgabe und Qualität direkt mit einem zugehörigen Code verknüpfte

- Nachdem ein Samsung-Insider den KI-Sprachassistenten Naver Clova verwendet hatte, um die Besprechungsaufzeichnung in Text umzuwandeln, wollte er ChatGPT verwenden, um den Besprechungsinhalt zusammenzufassen und zu verfeinern, was jedoch dazu führen könnte das Durchsickern vertraulicher Besprechungsaufzeichnungen.

Nach dem Leck von Samsung Electronics organisierten sie sofort intern Sicherheitspersonal, um entsprechende Schutzmaßnahmen zu formulieren, und gaben an, dass Samsung den ChatGPT-Dienst möglicherweise intern abschalten würde, wenn ähnliche Vorfälle in Zukunft erneut auftreten. Darüber hinaus enthüllten die Medien, dass Samsung derzeit über das DS Department Innovation Center die Entwicklung Samsung-spezifischer KI-Dienste erwägt.

Am 11. März dieses Jahres verabschiedete Samsung Electronics einen Beschluss, um Mitarbeitern der DS-Abteilung die Nutzung von ChatGPT zu ermöglichen, ChatGPT ist jedoch für Mitarbeiter der Abteilung DX Device Experience weiterhin deaktiviert. Infolgedessen sind wir in nur zwanzig Tagen auf drei unerwartete Sicherheitsvorfälle gestoßen, was zeigt, dass die Sicherheit von ChatGPT tatsächlich eine Überlegung wert ist.

Samsung ist nicht das einzige Unternehmen, bei dem Mitarbeiter vertrauliche Unternehmensdaten auf ChatGPT hochladen. Den Statistiken von Cyberhaven über die Nutzung von ChatGPT durch 1,6 Millionen Mitarbeiter zufolge laden etwa 3,1 % der Mitarbeiter interne Unternehmensdaten zur Analyse direkt auf ChatGPT hoch, um die Arbeitseffizienz zu verbessern.

Eine Reihe wissenschaftlicher Persönlichkeiten haben gemeinsam ein Moratorium für leistungsfähigere KI-Entwicklungsforschung gefordert.

Wie aus den oben genannten Inhalten hervorgeht, ist ChatGPT weit verbreitet und birgt einige ernsthafte Sicherheitsrisiken, was die Zukunft von ChatGPT betrifft und künstliche Intelligenz weckten öffentliche Besorgnis über die KI-Technologie, und viele bekannte Wissenschaftler erklärten gemeinsam, dass sie die Entwicklung leistungsfähigerer KI-Systeme aussetzen würden.

Am 29. März (US-Zeit) waren unter den Teilnehmern der Vater der künstlichen Intelligenz, Jeffrey Hinton, Tesla- und Twitter-CEO Elon Musk, Turing-Award-Gewinner Joshua Bengio usw. Tausende von Experten für künstliche Intelligenz und Branchenführern haben einen offenen Brief mit dem Titel „ „Pause Large Model Experiments in AI“, herausgegeben vom Future of Life Institute, einer US-amerikanischen Non-Profit-Organisation.

In dem Brief forderten diese hochrangigen Experten alle Labore für künstliche Intelligenz auf, die Entwicklung und Ausbildung leistungsfähigerer Systeme für künstliche Intelligenz für mindestens ein halbes Jahr auszusetzen. Unter besonderen Umständen sollten Regierungen umgehend eingreifen und das KI-System sofort aussetzen Forschung.

Das obige ist der detaillierte Inhalt vonChatGPT Waterloo: Weit verbreitetes Kontoverbot; von Italien verboten. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

Video Face Swap

Tauschen Sie Gesichter in jedem Video mühelos mit unserem völlig kostenlosen KI-Gesichtstausch-Tool aus!

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1665

1665

14

14

1423

1423

52

52

1321

1321

25

25

1269

1269

29

29

1249

1249

24

24

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

Installationsschritte: 1. Laden Sie die ChatGTP-Software von der offiziellen ChatGTP-Website oder dem mobilen Store herunter. 2. Wählen Sie nach dem Öffnen in der Einstellungsoberfläche die Sprache aus. 3. Wählen Sie in der Spieloberfläche das Mensch-Maschine-Spiel aus 4. Geben Sie nach dem Start Befehle in das Chatfenster ein, um mit der Software zu interagieren.

Meistern Sie Netzwerksicherheit und Penetrationstests in Go

Nov 30, 2023 am 10:16 AM

Meistern Sie Netzwerksicherheit und Penetrationstests in Go

Nov 30, 2023 am 10:16 AM

Mit der Entwicklung des Internets ist die Netzwerksicherheit zu einem dringenden Thema geworden. Für Techniker, die sich mit der Netzwerksicherheit befassen, ist es zweifellos notwendig, eine effiziente, stabile und sichere Programmiersprache zu beherrschen. Unter anderem ist die Go-Sprache für viele Netzwerksicherheitsexperten zur ersten Wahl geworden. Die Go-Sprache, auch Golang genannt, ist eine von Google entwickelte Open-Source-Programmiersprache. Die Sprache zeichnet sich durch herausragende Eigenschaften wie hohe Effizienz, hohe Parallelität, hohe Zuverlässigkeit und hohe Sicherheit aus und wird daher häufig in der Netzwerksicherheit und bei Penetrationstests eingesetzt.

Kann Chatgpt in China verwendet werden?

Mar 05, 2024 pm 03:05 PM

Kann Chatgpt in China verwendet werden?

Mar 05, 2024 pm 03:05 PM

chatgpt kann in China verwendet werden, kann jedoch nicht registriert werden. Wenn Benutzer sich registrieren möchten, können sie zur Registrierung eine ausländische Mobiltelefonnummer verwenden. Beachten Sie, dass während des Registrierungsprozesses auf die Netzwerkumgebung umgestellt werden muss eine fremde IP.

Künstliche Intelligenz in der Cybersicherheit: Aktuelle Probleme und zukünftige Richtungen

Mar 01, 2024 pm 08:19 PM

Künstliche Intelligenz in der Cybersicherheit: Aktuelle Probleme und zukünftige Richtungen

Mar 01, 2024 pm 08:19 PM

Künstliche Intelligenz (KI) hat jeden Bereich revolutioniert, und die Cybersicherheit bildet da keine Ausnahme. Da unsere Abhängigkeit von Technologie immer weiter zunimmt, nehmen auch die Bedrohungen für unsere digitale Infrastruktur zu. Künstliche Intelligenz (KI) hat den Bereich der Cybersicherheit revolutioniert und fortschrittliche Funktionen für die Erkennung von Bedrohungen, die Reaktion auf Vorfälle und die Risikobewertung bereitgestellt. Allerdings gibt es einige Schwierigkeiten beim Einsatz künstlicher Intelligenz in der Cybersicherheit. Dieser Artikel befasst sich mit dem aktuellen Stand der künstlichen Intelligenz in der Cybersicherheit und erkundet zukünftige Richtungen. Die Rolle künstlicher Intelligenz bei der Cybersicherheit Regierungen, Unternehmen und Einzelpersonen stehen vor immer größeren Herausforderungen im Bereich der Cybersicherheit. Da Cyber-Bedrohungen immer ausgefeilter werden, steigt der Bedarf an fortschrittlichen Sicherheitsmaßnahmen weiter. Künstliche Intelligenz (KI) setzt auf ihre einzigartige Methode zur Erkennung und Vorbeugung

Der Roborock-Kehrroboter hat die Rheinland-Doppelzertifizierung bestanden und ist branchenführend in der Eckenreinigung und Sterilisation

Mar 19, 2024 am 10:30 AM

Der Roborock-Kehrroboter hat die Rheinland-Doppelzertifizierung bestanden und ist branchenführend in der Eckenreinigung und Sterilisation

Mar 19, 2024 am 10:30 AM

Kürzlich hat der TÜV Rheinland Greater China („TUV Rheinland“), eine international renommierte unabhängige Test-, Inspektions- und Zertifizierungsstelle, wichtige Netzwerksicherheits- und Datenschutzzertifizierungen für drei Kehrroboter P10Pro, P10S und P10SPro im Besitz von Roborock Technology ausgestellt. sowie die China-Marken-Zertifizierung „Effiziente Eckenreinigung“. Gleichzeitig veröffentlichte die Agentur auch Testberichte zur Selbstreinigungs- und Sterilisationsleistung für die Kehrroboter und Bodenwaschmaschinen A20 und A20Pro, die den Verbrauchern auf dem Markt eine maßgebliche Kaufreferenz bieten. Da Netzwerksicherheit immer mehr an Bedeutung gewinnt, hat TÜV Rheinland strenge Netzwerksicherheit und Datenschutz für Roborock-Kehrroboter gemäß den ETSIEN303645-Standards implementiert.

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

Die ChatGPT-Mac-Anwendung von Open AI ist jetzt für alle verfügbar, während sie in den letzten Monaten nur denjenigen mit einem ChatGPT Plus-Abonnement vorbehalten war. Die App lässt sich wie jede andere native Mac-App installieren, sofern Sie über ein aktuelles Apple S verfügen

Zehn Methoden zur KI-Risikoerkennung

Apr 26, 2024 pm 05:25 PM

Zehn Methoden zur KI-Risikoerkennung

Apr 26, 2024 pm 05:25 PM

Über Chatbots oder personalisierte Empfehlungen hinaus gewinnt die leistungsstarke Fähigkeit der KI, Risiken vorherzusagen und zu beseitigen, in Unternehmen immer mehr an Bedeutung. Da sich riesige Datenmengen vermehren und die Vorschriften strenger werden, geraten herkömmliche Risikobewertungstools zunehmend unter Druck. Die Technologie der künstlichen Intelligenz kann die Erfassung großer Datenmengen schnell analysieren und überwachen, wodurch Risikobewertungstools unter Komprimierung verbessert werden können. Durch den Einsatz von Technologien wie maschinellem Lernen und Deep Learning kann KI potenzielle Risiken erkennen, vorhersagen und zeitnah Empfehlungen geben. Vor diesem Hintergrund kann die Nutzung der Risikomanagementfunktionen von KI die Einhaltung sich ändernder Vorschriften sicherstellen und proaktiv auf unvorhergesehene Bedrohungen reagieren. Der Einsatz von KI zur Bewältigung der Komplexität des Risikomanagements mag alarmierend erscheinen, aber für diejenigen, die leidenschaftlich daran interessiert sind, im digitalen Wettlauf an der Spitze zu bleiben