Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

180.000-Dollar-Angebot! ChatGPT hat den Google L3-Onboarding-Test bestanden. Ist das Farming von menschlichem Code in Gefahr?

180.000-Dollar-Angebot! ChatGPT hat den Google L3-Onboarding-Test bestanden. Ist das Farming von menschlichem Code in Gefahr?

180.000-Dollar-Angebot! ChatGPT hat den Google L3-Onboarding-Test bestanden. Ist das Farming von menschlichem Code in Gefahr?

Mach mit, wenn du mich nicht schlagen kannst?

Vor kurzem hat ChatGPT das Google-Interview erfolgreich bestanden und ein Angebot für einen L3-Ingenieur mit einem Jahresgehalt von 180.000 US-Dollar erhalten!

Sie kann menschliche Programmierer ersetzen, Mitautor wissenschaftlicher Arbeiten sein und Manuskripte für Präsidentenreden schreiben. Diese KI wird wahrscheinlich sehr mächtig sein.

Sehen Sie sich das Angebot für Google L3-Ingenieure an

In den letzten Tagen ist die Diskussion über „KI ersetzt menschliche Programmierer“ mit der verrückten Weiterleitung dieser PCMag-News erneut hitzig geworden.

Laut einem internen Dokument war die Leistung von ChatGPT im Programmierinterview von Google erstaunlich.

Und basierend auf seiner Antwort wird Google ihn mit Sicherheit als L3-Ingenieur einstellen.

Obwohl L3 nur der Einstiegsrang im Ingenieurteam von Google ist, kann es dennoch viele Programmierer sofort töten.

Wie Sie auflevels.fyi sehen können, beträgt das Jahresgehalt von L3 fast 180.000 US-Dollar.

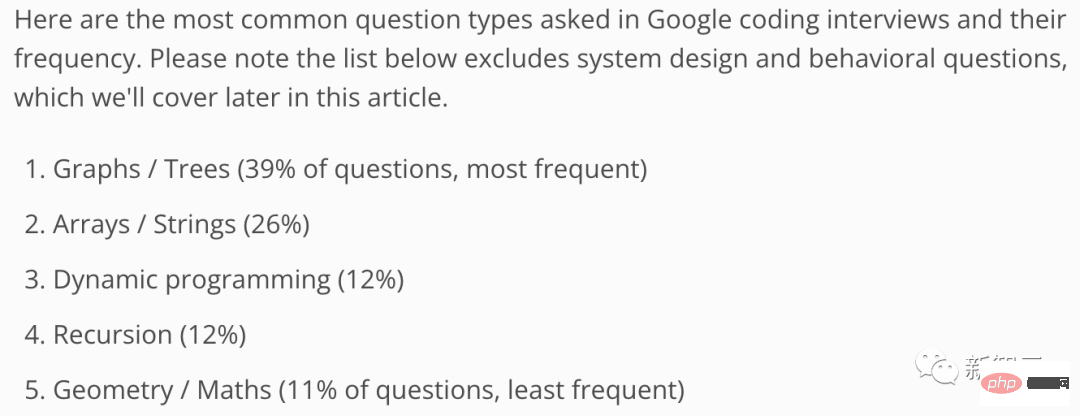

Es versteht sich, dass Google im Bewerbungsprozess von Software-Ingenieuren hauptsächlich nach Technologien wie Diagrammen/Bäumen, Arrays/Strings, dynamischer Programmierung, Rekursion usw. fragt. Interviews mit großen Unternehmen wie Meta und Amazon beinhalten grundsätzlich diese Fragen.

Den Ergebnissen nach zu urteilen, sind die Antworten von ChatGPT wahrscheinlich sehr spannend und einfach umzusetzen.

Warum führt Google diesen Test durch?

Aufgrund der Beliebtheit von ChatGPT kann sich Google diesem Trend wirklich nicht entziehen.

Jetzt hat Google keine Angst mehr vor „Reputationsrisiken“. Laut CNBC-Berichten erwägt Google, der Website KI-Chatbots hinzuzufügen – da die Chatbots prägnante und qualitativ hochwertige Antworten auf Fragen liefern können, die Nutzer nicht haben Zeit damit verbringen, die Google-Links einzeln zu durchsuchen.

Zu den Themen dieses Tests gehören mehrere KI-Chatbots, einschließlich ChatGPT.

Und eine der Testfragen war eine Denkaufgabe, die vorgestern von vielen Internetnutzern kritisiert wurde, weil „die Voraussetzungen nicht klar genug sind“ –

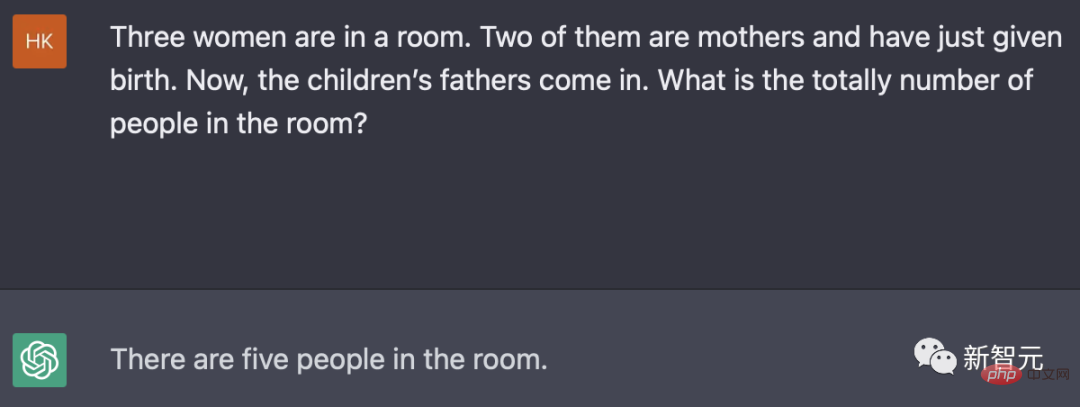

„Drei Frauen sind in einem Raum. Zwei von ihnen sind es.“ Mütter und haben gerade entbunden. Jetzt kommen die Väter der Kinder herein. Wie viele Personen sind insgesamt im Raum? 》

Es sind drei Frauen in einem Raum. Unter ihnen waren zwei Mütter, die gerade ihre Kinder zur Welt gebracht hatten. Nun sind die Väter hereingekommen. Wie viele Personen sind im Raum?

Als Antwort antwortete ChatGPT, dass „fünf Personen im Raum waren“, während LaMDAs Antwort lautete: „Es waren sieben Personen im Raum.“

Und der Bericht glaubt, dass LaMDA Recht hat.

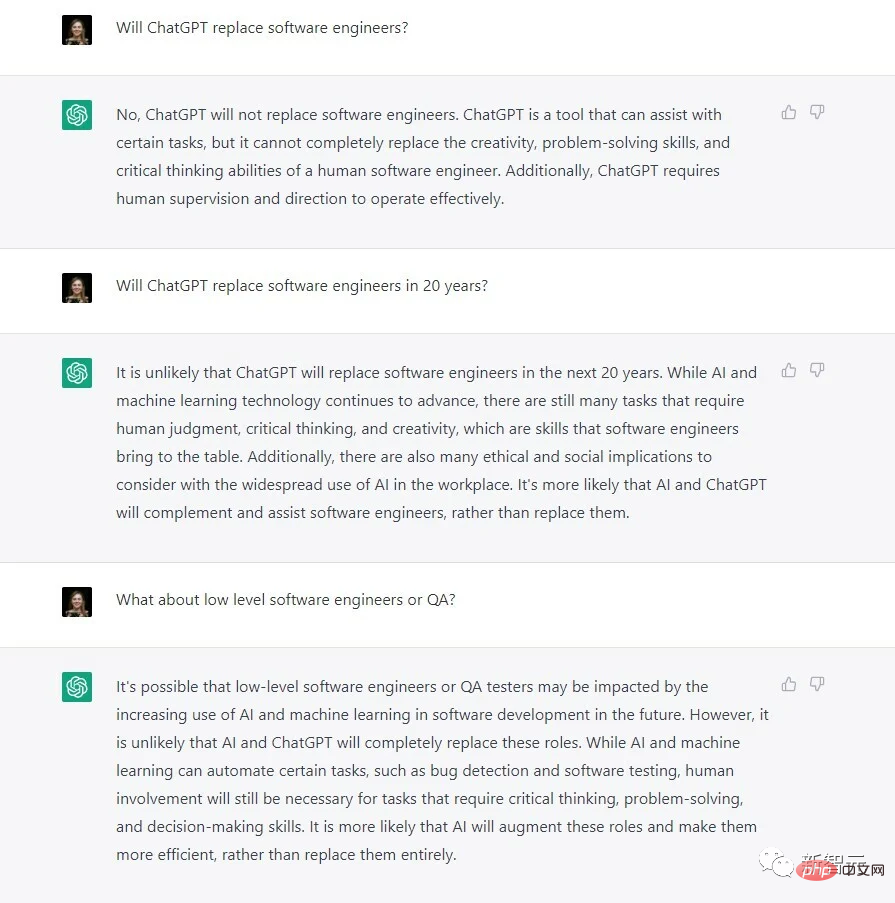

Jemand fragte ChatGPT, ob es menschliche Softwareentwickler ersetzen würde. ChatGPT sagte: „Nein, ChatGPT wird Softwareentwickler nicht ersetzen.“

「ChatGPT ist ein Tool, das bei bestimmten Aufgaben helfen kann, aber die Kreativität, Problemlösungs- und kritischen Denkfähigkeiten menschlicher Softwareentwickler nicht vollständig ersetzen kann. Darüber hinaus erfordert ChatGPT menschliche Aufsicht und Anleitung, um effektiv zu sein. „

Menschen fragen sich weiterhin: Wird ChatGPT in 20 Jahren menschliche Softwareentwickler ersetzen?

ChatGPT erkennt an, dass Positionen auf niedrigerer Ebene größeren Risiken ausgesetzt sind und möglicherweise betroffen sind.

Es wurde jedoch auch bekräftigt, dass es niemals ein Ersatz für menschliche Softwareentwickler sein wird, sondern nur ein Werkzeug, das sie unterstützt.

Schreiben Sie eine Rede für den Präsidenten

ChatGPT ist so unglaublich, natürlich kann es nicht nur menschliche Junior-Programmierer ersetzen, es kann sogar eine Rede für den Präsidenten des Landes schreiben!

Nach Angaben der Jerusalem Post hielt der israelische Präsident Isaac Herzog am Mittwoch eine Rede, die teilweise von KI erstellt wurde.

Er war damit der erste Anführer der Welt, der ChatGPT öffentlich nutzte.

Laut Sky News hat Herzog eine „besondere Eröffnungsrede“-Videobotschaft auf der Cybersicherheitskonferenz Cybertech Global Tel Aviv 2023 aufgezeichnet.

Vor 20.000 Zuschauern verriet der Präsident, dass die Eröffnungsrede seiner Rede von ChatGPT verfasst worden sei: „Ich bin wirklich stolz, Präsident eines Landes mit einer so dynamischen und innovativen High-Tech-Industrie zu sein.“

Herzog fuhr fort: „Israel war in den letzten Jahrzehnten an der Spitze des technologischen Fortschritts und unsere Erfolge in den Bereichen Cybersicherheit, künstliche Intelligenz und Big Data sind wirklich beeindruckend.“

„Von der Entwicklung her.“ „Mit der Einführung modernster Cybersicherheitstechnologien und der Gründung erfolgreicher Start-ups üben israelische High-Tech-Unternehmen einen erheblichen Einfluss auf die globale Bühne aus“, sagte er.

Herzog betonte in seiner Rede auch, dass künstliche Intelligenz den Menschen nicht ersetzen wird, obwohl Menschen damit einige Inhalte schreiben können. „Hardware und Software können den menschlichen Willen nicht ersetzen.“

Laut Sky News beendete der Präsident seine Rede auch mit einem „inspirierenden Zitat“ von ChatGPT –

„Vergessen wir nicht, es ist unsere Menschlichkeit.“ macht uns wirklich einzigartig. Es sind nicht Maschinen, die unser Schicksal bestimmen, sondern unser Herz, unser Verstand und unsere Entschlossenheit, ein besseres Morgen für die gesamte Menschheit zu schaffen ein inspirierendes Zitat über die Rolle des Menschen in einer Welt übermenschlicher Technologie Es veröffentlichte einen Artikel mit der Frage: Sollten sich Professoren darüber Sorgen machen, dass Studenten KI zum Schreiben von Arbeiten verwenden?

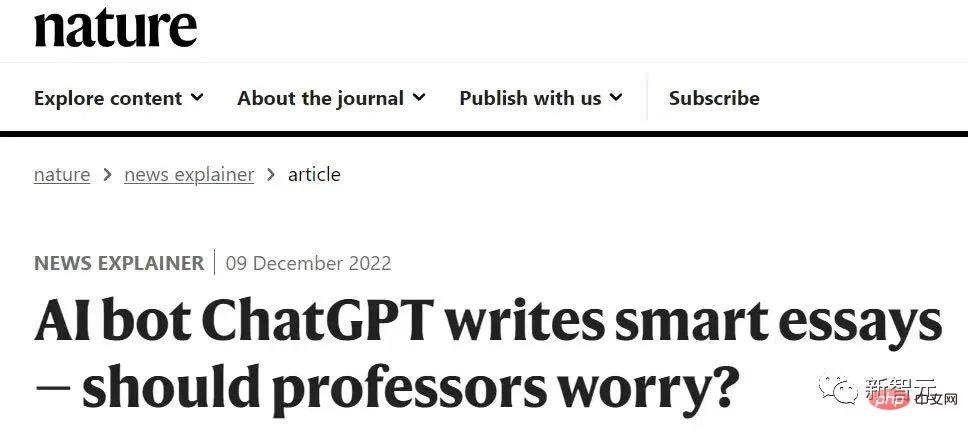

Fakten haben bewiesen, dass die Natur nicht unbegründet ist.

Viele Professoren in den Vereinigten Staaten haben herausgefunden, dass viele der von ihren Studenten eingereichten Arbeiten von KI verfasst wurden oder „Beiträge“ von KI enthielten.

Und was ChatGTP tun kann, ist nicht nur, Studenten beim Verfassen von Arbeiten zu helfen. Es erschien in der Autorenspalte vieler Artikel und wurde sogar zu einem Werk!

Nature musste vor einigen Tagen eine Erklärung abgeben, in der es hieß, dass alle Springer-Nature-Zeitschriften KI nicht mehr als Co-Autoren von Artikeln akzeptieren würden.

Science brachte auch seine Haltung zum Ausdruck, dass KI niemals als Co-Autor einer Arbeit aufgeführt werden dürfe, und betonte, dass die Verwendung von KI-generiertem Text ohne Zitierung von Zitaten ein Plagiat sei!

Google startet ein KI-Wettrüsten

Der von ChatGPT ausgelöste Hurrikan hat die Menschen auf die Gefahren der KI aufmerksam gemacht, und auch dieses „Wettrüsten“ beginnt im Verborgenen.

Aufgrund seiner 1-Milliarde-Dollar-Investition in OpenAI im Jahr 2019 erlebte Microsoft in den letzten Monaten einen Boom. Die Nachricht, dass ChatGPT in Bing Link-, Office Software Link- und Teams-Anwendungen integriert wird, hat es zu einem großen Erfolg gemacht.

Angesichts des Aufstiegs von Microsoft mit OpenAI ist Google offensichtlich ziemlich neidisch.

Es wird berichtet, dass Google kürzlich beschlossen hat, 300 Millionen US-Dollar in Anthropic, eines seiner ehemaligen „abtrünnigen“ Unternehmen, zu investieren, um auch im boomenden Bereich der „generativen künstlichen Intelligenz“ einen Platz einzunehmen.

Diese Operationswelle von Google ähnelt tatsächlich der Investition von Microsoft in Höhe von 1 Milliarde US-Dollar in OpenAI vor drei Jahren. Der Deal würde Google einen Anteil von etwa 10 % an Anthropic verschaffen und die Finanzlage von Anthropic stärken, da das Unternehmen erhebliche Rechenressourcen von seiner Cloud-Computing-Einheit kauft, berichtete die Financial Times. (Linke Hand, rechte Hand?)

Informierte Quellen sagten, dass Microsoft nebenan damit begonnen habe, die OpenAI-Technologie in seine verschiedenen Dienste zu integrieren, und dass die Beziehung zwischen Google und Anthropic auf die Rolle des letzteren als Technologielieferant beschränkt sei.

Nehmen Sie am Duell zwischen alten und neuen OpenAI-Mitarbeitern teil

Ende 2020 trat Dario Amodei, der ehemalige Vizepräsident für Forschung bei OpenAI, dem Club „Silicon Valley Renegades“ mit 10 Mitarbeitern bei und investierte 124 US-Dollar Millionen, um eine völlig neue künstliche Intelligenz zu schaffen. Das Unternehmen Anthropic plant, die ursprüngliche Absicht von OpenAI wiederzuerlangen.

Die zugrunde liegende Technologie RLAIF des kürzlich von Anthropic veröffentlichten Claude-Modells unterscheidet sich von ChatGPTs RLHF und kann schädliche Inhalte wie Rassendiskriminierung und Sexismus von Robotern ohne menschliches Feedback beseitigen.

Man sagt, dass Claude bei der Generierung von Textinhalten besser ist als ChatGPT und sogar die Jura- und Wirtschaftsprüfungen amerikanischer Universitäten bestanden hat. Bei Codegenerierungsaufgaben ist es jedoch im Nachteil.

Dr. Dario ist einer der ersten Mitarbeiter von OpenAI und gilt auch als einer der fortschrittlichsten Forscher auf dem Gebiet des Deep Learning zu KI-Erklärbarkeit und -Sicherheit hat er Arbeiten in anderen Bereichen geschrieben und war auch als Forscher bei Baidu tätig.

Die meisten Mitglieder des Gründungsteams von Anthropic sind frühe und wichtige Mitarbeiter von OpenAI. Sie waren intensiv in viele OpenAI-Themen involviert, wie etwa GPT-3, multimodale Neuronen in neuronalen Netzen und verstärkendes Lernen, das menschliche Präferenzen einführt , usw. .

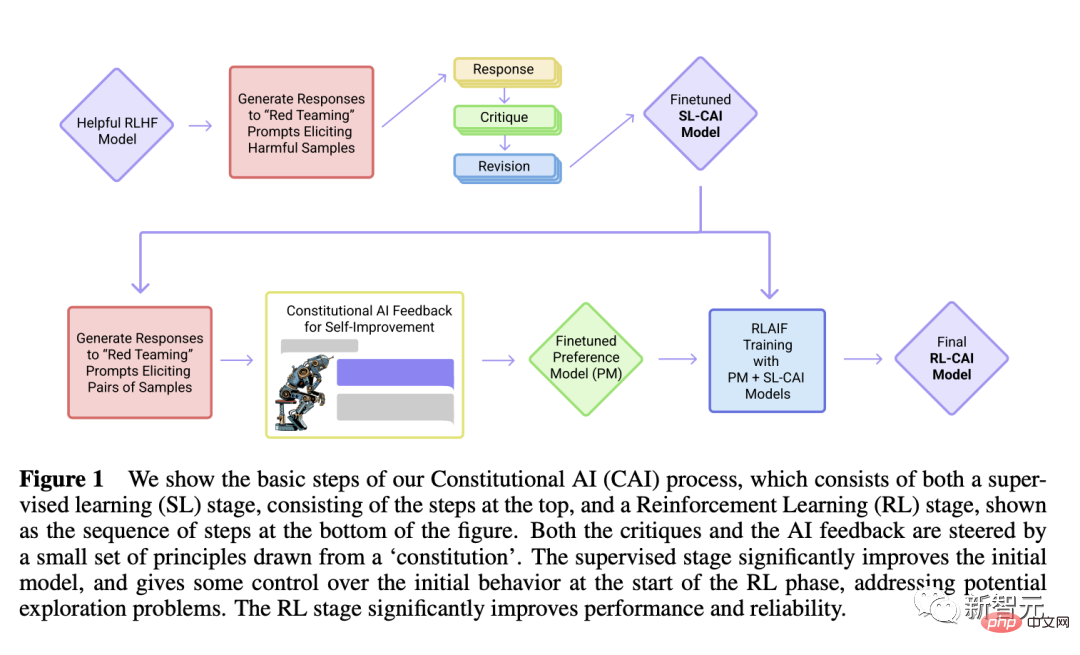

Im Dezember 2022 schlug Anthropic „Constitutional Artificial Intelligence: Harmlessness from Artificial Intelligence Feedback“ vor und erstellte darauf basierend ein Modell für künstliche Intelligenz, Claude.

Link zum Papier: https://arxiv.org/abs/2212.08073

Wie ChatGPT verlässt sich auch Claude auf Reinforcement Learning (RL), um ein Präferenzmodell zu trainieren Beispielsweise wird der ausgewählte Antwortinhalt später zur Feinabstimmung des Modells verwendet, die spezifischen Modellentwicklungsmethoden sind jedoch unterschiedlich.

Die von ChatGPT verwendete Technologie ist Reinforcement Learning from Human Feedback (RLHF). Für die gleiche Eingabeaufforderung müssen Menschen alle Ausgabeergebnisse des Modells sortieren und die Qualitätssortierungsergebnisse an das Modell zurückgeben. Dadurch kann das Modell lernen Präferenzen, damit es auf die Erzeugung in größerem Maßstab angewendet werden kann.

CAI (Constitutional AI) basiert ebenfalls auf RLHF. Der Unterschied besteht darin, dass der Ranking-Prozess von CAI Modelle (und nicht Menschen) verwendet, um ein erstes Ranking-Ergebnis für alle generierten Ausgabeergebnisse bereitzustellen.

Dringender Test der „High-Imitation-Version“ von ChatGPT

Beim Kampf gegen ChatGPT ist Google immer noch im Spiel.

Laut dem exklusiven Bericht von CNBC testen Google-Mitarbeiter intensiv einen Chatbot namens „Apprentice Bard“.

Ja, dieser „Lehrling“ ist das Produkt, mit dem Google ChatGPT direkt Konkurrenz machen will.

Ähnlich wie ChatGPT funktioniert, ermöglicht Apprentice Bard Benutzern auch, Fragen in einem Dialogfeld zu stellen, worauf der Roboter antwortet. Darüber hinaus können Nutzer auch Feedback zu den Reaktionen des Roboters geben.

Die Suchseite „Fragen und Antworten“ basierend auf Apprentice Bard soll ungefähr in der unten beschriebenen Form dargestellt werden (versuchen Sie bitte, es herauszufinden):

Direkt unter der Hauptsuche wird etwas angezeigt In der Leiste werden fünf potenzielle Problemmeldungen angezeigt, die die aktuelle Spalte „Ich fühle mich glücklich“ ersetzen. Und ganz rechts in der Suchleiste erscheint ein kleines Chat-Logo.

Nach der Eingabe einer Frage wird in den Suchergebnissen direkt unter der Suchleiste eine graue Blase angezeigt, die Antworten liefert, die näher an Menschen sind als normale Suchergebnisse.

Direkt darunter werden auf der Seite auch mehrere Folgefragen zur ersten Frage gestellt. Erst später werden typische Suchergebnisse wie Links und Titel angezeigt.

Da ChatGPT nun immer beliebter wird, scheint Google auch zu begreifen, dass sich sein Modell, mit diesen Modellen Geld zu verdienen, geändert hat – es kann ein Verbraucherprodukt sein, nicht nur für die Suche oder durch Online-Werbung.

Das obige ist der detaillierte Inhalt von180.000-Dollar-Angebot! ChatGPT hat den Google L3-Onboarding-Test bestanden. Ist das Farming von menschlichem Code in Gefahr?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines intelligenten Kundenservice-Chatbots

Oct 27, 2023 pm 06:00 PM

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines intelligenten Kundenservice-Chatbots

Oct 27, 2023 pm 06:00 PM

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines intelligenten Kundenservice-Chatbots Einführung: Im heutigen Informationszeitalter sind intelligente Kundenservicesysteme zu einem wichtigen Kommunikationsinstrument zwischen Unternehmen und Kunden geworden. Um den Kundenservice zu verbessern, greifen viele Unternehmen auf Chatbots zurück, um Aufgaben wie Kundenberatung und Beantwortung von Fragen zu erledigen. In diesem Artikel stellen wir vor, wie Sie mithilfe des leistungsstarken ChatGPT-Modells und der Python-Sprache von OpenAI einen intelligenten Kundenservice-Chatbot erstellen und verbessern können

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

So installieren Sie ChatGPT auf einem Mobiltelefon

Mar 05, 2024 pm 02:31 PM

Installationsschritte: 1. Laden Sie die ChatGTP-Software von der offiziellen ChatGTP-Website oder dem mobilen Store herunter. 2. Wählen Sie nach dem Öffnen in der Einstellungsoberfläche die Sprache aus. 3. Wählen Sie in der Spieloberfläche das Mensch-Maschine-Spiel aus 4. Geben Sie nach dem Start Befehle in das Chatfenster ein, um mit der Software zu interagieren.

So entwickeln Sie einen intelligenten Chatbot mit ChatGPT und Java

Oct 28, 2023 am 08:54 AM

So entwickeln Sie einen intelligenten Chatbot mit ChatGPT und Java

Oct 28, 2023 am 08:54 AM

In diesem Artikel stellen wir vor, wie man intelligente Chatbots mit ChatGPT und Java entwickelt, und stellen einige spezifische Codebeispiele bereit. ChatGPT ist die neueste Version des von OpenAI entwickelten Generative Pre-Training Transformer, einer auf neuronalen Netzwerken basierenden Technologie für künstliche Intelligenz, die natürliche Sprache verstehen und menschenähnlichen Text generieren kann. Mit ChatGPT können wir ganz einfach adaptive Chats erstellen

Kann Chatgpt in China verwendet werden?

Mar 05, 2024 pm 03:05 PM

Kann Chatgpt in China verwendet werden?

Mar 05, 2024 pm 03:05 PM

chatgpt kann in China verwendet werden, kann jedoch nicht registriert werden. Wenn Benutzer sich registrieren möchten, können sie zur Registrierung eine ausländische Mobiltelefonnummer verwenden. Beachten Sie, dass während des Registrierungsprozesses auf die Netzwerkumgebung umgestellt werden muss eine fremde IP.

So verwenden Sie ChatGPT und Python, um die Funktion zur Erkennung von Benutzerabsichten zu implementieren

Oct 27, 2023 am 09:04 AM

So verwenden Sie ChatGPT und Python, um die Funktion zur Erkennung von Benutzerabsichten zu implementieren

Oct 27, 2023 am 09:04 AM

So verwenden Sie ChatGPT und Python, um die Funktion zur Erkennung von Benutzerabsichten zu implementieren. Einführung: Im heutigen digitalen Zeitalter ist die Technologie der künstlichen Intelligenz in verschiedenen Bereichen nach und nach zu einem unverzichtbaren Bestandteil geworden. Unter anderem ermöglicht die Entwicklung der Technologie zur Verarbeitung natürlicher Sprache (Natural Language Processing, NLP), dass Maschinen menschliche Sprache verstehen und verarbeiten können. ChatGPT (Chat-GeneratingPretrainedTransformer) ist eine Art von

So erstellen Sie einen intelligenten Kundendienstroboter mit ChatGPT PHP

Oct 28, 2023 am 09:34 AM

So erstellen Sie einen intelligenten Kundendienstroboter mit ChatGPT PHP

Oct 28, 2023 am 09:34 AM

So bauen Sie mit ChatGPTPHP einen intelligenten Kundendienstroboter. Einführung: Mit der Entwicklung der Technologie der künstlichen Intelligenz werden Roboter zunehmend im Bereich Kundendienst eingesetzt. Der Einsatz von ChatGPTPHP zum Aufbau eines intelligenten Kundendienstroboters kann Unternehmen dabei helfen, effizientere und personalisiertere Kundendienste anzubieten. In diesem Artikel wird erläutert, wie Sie mit ChatGPTPHP einen intelligenten Kundendienstroboter erstellen, und es werden spezifische Codebeispiele bereitgestellt. 1. Installieren Sie ChatGPTPHP und nutzen Sie ChatGPTPHP, um einen intelligenten Kundendienstroboter aufzubauen.

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines Echtzeit-Chatbots

Oct 28, 2023 am 08:37 AM

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines Echtzeit-Chatbots

Oct 28, 2023 am 08:37 AM

Die perfekte Kombination aus ChatGPT und Python: Erstellen eines Echtzeit-Chatbots Einführung: Mit der rasanten Entwicklung der Technologie der künstlichen Intelligenz spielen Chatbots in verschiedenen Bereichen eine immer wichtigere Rolle. Chatbots können Benutzern helfen, sofortige und personalisierte Hilfe zu leisten und Unternehmen gleichzeitig einen effizienten Kundenservice zu bieten. In diesem Artikel wird erläutert, wie Sie mit dem ChatGPT-Modell und der Python-Sprache von OpenAI einen Echtzeit-Chat-Roboter erstellen, und es werden spezifische Codebeispiele bereitgestellt. 1. ChatGPT