Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Winziges maschinelles Lernen verspricht, Deep Learning in Mikroprozessoren zu integrieren

Winziges maschinelles Lernen verspricht, Deep Learning in Mikroprozessoren zu integrieren

Winziges maschinelles Lernen verspricht, Deep Learning in Mikroprozessoren zu integrieren

Übersetzer |. Zhu Xianzhong

Rezensent |. Liang Ce Sun Shujuan

Der anfängliche Erfolg von Deep-Learning-Modellen wurde großen Servern mit großen Speichermengen und GPU-Clustern zugeschrieben. Das Versprechen von Deep Learning hat eine Branche hervorgebracht, die Cloud-Computing-Dienste für tiefe neuronale Netze bereitstellt. Infolgedessen erfreuen sich große neuronale Netze, die auf nahezu unbegrenzten Cloud-Ressourcen laufen, großer Beliebtheit, insbesondere bei Technologieunternehmen mit großen Budgets.

Aber gleichzeitig zeichnete sich in den letzten Jahren auch ein weiterer gegenläufiger Trend ab, nämlich die Erstellung von Machine-Learning-Modellen für Edge-Geräte. Diese als Tiny Machine Learning (TinyML) bekannten Modelle funktionieren auf Geräten mit begrenztem Speicher und begrenzter Rechenleistung sowie nicht vorhandener oder eingeschränkter Internetverbindung.

Eine aktuelle Forschungsarbeit, die gemeinsam von IBM und dem Massachusetts Institute of Technology (MIT) durchgeführt wurde, löst das Problem des Spitzenspeicherengpasses von Convolutional Neural Networks (CNN). Hierbei handelt es sich um eine Deep-Learning-Architektur, die besonders für Computer-Vision-Anwendungen wichtig ist. Ein Modell namens McUnETV2, das in der Lage ist, Convolutional Neural Networks (CNN) auf Mikrocontrollern mit geringem Speicher und geringem Stromverbrauch auszuführen, wird in einem auf der NeurIPS 2021-Konferenz vorgestellten Papier detailliert beschrieben.

1. Warum TinyML (TinyML)?

Obwohl Cloud Deep Learning sehr erfolgreich ist, ist es nicht für alle Situationen geeignet. Tatsächlich erfordern viele Anwendungen häufig, dass Inferenzaufgaben direkt auf dem Hardwaregerät ausgeführt werden. Beispielsweise ist in manchen Einsatzumgebungen wie der Drohnenrettung die Internetverbindung nicht garantiert. Auch in anderen Bereichen wie dem Gesundheitswesen erschweren Datenschutzanforderungen und behördliche Auflagen das Senden von Daten zur Verarbeitung in die Cloud. Für Anwendungen, die Echtzeit-Inferenz in Maschinensprache erfordern, ist die durch Round-Trip-Cloud-Computing verursachte Latenz noch unerschwinglicher.

Alle oben genannten Bedingungen müssen erfüllt sein, um Geräte für maschinelles Lernen wissenschaftlich und kommerziell attraktiv zu machen. Beispielsweise verfügen iPhone-Telefone mittlerweile über viele Anwendungen, die Gesichtserkennung und Spracherkennung ausführen, und Android-Telefone können auch Übersetzungssoftware direkt ausführen. Darüber hinaus kann die Apple Watch bereits maschinelle Lernalgorithmen verwenden, um Bewegungen und EKG-Muster zu erkennen (Hinweis: EKG ist die Abkürzung für Elektrokardiogramm, auch bekannt als EKG). Es handelt sich um ein Testexperiment, mit dem die Zeitknoten der auslösenden elektrischen Signalsequenz aufgezeichnet werden Durch die Analyse von EKG-Bildern können Ärzte besser diagnostizieren, ob die Herzfrequenz normal ist und ob Probleme mit der Herzfunktion vorliegen.

Die oben genannten ML-Modelle auf diesen Geräten werden teilweise durch technologische Fortschritte ermöglicht, die eine kompaktere und rechen- und speichereffizientere neuronale Netze unterstützen. Gleichzeitig ist aufgrund der Fortschritte in der Hardwaretechnologie die Implementierung solcher ML-Modelle auch im mobilen Umfeld möglich geworden. Unsere Smartphones und Wearables verfügen heute über mehr Rechenleistung als die Hochleistungsserver von vor 30 Jahren und einige verfügen sogar über spezielle Coprozessoren für maschinelle Sprachinferenz.

TinyML bringt Edge-KI noch einen Schritt weiter und ermöglicht die Ausführung von Deep-Learning-Modellen auf Mikrocontrollern (MCUs), auch wenn Mikrocontroller ressourcenbeschränkter sind als die kleinen Computer, die wir in unseren Taschen und am Handgelenk tragen.

Mikrocontroller hingegen sind preiswert und werden im Durchschnitt für weniger als 0,50 US-Dollar verkauft. Sie sind fast überall zu finden und können in alles eingebaut werden, von der Verbraucherindustrie bis hin zu Industrieanlagen. Gleichzeitig verfügen sie nicht über die Ressourcen, die in Allzweck-Computergeräten zu finden sind, und die meisten verfügen nicht über Betriebssysteme. Die CPU des Mikrocontrollers ist klein, verfügt nur über ein paar hundert Kilobyte Low-Power-Speicher (SRAM) und ein paar Megabyte Speicher und verfügt über keine Netzwerkausrüstung. Die meisten von ihnen verfügen über keinen Stromanschluss und waren viele Jahre lang auf Knopfbatterien angewiesen. Daher könnte die Installation von Deep-Learning-Modellen auf MCUs neue Möglichkeiten für viele Anwendungen eröffnen.

2. Speicherengpass in Faltungs-Neuronalen Netzen

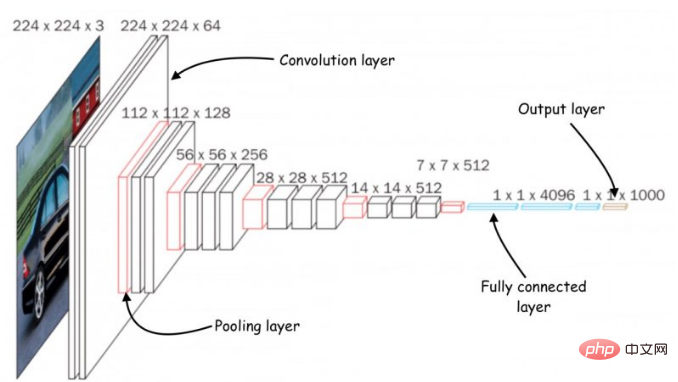

Architektur von Faltungs-Neuronalen Netzen (CNN)

Es wurden mehrere Anstrengungen unternommen, um tiefe neuronale Netze auf eine Größe zu reduzieren, die für Rechengeräte mit kleinem Speicher geeignet ist. Die meisten dieser Bemühungen konzentrieren sich jedoch auf die Reduzierung der Parameteranzahl in Deep-Learning-Modellen. „Pruning“ ist beispielsweise ein beliebter Optimierungsalgorithmus, der neuronale Netze verkleinert, indem unwichtige Parameter aus der Modellausgabe entfernt werden.

Das Problem bei Pruning-Methoden besteht darin, dass sie den Speicherengpass neuronaler Netze nicht lösen können. Standardimplementierungen von Deep-Learning-Bibliotheken erfordern, dass die gesamte Netzwerkschicht- und Aktivierungsschichtzuordnung in den Speicher geladen wird. Leider bewirken klassische Optimierungsmethoden keine wesentlichen Änderungen an den frühen Rechenschichten neuronaler Netze, insbesondere bei Faltungs-Neuronalen Netzen.

Dies führt zu einem Ungleichgewicht in der Größe der verschiedenen Schichten des Netzwerks und führt zum Problem der „Speicherspitze“: Selbst wenn das Netzwerk nach der Bereinigung schlanker wird, muss das Gerät, auf dem es ausgeführt wird, über denselben Speicher wie die größte Schicht verfügen. Beispielsweise erreicht die Berechnung der frühen Schichten im beliebten TinyML-Modell MobileNetV2 eine Speicherspitze von etwa 1,4 Megabyte, während spätere Schichten einen sehr geringen Speicherbedarf haben. Zum Ausführen des Modells benötigt das Gerät so viel Speicher wie das Modell seinen Spitzenwert erreicht. Da die meisten MCUs nur über ein paar hundert KB Speicher verfügen, können sie keine Standardversionen von MobileNetV2 ausführen.

MobileNetV2 ist ein für Edge-Geräte optimiertes neuronales Netzwerk, dessen Spitzenspeicher jedoch etwa 1,4 Megabyte beträgt, was es für viele Mikrocontroller unzugänglich macht.

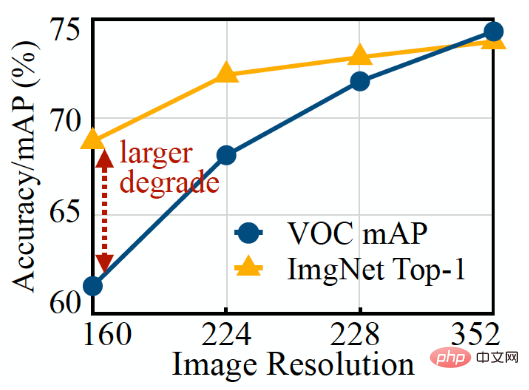

Eine weitere Möglichkeit, ein neuronales Netzwerk zu optimieren, besteht darin, die Eingabegröße des Modells zu reduzieren. Kleinere Eingabebilder erfordern kleinere CNNs, um Vorhersageaufgaben auszuführen. Allerdings stellt die Reduzierung der Eingabegröße ihre eigenen Herausforderungen dar und ist nicht für alle Computer-Vision-Aufgaben effektiv. Deep-Learning-Modelle zur Objekterkennung reagieren beispielsweise sehr empfindlich auf die Bildgröße und ihre Leistung lässt schnell nach, wenn die Eingabeauflösung abnimmt.

Aus der obigen Abbildung ist leicht zu erkennen, dass das Bildklassifizierungs-ML-Modell (orange Linie) die Auflösung leichter reduzieren kann als das Zielerkennungsmodell (blaue Linie).

3. MCUNetV2-Patch-basierte Inferenz

Um das Speicherengpassproblem von Faltungs-Neuronalen Netzen zu lösen, haben Forscher eine Deep-Learning-Architektur namens MCUNetV2 entwickelt, die ihre Speicherbandbreite an die Grenze des Mikrocontrollers anpassen kann. MCUNetV2 wurde auf der Grundlage früherer Ergebnisse derselben wissenschaftlichen Forschungsgruppe entwickelt, die angenommen und erfolgreich bei der NeurIPS 2020-Konferenz eingereicht wurden.

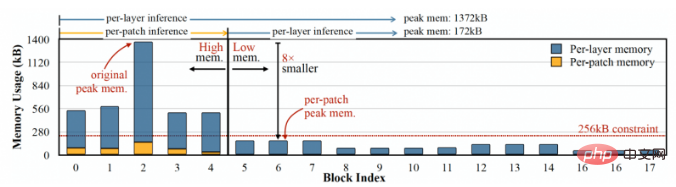

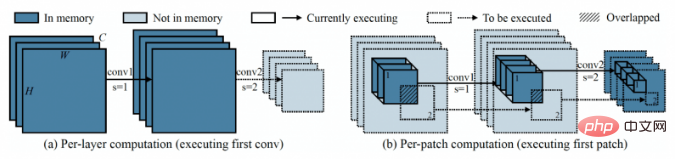

Die Hauptidee hinter MCUNetV2 ist „Patch-basierte Inferenz“, eine Technik, die den Speicherbedarf eines CNN reduziert, ohne seine Genauigkeit zu beeinträchtigen. Anstatt eine gesamte neuronale Netzwerkschicht in den Speicher zu laden, lädt und berechnet MCUNetV2 zu jedem Zeitpunkt kleinere Regionen oder „Patches“ der Schicht. Anschließend durchläuft es die Schicht Block für Block und kombiniert diese Werte, bis der Aktivierungsanteil der gesamten Schicht berechnet wird.

Die linke Seite der Abbildung zeigt das klassische Deep-Learning-System, das eine ganze Schicht berechnet, während die rechte Seite zeigt, wie MCUNetV2 jeweils einen Patch berechnet, wodurch der Speicherbedarf für die DL-Inferenz reduziert wird.

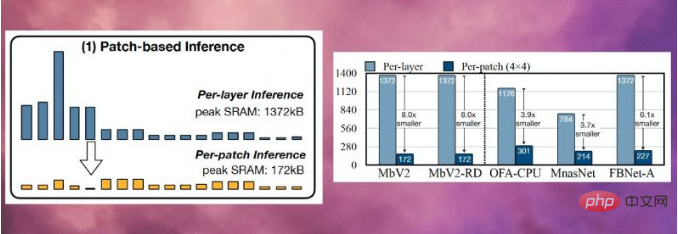

Da MCUNetV2 jeweils nur ein Neuron speichern muss, werden Speicherspitzen erheblich reduziert, ohne die Modellauflösung oder Parameter zu verringern. Experimente der Forscher zeigen, dass MCUNetV2 den Spitzenspeicher auf ein Achtel reduzieren kann.

MCUNetV2 kann die Speicherspitze von Deep-Learning-Modellen auf ein Achtel reduzieren.

Patch-basierte Inferenz führt auch zu einem Kompromiss beim Rechenaufwand und spart gleichzeitig Speicher. Forscher am Massachusetts Institute of Technology (MIT) und IBM haben herausgefunden, dass die gesamte Netzwerkberechnung in verschiedenen Architekturen um 10–17 % zunehmen kann, was offensichtlich nicht auf Mikrocontroller mit geringem Stromverbrauch zutrifft.

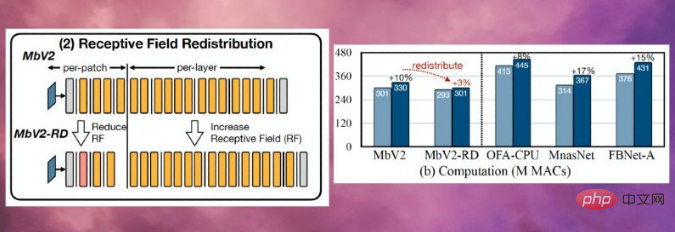

Um diese Einschränkung zu überwinden, verteilten die Forscher die „Empfangsfelder“ verschiedener Blöcke des neuronalen Netzwerks neu (Hinweis: In CNN entspricht ein Pixel in der Feature-Map der n-ten Ebene der Anzahl der Pixel im Eingabebild der ersten Schicht, d. h. Dies ist das Empfangsfeld dieser Schicht (als „RF“ bezeichnet). Bei CNN ist das Empfangsfeld der Bildbereich, der jederzeit verarbeitet werden kann. Größere Empfangsfelder erfordern größere Patches und Überlappungen zwischen den Patches. Dies führt natürlich zu einem höheren Rechenaufwand. Durch die Verkleinerung des Empfangsfelds in den ersten Blöcken des Netzwerks und die Erweiterung des Empfangsfelds in späteren Phasen konnten die Forscher den Rechenaufwand um mehr als zwei Drittel reduzieren.

Die Neuverteilung rezeptiver Felder trägt dazu bei, den Rechenaufwand von MCUNetV2 um mehr als zwei Drittel zu reduzieren.

Abschließend stellten die Forscher fest, dass die Optimierung von MCUNetV2 weitgehend von der ML-Modellarchitektur, der Anwendung sowie dem Arbeitsspeicher und der Speicherkapazität abhängt des Zielgeräts. Um die manuelle Abstimmung von Deep-Learning-Modellen für jedes Gerät und jede Anwendung zu vermeiden, verwendeten die Forscher die „Suche nach neuronalen Algorithmen“, einen Prozess, der maschinelles Lernen nutzt, um die Struktur neuronaler Netzwerke und die Inferenzplanung automatisch zu optimieren.

Die Forscher testeten Deep-Learning-Architekturen in verschiedenen Anwendungen auf mehreren Mikrocontroller-Modellen mit kleineren Speicherkapazitäten. Die Ergebnisse zeigen, dass MCUNetV2 andere TinyML-Technologien übertrifft und in der Lage ist, eine höhere Genauigkeit bei der Bildklassifizierung und Objekterkennung bei geringerem Speicherbedarf und geringerer Latenz zu erreichen.

Wie in der Abbildung unten gezeigt, verwenden Forscher MCUNetV2 mit Echtzeit-Personenerkennung, visuellen Weckwörtern und Gesichts-/Maskenerkennung.

Anmerkung des Übersetzers: Was hier gezeigt wird, ist nur ein Screenshot des Videos mit MCUNetV2, das auf der Website youtube.com angezeigt wird.

4. TinyML-Anwendungen

In einem Artikel aus dem Jahr 2018 mit dem Titel „Why the Future of Machine Learning is Tiny“ glaubt Softwareentwickler Pete Warden, dass maschinelles Lernen auf MCU äußerst wichtig ist. „Ich glaube, dass maschinelles Lernen auf kleinen Chips mit geringem Stromverbrauch ausgeführt werden kann, und diese Kombination wird eine Vielzahl von Problemen lösen, die wir derzeit nicht lösen können“, schrieb Worden.

Dank der Fortschritte bei Sensoren erhalten wir Daten aus der ganzen Welt und CPU-Fähigkeiten werden erheblich verbessert. Unsere Fähigkeit, diese Daten durch Modelle des maschinellen Lernens zu verarbeiten und zu nutzen, ist jedoch durch die Netzwerkkonnektivität und den Zugriff auf Cloud-Server eingeschränkt. Wie Worden sagte, sind Prozessoren und Sensoren energieeffizienter als Funksender wie Bluetooth und WLAN.

Worden schrieb: „Der physikalische Prozess des Verschiebens von Daten scheint viel Energie zu erfordern. Es scheint eine Regel zu sein, dass die für einen Vorgang erforderliche Energie proportional zur Distanz zum Senden der Bits ist. Die CPU und der Sensor benötigen zum Senden nur.“ Die Übertragung der Anzahl der Bits erfordert nur ein paar Millimeter und ist kostengünstig, während die Funkübertragung mehrere Meter oder mehr erfordert, um ein paar Datenbits zu senden, und das ist teuer ... Es ist klar, dass es ein riesiges potenzielles Marktpotenzial gibt, das darauf wartet, erschlossen zu werden Wir brauchen eine Technologie, die auf billigen Mikrocontrollern funktioniert, sehr wenig Energie verbraucht, auf Berechnungen statt auf Funk basiert und alle unsere verschwendeten Sensordaten in nützliche Daten umwandeln kann „Deep Learning“ wird die Lücke füllen. Wir können damit rechnen, dass TinyML in den kommenden Jahren seinen Weg in Milliarden von Mikrocontrollern in Haushalten, Büros, Krankenhäusern, Fabriken, Bauernhöfen, Straßen, Brücken und mehr findet und möglicherweise Anwendungen ermöglicht, die vorher einfach nicht möglich waren.

Originallink: https://thenextweb.com/news/tinyml-deep-learning-microcontrollers-syndication

Einführung des Übersetzers

Zhu Xianzhong, 51CTO-Community-Redakteur, 51CTO-Expertenblogger, Dozent, Computerlehrer an einer Universität in Weifang , Ein Veteran in der Welt der freiberuflichen Programmierung. In den Anfängen konzentrierte er sich auf verschiedene Microsoft-Technologien (stellte drei technische Bücher zu ASP.NET AJX und Cocos 2d-X zusammen). In den letzten zehn Jahren widmete er sich der Open-Source-Welt (vertraut mit beliebten Vollversionen). Stack-Webentwicklungstechnologie) und lernte OneNet/AliOS+Arduino/ESP32/Raspberry Pi und andere IoT-Entwicklungstechnologien sowie Scala+Hadoop+Spark+Flink und andere Big-Data-Entwicklungstechnologien kennen.

Das obige ist der detaillierte Inhalt vonWinziges maschinelles Lernen verspricht, Deep Learning in Mikroprozessoren zu integrieren. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1377

1377

52

52

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In den Bereichen maschinelles Lernen und Datenwissenschaft stand die Interpretierbarkeit von Modellen schon immer im Fokus von Forschern und Praktikern. Mit der weit verbreiteten Anwendung komplexer Modelle wie Deep Learning und Ensemble-Methoden ist das Verständnis des Entscheidungsprozesses des Modells besonders wichtig geworden. Explainable AI|XAI trägt dazu bei, Vertrauen in maschinelle Lernmodelle aufzubauen, indem es die Transparenz des Modells erhöht. Eine Verbesserung der Modelltransparenz kann durch Methoden wie den weit verbreiteten Einsatz mehrerer komplexer Modelle sowie der Entscheidungsprozesse zur Erläuterung der Modelle erreicht werden. Zu diesen Methoden gehören die Analyse der Merkmalsbedeutung, die Schätzung des Modellvorhersageintervalls, lokale Interpretierbarkeitsalgorithmen usw. Die Merkmalswichtigkeitsanalyse kann den Entscheidungsprozess des Modells erklären, indem sie den Grad des Einflusses des Modells auf die Eingabemerkmale bewertet. Schätzung des Modellvorhersageintervalls

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Heute diskutieren wir darüber, wie Deep-Learning-Technologie die Leistung von visionbasiertem SLAM (Simultaneous Localization and Mapping) in komplexen Umgebungen verbessern kann. Durch die Kombination von Methoden zur Tiefenmerkmalsextraktion und Tiefenanpassung stellen wir hier ein vielseitiges hybrides visuelles SLAM-System vor, das die Anpassung in anspruchsvollen Szenarien wie schlechten Lichtverhältnissen, dynamischer Beleuchtung, schwach strukturierten Bereichen und starkem Jitter verbessern soll. Unser System unterstützt mehrere Modi, einschließlich erweiterter Monokular-, Stereo-, Monokular-Trägheits- und Stereo-Trägheitskonfigurationen. Darüber hinaus wird analysiert, wie visuelles SLAM mit Deep-Learning-Methoden kombiniert werden kann, um andere Forschungen zu inspirieren. Durch umfangreiche Experimente mit öffentlichen Datensätzen und selbst abgetasteten Daten demonstrieren wir die Überlegenheit von SL-SLAM in Bezug auf Positionierungsgenauigkeit und Tracking-Robustheit.

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

In diesem Artikel wird vorgestellt, wie Überanpassung und Unteranpassung in Modellen für maschinelles Lernen mithilfe von Lernkurven effektiv identifiziert werden können. Unteranpassung und Überanpassung 1. Überanpassung Wenn ein Modell mit den Daten übertrainiert ist, sodass es daraus Rauschen lernt, spricht man von einer Überanpassung des Modells. Ein überangepasstes Modell lernt jedes Beispiel so perfekt, dass es ein unsichtbares/neues Beispiel falsch klassifiziert. Für ein überangepasstes Modell erhalten wir einen perfekten/nahezu perfekten Trainingssatzwert und einen schrecklichen Validierungssatz-/Testwert. Leicht geändert: „Ursache der Überanpassung: Verwenden Sie ein komplexes Modell, um ein einfaches Problem zu lösen und Rauschen aus den Daten zu extrahieren. Weil ein kleiner Datensatz als Trainingssatz möglicherweise nicht die korrekte Darstellung aller Daten darstellt. 2. Unteranpassung Heru.“

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

In den 1950er Jahren wurde die künstliche Intelligenz (KI) geboren. Damals entdeckten Forscher, dass Maschinen menschenähnliche Aufgaben wie das Denken ausführen können. Später, in den 1960er Jahren, finanzierte das US-Verteidigungsministerium künstliche Intelligenz und richtete Labore für die weitere Entwicklung ein. Forscher finden Anwendungen für künstliche Intelligenz in vielen Bereichen, etwa bei der Erforschung des Weltraums und beim Überleben in extremen Umgebungen. Unter Weltraumforschung versteht man die Erforschung des Universums, das das gesamte Universum außerhalb der Erde umfasst. Der Weltraum wird als extreme Umgebung eingestuft, da sich seine Bedingungen von denen auf der Erde unterscheiden. Um im Weltraum zu überleben, müssen viele Faktoren berücksichtigt und Vorkehrungen getroffen werden. Wissenschaftler und Forscher glauben, dass die Erforschung des Weltraums und das Verständnis des aktuellen Zustands aller Dinge dazu beitragen können, die Funktionsweise des Universums zu verstehen und sich auf mögliche Umweltkrisen vorzubereiten

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Zu den häufigsten Herausforderungen, mit denen Algorithmen für maschinelles Lernen in C++ konfrontiert sind, gehören Speicherverwaltung, Multithreading, Leistungsoptimierung und Wartbarkeit. Zu den Lösungen gehören die Verwendung intelligenter Zeiger, moderner Threading-Bibliotheken, SIMD-Anweisungen und Bibliotheken von Drittanbietern sowie die Einhaltung von Codierungsstilrichtlinien und die Verwendung von Automatisierungstools. Praktische Fälle zeigen, wie man die Eigen-Bibliothek nutzt, um lineare Regressionsalgorithmen zu implementieren, den Speicher effektiv zu verwalten und leistungsstarke Matrixoperationen zu nutzen.

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Übersetzer |. Rezensiert von Li Rui |. Chonglou Modelle für künstliche Intelligenz (KI) und maschinelles Lernen (ML) werden heutzutage immer komplexer, und die von diesen Modellen erzeugten Ergebnisse sind eine Blackbox, die den Stakeholdern nicht erklärt werden kann. Explainable AI (XAI) zielt darauf ab, dieses Problem zu lösen, indem es Stakeholdern ermöglicht, die Funktionsweise dieser Modelle zu verstehen, sicherzustellen, dass sie verstehen, wie diese Modelle tatsächlich Entscheidungen treffen, und Transparenz in KI-Systemen, Vertrauen und Verantwortlichkeit zur Lösung dieses Problems gewährleistet. In diesem Artikel werden verschiedene Techniken der erklärbaren künstlichen Intelligenz (XAI) untersucht, um ihre zugrunde liegenden Prinzipien zu veranschaulichen. Mehrere Gründe, warum erklärbare KI von entscheidender Bedeutung ist. Vertrauen und Transparenz: Damit KI-Systeme allgemein akzeptiert und vertrauenswürdig sind, müssen Benutzer verstehen, wie Entscheidungen getroffen werden

Ist Flash Attention stabil? Meta und Harvard stellten fest, dass die Gewichtsabweichungen ihrer Modelle um Größenordnungen schwankten

May 30, 2024 pm 01:24 PM

Ist Flash Attention stabil? Meta und Harvard stellten fest, dass die Gewichtsabweichungen ihrer Modelle um Größenordnungen schwankten

May 30, 2024 pm 01:24 PM

MetaFAIR hat sich mit Harvard zusammengetan, um einen neuen Forschungsrahmen zur Optimierung der Datenverzerrung bereitzustellen, die bei der Durchführung groß angelegten maschinellen Lernens entsteht. Es ist bekannt, dass das Training großer Sprachmodelle oft Monate dauert und Hunderte oder sogar Tausende von GPUs verwendet. Am Beispiel des Modells LLaMA270B erfordert das Training insgesamt 1.720.320 GPU-Stunden. Das Training großer Modelle stellt aufgrund des Umfangs und der Komplexität dieser Arbeitsbelastungen einzigartige systemische Herausforderungen dar. In letzter Zeit haben viele Institutionen über Instabilität im Trainingsprozess beim Training generativer SOTA-KI-Modelle berichtet. Diese treten normalerweise in Form von Verlustspitzen auf. Beim PaLM-Modell von Google kam es beispielsweise während des Trainingsprozesses zu Instabilitäten. Numerische Voreingenommenheit ist die Hauptursache für diese Trainingsungenauigkeit.

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist