Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Deep-Learning-Bildsegmentierung: Ein Überblick über das Netzwerkstrukturdesign

Deep-Learning-Bildsegmentierung: Ein Überblick über das Netzwerkstrukturdesign

Deep-Learning-Bildsegmentierung: Ein Überblick über das Netzwerkstrukturdesign

Dieser Artikel fasst die Innovationen in der Netzwerkstruktur bei der Verwendung von CNNs für die semantische Bildsegmentierung zusammen. Diese Innovationen umfassen hauptsächlich das Design neuer neuronaler Architekturen (unterschiedliche Tiefen, Breiten, Verbindungen und Topologien) und das Design neuer Komponenten oder Schichten. Ersteres nutzt vorhandene Komponenten, um komplexe groß angelegte Netzwerke aufzubauen, während letzteres lieber zugrunde liegende Komponenten entwirft. Zunächst stellen wir einige klassische semantische Segmentierungsnetzwerke und ihre Innovationen vor und stellen dann einige Anwendungen des Netzwerkstrukturdesigns im Bereich der medizinischen Bildsegmentierung vor.

1. Bildsemantische Netzwerkstrukturinnovation

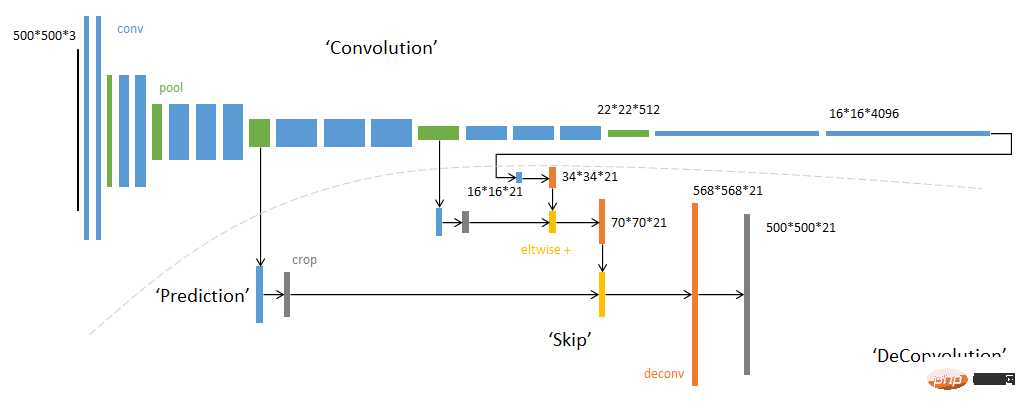

1.1 FCN-Netzwerk

FCN-Gesamtarchitektur

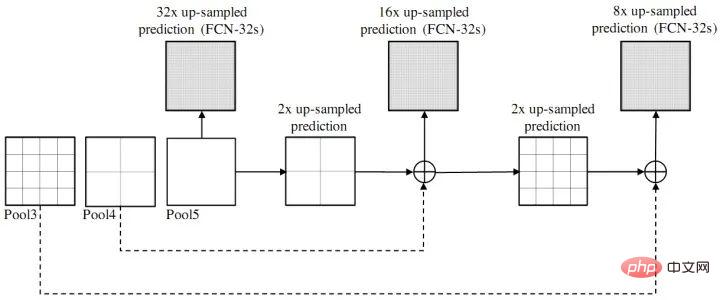

Vereinfachtes DiagrammDas FCN-Netzwerk wird separat aufgeführt, da das FCN-Netzwerk das erste ist Ein Netzwerk, das semantische Segmentierungsprobleme aus einer völlig neuen Perspektive löst. Frühere semantische Bildsegmentierungsnetzwerke, die auf neuronalen Netzwerken basieren, verwenden Bildblöcke, die auf dem zu klassifizierenden Pixel zentriert sind, um die Bezeichnung des zentralen Pixels vorherzusagen. Das Netzwerk wird im Allgemeinen unter Verwendung einer CNN+FC-Strategie aufgebaut. Offensichtlich kann diese Methode die globalen Kontextinformationen nicht nutzen des Bildes, und die Pixel-für-Pixel-Überlegungsgeschwindigkeit ist sehr niedrig; während das FCN-Netzwerk die vollständig verbundene Schicht FC aufgibt und Faltungsschichten verwendet, um das Netzwerk aufzubauen Die Netzwerkausgabe ist direkt die Vorhersagemaske des Eingabebildes. Effizienz und Genauigkeit wurden erheblich verbessert. Schematische Darstellung der FCN-Feature-Fusion für verschiedene Layer 1.2 Codierungsstruktur (Encoder-Decoder)

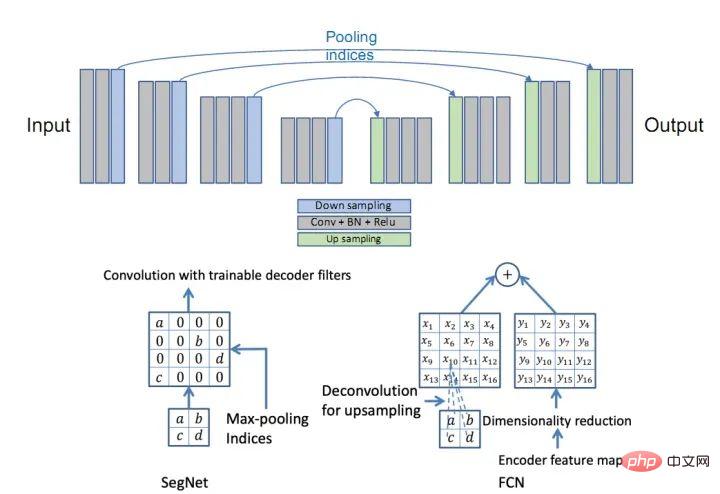

ist im Grunde die gleiche Idee wie das FCN-Netzwerk. Der Encoder-Teil verwendet die ersten 13 Faltungsschichten von VGG16. Der Unterschied liegt in der Upsampling-Methode des Decoder-Teils. FCN erhält das Upsampling-Ergebnis, indem es das Ergebnis der Dekonvertierung der Feature-Map zur Feature-Map der entsprechenden Größe des Encoders hinzufügt, während SegNet den Index des Maxpools des Encoder-Teils verwendet, um den Decoder-Teil (ursprüngliche Beschreibung: der Decoder) hochzusampeln führt ein Upsampling der Feature-Eingabekarten mit niedrigerer Auflösung durch. Insbesondere verwendet der Decoder Pooling-Indizes, die im Max-Pooling-Schritt des entsprechenden Encoders berechnet werden, um ein nichtlineares Upsampling durchzuführen. Innovationspunkte

: Encoder-Decoder-Struktur;

- SegNet-Netzwerk

Vergleich der Upsample-Methode zwischen SegNet und FCN

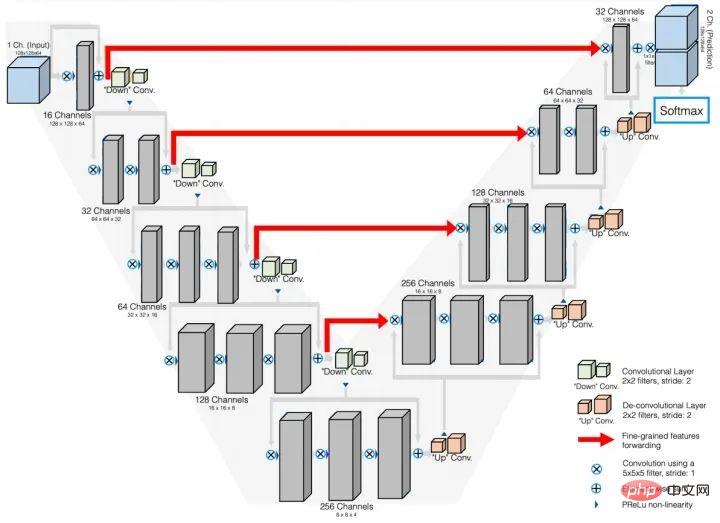

U-Net-Netzwerk wurde ursprünglich für biomedizinische Bilder entwickelt, jedoch aufgrund seiner schlechten Leistung , jetzt UNet und seine Varianten werden in verschiedenen Teilbereichen des Lebenslaufs häufig eingesetzt. Das UNet-Netzwerk besteht aus einem U-Kanal und einer Skip-Verbindung. Der U-Kanal ähnelt der Kodierungs- und Dekodierungsstruktur von SegNet. Der Kodierungsteil (Kontrahierungspfad) führt die Merkmalsextraktion durch und erfasst Kontextinformationen, und der Dekodierungsteil (Erweiterungspfad). ) verwendet Dekodierungsfunktionen, um Pixelbeschriftungen vorherzusagen. Der Kurzschlusskanal verbessert die Modellgenauigkeit und löst das Problem des Verschwindens des Gradienten. Es ist besonders wichtig zu beachten, dass die oben verwendete Kurzschlusskanal-Feature-Map und die Feature-Map gespleißt und nicht addiert werden (im Gegensatz zu FCN).

Innovationspunkt: U-förmige Struktur; Kurzschlusskanal (Sprungverbindung)

U-Net-Netzwerk

-

- Die V-Net-Netzwerkstruktur ähnelt U-Net, mit der Ausnahme, dass die Architektur Sprungverbindungen hinzufügt und 2D-Operationen durch 3D-Operationen ersetzt, um 3D-Bilder (volumetrische Bilder) zu verarbeiten. Und optimiert für weit verbreitete Segmentierungsmetriken wie Dice.

V-Net-Netzwerk

Innovationspunkt : Äquivalent zur 3D-Version des U-Net-Netzwerks

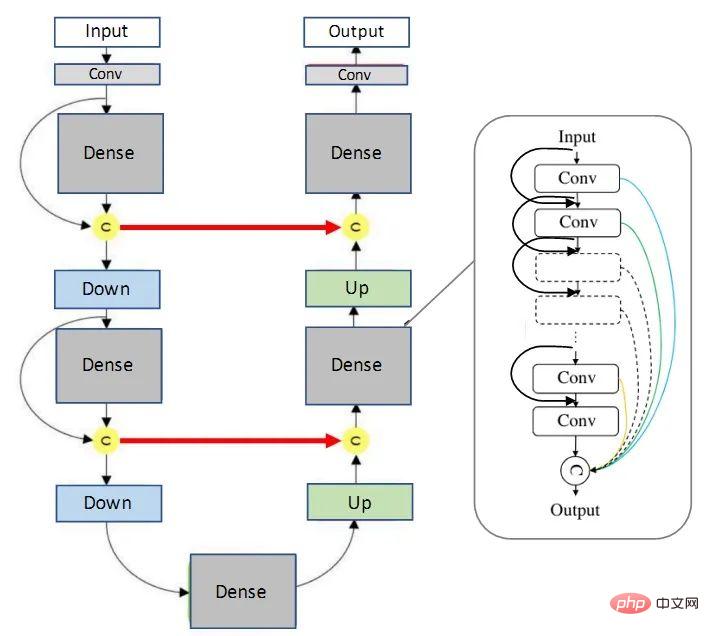

- FC-DenseNet (Hundred-Layer Tiramisu Network) Titel: Das Hundert-Schichten-Tiramisu: Vollständig faltende dichte Netze für die semantische Segmentierung) Die Netzwerkstruktur besteht aus dichter Block- und UNet-Architektur. Die einfachste Version dieses Netzwerks besteht aus zwei Downsampling-Pfaden mit Übergang nach unten und zwei Upsampling-Pfaden mit Übergang nach oben. Es enthält außerdem zwei horizontale Sprungverbindungen, um die Feature-Map aus dem Downsampling-Pfad mit der entsprechenden Feature-Map im Upsampling-Pfad zu verbinden. Die Verbindungsmuster im Upsampling-Pfad und im Downsampling-Pfad sind nicht genau gleich: Im Downsampling-Pfad gibt es außerhalb jedes dichten Blocks einen Skip-Splicing-Pfad, was zu einem linearen Anstieg der Anzahl der Feature-Maps führt, während im Upsampling-Pfad ein linearer Anstieg der Anzahl der Feature-Maps auftritt Es gibt keine solche Operation. (Noch etwas: Die Abkürzung dieses Netzwerks kann Dense Unet sein, aber es gibt einen Artikel mit dem Titel „Fully Dense UNet for 2D Sparse Photoacoustic Tomography Artifact Removal“, bei dem es um die Entfernung von Artefakten in der photoakustischen Bildgebung geht. Ich habe viele Blogs gesehen, in denen dieser Artikel zitiert wurde . Die Abbildungen im Papier sprechen von semantischer Segmentierung, was überhaupt nicht dasselbe ist =_=||, Sie können es selbst unterscheiden)

FC-DenseNet (Hundred-Layer Tiramisu Network)

Innovationspunkt: Integration von DenseNet- und U-Net-Netzwerken (aus Sicht des Informationsaustauschs sind dichte Verbindungen tatsächlich leistungsfähiger als Reststrukturen)

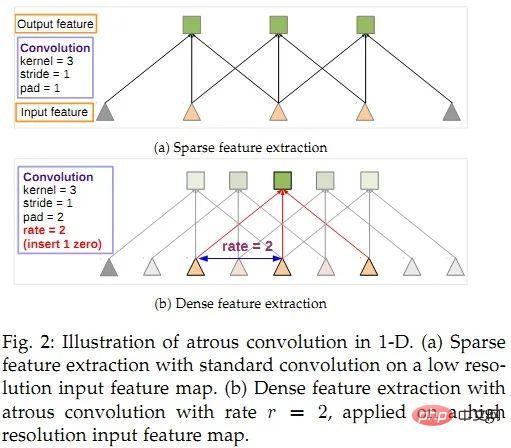

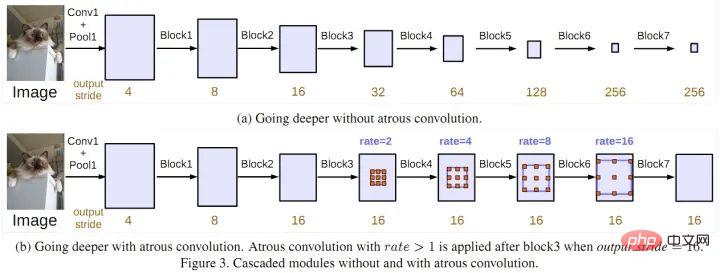

- Deeplab-Seriennetzwerke werden basierend auf der verbesserten Kodierungs- und Dekodierungsstruktur vorgeschlagen In der Version 2018 schnitt das DeeplabV3+-Netzwerk bei den VOC2012- und Cityscapes-Datensätzen hervorragend ab und erreichte das SOTA-Niveau. Es gibt vier Artikel in der DeepLab-Reihe: V1, V2, V3 und V3+. Fassen Sie kurz die Kerninhalte einiger Artikel zusammen:

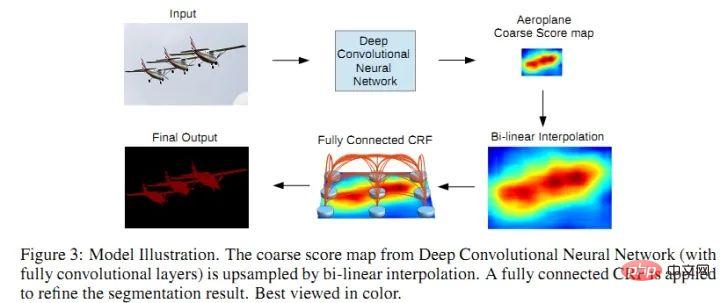

1) DeepLabV1: Fusion eines Faltungs-Neuronalen Netzwerks und eines Wahrscheinlichkeitsgraphenmodells: CNN+CRF, was die Segmentierungs- und Positionierungsgenauigkeit verbessert;

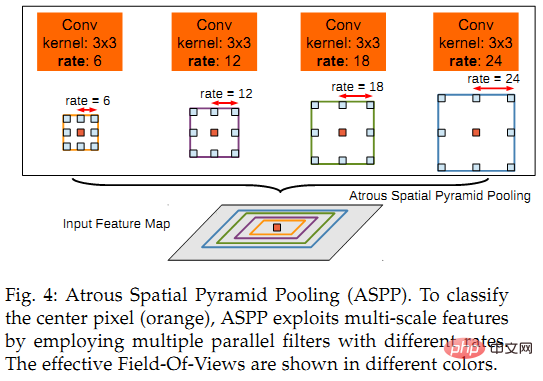

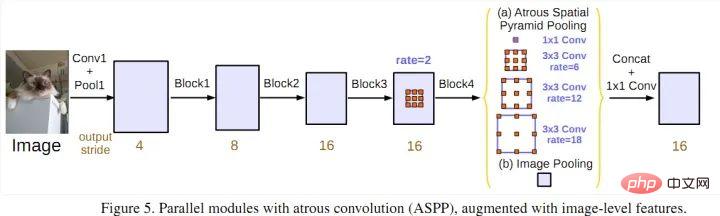

2) DeepLabV2: ASPP (Erweiterung Räumliches Pyramiden-Pooling); CNN+CRF

3) DeepLabV3: Verbessertes ASPP, Hinzufügen von 1*1-Faltung und globalem durchschnittlichem Pooling; verglichen mit kaskadiertem und parallelem atrous-Volumen-Kumulativer Effekt.

Cascade Atrous Convolution

Parallel Atrous Convolution (ASPP)

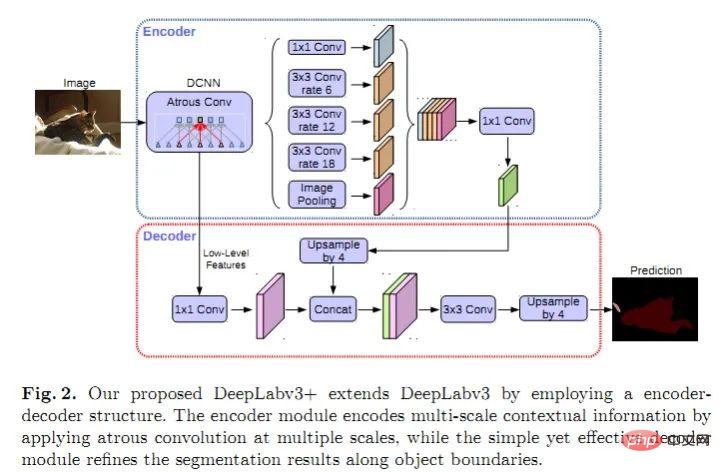

4) DeepLabV3+: Fügen Sie die Idee der Codec-Architektur hinzu und fügen Sie ein Decoder-Modul hinzu um DeepLabv3 zu erweitern; Wenden Sie in der Tiefe trennbare Faltungen auf ASPP- und Decoder-Module an. Verbessertes Xception als Backbone.

DeepLabV3+

Im Allgemeinen sind die Kernbeiträge der DeepLab-Serie: atrous Faltung; CNN+CRF (nur V1 und V2 verwenden CRF, es sollten V3 und V3+ sein, die die Segmentierungsgrenze durch lösen). tiefes Netzwerk Bei verschwommenen Problemen ist der Effekt besser als das Hinzufügen von CRF)

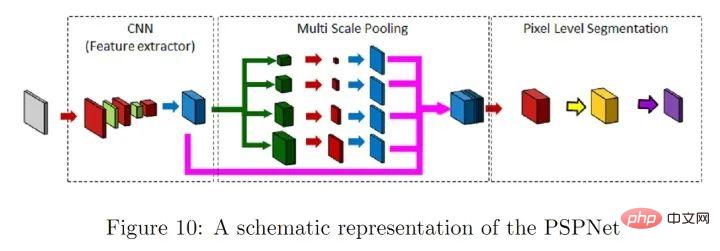

- PSPNet (Pyramid Scene Parsing Network) verbessert die Fähigkeit des Netzwerks, globale Kontextinformationen zu nutzen, indem Kontextinformationen in verschiedenen Bereichen aggregiert werden. In SPPNet werden die durch Pyramidenpooling generierten Feature-Maps verschiedener Ebenen schließlich abgeflacht und verkettet und dann zur Klassifizierung an die vollständig verbundene Ebene gesendet, wodurch die Einschränkung von CNN, die eine feste Eingabegröße für die Bildklassifizierung erfordert, entfällt. In PSPNet lautet die verwendete Strategie: Pooling-Conv-Upsample und dann gespleißt, um die Feature-Map zu erhalten, und dann eine Etikettenvorhersage durchführen.

PSPNET-Netzwerk

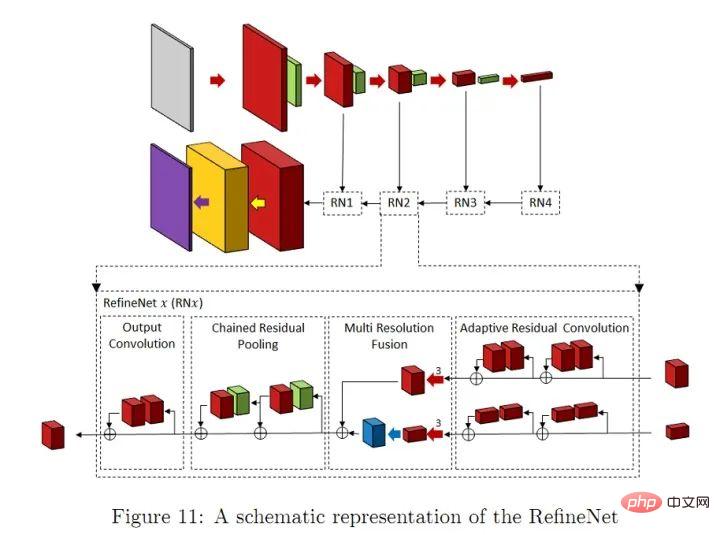

Innovationspunkte: multi-skaliertem Pooling, um globale Vorkenntnisse auf Bildebene zu nutzen, um komplexe Szenen zu verstehen. Dadurch können Multiskalenaktivierungen kombiniert und gleichzeitig ein Schärfeverlust verhindert werden. Das Netzwerk besteht aus unabhängigen Refine-Modulen, jedes Refine-Modul besteht aus drei Hauptmodulen, nämlich: Residual Convolutional Unit (RCU), Multi-Resolution Fusion (MRF) und Chain Residual Pooling (CRP). Die Gesamtstruktur ähnelt in gewisser Weise der von U-Net, es wurde jedoch eine neue Kombinationsmethode für die Sprungverbindung entwickelt (keine einfache Verbindung). Persönlich denke ich, dass diese Struktur tatsächlich sehr gut als Idee für Ihr eigenes Netzwerkdesign geeignet ist. Sie können viele CNN-Module hinzufügen, die in anderen CV-Problemen verwendet werden, und wenn Sie U-Net als Gesamtrahmen verwenden, wird der Effekt nicht allzu schlecht sein. ?? . Einige Methoden zur Vereinfachung der Struktur tiefer Netzwerke: Tensorzerlegung; Kanal-/Netzwerkbereinigung; Es gibt auch einige, die NAS (Neural Architecture Search) verwenden, um das manuelle Design zum Durchsuchen der Struktur von Modulen oder des gesamten Netzwerks zu ersetzen. Natürlich werden die von AutoDL benötigten GPU-Ressourcen viele Menschen abschrecken. Daher verwenden manche Leute die Zufallssuche, um nach viel kleineren ASPP-Modulen zu suchen und bauen dann das gesamte Netzwerkmodell auf der Grundlage der kleinen Module auf.

Leichtes Netzwerkdesign ist der Konsens in der Branche, dass es unmöglich ist, jede Maschine mit einem 2080ti auszustatten. Darüber hinaus schränken Stromverbrauch, Speicher und andere Probleme die Förderung und Anwendung des Modells ein. Wenn jedoch 5G populär wird, können alle Daten in der Cloud verarbeitet werden, was sehr interessant sein wird. Natürlich wissen wir kurzfristig (zehn Jahre) nicht, ob eine vollständige Einführung von 5G machbar ist.- 1.4 Netzwerkstruktur basierend auf dem Aufmerksamkeitsmechanismus Der Aufmerksamkeitsmechanismus kann wie folgt definiert werden: Verwendung nachfolgender Layer-/Feature-Map-Informationen, um den wertendsten (oder hervorstechendsten) Teil der Eingabe-Feature-Map auszuwählen und zu lokalisieren. Es kann einfach als eine Möglichkeit zur Gewichtung von Feature-Maps betrachtet werden (die Gewichte werden über das Netzwerk berechnet und kann in Kanal-Aufmerksamkeitsmechanismus (CA) und räumlicher Aufmerksamkeitsmechanismus (PA) unterteilt werden). . Das FPA-Netzwerk (Feature Pyramid Attention) ist ein semantisches Segmentierungsnetzwerk, das auf dem Aufmerksamkeitsmechanismus basiert und den Aufmerksamkeitsmechanismus und die räumliche Pyramide kombiniert, um präzise Merkmale für die Kennzeichnung auf Pixelebene zu extrahieren, ohne dass Faltungs- und vom Menschen entworfene Decodernetzwerke verwendet werden.

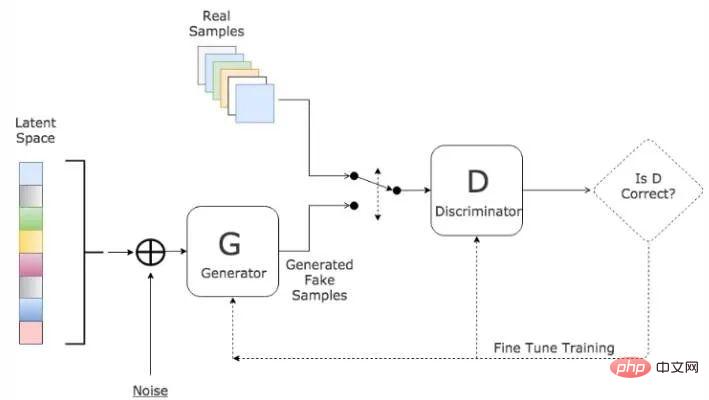

Goodfellow et al. schlugen 2014 eine kontradiktorische Methode zum Erlernen tiefer generativer Modelle vor. In generativen kontradiktorischen Netzwerken (GANs) müssen zwei Modelle gleichzeitig trainiert werden: ein generatives Modell, das erfasst die Datenverteilung G und ein Unterscheidungsmodell D, das die Wahrscheinlichkeit schätzt, dass eine Stichprobe aus den Trainingsdaten stammt.

Goodfellow et al. schlugen 2014 eine kontradiktorische Methode zum Erlernen tiefer generativer Modelle vor. In generativen kontradiktorischen Netzwerken (GANs) müssen zwei Modelle gleichzeitig trainiert werden: ein generatives Modell, das erfasst die Datenverteilung G und ein Unterscheidungsmodell D, das die Wahrscheinlichkeit schätzt, dass eine Stichprobe aus den Trainingsdaten stammt. ● G ist ein generatives Netzwerk, das ein zufälliges Rauschen z (Zufallszahl) empfängt und durch dieses Rauschen ein Bild generiert. ● D ist ein diskriminatives Netzwerk, das bestimmt, ob ein Bild „echt“ ist. Sein Eingabeparameter ist x (ein Bild), und die Ausgabe D(x) stellt die Wahrscheinlichkeit dar, dass x ein reales Bild ist. Wenn es 1 ist, bedeutet dies, dass 100 % ein reales Bild ist, und die Ausgabe ist 0, was bedeutet, dass es sich um ein reales Bild handelt kann nicht real sein.

Das Trainingsverfahren von G besteht darin, die Wahrscheinlichkeit eines D-Fehlers zu maximieren. Es kann bewiesen werden, dass es im Raum aller Funktionen G und D eine eindeutige Lösung gibt, sodass G die Trainingsdatenverteilung reproduziert und D = 0,5. Während des Trainingsprozesses besteht das Ziel des Generierungsnetzwerks G darin, zu versuchen, echte Bilder zu erzeugen, um das Diskriminanznetzwerk D zu täuschen. Das Ziel von D besteht darin, zu versuchen, die von G erzeugten gefälschten Bilder von den echten Bildern zu unterscheiden. Auf diese Weise stellen G und D einen dynamischen „Spielprozess“ dar, und der endgültige Gleichgewichtspunkt ist der Nash-Gleichgewichtspunkt. Für den Fall, dass G und D durch ein neuronales Netzwerk definiert werden, kann das gesamte System mit Backpropagation trainiert werden.

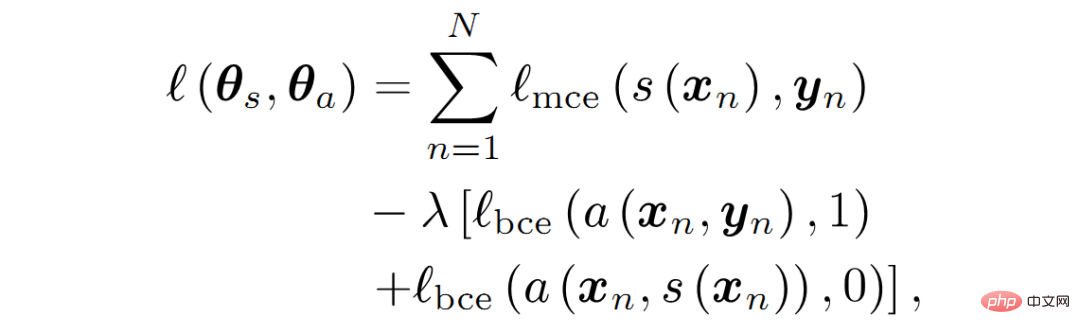

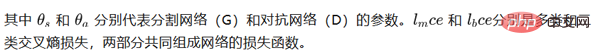

Illustration der GANs-NetzwerkstrukturInspiriert von GANs trainierten Luc et al. ein semantisches Segmentierungsnetzwerk (G) und ein gegnerisches Netzwerk (D). G) Segmentierungsdiagramm. G und D spielen weiterhin Spiele und lernen, und ihre Verlustfunktion ist definiert als:

GANs Verlustfunktion

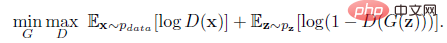

Schauen Sie sich die ursprüngliche GAN-Verlustfunktion an: die Verlustfunktion von GANs verkörpern eine Null. Basierend auf der Idee und dem Spiel ist die Verlustfunktion der ursprünglichen GANs wie folgt:

Die Berechnungsposition des Verlusts liegt am Ausgang von D (Diskriminator) und dem Die Ausgabe von D ist im Allgemeinen eine falsche/wahre Beurteilung, sodass das Ganze wie oben betrachtet werden kann. Es wurde eine binäre Kreuzentropiefunktion verwendet. Aus der Form der Verlustfunktion von GANs ist ersichtlich, dass das Training in zwei Teile unterteilt ist: Der erste ist der maxD-Teil, da beim Training im Allgemeinen zuerst D trainiert wird, während G (Generator) unverändert bleibt. Das Trainingsziel von D besteht darin, richtig/falsch zu unterscheiden. Wenn wir 1/0 verwenden, um wahr/falsch darzustellen, dann erwarten wir für das erste Element E, dass sich D(x) dem Wert 1 nähert, da die Eingabe aus realen Daten stammt , was bedeutet, dass die ersten Elemente größer sind. Auf die gleiche Weise tastet die Eingabe des zweiten Elements E die von G generierten Daten ab, sodass wir erwarten, dass D(G(z)) sich besser 0 nähert, was bedeutet, dass das zweite Element wieder größer ist. Dieser Teil ist also die Erwartung, dass das Training das Ganze größer machen wird, was die Bedeutung von maxD ist. Dieser Teil aktualisiert nur die Parameter von D. Der zweite Teil behält D unverändert (keine Parameteraktualisierungen) und trainiert G. Zu diesem Zeitpunkt ist nur das zweite Element E nützlich. Der Schlüssel ist hier, weil wir D verwirren wollen, also setzen wir jetzt die Bezeichnung auf 1 (wir wissen, dass es sich um eine Fälschung handelt, daher wird es als Verwirrung bezeichnet. Es ist besser zu hoffen, dass die Ausgabe von D(G(z)) nahe bei 1 liegt, das heißt, je kleiner dieser Term ist, desto besser. Natürlich ist der Diskriminator nicht so leicht zu täuschen, daher wird der Diskriminator zu diesem Zeitpunkt einen relativ großen Fehler erzeugen, und dann wird G Sie nicht täuschen, also kann ich es tun Arbeiten Sie das nächste Mal nur härter. (Zitiert aus

https://www.cnblogs.com/walter-xh/p/10051634.html). Zu diesem Zeitpunkt werden nur die Parameter von G aktualisiert.

Wenn man GANs aus einer anderen Perspektive betrachtet, entspricht der Diskriminator (D) einer speziellen Verlustfunktion (bestehend aus einem neuronalen Netzwerk, anders als herkömmliche Verlustfunktionen wie L1, L2, Kreuzentropie usw.). Darüber hinaus verfügen GANs über eine spezielle Trainingsmethode und es gibt Probleme wie das Verschwinden des Gradienten und den Zusammenbruch des Modus (derzeit scheint es eine Möglichkeit zu geben, dieses Problem zu lösen), aber sein Designkonzept ist in der Tat eine großartige Erfindung im Zeitalter von tiefes Lernen. 1.6 Zusammenfassung Auf Deep Learning basierende Bildsemantiksegmentierungsmodelle folgen meist der Encoder-Decoder-Architektur, wie z. B. U-Net. Forschungsergebnisse der letzten Jahre haben gezeigt, dass erweiterte Faltung und Feature-Pyramiden-Pooling die Netzwerkleistung im U-Net-Stil verbessern können. In Abschnitt 2 fassen wir zusammen, wie diese Methoden und ihre Varianten auf die medizinische Bildsegmentierung angewendet werden können. 2. Anwendung von Netzwerkstrukturinnovationen in der medizinischen Bildsegmentierung In diesem Teil werden einige Forschungsergebnisse zur Anwendung von Netzwerkstrukturinnovationen in der 2D/3D-medizinischen Bildsegmentierung vorgestellt.2.1 Segmentierungsmethode basierend auf Modellkomprimierung

Um eine Echtzeitverarbeitung hochauflösender medizinischer 2D/3D-Bilder (wie CT-, MRT- und histopathologische Bilder usw.) zu erreichen, haben Forscher verschiedene Methoden zur Komprimierung vorgeschlagen Modelle. Weng et al. nutzten die NAS-Technologie zur Anwendung im U-Net-Netzwerk und erhielten ein kleines Netzwerk mit besserer Organ-/Tumorsegmentierungsleistung bei CT-, MRT- und Ultraschallbildern. Brugger hat die U-Net-Architektur neu gestaltet, indem er Gruppennormalisierung und Leaky-ReLU (Leaky-ReLU-Funktion) nutzte, um die Speichereffizienz des Netzwerks für die Segmentierung medizinischer 3D-Bilder effizienter zu gestalten. Einige Leute haben auch erweiterte Faltungsmodule mit weniger Parametern entworfen. Einige andere Modellkomprimierungsmethoden umfassen Gewichtsquantisierung (Sechzehn-Bit-, Acht-Bit-, Binärquantisierung), Destillation, Bereinigung usw.

2.2 Segmentierungsmethode der Kodierungs-Dekodierungsstruktur

Drozdal schlug eine Methode vor, die ein einfaches CNN anwendet, um das ursprüngliche Eingabebild zu normalisieren, bevor das Bild in das Segmentierungsnetzwerk eingespeist wird, was die Bildsegmentierung bei der Singleton-Mikroskopie, die Leber-CT und die Segmentierungsgenauigkeit der Prostata verbessert MRT. Gu schlug eine Methode zur Verwendung erweiterter Faltung im Backbone-Netzwerk vor, um Kontextinformationen beizubehalten. Vorontsov schlug ein Graph-zu-Graph-Netzwerk-Framework vor, das Bilder mit ROI in Bilder ohne ROI umwandelt (z. B. Bilder mit Tumoren werden in gesunde Bilder ohne Tumoren umgewandelt) und dann die vom Modell entfernten Tumore zu den neuen gesunden Bildern hinzugefügt . , um die detaillierte Struktur des Objekts zu erhalten. Zhou et al. schlugen eine Methode zur Neuverkabelung des U-Net-Netzwerks vor und führten diese an der Knotensegmentierung in Niedrigdosis-CT-Scans des Brustkorbs, der Kernsegmentierung in Mikroskopiebildern, der Lebersegmentierung in CT-Scans des Abdomens und der Koloskopie durch zu einer Polypensegmentierungsaufgabe im Untersuchungsvideo. Goyal wandte DeepLabV3 zur dermatoskopischen Farbbildsegmentierung an, um Bereiche mit Hautläsionen zu extrahieren.

2.3 Segmentierungsmethode basierend auf dem Aufmerksamkeitsmechanismus

Nie schlug ein Aufmerksamkeitsmodell vor, das die Prostata im Vergleich zu Basismodellen (V-Net und FCN) genauer segmentieren kann. SinHa schlug ein Netzwerk vor, das auf einem mehrschichtigen Aufmerksamkeitsmechanismus für die Segmentierung von Bauchorganen in MRT-Bildern basiert. Qin et al. schlugen ein erweitertes Faltungsmodul vor, um mehr Details medizinischer 3D-Bilder zu bewahren. Es gibt viele andere Veröffentlichungen zur Blutbildsegmentierung basierend auf Aufmerksamkeitsmechanismen.

2.4 Segmentierungsnetzwerk basierend auf kontradiktorischem Lernen

Khosravan schlug ein kontradiktorisches Trainingsnetzwerk für die Pankreassegmentierung anhand von CT-Scans vor. Son verwendet generative kontradiktorische Netzwerke zur Segmentierung von Netzhautbildern. Xue verwendet ein vollständig Faltungsnetzwerk als Segmentierungsnetzwerk in einem generativen kontradiktorischen Rahmen, um Hirntumoren aus MRT-Bildern zu segmentieren. Es gibt andere Artikel, die GANs erfolgreich auf medizinische Bildsegmentierungsprobleme anwenden, daher werde ich sie nicht einzeln auflisten.

2.5 RNN-basiertes Segmentierungsmodell

Rekurrentes neuronales Netzwerk (RNN) wird hauptsächlich zur Verarbeitung von Sequenzdaten verwendet. Das lange Kurzzeitgedächtnisnetzwerk (LSTM) ist eine verbesserte Version von LSTM, die den Gradientenfluss durch die Einführung von Selbstschleifen ermöglicht . Kann lange aufrechterhalten werden. Im Bereich der medizinischen Bildanalyse wird RNN zur Modellierung zeitlicher Abhängigkeiten in Bildsequenzen eingesetzt. Bin et al. schlugen einen Bildsequenz-Segmentierungsalgorithmus vor, der ein vollständig faltendes neuronales Netzwerk und RNN integriert und Informationen in der Zeitdimension in die Segmentierungsaufgabe einbezieht. Gao et al. verwendeten CNN und LSTM, um zeitliche Beziehungen in MRT-Schnittsequenzen des Gehirns zu modellieren und so die Segmentierungsleistung in 4D-Bildern zu verbessern. Li et al. verwendeten zunächst U-Net, um die anfängliche Segmentierungswahrscheinlichkeitskarte zu erhalten, und verwendeten dann LSTM, um die Bauchspeicheldrüse aus 3D-CT-Bildern zu segmentieren, was die Segmentierungsleistung verbesserte. Es gibt viele andere Artikel, die RNN für die Segmentierung medizinischer Bilder verwenden, daher werde ich sie nicht einzeln vorstellen.

2.6 Zusammenfassung

In diesem Teil des Inhalts geht es hauptsächlich um die Anwendung von Segmentierungsalgorithmen bei der medizinischen Bildsegmentierung, daher gibt es nicht viele Neuerungen. Er konzentriert sich hauptsächlich auf die Analyse von Daten in verschiedenen Formaten (CT oder RGB, Pixelbereich, Bildauflösung usw.) Aufgrund der Eigenschaften verschiedener Teile der Daten (Rauschen, Objektform usw.) muss das klassische Netzwerk verbessert werden, damit sich verschiedene Daten an das Eingabedatenformat und die Eigenschaften anpassen können, damit dies möglich ist Schließen Sie die Segmentierungsaufgabe besser ab. Obwohl es sich bei Deep Learning um eine Blackbox handelt, müssen beim Gesamtdesign des Modells dennoch Regeln befolgt werden, welche Strategie welches Problem löst und welches Problem es verursacht, basierend auf dem spezifischen Segmentierungsproblem, um eine optimale Segmentierungsleistung zu erzielen.

Einige Referenzen:

1.Deep Semantic Segmentation of Natural and Medical Images: A Review

2.NAS-Unet: Neural Architecture Search for Medical Image Segmentation. IEEE Access, 7:44247–44257, 2019 .

3.Steigerung der Segmentierung durch schwache Überwachung von Bild-zu-Bild-Übersetzung arXiv:1904.01636, 2019

4. .

5.SegAN: Gegnerisches Netzwerk mit mehrskaligem L1-Verlust Medizinische Bildsegmentierung.

6.Vollständig faltungsstrukturierte LSTM-Netzwerke für die gemeinsame 4D-Bildsegmentierung. Im Jahr 2018 IEEE7 https://www.cnblogs.com/walter-xh/p/10051634.html

Das obige ist der detaillierte Inhalt vonDeep-Learning-Bildsegmentierung: Ein Überblick über das Netzwerkstrukturdesign. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Methoden und Schritte zur Verwendung von BERT für die Stimmungsanalyse in Python

Jan 22, 2024 pm 04:24 PM

Methoden und Schritte zur Verwendung von BERT für die Stimmungsanalyse in Python

Jan 22, 2024 pm 04:24 PM

BERT ist ein vorab trainiertes Deep-Learning-Sprachmodell, das 2018 von Google vorgeschlagen wurde. Der vollständige Name lautet BidirektionalEncoderRepresentationsfromTransformers, der auf der Transformer-Architektur basiert und die Eigenschaften einer bidirektionalen Codierung aufweist. Im Vergleich zu herkömmlichen Einweg-Codierungsmodellen kann BERT bei der Textverarbeitung gleichzeitig Kontextinformationen berücksichtigen, sodass es bei Verarbeitungsaufgaben in natürlicher Sprache eine gute Leistung erbringt. Seine Bidirektionalität ermöglicht es BERT, die semantischen Beziehungen in Sätzen besser zu verstehen und dadurch die Ausdrucksfähigkeit des Modells zu verbessern. Durch Vorschulungs- und Feinabstimmungsmethoden kann BERT für verschiedene Aufgaben der Verarbeitung natürlicher Sprache verwendet werden, wie z. B. Stimmungsanalyse und Benennung

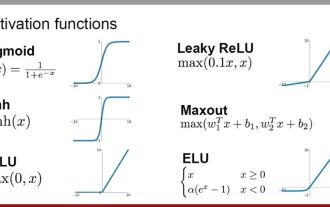

Analyse häufig verwendeter KI-Aktivierungsfunktionen: Deep-Learning-Praxis von Sigmoid, Tanh, ReLU und Softmax

Dec 28, 2023 pm 11:35 PM

Analyse häufig verwendeter KI-Aktivierungsfunktionen: Deep-Learning-Praxis von Sigmoid, Tanh, ReLU und Softmax

Dec 28, 2023 pm 11:35 PM

Aktivierungsfunktionen spielen beim Deep Learning eine entscheidende Rolle. Sie können nichtlineare Eigenschaften in neuronale Netze einführen und es dem Netz ermöglichen, komplexe Eingabe-Ausgabe-Beziehungen besser zu lernen und zu simulieren. Die richtige Auswahl und Verwendung von Aktivierungsfunktionen hat einen wichtigen Einfluss auf die Leistung und Trainingsergebnisse neuronaler Netze. In diesem Artikel werden vier häufig verwendete Aktivierungsfunktionen vorgestellt: Sigmoid, Tanh, ReLU und Softmax. Beginnend mit der Einführung, den Verwendungsszenarien und den Vorteilen. Nachteile und Optimierungslösungen werden besprochen, um Ihnen ein umfassendes Verständnis der Aktivierungsfunktionen zu vermitteln. 1. Sigmoid-Funktion Einführung in die Sigmoid-Funktionsformel: Die Sigmoid-Funktion ist eine häufig verwendete nichtlineare Funktion, die jede reelle Zahl auf Werte zwischen 0 und 1 abbilden kann. Es wird normalerweise verwendet, um das zu vereinheitlichen

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Jenseits von ORB-SLAM3! SL-SLAM: Szenen mit wenig Licht, starkem Jitter und schwacher Textur werden verarbeitet

May 30, 2024 am 09:35 AM

Heute diskutieren wir darüber, wie Deep-Learning-Technologie die Leistung von visionbasiertem SLAM (Simultaneous Localization and Mapping) in komplexen Umgebungen verbessern kann. Durch die Kombination von Methoden zur Tiefenmerkmalsextraktion und Tiefenanpassung stellen wir hier ein vielseitiges hybrides visuelles SLAM-System vor, das die Anpassung in anspruchsvollen Szenarien wie schlechten Lichtverhältnissen, dynamischer Beleuchtung, schwach strukturierten Bereichen und starkem Jitter verbessern soll. Unser System unterstützt mehrere Modi, einschließlich erweiterter Monokular-, Stereo-, Monokular-Trägheits- und Stereo-Trägheitskonfigurationen. Darüber hinaus wird analysiert, wie visuelles SLAM mit Deep-Learning-Methoden kombiniert werden kann, um andere Forschungen zu inspirieren. Durch umfangreiche Experimente mit öffentlichen Datensätzen und selbst abgetasteten Daten demonstrieren wir die Überlegenheit von SL-SLAM in Bezug auf Positionierungsgenauigkeit und Tracking-Robustheit.

Latente Raumeinbettung: Erklärung und Demonstration

Jan 22, 2024 pm 05:30 PM

Latente Raumeinbettung: Erklärung und Demonstration

Jan 22, 2024 pm 05:30 PM

Latent Space Embedding (LatentSpaceEmbedding) ist der Prozess der Abbildung hochdimensionaler Daten auf niedrigdimensionalen Raum. Im Bereich des maschinellen Lernens und des tiefen Lernens handelt es sich bei der Einbettung latenter Räume normalerweise um ein neuronales Netzwerkmodell, das hochdimensionale Eingabedaten in einen Satz niedrigdimensionaler Vektordarstellungen abbildet. Dieser Satz von Vektoren wird oft als „latente Vektoren“ oder „latent“ bezeichnet Kodierungen". Der Zweck der Einbettung latenter Räume besteht darin, wichtige Merkmale in den Daten zu erfassen und sie in einer prägnanteren und verständlicheren Form darzustellen. Durch die Einbettung latenter Räume können wir Vorgänge wie das Visualisieren, Klassifizieren und Clustern von Daten im niedrigdimensionalen Raum durchführen, um die Daten besser zu verstehen und zu nutzen. Die Einbettung latenter Räume findet in vielen Bereichen breite Anwendung, z. B. bei der Bilderzeugung, der Merkmalsextraktion, der Dimensionsreduzierung usw. Die Einbettung des latenten Raums ist das Wichtigste

Verstehen Sie in einem Artikel: die Zusammenhänge und Unterschiede zwischen KI, maschinellem Lernen und Deep Learning

Mar 02, 2024 am 11:19 AM

Verstehen Sie in einem Artikel: die Zusammenhänge und Unterschiede zwischen KI, maschinellem Lernen und Deep Learning

Mar 02, 2024 am 11:19 AM

In der heutigen Welle rasanter technologischer Veränderungen sind künstliche Intelligenz (KI), maschinelles Lernen (ML) und Deep Learning (DL) wie helle Sterne und führen die neue Welle der Informationstechnologie an. Diese drei Wörter tauchen häufig in verschiedenen hochaktuellen Diskussionen und praktischen Anwendungen auf, aber für viele Entdecker, die neu auf diesem Gebiet sind, sind ihre spezifische Bedeutung und ihre internen Zusammenhänge möglicherweise noch immer rätselhaft. Schauen wir uns also zunächst dieses Bild an. Es ist ersichtlich, dass zwischen Deep Learning, maschinellem Lernen und künstlicher Intelligenz ein enger Zusammenhang und eine fortschreitende Beziehung besteht. Deep Learning ist ein spezifischer Bereich des maschinellen Lernens und des maschinellen Lernens

Super stark! Top 10 Deep-Learning-Algorithmen!

Mar 15, 2024 pm 03:46 PM

Super stark! Top 10 Deep-Learning-Algorithmen!

Mar 15, 2024 pm 03:46 PM

Fast 20 Jahre sind vergangen, seit das Konzept des Deep Learning im Jahr 2006 vorgeschlagen wurde. Deep Learning hat als Revolution auf dem Gebiet der künstlichen Intelligenz viele einflussreiche Algorithmen hervorgebracht. Was sind Ihrer Meinung nach die zehn besten Algorithmen für Deep Learning? Im Folgenden sind meiner Meinung nach die besten Algorithmen für Deep Learning aufgeführt. Sie alle nehmen hinsichtlich Innovation, Anwendungswert und Einfluss eine wichtige Position ein. 1. Hintergrund des Deep Neural Network (DNN): Deep Neural Network (DNN), auch Multi-Layer-Perceptron genannt, ist der am weitesten verbreitete Deep-Learning-Algorithmus. Als er erstmals erfunden wurde, wurde er aufgrund des Engpasses bei der Rechenleistung in Frage gestellt Jahre, Rechenleistung, Der Durchbruch kam mit der Datenexplosion. DNN ist ein neuronales Netzwerkmodell, das mehrere verborgene Schichten enthält. In diesem Modell übergibt jede Schicht Eingaben an die nächste Schicht und

So verwenden Sie CNN- und Transformer-Hybridmodelle, um die Leistung zu verbessern

Jan 24, 2024 am 10:33 AM

So verwenden Sie CNN- und Transformer-Hybridmodelle, um die Leistung zu verbessern

Jan 24, 2024 am 10:33 AM

Convolutional Neural Network (CNN) und Transformer sind zwei verschiedene Deep-Learning-Modelle, die bei verschiedenen Aufgaben eine hervorragende Leistung gezeigt haben. CNN wird hauptsächlich für Computer-Vision-Aufgaben wie Bildklassifizierung, Zielerkennung und Bildsegmentierung verwendet. Es extrahiert lokale Merkmale auf dem Bild durch Faltungsoperationen und führt eine Reduzierung der Merkmalsdimensionalität und räumliche Invarianz durch Pooling-Operationen durch. Im Gegensatz dazu wird Transformer hauptsächlich für Aufgaben der Verarbeitung natürlicher Sprache (NLP) wie maschinelle Übersetzung, Textklassifizierung und Spracherkennung verwendet. Es nutzt einen Selbstaufmerksamkeitsmechanismus, um Abhängigkeiten in Sequenzen zu modellieren und vermeidet so die sequentielle Berechnung in herkömmlichen rekurrenten neuronalen Netzen. Obwohl diese beiden Modelle für unterschiedliche Aufgaben verwendet werden, weisen sie Ähnlichkeiten in der Sequenzmodellierung auf

Verbesserter RMSprop-Algorithmus

Jan 22, 2024 pm 05:18 PM

Verbesserter RMSprop-Algorithmus

Jan 22, 2024 pm 05:18 PM

RMSprop ist ein weit verbreiteter Optimierer zum Aktualisieren der Gewichte neuronaler Netze. Es wurde 2012 von Geoffrey Hinton et al. vorgeschlagen und ist der Vorgänger des Adam-Optimierers. Das Aufkommen des RMSprop-Optimierers besteht hauptsächlich darin, einige Probleme zu lösen, die im SGD-Gradientenabstiegsalgorithmus auftreten, wie z. B. das Verschwinden des Gradienten und die Explosion des Gradienten. Durch den Einsatz des RMSprop-Optimierers kann die Lernrate effektiv angepasst und Gewichte adaptiv aktualisiert werden, wodurch der Trainingseffekt des Deep-Learning-Modells verbessert wird. Die Kernidee des RMSprop-Optimierers besteht darin, einen gewichteten Durchschnitt von Gradienten durchzuführen, sodass Gradienten in unterschiedlichen Zeitschritten unterschiedliche Auswirkungen auf Gewichtsaktualisierungen haben. Konkret berechnet RMSprop das Quadrat jedes Parameters

Goodfellow et al. schlugen 2014 eine kontradiktorische Methode zum Erlernen tiefer generativer Modelle vor. In generativen kontradiktorischen Netzwerken (GANs) müssen zwei Modelle gleichzeitig trainiert werden: ein generatives Modell, das erfasst die Datenverteilung G und ein Unterscheidungsmodell D, das die Wahrscheinlichkeit schätzt, dass eine Stichprobe aus den Trainingsdaten stammt.

Goodfellow et al. schlugen 2014 eine kontradiktorische Methode zum Erlernen tiefer generativer Modelle vor. In generativen kontradiktorischen Netzwerken (GANs) müssen zwei Modelle gleichzeitig trainiert werden: ein generatives Modell, das erfasst die Datenverteilung G und ein Unterscheidungsmodell D, das die Wahrscheinlichkeit schätzt, dass eine Stichprobe aus den Trainingsdaten stammt.