Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Deep Learning stößt an eine Wand? Wer hat das Wespennest zwischen LeCun und Marcus aufgewühlt?

Deep Learning stößt an eine Wand? Wer hat das Wespennest zwischen LeCun und Marcus aufgewühlt?

Deep Learning stößt an eine Wand? Wer hat das Wespennest zwischen LeCun und Marcus aufgewühlt?

Die heutigen Protagonisten sind ein Paar alter Feinde in der KI-Branche, die sich lieben und gegenseitig töten:

Yann LeCun und Gary Marcus

Bevor wir offiziell über die „neue Fehde“ dieser Zeit sprechen, lassen Sie uns zunächst die „alte Fehde“ Revue passieren lassen „Zwischen den beiden großen Meistern“.

Der Kampf zwischen LeCun und Marcus

Der Facebook-Chefwissenschaftler für künstliche Intelligenz und Professor der New York University, Turing-Award-Gewinner 2018, veröffentlichte einen Artikel im NOEMA-Magazin als Antwort auf die vorherige Rezension von Gary Marcus über KI und tiefes Lernen.

Zuvor veröffentlichte Marcus einen Artikel in der Zeitschrift Nautilus, in dem er sagte, dass Deep Learning „nicht in der Lage sei, voranzukommen“

Marcus ist ein Mensch, der die Aufregung beobachtet und sie nicht zu ernst nimmt.

Sobald es eine leichte Störung gab, sagte er „KI ist tot“ und sorgte damit für Aufruhr im Kreis!

Ich habe schon oft gepostet und GPT-3 als „Unsinn“ und „Bullshit“ bezeichnet.

Der eiserne Beweis ist hier:

Hey, er hat tatsächlich gesagt, dass „Deep Learning an eine Wand gestoßen ist“, und LeCun, ein großer Star in der KI-Branche, könnte es tun Ich saß nicht still und habe sofort eine Antwort gepostet!

und sagte, wenn du dich anstellen willst, begleite ich dich!

LeCun widerlegte in dem Artikel nacheinander Marcus‘ Ansichten.

Schauen wir uns an, wie der Meister als Antwort schreibt~~

Das Folgende ist LeCuns langer Artikel:

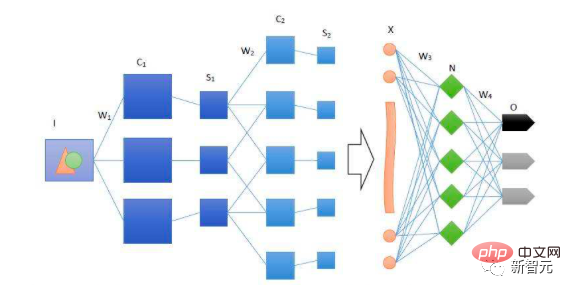

Die dominierende Technologie der zeitgenössischen künstlichen Intelligenz ist das Deep Learning (DL) Neuronale Netzwerk (NN), ein großes- Scale Selbstlernende Algorithmen im großen Maßstab, die gut darin sind, Muster in Daten zu erkennen und auszunutzen. Von Anfang an glaubten Kritiker, dass neuronale Netze auf eine „unüberwindbare Mauer“ gestoßen seien, doch jedes Mal erwies sich dies als vorübergehendes Hindernis.

In den 1960er Jahren konnte NN nichtlineare Funktionen nicht lösen. Diese Situation hielt jedoch nicht lange an, als in den 1980er Jahren die Backpropagation aufkam, aber es entstand erneut eine „unüberwindbare Mauer“, das heißt, es war sehr schwierig, das System zu trainieren.

In den 1990er Jahren entwickelten die Menschen vereinfachte Verfahren und standardisierte Strukturen, die das Training zuverlässiger machten, aber egal welche Ergebnisse erzielt wurden, es schien immer eine „unüberwindbare Mauer“ zu geben. Diesmal war es der Mangel an Trainingsdaten und Computern Leistung.

Deep Learning begann 2012 zum Mainstream zu werden, als die neuesten GPUs auf dem riesigen ImageNet-Datensatz trainieren konnten und dabei alle Konkurrenten mit Leichtigkeit besiegten. Doch dann wurden Zweifel laut: Man entdeckte „eine neue Mauer“ – Deep-Learning-Training erfordert eine große Menge manuell beschrifteter Daten.

In den letzten Jahren ist dieser Zweifel jedoch bedeutungslos geworden, da selbstüberwachtes Lernen recht gute Ergebnisse erzielt hat, wie beispielsweise GPT-3, das keine gekennzeichneten Daten erfordert.

Das scheinbar unüberwindbare Hindernis heutzutage ist das „symbolische Denken“, also die Fähigkeit, Symbole auf algebraische oder logische Weise zu manipulieren. Wie wir als Kinder gelernt haben, erfordert das Lösen mathematischer Probleme die schrittweise Manipulation von Symbolen nach strengen Regeln (z. B. das Lösen von Gleichungen).

Gary Marcus, Autor von „The Algebraic Mind“ und Co-Autor von „Rebooting AI“, glaubte kürzlich, dass DL keine weiteren Fortschritte machen kann, weil neuronale Netze Schwierigkeiten haben, solche symbolischen Operationen zu verarbeiten. Im Gegensatz dazu glauben viele DL-Forscher, dass DL bereits symbolisches Denken betreibt und sich weiter verbessern wird.

Im Mittelpunkt dieser Debatte steht die Rolle von Symbolen in der künstlichen Intelligenz. Es gibt zwei unterschiedliche Ansichten: Die eine ist der Ansicht, dass symbolisches Denken von Anfang an fest codiert sein muss, während die andere glaubt, dass Maschinen symbolisches Denken durch Erfahrung erlernen können . Daher liegt der Schlüssel zum Problem darin, wie wir die menschliche Intelligenz verstehen sollten und wie wir daher künstliche Intelligenz anstreben sollten, die menschliches Niveau erreichen kann.

Verschiedene Arten künstlicher Intelligenz

Das Wichtigste beim symbolischen Denken ist die Genauigkeit: Je nach Permutation und Kombination können Symbole viele verschiedene Reihenfolgen haben, beispielsweise zwischen „(3-2)-1 und 3-(2- 1) „Die Unterschiede sind wichtig, daher ist es entscheidend, wie man das korrekte symbolische Denken in der richtigen Reihenfolge durchführt.“

Marcus glaubt, dass diese Art des Denkens den Kern der Erkenntnis ausmacht und wesentlich für die Bereitstellung der zugrunde liegenden grammatikalischen Logik für die Sprache und der grundlegenden Operationen für die Mathematik ist. Er glaubt, dass sich dies auf unsere grundlegenderen Fähigkeiten erstrecken kann und dass hinter diesen Fähigkeiten eine symbolische Logik steckt.

Die künstliche Intelligenz, mit der wir vertraut sind, entstand aus dem Studium dieser Art des Denkens und wird oft als „symbolische künstliche Intelligenz“ bezeichnet. Aber menschliches Fachwissen in ein Regelwerk umzuwandeln, ist eine große Herausforderung und kostet viel Zeit und Arbeit. Dies ist der sogenannte „Flaschenhals beim Wissenserwerb“.

Obwohl es einfach ist, Regeln für Mathematik oder Logik zu schreiben, ist die Welt selbst schwarz und weiß und sehr unscharf. Es stellt sich heraus, dass es für Menschen unmöglich ist, Regeln zu schreiben, die jedes Muster kontrollieren oder Symbole für jedes unscharfe Konzept definieren.

Durch die Entwicklung von Wissenschaft und Technologie sind jedoch neuronale Netze entstanden, und neuronale Netze sind am besten darin, Muster zu entdecken und Mehrdeutigkeiten zu akzeptieren.

Ein neuronales Netzwerk ist eine relativ einfache Gleichung, die eine Funktion lernt, um für alles, was in das System eingegeben wird, eine angemessene Ausgabe bereitzustellen.

Um beispielsweise ein Netzwerk mit zwei Klassifizierungen zu trainieren, geben Sie eine große Menge an Beispieldaten (hier als Beispiel einen Stuhl) in das neuronale Netzwerk ein, trainieren Sie es für mehrere Epochen und lassen Sie das Netzwerk schließlich zu erfolgreich ableiten, ob das Bild einen Stuhl zeigt.

Um es ganz klar auszudrücken: Hier geht es nicht nur um künstliche Intelligenz, sondern vielmehr darum, was Intelligenz ist und wie das menschliche Gehirn funktioniert. „

Diese neuronalen Netze können genau deshalb trainiert werden, weil die Funktion, die sie implementiert, differenzierbar ist. Mit anderen Worten: Wenn symbolische KI den in der symbolischen Logik verwendeten diskreten Token ähnelt, dann sind neuronale Netze kontinuierliche Funktionen der Infinitesimalrechnung.

Dies ermöglicht Lernen Bessere Darstellungen durch Feinabstimmung der Parameter, was bedeutet, dass die Daten besser angepasst werden können, ohne dass es zu Problemen mit der Unter- oder Überanpassung kommt. Wenn es jedoch um strenge Regeln und diskrete Token geht, schafft diese Fluidität eine neue Mauer: Wenn wir ein Problem lösen Gleichung wollen wir normalerweise die genaue Antwort, keine ungefähre Antwort.

Hier glänzt die symbolische KI, daher schlägt Marcus vor, einfach beides zu kombinieren: ein fest codiertes symbolisches Manipulationsmodul über dem DL-Modul einzufügen.

Das ist attraktiv, weil sich die beiden Ansätze sehr gut ergänzen, sodass es den Anschein hat, als würde ein „Hybrid“ von Modulen mit unterschiedlichen Arbeitsweisen die Vorteile beider Ansätze maximieren.

Aber die Debatte dreht sich darum, ob symbolische Manipulation in ein System eingebaut werden muss, in dem Symbole und Manipulationsfähigkeiten von Menschen entworfen werden und das Modul nicht differenzierbar ist – und daher nicht mit DL kompatibel ist.

Das legendäre „Symbolische Denken“

Diese Hypothese ist sehr umstritten.

Traditionelle neuronale Netze gehen davon aus, dass wir symbolisches Denken nicht manuell durchführen müssen, sondern symbolisches Denken erlernen können, d . Kurz gesagt: Maschinen können lernen, Symbole in der Welt zu manipulieren, allerdings ohne eingebaute handgefertigte Symbole und Symbolmanipulationsregeln.

Zeitgenössische große Sprachmodelle wie GPT-3 und LaMDA zeigen das Potenzial dieses Ansatzes. Ihre Fähigkeit, Symbole zu manipulieren, ist erstaunlich, und diese Modelle zeigen erstaunliches gesundes Denken, kombinatorische Fähigkeiten, Mehrsprachigkeitsfähigkeiten, logische und mathematische Fähigkeiten und sogar die erschreckende Fähigkeit, die Toten zu imitieren.

Aber tatsächlich ist das nicht zuverlässig. Wenn Sie DALL-E bitten würden, eine römische Skulptur eines Philosophen mit Bart, Brille und tropischem Hemd anzufertigen, wäre das hervorragend. Aber wenn man es bittet, einen Beagle zu zeichnen, der ein rosa Spielzeug trägt und ein Eichhörnchen jagt, bekommt man manchmal einen Beagle, der ein rosa Spielzeug trägt, oder ein Eichhörnchen.

Es leistet hervorragende Arbeit, wenn es alle Eigenschaften einem Objekt zuweisen kann, aber es gerät ins Stocken, wenn mehrere Objekte und mehrere Eigenschaften vorhanden sind. Die Haltung vieler Forscher ist, dass dies eine „Mauer“ für DL auf dem Weg zu mehr menschenähnlicher Intelligenz ist.

Muss die symbolische Operation also fest codiert werden?

Das ist nicht Marcus‘ Verständnis.

Er geht davon aus, dass symbolisches Denken alles oder nichts ist – da DALL-E keine Symbole und logischen Regeln als Grundlage für seine Operationen hat, argumentiert es nicht wirklich mit Symbolen. Die zahlreichen Fehlschläge großer Sprachmodelle deuten also darauf hin, dass es sich dabei nicht um echtes Denken, sondern lediglich um eine emotionslose mechanische Nachahmung handelt.

Für Marcus ist es unmöglich, den Mond zu erreichen, indem man auf einen Baum klettert, der groß genug ist. Daher glaubt er, dass das aktuelle DL-Sprachmodell der echten Sprache nicht näher kommt als Nim Chimpsky (ein männlicher Schimpanse, der die amerikanische Gebärdensprache verwenden kann). Das Problem von DALL-E ist nicht mangelnde Ausbildung. Es handelt sich einfach um Systeme, die die zugrunde liegende logische Struktur des Satzes nicht erfasst haben und daher nicht richtig erfassen können, wie die verschiedenen Teile zu einem Ganzen verbunden werden sollten.

Im Gegensatz dazu glauben Geoffrey Hinton und andere, dass neuronale Netze Symbole erfolgreich manipulieren können, ohne dass fest codierte Symbole und algebraische Überlegungen erforderlich sind. Das Ziel von DL ist nicht die symbolische Manipulation innerhalb der Maschine, sondern vielmehr das Erlernen, korrekte Symbole aus Systemen in der Welt zu generieren.

Die Ablehnung einer Vermischung der beiden Modalitäten ist nicht voreilig, sondern basiert vielmehr auf philosophischen Unterschieden in der Frage, ob man glaubt, dass symbolisches Denken erlernt werden kann.

Die zugrunde liegende Logik des menschlichen Denkens

Marcus‘ Kritik an DL hat ihren Ursprung in einer verwandten Debatte in der Kognitionswissenschaft darüber, wie Intelligenz funktioniert und was den Menschen einzigartig macht. Seine Ansichten stehen im Einklang mit einer bekannten „nativistischen“ Denkrichtung in der Psychologie, die davon ausgeht, dass viele Schlüsselmerkmale der Kognition angeboren sind – tatsächlich werden wir größtenteils mit dem Wissen geboren, wie die Welt funktioniert.

Der Kern dieser angeborenen Wahrnehmung ist die Fähigkeit, Symbole zu manipulieren (aber ob dies in der Natur vorkommt oder nur beim Menschen vorkommt, ist noch nicht geklärt). Für Marcus liegt diese Fähigkeit, Symbole zu manipulieren, vielen grundlegenden Merkmalen des gesunden Menschenverstandes zugrunde: Regelbefolgung, Abstraktion, kausales Denken, Neuidentifizierung von Details, Verallgemeinerung und viele andere Fähigkeiten.

Kurz gesagt, ein Großteil unseres Verständnisses der Welt ist von der Natur gegeben und beim Lernen geht es darum, die Details zu bereichern.

Es gibt eine weitere empirische Sichtweise, die die obige Idee widerlegt: Symbolmanipulation kommt in der Natur selten vor und ist hauptsächlich eine erlernte Kommunikationsfähigkeit, die unsere alten menschlichen Vorfahren im Laufe der letzten 2 Millionen Jahre nach und nach erworben haben.

Aus dieser Sicht sind die primären kognitiven Fähigkeiten nicht-symbolische Lernfähigkeiten im Zusammenhang mit verbesserten Überlebensfähigkeiten, wie z. B. der schnellen Identifizierung von Beutetieren, der Vorhersage ihrer wahrscheinlichen Handlungen und der Entwicklung kompetenter Reaktionen.

Diese Ansicht besagt, dass die meisten komplexen kognitiven Fähigkeiten durch allgemeine, selbstüberwachte Lernfähigkeiten erworben werden. Es geht auch davon aus, dass die meisten unserer komplexen kognitiven Fähigkeiten nicht auf symbolischen Operationen beruhen. Stattdessen simulieren sie verschiedene Szenarien und sagen die besten Ergebnisse voraus.

Diese empirische Sichtweise betrachtet Symbole und Symbolmanipulation lediglich als eine weitere erlernte Fähigkeit, die erworben wird, da Menschen zunehmend auf kooperatives Verhalten angewiesen sind, um erfolgreich zu sein. Darin werden Symbole als Erfindungen verstanden, mit denen wir die Zusammenarbeit zwischen Gruppen koordinieren – etwa Wörter, aber auch Karten, ikonische Beschreibungen, Rituale und sogar soziale Rollen.

Der Unterschied zwischen diesen beiden Ansichten ist sehr offensichtlich. Für die nativistische Tradition sind Symbole und Symbolmanipulation von Natur aus im Geist vorhanden, und die Verwendung von Wörtern und Zahlen ergibt sich aus dieser primitiven Fähigkeit. Diese Sichtweise erklärt auf attraktive Weise Fähigkeiten, die sich aus evolutionären Anpassungen ergeben (obwohl Erklärungen, wie oder warum sich Symbolmanipulation entwickelte, umstritten waren).

Aus Sicht der empiristischen Tradition sind Symbole und symbolisches Denken eine nützliche kommunikative Erfindung, die sich aus allgemeinen Lernfähigkeiten und unserer komplexen sozialen Welt ergibt. Dabei werden die symbolischen Dinge, die in unseren Köpfen passieren, wie interne Berechnungen und innere Monologe, als externe Praktiken behandelt, die aus der Mathematik und dem Sprachgebrauch entstehen.

Die Bereiche künstliche Intelligenz und Kognitionswissenschaft sind eng miteinander verflochten, daher ist es keine Überraschung, dass diese Kämpfe hier wieder auftauchen. Da der Erfolg einer der beiden Perspektiven in der künstlichen Intelligenz den einen oder anderen Ansatz in der Kognitionswissenschaft teilweise (aber nur teilweise) rechtfertigen wird, ist es nicht verwunderlich, dass diese Debatten intensiver geworden sind.

Der Schlüssel zum Problem liegt nicht nur darin, wie man die Probleme im Bereich der zeitgenössischen künstlichen Intelligenz richtig löst, sondern auch darin, was Intelligenz ist und wie das Gehirn funktioniert.

Soll ich auf KI setzen oder short gehen?

Warum ist die Aussage „Deep Learning stößt an eine Wand“ so provokativ?

Wenn Marcus Recht hat, wird Deep Learning nie in der Lage sein, eine menschenähnliche KI zu erreichen, egal wie viele neue Architekturen es hervorbringt oder wie viel Rechenleistung es hineinsteckt.

Das weitere Hinzufügen weiterer Ebenen zu neuronalen Netzen wird die Sache nur noch verwirrender machen, da echte Symbolmanipulation einen natürlichen Symbolmanipulator erfordert. Da diese symbolische Operation die Grundlage für mehrere Fähigkeiten des gesunden Menschenverstands ist, wird DL lediglich „nicht um eine gründliche Erklärung“ für irgendetwas bitten.

Wenn dagegen die Befürworter und Empiriker von DL Recht haben, ist die Idee, ein Modul zur Symbolmanipulation einzufügen, rätselhaft.

In diesem Zusammenhang führen Deep-Learning-Systeme bereits symbolisches Denken durch und werden sich durch mehr multimodales selbstüberwachtes Lernen, zunehmend nützliche prädiktive Weltmodelle und die Erweiterung des dafür verwendeten Arbeitsgedächtnisses weiter verbessern Simulations- und Bewertungsergebnisse, um Einschränkungen besser zu erfüllen.

Die Einführung symbolischer Manipulationsmodule wird keine menschlichere KI schaffen. Im Gegenteil, sie wird alle „Denkungsoperationen“ dazu zwingen, einen unnötigen Engpass zu durchlaufen, der uns weiter vom „Menschen“ entfernen wird -ähnliche Intelligenz“. Dies könnte einen der aufregendsten Aspekte des Deep Learning beeinträchtigen: seine Fähigkeit, übermenschliche Lösungen zu finden.

Allerdings rechtfertigt nichts davon den albernen Hype: Da aktuelle Systeme nicht bewusst sind, können sie uns nicht verstehen, Reinforcement Learning reicht nicht aus und man kann nicht nur durch Skalierung aufbauen Menschenähnliche Intelligenz. Aber bei all diesen Themen handelt es sich um „Edge-Themen“: Müssen symbolische Operationen fest codiert werden (oder können sie natürlich nicht erlernt werden)? Die Menschen sollten wählen, was funktioniert.

Allerdings arbeiten Forscher seit den 1980er Jahren an Hybridmodellen, die sich jedoch noch nicht als wirksamer Ansatz erwiesen haben und in vielen Fällen möglicherweise sogar neuronalen Netzen weit unterlegen sind.

Generell ausgedrückt sollte man sich fragen, ob Deep Learning seine Obergrenze erreicht hat.

Das obige ist der detaillierte Inhalt vonDeep Learning stößt an eine Wand? Wer hat das Wespennest zwischen LeCun und Marcus aufgewühlt?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1386

1386

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

Herausgeber | Rettichhaut Seit der Veröffentlichung des leistungsstarken AlphaFold2 im Jahr 2021 verwenden Wissenschaftler Modelle zur Proteinstrukturvorhersage, um verschiedene Proteinstrukturen innerhalb von Zellen zu kartieren, Medikamente zu entdecken und eine „kosmische Karte“ jeder bekannten Proteininteraktion zu zeichnen. Gerade hat Google DeepMind das AlphaFold3-Modell veröffentlicht, das gemeinsame Strukturvorhersagen für Komplexe wie Proteine, Nukleinsäuren, kleine Moleküle, Ionen und modifizierte Reste durchführen kann. Die Genauigkeit von AlphaFold3 wurde im Vergleich zu vielen dedizierten Tools in der Vergangenheit (Protein-Ligand-Interaktion, Protein-Nukleinsäure-Interaktion, Antikörper-Antigen-Vorhersage) deutlich verbessert. Dies zeigt, dass dies innerhalb eines einzigen einheitlichen Deep-Learning-Frameworks möglich ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S