Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

KI schreibt Romane, malt und schneidet Videos. Generative KI ist sogar noch beliebter!

KI schreibt Romane, malt und schneidet Videos. Generative KI ist sogar noch beliebter!

KI schreibt Romane, malt und schneidet Videos. Generative KI ist sogar noch beliebter!

Seit kurzem erfreut sich generative KI wieder großer Beliebtheit! Ein WeChat-Applet namens „Dream Stealer“ wurde sofort ein Hit und erreichte einen Rekord von täglich 50.000 neuen Benutzern.

Dream Stealer ist eine KI-Plattform, die Bilder basierend auf eingegebenem Text generieren kann. Es ist ein Zweig von AIGC (AI-Generated Content).

Nachdem Benutzer ihrer Fantasie freien Lauf gelassen und eine Textbeschreibung eingegeben haben, kann Dream Stealer Bilder in drei Verhältnissen generieren: 1:1, 9:16 und 16:9. Zusätzlich zu den einfachen Ölgemälden stehen außerdem 24 Malstile zur Auswahl Zu den Malkategorien wie Aquarell und Skizze gehören auch spezielle Stile wie Cyberpunk, Vaporwave, Pixel Art, Ghibli und CG-Rendering.

Bild: Der Technology Cloud Report-Editor hat zum Generieren das WeChat-Applet „Dream Stealer“ verwendet

Tatsächlich ist dies nicht die erste KI-Software, die „Text zum Erstellen von Bildern verwendet“. Von Midjourney bis Stable Diffusion war generative KI in den letzten zwei Jahren das heißeste Thema.

Generative KI hat als wichtige Richtung in der Entwicklung von KI großes Entwicklungspotenzial.

Nach Angaben von Gartner im ersten Halbjahr wird erwartet, dass generative KI bis 2025 10 % aller generierten Daten ausmachen wird, verglichen mit derzeit weniger als 1 %.

Manche Menschen glauben, dass 2022 das erste Jahr sein wird, in dem generative KI aus der Technologie reift und in die Grundlagen der Gesellschaft vordringt.

Das explosionsartige Wachstum der generativen KI: von Bildern zu Videos

In den letzten Jahren kann die Entwicklung der KI-Technologie im visuellen Bereich als „rasant“ bezeichnet werden.

Im Januar letzten Jahres veröffentlichte OpenAI, ein Unternehmen, das sich zum Ziel gesetzt hat, „der gesamten Menschheit mit allgemeiner künstlicher Intelligenz zu helfen“, das bahnbrechende DALL-E auf Basis des GPT-3-Modells, das die Generierung von Bildern aus Text realisiert.

Im April dieses Jahres setzte das von OpenAI veröffentlichte DALL-E 2-Modell der zweiten Generation erneut einen neuen Maßstab im Bereich der Bilderzeugung.

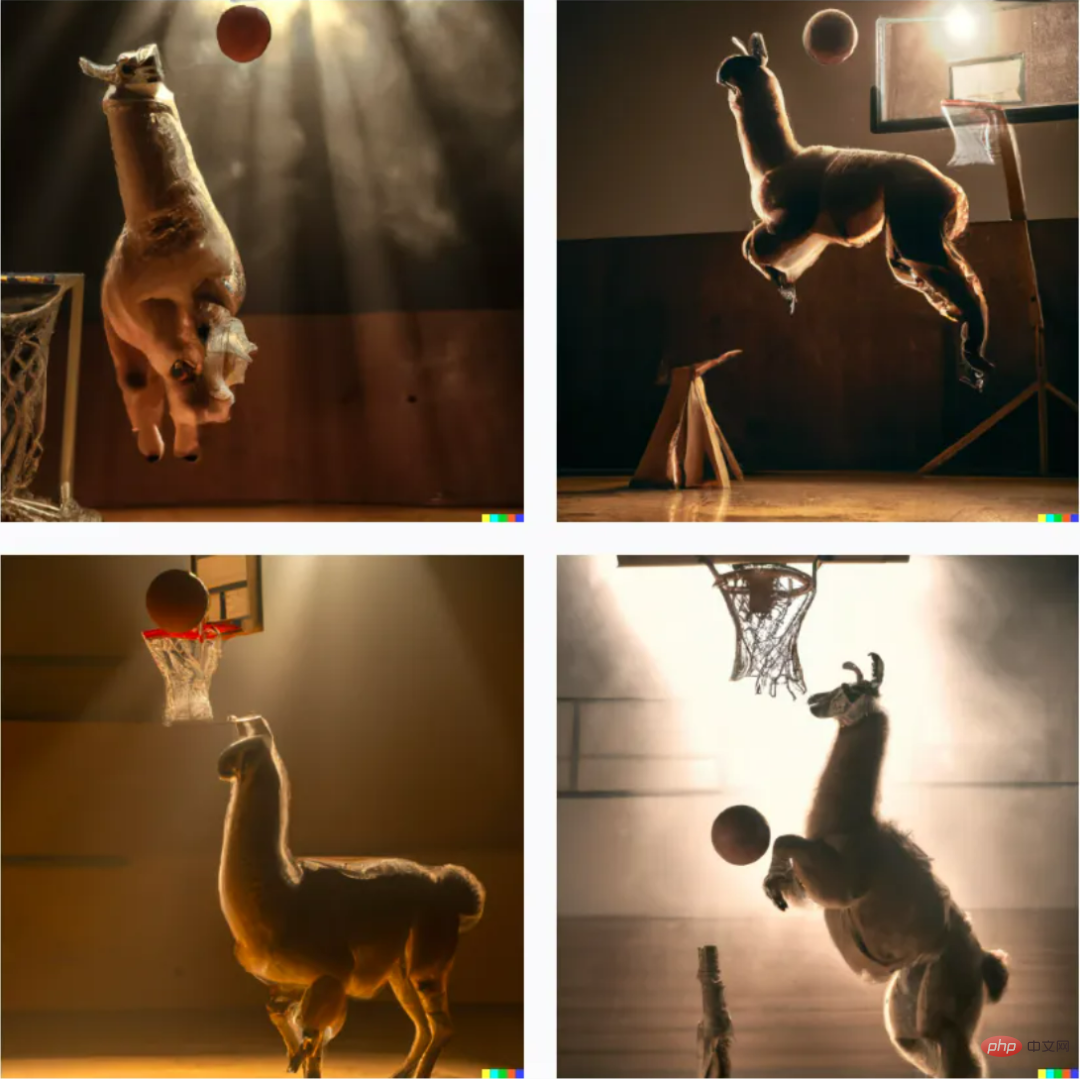

Benutzer können durch kurze Textbeschreibungen (Eingabeaufforderung) entsprechende Bilder generieren, sodass auch Menschen, die nicht zeichnen können, ihre Fantasie in künstlerische Kreationen umsetzen können, wie zum Beispiel die vier Wörter, die durch den Satz „Alpaka spielt Basketball“ generiert werden. Das Bild sieht sehr gut aus im Einklang mit den Erwartungen aller.

Beispiel für ein vom DALL-E 2-Modell generiertes Bild

Da die Granularität der Textbeschreibungen immer weiter verfeinert wird, werden die generierten Bilder nicht nur immer genauer, und der Effekt ist für Nicht-Benutzer bereits ziemlich schockierend. Profis.

Aber Modelle wie DALL-E 2 bleiben immer noch im Bereich der zweidimensionalen Erstellung, also der Bilderzeugung, und können keine 360-Grad-3D-Modelle ohne Sackgassen generieren.

Allerdings kann dies die sehr kreativen Algorithmusforscher nicht aufhalten. Eine der neuesten Errungenschaften der Google-Forschung – das DreamFusion-Modell – kann 3D-Modelle durch die Eingabe einfacher Textaufforderungen generieren Generierte 3D-Modelle verfügen außerdem über Eigenschaften wie Dichte und Farbe, und mehrere generierte 3D-Modelle können sogar in eine Szene integriert werden.

Nach der Generierung von 3D-Bildern erweiterten die Algorithmus-Mitarbeiter von Meta ihre Ideen weiter, stellten höhere Schwierigkeitsgrade in Frage und begannen, die Verwendung von Textaufforderungen zur direkten Generierung von Videos zu erforschen.

Obwohl es sich bei einem Video im Wesentlichen um die Überlagerung einer Reihe von Bildern handelt, ist es im Vergleich zur Generierung von Bildern bei der Verwendung von Text zur Generierung eines Videos nicht nur erforderlich, mehrere Bilder derselben Szene zu generieren, sondern auch die Kontinuität zwischen benachbarten Bildern sicherzustellen. Sex. Da beim Training des Modells nur sehr wenige hochwertige Videodaten verfügbar sind, der Rechenaufwand jedoch sehr groß ist, erhöht sich die Komplexität der Videogenerierungsaufgabe erheblich.

Im September dieses Jahres veröffentlichten Forscher von Meta Make-A-Video, ein hochwertiges Kurzvideo-Generierungsmodell auf Basis künstlicher Intelligenz, das der Videoversion von DALL-E entspricht, die auch den Spitznamen „Made with Mouth“ trägt. Video“, das heißt, Sie können durch Textansagen neue Videoinhalte erstellen. Die Schlüsseltechnologie dahinter stammt auch aus der „Text-Bild“-Synthesetechnologie, die von Bildgeneratoren wie DALL-E verwendet wird.

Nur eine Woche später kündigte Google-CEO Pichai offiziell zwei Modelle an, die Metas Make-A-Video direkt herausfordern würden, nämlich Imagen Video und Phenaki.

Im Vergleich zu Make-A-Video hebt Imagen Video die hochauflösenden Eigenschaften von Videos hervor, kann Videoclips mit einer Auflösung von 1280 * 768 und 24 Bildern pro Sekunde generieren und auch Werke verschiedener künstlerischer Stile verstehen und generieren Die 3D-Struktur des Objekts wird während der Rotationsanzeige nicht verformt;

übernimmt sogar die Fähigkeit von Imagen, Text genau darzustellen, und auf dieser Grundlage können durch einfache Beschreibung verschiedene kreative Animationen generiert werden.

Imagen Video generiert Videobeispiele

Imagen Video generiert Videobeispiele

Und Phenaki kann mehr als 2 Minuten lange Aufnahmen mit niedrigerer Auflösung basierend auf Eingabeaufforderungen von etwa 200 Wörtern generieren und so eine relativ vollständige Geschichte erzählen.

Phenaki-generiertes Videobeispiel

Derzeit gibt es in China viele generative KI-Anwendungen.

Zum Beispiel bietet die Jianying-APP von ByteDance KI-generierte Videofunktionen und kann kostenlos genutzt werden.

Die Bild-zu-Text-Videofunktion ähnelt der von Google. Ersteller können ein paar Schlüsselwörter oder einen kurzen Textabschnitt verwenden, um ein kreatives Kurzvideo zu erstellen.

Clip Screen kann auch Videomaterialien auf der Grundlage von Textbeschreibungen intelligent zuordnen und Videos in Werke mit eher vertikalem Inhalt packen, darunter Finanzen, Geschichte, Geisteswissenschaften und andere Kategorien.

Im Januar 2022 startete NetEase die One-Stop-KI-Musikerstellungsplattform „NetEase Tianyin“, die von Nutzern in Lieder umgewandelte Neujahrsgrüße generiert und in der ersten Jahreshälfte eine professionelle Website-Version auf den Markt brachte.

Im September 2021 wurde die Caiyun Xiaomeng APP gestartet, mit der verschiedene Texttypen erstellt werden können. Benutzer müssen nur einen Anfang von 1-1000 Wörtern angeben, und Caiyun Xiaomeng kann mit dem Schreiben der folgenden Geschichte fortfahren.

Tatsächlich gibt es viele Formen der KI-Erstellung. Wenn generative KI-Technologie auf das Schreiben angewendet wird, können maschinelle Versionen von Journalisten, Romanautoren, Dichtern, Drehbuchautoren usw. entstehen. Wenn sie auf die Bereiche Malerei, Musik und Tanz angewendet wird, kann sie Maler, Komponisten und Redakteure „kultivieren“. . Tanzpersonal.

Hinter der Explosion der generativen KI

Im vergangenen Jahr hat sich die generative KI noch besser entwickelt. Softwareriesen im KI-Bereich wie Google, Microsoft und Meta haben diese Technologie intern vorangetrieben und generative KI in ihre Produkte integriert.

Warum ist generative KI plötzlich so beliebt?

Tatsächlich entwickelt sich die generative KI-Technologie rasant, war jedoch aufgrund zu hoher technischer Schwellenwerte bisher auf einen kleinen Kreis in der Technologiebranche beschränkt.

Wenn wir auf die Entwicklungsgeschichte der KI-Technologie zurückblicken, werden wir feststellen, dass die Explosion generativer KI untrennbar mit drei Faktoren verbunden ist: bessere Modelle, mehr Daten und mehr Berechnungen.

Vor 2015 galten kleine Modelle als „modernste Technologie“ zum Verstehen von Sprache. Diese kleinen Modelle eignen sich hervorragend für analytische Aufgaben und werden für Aufgaben eingesetzt, die von der Vorhersage von Lieferzeiten bis zur Betrugsklassifizierung reichen.

Allerdings sind sie für allgemeine Generierungsaufgaben nicht ausdrucksstark genug. Das Generieren von Texten oder Codes auf menschlicher Ebene ist immer noch ein Traum.

Im Jahr 2017 veröffentlichte Google Research ein bahnbrechendes Papier (Attention is All You Need), in dem eine neue neuronale Netzwerkarchitektur für das Verständnis natürlicher Sprache beschrieben wird, sogenannte Transformatoren, die qualitativ hochwertige Sprachmodelle generieren kann und gleichzeitig über eine höhere Qualität verfügt Parallelisierbarkeit und die erforderliche Trainingszeit werden ebenfalls stark reduziert.

Wenn die Modelle größer werden, zeigen sie natürlich übermenschliche Leistungen. Der Rechenaufwand für das Training dieser Modelle stieg von 2015 bis 2020 um sechs Größenordnungen, wobei die Ergebnisse die Benchmarks für die menschliche Leistung in den Bereichen Handschrift, Sprach- und Bilderkennung, Leseverständnis und Sprachverständnis übertrafen.

Unter ihnen sticht GPT-3 von OpenAI hervor. Die Leistung dieses Modells hat einen großen Sprung gegenüber GPT-2 gemacht und zeigt bessere Fähigkeiten von der Codegenerierung bis zum Schreiben von Witzen.

Trotz aller Fortschritte in Grundlagenforschungsbereichen sind diese Modelle nicht universell.

Sie sind groß, schwierig auszuführen (erfordert GPU-Koordination), nicht allgemein verfügbar (nicht verfügbar oder nur in der geschlossenen Betaphase) und teuer in der Nutzung als Cloud-Dienst.

Aber trotz dieser Einschränkungen kamen die ersten generativen KI-Anwendungen auf den Markt.

Da die Datenverarbeitung immer billiger wurde, entwickelte die Industrie weiterhin bessere Algorithmen und größere Modelle.

Die Entwicklerberechtigungen wurden von der Closed Beta auf die Open Beta oder in einigen Fällen auf Open Source erweitert.

Jetzt, da die Plattformschicht solide ist, die Modelle immer besser, schneller und billiger werden und der Zugang zu Modellen tendenziell kostenlos und Open Source ist, ist die KI-Anwendungsschicht reif für eine Explosion der Kreativität.

Im August dieses Jahres wurde beispielsweise das Text-Bild-Generierungsmodell Stable Diffusion als Open-Source-Lösung veröffentlicht. Nachfolger können dieses Open-Source-Tool besser nutzen, um eine umfassendere Inhaltsökologie zu erschließen, die eine entscheidende Rolle dabei spielt, es einem breiteren Spektrum bekannt zu machen der C-End-Benutzer eine wichtige Rolle.

Die Popularität von Stable Diffusion liegt im Wesentlichen darin, dass Open Source Kreativität freisetzt.

Generative KI steht vor echten Herausforderungen

Die Risikokapitalinstitution Sequoia Capital erwähnte in einem Blogbeitrag auf ihrer offiziellen Website: „Generative KIhat das Potenzial, einen wirtschaftlichen Wert in Billionenhöhe zu generieren.

“ Laut Sequoia Capital Generative KI kann jede Branche verändern, in der Menschen Originalwerke schaffen müssen, von Spielen über Werbung bis hin zum Recht.

Insbesondere sind die Anwendungsszenarien der generativen KI in der Zukunft sehr breit gefächert. Neben Branchen für die Produktion von Inhalten wie Kulturschaffen und Nachrichten bietet generative KI vielfältige Anwendungsmöglichkeiten in vielen Branchen wie dem Gesundheitswesen, dem digitalen Handel, der Fertigung usw Anwendungsaussichten in der Landwirtschaft, z. B. Unterstützung bei der Erkennung von Läsionen bei Röntgen-, CT- und anderen Gerätescans, Erstellung digitaler Produktzwillinge, Unterstützung bei der Prüfung der Produktqualität usw.

Es gibt auch reichlich Anwendungsraum für beliebte Technologien wie XR, digitale Zwillinge und autonome Fahrzeuge.

Aber es ist erwähnenswert, dass es in der aktuellen generativen KI noch viele Probleme gibt, die gelöst werden müssen.

Im Unterhaltungsbereich beispielsweise ist einer der Gründe, warum viele Menschen generative KI für die Erstellung nutzen, die Vermeidung von Urheberrechtsproblemen. Dies bedeutet jedoch nicht, dass keine versteckten Gefahren bestehen.

Einerseits kombiniert die KI-Erstellung auch die gelernten Daten entsprechend den Anforderungen neu. Obwohl die Granularität immer feiner wird, ist es unvermeidlich, dass einige scharfsichtige Menschen erkennen, auf welche Werke verwiesen werden kann, und einige Internetnutzer sogar Auf der sozialen Plattform hieß es, dass auf einem KI-generierten Bild vage Spuren einer vermuteten Unterschrift zu erkennen seien.

Andererseits beanspruchen die meisten Plattformen der aktuellen KI-Generation kein Urheberrecht oder geben eindeutig an, dass sie kommerzialisiert werden können. Mit der zunehmenden Kommerzialisierung der generativen KI stellt sich jedoch die Frage, ob ein solches Urheberrechtsumfeld existiert und ob neue Urheberrechtsprobleme auftreten werden entstehen, sind ebenfalls Diskussionsbedarf.

Auch die Logik und Sicherheit der generativen KI müssen verbessert werden. Die derzeitige generative KI ist anfällig für Fehler im gesunden Menschenverstand und auch anfällig für Probleme in Bereichen, die ein Langzeitgedächtnis erfordern.

Zum Beispiel kommt es im Prozess von KI-generierten Romanen aufgrund der langen Länge oft zu Inkonsistenzen.

Auch wenn generative KI bereits in vielen Bereichen eingesetzt werden kann, ist daher, um generative KI wirklich zum Einsatz zu bringen, viel Training erforderlich, um größere Verluste durch KI-„Fehler“ zu vermeiden.

Schließlich gibt es in Anwendungsszenarien wie Medizin und Fertigung nicht den gleichen Spielraum für Versuch und Irrtum wie in der Kultur- und Kreativbranche.

Fazit

Obwohl generative KI derzeit untrennbar mit menschlichen Eingriffen verbunden ist, lässt sich nicht leugnen, dass generative KI immer noch großes Entwicklungspotenzial hat.

Das Aufkommen generativer KI bedeutet, dass KI beginnt, eine neue Rolle in realen Inhalten einzunehmen, von „Beobachtung und Vorhersage“ bis hin zu „direkter Generierung und Entscheidungsfindung“. Mit anderen Worten: Generative KI schafft, nicht nur analysiert.

Wie OpenAI-CEO Sam Altman sagte: „Generative KI erinnert uns daran, dass es schwierig ist, Vorhersagen über künstliche Intelligenz zu treffen.

Vor zehn Jahren war die gängige Meinung, dass künstliche Intelligenz zunächst die manuelle Arbeit beeinflussen würde; dann ist kognitive Arbeit; vielleicht kann es eines Tages kreative Arbeit leisten

Das obige ist der detaillierte Inhalt vonKI schreibt Romane, malt und schneidet Videos. Generative KI ist sogar noch beliebter!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht