Ärger machen!

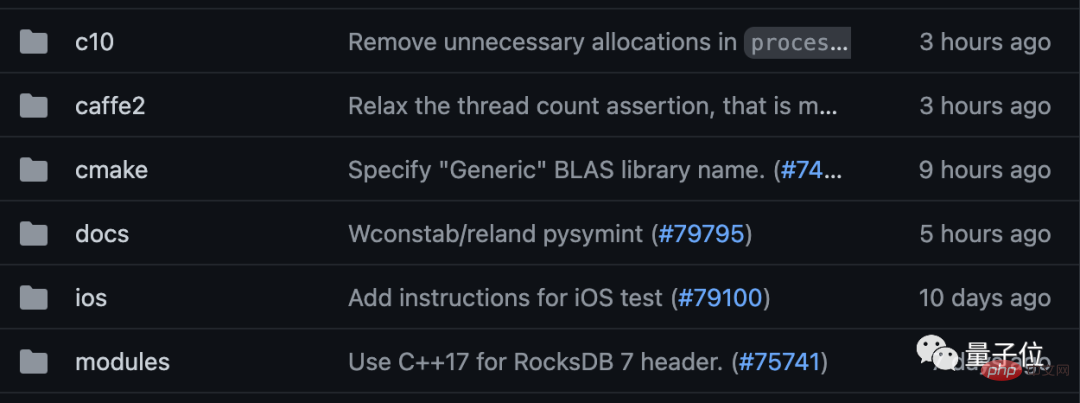

KI „schaute“ sich an, wie Menschen Updates (Commits) auf GitHub einreichen, und ahmte dann menschliche Programmierer nach, um den Code zu modifizieren …

Am Ende „trainierte“ diese KI auch erfolgreich einen intelligenten Roboter:

Kein Scherz, so etwas Schreckliches passierte tatsächlich in einer kürzlich von OpenAI veröffentlichten Studie...

Ursprünglich wollten die Forscher ein Problem der genetischen Programmierung (GP) lösen – einen intelligenten Roboter lernen lassen, sich zu bewegen .

(GP ist ein Spezialgebiet im Evolutionary Computing. Es zielt hauptsächlich darauf ab, automatisch Programme zu erstellen, um Probleme unabhängig zu lösen.)

Aber OpenAI hat einen anderen Ansatz gewählt und ein eigenes groß angelegtes Sprachmodell (LLM) eingeführt. Das Ergebnis ist ein großes „nie erwartet“.

In der Vergangenheit mussten menschliche Forscher im Prozess der Entwicklung intelligenter Agenten an einigen detaillierten Anpassungen teilnehmen und die Richtung der Evolution bestimmen, damit sich der intelligente Agent in eine gute Richtung entwickeln konnte.

Alle diese Aufgaben werden jetzt vom großen Modell erledigt. Sie können lernen, Code schreiben und sich selbst „beibringen“:

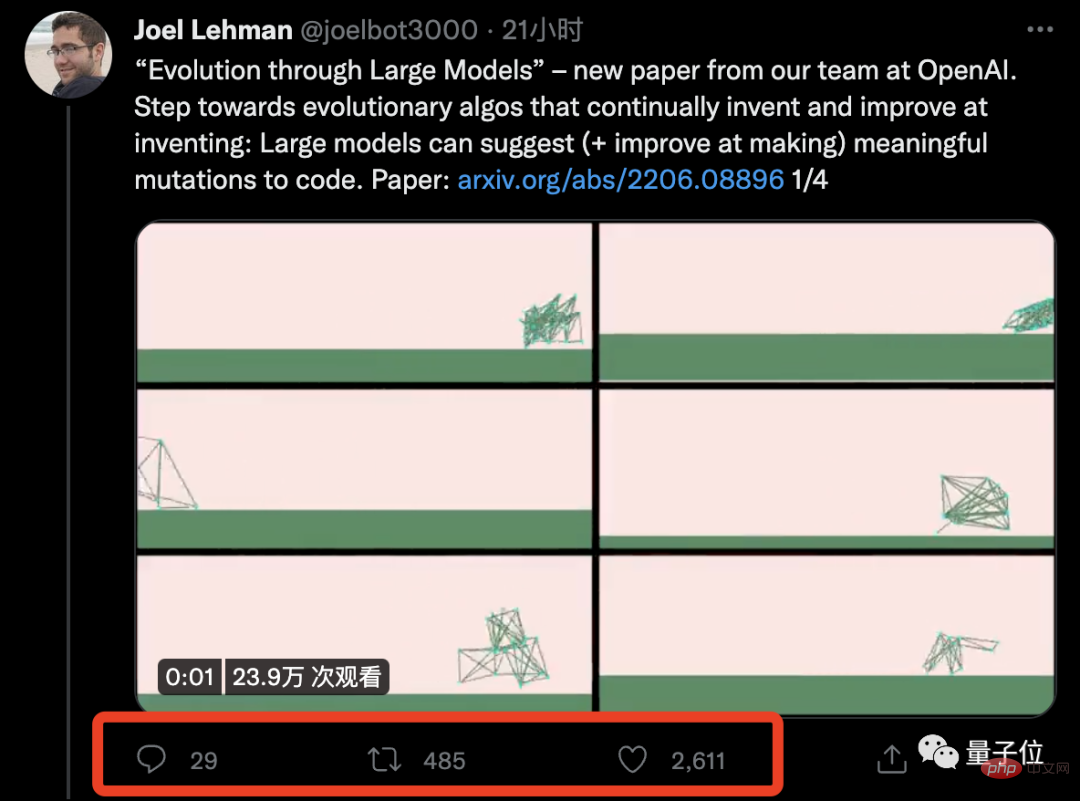

Der erste Autor des Artikels, Joel Lehman, hat diese Angelegenheit aufgedeckt Im Internet erregte es bei Internetnutzern sofort große Aufmerksamkeit:

Ein Programmierer-Internetnutzer sagte, nachdem er es gelesen hatte, dass er „mit dem Tempo der (technologischen) Entwicklung nicht mithalten kann“:

Sogar OpenAI selbst sagte in der Forschung:

Überbrückung der Lücke zwischen evolutionären Algorithmen, die auf der Ebene des menschlichen Geistes arbeiten.

Wie hat die KI dieses „magische“ Ding erreicht?

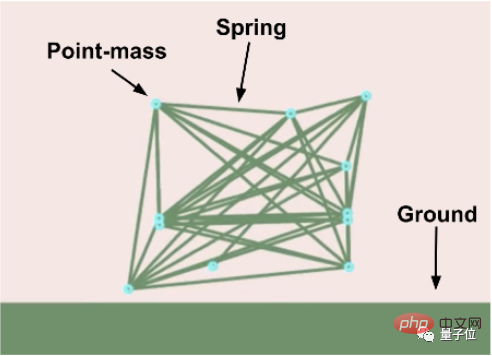

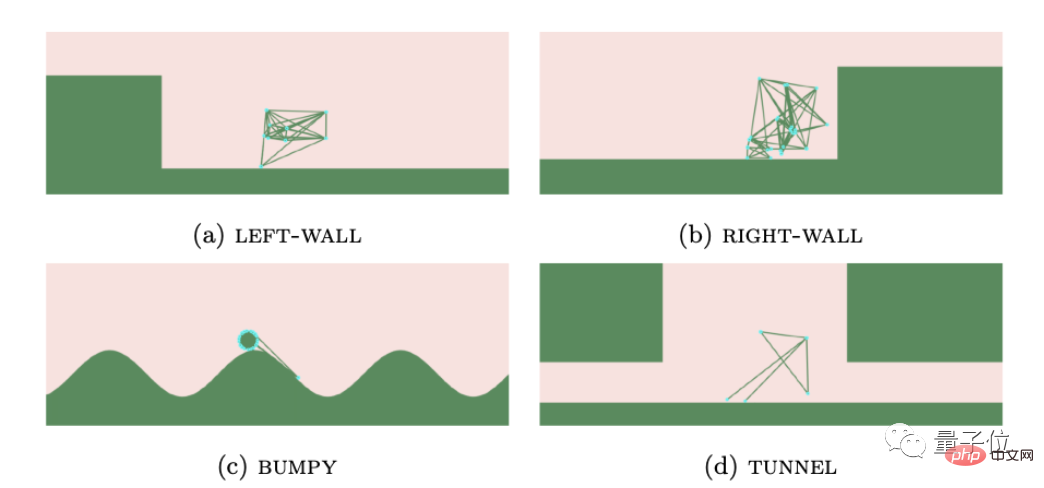

Das Entwerfen mobiler Roboter in einer virtuellen Umgebung ist ein sehr beliebtes Projekt in der genetischen Algorithmenforschung.

Besonders der Sodarace-Wettbewerb erfreut sich großer Beliebtheit, da er weniger Berechnungen erfordert und der Ablauf gut visualisiert werden kann.

Die Regeln sind einfach, Roboter, die aus „Gelenken“ und „Muskeln“ bestehen, rasen auf verschiedenen Terrains.

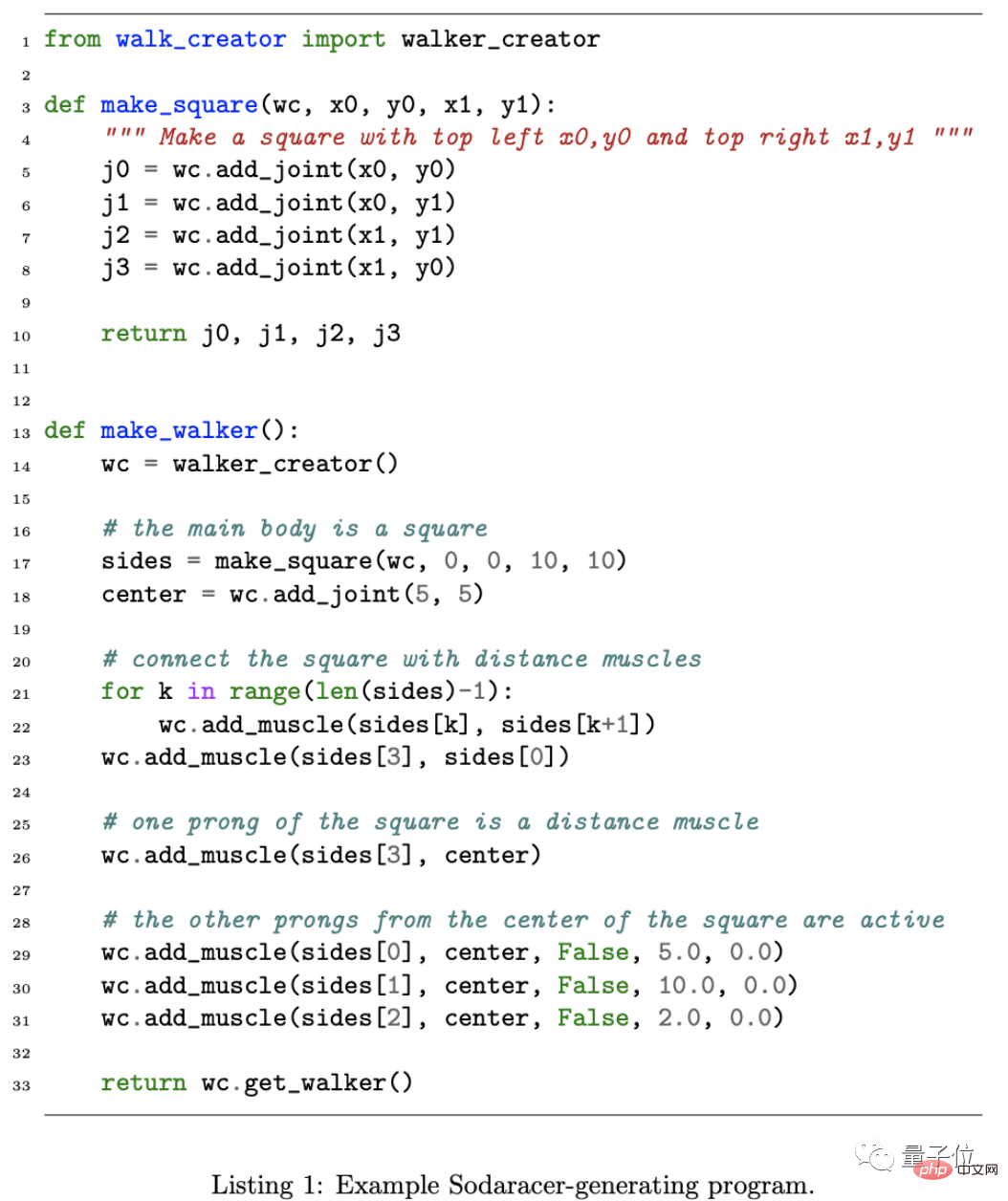

OpenAI hat außerdem bewusst das gesamte Wettbewerbsprogramm von der dedizierten genetischen Codierung auf eine Python-Version umgeschrieben, um die Vielseitigkeit der neuen Methode für moderne Programmiersprachen zu demonstrieren.

Dieser Teil des Python-Codes kann beispielsweise als erster Seed-Roboter verwendet werden.

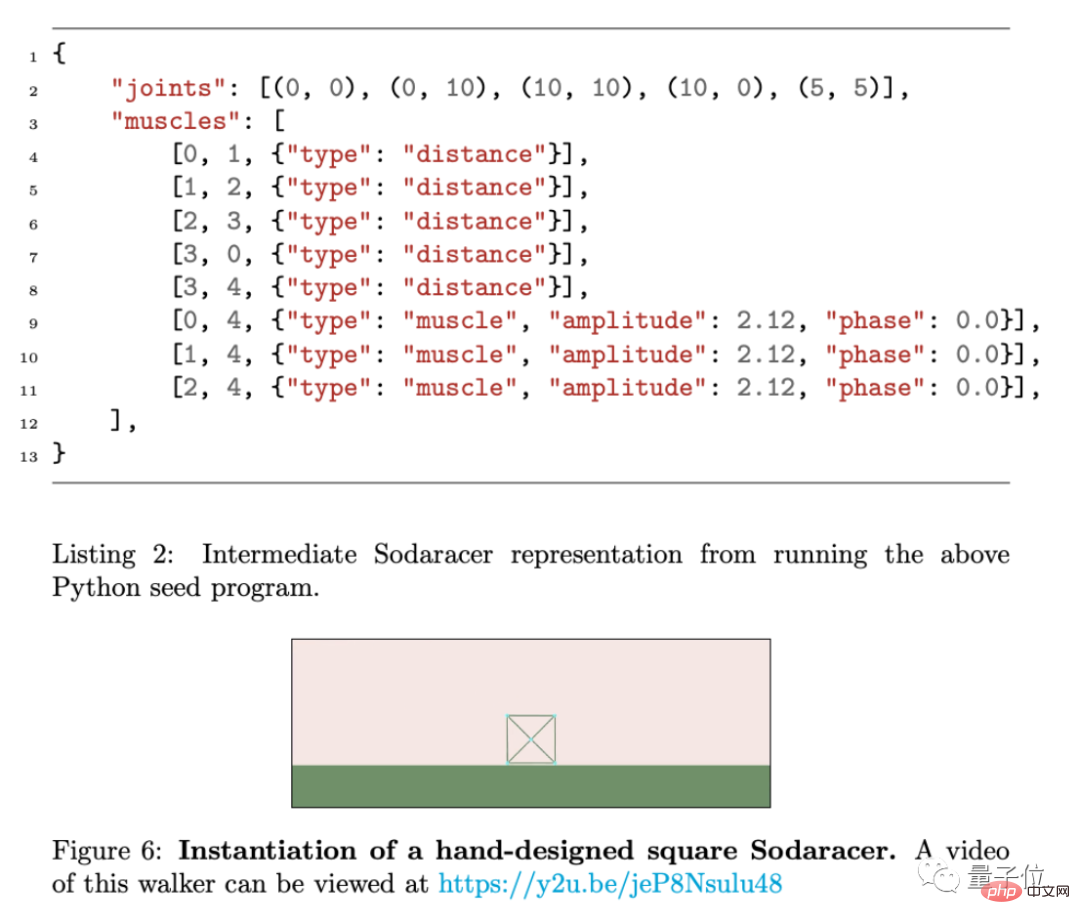

Nachdem man die vier Eck- und Endverbindungen eines Quadrats definiert und diese mit „Muskeln“ verbunden hat, sieht das Ergebnis wie folgt aus.

Eine solche quadratische Struktur kann sich jedoch überhaupt nicht bewegen. Als nächstes muss der Code durch einen genetischen Algorithmus geändert werden.

Das Forschungsteam ist davon überzeugt, dass es immer noch zwei Effizienzlücken zwischen der Verwendung traditioneller genetischer Algorithmen zur Änderung von Code und der Verwendung durch menschliche Programmierer, die dies selbst tun, gibt:

Einer besteht darin, dass Software immer komplexer wird und Menschen die modulare Code-Wiederverwendung nutzen können Dies können die fortschrittlichsten genetischen Algorithmen in den von Menschen verwendeten Programmiersprachen derzeit nicht bewältigen.

Das andere ist, dass fast alle genetischen Algorithmen auf zufälligen Mutationen basieren und jedes Mal, wenn menschliche Programmierer den Code ändern, sie einen Zweck verfolgen, entweder um Funktionalität hinzuzufügen, die Effizienz zu verbessern oder Fehler zu beheben.

Gibt es also eine Möglichkeit für die KI zu lernen, wie Menschen Code ändern?

Ja, die erforderlichen Trainingsdaten sind alle auf GitHub gespeichert.

Ausgezeichnete Programmierer schreiben jedes Mal, wenn sie Code einreichen, eine Commit-Beschreibung, in der klar erläutert wird, was in dieser Übermittlung geändert wurde.

Die Commit-Beschreibung in Kombination mit den Diff-Daten, die den Code vor und nach der Übermittlung vergleichen, ist ein hervorragendes Lernmaterial für KI.

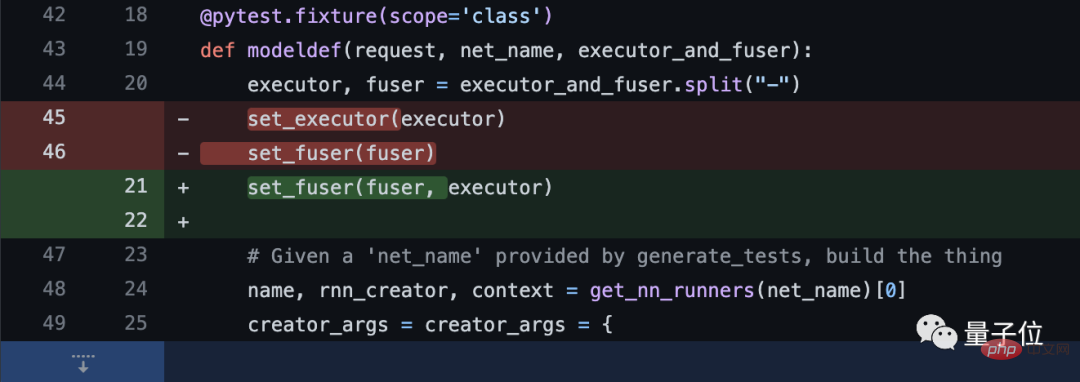

Die Forscher haben einige eingereichte Daten mit klaren Beschreibungen und kleinen Mengen modifizierten Codes herausgesucht, um ein KI-Modell mit GPT-3-Architektur zu trainieren.

Es ist gleichbedeutend damit, die KI von menschlichen Programmierern lernen zu lassen, wie man einen Code gezielt ändert.

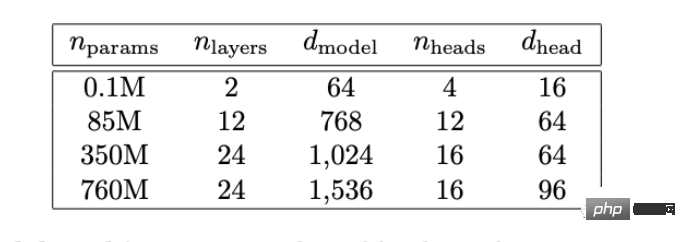

Das in diesem Artikel verwendete Modell muss nicht so groß sein wie die 175 Milliarden Parameter der Vollversion von GPT-3, und maximal 750 Millionen Parameter reichen aus.

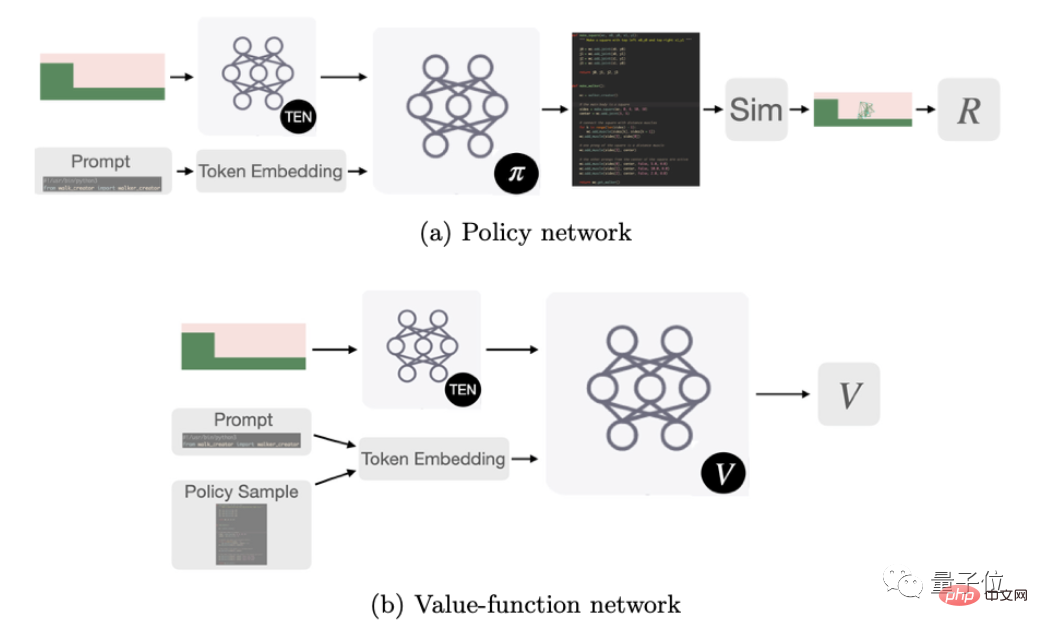

Auf diese Weise wird das grundlegende KI-Modell erhalten, das die Rolle des Mutationsoperators im genetischen Algorithmus spielt.

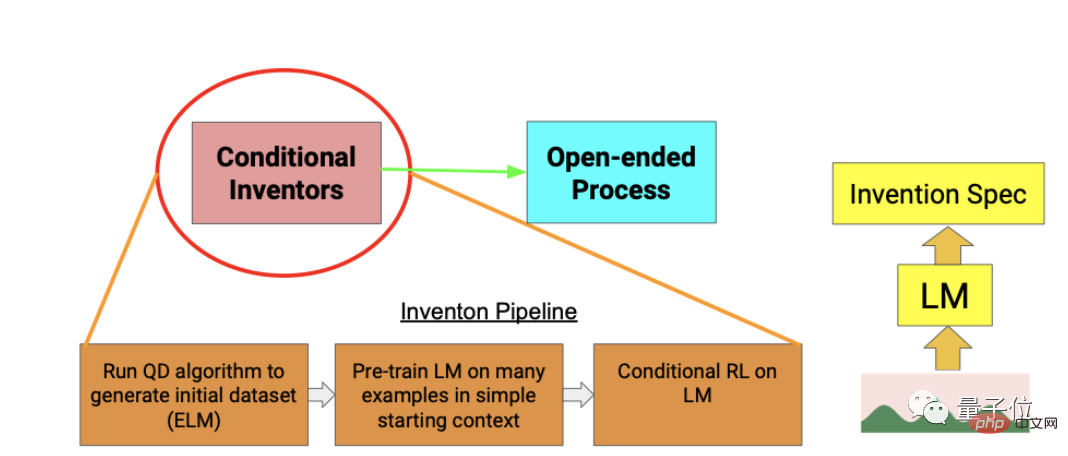

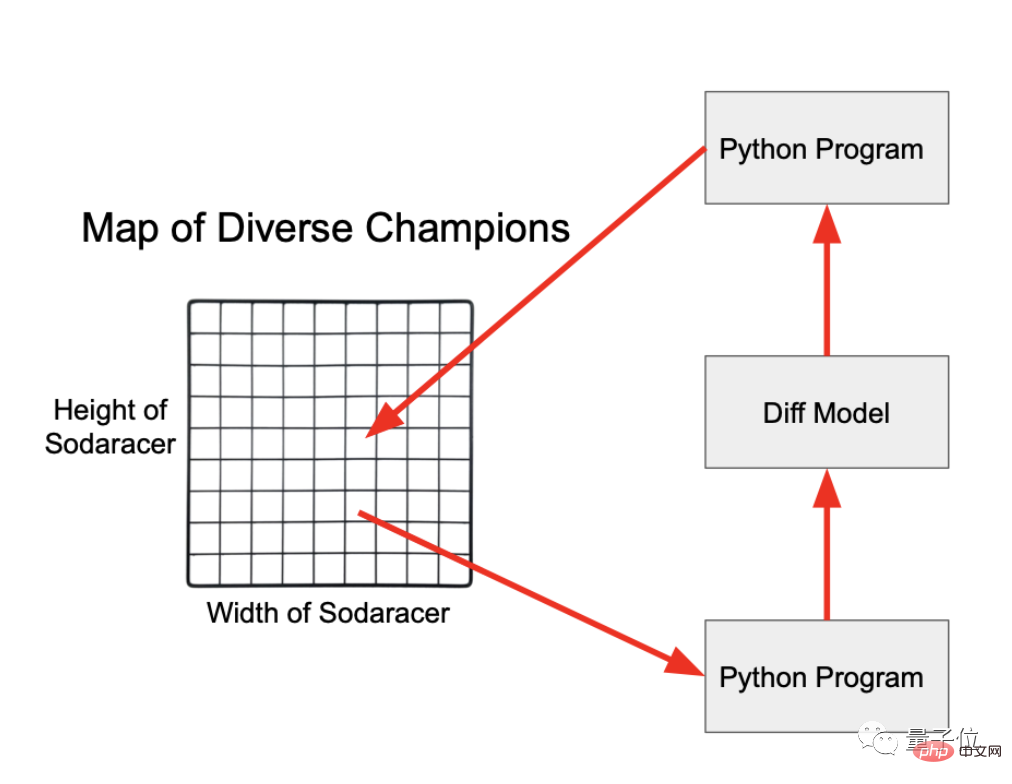

Der nächste Prozess, bei dem KI einen neuen Roboter entwerfen lässt, ist in drei Schritte unterteilt.

Im ersten Schritt verwenden Sie den klassischen MAP-Elites-Algorithmus, um einen ersten Satz Roboter zu generieren.

Dies ist ein QD-Algorithmus (Quality Diversity), der sicherstellt, dass sich Roboter unterschiedlich verhalten und alle von hoher Qualität sind.

Der zweite Schritt besteht darin, die im ersten Schritt generierten Ausgangsdaten für das Vortraining zu verwenden, damit die KI zunächst lernen kann, Roboter innerhalb der Trainingsdatenverteilung zu entwerfen.

Das ist das animierte Bild am Anfang, das alle im Internet in Erstaunen versetzte und zeigt, wie KI einen unbeweglichen „Block“ Schritt für Schritt in einen mobilen Roboter mit abwechselnden Beinen verwandelt.

Der dritte Schritt, kombiniert mit dem Reinforcement-Learning-Algorithmus zur Feinabstimmung, ermöglicht es der KI, Roboter zu generieren, die sich je nach Geländebedingungen an die Umgebung anpassen können.

Schließlich wählten die Forscher aus den ersten drei Samen entwickelte Roboter aus, um die Wirkung zu demonstrieren.

Man erkennt, dass ihr Aufbau und ihre Bewegungsabläufe völlig unterschiedlich sind.

Sobald diese Forschung angekündigt wurde, kann man sagen, dass sie mit einer Klappe Tausende von Wellen verursacht hat.

Viele Internetnutzer staunten über diese neuartige Art der Kombination von „großem Modell + evolutionärem Algorithmus“:

Forscher, die verwandte Arbeiten durchgeführt haben, sagten auch, dass sie nie gedacht hätten, dass große Modelle in Form von Diffs verwendet werden könnten. Lasst uns mehr darüber erfahren Mutationen:

Neben der Diskussion über die Forschungsform und sich selbst haben einige Internetnutzer auch Bilder wie dieses gepostet:

Emmm... Es ist ein bisschen so.

Die Teammitglieder dieser Forschung stammen alle von OpenAI.

Der Erstautor des Artikels ist Joel Lehman, ein Wissenschaftler für maschinelles Lernen. Zu den Schwerpunkten zählen Sicherheit durch künstliche Intelligenz, Reinforcement Learning und offene Suchalgorithmen.

Zur gleichen Zeit war Joel Lehman zuvor Mitautor eines wissenschaftlichen Buches „Why Greatness Can't Be Planned: The Secret of Objectiveness“, das auf seinen Gedanken zur Entwicklung der künstlichen Intelligenz basiert:

Was den nächsten Schritt betrifft In dieser Forschung sagte Joel Lehman selbst:

Eine weitere wichtige Frage ist, inwieweit das Modell auf andere Umgebungen angewendet werden kann.

Die Wirksamkeit von Mutationen bei GP kann jetzt durch ELM erheblich verbessert werden, was eine Vielzahl neuer Anwendungen und Forschungsrichtungen inspirieren wird.

Hat Ihnen diese Forschung neue Inspiration gegeben?

Referenzlinks:

[1]https://arxiv.org/abs/2206.08896

[2]https://twitter.com/joelbot3000/status/1538770905119150080?s=21&t=l8AASYjgC6RAEEimcQa Nebel

Das obige ist der detaillierte Inhalt vonKI schreibt ihren eigenen Code, damit sich der Agent weiterentwickeln kann! Das große Modell von OpenAI schmeckt nach „menschlichem Denken'. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

CSS-Schriftfarbe

CSS-Schriftfarbe

Häufig verwendete Linux-Befehle

Häufig verwendete Linux-Befehle

So implementieren Sie Farbschriftarten in CSS

So implementieren Sie Farbschriftarten in CSS

Rangliste der Kryptowährungs-Handelsplattformen

Rangliste der Kryptowährungs-Handelsplattformen

Was beinhaltet die Datenverschlüsselungsspeicherung?

Was beinhaltet die Datenverschlüsselungsspeicherung?

So deinstallieren Sie phpnow

So deinstallieren Sie phpnow

So generieren Sie eine Bin-Datei mit MDK

So generieren Sie eine Bin-Datei mit MDK

Verwendung des Velocitytrackers

Verwendung des Velocitytrackers

Zusammenfassung der Java-Grundkenntnisse

Zusammenfassung der Java-Grundkenntnisse