Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Forschung zur komplexen Quantifizierungsmethode der Bibliothek erwarteter funktionaler Sicherheitsszenarien

Forschung zur komplexen Quantifizierungsmethode der Bibliothek erwarteter funktionaler Sicherheitsszenarien

Forschung zur komplexen Quantifizierungsmethode der Bibliothek erwarteter funktionaler Sicherheitsszenarien

Basierend auf dem Pegasus-Szenenschichtsystem wird eine quantitative Methode zur Szenenkomplexität vorgeschlagen, um die Qualität von Szenendaten zu bewerten. Diese Methode bestimmt die Determinanten der Elemente auf jeder Ebene, bestimmt die Komplexität der Elemente auf jeder Ebene basierend auf den Determinanten und erhält die Gesamtkomplexität der Szenendaten durch Berechnen der Summe der Komplexität der Elemente auf jeder Ebene. Um das Phänomen der „Überkomplexität“ zu verhindern, werden außerdem die Methoden „Mutter-Kind-Bibliothek“ und „Systemszenario-Wahrscheinlichkeit“ vorgeschlagen. Die Komplexität des Szenenelements wird mit der Auftrittswahrscheinlichkeit des Elements multipliziert Erhalten Sie die korrigierte Komplexität. Die Forschungsergebnisse zeigen, dass mit dieser Methode eine sinnvolle und nutzbare Szenenbibliothek aufgebaut werden kann.

Die Hauptgründe, warum selbstfahrende Autos aufgrund von Sicherheitsproblemen Schaden anrichten, umfassen zwei Aspekte: (1) Gefahren durch elektronische und elektrische Fehler oder Softwaresystemfehler. Aus diesem Grund schlug ISO ISO26262 „Straßenfahrzeuge – Funktionale Sicherheitsnorm“ vor, und China schlug die entsprechende GB/T 34590 „Straßenfahrzeuge – Funktionale Sicherheitsnorm“ vor. (2) Schäden, die durch unzureichende Systemleistung oder vernünftigerweise vorhersehbaren menschlichen Missbrauch verursacht werden. Aus diesem Grund hat die ISO den ISO/PAS 21448 Safety of the Intended Functionality vorgeschlagen, der als SOTIF-Standard bezeichnet wird.

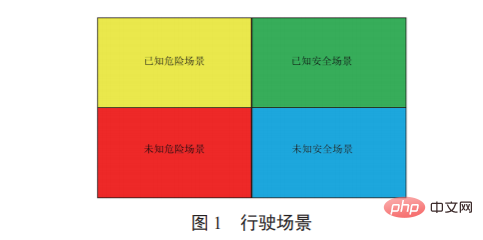

Der SOTIF-Standard unterteilt die Szenarien, denen autonome Fahrzeuge beim Fahren ausgesetzt sind, in vier Kategorien: bekannte sichere Szenarien, bekannte unsichere Szenarien, unbekannte sichere Szenarien und unbekannte unsichere Szenarios, wie in gezeigt Abbildung 1. Auf bekannte Sicherheitsszenarien und unbekannte Sicherheitsszenarien wird im SOTIF-Standard keine Rücksicht genommen. Für bekannte Gefahrenszenarien schlägt der SOTIF-Standard eine Methodik vor. Der Zweck besteht darin, die Leistung autonomer fahrzeugbezogener Systeme zu verbessern oder den Betriebsbereich verwandter Systeme zu verringern und Tests und Verifizierungen auf der Grundlage der relevanten Szenariobibliothek durchzuführen, dh bekannte gefährliche Szenarien in bekannte sichere Szenarien umzuwandeln.

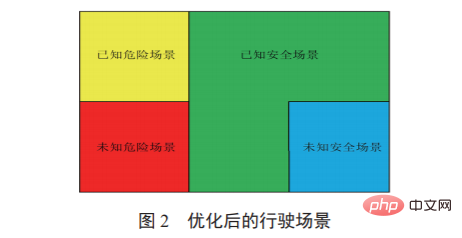

Für unbekannte gefährliche Szenarien kann eine große Anzahl von Experimenten basierend auf der Szenariobibliothek durchgeführt werden, um potenzielle Sicherheitsrisikoszenarien in verwandten, also unbekannten Systemen zu entdecken und zu erkennen gefährliche Szenarien. Konvertieren Sie in ein bekanntes Gefahrenszenario. Basierend auf der oben genannten Methodik werden schließlich die bekannten Gefahrenszenarien in bekannte sichere Szenarien umgewandelt. Kurz gesagt besteht das Ziel des SOTIF-Standards darin, den Bereich bekannter Sicherheits- und unbekannter Sicherheitsszenarien, denen autonome fahrzeugbezogene Systeme beim Betrieb ausgesetzt sind, so weit wie möglich zu erweitern und dadurch den Bereich bekannter Gefahren und unbekannter Gefahrenszenarien so weit wie möglich einzuschränken , wie in Abbildung 2 dargestellt. Um die oben genannten Ziele zu erreichen, ist einer der Schlüsselfaktoren der Aufbau einer hochwertigen Bibliothek erwarteter funktionaler Sicherheitsszenarien.

Derzeit haben sich viele Unternehmen und Organisationen A Bibliothek erwarteter funktionaler Sicherheitsszenarien. Zum Beispiel: Kitti-Szenenbibliothek, NuScenes[6]-Szenenbibliothek, Lyft-Szenenbibliothek für selbstfahrende Autos usw. Die meisten Unternehmen und Organisationen konzentrieren sich während des Erstellungsprozesses der Szenenbibliothek auf die Erfassung von Szenenbibliotheksdaten, es fehlen jedoch vernünftige quantitative Indikatoren für die Qualität der gesammelten Szenendaten.

Dies führt zweifellos zu zwei Problemen:

(1) Die Szenenbibliothek kann eine große Menge enthalten Die Verwendung sich wiederholender und minderwertiger Szenendaten führt dazu, dass die auf der Szenenbibliothek basierende Testzeit zu lang ist und selbst Leistungsmängel autonomer Fahrzeuge nicht erkannt werden können, was die Glaubwürdigkeit der Testergebnisse verringert.

(2) Es ist unmöglich, die Vor- und Nachteile verschiedener Szenenbibliotheken zu vergleichen, was dazu führt, dass die optimalen Szenenbibliotheksdaten für die Szenenbibliothek autonomer Fahrzeuge nicht ausgewählt werden können prüfen. Daher ist es sehr wichtig, eine wissenschaftliche und vernünftige Methode zur Quantifizierung der Qualität der Szenenbibliothek anzuwenden. Je komplexer die Szenendaten sind, desto größer ist die Herausforderung für das relevante System und desto größer ist die Möglichkeit, Leistungsmängel des relevanten Systems zu erkennen. Daher kann davon ausgegangen werden, dass die Komplexität der Szenendaten einer der Schlüsselfaktoren ist, die die Qualität der Szenenbibliothek beeinflussen.

Dieser Artikel schlägt eine Methode zur Quantifizierung der Komplexität von Szenendaten vor. Diese Methode basiert auf dem Szenenebenensystem des deutschen Pegasus-Projekts. Es klassifiziert und zählt die Elemente in der Szene, um die Komplexität der Elemente in den Szenendaten zu berechnen und die Qualität der Szenendaten zu bewerten.

1 Pegasus-Szenenschichtungssystem

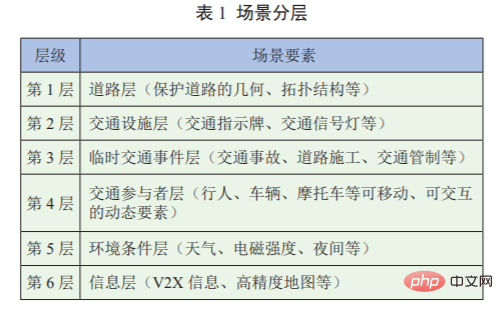

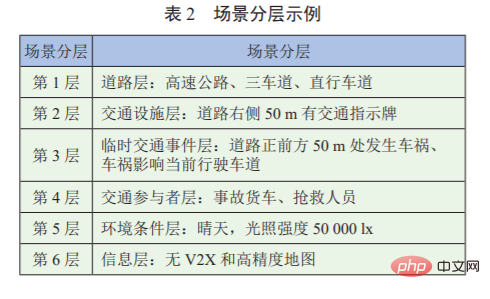

Das Pegasus-Projekt wurde gemeinsam von relevanten Unternehmen und Forschungseinrichtungen der deutschen Automobilindustrie initiiert, um entsprechende Pläne zu formulieren autonome Fahrzeuge im Zusammenhang mit einer Reihe von Teststandards. Dieses Projekt schlägt ein Szenenebenensystem vor, das heißt, die Szene ist entsprechend den verschiedenen Szenenelementen in sechs Szenenebenen unterteilt, siehe Tabelle 1. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜#Szenendaten Wie in Abbildung 3 dargestellt. Basierend auf dem Pegasus-Szenenebenensystem können Szenendaten geschichtet werden, siehe Tabelle 2.

2 Komplexe Quantifizierungsmethode für Szenendaten#🎜🎜 #Das Pegasus-Szenenebenensystem schichtet Szenenelemente. In diesem Artikel werden die Elemente jeder Schicht weiter analysiert und die Komplexität jeder Elementschicht quantifiziert.

Die Komplexität der Straßenschicht wird hauptsächlich durch die Sichtbarkeit der Fahrspurlinien bestimmt, siehe Tabelle 3. Bei freien Fahrspurlinien beträgt die Komplexität 1; blockierte oder abgenutzte Fahrspurlinien beeinträchtigen die Fahrspurlinienerkennung, und die Komplexität beträgt 2; die Ansammlung von Straßenwasser und die Eisbedeckung der Fahrspurlinien beeinträchtigen nicht nur die Fahrspurlinienerkennung, sondern verursachen auch Fahrschwierigkeiten. Bei einer Komplexität von 3 können unregelmäßige Fahrspurlinien zu einer Fehlerkennung der Fahrspurlinien führen, was dazu führt, dass das Fahrzeug in die falsche Richtung fährt. Bei einer Komplexität von 4 können Szenen ohne Fahrspurlinien die Fahrtrichtung des Fahrzeugs beeinträchtigen 5.

Die Komplexität der Transporteinrichtungsschicht wird hauptsächlich durch die Sichtbarkeit der Transporteinrichtungen bestimmt, siehe Tabelle 4. Eine Szene ohne Transportmöglichkeiten hat eine Komplexität von 1; eine Szene mit Transportmöglichkeiten, die zu weit entfernt sind und nicht eindeutig identifiziert werden können, hat eine Komplexität von 3; schmutzig usw. Szenarien, die schwer zu identifizieren sind, haben einen Komplexitätsgrad von 4; unregelmäßige Verkehrseinrichtungen können zu Fehlidentifizierungen führen und zu gefährlichem Verhalten wie dem Überfahren roter Ampeln führen. Der Komplexitätsgrad beträgt 5.

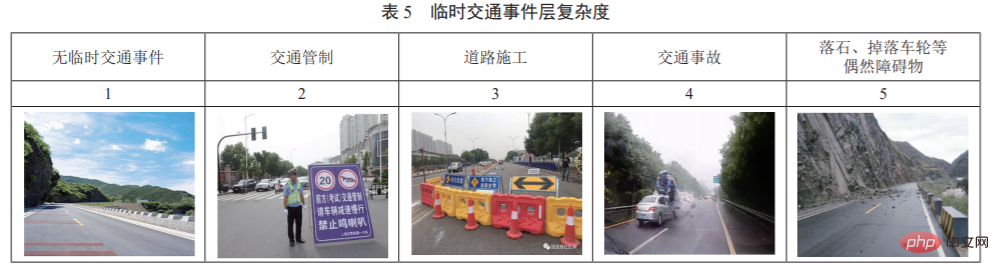

Die Komplexität der temporären Verkehrsstörungsschicht ist hauptsächlich wird durch die Kontingenz und Vorhersehbarkeit des Ereignisses bestimmt, siehe Tabelle 5. Wenn es keine vorübergehenden Verkehrsstörungen gibt, beträgt die Komplexität 1; wenn es vorübergehende Verkehrsstörungen wie die Verkehrskontrolle gibt und es engagiertes Personal gibt, das den Unfallort instandhält, beträgt die Komplexität 2; Im Bauwesen beträgt die Komplexität 3; Verkehrsunfälle usw. Temporäre Verkehrsereignisse, die einen größeren Einfluss auf das Fahren haben, haben eine Komplexität von 4; vorübergehende Verkehrsereignisse, die sehr sporadisch und schwer vorhersehbar sind, wie z Komplexität von 5.

Die Komplexität der Verkehrsteilnehmerschicht wird durch die Gemeinsamkeit und Compliance der Teilnehmer bestimmt, siehe Tabelle 6. Wenn es keine Verkehrsteilnehmer gibt, beträgt die Komplexität 1; wenn die Szene nur Fahrzeuge enthält, beträgt die Komplexität 2, wenn sie gemeinsame Teilnehmer wie Fußgänger und Fahrräder enthält und sich an einem durch Vorschriften festgelegten Ort befindet (z. B. Gehwege, Fahrradwege). usw.), die Komplexität beträgt 3; enthält gemeinsame Teilnehmer wie Fußgänger und Fahrräder und befindet sich nicht an einer durch Vorschriften festgelegten Position (Fußgänger, die die Straße überqueren, Fahrräder, die auf Kraftfahrzeugspuren fahren usw.), ihre Komplexität beträgt 4; Ungewöhnliche Verkehrsteilnehmer (z. B. Lastwagen, die Elefanten schleppen), Fußgänger auf Pferden usw.), seine Komplexität beträgt 5.

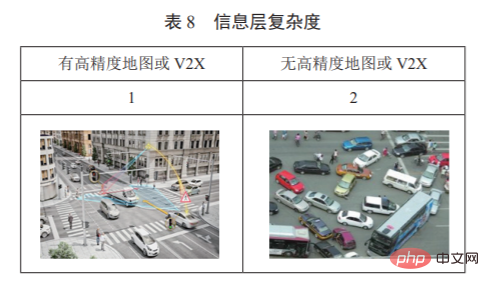

Die Komplexität der Informationsschicht wird hauptsächlich dadurch bestimmt, ob Verkehrsinformationen vorhanden sind, siehe Tabelle 8. Wenn eine hochpräzise Karte vorhanden ist oder V2X Verkehrsinformationen bereitstellt, beträgt die Komplexität 1; wenn keine hochpräzise Karte vorhanden ist oder V2X Verkehrsinformationen bereitstellt, beträgt die Komplexität 2.

Die Komplexität der Informationsschicht wird hauptsächlich dadurch bestimmt, ob Verkehrsinformationen vorhanden sind, siehe Tabelle 8. Wenn eine hochpräzise Karte vorhanden ist oder V2X Verkehrsinformationen bereitstellt, beträgt die Komplexität 1; wenn keine hochpräzise Karte vorhanden ist oder V2X Verkehrsinformationen bereitstellt, beträgt die Komplexität 2.

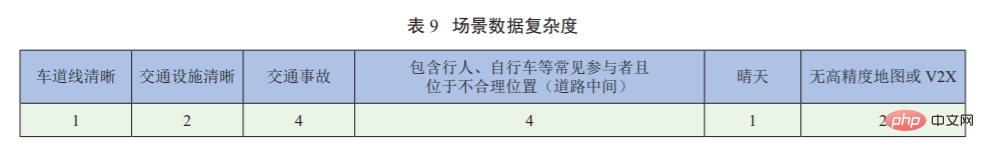

Durch die obige Schichtungsmethode und die Komplexitätsquantifizierungsmethode jeder Schicht kann die Komplexität einzelner Szenendaten berechnet werden, dh die Summe der Komplexität von jede Schicht. Beispiel: Die Szenendaten in Abbildung 3 haben eine Komplexität von 18 (die Komplexität jeder Ebene finden Sie in Tabelle 9). Die Komplexität wird addiert und durch die Gesamtzahl der Szenendaten in der Szenenbibliothek dividiert, um die Komplexität der gesamten Szenenbibliothek zu erhalten. Die Qualität verschiedener Szenenbibliotheken kann anhand der Komplexität der Szenenbibliothek verglichen werden.

Durch die obige Schichtungsmethode und die Komplexitätsquantifizierungsmethode jeder Schicht kann die Komplexität einzelner Szenendaten berechnet werden, dh die Summe der Komplexität von jede Schicht. Beispiel: Die Szenendaten in Abbildung 3 haben eine Komplexität von 18 (die Komplexität jeder Ebene finden Sie in Tabelle 9). Die Komplexität wird addiert und durch die Gesamtzahl der Szenendaten in der Szenenbibliothek dividiert, um die Komplexität der gesamten Szenenbibliothek zu erhalten. Die Qualität verschiedener Szenenbibliotheken kann anhand der Komplexität der Szenenbibliothek verglichen werden.

Es ist zu beachten, dass die obige Komplexitätstabelle für jede Ebene aus Platzgründen nicht alle Elemente auflistet und abdeckt. Für Elemente, die nicht aufgelistet oder abgedeckt sind, sollte ihre Komplexität auf der Grundlage der Faktoren bestimmt werden, die die Komplexität der Ebene bestimmen, auf der sie sich befinden. Beispiel: Die Determinante der Komplexität der Schicht „Umgebungsbedingungen“ ist die Sichtbarkeit. Für neblige Tage mit niedrigeren Konzentrationen, die nicht aufgeführt sind, entspricht die Sichtbarkeit der Sichtbarkeit von Umgebungslichtern bei Nacht, sodass die Komplexität 3 beträgt.

Es ist zu beachten, dass die obige Komplexitätstabelle für jede Ebene aus Platzgründen nicht alle Elemente auflistet und abdeckt. Für Elemente, die nicht aufgelistet oder abgedeckt sind, sollte ihre Komplexität auf der Grundlage der Faktoren bestimmt werden, die die Komplexität der Ebene bestimmen, auf der sie sich befinden. Beispiel: Die Determinante der Komplexität der Schicht „Umgebungsbedingungen“ ist die Sichtbarkeit. Für neblige Tage mit niedrigeren Konzentrationen, die nicht aufgeführt sind, entspricht die Sichtbarkeit der Sichtbarkeit von Umgebungslichtern bei Nacht, sodass die Komplexität 3 beträgt.

3 Korrektur der Szenendatenkomplexität

Beim Aufbau der Szenenbibliothek mit der oben genannten komplexen metrischen Methode wird It ist anfällig für das Phänomen der „Überkomplexität“, das heißt, um die Komplexität der Szenenbibliothek zu verfolgen, sammelt die Szenenbibliothek nur Szenen mit hoher Komplexität Obwohl die Komplexität der Szenenbibliothek sehr hoch ist. Die Eintrittswahrscheinlichkeit der Szenen ist sehr gering, was letztendlich dazu führt, dass das System Leistungsmängel entdeckt. Um das Phänomen der „Überkomplexität“ zu vermeiden, werden in diesem Artikel zwei Konzepte vorgeschlagen: „Mutter-Kind-Bibliothek“ und „Systemszenario-Wahrscheinlichkeit“.

3.1 Mutter-Kind-Bibliothek

Im eigentlichen Sammlungsprozess der Szenenbibliothek werden zufällige Sammlungsmethoden wie zufällige Orte, zufällige Zeiträume, zufällige Klima etc. werden übernommen. Die gesammelten Daten bilden die „Masterdatenbank“. Basierend auf den Eigenschaften und dem Betriebsbereich des relevanten Systems wird dann die „Unterbibliothek“ aus der „Mutterbibliothek“ extrahiert. Beispiel: Für ein autonomes Fahrsystem, das nur auf Autobahnen anwendbar ist, werden die Szenendaten von Autobahnen aus der „übergeordneten Bibliothek“ extrahiert und in einer „Unterbibliothek“ zusammengefasst. Beispiel: Für ein autonomes Fahrsystem, das für eine bestimmte Stadt entwickelt wurde, werden die Szenendaten dieser Stadt aus der „Mutterdatenbank“ extrahiert, um eine „Unterdatenbank“ für das System zu bilden.

Es ist erwähnenswert, dass Sie theoretisch entweder zuerst die „Mutterbibliothek“ erstellen und dann die „Unterbibliothek“ extrahieren können, oder Sie können die „ werden zunächst in einer „Unterbibliothek“ erfasst und dann in einer „Mutterbibliothek“ zusammengefasst. In diesem Artikel wird jedoch der Ansatz „Mutter zuerst, Sohn zweitens“ empfohlen. Da der Aufbau der „Mutterbibliothek“ zufällig ist, weist die aus der „Mutterbibliothek“ extrahierte „Unterbibliothek“ ebenfalls zufällige Attribute auf. Wenn die „Unterbibliothek“ zuerst erstellt wird und weil die „Unterbibliothek“ systemspezifisch ist, ist es schwierig, im Erstellungsprozess eine vollständige Zufälligkeit zu erreichen.

3.2 SystemszenariowahrscheinlichkeitAnalysieren Sie für die aus der „Mutterbibliothek“ extrahierte „Unterbibliothek“ jede Ebene in ihrem Szenario weiter Die Wahrscheinlichkeit, dass ein Element während des Systembetriebs auftritt, ist die Wahrscheinlichkeit des Systemszenarios. Beispiel: Bei einem autonomen Fahrsystem, das nur für Autobahnen geeignet ist, ist die Wahrscheinlichkeit, dass die Verkehrsteilnehmerschicht nur Fahrzeuge enthält (Komplexität 2), viel höher als die Wahrscheinlichkeit von Fußgängern und Fahrrädern (Komplexität 3). Daher ist es bei der Bewertung der Komplexität der Elemente in dieser Schicht auch erforderlich, die Komplexität mit einem Wahrscheinlichkeitskoeffizienten zu multiplizieren, um die endgültige Komplexität dieser Schicht zu erhalten. Die Formel lautet:

In der Formel: C ist die endgültige Komplexität der Szenendaten; Für verschiedene Systeme sind die Wahrscheinlichkeitskoeffizienten unterschiedlich. Beispiel: Bei einem System, das auf die Nutzung von Autobahnen beschränkt ist, ist der Wahrscheinlichkeitskoeffizient, dass nur Fahrzeuge in der Verkehrsteilnehmerebene auftauchen, größer als der Wahrscheinlichkeitskoeffizient von Fußgängern und Fahrrädern, bei einem System, das in städtischen Verkehrsszenarien verwendet werden kann Koeffizient der in der Verkehrsteilnehmerschicht vorkommenden Fußgänger und Fahrräder. Der Wahrscheinlichkeitskoeffizient ist größer als der Wahrscheinlichkeitskoeffizient nur von Fahrzeugen. Darüber hinaus können die Wahrscheinlichkeitskoeffizienten desselben Systems in verschiedenen Phasen des autonomen Fahrentwicklungsprozesses unterschiedlich sein. Beispiel: Zu diesem Zeitpunkt ist der Wahrscheinlichkeitskoeffizient eines Systems mit hochpräzisen Karten oder V2X in der Informationsschicht niedriger als der eines Systems ohne hochpräzise Karten oder V2X. In späteren Entwicklungsstadien des autonomen Fahrens kann der Wahrscheinlichkeitskoeffizient eines Systems mit hochpräzisen Karten oder V2X höher sein als der eines Systems ohne hochpräzise Karten oder V2X. 4 Fazit Um die Anforderungen von ISO/PAS 21448 zu erfüllen, muss eine Bibliothek erwarteter funktionaler Sicherheitsszenarien erstellt werden. Der Konstruktionsqualität der Szenenbibliothek fehlen jedoch entsprechende quantitative Indikatoren. Basierend auf dem Pegasus-Szenenebenensystem quantifiziert dieser Artikel die Komplexität jeder Elementebene, um die Qualität der Szenenbibliothek zu bewerten. Um das Phänomen der „Überkomplexität“ zu vermeiden, werden gleichzeitig die beiden Konzepte „Mutter-Kind-Bibliothek“ und „Systemszenario-Wahrscheinlichkeit“ vorgeschlagen und erläutert, wie und wie die „Mutter-Kind-Bibliothek“ aufgebaut werden soll Es wird erläutert, wie die „Systemszenario-Wahrscheinlichkeit“ berechnet wird, und auf dieser Grundlage wird abschließend erläutert, wie die Komplexität berechnet wird. Die in diesem Artikel erwähnten Quantifizierungsmethoden und die Methoden zur Vermeidung „übermäßiger Komplexität“ spielen eine aufschlussreiche Rolle beim Aufbau und der Förderung der erwarteten funktionalen Sicherheitsszenarienbibliothek.  ist die Komplexität der Szenenelemente der

ist die Komplexität der Szenenelemente der  ; erscheint, wenn das entsprechende System läuft.

; erscheint, wenn das entsprechende System läuft.  3.3 Verhinderung des Phänomens „Überkomplexität“

3.3 Verhinderung des Phänomens „Überkomplexität“  Die „Mutter-Kind-Bibliothek“ und die „Systemszenario-Wahrscheinlichkeit“ können verwendet werden, um das Phänomen „Überkomplexität“ zu vermeiden. Die Hauptgründe sind: (1) Beim Aufbau der „Mutterbibliothek“ wird eine zufällige Sammlungsmethode mit zufälligem Ort, zufälligem Zeitraum, zufälligem Klima usw. verwendet, um menschliche Faktoren im Sammlungsprozess der „Mutterbibliothek“ zu reduzieren. (2) Für ein bestimmtes System wird die entsprechende „Unterbibliothek“ aus der „Mutterbibliothek“ extrahiert, wodurch menschliche Faktoren in der „Unterbibliothek“ indirekt vermieden werden. (3) Berechnen Sie die endgültige Szenenkomplexität basierend auf der Wahrscheinlichkeit und Komplexität des Szenenauftritts, wenn das System ausgeführt wird. Durch die Kombination der objektiven Faktoren Komplexität und Wahrscheinlichkeit wird der Einfluss menschlicher Faktoren vermieden. Beispiel: Für Szenenelemente mit hoher Komplexität und geringer Wahrscheinlichkeit oder für Szenenelemente mit geringer Komplexität und hoher Wahrscheinlichkeit kann der endgültige Szenenkomplexitätswert niedriger sein.

Die „Mutter-Kind-Bibliothek“ und die „Systemszenario-Wahrscheinlichkeit“ können verwendet werden, um das Phänomen „Überkomplexität“ zu vermeiden. Die Hauptgründe sind: (1) Beim Aufbau der „Mutterbibliothek“ wird eine zufällige Sammlungsmethode mit zufälligem Ort, zufälligem Zeitraum, zufälligem Klima usw. verwendet, um menschliche Faktoren im Sammlungsprozess der „Mutterbibliothek“ zu reduzieren. (2) Für ein bestimmtes System wird die entsprechende „Unterbibliothek“ aus der „Mutterbibliothek“ extrahiert, wodurch menschliche Faktoren in der „Unterbibliothek“ indirekt vermieden werden. (3) Berechnen Sie die endgültige Szenenkomplexität basierend auf der Wahrscheinlichkeit und Komplexität des Szenenauftritts, wenn das System ausgeführt wird. Durch die Kombination der objektiven Faktoren Komplexität und Wahrscheinlichkeit wird der Einfluss menschlicher Faktoren vermieden. Beispiel: Für Szenenelemente mit hoher Komplexität und geringer Wahrscheinlichkeit oder für Szenenelemente mit geringer Komplexität und hoher Wahrscheinlichkeit kann der endgültige Szenenkomplexitätswert niedriger sein. 3.4 Wert des Wahrscheinlichkeitskoeffizienten

Das obige ist der detaillierte Inhalt vonForschung zur komplexen Quantifizierungsmethode der Bibliothek erwarteter funktionaler Sicherheitsszenarien. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

Vorab geschrieben und Ausgangspunkt Das End-to-End-Paradigma verwendet ein einheitliches Framework, um Multitasking in autonomen Fahrsystemen zu erreichen. Trotz der Einfachheit und Klarheit dieses Paradigmas bleibt die Leistung von End-to-End-Methoden für das autonome Fahren bei Teilaufgaben immer noch weit hinter Methoden für einzelne Aufgaben zurück. Gleichzeitig erschweren die in früheren End-to-End-Methoden weit verbreiteten Funktionen der dichten Vogelperspektive (BEV) die Skalierung auf mehr Modalitäten oder Aufgaben. Hier wird ein Sparse-Search-zentriertes End-to-End-Paradigma für autonomes Fahren (SparseAD) vorgeschlagen, bei dem die Sparse-Suche das gesamte Fahrszenario, einschließlich Raum, Zeit und Aufgaben, ohne dichte BEV-Darstellung vollständig abbildet. Insbesondere ist eine einheitliche, spärliche Architektur für die Aufgabenerkennung einschließlich Erkennung, Verfolgung und Online-Zuordnung konzipiert. Zudem schwer

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

Die erste rein visuelle statische Rekonstruktion des autonomen Fahrens

Jun 02, 2024 pm 03:24 PM

Die erste rein visuelle statische Rekonstruktion des autonomen Fahrens

Jun 02, 2024 pm 03:24 PM

Eine rein visuelle Annotationslösung nutzt hauptsächlich die visuelle Darstellung sowie einige Daten von GPS, IMU und Radgeschwindigkeitssensoren für die dynamische Annotation. Für Massenproduktionsszenarien muss es sich natürlich nicht nur um visuelle Aspekte handeln. Einige in Massenproduktion hergestellte Fahrzeuge verfügen über Sensoren wie Festkörperradar (AT128). Wenn wir aus Sicht der Massenproduktion einen geschlossenen Datenkreislauf erstellen und alle diese Sensoren verwenden, können wir das Problem der Kennzeichnung dynamischer Objekte effektiv lösen. Aber in unserem Plan gibt es kein Festkörperradar. Aus diesem Grund stellen wir diese gängigste Etikettierungslösung für die Massenproduktion vor. Der Kern einer rein visuellen Annotationslösung liegt in der hochpräzisen Posenrekonstruktion. Wir verwenden das Posenrekonstruktionsschema von Structure from Motion (SFM), um die Genauigkeit der Rekonstruktion sicherzustellen. Aber pass

Werfen Sie einen Blick auf die Vergangenheit und Gegenwart von Occ und autonomem Fahren! Die erste Rezension fasst die drei Hauptthemen Funktionserweiterung/Massenproduktionsbereitstellung/effiziente Annotation umfassend zusammen.

May 08, 2024 am 11:40 AM

Werfen Sie einen Blick auf die Vergangenheit und Gegenwart von Occ und autonomem Fahren! Die erste Rezension fasst die drei Hauptthemen Funktionserweiterung/Massenproduktionsbereitstellung/effiziente Annotation umfassend zusammen.

May 08, 2024 am 11:40 AM

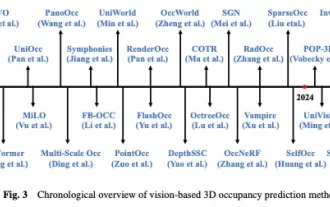

Oben geschrieben und persönliches Verständnis des Autors In den letzten Jahren hat autonomes Fahren aufgrund seines Potenzials, die Belastung des Fahrers zu verringern und die Fahrsicherheit zu verbessern, zunehmende Aufmerksamkeit erhalten. Die visionsbasierte dreidimensionale Belegungsvorhersage ist eine neue Wahrnehmungsaufgabe, die sich für eine kostengünstige und umfassende Untersuchung der Sicherheit autonomen Fahrens eignet. Obwohl viele Studien die Überlegenheit von 3D-Belegungsvorhersagetools im Vergleich zu objektzentrierten Wahrnehmungsaufgaben gezeigt haben, gibt es immer noch Rezensionen, die diesem sich schnell entwickelnden Bereich gewidmet sind. In diesem Artikel wird zunächst der Hintergrund der visionsbasierten 3D-Belegungsvorhersage vorgestellt und die bei dieser Aufgabe auftretenden Herausforderungen erörtert. Als nächstes diskutieren wir umfassend den aktuellen Status und die Entwicklungstrends aktueller 3D-Belegungsvorhersagemethoden unter drei Gesichtspunkten: Funktionsverbesserung, Bereitstellungsfreundlichkeit und Kennzeichnungseffizienz. zu guter Letzt

LLM ist fertig! OmniDrive: Integration von 3D-Wahrnehmung und Argumentationsplanung (NVIDIAs neueste Version)

May 09, 2024 pm 04:55 PM

LLM ist fertig! OmniDrive: Integration von 3D-Wahrnehmung und Argumentationsplanung (NVIDIAs neueste Version)

May 09, 2024 pm 04:55 PM

Oben geschrieben und persönliches Verständnis des Autors: Dieses Papier widmet sich der Lösung der wichtigsten Herausforderungen aktueller multimodaler großer Sprachmodelle (MLLMs) in autonomen Fahranwendungen, nämlich dem Problem der Erweiterung von MLLMs vom 2D-Verständnis auf den 3D-Raum. Diese Erweiterung ist besonders wichtig, da autonome Fahrzeuge (AVs) genaue Entscheidungen über 3D-Umgebungen treffen müssen. Das räumliche 3D-Verständnis ist für AVs von entscheidender Bedeutung, da es sich direkt auf die Fähigkeit des Fahrzeugs auswirkt, fundierte Entscheidungen zu treffen, zukünftige Zustände vorherzusagen und sicher mit der Umgebung zu interagieren. Aktuelle multimodale große Sprachmodelle (wie LLaVA-1.5) können häufig nur Bildeingaben mit niedrigerer Auflösung verarbeiten (z. B. aufgrund von Auflösungsbeschränkungen des visuellen Encoders und Einschränkungen der LLM-Sequenzlänge). Allerdings erfordern autonome Fahranwendungen

Auf dem Weg zum „Closed Loop' |. PlanAgent: Neues SOTA für die Closed-Loop-Planung des autonomen Fahrens auf Basis von MLLM!

Jun 08, 2024 pm 09:30 PM

Auf dem Weg zum „Closed Loop' |. PlanAgent: Neues SOTA für die Closed-Loop-Planung des autonomen Fahrens auf Basis von MLLM!

Jun 08, 2024 pm 09:30 PM

Das Deep-Reinforcement-Learning-Team des Instituts für Automatisierung der Chinesischen Akademie der Wissenschaften hat zusammen mit Li Auto und anderen ein neues Closed-Loop-Planungsframework für autonomes Fahren vorgeschlagen, das auf dem multimodalen großen Sprachmodell MLLM basiert – PlanAgent. Bei dieser Methode werden die Szene aus der Vogelperspektive und diagrammbasierte Textaufforderungen als Eingabe betrachtet. Dabei werden die Fähigkeiten des multimodalen Verständnisses und des gesunden Menschenverstandes des multimodalen großen Sprachmodells genutzt, um hierarchische Überlegungen vom Szenenverständnis bis zur Generierung durchzuführen von horizontalen und vertikalen Bewegungsanweisungen und generieren Sie außerdem die vom Planer benötigten Anweisungen. Die Methode wird im groß angelegten und anspruchsvollen nuPlan-Benchmark getestet und Experimente zeigen, dass PlanAgent sowohl in regulären als auch in Long-Tail-Szenarien eine State-of-the-Art-Leistung (SOTA) erreicht. Im Vergleich zu herkömmlichen LLM-Methoden (Large Language Model) bietet PlanAgent

Überblick über die Pfadplanung: Basierend auf Probenahme, Suche und Optimierung, fertig!

Jun 01, 2024 pm 08:12 PM

Überblick über die Pfadplanung: Basierend auf Probenahme, Suche und Optimierung, fertig!

Jun 01, 2024 pm 08:12 PM

1 Überblick über Entscheidungssteuerung und Bewegungsplanung Aktuelle Methoden zur Entscheidungssteuerung können in drei Kategorien unterteilt werden: sequentielle Planung, verhaltensbewusste Planung und End-to-End-Planung. Sequentielle Planung: Bei der traditionellsten Methode sind die drei Teile Wahrnehmung, Entscheidungsfindung und Kontrolle relativ klar. Verhaltensbewusste Planung: Im Vergleich zur ersten Methode ist der Höhepunkt die Einführung von Mensch-Maschine-Co-Fahren und Fahrzeug-Straße Zusammenarbeit und Fahrzeugrisikoabschätzung der externen dynamischen Umgebung; End-to-End-Planung: DL- und DRL-Technologien nutzen eine große Menge an Datentraining, um sensorische Informationen wie Bilder, Lenkradwinkel usw. zu erhalten.