Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Die reale Demonstration von „Black Wukong' explodiert, NVIDIA präsentiert Light-Tracing-Technologie

Die reale Demonstration von „Black Wukong' explodiert, NVIDIA präsentiert Light-Tracing-Technologie

Die reale Demonstration von „Black Wukong' explodiert, NVIDIA präsentiert Light-Tracing-Technologie

Nach einem Jahr ist „Black Wukong“ zurück und erneut auf der Hotlist.

Zusätzlich zur offiziellen Veröffentlichung eines 6-minütigen Real-Life-Plot-Clips brachte NVIDIA dieses Mal auch einen 8-Minuten-Real-Life-Testclip mit.

Was noch wichtiger ist, ist, dass „Black Wukong“ zum ersten Mal 4K RTX ON Raytracing + NVIDIA DLSS-Technologie unterstützt.

Das Blut der Internetnutzer kochte sofort, nachdem sie es gesehen hatten.

Die erste 4K-Lichtverfolgung + DLSS

Im Jahr 2020 wurde Black Wukong zum ersten Mal freigelegt und versetzte die Welt in Erstaunen.

Im Jahr 2021 wurde der UE5-Test gezeigt, und die Szenenverarbeitung auf verschneitem Boden ließ Internetnutzer die chinesische Version der Grafikkartenkrise nennen.

Im Jahr 2022 bin ich direkt zu NVIDIA 4K RTX ON übergegangen.

Vergleichen wir die Szene, in der sich Wukong zu Beginn in eine goldene Zikade verwandelt. Die Flügelmodellierung und Flugbewegungen sind in diesem Jahr offensichtlich strukturierter als in der Version von 2020.

Mit dem Segen der Lichtverfolgung zeigen verschiedene Positionen des Körpers der goldenen Zikade auch unterschiedliche Details basierend auf unterschiedlichen Beleuchtungswinkeln, wodurch sie realistischer und natürlicher erscheinen.

KI-Technologie und Raytracing-Technologie verändern eindeutig die Art und Weise, wie wir spielen und kreieren.

Aus technischer Sicht sind Raytracing und DLSS zur Standardausrüstung für die Produktion von AAA-Game-Meisterwerken geworden.

Der Grund, warum „Black Wukong“ den Spielern das Erleben einer so immersiven Fantasiewelt der chinesischen Mythologie ermöglicht, liegt an der leistungsstarken Raytracing-Funktion und NVIDIA DLSS, die alle auf der GeForce RTX-Technologie basieren.

NVIDIA RTX steht an der Spitze der aktuellen Revolution im Gaming, der schnellsten und fortschrittlichsten Plattform für hochmoderne Anwendungen und Spiele.

Wenn Spieler einen GeForce RTX-basierten PC verwenden und ihn mit dem neuesten Game Ready-Treiber optimieren, erhalten sie die stärkste Leistung, das reibungsloseste Spielerlebnis und die Raytracing-Effekte mit der höchsten Wiedergabetreue.

Ein Meilenstein, der die Spielebranche untergräbt

Als nächstes stellen wir Raytracing und DLSS im Detail vor.

Am 14. August 2018 fand in Vancouver die SIGGRAPH, die führende Computergrafikkonferenz, statt. NVIDIA stellte offiziell NVIDIA Quadro RTX vor, die weltweit erste neue Grafikkartenfamilie, die Echtzeit-Raytracing-Technologie unterstützt.

Am 21. August veröffentlichte NVIDIA eine neue Generation von Grafikkarten auf Basis der Turing-Architektur: GeForce 2080Ti, GeForce 2080 und GeForce 2070. Seitdem hat die GPU eine neue Welt des Raytracing für Spiele eröffnet.

Echtzeit-Raytracing-Technologie und DLSS-Technologie sind definitiv bahnbrechende Störungen.

1. Raytracing-Technologie

Raytracing ist eine Grafik-Rendering-Methode, die die physikalischen Eigenschaften von Licht simuliert.

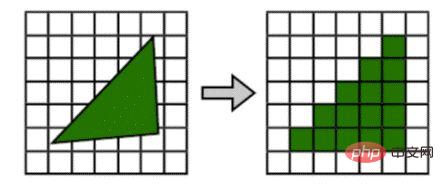

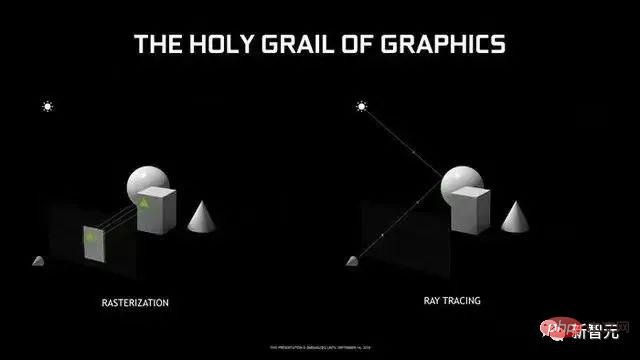

Vor dem Aufkommen von Raytracing war die traditionelle Methode das Rasterrendering.

Angenommen, es gibt einen Raum und eine Lichtquelle. Geben Sie jeder Oberfläche eine ebene Textur, entsprechend der Position der Lichtquelle. Die Koordinatentransformation der Eckpunkte des Polygons oder Dreiecks auf dem Bildschirm (Matrixtransformation, Perspektive usw.) und das anschließende Füllen der Textur innerhalb des Polygons oder Dreiecks, während gleichzeitig die Farbe jedes Pixels des Raums berechnet wird, wodurch ein ziemlich realistischer 3D-Raum erzeugt wird .

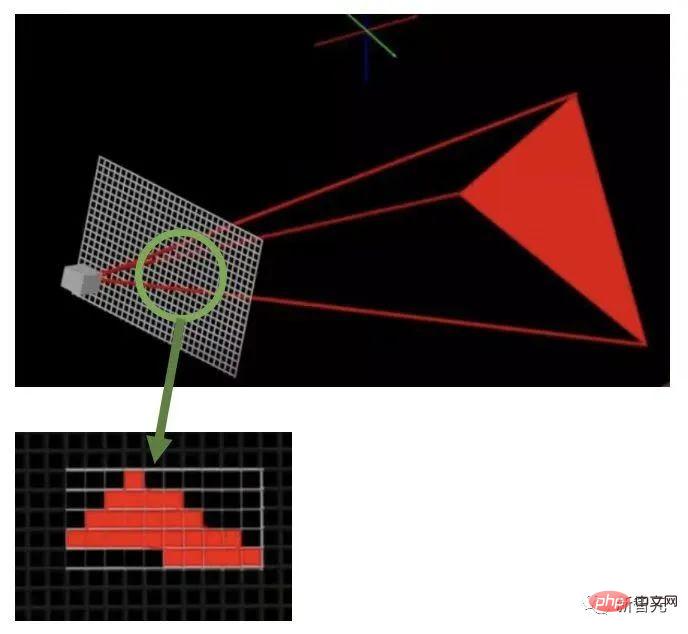

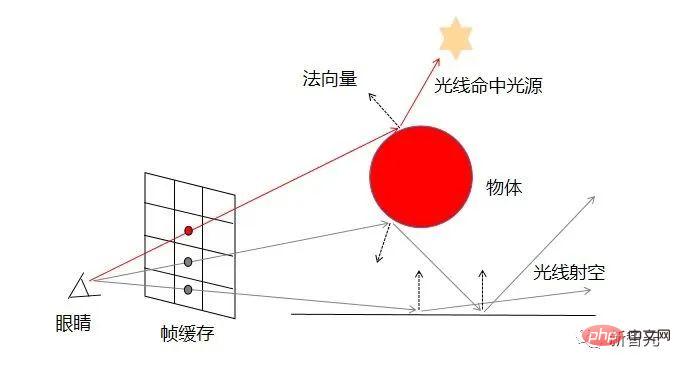

Das Prinzip der Strahlverfolgung besteht darin, das Ausbreitungsverhalten jedes Strahls zu verfolgen und den Beitragswert jedes Strahls zur Beobachtung unseres menschlichen Auges, also den Farbwert, zu berechnen. Die mithilfe der Raytracing-Technologie gerenderten Lichtstrahlen springen wie in der realen Welt um die Szene herum und sehen daher realistischer aus. Es berechnet, wo das Licht den Raum trifft und wie viel es reflektieren soll, wie das Licht durch das Objektiv der virtuellen Kamera geht und bestimmt schließlich, wie das Bild der Kamera auf Ihrem Bildschirm erscheinen soll.

Um es einfach auszudrücken: Beim Rasterrendering beginnt die Berechnung des Lichts beim Objekt selbst und durchläuft Berechnungen und Simulationen wie eine Koordinatenmatrixtransformation, um die Farbe und andere Informationen zu erhalten, die auf jedes Pixel auf dem Bildschirm projiziert werden.

Und Raytracing verfolgt das Licht von der Kamera (Auge) zurück, um die verschiedenen Effekte der Lichtreflexion zu erfassen.

Rasterisierung (links) und Raytracing (rechts)

Im Spiel wird ein spezieller Light Tracing (RT)-Kern verwendet, um die Lichtphysik beim Szenenwechsel im Spiel zu simulieren.

Es können physikalisch genaue Schatten, Reflexionen und Brechungen sowie eine globale Beleuchtung erzielt werden, wodurch Objekte im Spiel in virtuellen Spielszenen realistischer werden.

Zum Beispiel wechseln sich Licht und Schatten bei der Black Wukong-Demonstration ab.

Szenen wie Flammen, Rauch und Explosionen wirken realistischer und vermitteln den Menschen ein immersives Gefühl, allesamt Lichtverfolgungseffekte.

Tatsächlich wurde der Algorithmus der Raytracing-Technologie bereits 1979 von Turner Whitted vorgeschlagen. Warum hat es so viele Jahre gedauert, diese Technologie für die Lichtwiedergabe einzusetzen? Dies liegt daran, dass der Rechenaufwand zu groß ist.

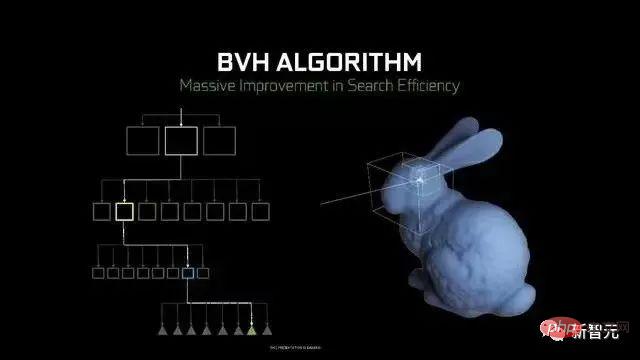

Um den enormen Bedarf an Rechenleistung sicherzustellen, verfügt NVIDIA in jeder SM-Einheit der Turing-Architektur über einen RT CORE, speziell für Raytracing-Dienste. Das Arbeitsprinzip von RT CORE ist der hierarchische Bounding-Box-Traversal-Algorithmus: BVH (Bounding Volume Hierarchy Traversal).

Zum Beispiel ist das Rendering-Objekt ein Kaninchen. Um die Wechselwirkung zwischen einem Lichtstrahl und dem Kaninchen selbst zu berechnen, teilen Sie den Raum, in dem sich das Kaninchen befindet, in N Begrenzungsrahmen auf und berechnen Sie, welchen Begrenzungsrahmen das Licht schneidet Wenn ja, dann wird dieser Begrenzungsrahmen weiter in N kleinere Begrenzungsrahmen unterteilt und der Schnittpunkt erneut berechnet. Dies wird wiederholt, bis der Begrenzungsrahmen gefunden wird, in dem sich das Dreieck befindet, das das Licht schneidet, und dann wird das Dreieck schließlich gefunden gerendert.

Der BVH-Algorithmus kann die Anzahl der Dreiecke, die durchlaufen werden müssen, um den nächsten Schnittpunkt jedes Strahls zu berechnen, erheblich reduzieren, und er muss nur einmal durchgeführt werden, um ihn für alle Strahlen zu verwenden, was die Ausführungseffizienz erheblich verbessert . 2. DLSS

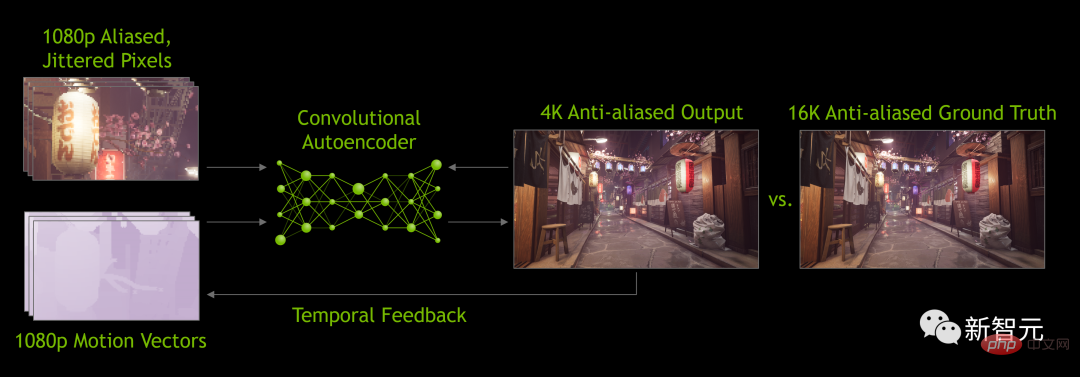

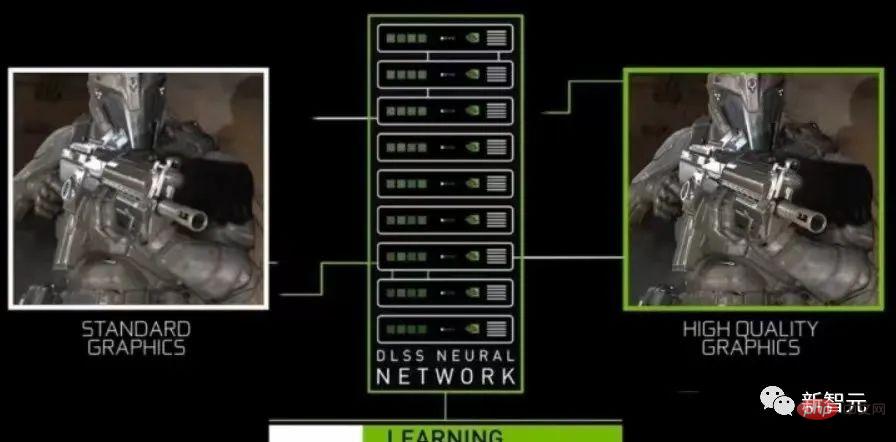

Das ist NVIDIA Deep Learning Super Sampling (DLSS), ein Deep-Learning-Neuronales Netzwerk, das die Bildraten steigert und gestochen scharfe Bilder erzeugt.

Der vollständige Name von DLSS ist Deep Learning Super Sampling und der chinesische Name ist Deep Learning Super Sampling Technology. Es kann ein Bild mit niedriger Auflösung (z. B. 1080P) verwenden, um ein Bild mit hoher Auflösung (8K) zu erzeugen, und das 8K-Bild dann wieder auf 4K verkleinern, um ein Super-Sampling-Anti-Aliasing-Bild (SSAA) zu erhalten.

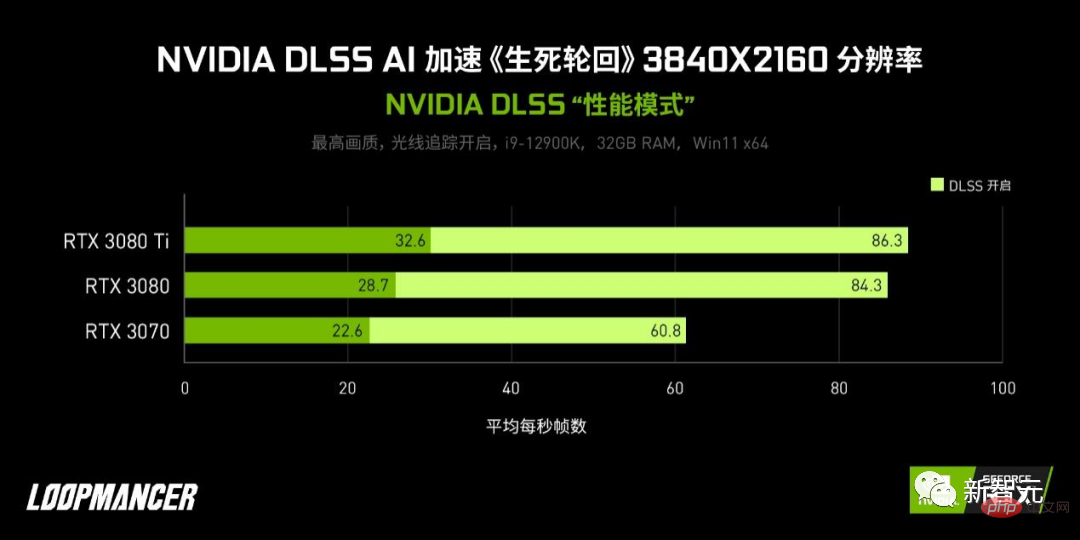

NVIDIA DLSS ist die einzige auf KI basierende Superauflösungstechnologie, die bis zu zweifache Leistungsverbesserungen für Spiele liefern kann.

In den nebligen Szenen von Black Wukong gab es beispielsweise keine instabile Bildrate, hauptsächlich aufgrund der DLSS-Technologie.

DLSS ist eine neue exklusive Anti-Aliasing-Technologie, die von NVIDIA nach TXAA eingeführt wurde. Sie nutzt die Leistungsfähigkeit von Deep Learning und KI, um die GPU für die Wiedergabe klarer Spielbilder zu trainieren.

Das Arbeitsprinzip von DLSS ist die Bild-Super-Resolution-Technologie, eine Funktion zur Optimierung von Bildern auf Basis von KI und Deep Learning. Durch NVIDIAs Supercomputing wird KI kontinuierlich zum Erlernen von Spielbildern mit ultrahoher Auflösung verwendet Bilder mit niedriger Auflösung werden ständig bis ins kleinste Detail wiederhergestellt.

Da die Supercomputing-Leistung enorm ist, kann sie die Details langsam vervollständigen, die Auflösung verbessern, ein tiefes Faltungs-Neuronales Netzwerk-Training verwenden und schließlich verschiedene Bilder mit nahezu perfekten Details und extrem hoher Auflösung ausgeben.

Der Berechnungsprozess von DLSS wird vollständig in der einzigartigen Tensor Core-Kerneinheit der RTX-Grafikkarte durchgeführt, sodass er nicht die CUDA-Allzweck-Recheneinheit der Grafikkarte belegt und so den Verbrauch vermeidet Renderleistung und Gameframes der Grafikkarte reduzieren sich.

Die DLSS-Technologie kann als Meilenstein im Grafikkarten-Rendering bezeichnet werden. Denn im Grafikbereich gibt es eine Regel: Wenn Sie eine bessere Bildqualität wünschen, müssen Sie eine bessere Leistung benötigen. DLSS 2.0, eine revolutionäre Technologie, bricht diese Regel und kann die Leistung verbessern, ohne die Bildqualität zu beeinträchtigen.

Nach dem Einschalten von DLSS läuft das Rendering der Engine mit einer niedrigen Auflösung von 1/2 bis 1/4 Pixel. Mehr als die Hälfte der Berechnungen auf Pixelebene entfallen. Berechnungen auf Pixelebene sind sehr zeitaufwändig und leistungsintensiv. Im Allgemeinen verbrauchen 3A-Meisterwerke mit besserer Grafik mehr Rendering-Leistung, und je mehr Rendering-Leistung zu einem Engpass wird, desto mehr Beschleunigung bietet DLSS.

Es besteht keine Notwendigkeit, ultrahochauflösende Bilder im Spiel voreinzustellen. Solange die DLSS-Technologie verwendet wird, ist das im Treiber integrierte Supercomputer-Modell aktiviert Wenn Sie die DLSS-Funktion aktivieren, wird sie aufgerufen.

Das wirklich Besondere an DLSS ist, dass es der erste KI-Algorithmus ist, der gleichzeitig stabile Bilder ohne Jitter-Artefakte erzeugt. Jedes Spiel erfasst hochwertige Bildsequenzen, wodurch die hohen Kosten für Echtzeit-Rendering vermieden werden und Spiele sehr schnell gerendert werden.

Es ist außerdem die einzige Bildschirmskalierungstechnologie, die Deep-Learning-Neuronale Netze nutzen kann, um sicherzustellen, dass die Bildqualität mit der nativen Auflösung vergleichbar ist. Ohne KI-gestützte Skalierungstechnologie können hochskalierte Bilder unansehnliche Artefakte wie Bewegungsartefakte, Flackern und stumpfe, verschwommene Texturen erzeugen.

Mit Hilfe der DLSS-Technologie kann zunächst die Bildqualität verbessert werden. Durch die fortschrittliche Time-Feedback-Technologie können klarere Bilddetails erzielt und gleichzeitig die Stabilität zwischen den Bildern verbessert werden.

Bilder, die mit einer Auflösung von 1080p im DLSS-Qualitätsmodus aufgenommen wurden

Zweitens können die Bildrate und die Auflösung erhöht werden. Das neue KI-Netzwerk nutzt Tensor-Kerne effizienter, um die doppelte Geschwindigkeit der Originalversion zu erreichen, was die Bildraten verbessert und frühere Einschränkungen bei Grafikkarten, Einstellungen und Auflösungen aufhebt.

Derzeit wurde DLSS auf Version 2.4.0 aktualisiert.

Angesichts der zweifachen Verbesserung der Spielleistung, Bildrate und Bildqualität gibt es nichts zu sagen.

Mittlerweile wird NVIDIA DLSS in 200 Spielen und Anwendungen verwendet.

Heiße Kommentare von Internetnutzern

Nachdem sie dieses von NVIDIA gezeigte Video gesehen haben, machen sich Internetnutzer Sorgen, ob ihre Grafikkarten explodieren könnten.

Was alle mehr beunruhigt, ist: Wann kommt Black Wukong?

Das obige ist der detaillierte Inhalt vonDie reale Demonstration von „Black Wukong' explodiert, NVIDIA präsentiert Light-Tracing-Technologie. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht