Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Huawei Cloud und eine Reihe von Unternehmen haben eine Aktionsinitiative gestartet: Gemeinsam ein offenes industrielles Ökosystem für autonomes Fahren aufbauen

Huawei Cloud und eine Reihe von Unternehmen haben eine Aktionsinitiative gestartet: Gemeinsam ein offenes industrielles Ökosystem für autonomes Fahren aufbauen

Huawei Cloud und eine Reihe von Unternehmen haben eine Aktionsinitiative gestartet: Gemeinsam ein offenes industrielles Ökosystem für autonomes Fahren aufbauen

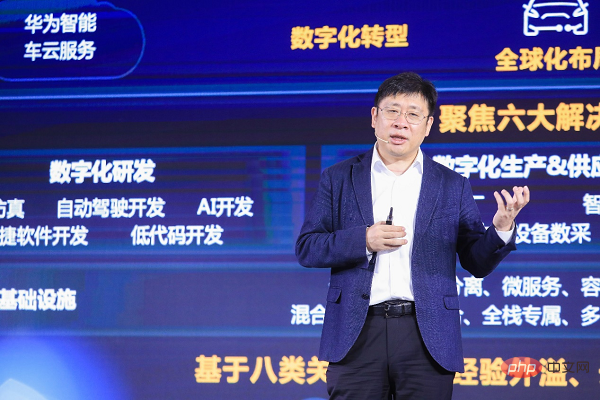

Am 18. November 2022 fand unter der Leitung des China Association of Automobile Manufacturers und der China Society of Automotive Engineers das von Huawei Cloud und dem Machinery Industry Information Research Institute veranstaltete „Automotive Industry Digital Intelligence Upgrade Summit Forum“ erfolgreich statt Suzhou. Bei dem Treffen tat sich Huawei Cloud mit Dutzenden von Branchenpartnern für autonomes Fahren wie Great Wall Motors, BYD, Human Horizons, NavInfo, Stardust Data, Saimu Technology, Yingyun Technology und Luokung Technology zusammen, um das „Co-Create Open Autonomous Driving“ zu starten „Industry Chain Action“-Initiative (im Folgenden als „Initiative“ bezeichnet), ausgehend von den vier Richtungen autonomes Fahren, ökologischer Aufbau, Standardsystemaufbau, Netzwerksicherheit und Datensicherheit sowie Industrieketten-Technologieaustausch, stärken gemeinsam den Aufbau meiner Die offene Industriekette des Landes für autonomes Fahren trägt dazu bei, die Beschleunigung der Technologie für autonomes Fahren im Land zu beschleunigen. Führungskräfte des Machinery Industry Information Research Institute, der China Association of Automobile Manufacturers und der China Society of Automotive Engineers waren gemeinsam Zeugen der Veröffentlichung der Initiative.

Autonomes Fahren hat den Tiefwasserbereich erreicht, und die Pflege einer offenen Industrieökologie ist der Schlüssel

In den letzten Jahren haben das Ministerium für Industrie und Informationstechnologie, die Nationale Entwicklungs- und Reformkommission und andere zentrale Ministerien und Die Kommissionen haben nacheinander Richtlinien herausgegeben, die das autonome Fahren als eine der Schlüsselaufgaben einbeziehen, und vorgeschlagen, die Weiterentwicklung des autonomen Fahrregelungssystems zu beschleunigen. Darüber hinaus haben mehr als 40 Provinzen und Städte, darunter Peking, Shanghai, Shenzhen und Guangzhou, detaillierte Managementmaßnahmen eingeführt, um die Entwicklung der heimischen Branche für autonomes Fahren von einem Spitzendesign aus zu sichern. Mit der Unterstützung einer kontinuierlich optimierten Industriepolitik ist die autonome Fahrindustrie meines Landes in eine neue Phase vertiefter Entwicklung eingetreten.

Allerdings ist die Entwicklung des autonomen Fahrens definitiv nicht das Ergebnis einer einzelnen Funktion, sondern eine komplexe Industriekette und Lieferkette, die Datenerfassung, Datenspeicherung, Datenverarbeitung, Data Mining, Datenannotation, Modelltraining, Simulationstests usw. umfasst. usw. In diesem Zusammenhang ist die Integration mehrerer Ressourcen und die Förderung der Synergie von Unternehmen in der Industriekette für autonomes Fahren zu einem schwierigen Problem für die Branche geworden.

Xu Donghai, stellvertretender Chefingenieur des Chinesischen Verbandes der Automobilhersteller, sagte, dass wir, um die Entwicklung der autonomen Fahrindustrie meines Landes zu beschleunigen, am Prinzip der Offenheit und des Teilens festhalten, unabhängige Innovationsfähigkeiten verbessern und die Zusammenarbeit im vorgelagerten Bereich fördern müssen und nachgelagerte Industrieketten für autonomes Fahren wie Chips, Hosts, Algorithmen und Plattformen und bauen eine offene Win-Win-Industrie auf.

Die Huawei Cloud Autonomous Driving Cloud-Plattform wird vorgestellt, datengesteuerte Forschung und Entwicklung, Herstellung und Vertrieb. Der größte Wert des Teilens und der Offenheit besteht darin, dass sie das Problem der quantitativen und qualitativen Bereitstellung von Szenarien und Daten löst und dies direkt ermöglichen kann Die Technologie führt Versuche und Irrtümer anhand umfangreicher Szenarien und Daten durch, um die Anpassung des autonomen Fahrens an verschiedene Szenarien zu beschleunigen.

Huawei Cloud arbeitet mit Partnern aus allen Lebensbereichen zusammen, um ein offenes Ökosystem der kollaborativen Zusammenarbeit, des doppelten Nutzens und des gegenseitigen Nutzens aufzubauen. Derzeit haben Partner wie NavInfo, Stardust Data und Saimu Technology ihre jeweiligen Vorteile und Fähigkeiten schnell auf der Grundlage der offenen API für autonomes Fahren von Huawei Cloud integriert, um eine ökologisch offene Forschungs- und Entwicklungsplattform für autonomes Fahren aufzubauen. Darüber hinaus hat Huawei Cloud auch Ploto, die Open-Source-Codebibliothek für F&E-Plattformlösungen für autonomes Fahren, geöffnet, um die Bereitstellung und das Andocken professioneller Softwaredienstleister zu unterstützen und so die Implementierungszeit von Projekten zum autonomen Fahren erheblich zu verkürzen. Zhang Xiuzheng, Präsident von Huawei Cloud China, sagte, dass Huawei Cloud zur Stärkung des Wohlstands des autonomen Fahrökosystems eine offene Forschungs- und Entwicklungsplattform für alle Parteien in der Branche bereitstellen und verschiedene Lösungen aktualisieren wird, um Unternehmen des autonomen Fahrens bei der Beschleunigung ihrer Entwicklung zu unterstützen wachsen und größer und stärker werden.Durch die Integration von Huaweis mehr als 30-jähriger Technologie- und Erfahrungssammlung bietet Huawei Cloud acht Schlüsselfunktionen für Automobilunternehmen, darunter: digitale Transformationserfahrung, intelligente Fertigungskapazitäten, Globalisierungserfahrung, Cloud-Cloud-Zusammenarbeitsfunktionen, autonome Fahrlösungen; Sicherheits-Compliance-Lösungen, zugrunde liegende technologische Innovation und offene ökologische Kooperationsmöglichkeiten.

Von Bambusrohrschuhen bis hin zu Pferdefahrrädern, von traditionellen Pferdekutschen bis hin zu Dampf, Elektrifizierung und sogar der Entwicklung der Intelligenz – der Mensch hat nie aufgehört, Reisemethoden auszuprobieren und zu erforschen. Derzeit ist autonomes Fahren immer noch der Maßstab für die Branchenentwicklung. Mit Blick auf die Zukunft wird Huawei Cloud die Branche des autonomen Fahrens weiterhin intensiv erforschen und Hand in Hand mit Partnern zusammenarbeiten, die über umfassende digitale Fähigkeiten und offene ökologische Dienste verfügen, um gemeinsam die schnelle Entwicklung des Bereichs des autonomen Fahrens voranzutreiben und Chinas Automobilindustrie dabei zu helfen, sich zu entwickeln größer und stärker.

Das obige ist der detaillierte Inhalt vonHuawei Cloud und eine Reihe von Unternehmen haben eine Aktionsinitiative gestartet: Gemeinsam ein offenes industrielles Ökosystem für autonomes Fahren aufbauen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1378

1378

52

52

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Warum ist Gaussian Splatting beim autonomen Fahren so beliebt, dass NeRF allmählich aufgegeben wird?

Jan 17, 2024 pm 02:57 PM

Oben geschrieben und persönliches Verständnis des Autors. Dreidimensionales Gaussplatting (3DGS) ist eine transformative Technologie, die in den letzten Jahren in den Bereichen explizite Strahlungsfelder und Computergrafik entstanden ist. Diese innovative Methode zeichnet sich durch die Verwendung von Millionen von 3D-Gaußkurven aus, was sich stark von der Neural Radiation Field (NeRF)-Methode unterscheidet, die hauptsächlich ein implizites koordinatenbasiertes Modell verwendet, um räumliche Koordinaten auf Pixelwerte abzubilden. Mit seiner expliziten Szenendarstellung und differenzierbaren Rendering-Algorithmen garantiert 3DGS nicht nur Echtzeit-Rendering-Fähigkeiten, sondern führt auch ein beispielloses Maß an Kontrolle und Szenenbearbeitung ein. Dies positioniert 3DGS als potenziellen Game-Changer für die 3D-Rekonstruktion und -Darstellung der nächsten Generation. Zu diesem Zweck geben wir erstmals einen systematischen Überblick über die neuesten Entwicklungen und Anliegen im Bereich 3DGS.

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Wie lässt sich das Long-Tail-Problem in autonomen Fahrszenarien lösen?

Jun 02, 2024 pm 02:44 PM

Gestern wurde ich während des Interviews gefragt, ob ich irgendwelche Long-Tail-Fragen gestellt hätte, also dachte ich, ich würde eine kurze Zusammenfassung geben. Das Long-Tail-Problem des autonomen Fahrens bezieht sich auf Randfälle bei autonomen Fahrzeugen, also mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. Das wahrgenommene Long-Tail-Problem ist einer der Hauptgründe, die derzeit den betrieblichen Designbereich intelligenter autonomer Einzelfahrzeugfahrzeuge einschränken. Die zugrunde liegende Architektur und die meisten technischen Probleme des autonomen Fahrens wurden gelöst, und die verbleibenden 5 % der Long-Tail-Probleme wurden nach und nach zum Schlüssel zur Einschränkung der Entwicklung des autonomen Fahrens. Zu diesen Problemen gehören eine Vielzahl fragmentierter Szenarien, Extremsituationen und unvorhersehbares menschliches Verhalten. Der „Long Tail“ von Randszenarien beim autonomen Fahren bezieht sich auf Randfälle in autonomen Fahrzeugen (AVs). Randfälle sind mögliche Szenarien mit geringer Eintrittswahrscheinlichkeit. diese seltenen Ereignisse

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

Kamera oder Lidar wählen? Eine aktuelle Übersicht über die Erzielung einer robusten 3D-Objekterkennung

Jan 26, 2024 am 11:18 AM

0. Vorab geschrieben&& Persönliches Verständnis, dass autonome Fahrsysteme auf fortschrittlichen Wahrnehmungs-, Entscheidungs- und Steuerungstechnologien beruhen, indem sie verschiedene Sensoren (wie Kameras, Lidar, Radar usw.) verwenden, um die Umgebung wahrzunehmen, und Algorithmen und Modelle verwenden für Echtzeitanalysen und Entscheidungsfindung. Dies ermöglicht es Fahrzeugen, Verkehrszeichen zu erkennen, andere Fahrzeuge zu erkennen und zu verfolgen, das Verhalten von Fußgängern vorherzusagen usw. und sich so sicher an komplexe Verkehrsumgebungen anzupassen. Diese Technologie erregt derzeit große Aufmerksamkeit und gilt als wichtiger Entwicklungsbereich für die Zukunft des Transportwesens . eins. Aber was autonomes Fahren schwierig macht, ist herauszufinden, wie man dem Auto klarmachen kann, was um es herum passiert. Dies erfordert, dass der dreidimensionale Objekterkennungsalgorithmus im autonomen Fahrsystem Objekte in der Umgebung, einschließlich ihrer Standorte, genau wahrnehmen und beschreiben kann.

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Der erste Pilot- und Schlüsselartikel stellt hauptsächlich mehrere häufig verwendete Koordinatensysteme in der autonomen Fahrtechnologie vor und erläutert, wie die Korrelation und Konvertierung zwischen ihnen abgeschlossen und schließlich ein einheitliches Umgebungsmodell erstellt werden kann. Der Schwerpunkt liegt hier auf dem Verständnis der Umrechnung vom Fahrzeug in den starren Kamerakörper (externe Parameter), der Kamera-in-Bild-Konvertierung (interne Parameter) und der Bild-in-Pixel-Einheitenkonvertierung. Die Konvertierung von 3D in 2D führt zu entsprechenden Verzerrungen, Verschiebungen usw. Wichtige Punkte: Das Fahrzeugkoordinatensystem und das Kamerakörperkoordinatensystem müssen neu geschrieben werden: Das Ebenenkoordinatensystem und das Pixelkoordinatensystem. Schwierigkeit: Sowohl die Entzerrung als auch die Verzerrungsaddition müssen auf der Bildebene kompensiert werden. 2. Einführung Insgesamt gibt es vier visuelle Systeme Koordinatensystem: Pixelebenenkoordinatensystem (u, v), Bildkoordinatensystem (x, y), Kamerakoordinatensystem () und Weltkoordinatensystem (). Es gibt eine Beziehung zwischen jedem Koordinatensystem,

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

SIMPL: Ein einfacher und effizienter Multi-Agent-Benchmark zur Bewegungsvorhersage für autonomes Fahren

Feb 20, 2024 am 11:48 AM

Originaltitel: SIMPL: ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Paper-Link: https://arxiv.org/pdf/2402.02519.pdf Code-Link: https://github.com/HKUST-Aerial-Robotics/SIMPL Autor: Hong Kong University of Science und Technologie DJI-Papieridee: Dieses Papier schlägt eine einfache und effiziente Bewegungsvorhersagebasislinie (SIMPL) für autonome Fahrzeuge vor. Im Vergleich zum herkömmlichen Agent-Cent

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

nuScenes' neuestes SOTA |. SparseAD: Sparse-Abfrage hilft effizientes durchgängiges autonomes Fahren!

Apr 17, 2024 pm 06:22 PM

Vorab geschrieben und Ausgangspunkt Das End-to-End-Paradigma verwendet ein einheitliches Framework, um Multitasking in autonomen Fahrsystemen zu erreichen. Trotz der Einfachheit und Klarheit dieses Paradigmas bleibt die Leistung von End-to-End-Methoden für das autonome Fahren bei Teilaufgaben immer noch weit hinter Methoden für einzelne Aufgaben zurück. Gleichzeitig erschweren die in früheren End-to-End-Methoden weit verbreiteten Funktionen der dichten Vogelperspektive (BEV) die Skalierung auf mehr Modalitäten oder Aufgaben. Hier wird ein Sparse-Search-zentriertes End-to-End-Paradigma für autonomes Fahren (SparseAD) vorgeschlagen, bei dem die Sparse-Suche das gesamte Fahrszenario, einschließlich Raum, Zeit und Aufgaben, ohne dichte BEV-Darstellung vollständig abbildet. Insbesondere ist eine einheitliche, spärliche Architektur für die Aufgabenerkennung einschließlich Erkennung, Verfolgung und Online-Zuordnung konzipiert. Zudem schwer

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren