Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Das Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen

Das Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen

Das Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen

Viele aktuelle Fortschritte in mehreren Teilbereichen der Forschung zum maschinellen Lernen (ML), wie z. B. Computer Vision und Verarbeitung natürlicher Sprache, basieren auf der Nutzung großer, vielfältiger Datensätze und Darstellungsmodelle, die alle Daten effizient absorbieren können.

Diese Hochleistungsmodellmethode hat jedoch relativ wenige Anwendungen im Bereich der Robotik.

Der Grund ist einfach: Das Fehlen umfangreicher und vielfältiger Roboterdaten schränkt die Fähigkeit des Modells ein, ein breites Spektrum an Robotererfahrungen aufzunehmen.

Zweitens mangelt es an ausdrucksstarken, skalierbaren und ausreichend schnellen Echtzeit-Inferenzmodellen, die aus solchen Datensätzen lernen und effektiv verallgemeinern können.

Und dieses Mal ist Googles Robotics Transformer 1 (kurz RT-1) ein Multitasking-Modell, das Eingabe- und Ausgabeaktionen des Roboters (wie Kamerabilder, Aufgabenanweisungen und Motorbefehle) kennzeichnen kann, um eine effiziente Ausführung zu erreichen Argumentation und ermöglichen eine Echtzeitkontrolle.

RT-1 absorbiert eine große Datenmenge, um den Roboter für eine Vielzahl von Aufgaben in verschiedenen Umgebungen kompetent zu machen, wodurch die Maschinenleistung und die Generalisierungsfähigkeiten verbessert werden.

Um es einfach auszudrücken bedeutet es Einen Roboter gleichzeitig mehrere Aufgaben erledigen lassen.

Das Modell wurde anhand eines großen realen Robotikdatensatzes aus 130.000 Episoden trainiert, der mehr als 700 Aufgaben abdeckt und über 17 Monate mit 13 Robotern von Everyday Robots (EDR) gesammelt wurde.

Die Ergebnisse zeigen, dass RT-1 die Zero-Shot-Generalisierung auf neue Aufgaben, Umgebungen und Objekte im Vergleich zu bestehenden Techniken deutlich verbessern kann.

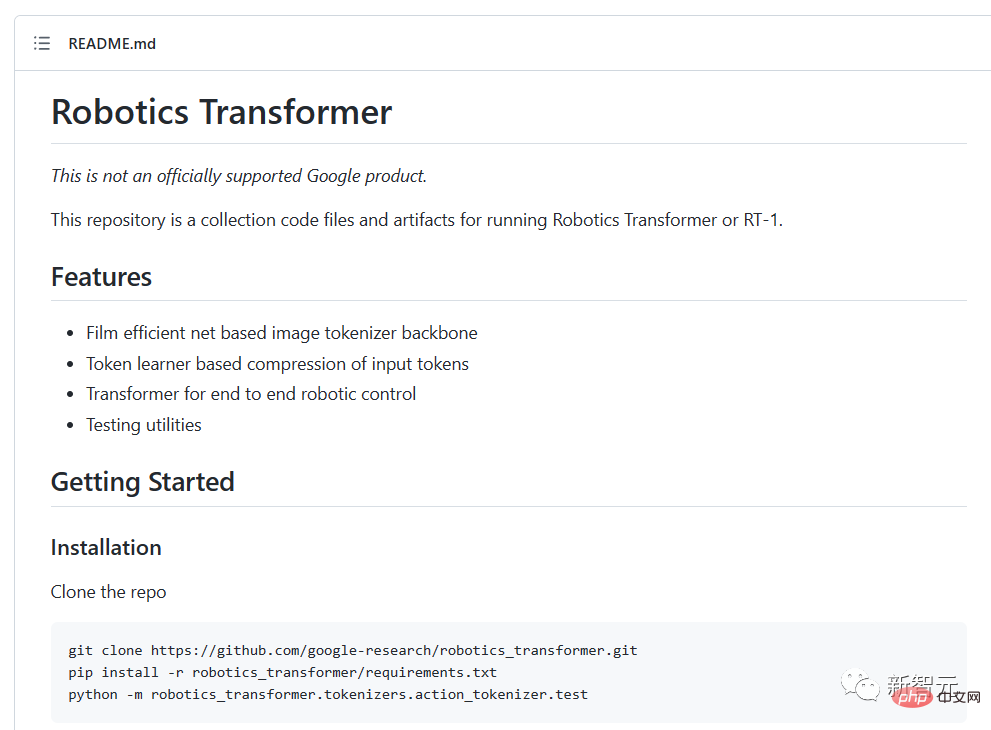

Der Herausgeber hat auch den Github-Link unten sorgfältig platziert. Wenn Sie interessiert sind, schauen Sie bitte vorbei.

https://github.com/google-research/robotics_transformer

RT-1 modellspezifisches Prinzip

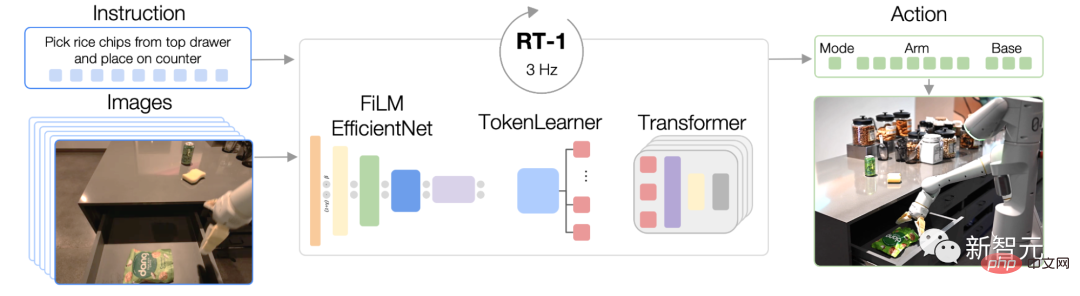

RT-1 basiert auf der Transformer-Architektur, die das transformieren kann Der Bildverlauf des Roboters wird von der Kamera abgerufen und die in natürlicher Sprache ausgedrückte Aufgabenbeschreibung wird als Eingabe verwendet, während die markierten Aktionen direkt ausgegeben werden. Die Architektur von

RT-1 ähnelt der eines Nur-Decoder-Sequenzmodells, das auf einem standardmäßigen kategorialen Kreuzentropieziel mit kausaler Maskierung trainiert wird.

Das Modell verwendet Textanweisungen und eine Reihe von Bildern als Eingabe, codiert sie über das vorab trainierte FiLM EfficientNet-Modell in Token, komprimiert sie über TokenLearner und gibt dann Aktionstoken über Transformer aus.

Zu seinen Hauptfunktionen gehören: Bild-Tokenisierung, Aktions-Tokenisierung und Token-Komprimierung.

- Bild-Tokenisierung: Wir leiten das Bild durch das auf ImageNet vorab trainierte EfficientNet-B3-Modell und reduzieren dann die resultierende räumliche 9×9×512-Feature-Map in 81 Token. Der Bild-Tokenizer basiert auf Aufgabenanweisungen in natürlicher Sprache und extrahiert frühzeitig aufgabenrelevante Bildmerkmale mithilfe einer auf Identität initialisierten FiLM-Ebene.

- Aktionstokenisierung: Die Aktionsdimensionen des Roboters sind 7 Variablen der Armbewegung (x, y, z, Rollen, Nicken, Gier, Klammeröffnung) und 3 grundlegende Bewegungsvariablen (x, y, Giernavigation). ) und eine zusätzliche diskrete Variable zum Umschalten zwischen den drei Modi.

- Token-Komprimierung: Das Modell wählt adaptiv weiche Kombinationen von Bild-Token aus, die basierend auf ihrer Auswirkung auf das Lernen mithilfe des Element-Aufmerksamkeitsmoduls TokenLearner komprimiert werden können, was zu einer über 2,4-mal schnelleren Inferenz führt.

Wir verwenden Demos, die von Menschen per Fernbedienung bereitgestellt werden, und kommentieren jede Episode mit Textbeschreibungen der Roboter, die Anweisungen ausführen.

Und dieser Roboter verlässt sich bei der Ausführung von Aufgaben auf „einen Arm mit 7 Freiheitsgraden, einen Zwei-Finger-Greifer und eine mobile Basis“.

Zu den im Datensatz dargestellten hochqualifizierten Fertigkeiten gehören Vorgänge wie das Aufnehmen und Platzieren von Gegenständen, das Öffnen und Schließen von Schubladen, das Einlegen und Herausnehmen von Gegenständen in Schubladen, das Aufrichten schlanker Gegenstände, das Umstoßen von Gegenständen usw.

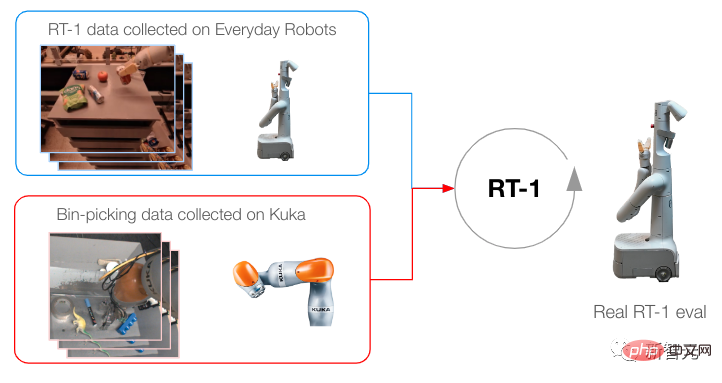

Integration heterogener Datenquellen

Um RT-1 weiter voranzutreiben, haben wir es mithilfe der von einem anderen Roboter gesammelten Daten trainiert, um (1) zu testen, ob das Modell seine Leistung bei der ursprünglichen Aufgabe beibehält, wenn neue Datenquellen präsentiert werden. und (2) ob sich das Modell bei der Generalisierung mit neuen und unterschiedlichen Daten verbessert.

Wir transformieren die gesammelten Daten so, dass sie den Aktionsspezifikationen und Grenzen der ursprünglichen Datensätze entsprechen, die wir mithilfe von EDR gesammelt haben, und kennzeichnen jeden Datensatz mit Aufgabenanweisungen.

Mischen Sie dann die Kuka-Daten mit den EDR-Daten in einem Verhältnis von 1:2 in jedem Trainingsstapel, um die Regression der ursprünglichen EDR-Fähigkeit zu steuern.

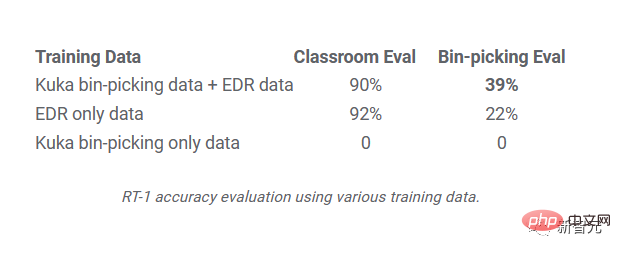

Das Bild zeigt die Trainingsmethode beim Sammeln von Daten von mehreren Robotern

Die Ergebnisse zeigen, dass RT-1 in der Lage ist, neue Fähigkeiten zu erwerben, indem er die Erfahrungen anderer Roboter beobachtet.

Als RT-1 mit Kukas Bin-Picking-Daten und vorhandenen EDR-Daten aus dem Robotik-Klassenzimmer trainiert wurde, stieg die Genauigkeit um fast das Zweifache auf 39 %, verglichen mit 22 %, wenn nur mit EDR-Daten trainiert wurde.

Beim Training des RT-1 allein anhand der Kommissionierungsdaten von Kuka und der Auswertung anhand der Kommissionierungsdaten des EDR-Roboters lag die Genauigkeit bei 0 %.

Experimentelle Ergebnisse

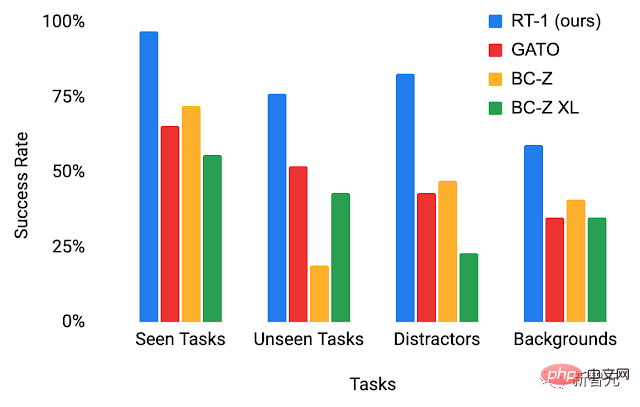

Um die Generalisierungsfähigkeit von RT-1 besser zu verstehen, haben wir seine Leistung anhand von drei Basislinien untersucht: Gato, BC-Z und BC-Z XL (d. h. mit demselben BC-Z für quantitative Parameter).

und unterteilte es in vier Kategorien:

Das Bild zeigt die Leistung von RT-1 und der Kontrollgruppe in der Testumgebung

- Gesehene Aufgabenleistung: während des Trainings beobachtete Aufgabenleistung;

-

Unsichtbare Aufgabenleistung: Leistung bei unsichtbaren Aufgaben, bei denen Fähigkeiten und Objekte im Trainingssatz getrennt sind; Störfaktoren und Leistung von Hintergrundänderungen (neue Küche, Beleuchtung, Hintergrundszenen)

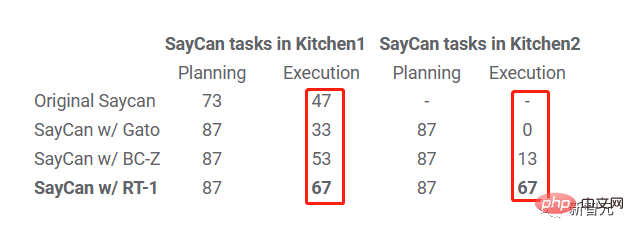

Szenarien mit langem Horizont): Ausführung von SayCan-ähnlichen Anweisungen in natürlicher Sprache in echten Küchen - Die hohen Leistungs- und Generalisierungsfähigkeiten von RT-1 kann über SayCan Fern- und mobile Einsatzaufgaben realisieren.

- SayCan funktioniert, indem es ein Sprachmodell in die Möglichkeiten des Roboters einfügt und eine Handvoll Hinweise nutzt, um die langfristige Aufgabe, natürliche Sprache auszudrücken, in eine Reihe von Fertigkeiten auf niedrigem Niveau zu zerlegen.

Wir evaluieren SayCan in zwei echten Küchen mit RT-1 und zwei weiteren Basislinien (SayCan mit Gato und SayCan mit BC-Z).

Im Folgenden stellt „Küche2“ ein anspruchsvolleres Verallgemeinerungsszenario dar als „Küche1“. Die simulierte Küche, die zum Sammeln der meisten Trainingsdaten verwendet wurde, wurde nach Kitchen1 modelliert.

Es ist ersichtlich, dass die Ausführungserfolgsrate von SayCan mit RT-1 in Kitchen1 67 % beträgt, was besser ist als bei anderen Basislinien.

Aufgrund der durch die neue unsichtbare Küche verursachten Generalisierungsschwierigkeiten verringerte sich die Leistung von SayCan mit Gato und SayCan mit BCZ, die Erfolgsquote von RT-1 verringerte sich jedoch nicht.

Aufgrund der durch die neue unsichtbare Küche verursachten Generalisierungsschwierigkeiten verringerte sich die Leistung von SayCan mit Gato und SayCan mit BCZ, die Erfolgsquote von RT-1 verringerte sich jedoch nicht.

Das obige ist der detaillierte Inhalt vonDas Google RT-1-Modell fordert einen Roboter auf, mehrere Aufgaben zu erledigen, mit einer Erfolgsquote von 97 % für 700 Anweisungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Wie kann KI Roboter autonomer und anpassungsfähiger machen?

Jun 03, 2024 pm 07:18 PM

Wie kann KI Roboter autonomer und anpassungsfähiger machen?

Jun 03, 2024 pm 07:18 PM

Im Bereich der industriellen Automatisierungstechnik gibt es zwei aktuelle Hotspots, die kaum zu ignorieren sind: Künstliche Intelligenz (KI) und Nvidia. Ändern Sie nicht die Bedeutung des ursprünglichen Inhalts, optimieren Sie den Inhalt, schreiben Sie den Inhalt neu, fahren Sie nicht fort: „Darüber hinaus sind beide eng miteinander verbunden, da Nvidia nicht auf seine ursprüngliche Grafikverarbeitungseinheit (GPU) beschränkt ist ) erweitert es seine GPU. Die Technologie erstreckt sich auf den Bereich der digitalen Zwillinge und ist eng mit neuen KI-Technologien verbunden. „Vor kurzem hat NVIDIA eine Zusammenarbeit mit vielen Industrieunternehmen geschlossen, darunter führende Industrieautomatisierungsunternehmen wie Aveva, Rockwell Automation und Siemens und Schneider Electric sowie Teradyne Robotics und seine Unternehmen MiR und Universal Robots. Kürzlich hat Nvidia gesammelt

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

Mit einer einzelnen Karte läuft Llama 70B schneller als mit zwei Karten, Microsoft hat gerade FP6 in A100 integriert |

Apr 29, 2024 pm 04:55 PM

FP8 und die geringere Gleitkomma-Quantifizierungsgenauigkeit sind nicht länger das „Patent“ von H100! Lao Huang wollte, dass jeder INT8/INT4 nutzt, und das Microsoft DeepSpeed-Team begann, FP6 auf A100 ohne offizielle Unterstützung von NVIDIA auszuführen. Testergebnisse zeigen, dass die FP6-Quantisierung der neuen Methode TC-FPx auf A100 nahe an INT4 liegt oder gelegentlich schneller als diese ist und eine höhere Genauigkeit aufweist als letztere. Darüber hinaus gibt es eine durchgängige Unterstützung großer Modelle, die als Open-Source-Lösung bereitgestellt und in Deep-Learning-Inferenz-Frameworks wie DeepSpeed integriert wurde. Dieses Ergebnis wirkt sich auch unmittelbar auf die Beschleunigung großer Modelle aus – in diesem Rahmen ist der Durchsatz bei Verwendung einer einzelnen Karte zum Ausführen von Llama 2,65-mal höher als der von Doppelkarten. eins