Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Der Vater von ChatGPT „kann nachts nicht schlafen': Ich mache mir große Sorgen, dass das große Modell missbraucht wird

Der Vater von ChatGPT „kann nachts nicht schlafen': Ich mache mir große Sorgen, dass das große Modell missbraucht wird

Der Vater von ChatGPT „kann nachts nicht schlafen': Ich mache mir große Sorgen, dass das große Modell missbraucht wird

Laut Nachrichten vom 21. März sagte Sam Altman, CEO der Start-up-Organisation für künstliche Intelligenz OpenAI, letzte Woche in einem Interview, dass künstliche Intelligenz möglicherweise „das Beste ist, was Menschen bisher entwickelt haben“. „Die größte Technologie“ wird die bestehende Gesellschaft umgestalten. Gleichzeitig räumte er aber auch ein, dass diese Technologie Risiken birgt und habe immer noch „ein wenig Angst“ davor.

Altmann betonte, dass künstliche Intelligenz echte Gefahren mit sich bringt, sie aber möglicherweise auch „die größte Technologie ist, die bisher von der Menschheit entwickelt wurde“, die die Gesellschaft umgestalten und weltbewegende Veränderungen im Leben herbeiführen kann.

Er sagte: „Wir müssen in dieser Hinsicht vorsichtig sein … Ich denke, zum Glück haben wir ein wenig Angst davor.“

Altman sprach im Interview über die neueste Version des Sprachmodells für künstliche Intelligenz, das kürzlich von OpenAI veröffentlicht wurde GPT-4. Er betonte, dass die Einführung von ChatGPT die gemeinsame Beteiligung von Regulierungsbehörden und der gesamten Gesellschaft erfordert und verschiedene Rückmeldungen dazu beitragen können, mögliche negative Auswirkungen der Technologie der künstlichen Intelligenz auf den Menschen zu verhindern. Er fügte hinzu, dass er in „regelmäßigem Kontakt“ mit Regierungsbeamten gestanden habe.

In nur wenigen Monaten seit der Einführung von ChatGPT hat die Zahl der monatlich aktiven Benutzer 100 Millionen überschritten und es gilt als die am schnellsten wachsende Verbraucheranwendung in der Geschichte. Laut einer UBS-Studie brauchte TikTok neun Monate, um monatlich 100 Millionen aktive Nutzer zu gewinnen, und Instagram fast drei Jahre.

Obwohl es noch nicht perfekt ist, sagte Altman, dass GPT-4 in der amerikanischen Rechtsprüfung eine gute Punktzahl von 90 und im SAT-Mathematiktest eine nahezu perfekte Punktzahl erreicht habe. GPT-4 kann jetzt Computercode in den meisten Programmiersprachen auf dem Markt kompetent schreiben.

GPT-4 ist nur ein kleiner Schritt auf dem Weg zur ultimativen Schaffung allgemeiner künstlicher Intelligenz durch OpenAI. Wenn die Technologie der künstlichen Intelligenz bahnbrechende Fortschritte macht, werden künstliche Intelligenzsysteme auftauchen, die intelligenter sind als Menschen. Dies ist die sogenannte allgemeine künstliche Intelligenz.

Obwohl Altman den Erfolg seines Produkts lobt, gibt er auch zu, dass ihn die möglichen Gefahren der künstlichen Intelligenz schlaflos machen.

Ich bin besonders besorgt darüber, dass diese Modelle dazu verwendet werden, Desinformation in großem Maßstab zu erzeugen“, sagte Altman. „Da sie jetzt immer besser darin werden, Computercode zu schreiben, können sie für offensive Cyberangriffe verwendet werden.“

Aber Al Terman glaubt nicht, dass Modelle der künstlichen Intelligenz nicht mehr darauf angewiesen sein werden, dass Menschen, wie in der Science-Fiction beschrieben, selbstständig Entscheidungen treffen und die Weltherrschaft planen. „Es wartet darauf, dass ihm jemand Informationen zuführt“, sagte Altman. „Es ist immer noch ein von Menschen kontrolliertes Werkzeug.“ Allerdings mache er sich Sorgen darüber, wer die künstliche Intelligenz kontrollieren werde. „Es wird immer Menschen geben, die einige der von uns festgelegten Sicherheitsregeln nicht befolgen“, fügte er hinzu. „Ich denke, dass der Gesellschaft als Ganzes nicht mehr viel Zeit bleibt, um herauszufinden, wie sie darauf reagieren soll.“

Als er die Idee kommentierte, dass die Beherrschung der Technologie der künstlichen Intelligenz „die Welt dominieren“ könnte, sagte Altman: „Das ist sicherlich eine erschreckende Aussage.“ „Im Gegenteil, was Ich hoffe, dass wir weiterhin immer leistungsfähigere Systeme entwickeln, die es den Menschen ermöglichen, diese Systeme auf unterschiedliche Weise zu nutzen, sodass das System in unser tägliches Leben und in die Wirtschaft integriert werden kann, um den Wünschen der Menschen voll Rechnung zu tragen.“

Bedenken hinsichtlich Fehlinformationen

Laut OpenAI hat GPT-4 durch Iteration enorme Verbesserungen erzielt, beispielsweise die Fähigkeit, Bilder als Eingabe zu verstehen. Demonstrationen haben gezeigt, dass GTP-4 den Inhalt eines Kühlschranks beschreiben, Rätsel lösen und sogar verborgene Bedeutungen hinter Internetbildern aufklären kann.

Aber Altman sagte, dass das inhärente Problem bei Sprachmodellen mit künstlicher Intelligenz wie ChatGPT Fehlinformationen seien und das Programm den Benutzern möglicherweise sachlich ungenaue Informationen liefern könne.

Altmann sagte: „Woran ich die Menschen am meisten erinnern möchte, ist das sogenannte ‚Illusionsproblem‘.“ „Dieses Modell wird tatsächlich eine Sache mit Zuversicht ausdrücken und etwas völlig Erfundenes wie eine Tatsache erscheinen lassen.“ KI-Modelle leiden teilweise unter diesem Problem, weil sie deduktives Denken anstelle von Gedächtnis verwenden.

Mira Murati, Chief Technology Officer von OpenAI, sagte einmal: „Einer der größten Unterschiede zwischen GPT-3.5 und GPT-4 besteht darin, dass letzteres über stärkere Emerging-Fähigkeiten im Denken verfügt.“

Murati sagte: „Das Ziel ist, dass die KI vorhersagt.“ welches Wort als nächstes kommt, das ist ein Verständnis der Natur der Sprache.“ „Wir möchten, dass diese Modelle die Welt so sehen und verstehen, wie es Menschen tun.“

„Man muss sich darüber im Klaren sein, dass das von uns entwickelte Modell eine Inferenzmaschine und keine Datenbank mit Fakteninformationen ist“, sagte Altman. „Natürlich können sie auch als Faktendatenbanken verwendet werden, aber das ist nichts Besonderes. Was wir mit ihnen erreichen wollen.“ ist Denken, nicht Gedächtnis.“ Altman und sein Team hoffen, dass „dieses Modell mit der Zeit zu einer echten Argumentationsmaschine wird“, sagte er, und dass das Modell schließlich auf das Internet angewiesen sein wird. Informationen und selbstdeduktives Denken zur Unterscheidung welche Informationen sachlich und welche Fiktion sind. Laut OpenAI-Daten ist die Wahrscheinlichkeit, dass GPT-4 genaue Informationen liefert, um 40 % höher als bei früheren Versionen. Doch Altman sagte, die Menschen sollten sich nicht auf das System als primäre Quelle für genaue Informationen verlassen und forderte die Benutzer auf, die vom Programm erzeugten Ergebnisse sorgfältig zu prüfen. So schützt man sich vor BösewichtenViele Menschen sind auch besorgt darüber, welche Art von Informationen ChatGPT und andere Sprachmodelle für künstliche Intelligenz generieren werden. Laut Altman sagt ChatGPT den Benutzern aufgrund der im System integrierten Sicherheitsmaßnahmen nicht, wie man eine Bombe baut. „Was mir Sorgen bereitet, ist, dass wir nicht die Einzigen sind, die diese Technologie entwickeln“, sagte Altman. „Es wird immer Leute geben, die nicht wie wir Sicherheitsmaßnahmen ergreifen.“ Laut Altman gibt es einige Lösungen und Schutzmaßnahmen für all diese potenziellen Gefahren der künstlichen Intelligenz. Eine besteht darin, die Gesellschaft mit ChatGPT herumspielen zu lassen, wenn der Einsatz gering ist, um zu sehen, wie die Leute es nutzen. Mulati sagte, dass der Hauptgrund, warum ChatGPT jetzt für die Öffentlichkeit zugänglich ist, darin besteht, „viel Feedback zu sammeln“. Sie glaubt, dass es einfacher werden wird, festzustellen, wo Sicherheitsmaßnahmen erforderlich sind, wenn die Öffentlichkeit weiterhin OpenAI-Anwendungen testet. Mulati sagte: „Wofür die Leute sie verwenden, welche Probleme es hat, welche Mängel es hat, all das ermöglicht es uns, rechtzeitig einzugreifen und die Technologie zu verbessern.“ Altman betonte auch, dass die Öffentlichkeit mit jeder Version von ChatGPT interagieren kann Es ist wichtig zu interagieren. Er sagte: „Wenn wir einfach im Labor sitzen und geheime Forschung betreiben, wie zum Beispiel die Entwicklung von GPT-7, und es dann auf einmal veröffentlichen … Ich denke, das wird mehr negative Auswirkungen haben.“ „Die Leute brauchen Zeit, um sich zu erholen.“ Wenn wir sie verstehen, reagieren und uns schließlich an diese Technologie gewöhnen, brauchen wir auch Zeit, um zu verstehen, wo die Mängel des Systems liegen und wie wir die nachteiligen Auswirkungen abmildern können. und sie entscheiden, welche Informationen ChatGPT eingegeben werden kann und welche Informationen ChatGPT mit Benutzern teilen kann. Altman fügte hinzu: „(Wir) sprechen mit Politik- und Sicherheitsexperten, um das System zu überprüfen, nur um diese Probleme zu lösen und etwas auf den Markt zu bringen, von dem wir glauben, dass es sicher und zuverlässig ist.“ „Auch hier können wir es nicht sofort perfekt machen.“ Zeit, aber es ist wichtig, Lehren zu ziehen und sichere Margen zu finden, wenn die Risiken relativ gering sind.“ Wird KI Arbeitsplätze ersetzen? es wird bestehende Arbeitsplätze verdrängen. Künstliche Intelligenz könnte in naher Zukunft einige Arbeitsplätze ersetzen, sagte Altman, aber es werde davon abhängen, wie schnell dies geschieht. Altmann sagte: „Ich denke, dass sich der Mensch im Laufe mehrerer Generationen als fähig erwiesen hat, sich an große technologische Veränderungen anzupassen.“ bewirkte... …“Aber er ermutigte die Menschen, ChatGPT als Werkzeug und nicht als Ersatz für ihre eigene Arbeit zu betrachten. Altman fügte hinzu: „Die menschliche Kreativität ist unbegrenzt, wir werden neue Jobs finden, wir werden neue Dinge tun können.“ Altman glaubt, dass ChatGPT als menschliches Werkzeug mehr Auswirkungen hat, als es Risiken mit sich bringt. Er sagte: „Wir können alle einen maßgeschneiderten, großartigen Pädagogen in der Tasche haben, der uns beim Lernen hilft.“ „Wir können jedem medizinische Ratschläge geben, was wir heute nicht erreichen können.“ChatGPT hat im Bildungsbereich für viele Kontroversen gesorgt, weil einige Schüler ChatGPT zum Betrügen nutzen. Pädagogen sind sich uneinig darüber, ob ChatGPT als Erweiterung des Lernens der Schüler dienen kann oder ob es die Motivation der Schüler zum eigenständigen Lernen beeinträchtigt.

„Die Art und Weise, wie Bildung sich verändert, aber das ist im Zuge der Weiterentwicklung der Technologie schon oft passiert“, sagte Altman. Er fügte hinzu, dass die Lehrer nicht mehr auf den Unterricht beschränkt sein werden. „Was mich am meisten begeistert, ist, dass es so ist.“ kann zu einem besseren personalisierten Lernen für jeden Schüler führen.“

Altmann und sein Team hoffen, dass Benutzer in allen Bereichen ChatGPT als ihren „Co-Piloten“ betrachten können, der Benutzern beispielsweise dabei hilft, große Mengen Computercode zu schreiben oder Probleme zu lösen.

„Wir können Dienstleistungen wie diese für jede Branche anbieten, damit die Menschen eine höhere Lebensqualität haben“, sagte Altman. „Wir werden auch neue Dinge haben, die heute noch nicht einmal vorstellbar sind, und das ist unser Versprechen.“

Das obige ist der detaillierte Inhalt vonDer Vater von ChatGPT „kann nachts nicht schlafen': Ich mache mir große Sorgen, dass das große Modell missbraucht wird. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

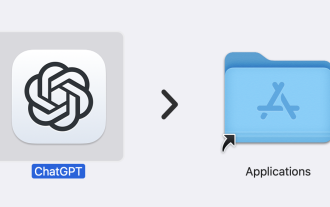

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

ChatGPT ist jetzt mit der Veröffentlichung einer speziellen App für macOS verfügbar

Jun 27, 2024 am 10:05 AM

Die ChatGPT-Mac-Anwendung von Open AI ist jetzt für alle verfügbar, während sie in den letzten Monaten nur denjenigen mit einem ChatGPT Plus-Abonnement vorbehalten war. Die App lässt sich wie jede andere native Mac-App installieren, sofern Sie über ein aktuelles Apple S verfügen

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht