Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Wang Lin von Taifan Technology: Graphdatenbank – ein neuer Weg zur kognitiven Intelligenz

Wang Lin von Taifan Technology: Graphdatenbank – ein neuer Weg zur kognitiven Intelligenz

Wang Lin von Taifan Technology: Graphdatenbank – ein neuer Weg zur kognitiven Intelligenz

Gast | 🎜#organisieren|. Zhang Feng

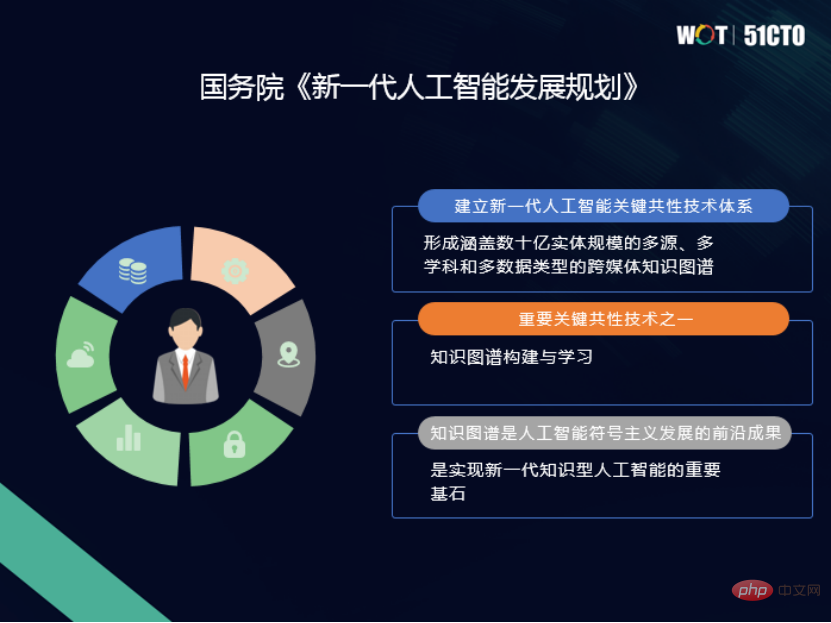

Planung |. # 🎜🎜#Es gibt zwei relativ große Fraktionen der künstlichen Intelligenz: Rationalismus und Empirismus. Doch bei echten Industrieprodukten ergänzen sich diese beiden Fraktionen. Um mehr Kontrollierbarkeit und mehr Wissen in die Black Box dieses Modells einzuführen, ist die Anwendung von Wissensgraphen erforderlich, die symbolisches Wissen enthalten.

Vor ein paar Tagen auf der WOT Global Technology Innovation Conference, veranstaltet von 51CTO #🎜 🎜#, Dr. Wang Lin, CTO von Taifan Technology, brachte den Teilnehmern die Entwicklung des Themas „Graph Database: A New Path to Cognitive Intelligence“ näher und konzentrierte sich dabei auf die Geschichte und Entwicklung des Graphen Datenbankmodell; Eine wichtige Möglichkeit für Graphdatenbanken, kognitive Intelligenz sowie das Design von Graphdatenbanken und praktische Erfahrungen mit OpenGauss zu realisieren.

Der Vortragsinhalt ist nun wie folgt gegliedert, ich hoffe, er wird Sie inspirieren:

Der andere Typ istSymbolismus, der normalerweise den menschlichen Geist simuliert. Kognitive Prozesse sind Operationen an symbolischen Darstellungen. Daher wird es oft zum Nachdenken und Argumentieren verwendet. Eine typische repräsentative Technologie ist der Wissensgraph.

4 Möglichkeiten zur Verbesserung der KI#🎜🎜 #1 . Situative Entscheidungsfindung

Wissensgraph ist im Wesentlichen ein graphbasiertes semantisches Netzwerk, das Entitäten und Beziehungen zwischen Entitäten darstellt. Auf einer höheren Ebene ist ein Wissensgraph auch eine Sammlung miteinander verknüpften Wissens, das die reale Welt und die Beziehungen zwischen Entitäten und Dingen in einer für Menschen verständlichen Form beschreibt.

Knowledge Graph kann uns mehr Fachwissen und Kontextinformationen liefern, die uns bei der Entscheidungsfindung helfen. Aus Anwendungssicht können Wissensgraphen in drei Typen unterteilt werden:Die erste ist die  domänenbezogene Wissenslandkarte.

domänenbezogene Wissenslandkarte.

Das zweite ist

Wissensdiagramm zur externen Wahrnehmung. Aggregieren Sie externe Datenquellen und ordnen Sie sie internen relevanten Einheiten zu. Eine typische Anwendung ist die Risikoanalyse der Lieferkette. Über die Lieferkette können Sie Informationen über Lieferanten, deren vor- und nachgelagerte Lieferketten, Fabriken und andere Lieferketten einsehen, sodass Sie analysieren können, wo es Probleme gibt und ob Unterbrechungsrisiken bestehen.

Der dritte ist

Natural Language Processing Knowledge Graph. Die Verarbeitung natürlicher Sprache umfasst eine große Anzahl technischer Begriffe und sogar Schlüsselwörter in diesem Bereich, die uns bei Abfragen in natürlicher Sprache helfen können.

2. Verbessern Sie die Betriebseffizienz

Darüber hinaus müssen maschinelle Lernalgorithmen häufig auf allen Daten berechnet werden. Durch eine einfache Diagrammabfrage können Sie den Teilgraphen der erforderlichen Daten zurückgeben und so die Betriebseffizienz beschleunigen. 3. Verbessern Sie die Vorhersagegenauigkeit Diagramm erhalten.

Durch die Verknüpfung von Daten und Beziehungsdiagrammen können die Merkmale von Beziehungen direkter extrahiert werden. Doch bei traditionellen Methoden des maschinellen Lernens gehen beim Abstrahieren und Vereinfachen von Daten manchmal tatsächlich viele wichtige Informationen verloren. Daher ermöglichen uns relationale Eigenschaften eine Analyse, ohne diese Informationen zu verlieren. Darüber hinaus vereinfachen Diagrammalgorithmen den Prozess der Erkennung von Anomalien wie engen Gemeinschaften. Wir können Knoten innerhalb enger Communities bewerten und diese Informationen extrahieren, um sie beim Training von Modellen für maschinelles Lernen zu verwenden. Abschließend erfolgt die Merkmalsauswahl mithilfe von Diagrammalgorithmen, um die Anzahl der im Modell verwendeten Merkmale auf eine möglichst relevante Teilmenge zu reduzieren.

4. Erklärbarkeit

In den letzten Jahren haben wir oft von „Erklärbarkeit“ gehört, was auch der Prozess der Anwendung künstlicher Intelligenz ist. Eine besonders große Herausforderung besteht darin, dass wir verstehen müssen, wie künstliche Intelligenz zu dieser Entscheidung und diesem Ergebnis gelangt. Gleichzeitig gibt es viele Anforderungen an die Erklärbarkeit, insbesondere in einigen spezifischen Anwendungsbereichen wie Medizin, Finanzen und Justiz.

Interpretierbarkeit umfasst drei Aspekte:

(1) Interpretierbarkeit Die Daten von #🎜 🎜#. Wir müssen wissen, warum die Daten ausgewählt wurden und woher die Daten stammen. Daten müssen interpretierbar sein.

(2) Interpretierbare Vorhersage . Interpretierbare Vorhersagen bedeuten, dass wir wissen müssen, welche Merkmale verwendet werden und welche Gewichte für eine bestimmte Vorhersage verwendet werden.

(3) Interpretierbarer Algorithmus . Die aktuellen Aussichten für erklärbare Algorithmen sind sehr attraktiv, aber es gibt noch einen langen Weg, der derzeit im Forschungsbereich vorgeschlagen wird, und solche Methoden können verwendet werden, um Algorithmen eine gewisse Interpretierbarkeit zu verleihen.

Da Grafiken für die Anwendung und Entwicklung so wichtig sind der künstlichen Intelligenz, wie können wir sie also sinnvoll nutzen? Das erste, worauf Sie achten müssen, ist die Speicherverwaltung des Diagramms, bei der es sich um das Diagrammdatenmodell handelt.

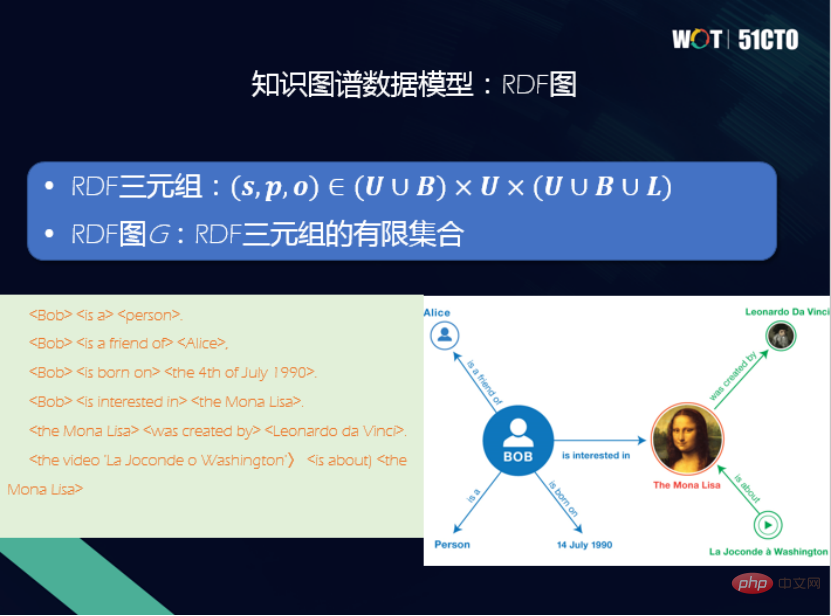

Es gibt derzeit zwei gängigste Diagrammdatenmodelle: RDF-Diagramm und Attributdiagramm.

1. RDF-DiagrammRDF steht für Resource Description Framework. Es wird vom W3C formuliert und dient zur Darstellung der Austauschfähigkeiten von Maschinen im Semantic World Wide Web. Ein Standarddatenmodell zum Verständnis von Informationen. In einem RDF-Diagramm verfügt jede Ressource über eine HTTP-URL als eine ihrer eindeutigen IDs. Die RDF-Definition hat die Form eines Tripletts und stellt eine Tatsachenfeststellung dar, wobei S das Subjekt, P das Prädikat und O das Objekt darstellt. Auf dem Bild interessiert sich Bob für The MonoLisa und weist darauf hin, dass es sich um ein RDF-Diagramm handelt.

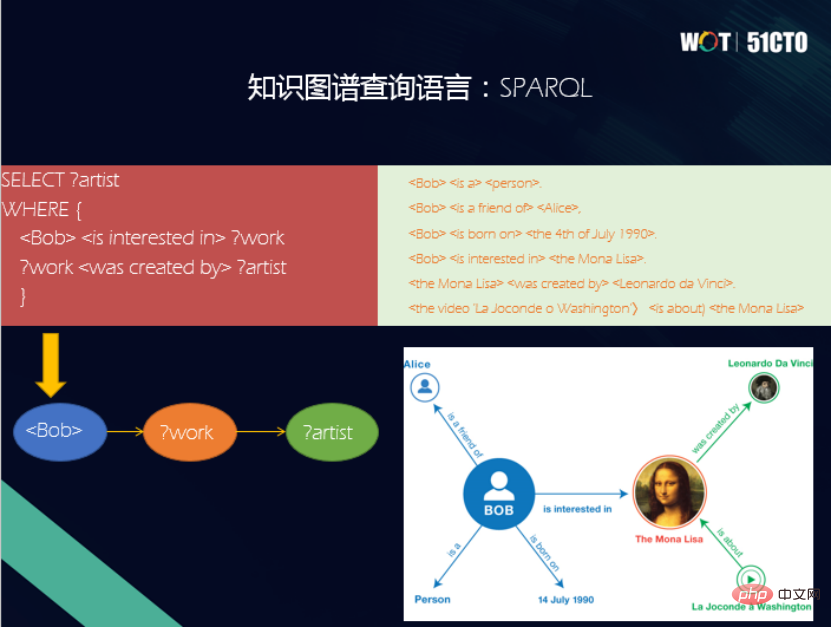

Das dem RDF-Diagramm entsprechende Datenmodell hat seine eigenen eigene Abfragesprache - SPARQL. SPARQL ist die vom W3C entwickelte Standardabfragesprache für RDF-Wissensgraphen. SPARQL lehnt sich in seiner Syntax an SQL an und ist eine deklarative Abfragesprache. Die Grundeinheit der Abfrage ist ebenfalls ein Triplettmuster.

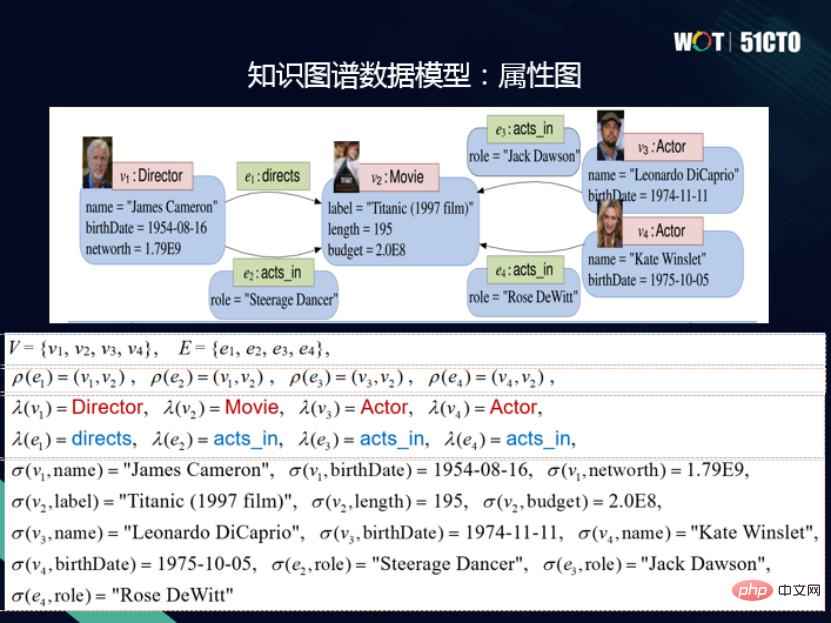

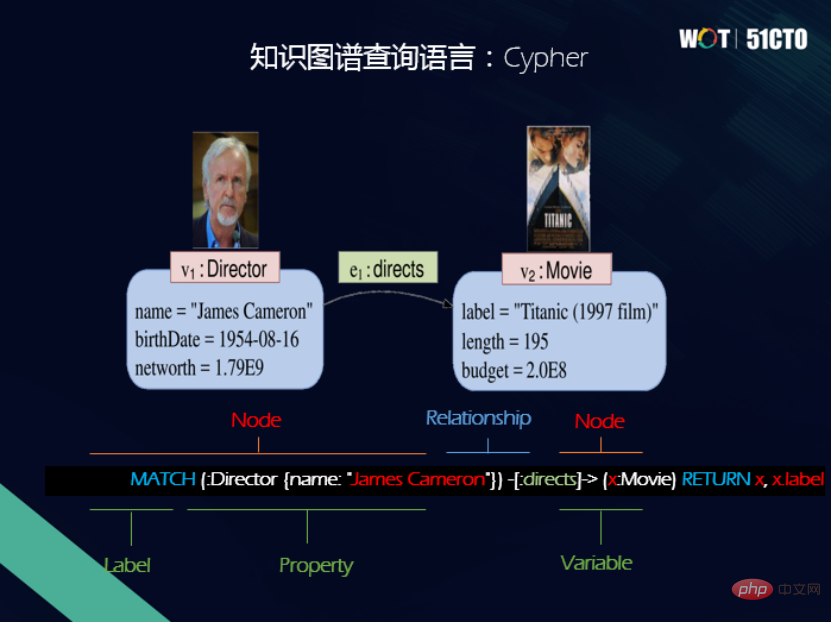

Jeder Scheitelpunkt und jede Kante im Attributdiagramm modellieren Es hat eine eindeutige ID, und die Scheitelpunkte und Kanten haben auch eine Beschriftung, die dem Ressourcentyp im RDF-Diagramm entspricht. Darüber hinaus verfügen Scheitelpunkte und Kanten über eine Reihe von Attributen, die aus Attributnamen und Attributwerten bestehen und so ein Attributdiagrammmodell bilden.

Das gleiche Attributdiagrammmodell verfügt auch über eine Abfragesprache — —Chiffre. Cypher ist ebenfalls eine deklarative Abfragesprache. Benutzer müssen nur angeben, was sie suchen möchten, und müssen nicht angeben, wie sie suchen möchten. Eines der Hauptmerkmale von Cypher ist die Verwendung der künstlerischen ASCII-Syntax, um den Diagrammmustervergleich auszudrücken.

Mit der Entwicklung künstlicher Intelligenz, kognitive Intelligenz Entwicklung und die Anwendung von Wissensgraphen nehmen zu. Daher haben Diagrammdatenbanken in den letzten Jahren immer mehr Aufmerksamkeit auf dem Markt erhalten, aber ein wichtiges Problem, mit dem Diagramme derzeit konfrontiert sind, ist die Inkonsistenz zwischen Datenmodellen und Abfragesprachen, was ein dringendes Problem ist, das gelöst werden muss # 🎜 🎜#.

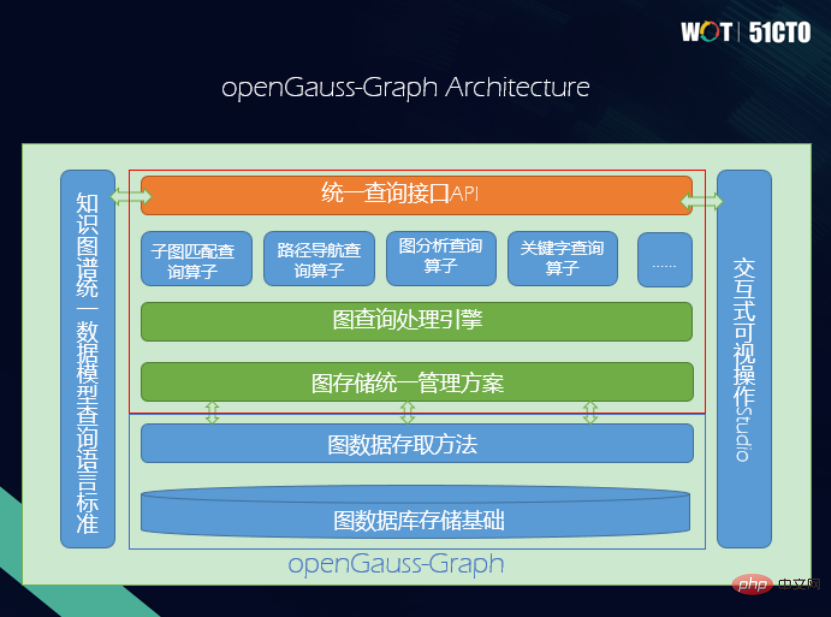

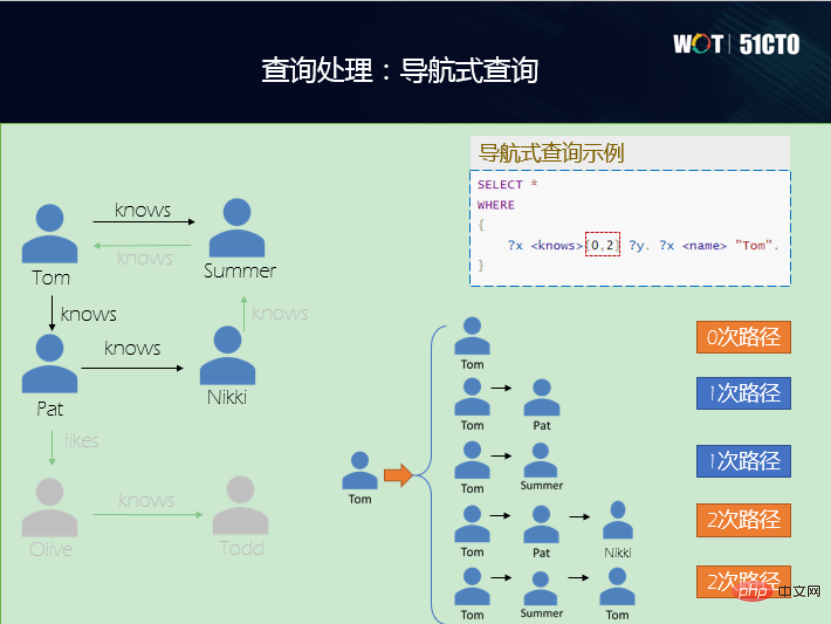

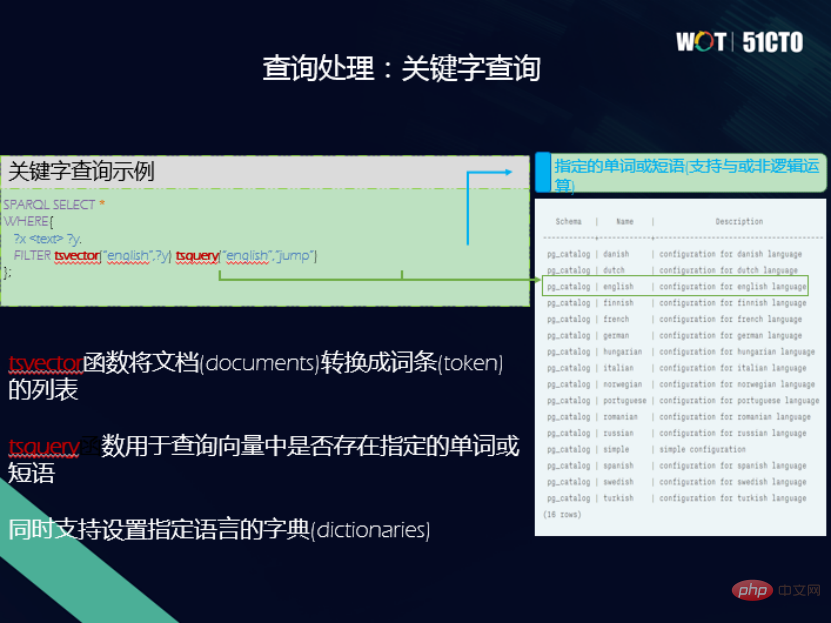

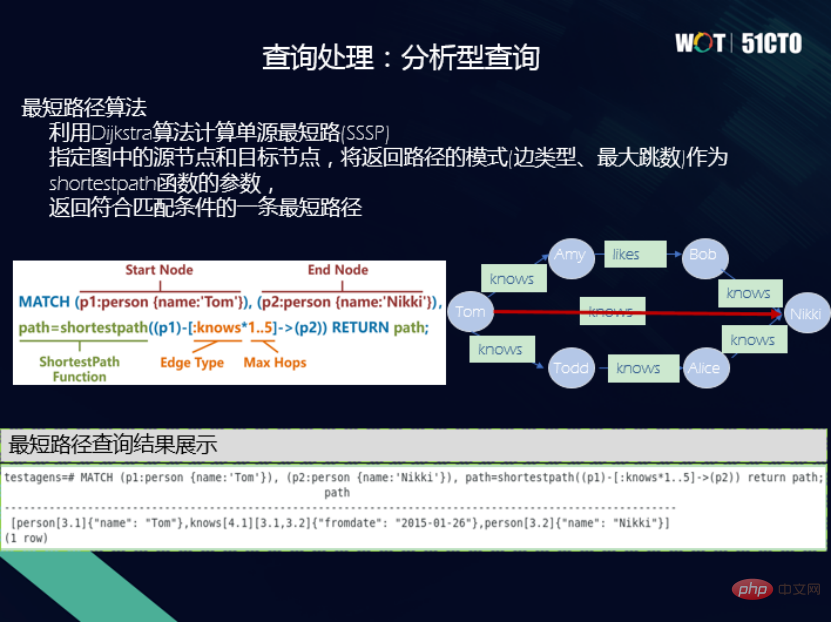

Die Motivation für das Studium der OpenGauss-Graphdatenbank

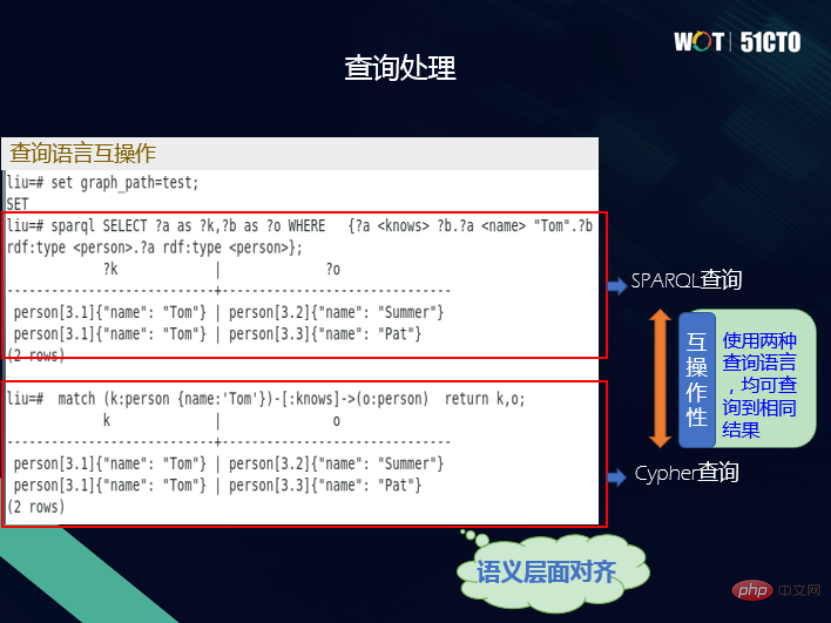

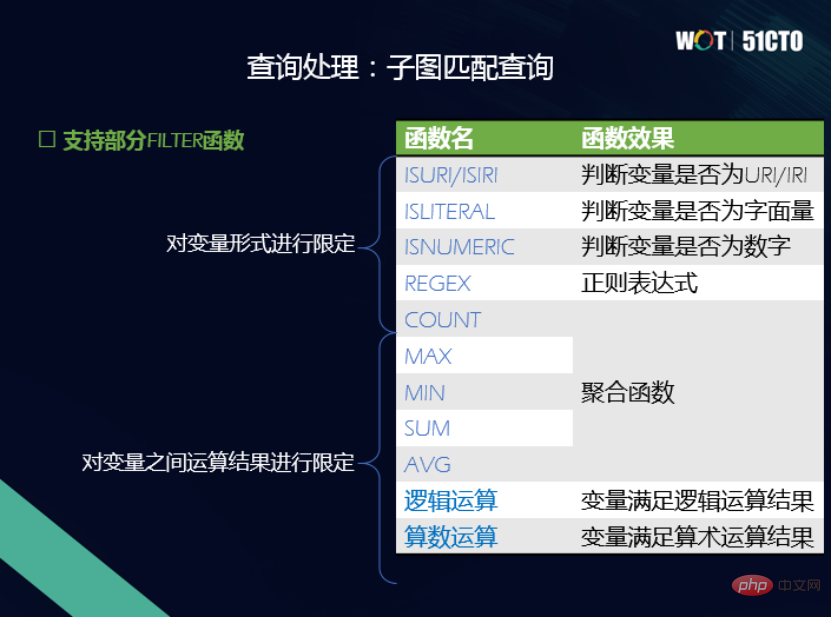

Einerseits möchte ich die Eigenschaften des Wissensgraphen selbst nutzen. Im Hinblick auf hohe Leistung, hohe Verfügbarkeit, hohe Sicherheit sowie einfache Bedienung und Wartung ist es beispielsweise für die Datenbank sehr wichtig, diese Funktionen in die Diagrammdatenbank integrieren zu können. Andererseits beginnen wir mit der Betrachtung des Diagrammdatenmodells. Derzeit gibt es zwei Datenmodelle und zwei Abfragesprachen, wenn Sie die Semantik hinter diesen beiden verschiedenen Abfragesprachen ausrichten, z. B. Projektion, Auswahl, Verknüpfung usw., wenn Sie die Semantik hinter SPARQL- und Cypher-Sprachen ausrichten zwei unterschiedliche Syntaxansichten, wodurch eine natürliche Interoperabilität erreicht wird. Das heißt, die interne Semantik kann konsistent sein, sodass Sie Cypher zum Überprüfen von RDF-Diagrammen und SPARQL auch zum Überprüfen von Attributdiagrammen verwenden können, was eine sehr gute Funktion darstellt. Die unterste Ebene verwendet OpenGauss und verwendet das relationale Modell als Diagramm zum Speichern des physischen Modells. Die Idee besteht darin, die Inkonsistenzen zwischen dem RDF-Diagramm und dem Attributdiagramm aufzulösen Speichern Sie sie physisch unten, indem Sie den größten gemeinsamen Nenner finden. Bilden Sie eine Einheit. Basierend auf dieser Idee ist die unterste Ebene der OpenGauss-Graph-Architektur die Infrastruktur, gefolgt von Zugriffsmethoden, einheitlichen Attributdiagrammen sowie RDF-Diagrammverarbeitungs- und -verwaltungsmethoden. Next ist eine einheitliche Ausführungs-Engine für die Abfrageverarbeitung, die einheitliche semantische Operatoren unterstützt, einschließlich Subgraph-Matching-Operatoren, Pfadnavigationsoperatoren, Graphanalyseoperatoren und Schlüsselwort-Abfrageoperatoren. Weiter oben befindet sich die einheitliche API-Schnittstelle, die eine SPARQL-Schnittstelle und eine Cypher-Schnittstelle bereitstellt. Darüber hinaus gibt es Sprachstandards für eine einheitliche Abfragesprache und eine visuelle Oberfläche für interaktive Abfragen. Beim Design einer Speicherlösung werden hauptsächlich die folgenden zwei Punkte berücksichtigt: (1) Es sollte nicht zu komplex sein, da die Effizienz einer Speicherlösung wichtig ist das zu komplex ist, wird nicht zu hoch sein. (2) Es muss in der Lage sein, die Datentypen von zwei verschiedenen Wissensgraphen geschickt unterzubringen. Daher gibt es eine Aufbewahrungslösung für Spitzentisch und Kantentisch. Es gibt eine gemeinsame Punkttabelle namens Eigenschaften. Für verschiedene Punkte gibt es eine Vererbung; die Kantentabelle wird auch von verschiedenen Kantentabellen geerbt. Für verschiedene Arten von Punkt- und Kantentabellen gibt es eine Kopie, wodurch eine Speicherlösung für eine Sammlung von Punkt- und Kantentabellen erhalten bleibt. Wenn es sich um ein Attributdiagramm handelt, finden Punkte mit unterschiedlichen Beschriftungen unterschiedliche Punktetabellen. Beispielsweise findet Professor die Professor-Punktetabelle. Die Attribute der Punkte werden den Attributspalten in der Punkttabelle zugeordnet. Das Gleiche gilt für die Kantentabelle. Autoren werden der Kantentabelle des Autors zugeordnet, und die Kanten werden einer Zeile in der Kantentabelle mit den IDs von zugeordnet der Startknoten und der Endknoten. Durch eine so scheinbar einfache, aber tatsächlich sehr vielseitige Methode können das RDF-Diagramm und das Attributdiagramm auf der physischen Ebene vereinheitlicht werden. In tatsächlichen Anwendungen gibt es jedoch eine große Anzahl untypisierter Entitäten. Zu diesem Zeitpunkt verwenden wir die Methode zur Klassifizierung der Semantik in der nächstgelegenen typisierten Tabelle. Neben der Speicherung ist die Abfrage das Wichtigste. Auf der semantischen Ebene haben wir Operationen angepasst und Interoperabilität zwischen zwei Abfragesprachen, SPARQL und Cypher, erreicht. In diesem Fall sind zwei Ebenen beteiligt: Grammatik und lexikalisch, und ihre Analyse kann nicht miteinander in Konflikt geraten. Wenn Sie beispielsweise SPARQL aktivieren, aktivieren Sie die Syntax von SPARQL. Wenn Sie Cypher aktivieren, aktivieren Sie die Syntax von Cypher, um Konflikte zu vermeiden. Wir haben auch viele Abfrageoperatoren implementiert. (1) Subgraph-Matching-Abfrage, die Abfrage aller Komponisten, ihrer Kompositionen und des Geburtstags des Komponisten ist ein typisches Subgraph-Matching-Problem. Es kann in Attributdiagramme und RDF-Diagramme unterteilt werden, und ihr allgemeiner Verarbeitungsablauf ist ebenfalls gleich. Beispielsweise wird der entsprechende Punkt zur Verknüpfungsliste hinzugefügt, dann wird eine Auswahloperation für die Eigenschaftenspalte hinzugefügt und dann werden Einschränkungen für die Verbindung zwischen den Punkttabellen auferlegt, die den Kopf- und Endpunktmustern entsprechen. Das RDF-Diagramm führt wichtige Operationen an den Start- und Endpunkten der Kantentabelle aus. Am Ende werden den Variablen Projektionsbeschränkungen hinzugefügt und das Endergebnis ausgegeben. Subgraph-Matching-Abfragen unterstützen auch einige integrierte Funktionen, wie z. B. die FILTER-Funktion, die Variablenformbeschränkungen, logische Operatoren, Aggregation und arithmetische Operatoren unterstützt. Natürlich kann dieser Teil auch kontinuierlich erweitert werden. (2) Navigationsabfrage, die in herkömmlichen relationalen Datenbanken nicht verfügbar ist. Die linke Seite der Abbildung unten ist ein kleines Diagramm für soziale Netzwerke. Sie können sehen, dass das Wissen, das Tom kennt, nicht stimmt. Wenn Sie in der Navigationsabfrage eine Two-Hop-Abfrage durchführen, sehen Sie, wer Tom kennt. Wenn es 0 Sprünge sind, weiß Tom es selbst. Der erste Unterschied besteht darin, dass Tom Pat kennt und Tom Summer kennt. Der zweite Sprung ist, wenn Tom zunächst Pat, dann Nikki und dann wieder Tom kennenlernt. (3) Schlüsselwortabfrage, hier sind zwei Beispiele, tsvector und tsquery. Die eine besteht darin, das Dokument in eine Liste von Begriffen umzuwandeln, die andere darin, abzufragen, ob das angegebene Wort oder die angegebene Phrase im Vektor vorhanden ist. Wenn der Text im Wissensdiagramm relativ lang ist und relativ lange Attribute aufweist, kann diese Funktion verwendet werden, um ihm eine Schlüsselwortsuchfunktion bereitzustellen, was ebenfalls sehr nützlich ist. (4) Analytische Abfragen verfügen über eigene eindeutige Abfragen für Diagrammdatenbanken, z. B. kürzester Pfad , Pagerank usw. sind alles diagrammbasierte Abfrageoperatoren, die sein können Wird verwendet in: In der Diagrammdatenbank implementiert. Um beispielsweise zu überprüfen, was der kürzeste Weg von Tom nach Nikki ist, wird der Operator für den kürzesten Weg über Cypher implementiert, und der kürzeste Weg kann ausgegeben und das Ergebnis gefunden werden. Zusätzlich zu den oben genannten Funktionen haben wir auch ein visuelles interaktives Studio implementiert, in dem Sie die Abfragesprache von Cypher und SPARQL eingeben können, um ein visuelles intuitives Diagramm zu erhalten, das oben angezeigt werden kann Für die Wartung, Verwaltung und Anwendung von Diagrammen können viele Interaktionen an Diagrammen durchgeführt werden. In Zukunft werden wir weitere Operatoren, Diagrammabfragen und Diagrammsuchen hinzufügen, um weitere Anwendungsrichtungen und -szenarien zu realisieren. Abschließend ist jeder herzlich willkommen, die OpenGauss Graph-Community zu besuchen, und auch Freunde, die sich für OpenGauss Graph interessieren, sind herzlich willkommen, der Community als neue Mitwirkende beizutreten und gemeinsam die OpenGauss Graph-Community aufzubauen. Wang Lin, Ph.D. in Ingenieurwesen, Betreuer der OpenGauss-Graphdatenbank-Community, CTO von Taifan Technology, leitender Ingenieur, stellvertretender Vorsitzender der China Computer Association YOCSEF Tianjin 21-22, Mitglied des Sonderausschusses des CCF-Informationssystems, Mitglied des Exekutivausschusses, ausgewählt in das Tianjin 131 Talent Project. OpenGauss – Diagrammarchitektur

Design einer Speicherlösung

Abfrageverarbeitungspraxis

Gastvorstellung

Das obige ist der detaillierte Inhalt vonWang Lin von Taifan Technology: Graphdatenbank – ein neuer Weg zur kognitiven Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Fortgeschrittene Praxis des industriellen Wissensgraphen

Jun 13, 2024 am 11:59 AM

Fortgeschrittene Praxis des industriellen Wissensgraphen

Jun 13, 2024 am 11:59 AM

1. Einführung in den Hintergrund Lassen Sie uns zunächst die Entwicklungsgeschichte von Yunwen Technology vorstellen. Yunwen Technology Company ... 2023 ist die Zeit, in der große Modelle vorherrschen. Viele Unternehmen glauben, dass die Bedeutung von Diagrammen nach großen Modellen stark abgenommen hat und die zuvor untersuchten voreingestellten Informationssysteme nicht mehr wichtig sind. Mit der Förderung von RAG und der Verbreitung von Data Governance haben wir jedoch festgestellt, dass eine effizientere Datenverwaltung und qualitativ hochwertige Daten wichtige Voraussetzungen für die Verbesserung der Wirksamkeit privatisierter Großmodelle sind. Deshalb beginnen immer mehr Unternehmen, darauf zu achten zu wissenskonstruktionsbezogenen Inhalten. Dies fördert auch den Aufbau und die Verarbeitung von Wissen auf einer höheren Ebene, wo es viele Techniken und Methoden gibt, die erforscht werden können. Es ist ersichtlich, dass das Aufkommen einer neuen Technologie nicht alle alten Technologien besiegt, sondern auch neue und alte Technologien integrieren kann.

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S