Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Alarm! Die durch die Explosion von ChatGPT verursachte Energieverbrauchskrise stellt Rechenzentrumsbetreiber vor große Herausforderungen

Alarm! Die durch die Explosion von ChatGPT verursachte Energieverbrauchskrise stellt Rechenzentrumsbetreiber vor große Herausforderungen

Alarm! Die durch die Explosion von ChatGPT verursachte Energieverbrauchskrise stellt Rechenzentrumsbetreiber vor große Herausforderungen

Vor kurzem hat ChatGPT, ein intelligentes Chat-Tool des amerikanischen Unternehmens OpenAI, die sozialen Medien im Sturm erobert, Investitionen in Höhe von über 10 Milliarden US-Dollar angezogen und eine große Begeisterung für Anwendungen der künstlichen Intelligenz auf dem Kapitalmarkt ausgelöst für eine Weile im Rampenlicht stehen.

Microsoft war der erste, der eine Investition von 10 Milliarden US-Dollar in OpenAI ankündigte, und dann gaben Amazon und die US-Version von „Today's Toutiao“ BuzzFeed bekannt, dass sie ChatGPT in ihrer täglichen Arbeit aktivieren würden. Baidu kündigte außerdem an, im März die „chinesische Version“ von ChatGPT auf den Markt zu bringen. Nachdem viele Technologieunternehmen Öl ins Feuer gegossen hatten, erregte ChatGPT sofort weltweite Aufmerksamkeit.

Daten zeigen, dass die Zahl der von Amazon eingesetzten Roboter schnell zunimmt, wobei der tägliche Anstieg etwa 1.000 erreicht. Darüber hinaus will der Facebook-Mutterkonzern Meta im Jahr 2023 weitere 4 bis 5 Milliarden US-Dollar in Rechenzentren investieren, die voraussichtlich vollständig für künstliche Intelligenz genutzt werden. Krishna, CEO von IBM, sagte, dass künstliche Intelligenz bis 2030 voraussichtlich 16 Billionen US-Dollar zur Weltwirtschaft beitragen werde.

Mit der Popularität von ChatGPT könnten Giganten im Jahr 2023 eine neue Runde erbitterter Kämpfe auf dem Gebiet der künstlichen Intelligenz beginnen.

Wenn ChatGPT-3 jedoch das nächste Wort vorhersagt, muss es mehrere Inferenzberechnungen durchführen, was viele Ressourcen beansprucht und mehr Strom verbraucht. Da die Infrastruktur von Rechenzentren erweitert wird, um das explosionsartige Wachstum von Cloud Computing, Video-Streaming und 5G-Netzwerken zu unterstützen, kann die GPU- und CPU-Architektur nicht effizient arbeiten, um den bevorstehenden Rechenbedarf zu decken, was für Betreiber von Hyperscale-Rechenzentren eine große Herausforderung darstellt.

Das GPT3.5-Training nutzt das speziell entwickelte KI-Computersystem von Microsoft, einen leistungsstarken Netzwerkcluster bestehend aus 10.000 V100-GPUs, mit einem gesamten Rechenleistungsverbrauch von etwa 3640 PF-Tagen (das heißt, wenn eine Billiarde pro Tag berechnet wird). zum zweiten Mal müssen 3640 Tage berechnet werden). Solch eine groß angelegte und langfristige GPU-Cluster-Trainingsaufgabe stellt extreme Anforderungen an die Leistung, Zuverlässigkeit, Kosten und andere Aspekte der Netzwerkverbindungsbasis.

Meta kündigte beispielsweise an, den Ausbau von Rechenzentren auf der ganzen Welt auszusetzen und diese Serverfarmen neu zu konfigurieren, um den Datenverarbeitungsanforderungen der künstlichen Intelligenz gerecht zu werden.

Der Datenverarbeitungsbedarf von Plattformen für künstliche Intelligenz ist enorm. Die OpenAI-Entwickler von ChatGPT haben die Plattform im November letzten Jahres gestartet. Ohne die bevorstehende Aktualisierung der Azure-Cloud-Plattform von Microsoft wird sie nicht weiter betrieben werden können.

Die Rechenzentrumsinfrastruktur, die diese digitale Transformation unterstützt, wird wie das menschliche Gehirn in zwei Hemisphären oder Lappen organisiert sein, wobei ein Lappen viel stärker sein muss als der andere. Eine Hemisphäre dient dem sogenannten „Training“, also der Rechenleistung, die zur Verarbeitung von bis zu 300 Milliarden Datenpunkten erforderlich ist, um den Wortsalat zu erstellen, den ChatGPT generiert.

Trainingslobes erfordern leistungsstarke Rechenleistung und modernste GPU-Halbleiter, aber in Rechenzentrumsclustern, die Cloud-Computing-Dienste und 5G-Netzwerke unterstützen, ist derzeit nur wenig Konnektivität erforderlich.

Gleichzeitig wird die Infrastruktur, die sich auf das „Training“ jeder KI-Plattform konzentriert, einen enormen Strombedarf erzeugen, was die Ansiedlung von Rechenzentren in der Nähe von Gigawatt erneuerbarer Energie, die Installation neuer Flüssigkeitskühlsysteme und die Neugestaltung erforderlich macht Notstrom- und Generatorsysteme sowie weitere neue Designmerkmale.

Künstliche Intelligenzplattformen Die andere Hemisphäre des Gehirns, eine höher funktionierende digitale Infrastruktur, die als „Inferenz“-Modus bekannt ist, unterstützt interaktive „generative“ Plattformen, die innerhalb von Sekunden nach Eingabe einer Frage oder Anweisung Abfragen in die modellierte Datenbank verarbeiten und antwortete mit überzeugender menschlicher Syntax.

Während die heutigen hypervernetzten Rechenzentrumsnetzwerke, wie der größte Rechenzentrumscluster in Nordamerika, verfügen die „Rechenzentren“ von Nord-Virginia auch über die umfangreichsten Glasfasernetze, um den Konnektivitätsanforderungen der nächsten Ebene der „Inferenz“ des KI-Gehirns gerecht zu werden ” Blätter , aber diese Anlagen müssen auch modernisiert werden, um die enorme erforderliche Verarbeitungskapazität zu erfüllen, und sie müssen näher an den Umspannwerken liegen.

Darüber hinaus zeigen Daten von Forschungseinrichtungen, dass Rechenzentren zu den weltweit größten Energieverbrauchern geworden sind und ihr Anteil am gesamten Stromverbrauch von 3 % im Jahr 2017 auf 4,5 % im Jahr 2025 steigen wird. Am Beispiel Chinas wird erwartet, dass der Stromverbrauch landesweit betriebener Rechenzentren im Jahr 2030 400 Milliarden kWh übersteigen wird, was 4 % des gesamten Stromverbrauchs des Landes ausmacht.

Daher benötigen sogar digitale Produkte Energie, um sich zu entwickeln und zu verbrauchen, und ChatGPT ist keine Ausnahme. Schätzungen zufolge macht die Inferenzverarbeitung bei der Arbeit mit maschinellem Lernen seit der Einführung von ChatGPT im November 2022 80–90 % des Rechenleistungsverbrauchs aus Seit der Inbetriebnahme am 30. haben die CO2-Emissionen 814,61 Tonnen überschritten.

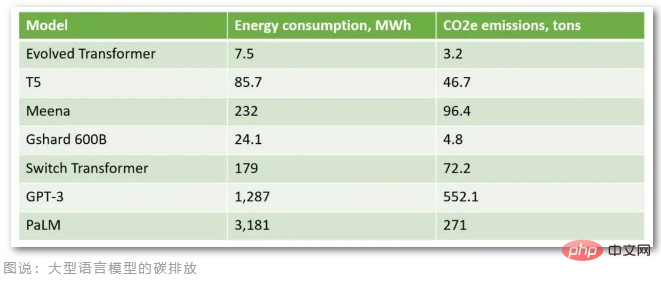

Nach Berechnungen von Berufsverbänden beträgt die maximale Leistung der A100-GPU 407 W, wenn man davon ausgeht, dass ChatGPT, das in der Azure-Cloud von Microsoft gehostet wird, 1 Million Benutzeranfragen pro Tag hat (ungefähr 29.167 Stunden pro Tag bei einer bestimmten Antwortzeit und einem bestimmten Vokabular). (Watt) erreichen die täglichen Kohlenstoffemissionen 3,82 Tonnen und die monatlichen Kohlenstoffemissionen übersteigen 100 Tonnen. Heute hat ChatGPT mehr als 10 Millionen tägliche Nutzer und der tatsächliche CO2-Ausstoß liegt weit über 100 Tonnen pro Monat. Darüber hinaus erfordert das Training eines so großen Sprachmodells mit 175 Milliarden Parametern Zehntausende CPUs/GPUs zur Dateneingabe rund um die Uhr, verbraucht etwa 1287 MWh Strom und stößt mehr als 552 Tonnen Kohlendioxid aus.

Gemessen an den CO2-Emissionen dieser großen Sprachmodelle weist GPT-3, der Vorgänger von ChatGPT, die höchsten CO2-Emissionen auf. Es wird berichtet, dass der durchschnittliche Amerikaner 16,4 Tonnen Kohlenstoffemissionen pro Jahr verursacht und der durchschnittliche Däne 11 Tonnen Kohlenstoffemissionen pro Jahr verursacht. Dadurch ist das ChatGPT-Modell darauf trainiert, mehr Kohlenstoffemissionen auszustoßen, als 50 Dänen pro Jahr ausstoßen.

Cloud-Computing-Anbieter haben ebenfalls erkannt, dass Rechenzentren große Mengen an Strom verbrauchen, und haben Maßnahmen zur Verbesserung der Effizienz ergriffen, beispielsweise den Bau und Betrieb von Rechenzentren in der Arktis, um erneuerbare Energien und natürliche Kühlbedingungen zu nutzen. Dies reicht jedoch nicht aus, um dem explosionsartigen Wachstum von KI-Anwendungen gerecht zu werden.

Das Lawrence Berkeley National Laboratory in den Vereinigten Staaten hat in einer Untersuchung herausgefunden, dass Verbesserungen der Rechenzentrumseffizienz das Wachstum des Energieverbrauchs in den letzten 20 Jahren kontrolliert haben, die Studie zeigt jedoch, dass die heutigen Energieeffizienzmaßnahmen dies möglicherweise nicht tun ausreichen, um die zukünftigen Anforderungen von Rechenzentren zu erfüllen.

Die Branche der künstlichen Intelligenz befindet sich jetzt an einem kritischen Wendepunkt. Technologische Fortschritte in den Bereichen generative KI, Bilderkennung und Datenanalyse offenbaren einzigartige Zusammenhänge und Einsatzmöglichkeiten für maschinelles Lernen, aber zunächst muss eine Technologielösung entwickelt werden, die diesen Bedarf decken kann, denn laut Gartner wird dies andernfalls bis 2025 der Fall sein, wenn keine nachhaltigere Wahl getroffen wird , KI wird mehr Energie verbrauchen als menschliche Aktivitäten.

Das obige ist der detaillierte Inhalt vonAlarm! Die durch die Explosion von ChatGPT verursachte Energieverbrauchskrise stellt Rechenzentrumsbetreiber vor große Herausforderungen. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

Mit ChatGPT können kostenlose Benutzer jetzt Bilder mithilfe von DALL-E 3 mit einem Tageslimit generieren

Aug 09, 2024 pm 09:37 PM

DALL-E 3 wurde im September 2023 offiziell als deutlich verbessertes Modell gegenüber seinem Vorgänger eingeführt. Er gilt als einer der bisher besten KI-Bildgeneratoren und ist in der Lage, Bilder mit komplexen Details zu erstellen. Zum Start war es jedoch exklusiv

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Samsung stellt die BM1743 SSD für Rechenzentren vor: ausgestattet mit v7 QLC V-NAND und unterstützt PCIe 5.0

Jun 18, 2024 pm 04:15 PM

Samsung stellt die BM1743 SSD für Rechenzentren vor: ausgestattet mit v7 QLC V-NAND und unterstützt PCIe 5.0

Jun 18, 2024 pm 04:15 PM

Laut Nachrichten dieser Website vom 18. Juni stellte Samsung Semiconductor kürzlich in seinem Technologieblog sein Solid-State-Laufwerk BM1743 der nächsten Generation für Rechenzentren vor, das mit dem neuesten QLC-Flash-Speicher (v7) ausgestattet ist. ▲Samsung QLC Solid-State-Laufwerk für Rechenzentren BM1743 Laut TrendForce im April hatten im Bereich der QLC-Solid-State-Laufwerke für Rechenzentren nur Samsung und Solidigm, eine Tochtergesellschaft von SK Hynix, die Unternehmenskundenüberprüfung bestanden diese Zeit. Im Vergleich zum v5QLCV-NAND der vorherigen Generation (Hinweis auf dieser Website: Samsung v6V-NAND verfügt nicht über QLC-Produkte) hat der Samsung v7QLCV-NAND-Flash-Speicher die Anzahl der Stapelschichten fast verdoppelt und auch die Speicherdichte wurde erheblich verbessert. Gleichzeitig ist die Glätte von v7QLCV-NAND gewährleistet

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

SK Hynix wird am 6. August neue KI-bezogene Produkte vorstellen: 12-Layer-HBM3E, 321-High-NAND usw.

Aug 01, 2024 pm 09:40 PM

Laut Nachrichten dieser Website vom 1. August hat SK Hynix heute (1. August) einen Blogbeitrag veröffentlicht, in dem es ankündigt, dass es am Global Semiconductor Memory Summit FMS2024 teilnehmen wird, der vom 6. bis 8. August in Santa Clara, Kalifornien, USA, stattfindet viele neue Technologien Generation Produkt. Einführung des Future Memory and Storage Summit (FutureMemoryandStorage), früher Flash Memory Summit (FlashMemorySummit), hauptsächlich für NAND-Anbieter, im Zusammenhang mit der zunehmenden Aufmerksamkeit für die Technologie der künstlichen Intelligenz wurde dieses Jahr in Future Memory and Storage Summit (FutureMemoryandStorage) umbenannt Laden Sie DRAM- und Speicheranbieter und viele weitere Akteure ein. Neues Produkt SK Hynix wurde letztes Jahr auf den Markt gebracht

SearchGPT: Open AI tritt mit seiner eigenen KI-Suchmaschine gegen Google an

Jul 30, 2024 am 09:58 AM

SearchGPT: Open AI tritt mit seiner eigenen KI-Suchmaschine gegen Google an

Jul 30, 2024 am 09:58 AM

Open AI macht endlich seinen Vorstoß in die Suche. Das Unternehmen aus San Francisco hat kürzlich ein neues KI-Tool mit Suchfunktionen angekündigt. The Information berichtete erstmals im Februar dieses Jahres über das neue Tool, das treffend SearchGPT heißt und über ein c