Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

DeepFake war noch nie so real! Wie stark ist Nvidias neueste „implizite Verzerrung'?

DeepFake war noch nie so real! Wie stark ist Nvidias neueste „implizite Verzerrung'?

DeepFake war noch nie so real! Wie stark ist Nvidias neueste „implizite Verzerrung'?

In den letzten Jahren ist die Generierungstechnologie im Bereich Computer Vision immer leistungsfähiger geworden und die entsprechende „Fälschungs“-Technologie ist immer ausgereifter geworden. Von DeepFake-Gesichtsveränderung bis hin zu Action-Simulationen ist es schwierig das Echte vom Fake.

Vor kurzem hat NVIDIA einen weiteren großen Schritt gemacht und auf der NeurIPS 2022-Konferenz ein neues „Implicit Warping“-Framework (Implicit Warping) veröffentlicht, das „eine Reihe von Quellbildern“ und „gesteuerte Videobewegungen“ verwendet Zielanimation. Link zum Papier: https://arxiv.org/pdf/2210.01794.pdf

Aus Sicht des Effekts ist das erzeugte Bild realistischer, die Charaktere bewegen sich im Video, Hintergrund Es wird keine Änderung geben.

Die Eingabe mehrerer Quellbilder liefert normalerweise unterschiedliche Darstellungsinformationen, wodurch der „Fantasie“-Raum des Generators

reduziert wird, wie beispielsweise die folgenden beiden als Modelleingaben.Es kann festgestellt werden, dass die implizite Verzerrung im Vergleich zu anderen Modellen keine „Raumverzerrung“ ähnlich dem Schönheitseffekt erzeugt. Aufgrund der Verdeckung von Personen können mehrere Quellbilder auch

einen vollständigeren Hintergrundliefern.

Wie Sie im Video unten sehen können, ist es schwierig zu erraten, ob es sich hinter dem Hintergrund um „BD“ oder „ED“ handelt, wenn links nur ein Bild zu sehen ist, was dazu führen wird Verzerrung des Hintergrunds und zwei Bilder erzeugen ein stabileres Bild.

Magische implizite Verzerrung

Videoimitation in der Wissenschaft lässt sich bis ins Jahr 2005 zurückverfolgen. Viele Projekte umfassen Echtzeit-Ausdrucksübertragung der Gesichtsreproduktion, Face2Face, synthetisches Obama, Recycle-GAN, ReenactGAN, dynamisches neuronales Strahlungsfeld und so diversifizierten sie die damals begrenzten Technologien wie Generative Adversarial Networks (GAN), Neural Radiation Fields (NeRF) und Autoencoder.

Da das DeepFake-Modell jedoch weniger Informationen erfasst, muss diese Methode für jeden Videoclip trainiert werden, und die Leistung ist im Vergleich zu den Open-Source-Methoden von DeepFaceLab oder FaceSwap, die jedem eine Identität aufzwingen können, geringer Anzahl der Videoclips.

Das 2019 veröffentlichte FOMM-Modell ermöglicht es den Charakteren, sich mit dem Video zu bewegen, was der Aufgabe der Videoimitation eine weitere Chance gibt.

Später versuchten andere Forscher, mehrere Posen und Ausdrücke aus einem einzigen Gesichtsbild oder einer Ganzkörperdarstellung zu erhalten. Diese Methode funktioniert jedoch normalerweise nur bei relativ ausdruckslosen und unbeweglichen Probanden, beispielsweise bei relativ stillen „sprechenden“ Probanden. denn es gibt keine „plötzlichen Verhaltensänderungen“ in Mimik oder Gestik, die das Netzwerk interpretieren muss.

Obwohl einige dieser Technologien und Methoden öffentliche Aufmerksamkeit erlangten, bevor Deepfake-Technologie und potenzielle Diffusionsbildsynthesemethoden populär wurden, ist ihr Anwendungsbereich begrenzt und ihre Vielseitigkeit wird in Frage gestellt.

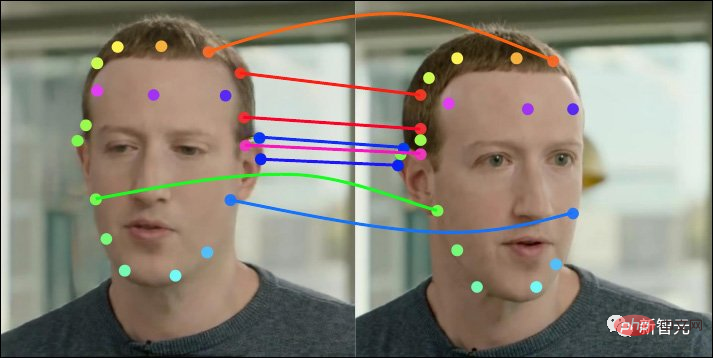

Die implizite Verzerrung, auf die sich NVIDIA dieses Mal konzentriert, besteht darin, Informationen zwischen mehreren Frames oder sogar nur zwischen zwei Frames zu erhalten, anstatt alle erforderlichen Haltungsinformationen aus einem Frame zu erhalten. Diese Einstellung ist in anderen Modellen nicht vorhanden oder extrem schlecht gehandhabt wird.

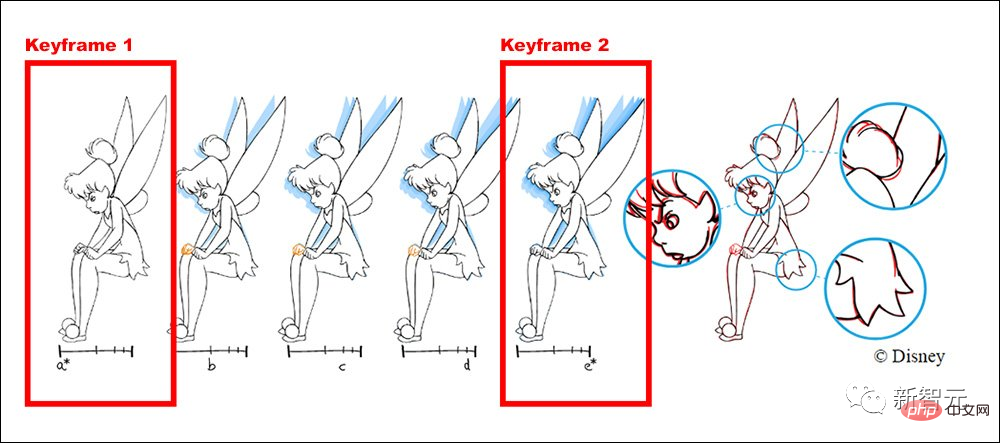

Zum Beispiel sieht der Arbeitsablauf bei Disney vor, dass ältere Animatoren die Hauptbilder und Schlüsselbilder zeichnen und andere jüngere Animatoren für das Zeichnen von Zwischenbildern verantwortlich sind.

Durch Tests früherer Versionen stellten Nvidia-Forscher fest, dass sich die Ergebnisqualität der vorherigen Methode durch zusätzliche „Keyframes“ verschlechterte, während die neue Methode mit der Logik von übereinstimmte Die Animationsproduktion ist konsistent und mit zunehmender Anzahl von Keyframes verbessert sich die Leistung linear.

Wenn in der Mitte des Clips plötzliche Änderungen auftreten, z. B. ein Ereignis oder ein Ausdruck, der nicht im Startbild oder Endbild angezeigt wird, kann dies zu einer impliziten Verzerrung führen Wenn Sie an dieser Stelle einen Frame hinzufügen, werden die zusätzlichen Informationen an den Aufmerksamkeitsmechanismus des gesamten Clips zurückgegeben.

Modellstruktur

Frühere Methoden wie FOMM, Monkey-Net und Face - vid2vid et al. verwenden explizite Verzerrung, um eine Zeitreihe zu zeichnen, zu der die aus der Quellfläche und der Kontrollbewegung extrahierten Informationen passen und übereinstimmen müssen.

Unter diesem Modelldesign ist die endgültige Zuordnung der Schlüsselpunkte ziemlich streng.

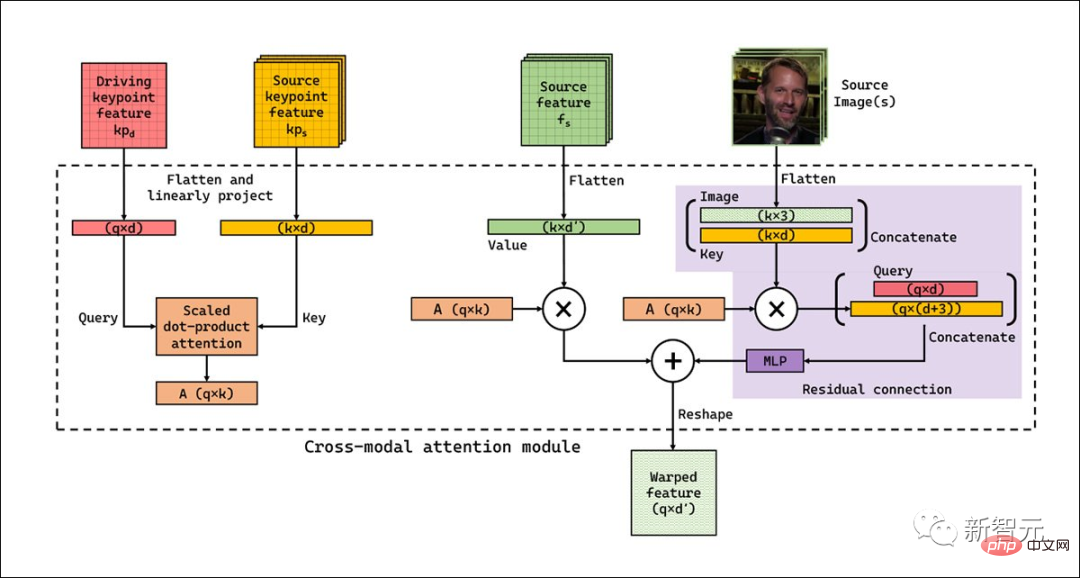

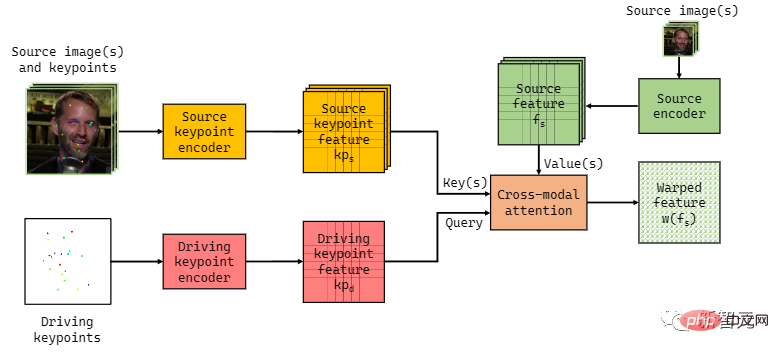

Im Gegensatz dazu verwendet Implicit Warp eine modalübergreifende Aufmerksamkeitsschicht, hat weniger vordefiniertes Bootstrapping in seinem Workflow und kann sich aus mehreren Framework-Eingaben anpassen.

Der Workflow erfordert auch keine Verzerrung pro Taste, das System kann die am besten geeigneten Funktionen aus einer Reihe von Bildern auswählen.

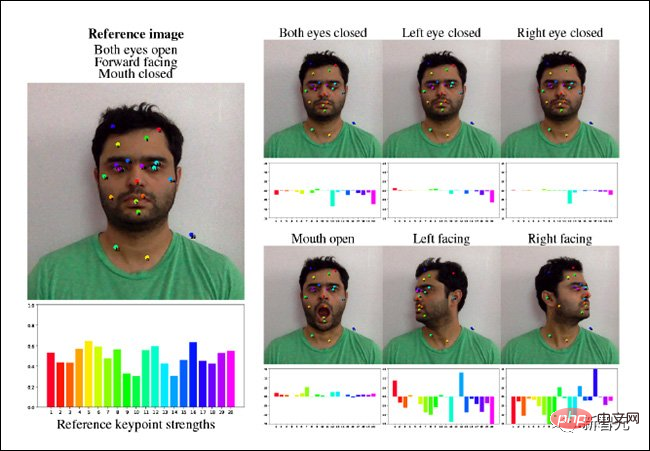

Implicit Twist verwendet auch einige Schlüsselpunktvorhersagekomponenten im FOMM-Framework wieder und verwendet schließlich ein einfaches U-Netz kodiert abgeleitete räumlich gesteuerte Schlüsselpunktdarstellungen. Ein separates U-Netz wird verwendet, um das Quellbild zusammen mit der abgeleiteten räumlichen Darstellung zu kodieren. Beide Netzwerke können mit Auflösungen von 64 Pixel (256 Pixel im Quadrat) bis 384 x 384 Pixel arbeiten.

Da dieser Mechanismus nicht automatisch alle möglichen Änderungen in Posen und Bewegungen in einem bestimmten Video berücksichtigen kann, sind zusätzliche Keyframes erforderlich erforderlich und können vorübergehend hinzugefügt werden. Ohne diese Eingriffsmöglichkeit werden Schlüssel, die dem Zielbewegungspunkt nicht ähnlich genug sind, automatisch aktualisiert, was zu einer Verschlechterung der Ausgabequalität führt.

Die Erklärung der Forscher hierfür ist, dass es zwar der Schlüssel ist, der der Abfrage in einem bestimmten Satz von Keyframes am ähnlichsten ist, er aber möglicherweise nicht ausreicht, um ein Gut zu erzeugen Ausgabe.

Angenommen, das Quellbild zeigt ein Gesicht mit geschlossenen Lippen und das Fahrerbild zeigt ein Gesicht mit offenen Lippen und freiliegenden Zähnen. In diesem Fall gibt es im Quellbild keinen geeigneten Schlüssel (und Wert), um den Mundbereich des Bildes zu steuern.

Diese Methode überwindet dieses Problem, indem sie zusätzliche bildunabhängige Schlüssel-Wert-Paare lernt, die den Informationsmangel im Quellbild bewältigen können.

Obwohl die aktuelle Implementierung recht schnell ist, etwa 10 FPS auf einem 512x512px-Bild, glauben die Forscher, dass die Pipeline in einer zukünftigen Version durch eine faktorisierte I-D geleitet werden kann Aufmerksamkeitsschicht oder SRA-Schicht (Spatial Reduction Attention) (d. h. Pyramid Visual Transformer) zur Optimierung.

Da implizites Warping globale Aufmerksamkeit anstelle lokaler Aufmerksamkeit verwendet, kann es im vorherigen Modell unvorhersehbare Faktoren vorhersagen.

Experimentelle Ergebnisse

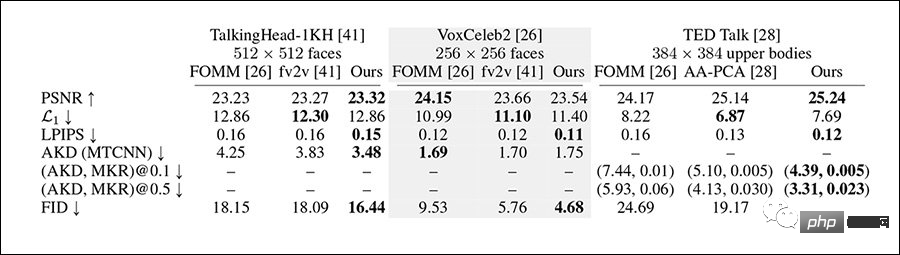

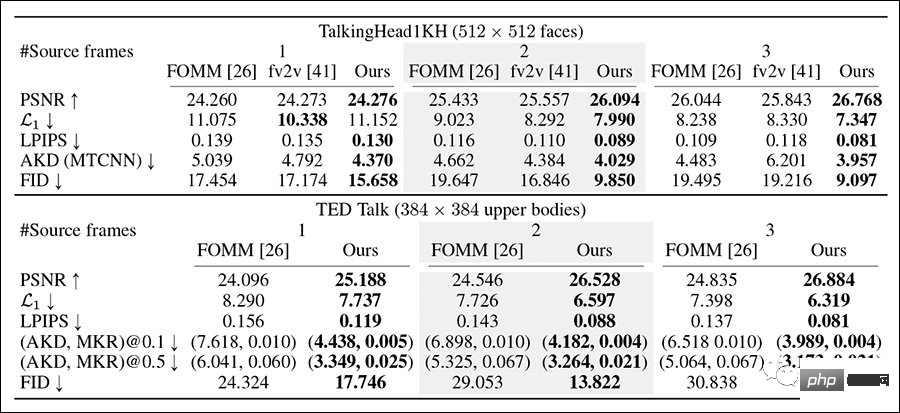

Die Forscher testeten den VoxCeleb2-Datensatz, den anspruchsvolleren TED Talk-Datensatz und den TalkingHead-1KH-Datensatz Das System wurde mit einer Basisauflösung zwischen 256 x 256 Pixel und der vollen Auflösung von 512 x 512 Pixel verglichen, wobei Metriken wie FID, AlexNet-basiertes LPIPS und maximales Signal-Rausch-Verhältnis (pSNR) zum Einsatz kamen.

Zu den zum Testen verwendeten Vergleichsframeworks gehören FOMM und face-vid2vid sowie AA-PCA. Da frühere Methoden kaum oder gar nicht in der Lage sind, mehrere Keyframes zu verwenden, ist dies auch die Hauptinnovation der impliziten Verzerrung. Die Forscher haben auch Ähnliches entwickelt Testmethoden.

Implizites Warping übertrifft die meisten Kontrastmethoden bei den meisten Metriken.

Im Multi-Keyframe-Rekonstruktionstest, bei dem die Forscher Sequenzen von bis zu 180 Frames und ausgewählte Gap-Frames verwendeten, gewann die implizite Verzerrung dieses Mal insgesamt.

Mit zunehmender Anzahl der Quellbilder können mit der Methode bessere Rekonstruktionsergebnisse erzielt werden und die Scores aller Indikatoren verbessern sich.

Und mit zunehmender Anzahl der Quellbilder wird der Rekonstruktionseffekt der vorherigen Arbeit wider Erwarten schlechter.

Nach der Durchführung qualitativer Untersuchungen durch AMT-Mitarbeiter wird auch angenommen, dass die Generierungsergebnisse der impliziten Verformung stärker sind als bei anderen Methoden.

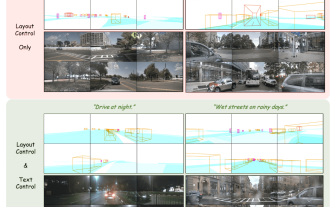

Durch den Zugriff auf dieses Framework wären Benutzer in der Lage, kohärentere und längere Videosimulationen und Ganzkörper-Deepfake-Videos zu erstellen, die alle eine bessere Leistung als jedes Framework zeigen könnten, mit dem das System experimentiert hat mit. Viel größere Bewegungsfreiheit.

Die Erforschung einer realistischeren Bildsynthese wirft jedoch auch Bedenken auf, da diese Techniken leicht für Fälschungen genutzt werden können und das Papier einen Standard-Haftungsausschluss enthält.

Wenn unsere Methode zur Erstellung von DeepFake-Produkten verwendet wird, kann dies negative Auswirkungen haben. Bösartige Sprachsynthese erzeugt falsche Bilder von Menschen, indem sie falsche Informationen über Identitäten hinweg überträgt und übermittelt, was zu Identitätsdiebstahl oder der Verbreitung falscher Nachrichten führt. Aber in kontrollierten Umgebungen kann die gleiche Technologie auch zu Unterhaltungszwecken eingesetzt werden.

Der Artikel weist auch auf das Potenzial dieses Systems für die neuronale Videorekonstruktion hin, wie beispielsweise Googles Project Starline, bei dem sich die Rekonstruktionsbemühungen hauptsächlich auf die Clientseite konzentrieren und spärliche Bewegungsinformationen der Person am anderen Ende nutzen.

Diese Lösung weckt zunehmend das Interesse der Forschungsgemeinschaft, und es gibt auch Unternehmen, die beabsichtigen, Konferenzgespräche mit geringer Bandbreite zu implementieren, indem sie reine Bewegungsdaten oder Keyframes mit geringem Abstand senden, die beim Eintreffen beim Zielclient interpretiert werden . und in Full-HD-Video eingefügt.

Das obige ist der detaillierte Inhalt vonDeepFake war noch nie so real! Wie stark ist Nvidias neueste „implizite Verzerrung'?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Dieser Artikel reicht aus, um etwas über autonomes Fahren und Flugbahnvorhersage zu lesen!

Feb 28, 2024 pm 07:20 PM

Die Trajektorienvorhersage spielt eine wichtige Rolle beim autonomen Fahren. Unter autonomer Fahrtrajektorienvorhersage versteht man die Vorhersage der zukünftigen Fahrtrajektorie des Fahrzeugs durch die Analyse verschiedener Daten während des Fahrvorgangs. Als Kernmodul des autonomen Fahrens ist die Qualität der Trajektorienvorhersage von entscheidender Bedeutung für die nachgelagerte Planungssteuerung. Die Trajektorienvorhersageaufgabe verfügt über einen umfangreichen Technologie-Stack und erfordert Vertrautheit mit der dynamischen/statischen Wahrnehmung des autonomen Fahrens, hochpräzisen Karten, Fahrspurlinien, Fähigkeiten in der neuronalen Netzwerkarchitektur (CNN&GNN&Transformer) usw. Der Einstieg ist sehr schwierig! Viele Fans hoffen, so schnell wie möglich mit der Flugbahnvorhersage beginnen zu können und Fallstricke zu vermeiden. Heute werde ich eine Bestandsaufnahme einiger häufiger Probleme und einführender Lernmethoden für die Flugbahnvorhersage machen! Einführungsbezogenes Wissen 1. Sind die Vorschaupapiere in Ordnung? A: Schauen Sie sich zuerst die Umfrage an, S

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Das Stable Diffusion 3-Papier wird endlich veröffentlicht und die architektonischen Details werden enthüllt. Wird es helfen, Sora zu reproduzieren?

Mar 06, 2024 pm 05:34 PM

Der Artikel von StableDiffusion3 ist endlich da! Dieses Modell wurde vor zwei Wochen veröffentlicht und verwendet die gleiche DiT-Architektur (DiffusionTransformer) wie Sora. Nach seiner Veröffentlichung sorgte es für großes Aufsehen. Im Vergleich zur Vorgängerversion wurde die Qualität der von StableDiffusion3 generierten Bilder erheblich verbessert. Es unterstützt jetzt Eingabeaufforderungen mit mehreren Themen, und der Textschreibeffekt wurde ebenfalls verbessert, und es werden keine verstümmelten Zeichen mehr angezeigt. StabilityAI wies darauf hin, dass es sich bei StableDiffusion3 um eine Reihe von Modellen mit Parametergrößen von 800 M bis 8 B handelt. Durch diesen Parameterbereich kann das Modell direkt auf vielen tragbaren Geräten ausgeführt werden, wodurch der Einsatz von KI deutlich reduziert wird

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Beherrschen Sie die Koordinatensystemkonvertierung wirklich? Multisensorik-Themen, die für das autonome Fahren unverzichtbar sind

Oct 12, 2023 am 11:21 AM

Der erste Pilot- und Schlüsselartikel stellt hauptsächlich mehrere häufig verwendete Koordinatensysteme in der autonomen Fahrtechnologie vor und erläutert, wie die Korrelation und Konvertierung zwischen ihnen abgeschlossen und schließlich ein einheitliches Umgebungsmodell erstellt werden kann. Der Schwerpunkt liegt hier auf dem Verständnis der Umrechnung vom Fahrzeug in den starren Kamerakörper (externe Parameter), der Kamera-in-Bild-Konvertierung (interne Parameter) und der Bild-in-Pixel-Einheitenkonvertierung. Die Konvertierung von 3D in 2D führt zu entsprechenden Verzerrungen, Verschiebungen usw. Wichtige Punkte: Das Fahrzeugkoordinatensystem und das Kamerakörperkoordinatensystem müssen neu geschrieben werden: Das Ebenenkoordinatensystem und das Pixelkoordinatensystem. Schwierigkeit: Sowohl die Entzerrung als auch die Verzerrungsaddition müssen auf der Bildebene kompensiert werden. 2. Einführung Insgesamt gibt es vier visuelle Systeme Koordinatensystem: Pixelebenenkoordinatensystem (u, v), Bildkoordinatensystem (x, y), Kamerakoordinatensystem () und Weltkoordinatensystem (). Es gibt eine Beziehung zwischen jedem Koordinatensystem,

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

In diesem Artikel wird das Problem der genauen Erkennung von Objekten aus verschiedenen Blickwinkeln (z. B. Perspektive und Vogelperspektive) beim autonomen Fahren untersucht, insbesondere wie die Transformation von Merkmalen aus der Perspektive (PV) in den Raum aus der Vogelperspektive (BEV) effektiv ist implementiert über das Modul Visual Transformation (VT). Bestehende Methoden lassen sich grob in zwei Strategien unterteilen: 2D-zu-3D- und 3D-zu-2D-Konvertierung. 2D-zu-3D-Methoden verbessern dichte 2D-Merkmale durch die Vorhersage von Tiefenwahrscheinlichkeiten, aber die inhärente Unsicherheit von Tiefenvorhersagen, insbesondere in entfernten Regionen, kann zu Ungenauigkeiten führen. Während 3D-zu-2D-Methoden normalerweise 3D-Abfragen verwenden, um 2D-Features abzutasten und die Aufmerksamkeitsgewichte der Korrespondenz zwischen 3D- und 2D-Features über einen Transformer zu lernen, erhöht sich die Rechen- und Bereitstellungszeit.

Das erste Weltmodell zur Erzeugung autonomer Fahrszenen mit mehreren Ansichten | DrivingDiffusion: Neue Ideen für BEV-Daten und Simulation

Oct 23, 2023 am 11:13 AM

Das erste Weltmodell zur Erzeugung autonomer Fahrszenen mit mehreren Ansichten | DrivingDiffusion: Neue Ideen für BEV-Daten und Simulation

Oct 23, 2023 am 11:13 AM

Einige persönliche Gedanken des Autors Im Bereich des autonomen Fahrens sind mit der Entwicklung BEV-basierter Teilaufgaben/End-to-End-Lösungen hochwertige Multi-View-Trainingsdaten und der entsprechende Aufbau von Simulationsszenen immer wichtiger geworden. Als Reaktion auf die Schwachstellen aktueller Aufgaben kann „hohe Qualität“ in drei Aspekte zerlegt werden: Long-Tail-Szenarien in verschiedenen Dimensionen: z. B. Nahbereichsfahrzeuge in Hindernisdaten und präzise Kurswinkel beim Schneiden von Autos sowie Spurliniendaten . Szenen wie Kurven mit unterschiedlichen Krümmungen oder Rampen/Zusammenführungen/Zusammenführungen, die schwer zu erfassen sind. Diese basieren häufig auf der Sammlung großer Datenmengen und komplexen Data-Mining-Strategien, die kostspielig sind. Echter 3D-Wert – hochkonsistentes Bild: Die aktuelle BEV-Datenerfassung wird häufig durch Fehler bei der Sensorinstallation/-kalibrierung, hochpräzisen Karten und dem Rekonstruktionsalgorithmus selbst beeinträchtigt. das hat mich dazu geführt

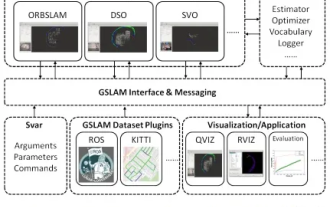

GSLAM |. Eine allgemeine SLAM-Architektur und ein Benchmark

Oct 20, 2023 am 11:37 AM

GSLAM |. Eine allgemeine SLAM-Architektur und ein Benchmark

Oct 20, 2023 am 11:37 AM

Plötzlich wurde ein 19 Jahre altes Papier namens GSLAM: A General SLAM Framework and Benchmark mit offenem Quellcode entdeckt: https://github.com/zdzhaoyong/GSLAM Gehen Sie direkt zum Volltext und spüren Sie die Qualität dieser Arbeit~1 Zusammenfassung der SLAM-Technologie hat in letzter Zeit viele Erfolge erzielt und die Aufmerksamkeit vieler High-Tech-Unternehmen auf sich gezogen. Es bleibt jedoch eine Frage, wie eine Schnittstelle zu bestehenden oder neuen Algorithmen hergestellt werden kann, um ein Benchmarking hinsichtlich Geschwindigkeit, Robustheit und Portabilität effizient durchzuführen. In diesem Artikel wird eine neue SLAM-Plattform namens GSLAM vorgeschlagen, die nicht nur Evaluierungsfunktionen bietet, sondern Forschern auch eine nützliche Möglichkeit bietet, schnell ihre eigenen SLAM-Systeme zu entwickeln.

„Minecraft' verwandelt sich in eine KI-Stadt und NPC-Bewohner spielen Rollenspiele wie echte Menschen

Jan 02, 2024 pm 06:25 PM

„Minecraft' verwandelt sich in eine KI-Stadt und NPC-Bewohner spielen Rollenspiele wie echte Menschen

Jan 02, 2024 pm 06:25 PM

Bitte beachten Sie, dass dieser kantige Mann die Stirn runzelt und über die Identität der „ungebetenen Gäste“ vor ihm nachdenkt. Es stellte sich heraus, dass sie sich in einer gefährlichen Situation befand, und als ihr dies klar wurde, begann sie schnell mit der mentalen Suche nach einer Strategie zur Lösung des Problems. Letztendlich entschloss sie sich, vom Unfallort zu fliehen, dann so schnell wie möglich Hilfe zu suchen und sofort Maßnahmen zu ergreifen. Gleichzeitig dachte die Person auf der Gegenseite das Gleiche wie sie... In „Minecraft“ gab es eine solche Szene, in der alle Charaktere von künstlicher Intelligenz gesteuert wurden. Jeder von ihnen hat eine einzigartige Identität. Das zuvor erwähnte Mädchen ist beispielsweise eine 17-jährige, aber kluge und mutige Kurierin. Sie haben die Fähigkeit, sich zu erinnern und zu denken und in dieser kleinen Stadt in Minecraft wie Menschen zu leben. Was sie antreibt, ist ein brandneues,

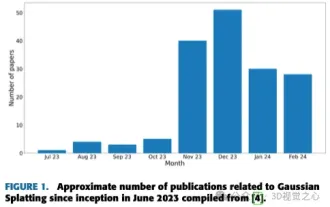

Mehr als nur 3D-Gauß! Aktueller Überblick über modernste 3D-Rekonstruktionstechniken

Jun 02, 2024 pm 06:57 PM

Mehr als nur 3D-Gauß! Aktueller Überblick über modernste 3D-Rekonstruktionstechniken

Jun 02, 2024 pm 06:57 PM

Oben geschrieben & Nach persönlichem Verständnis des Autors ist die bildbasierte 3D-Rekonstruktion eine anspruchsvolle Aufgabe, bei der aus einer Reihe von Eingabebildern auf die 3D-Form eines Objekts oder einer Szene geschlossen werden muss. Lernbasierte Methoden haben wegen ihrer Fähigkeit, 3D-Formen direkt abzuschätzen, Aufmerksamkeit erregt. Dieser Übersichtsartikel konzentriert sich auf modernste 3D-Rekonstruktionstechniken, einschließlich der Generierung neuartiger, unsichtbarer Ansichten. Es wird ein Überblick über die jüngsten Entwicklungen bei Gaußschen Splash-Methoden gegeben, einschließlich Eingabetypen, Modellstrukturen, Ausgabedarstellungen und Trainingsstrategien. Auch ungelöste Herausforderungen und zukünftige Ausrichtungen werden besprochen. Angesichts der rasanten Fortschritte auf diesem Gebiet und der zahlreichen Möglichkeiten zur Verbesserung der 3D-Rekonstruktionsmethoden scheint eine gründliche Untersuchung des Algorithmus von entscheidender Bedeutung zu sein. Daher bietet diese Studie einen umfassenden Überblick über die jüngsten Fortschritte in der Gaußschen Streuung. (Wischen Sie mit dem Daumen nach oben