Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Zhou Bowen von der Tsinghua-Universität: Die Popularität von ChatGPT zeigt die hohe Bedeutung der neuen Generation der Zusammenarbeit und interaktiven Intelligenz

Zhou Bowen von der Tsinghua-Universität: Die Popularität von ChatGPT zeigt die hohe Bedeutung der neuen Generation der Zusammenarbeit und interaktiven Intelligenz

Zhou Bowen von der Tsinghua-Universität: Die Popularität von ChatGPT zeigt die hohe Bedeutung der neuen Generation der Zusammenarbeit und interaktiven Intelligenz

Das Folgende ist der Inhalt von Zhou Bowens Rede auf der Heart of Machine AI Technology-Jahreskonferenz, ohne die ursprüngliche Bedeutung zu ändern:

Vielen Dank an Heart of Machine für die Einladung bin Zhou Bowen von der Tsinghua-Universität. Es ist jetzt das Ende des Mondkalenders und der Beginn des Gregorianischen Kalenders. Ich freue mich sehr über eine solche Einladung, Ihnen unsere Zusammenfassung der Entwicklungstrends der künstlichen Intelligenz in der vergangenen Zeit sowie einige Gedanken dazu mitzuteilen die Zukunft.

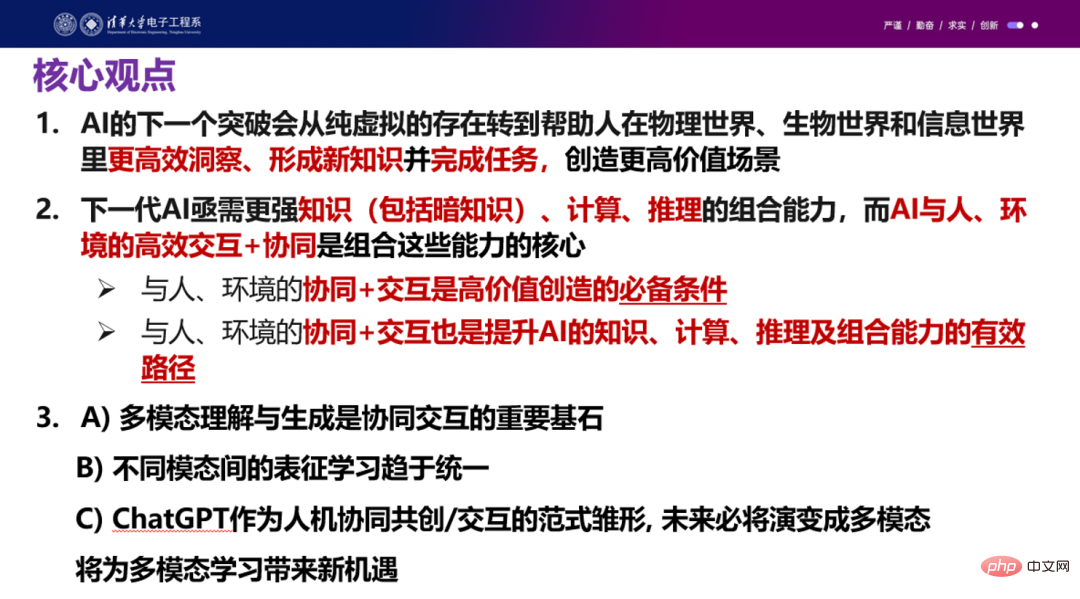

Teilen Sie zunächst die Kernidee mit. Wenn Sie sich nach dem Anhören der gesamten Rede nur an drei Punkte erinnern können, erinnern Sie sich bitte an diese drei Punkte:

Zuerst wird der nächste Durchbruch in der künstlichen Intelligenz beginnen Die virtuelle Existenz von Pure hilft Menschen, effizientere Einblicke in die physische, biologische und Informationswelt zu gewinnen und neues Wissen zu bilden, Aufgaben zu erledigen und höherwertige Szenarien zu schaffen.

Zweitens muss die nächste Generation der künstlichen Intelligenz dringend die Kombination aus Wissen (einschließlich dunklem Wissen), Berechnungs- und Argumentationsfähigkeiten stärken. Diese Kombinationsfähigkeit ist sehr wichtig, aber wir glauben, dass eine effiziente Interaktion + Zusammenarbeit zwischen künstlicher Intelligenz und Mensch und Umwelt der Kern der Kombination dieser Fähigkeiten ist.

Dafür gibt es zwei Gründe: Erstens, weil die Zusammenarbeit und Interaktion mit Menschen und der Umwelt notwendige Voraussetzungen für die Schaffung hochwertiger Werte sind. Ohne die Zusammenarbeit zwischen KI und Menschen kann die KI diese hochwertigen Szenarien nicht selbstständig abschließen Diese Art der Zusammenarbeit und Interaktion ist auch eine wirksame Möglichkeit, die Wissens-, Rechen-, Argumentations- und Kombinationsfähigkeiten der KI zu verbessern. KI hat in der Informatik große Fortschritte gemacht, aber es gibt immer noch einen großen Engpass zwischen Wissen und Argumentation und der effektiven Kombination von Modulen. Das Hinzufügen von Zusammenarbeit und Interaktion zwischen Menschen und der Umwelt kann dazu beitragen, einige der Engpässe der KI in diesen Bereichen auszugleichen.

Drittens haben wir drei Urteile über Multimodalität: Erstens sind multimodales Verständnis und Generierung wichtige Eckpfeiler der Zusammenarbeit und Interaktion. Zweitens hat sich das Repräsentationslernen zwischen verschiedenen Modalitäten tendenziell vereinheitlicht gute Grundvoraussetzung; drittens wird sich das kürzlich beliebte ChatGPT als Prototyp eines zukünftigen Paradigmas für die kollaborative Zusammenarbeit und Interaktion zwischen Mensch und Maschine in Zukunft sicherlich zur Multimodalität entwickeln und neue Möglichkeiten für multimodales Lernen bringen. Obwohl es immer noch viele naive Aspekte hat, weist uns die Darstellung dieses Paradigmas auf die zukünftige Richtung hin.

Das Obige ist der Kernpunkt. Im heutigen Bericht werde ich über kollaborative interaktive Intelligenz und multimodales Lernen sprechen und die neuesten Fortschritte und Möglichkeiten besprechen.

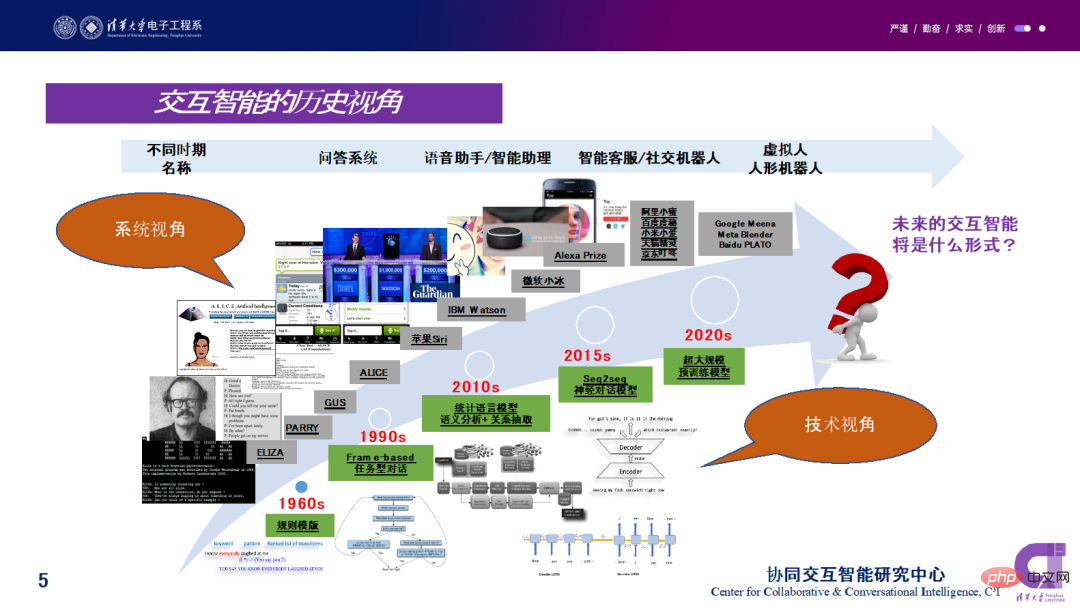

Teil eins: Aus der Perspektive der traditionellen interaktiven Intelligenz haben wir einen langen Weg zurückgelegt. Zunächst möchte ich betonen, dass die Zusammenarbeit und Interaktion, über die wir heute sprechen, völlig anders ist als die ursprüngliche interaktive Intelligenz. Bei der Interaktion in der Geschichte geht es eher darum, ein trainiertes System bereitzustellen und die Interaktion als Aufgabe abzuschließen, beispielsweise von ELIZA, IBM Watson, Microsoft Xiaoice, Siri bis hin zum intelligenten Kundenservice von JD.com. Die Zusammenarbeit und Interaktion, über die wir heute sprechen, besteht darin, Interaktion als Lernmethode und Zusammenarbeit als Arbeitsteilung zwischen KI und Menschen zu nutzen, um die Integration der Mensch-Maschine-Zusammenarbeit besser zu vervollständigen, um Erkenntnisse zu gewinnen, neues Wissen zu bilden und Aufgaben zu erledigen. Dies ist die historische Perspektive der interaktiven Intelligenz als Ganzes. Es ist zu beobachten, dass der Fortschritt in der Veränderung der technischen Perspektive vorangetrieben wird, darunter von frühen Regelvorlagen über rahmenbasierte aufgabenbasierte Dialoge bis hin zur Generierung statistischer Sprachmodelle, des Seq2seq-Modells und extrem großer Pre-Training-Modelle .

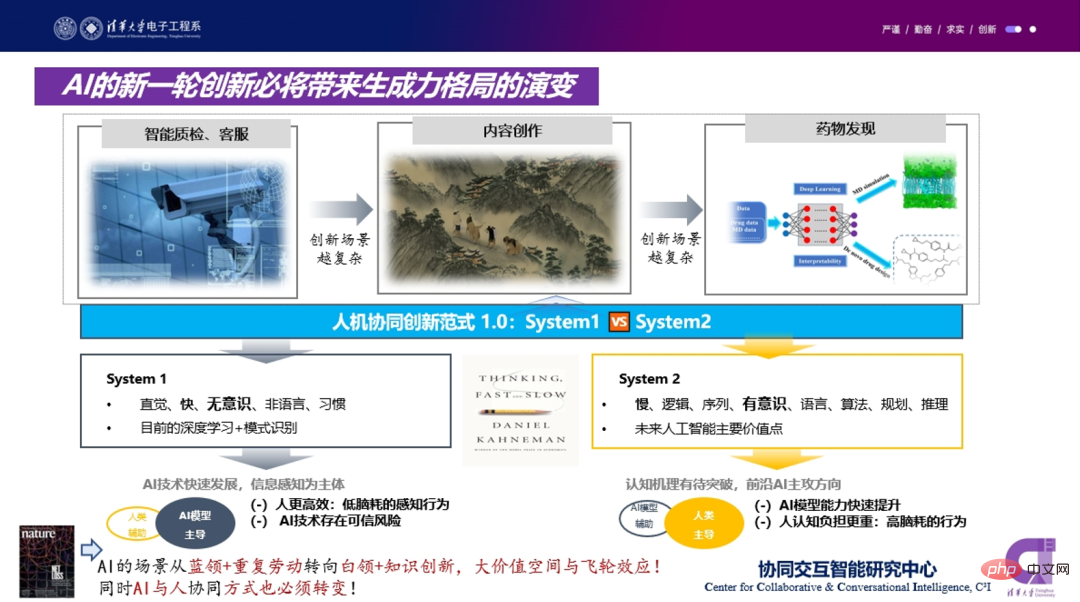

In Bezug auf diese Veränderungen sind wir der Meinung, dass eine neue Innovationsrunde in der KI definitiv die Weiterentwicklung der Produktivitätslandschaft bewirken wird. Vor einigen Jahren war die Rede von Anwendungsszenarien künstlicher Intelligenz in aller Munde und konzentrierte sich dabei auf Bereiche wie intelligente Qualitätsprüfung und Kundenservice. Aber jetzt sehen wir, dass KI-Innovationsszenarien immer komplexer werden und beginnen, die Erstellung künstlerischer Inhalte, die Entdeckung von Medikamenten und die Entdeckung neuer Erkenntnisse einzubeziehen. In dem Bestseller „Thinking Fast And Slow“ von Daniel Kahneman, Gewinner des Wirtschaftsnobelpreises 2002, wird vorgeschlagen, dass es zwei Arten von Denkmethoden für Menschen gibt: System 1 zeichnet sich durch Intuition und Unbewusstheit aus, und System 1 zeichnet sich durch Intuition und Unbewusstheit. Es gibt Sprachen, Algorithmen, Berechnungen und Logik.

In den letzten Jahren wurde künstliche Intelligenz häufiger in System-1-Szenarien eingesetzt, aber in der Zukunft, einschließlich dem, was jetzt passiert, ist künstliche Intelligenz tatsächlich besser darin und besser geeignet, mehr Aufgaben zu übernehmen aus der Perspektive der Mensch-Maschine-Kollaboration. Da System 1 für den Menschen effizienter ist, handelt es sich um eine Aufgabe mit geringem Gehirnverbrauch und geringer kognitiver Belastung, während System 2 für den Menschen eine sehr hohe kognitive Belastung darstellt. Nur konnte der technologische Fortschritt der künstlichen Intelligenz in der Vergangenheit nur System 1 und nicht System 2 gut tun. Der aktuelle Trend geht dahin, dass sich die KI dem System 2 annähert. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜#aus der Industrie aus Aus einer Closed-Loop-Perspektive haben sich KI-Szenarien von Arbeitern und sich wiederholenden Arbeiten (Qualitätsprüfung, Kundenservice usw.) zu Anwendungsbereichen für Angestellte und Wissensinnovation gewandelt. Es besteht kein Zweifel, dass dies zu mehr Wertraum und mehr Schwungradeffekten führen wird. Was ist der Schwungradeffekt? Das heißt, KI kann Angestellten und Wissensarbeitern dabei helfen, besser zu verstehen, Erkenntnisse zu gewinnen und neues Wissen zu bilden. Neues Wissen wird dazu beitragen, eine bessere KI zu entwickeln, und eine bessere KI kann mehr neues Wissen generieren.

Angesichts dieses Trends müssen wir uns klar darüber im Klaren sein, dass sich die Art und Weise, wie KI und Menschen zusammenarbeiten, ändern muss, denn KI ist nicht mehr die ursprüngliche KI von System 1, sondern wird sie System 2 KI. In diesem Fall ist die Art und Weise, wie KI zusammenarbeiten und interagieren soll, ein aktuelles Thema, das berücksichtigt werden muss.

Warum muss KI in der Lage sein, Wissen, Berechnung und Argumentation zu kombinieren? Hier sind einige Beispiele für multimodale Berechnungen als Referenz:

Für Wenn Sie beispielsweise im ersten Bild links fragen, wo die Person mit der roten Jacke am Ende des Spiels am wahrscheinlichsten landen wird, ist die Antwort der vierte Platz. Um solche Fragen zu beantworten, sind neben einer sehr genauen Bildsegmentierung und semantischen Segmentierung auch viele vernünftige Überlegungen und diskrete Überlegungen erforderlich. Das sind Dinge, die unseren aktuellen KI-Systemen sehr, sehr fehlen.

Als weiteres Beispiel: Was macht diese Stühle leicht zu tragen? Die Antwort lautet „faltbar“. Darin steckt auch eine logische Begründung. Solche System-2-Herausforderungen erfordern tatsächlich mehr Iteration und Weiterentwicklung der künstlichen Intelligenz.

Eine Entwicklung, die jetzt jeder kennt, ist der Durchbruch groß angelegter vorab trainierter Sprachmodelle. Eine natürliche Frage ist also: Wenn wir diesem Paradigma weiterhin folgen, können wir die effektive Integration hochwertiger Anwendungsszenarien und Wissen, Berechnung und Argumentation lösen?

Eine Entwicklung, die jetzt jeder kennt, ist der Durchbruch groß angelegter vorab trainierter Sprachmodelle. Eine natürliche Frage ist also: Wenn wir diesem Paradigma weiterhin folgen, können wir die effektive Integration hochwertiger Anwendungsszenarien und Wissen, Berechnung und Argumentation lösen?

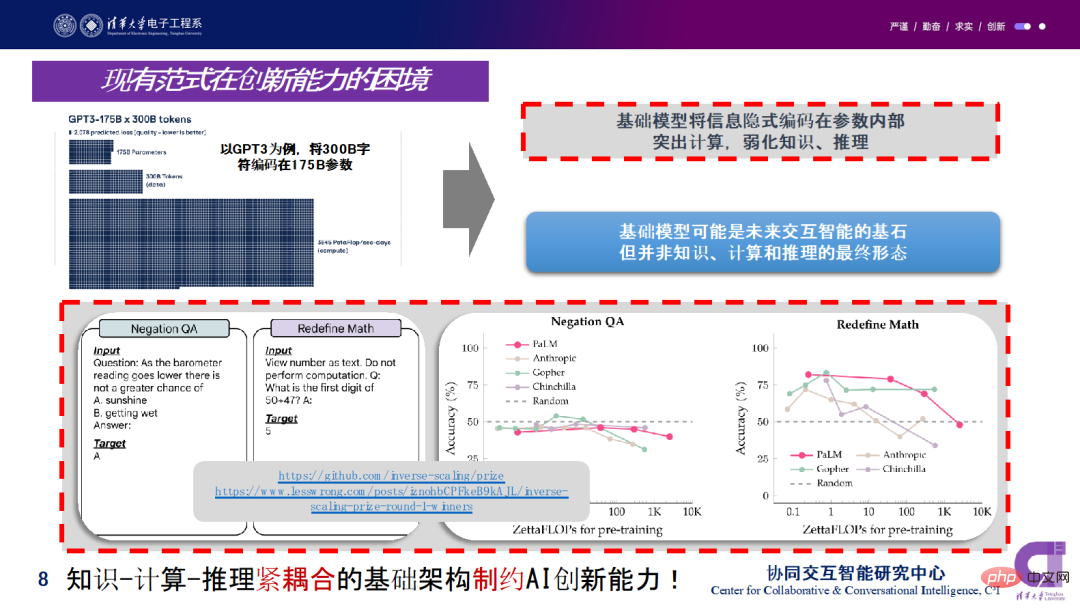

Nehmen Sie GPT-3 als Beispiel. Jeder weiß, dass es 175 Milliarden Parameter in der Modellarchitektur kodiert, wodurch Berechnungen hervorgehoben und Wissen geschwächt werden Argumentation. Einerseits verfügt es mit der Unterstützung des „Skalierungsgesetzes“ über immer mehr Daten und seine Modellfähigkeiten werden immer stärker. Andererseits haben mehrere Wissenschaftler an der NYU eine Herausforderung namens „Inverse Scaling“ für alle veranstaltet Finden Sie einige Anwendungsszenarien: Je größer das Modell und je größer die Parameter, desto schlechter ist die Leistung.

Im Bild oben sind zwei Beispiele zu sehen: eines heißt Negation QA Es handelt sich um die Negation der Negation, wobei die doppelte Negation verwendet wird, um das Verständnis und die Argumentationsfähigkeit des vorab trainierten Modells zu testen. Die andere ist Redefine Math,

Diese Aufgabe zielt darauf ab, mathematische Konstanten für bestehende mathematische Berechnungsprobleme neu zu definieren, um zu testen, ob das Sprachmodell ihre Bedeutung verstehen und korrekt berechnen kann#🎜🎜 ##🎜 🎜#

COUNT . Wie Sie den beiden Abbildungen rechts entnehmen können, ist bei diesen Aufgaben die Genauigkeit umso geringer, je größer die Modellparameter sind.

. Wie Sie den beiden Abbildungen rechts entnehmen können, ist bei diesen Aufgaben die Genauigkeit umso geringer, je größer die Modellparameter sind.

Diese Beispiele zeigen tatsächlich, dass das Grundmodell der Eckpfeiler zukünftiger interaktiver Intelligenz sein könnte. Ich persönlich halte es für ein wichtigeres Wort als „großes Modell“. Ein sehr wichtiger Punkt ist, dass das Grundmodell nicht seine endgültige Form ist. Um die aufgetretenen Probleme zu lösen, muss es besser visualisiert werden. Daher schlage ich vor, dass die effektive Kombination von Wissen, Berechnung und Argumentation eine Richtung ist, die als nächstes erforscht werden muss. Ein wichtiger Aspekt dieser Kombination besteht darin, dass die menschliche Zusammenarbeit und Interaktion die Weiterentwicklung dieser Grundmodelle fördern kann.

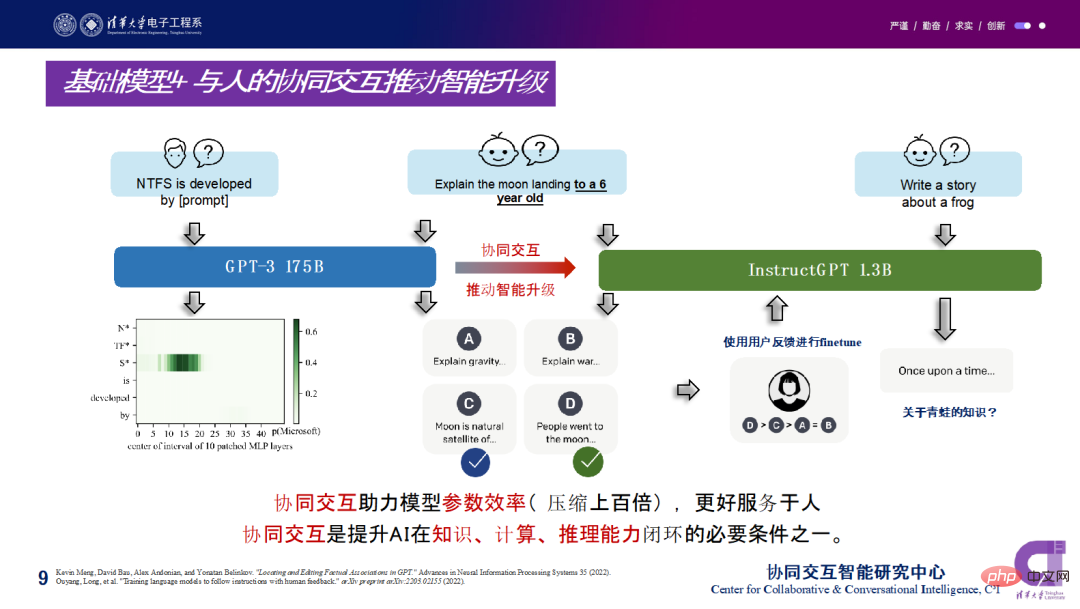

Wir verwenden zum Vergleich ein weiteres Beispiel basierend auf dem GPT3-Modell „InstructGPT“:

Bei einigen Fragen kann GPT-3 anhand von Eingabeaufforderungen sehr gut lernen, zu antworten. Wenn Sie jedoch einem 6-jährigen Kind die Mondlandung im Hinblick auf die grundlegenden Modellfunktionen von GPT3 erklären möchten, gibt es verschiedene Perspektiven für die Beantwortung dieser Frage, da eine große Anzahl von Werten dahinter steckt. Ausgehend vom physikalischen Prinzip der Schwerkraft ist dies beispielsweise das erste, das zweite aus der Perspektive des historischen Hintergrunds: Die Mondlandung fand während des Kalten Krieges zwischen den Vereinigten Staaten und der Sowjetunion statt und erklärt, wie der Kalte Krieg entstand geschah und wie es zum Mondlandeprojekt führte. Drittens ist der Mond aus astronomischer Sicht der Planet der Erde. Der vierte Typ geht von der menschlichen Perspektive aus. Beispielsweise wollten Menschen schon immer auf dem Mond landen. Es gibt viele schöne Legenden über Chang'e, und das Gleiche gilt auch für den Westen.

Aber anhand des aktuellen GPT3-Modells ist es schwierig zu beurteilen, welche Methode geeignet ist, einem 6-jährigen Kind so etwas zu erklären. Es basiert eher auf der Bedeutung von Häufigkeit und Korpus. Es ist sehr wahrscheinlich, dass es erklärt wird basierend auf einer Wikipedia-Seite. Was ist die Mondlandung und das Mondlandungsprojekt? Dies passt offensichtlich nicht gut zum Kontext. InstructGPT basiert also auf dieser Grundlage und ermöglicht es Benutzern, vier Arten von Antworten auszuwählen und zu bewerten: a, b, c und d. Nachdem das Ranking erstellt wurde, kann dieses Feedback zur Feinabstimmung des GPT3-Modells herangezogen werden. Wenn als nächstes eine neue Frage ansteht, wie zum Beispiel „Schreibe eine Froschgeschichte“, wird der Anfang dieses Modells zu „Es war einmal“, eine sehr geeignete Möglichkeit für Kinder, mit dem Anhören von Geschichten zu beginnen.

Der erste Punkt ist, dass das Modell zweifellos effizienter ist, und der andere Punkt ist, dass es zur Reduzierung der Modellparameter beiträgt. InstructGPT verfügt nur über 1,3 Milliarden Modellparameter, was im Vergleich zum GPT3-Modell hunderte Male komprimiert ist, aber es kann Menschen in bestimmten Szenarien besser bedienen. Kollaborative Interaktion ist eine notwendige Voraussetzung für die Verbesserung der Closed-Loop-Computing-Kenntnisse, Berechnungs- und Argumentationsfähigkeiten der KI.

Wir glauben, dass Intelligenz drei grundlegende Fähigkeiten umfasst: Wissen, Berechnung und Argumentation. Wir sehen, dass die Informatik derzeit sehr schnell voranschreitet. Natürlich gibt es auch Herausforderungen in Bezug auf Rechenleistung und Daten, aber der Mangel an Wissen und Argumentation ist besonders offensichtlich.

Hier stellt sich also die Frage: Wie erreicht man einen geschlossenen Kreislauf zwischen den dreien? Kann die Stärkung der aktiven kollaborativen Interaktion zwischen KI, Menschen und Umwelt der KI besser dabei helfen, einen geschlossenen Kreislauf zwischen den dreien zu erreichen? Unser akademischer Standpunkt ist, dass wir die Zusammenarbeit und Interaktion zwischen KI, Menschen und der Umwelt einführen müssen. Einerseits können wir die Fähigkeiten jedes Moduls verbessern und andererseits können wir Module zu einer Zusammenarbeit kombinieren Interaktionen.

In Anlehnung an unseren Eröffnungspunkt wird sich der nächste KI-Durchbruch von der virtuellen Existenz dahingehend verlagern, Menschen dabei zu helfen, effizienter Einblick in neues Wissen zu gewinnen und Aufgaben in der physischen, biologischen und Informationswelt zu erledigen.

Am Collaborative Interactive Intelligence Research Center der Tsinghua-Universität forschen wir hauptsächlich zu diesen akademischen Themen: Das heißt, unsere Forschung macht die KI stärker für System 2 und die Menschen stärker für System 1 verantwortlich. Die erste Herausforderung, die dies mit sich bringt, besteht darin, dass sich die KI selbst auf Aufgaben wie logisches Denken, hohe Berechnungen und hohe Komplexität verlagern muss, anstatt nur die Mustererkennungs- und Intuitionsarbeit von System 1 zu übernehmen. Die zweite Herausforderung besteht darin, wie Menschen und KI im Rahmen dieser neuen Arbeitsteilung zusammenarbeiten können. Dies sind zwei Forschungsrichtungen.

Die zweite Möglichkeit besteht in der Zusammenarbeit zwischen KI und Menschen, die es der KI ermöglicht, das Reinforcement Learning von Menschen im Kreislauf besser zu erlernen. Wir müssen ein besseres kontinuierliches KI-Lernen erforschen und in der Zusammenarbeit zwischen KI, der Umwelt und den Menschen viel Arbeit zur Verbesserung der multimodalen Darstellung leisten. Multimodalität ist ein wichtiger Kanal für die Zusammenarbeit, und gleichzeitig muss der Verbesserungsmechanismus für die Gesprächsinteraktion gestärkt werden.

Es gibt auch eine sehr wichtige Synergie, nämlich die Synergie zwischen KI und der Umwelt. KI muss sich an unterschiedliche Umgebungen anpassen. Diese Umgebungsanpassungen lassen sich in einem Satz zusammenfassen: Cloud-to-Edge-Anpassung und Edge-to-Cloud-Selbstentwicklung. Es ist leicht zu verstehen, wie sich diese Grundmodelle unter verschiedenen Rechenleistungs- und Kommunikationsbedingungen besser an diese Umgebungen anpassen können am Rand, um umgekehrt zu helfen. Das Basismodell iteriert besser. Mit anderen Worten handelt es sich hierbei um eine Zusammenarbeit und Interaktion zwischen kleinen Modellen und großen Modellen. Wir glauben jedoch nicht, dass diese Art der Zusammenarbeit und Interaktion einseitig ist. Es kann nur das große Modell sein, das durch Wissensdestillation und -bereinigung das kleine Modell erhält. Wir glauben, dass die Iteration und Interaktion kleiner Modelle einen effektiveren Weg zum Basismodell bieten sollte.

Wir glauben, dass die oben genannten drei technischen Wege sehr wichtig sind. Unten wird es eine Unterstützung auf unterster Ebene geben – vielleicht wird unsere aktuelle Forschung einige grundlegende theoretische Durchbrüche in der vertrauenswürdigen künstlichen Intelligenz bewirken, denn mit einer besseren Kombination aus Wissen, Berechnung und Argumentation können wir die ursprünglich durch Wissen verursachten Probleme besser lösen. Berechnung und Argumentation. Die Herausforderungen hinsichtlich Interpretierbarkeit, Robustheit und Verallgemeinerung der Black Box, die durch die Verschmelzung von Berechnung und Argumentation entstehen. Wir hoffen, diesen Fortschritt in der vertrauenswürdigen künstlichen Intelligenz auf eine Weise zu erreichen, die sowohl teilbar als auch zusammensetzbar ist. Wenn eine Person den Denkprozess der künstlichen Intelligenz nicht transparent erkennen kann, ist es tatsächlich schwierig, den Ergebnissen des Systems 2 der künstlichen Intelligenz zu vertrauen.

Betrachten Sie dieses Problem aus einer anderen Perspektive. Jeder weiß, dass ChatGPT in letzter Zeit sehr beliebt ist, daher haben wir viel daran gearbeitet, ChatGPT zu vermeiden. Dazu gehört natürlich auch Galactica, ein von Facebook vor einiger Zeit vorgeschlagenes System, das KI nutzt, um beim Verfassen wissenschaftlicher Arbeiten zu helfen. Wir haben festgestellt, dass sie alle die Zusammenarbeit von Menschen und der Umgebung erfordern, um Szenen zu erstellen. Diese Werteszenarien gab es früher eigentlich nicht, aber jetzt beginnen sie möglich zu werden. Aber sobald diese Möglichkeit von der menschlichen Zusammenarbeit und Interaktion getrennt wird, werden wir sofort feststellen, dass diese KI-Systeme nicht ausreichen.

Einschließlich Galactica, die sehr glatte Papiere schreiben kann, aber es gibt viele Die grundlegenden Fakten und Referenzen sind falsch. Beispielsweise ist der Name des Autors wahr, aber ein Teil des Titels ist wahr und ein Teil falsch, oder es werden mehrere Artikel miteinander kombiniert. Was ich betonen möchte, ist, dass die aktuelle KI nicht in der Lage ist, diesen vollständigen geschlossenen Kreislauf aus Wissen, Berechnung und Argumentation zu schließen, sodass sie den Menschen einbeziehen muss.

Obwohl Galactica bald offline sein wird, besteht ihr Zweck nicht darin, dass jeder damit selbstständig Arbeiten und wissenschaftliche Forschung abschließen kann, sondern darin, den Menschen besser zu helfen, also müssen die Menschen es sein in einem geschlossenen Kreislauf. Dies ist eine weitere Perspektive, die betont, dass die menschliche Zusammenarbeit und Interaktion eine sehr wichtige Grundvoraussetzung ist.

Als nächstes werde ich darüber sprechen, wie ich die Fortschritte und neuen Möglichkeiten des multimodalen Lernens im Kontext der kollaborativen Interaktion sehe. Zunächst einmal denke ich, dass sich die Multimodalität in letzter Zeit sehr schnell entwickelt hat und einige offensichtliche Trends hervorgebracht hat.

Zuallererst gibt es eine Konvergenz zwischen Multimodalitäten hinsichtlich der Dimensionen der Modellierung und Charakterisierung von Strukturen. In der Vergangenheit verwendete beispielsweise jeder CNN in Bildern und Videos, da Text ein Sequenzmodell ist und jeder hauptsächlich RNN und LSTM verwendete. Aber jetzt kann jeder, unabhängig von der Modalität, alle tokenisierten Eingaben als eine Sequenz behandeln oder das Diagrammmodell wird mithilfe des Selbstaufmerksamkeits-Plus-Mehrkopfmechanismus verarbeitet. Die in den letzten Jahren beliebte Transformer-Architektur hat dazu geführt, dass die Strukturen praktisch aller Modelle konvergieren.

Aber eine tiefe Frage ist, warum diese Architektur von Transformer Vorteile für alle modalen Darstellungen hat? Wir haben uns auch einige Gedanken gemacht und sind zu dem Schluss gekommen, dass Transformer verschiedene Modi in einem universelleren geometrischen topologischen Raum modellieren kann, wodurch die Modellierungsbarrieren zwischen Multimodalitäten weiter verringert werden. Daher legt dieser Vorteil von Transformer lediglich den Grundstein für diese architektonische Konvergenz in die multimodale Richtung.

#🎜🎜#Zweitens haben wir festgestellt, dass auch die multimodalen Pre-Training-Dimensionen konvergieren. Der früheste Bert wurde im Bereich der natürlichen Sprache vorgeschlagen, und dieser Maskenmodus brachte das Vortrainingsmodell zur Explosion. In neueren Arbeiten, einschließlich der MAE-Arbeit von Herrn He Kaiming, einschließlich Arbeiten im Bereich Sprache, wurden weiterhin ähnliche Ideen verwendet. Durch diese Maskenmethode wird eine konvergente vorab trainierte Modellarchitektur zwischen verschiedenen Modalitäten gebildet. Jetzt wurden die Barrieren vor dem Training zwischen den Modalitäten abgebaut und die Dimensionen der vorab trainierten Modelle haben sich weiter angenähert. Beispielsweise führt MAE die Vortrainingsmethode von BERT in verschiedene Modalitäten wie Sehen, Bild und Stimme ein. Daher zeigt der Maskenmechanismus Universalität in mehreren Modalitäten.

Der dritte Trend ist die Vereinheitlichung von Parametern vor der Architektur und Zielen vor dem Training. Derzeit wird die Transformer-Architektur zum Modellieren von Text, Bildern und Audio verwendet, und Parameter können von mehreren Aufgaben gemeinsam genutzt werden.

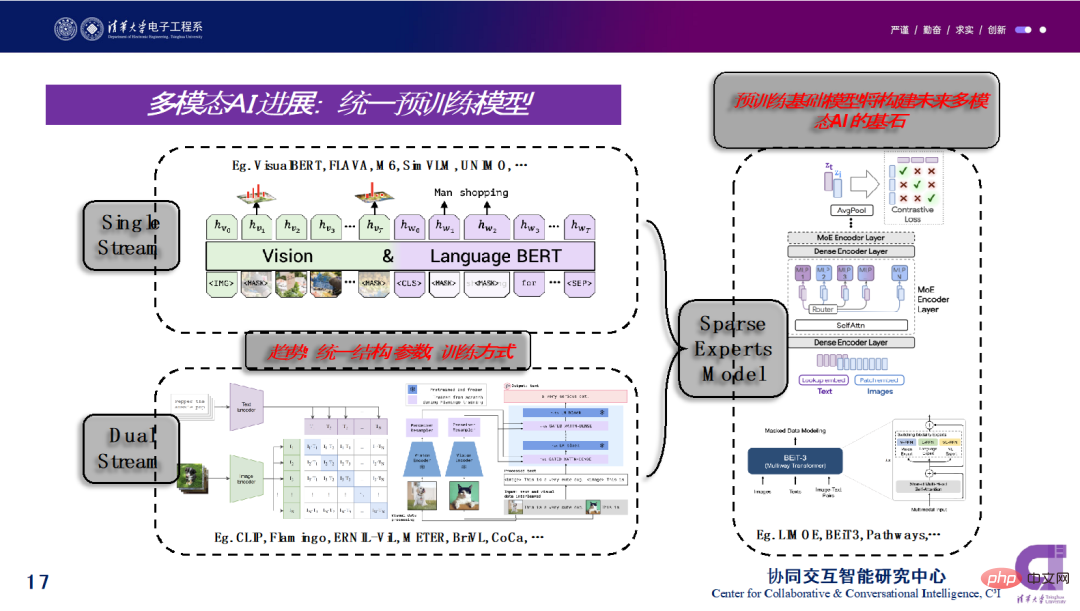

Konkret handelt es sich hauptsächlich um das aktuelle multimodale Pre-Training-Modell Unterteilt in Single-Flow- und Dual-Flow-Modelle. In einer Single-Stream-Architektur gehen wir davon aus, dass die zugrunde liegende Korrelation und Ausrichtung zwischen den beiden Modellen relativ einfach ist. Die Dual-Stream-Architektur geht davon aus, dass es notwendig ist, die Interaktion von Modalklassen innerhalb der Modalität und die Interaktion zwischen Cross-Modalitäten zu trennen, um eine bessere multimodale Darstellung zu erhalten und in der Lage zu sein, verschiedene Modalinformationen zu kodieren und zu fusionieren.

Die Frage ist, ob es einen besseren Weg gibt, diese Ideen zu vereinen. Der aktuelle Trend geht dahin, dass Sparsity und Modularität zwei Schlüsseleigenschaften zwischen leistungsfähigeren multimodalen Multitasks sein könnten. Das Sparse-Expertenmodell kann als ein ausgewogenes Sparse-Expertenmodellsystem zwischen Single-Stream und Dual-Stream betrachtet werden, das unterschiedliche Experten, unterschiedliche Modalitäten und Aufgaben bewältigen kann.

Eine Frage, die wir aufgeworfen haben, ist, ob wir den kollaborativen Interaktionsmodus verwenden können, um das Google Pathway-Modell für diese spezifischen Aufgaben hundertmal zu komprimieren, dabei aber eine spärliche und modulare Struktur beizubehalten Struktur? Diese Art von Arbeit ist eine weiterführende Forschung durchaus wert.

Um auf den Aspekt der kollaborativen Konversation zurückzukommen: Ich denke, dass ChatGPT derzeit eine sehr wichtige Arbeit ist, die darin besteht, eine neue Richtung einzuschlagen Richtung der kollaborativen Interaktion. Es kann beim wissenschaftlichen Schreiben, bei der Codegenerierung, bei Fragen und Antworten in Enzyklopädien, beim Verstehen von Anweisungen usw. verwendet werden. Das vorab trainierte Basismodell kann verschiedene Funktionen bereitstellen, z. B. interaktive intelligente Fragenbeantwortung, Schreiben und Codegenerierung. Die Kernfähigkeitsverbesserung von ChatGPT besteht darin, GPT 3 um Human-in-the-Loop-Lernen zur Verstärkung sowie menschliche Auswahl und Rangfolge verschiedener Antworten zu erweitern.

Obwohl die aktuelle Präsentationsform in ChatGPT die natürliche Sprache als Hauptträger ist, wird sich die gesamte Interaktionsmodalität definitiv zu dieser Multimodalität erweitern. Die menschliche Zusammenarbeit und Interaktion in multimodalen Szenarien wird tatsächlich effizienter sein, mehr Informationen liefern und die Integration von Wissen aus verschiedenen Modalitäten bewirken.

Wenn die kollaborativen Interaktionsfähigkeiten dieser Personen in der Schleife und die Fähigkeiten zur KI-Generierung integriert werden, kann viel getan werden. Beispielsweise sind das kollaborative Interaktions-ChatGPT-Modell und das Diffusionsmodell für Produktinnovation und Designinnovation integriert. Im Prozess der kollaborativen Interaktion suchen Modelle wie ChatGPT ständig nach den Mainstream-Trends im aktuellen Design und den Vorlieben bestimmter Verbraucher durch Einblicke in die emotionale Erfahrung von Verbraucherszenarien, Beurteilungen von Designtrends und Technologietrends, kombiniert mit einer großen Anzahl Durch die Analyse von Bildern kann eine gemeinsame Kreation durch mehrere Runden kollaborativer Interaktion mit Designern oder professionellen Produktmanagern erreicht werden.

In einigen sehr detaillierten Szenarien haben viele Menschen tatsächlich keine Vorkenntnisse, wie zum Beispiel im Bereich Smart Home, aber Menschen können über mehrere Runden der Mensch-Maschine-Zusammenarbeit interagieren Generieren Sie diese kreativen Designs und verwenden Sie dann das Stable Diffusion Model, um diese zentralen Keyword-Szenenerlebnisse menschlicher Kreativität in originalgetreue, wiederhergestellte Originaldesignbilder umzuwandeln. Kollaborative Interaktion kann Menschen dabei helfen, effizientere Produktinnovationen und Designinnovationen durchzuführen, und genau das tun wir bei Xianyuan Technology.

Multimodale Arbeit wird immer wichtiger, daher übernimmt unser Zentrum die Führung bei der Veröffentlichung der TPAMI 2023-Sonderausgabe zum Thema „Groß angelegtes multimodales Lernen“ mit dem Ziel der Zusammenführung von Daten aus mehreren Disziplinen (z. B. Computer Vision, Verarbeitung natürlicher Sprache, maschinelles Lernen, Deep Learning, intelligente Gesundheitsversorgung, Bioinformatik, Kognitionswissenschaft) wichtige wissenschaftliche Fragen aufwerfen und Forschungsmöglichkeiten entdecken, um mit der Zeit zurechtzukommen von Deep Learning und Big Data Herausragende Herausforderungen beim multimodalen Lernen.

Das obige ist der detaillierte Inhalt vonZhou Bowen von der Tsinghua-Universität: Die Popularität von ChatGPT zeigt die hohe Bedeutung der neuen Generation der Zusammenarbeit und interaktiven Intelligenz. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Wie man MySQL löst, kann nicht gestartet werden

Apr 08, 2025 pm 02:21 PM

Es gibt viele Gründe, warum MySQL Startup fehlschlägt und durch Überprüfung des Fehlerprotokolls diagnostiziert werden kann. Zu den allgemeinen Ursachen gehören Portkonflikte (prüfen Portbelegung und Änderung der Konfiguration), Berechtigungsprobleme (Überprüfen Sie den Dienst Ausführen von Benutzerberechtigungen), Konfigurationsdateifehler (Überprüfung der Parametereinstellungen), Datenverzeichniskorruption (Wiederherstellung von Daten oder Wiederaufbautabellenraum), InnoDB-Tabellenraumprobleme (prüfen IBDATA1-Dateien), Plug-in-Ladeversagen (Überprüfen Sie Fehlerprotokolle). Wenn Sie Probleme lösen, sollten Sie sie anhand des Fehlerprotokolls analysieren, die Hauptursache des Problems finden und die Gewohnheit entwickeln, Daten regelmäßig zu unterstützen, um Probleme zu verhindern und zu lösen.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Verstehen von Säureeigenschaften: Die Säulen einer zuverlässigen Datenbank

Apr 08, 2025 pm 06:33 PM

Detaillierte Erläuterung von Datenbanksäureattributen Säureattribute sind eine Reihe von Regeln, um die Zuverlässigkeit und Konsistenz von Datenbanktransaktionen sicherzustellen. Sie definieren, wie Datenbanksysteme Transaktionen umgehen, und sorgen dafür, dass die Datenintegrität und -genauigkeit auch im Falle von Systemabstürzen, Leistungsunterbrechungen oder mehreren Benutzern gleichzeitiger Zugriff. Säureattributübersicht Atomizität: Eine Transaktion wird als unteilbare Einheit angesehen. Jeder Teil schlägt fehl, die gesamte Transaktion wird zurückgerollt und die Datenbank behält keine Änderungen bei. Wenn beispielsweise eine Banküberweisung von einem Konto abgezogen wird, jedoch nicht auf ein anderes erhöht wird, wird der gesamte Betrieb widerrufen. begintransaktion; updateAccountsSetBalance = Balance-100WH

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

Kann MySQL JSON zurückgeben?

Apr 08, 2025 pm 03:09 PM

MySQL kann JSON -Daten zurückgeben. Die JSON_EXTRACT -Funktion extrahiert Feldwerte. Über komplexe Abfragen sollten Sie die Where -Klausel verwenden, um JSON -Daten zu filtern, aber auf die Leistungsauswirkungen achten. Die Unterstützung von MySQL für JSON nimmt ständig zu, und es wird empfohlen, auf die neuesten Versionen und Funktionen zu achten.

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

MySQL kann nach dem Herunterladen nicht installiert werden

Apr 08, 2025 am 11:24 AM

Die Hauptgründe für den Fehler bei MySQL -Installationsfehlern sind: 1. Erlaubnisprobleme, Sie müssen als Administrator ausgeführt oder den Sudo -Befehl verwenden. 2. Die Abhängigkeiten fehlen, und Sie müssen relevante Entwicklungspakete installieren. 3. Portkonflikte müssen Sie das Programm schließen, das Port 3306 einnimmt, oder die Konfigurationsdatei ändern. 4. Das Installationspaket ist beschädigt. Sie müssen die Integrität herunterladen und überprüfen. 5. Die Umgebungsvariable ist falsch konfiguriert und die Umgebungsvariablen müssen korrekt entsprechend dem Betriebssystem konfiguriert werden. Lösen Sie diese Probleme und überprüfen Sie jeden Schritt sorgfältig, um MySQL erfolgreich zu installieren.

Master SQL Limit -Klausel: Steuern Sie die Anzahl der Zeilen in einer Abfrage

Apr 08, 2025 pm 07:00 PM

Master SQL Limit -Klausel: Steuern Sie die Anzahl der Zeilen in einer Abfrage

Apr 08, 2025 pm 07:00 PM

SQllimit -Klausel: Steuern Sie die Anzahl der Zeilen in Abfrageergebnissen. Die Grenzklausel in SQL wird verwendet, um die Anzahl der von der Abfrage zurückgegebenen Zeilen zu begrenzen. Dies ist sehr nützlich, wenn große Datensätze, paginierte Anzeigen und Testdaten verarbeitet werden und die Abfrageeffizienz effektiv verbessern können. Grundlegende Syntax der Syntax: SelectColumn1, Spalte2, ... Fromtable_Namelimitnumber_of_rows; number_of_rows: Geben Sie die Anzahl der zurückgegebenen Zeilen an. Syntax mit Offset: SelectColumn1, Spalte2, ... Fromtable_NamelimitOffset, Number_of_rows; Offset: Skip überspringen