Papierlink: https://arxiv.org/pdf/2105.10375.pdf

Anwendung & Code:

Bildklassifizierung ist derzeit die erfolgreichste KI Eine der praktischen Anwendungstechnologien wurde in den Alltag der Menschen integriert. Es wird häufig in den meisten Computer-Vision-Aufgaben verwendet, z. B. in der Bildklassifizierung, Bildsuche, OCR, Inhaltsüberprüfung, Erkennungsauthentifizierung und anderen Bereichen. Mittlerweile herrscht allgemeiner Konsens: „Wenn der Datensatz größer ist und mehr IDs vorhanden sind, ist der Effekt der entsprechenden Klassifizierungsaufgabe besser, solange er richtig trainiert wird.“ Angesichts von Dutzenden Millionen IDs oder sogar Hunderten Millionen IDs ist es für das derzeit beliebte DL-Framework jedoch schwierig, solch ein sehr umfangreiches Klassifizierungstraining direkt und kostengünstig durchzuführen.

Der intuitivste Weg, dieses Problem zu lösen, besteht darin, durch Clustering mehr Grafikkartenressourcen zu verbrauchen, aber trotzdem wird das Klassifizierungsproblem unter massiven IDs immer noch die folgenden Probleme haben:

1) Kostenproblem: Verteiltes Training Framework + Bei großen Datenmengen verbrauchen Speicheraufwand, Kommunikation mit mehreren Maschinen, Datenspeicherung und -laden mehr Ressourcen.

2) Long-Tail-Problem: Wenn der Datensatz Hunderte Millionen IDs erreicht, ist die Anzahl der Bildbeispiele in den meisten IDs oft sehr gering. Die Long-Tail-Verteilung der Daten ist sehr offensichtlich und es ist schwierig, durch direktes Training größere Daten zu erhalten.

Die verbleibenden Kapitel dieses Artikels konzentrieren sich auf die vorhandenen Lösungen für sehr große Klassifizierungsrahmen sowie auf die entsprechenden Prinzipien und Tricks des kostengünstigen Klassifizierungsrahmens FFC.

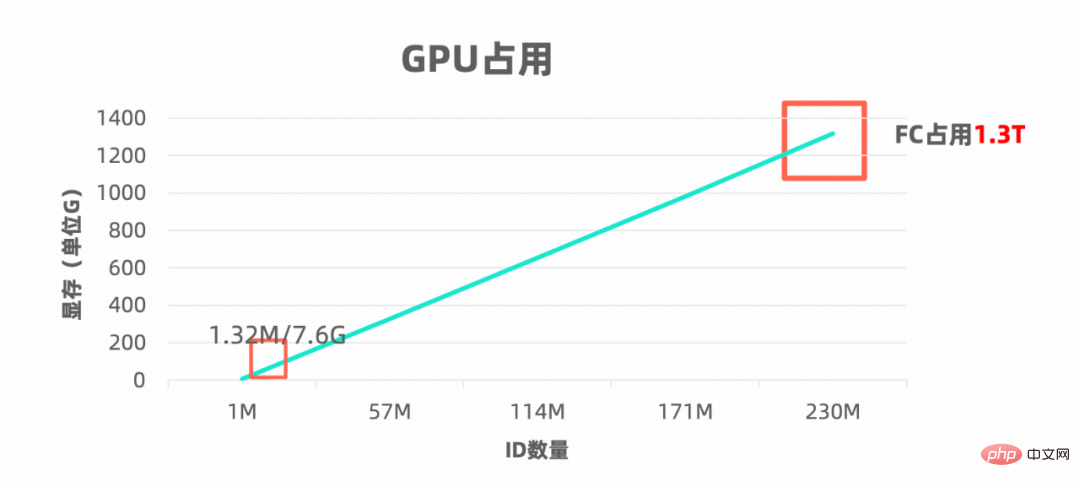

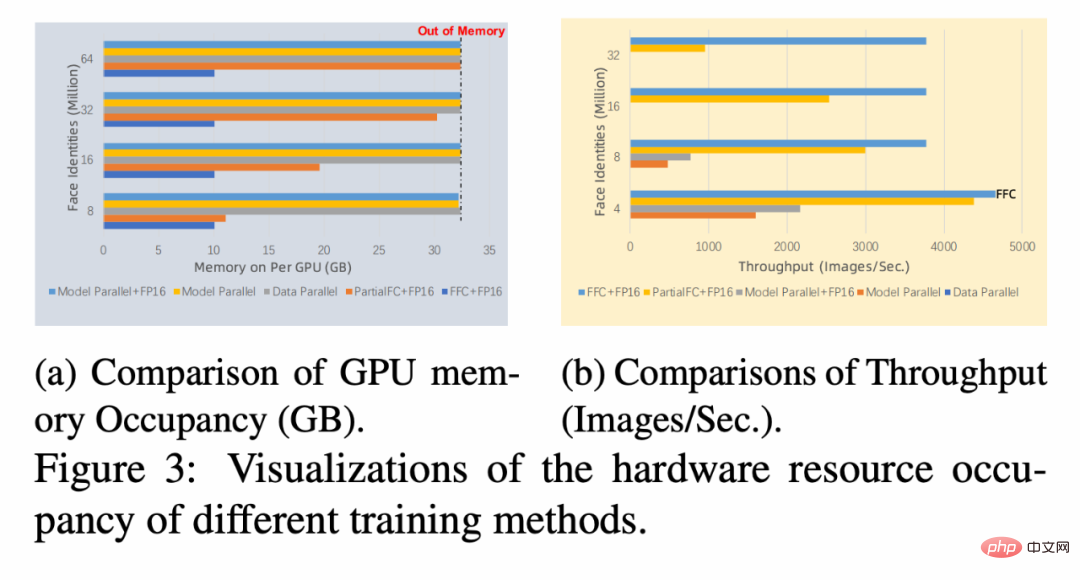

Vor der Einführung der Methode werden in diesem Artikel zunächst die größten Herausforderungen der aktuellen Klassifizierung im Ultragroßmaßstab erläutert: Je mehr IDs vorhanden sind, desto höher ist die Klassifizierung. Je größer der Speicherbedarf des Computers ist, wie in der folgenden schematischen Abbildung dargestellt: Je größer der Videospeicher, desto mehr Maschinenkarten sind erforderlich und desto höher sind die Kosten und desto höher sind die entsprechenden Kosten Hardware-Infrastruktur für die Zusammenarbeit mehrerer Maschinen. Wenn gleichzeitig die Anzahl der Klassifizierungs-IDs einen extrem großen Umfang erreicht, wird der Hauptberechnungsaufwand für die letzte Klassifikatorschicht verschwendet, und die vom Skelettnetzwerk verbrauchte Zeit ist vernachlässigbar.

Herausforderungspunkt 2: Schwierigkeiten beim Long-Tail-Lernen

In tatsächlichen Szenarien verfügen die meisten der Hunderte Millionen IDs nur über sehr wenige Bildbeispiele, und die Verteilung der Long-Tail-Daten ist sehr offensichtlich , direktes Training ist schwer zu konvergieren. Wenn mit gleichen Gewichten trainiert wird, werden Long-Tail-Proben überfordert und unzureichend erlernt. Derzeit werden im Allgemeinen unausgeglichene Stichproben verwendet. Welche Methode eignet sich besser für die Integration in das einfache, sehr große Klassifizierungsrahmenwerk?

Angesichts der beiden oben genannten Herausforderungen werfen wir zunächst einen Blick auf die vorhandenen realisierbaren Lösungen und darauf, ob sie die beiden oben genannten Herausforderungen gut lösen können.

Angesichts der beiden oben genannten Herausforderungen werfen wir zunächst einen Blick auf die vorhandenen realisierbaren Lösungen und darauf, ob sie die beiden oben genannten Herausforderungen gut lösen können.

Machbare Methode 1: Metrisches Lernen

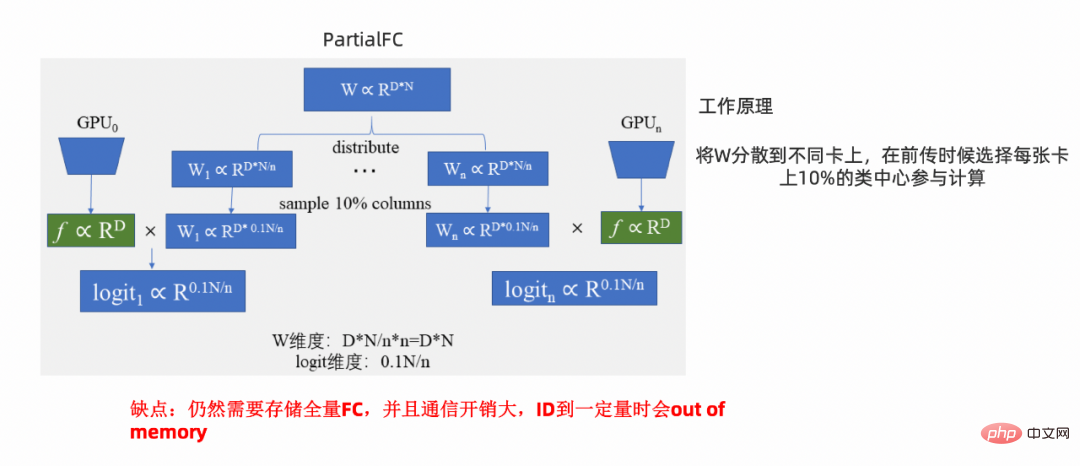

Machbare Methode 2: PFC-Framework

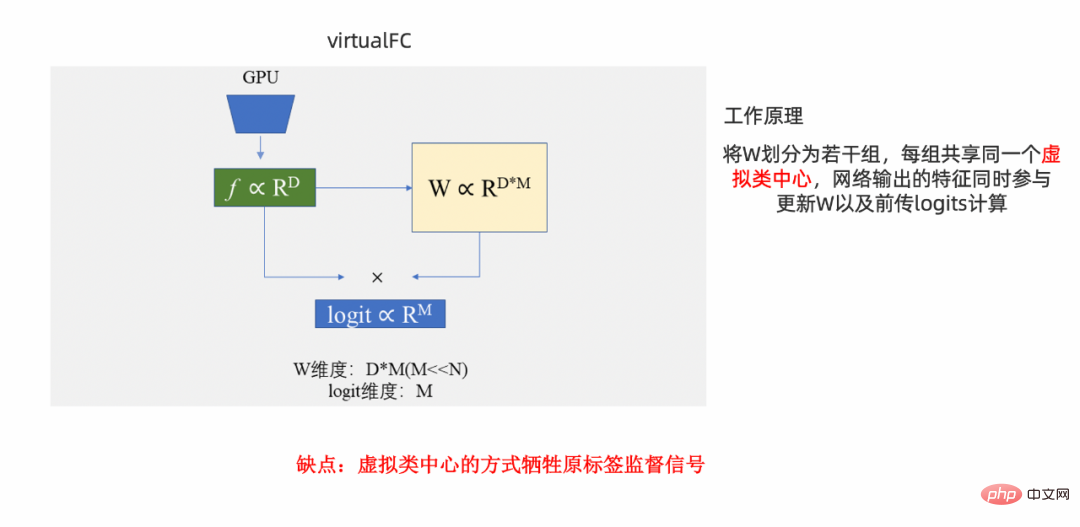

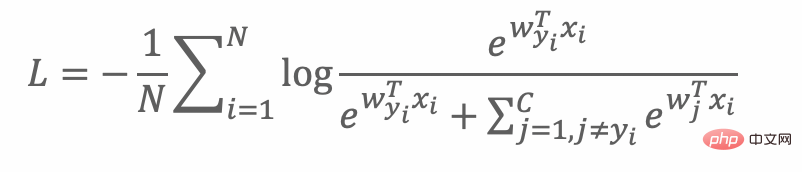

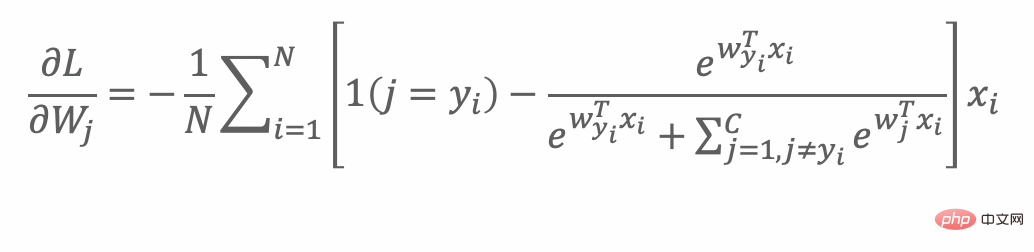

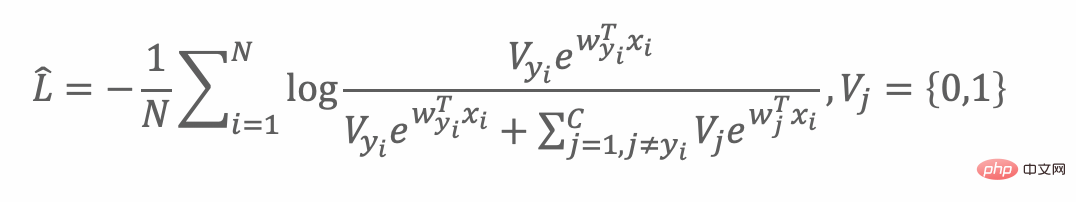

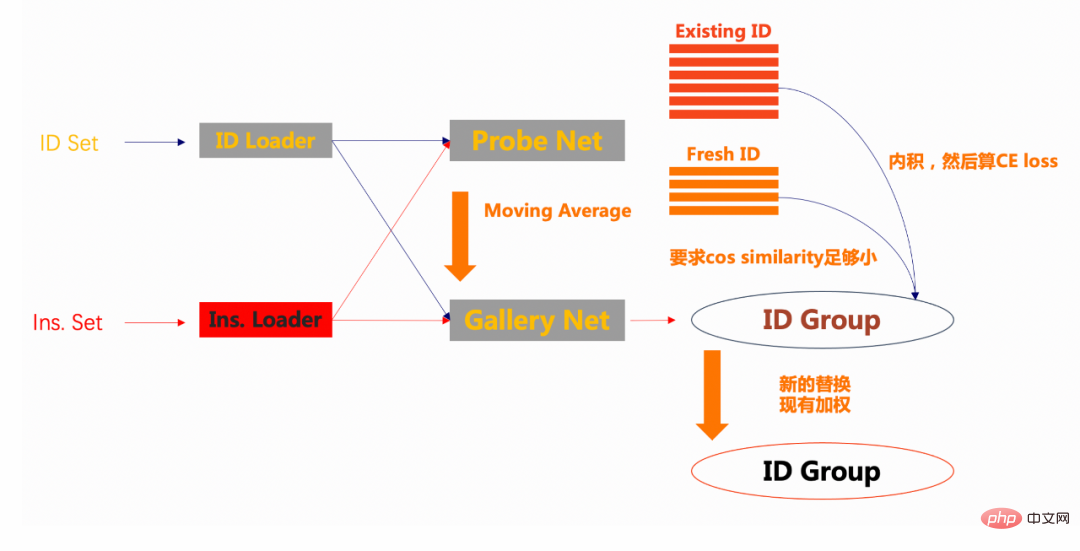

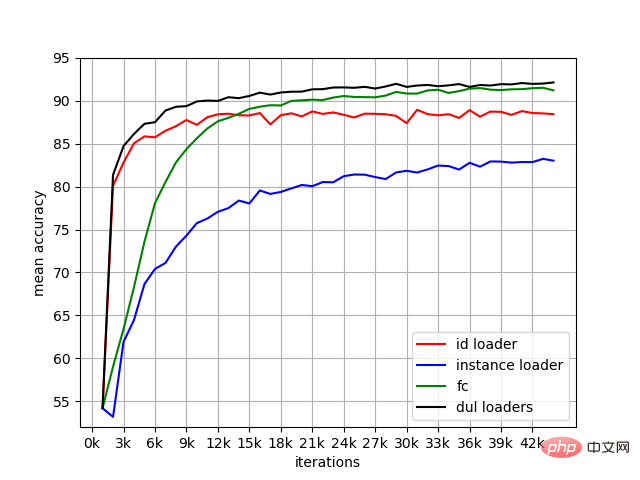

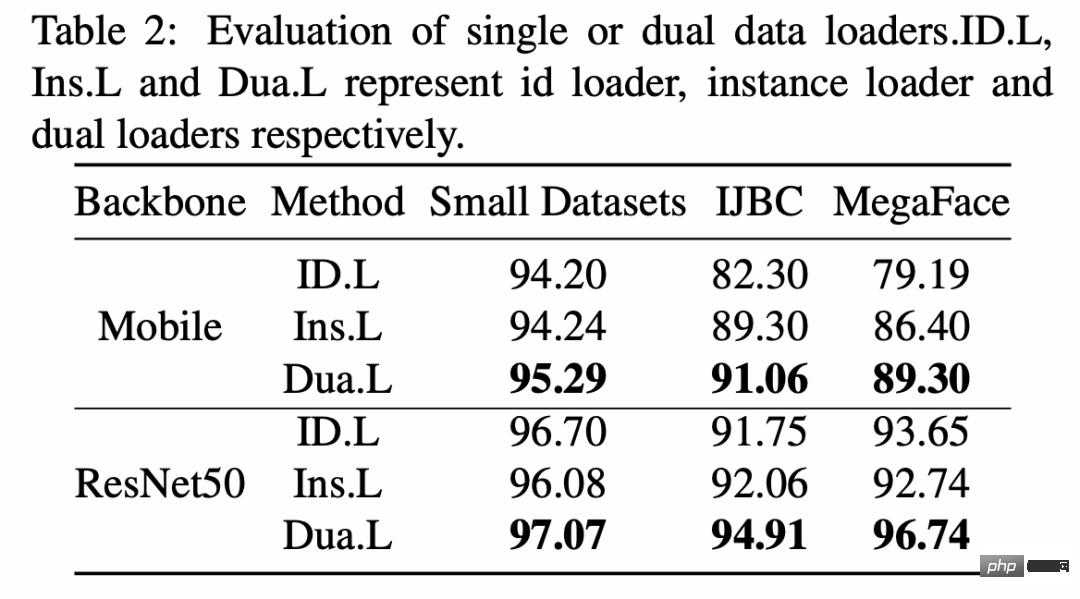

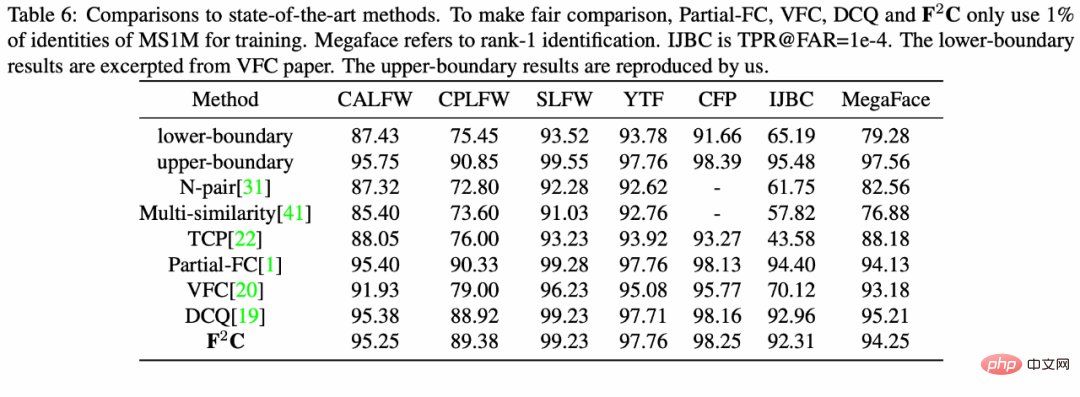

Machbare Methode 3: VFC-Framework Die Methode dieses Artikels: FFC-Framework Die Verlustfunktion beim Training mit FC für eine groß angelegte Klassifizierung ist wie folgt : Bei jedem Backpropagation-Prozess werden alle Klassenzentren aktualisiert: Aber FC ist zu groß, die intuitive Idee besteht darin, einen bestimmten Anteil der Klasse vernünftig auszuwählen Zentren, das heißt, Vj ist 1 wie folgt Teil: Die obige Motivation führt zu dem folgenden vorläufigen Plan: Zunächst, um die Auswirkungen des langen Schwanzes zu lösen In diesem Artikel werden zwei Loader vorgestellt, die auf ID-Sampling basieren und auf denen Instanz_Loader basiert. In jeder Epoche können Klassen mit vielen Stichproben und Klassen mit wenigen Stichproben (wenige Schüsse) trainiert werden. Zweitens: Senden Sie vor Beginn des Trainings einen Teil der ID-Proben an die ID-Gruppe. Dabei wird davon ausgegangen, dass 10 % der ID-Proben in die Gruppe aufgenommen werden. Derzeit verwendet die Galerie Zufallsparameter. Wenn dann das Training beginnt, gelangen die Chargenproben nacheinander in das Sondennetz. Dann gibt es für die Proben in jedem Stapel zwei Situationen: 1.) Es gibt Features mit derselben ID dieser Probe in der Gruppe, 2.) Es gibt keine Features ähnlicher Proben in der Gruppe. Nennen Sie sie in diesen beiden Fällen vorhandene ID bzw. neue ID. Verwenden Sie für vorhandene Proben das Feature und das Feature in der Gruppe, um das innere Produkt zu ermitteln, die Kreuzentropieverlustfunktion mit der Beschriftung zu berechnen und sie dann zurückzugeben. Minimieren Sie bei frischen Proben die Kosinusähnlichkeit mit den Proben in der Gruppe. Abschließend werden die Funktionen in der Gruppe aktualisiert und durch neue Klassenzentren ersetzt, basierend auf dem Prinzip der Gewichtung der vorhandenen Klassenzentren. Für das Galerienetz wird die Strategie des gleitenden Durchschnitts verwendet, um die Parameter in der Sonde schrittweise zu aktualisieren. Methode dieses Artikels: Einführung in den Trick 1.) Die Größe der eingeführten ID-Gruppe ist ein einstellbarer Parameter, im Allgemeinen beträgt der Standardwert 30.000. 2.) Um ein stabiles Training zu erreichen, beziehen Sie sich auf die Moco-Klassenmethode und führen Sie die entsprechenden Konvergenzbedingungen ein: 1 2. Wirkungsvergleich der SOTA-Methode 3. Vergleich von Videospeicher und Probendurchsatz

Experimentelle Ergebnisse

Das obige ist der detaillierte Inhalt vonDas kostengünstige Open-Source-Klassifizierungsframework FFC der DAMO Academy. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Einführung in das von vscode verwendete Framework

Einführung in das von vscode verwendete Framework

Vollständige Sammlung von SQL-Abfrageanweisungen

Vollständige Sammlung von SQL-Abfrageanweisungen

window.prompt

window.prompt

Wie Orakel rundet

Wie Orakel rundet

So öffnen Sie die Bin -Datei

So öffnen Sie die Bin -Datei

Der Unterschied zwischen counta und count

Der Unterschied zwischen counta und count

Vor- und Nachteile des Flutter-Frameworks

Vor- und Nachteile des Flutter-Frameworks

Sie benötigen die Erlaubnis des Administrators, um Änderungen an dieser Datei vorzunehmen

Sie benötigen die Erlaubnis des Administrators, um Änderungen an dieser Datei vorzunehmen