Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

AIGC, das sich an den menschlichen kreativen Prozess anpasst: Es entsteht ein Modell zur automatischen Generierung von Wachstumsgeschichten

AIGC, das sich an den menschlichen kreativen Prozess anpasst: Es entsteht ein Modell zur automatischen Generierung von Wachstumsgeschichten

AIGC, das sich an den menschlichen kreativen Prozess anpasst: Es entsteht ein Modell zur automatischen Generierung von Wachstumsgeschichten

Im heutigen Bereich der künstlichen Intelligenz tauchen nach und nach KI-Schreibartefakte auf, und Technologie und Produkte ändern sich mit jedem Tag.

Wenn es beim vor zwei Jahren von OpenAI veröffentlichten GPT-3 noch ein wenig an Schrift mangelt, dann können die generierten Ergebnisse von ChatGPT vor einiger Zeit als „wunderschön“ angesehen werden Schreiben und Handlung. „Es ist sowohl vollständig als auch logisch und in sich stimmig.“

Manche Leute sagen, wenn KI anfängt zu schreiben, hat das wirklich nichts mit Menschen zu tun.

Aber egal, ob es sich um Menschen oder KI handelt, sobald die „Wortzahlanforderung“ erhöht wird, wird es schwieriger, den Artikel zu „kontrollieren“.

Kürzlich haben der chinesische KI-Forscher Tian Yuandong und mehrere andere Forscher kürzlich ein neues Sprachmodell veröffentlicht – Re^3. Diese Forschung wurde auch für EMNLP 2022 ausgewählt.

Papierlink: https://arxiv. org/pdf/2210.06774.pdf

Tian Yuandong hat dieses Modell einmal auf Zhihu vorgestellt:

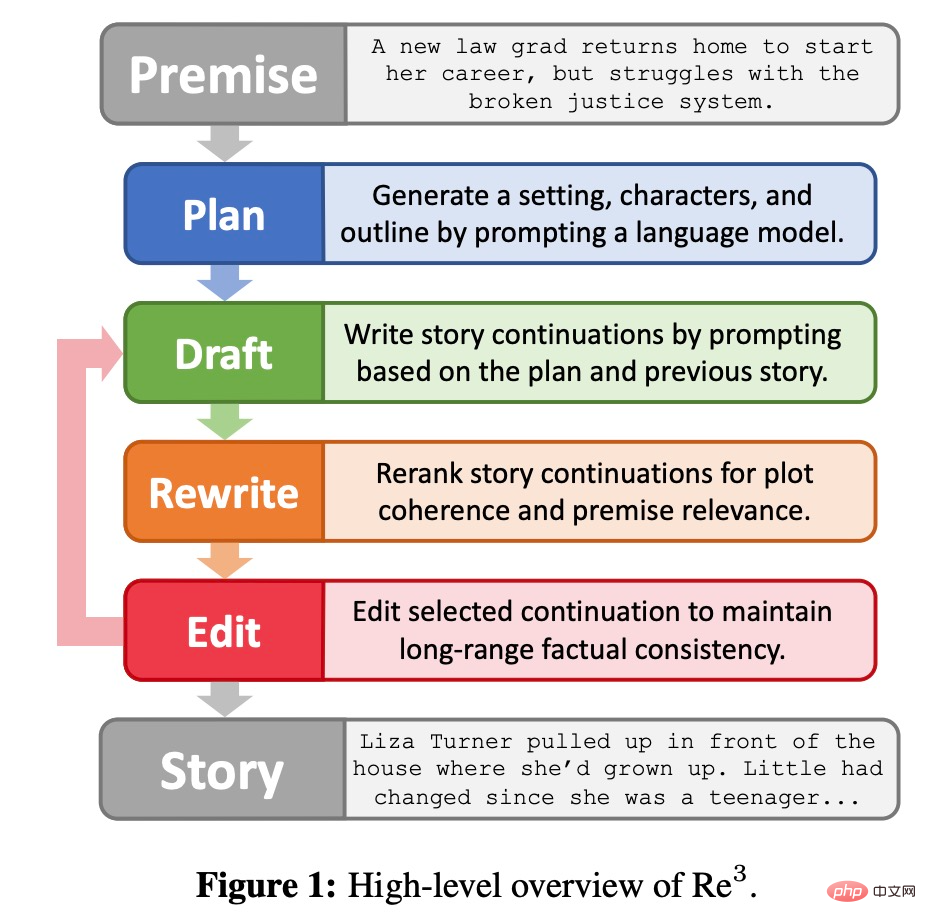

Das Die Idee von Re^3 ist äußerst einfach. Durch das Entwerfen von Eingabeaufforderungen können konsistente Geschichten generiert werden, ohne dass große Modelle optimiert werden müssen. Wir verlassen die lineare Logik der Wort-für-Wort-Generierung des Sprachmodells und verwenden eine hierarchische Generierungsmethode: Generieren Sie zunächst die Story-Charaktere, verschiedene Attribute und Umrisse der Charaktere in der Planphase und geben Sie dann die Story-Umrisse und Rollen in der Entwurfsphase und generieren wiederholt bestimmte Absätze. Diese spezifischen Absätze werden in der Rewrite-Phase gefiltert, um generierte Absätze auszuwählen, die in hohem Maße mit dem vorherigen Absatz zusammenhängen, während diejenigen verworfen werden, die nicht eng miteinander verbunden sind (dies erfordert das Training eines kleinen Modells). und schließlich einige offensichtliche sachliche Fehler in der Bearbeitungsphase korrigieren. MethodeneinführungDie Idee von Re^3 besteht darin, durch rekursives Reprompt und Anpassungen längere Geschichten zu generieren, was eher dem kreativen Prozess entspricht menschlicher Schriftsteller. Re^3 unterteilt den menschlichen Schreibprozess in vier Module: Planung, Entwurf, Umschreiben und Bearbeitung. #🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜 ## 🎜🎜##Plan -Modul

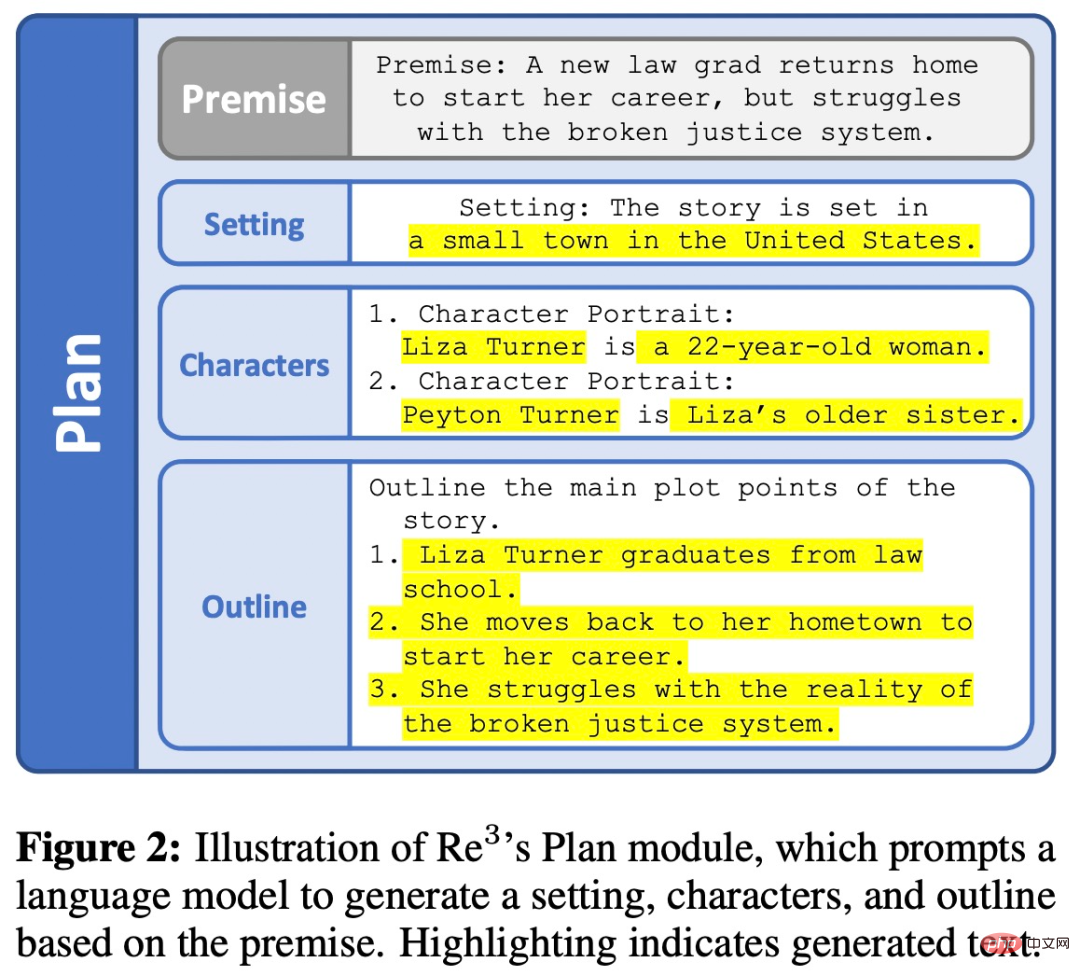

### 🎜🎜##🎜🎜 🎜🎜 #Wie in Abbildung 2 unten dargestellt, erweitert das Planungsmodul die Story-Prämisse um Hintergrund, Charaktere und Story-Umriss. Erstens ist der Hintergrund eine einfache Ein-Satz-Erweiterung der Story-Prämisse, die mit GPT3-Instruct-175B (Ouyang et al., 2022) erhalten wurde; dann generiert GPT3-Instruct175B Charakternamen neu und generiert Charakterbeschreibungen basierend auf der Prämisse und dem Hintergrund ; schließlich fordert die Methode GPT3-Instruct175B auf, die Story-Gliederung zu schreiben. Die Komponenten im Planungsmodul werden von prompt selbst generiert und immer wieder verwendet.

Entwurfsmodul

# 🎜 🎜#

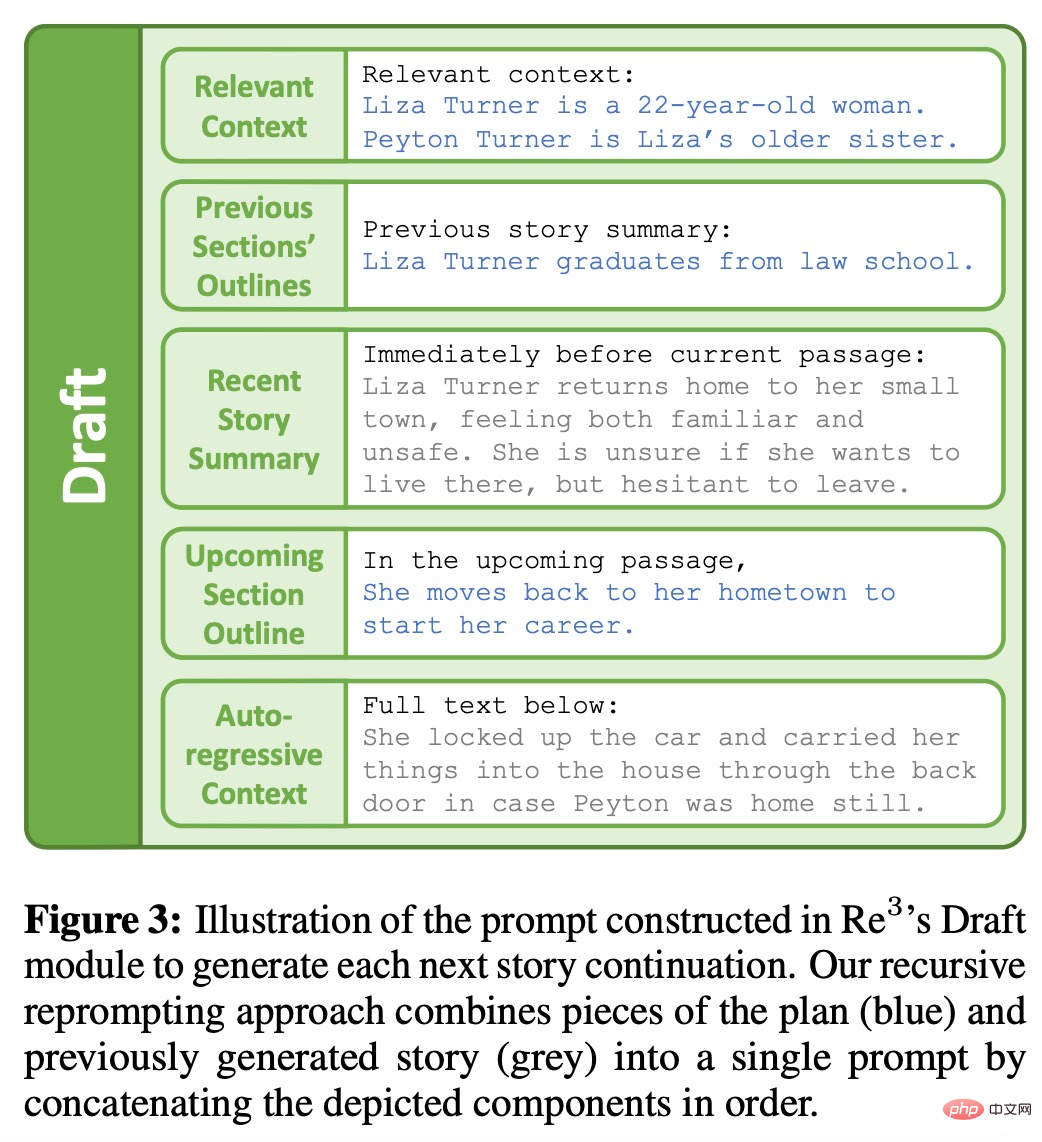

Für jede vom Planungsmodul erhaltene Gliederung generiert das Entwurfsmodul weiterhin mehrere Story-Absätze. Jeder Absatz ist eine Fortsetzung mit fester Länge, die aus einer strukturierten Eingabeaufforderung generiert wird, die durch eine rekursive erneute Eingabeaufforderung gebildet wird. Das Entwurfsmodul ist in Abbildung 3 unten dargestellt.

Modul neu schreiben

# 🎜🎜 # Die erste Ausgabe des Generators ist normalerweise von geringer Qualität, wie der erste Entwurf, den die Leute fertigstellen, der zweite Entwurf erfordert möglicherweise das Umschreiben eines Artikels auf der Grundlage von Feedback.

Bearbeitungsmodul

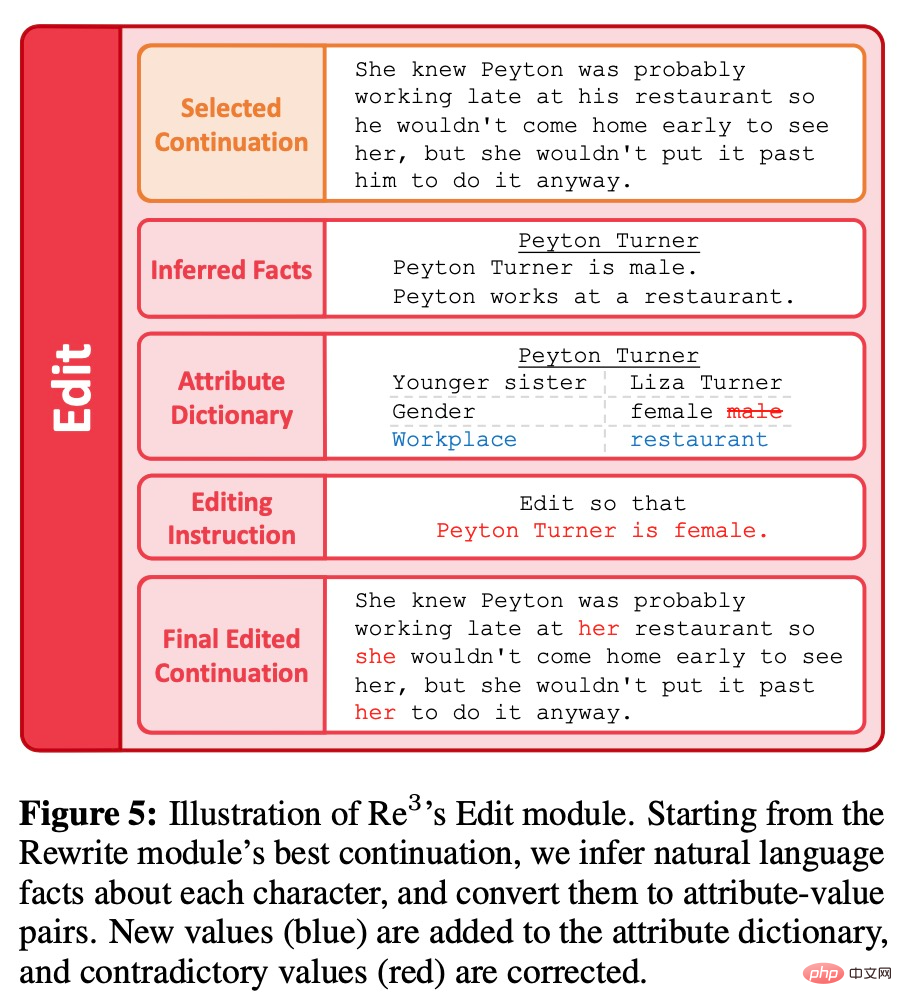

Im Gegensatz zum umfangreichen Umschreiben handelt es sich beim Bearbeitungsmodul um eine teilweise Bearbeitung der durch die Planungs-, Entwurfs- und Umschreibungsmodule generierten Absätze, um den generierten Inhalt weiter zu verbessern. Konkret geht es darum, lange Abfolgen sachlicher Inkonsistenzen zu beseitigen. Wenn man beim Korrekturlesen eine kleine sachliche Diskontinuität entdeckt, kann man einfach das problematische Detail bearbeiten, anstatt den übergeordneten Artikelplan umfassend zu überarbeiten oder inhaltlich umzuschreiben. Das Bearbeitungsmodul ahmt diesen Prozess des menschlichen Verfassens in zwei Schritten nach: Erkennen sachlicher Inkonsistenzen und deren Korrektur, wie in Abbildung 5 unten dargestellt.

Bewertung

In der Bewertungsphase stellte der Forscher die Aufgabe, auf der Grundlage eines kurzen Ausgangskontexts eine Geschichte zu generieren. Da es schwierig ist, „Geschichten“ auf regelbasierte Weise zu definieren, haben wir den akzeptablen Ergebnissen keine regelbasierten Einschränkungen auferlegt und sie stattdessen anhand mehrerer von Menschen kommentierter Metriken bewertet. Um erste Prämissen zu generieren, forderten die Forscher mit GPT3-Instruct-175B auf, 100 verschiedene Prämissen zu erhalten.

Baseline

Da sich die vorherige Methode im Vergleich zu Re^3 mehr auf Kurzgeschichten konzentrierte, ist ein direkter Vergleich schwierig. Daher verwendeten die Forscher die folgenden zwei Basislinien basierend auf GPT3-175B:

1, generieren Sie 256 Token gleichzeitig über GPT3-175B, verwenden Sie die vorherige Situation und den gesamten zuvor generierten Story-Text als Eingabeaufforderung, falls es mehr gibt Wenn ein Token größer als 768 ist, wird die Eingabeaufforderung links abgeschnitten. Daher beträgt die maximale Kontextlänge des „Rolling Window“ 1024, was der gleichen maximalen Kontextlänge entspricht, die in RE^3 verwendet wird. Nach der Generierung von 3072 Token verwendeten die Forscher denselben Story-Ende-Mechanismus wie RE^3.

2. Das Gleiche wie ROLLING, außer dass GPT3-175B zunächst Hunderte von Absätzen in der WritingPrompts-Story verfeinert, die mindestens 3000 Token haben.

Indikatoren

Zu den von Forschern verwendeten Bewertungsindikatoren gehören:

1. Interessant. Seien Sie für die Leser interessant.

2. Konsistenz. Die Handlung ist stimmig.

3. Relevanz. Bleiben Sie dem Original treu.

4. Humanoid. Vermutlich von Menschen geschrieben.

Darüber hinaus verfolgten die Forscher auch, wie oft die generierten Geschichten Schreibprobleme in den folgenden Aspekten hatten:

1. Eine schockierende Veränderung in der Erzählung oder im Stil.

2. Inkonsistenz. Es ist sachlich falsch oder enthält sehr seltsame Details.

3. Chaos. Verwirrend oder schwer verständlich.

4. Wiederholbarkeit. Hohe Wiederholgenauigkeit.

5. Nicht glatt. Häufige Grammatikfehler.

Ergebnisse

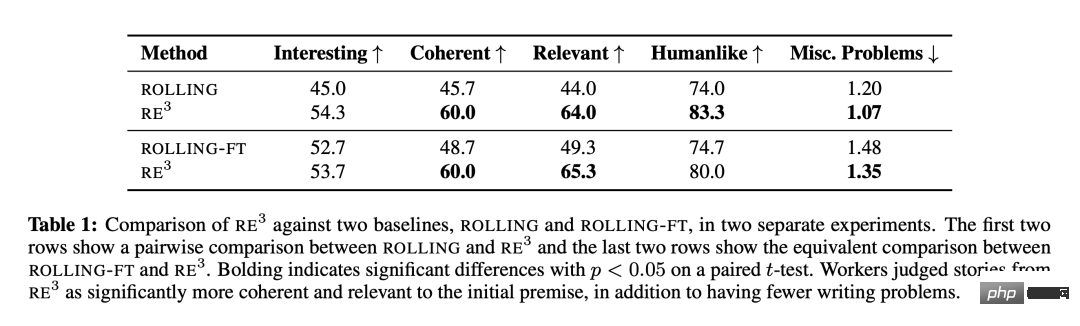

Wie in Tabelle 1 gezeigt, ist Re^3 sehr effektiv, wenn es darum geht, eine längere Geschichte basierend auf der erwarteten Situation zu schreiben und gleichzeitig eine kohärente Gesamthandlung beizubehalten. Überprüfung Es beinhaltet Design Entscheidungen von Forschern, die vom menschlichen Schreibprozess inspiriert sind, sowie rekursive Generierungsmethoden für erneute Eingabeaufforderungen. Im Vergleich zu ROLLING und ROLLING-FT verbessert Re^3 sowohl Kohärenz als auch Relevanz erheblich. Der Kommentator bezeichnete die Geschichte von Re^3 auch als „deutlich weniger redundante Schreibprobleme“.

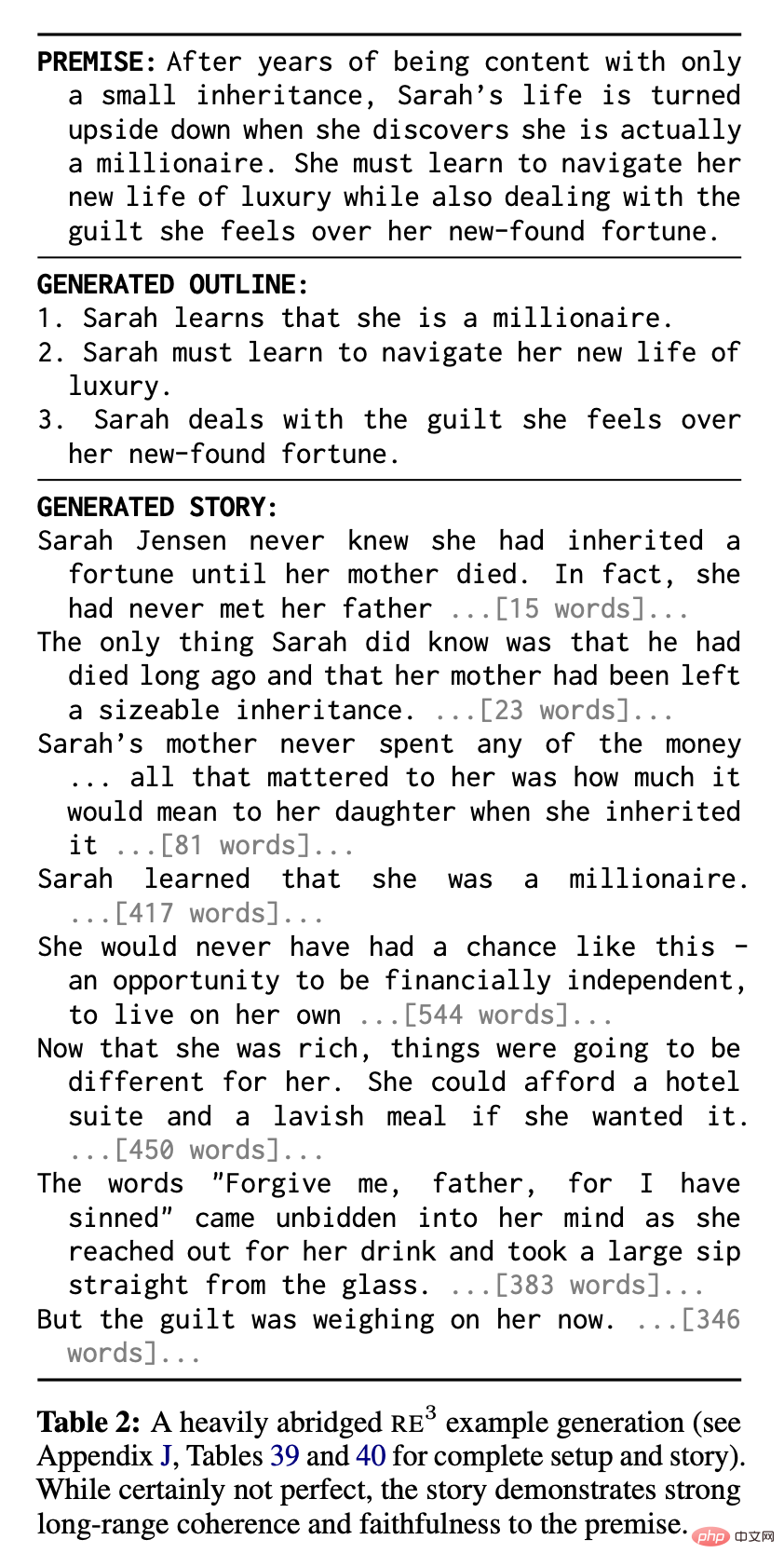

Re^3 zeigt im absoluten Sinne eine starke Leistung: Kommentatoren glauben, dass in den beiden Vergleichen 83,3 % bzw. 80,0 % der Re^3-Geschichten von Menschen geschrieben wurden. Tabelle 2 zeigt ein Beispiel einer stark gekürzten Geschichte aus Re^3, in der starke Kohärenz und Kontextrelevanz erkennbar sind: Verbesserung durch Re^3.

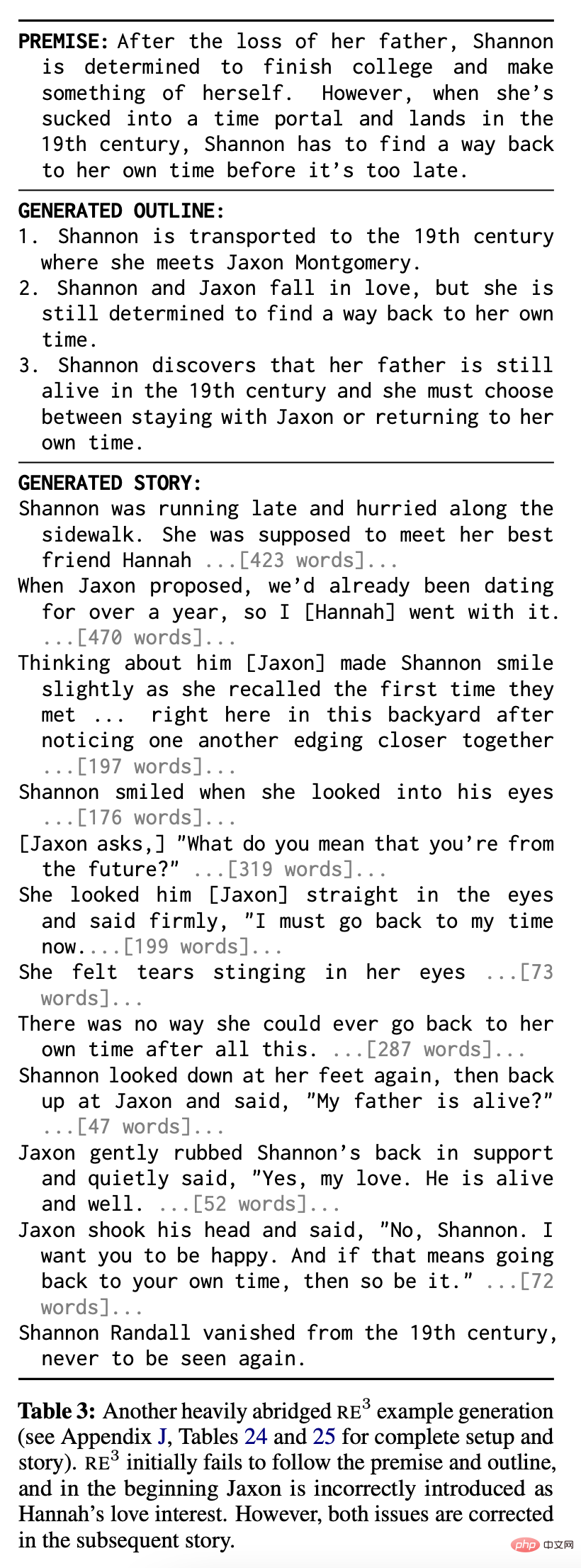

Zwei häufige Probleme sind in Tabelle 3 aufgeführt. Erstens: Obwohl Re^3s im Gegensatz zu Basisgeschichten fast immer bis zu einem gewissen Grad der Prämisse der Geschichte folgen, erfassen sie möglicherweise nicht alle Teile der Prämisse und folgen möglicherweise nicht der vom Planungsmodul generierten Teilgliederung (z. B. Tabelle 3 Der erste Teil von die Geschichte und die Gliederung). Zweitens gibt es aufgrund des Ausfalls des Rewriting-Moduls, insbesondere des Editing-Moduls, immer noch einige verwirrende Passagen oder widersprüchliche Aussagen: Beispielsweise hat die Figur Jaxon in Tabelle 3 an einigen Stellen eine widersprüchliche Identität.

Zwei häufige Probleme sind in Tabelle 3 aufgeführt. Erstens: Obwohl Re^3s im Gegensatz zu Basisgeschichten fast immer bis zu einem gewissen Grad der Prämisse der Geschichte folgen, erfassen sie möglicherweise nicht alle Teile der Prämisse und folgen möglicherweise nicht der vom Planungsmodul generierten Teilgliederung (z. B. Tabelle 3 Der erste Teil von die Geschichte und die Gliederung). Zweitens gibt es aufgrund des Ausfalls des Rewriting-Moduls, insbesondere des Editing-Moduls, immer noch einige verwirrende Passagen oder widersprüchliche Aussagen: Beispielsweise hat die Figur Jaxon in Tabelle 3 an einigen Stellen eine widersprüchliche Identität.

Im Gegensatz zur Rolling-Window-Methode kann sich die Planungsmethode von Re^3 jedoch „selbst korrigieren“ und zur ursprünglichen Handlung zurückkehren. Die zweite Hälfte der Geschichte in Tabelle 3 veranschaulicht diese Fähigkeit.

Analyse

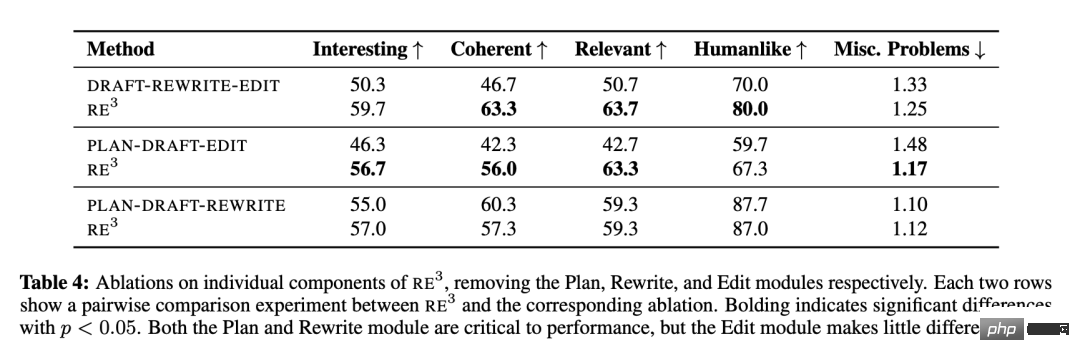

Die Forscher untersuchten den relativen Beitrag jedes Moduls von Re^3: Planung, Entwurf, Umschreiben und Bearbeitung, und führten nacheinander Ablationsexperimente für jedes Modul durch. Die Ausnahme bildet das Draft-Modul, da unklar ist, wie das System ohne dieses funktionieren würde.

Tabelle 4 zeigt, dass die Module „Planung“ und „Umschreiben“, die den menschlichen Planungs- und Umschreibungsprozess nachahmen, für die Gesamtkohärenz der Handlung und die Relevanz der Prämisse von entscheidender Bedeutung sind. Allerdings trägt das Modul „Bearbeiten“ nur sehr wenig zu diesen Kennzahlen bei. Die Forscher stellten auch qualitativ fest, dass es in der letzten Geschichte von Re^3 immer noch viele Kohärenzprobleme gibt, die nicht vom Bearbeitungsmodul behoben werden, dass diese Probleme jedoch von einem sorgfältigen menschlichen Redakteur gelöst werden könnten.

Weitere Analyse des Moduls „Bearbeiten“

Weitere Analyse des Moduls „Bearbeiten“

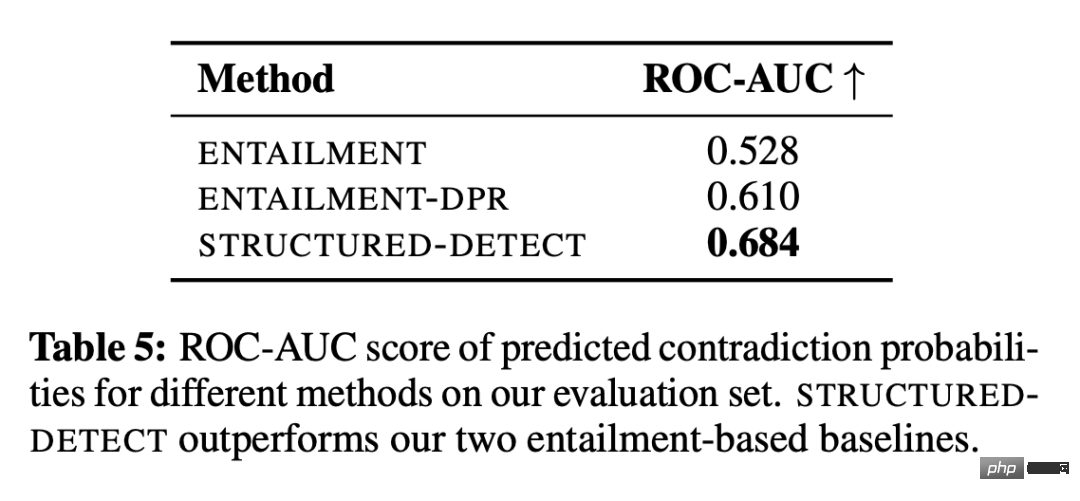

Die Forscher untersuchten in einer kontrollierten Umgebung, ob das Modul „Bearbeiten“ zumindest rollenbasierte Sachinkonsistenzen erkennen konnte. Das Erkennungssubsystem heißt STRUCTURED-DETECT, um Verwechslungen mit dem gesamten Bearbeitungsmodul zu vermeiden.

Wie in Tabelle 5 gezeigt, übertrifft STRUCTUREDDETECT beide Baselines bei der Erkennung rollenbasierter Inkonsistenzen gemäß der Standard-ROC-AUC-Klassifizierungsmetrik. Der ROC-AUC-Score des ENTAILMENT-Systems ist kaum besser als die Zufallsleistung (0,5), was die zentrale Herausforderung verdeutlicht, dass Erkennungssysteme äußerst genau sein müssen. Darüber hinaus ist STRUCTURED-DETECT so konzipiert, dass es auf längere Absätze skaliert werden kann. Die Forscher stellten die Hypothese auf, dass sich die Leistungslücke bei Auswertungen mit längeren Eingaben im Vergleich zum Ausgangswert vergrößern würde.

Selbst in dieser vereinfachten Umgebung ist die absolute Leistung aller Systeme immer noch gering. Darüber hinaus enthalten viele der generierten vollständigen Geschichten Inkonsistenzen, die nicht mit den Charakteren zusammenhängen, beispielsweise Hintergrundinkonsistenzen mit der aktuellen Szene. Obwohl die Forscher die Fähigkeit der GPT-3-Bearbeitungs-API, Inkonsistenzen nach deren Erkennung zu korrigieren, nicht offiziell analysierten, stellten sie auch fest, dass sie isolierte Details korrigieren kann, bei größeren Änderungen jedoch Probleme bereitet.

Zusammenfassend lässt sich sagen, dass zusammengesetzte Fehler aus den Erkennungs- und Korrektur-Subsystemen es für das aktuelle Bearbeitungsmodul dieser Studie schwierig machen, die sachliche Konsistenz über Tausende von Wörtern hinweg effektiv zu verbessern, ohne gleichzeitig unnötige Änderungen einzuführen.

Das obige ist der detaillierte Inhalt vonAIGC, das sich an den menschlichen kreativen Prozess anpasst: Es entsteht ein Modell zur automatischen Generierung von Wachstumsgeschichten. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Welche Methode wird verwendet, um Strings in Objekte in Vue.js umzuwandeln?

Apr 07, 2025 pm 09:39 PM

Welche Methode wird verwendet, um Strings in Objekte in Vue.js umzuwandeln?

Apr 07, 2025 pm 09:39 PM

Bei der Konvertierung von Zeichenfolgen in Objekte in Vue.js wird JSON.Parse () für Standard -JSON -Zeichenfolgen bevorzugt. Bei nicht standardmäßigen JSON-Zeichenfolgen kann die Zeichenfolge durch Verwendung regelmäßiger Ausdrücke verarbeitet und Methoden gemäß dem Format oder dekodierten URL-kodiert reduziert werden. Wählen Sie die entsprechende Methode gemäß dem String -Format aus und achten Sie auf Sicherheits- und Codierungsprobleme, um Fehler zu vermeiden.

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

So verwenden Sie MySQL nach der Installation

Apr 08, 2025 am 11:48 AM

Der Artikel führt den Betrieb der MySQL -Datenbank vor. Zunächst müssen Sie einen MySQL -Client wie MySQLworkBench oder Befehlszeilen -Client installieren. 1. Verwenden Sie den Befehl mySQL-uroot-P, um eine Verbindung zum Server herzustellen und sich mit dem Stammkonto-Passwort anzumelden. 2. Verwenden Sie die Erstellung von Createdatabase, um eine Datenbank zu erstellen, und verwenden Sie eine Datenbank aus. 3.. Verwenden Sie CreateTable, um eine Tabelle zu erstellen, Felder und Datentypen zu definieren. 4. Verwenden Sie InsertInto, um Daten einzulegen, Daten abzufragen, Daten nach Aktualisierung zu aktualisieren und Daten nach Löschen zu löschen. Nur indem Sie diese Schritte beherrschen, lernen, mit gemeinsamen Problemen umzugehen und die Datenbankleistung zu optimieren, können Sie MySQL effizient verwenden.

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Laravels Geospatial: Optimierung interaktiver Karten und großen Datenmengen

Apr 08, 2025 pm 12:24 PM

Verarbeiten Sie 7 Millionen Aufzeichnungen effizient und erstellen Sie interaktive Karten mit Geospatial -Technologie. In diesem Artikel wird untersucht, wie über 7 Millionen Datensätze mithilfe von Laravel und MySQL effizient verarbeitet und in interaktive Kartenvisualisierungen umgewandelt werden können. Erstes Herausforderungsprojektanforderungen: Mit 7 Millionen Datensätzen in der MySQL -Datenbank wertvolle Erkenntnisse extrahieren. Viele Menschen erwägen zunächst Programmiersprachen, aber ignorieren die Datenbank selbst: Kann sie den Anforderungen erfüllen? Ist Datenmigration oder strukturelle Anpassung erforderlich? Kann MySQL einer so großen Datenbelastung standhalten? Voranalyse: Schlüsselfilter und Eigenschaften müssen identifiziert werden. Nach der Analyse wurde festgestellt, dass nur wenige Attribute mit der Lösung zusammenhängen. Wir haben die Machbarkeit des Filters überprüft und einige Einschränkungen festgelegt, um die Suche zu optimieren. Kartensuche basierend auf der Stadt

Vue- und Element-UI-Kaskaden-Dropdown-Box V-Model-Bindung

Apr 07, 2025 pm 08:06 PM

Vue- und Element-UI-Kaskaden-Dropdown-Box V-Model-Bindung

Apr 07, 2025 pm 08:06 PM

Vue- und Element-UI-kaskadierte Dropdown-Boxen V-Model-Bindung gemeinsame Grubenpunkte: V-Model bindet ein Array, das die ausgewählten Werte auf jeder Ebene des kaskadierten Auswahlfelds darstellt, nicht auf einer Zeichenfolge; Der Anfangswert von ausgewählten Optionen muss ein leeres Array sein, nicht null oder undefiniert. Die dynamische Belastung von Daten erfordert die Verwendung asynchroner Programmierkenntnisse, um Datenaktualisierungen asynchron zu verarbeiten. Für riesige Datensätze sollten Leistungsoptimierungstechniken wie virtuelles Scrollen und fauler Laden in Betracht gezogen werden.

VUE.JS Wie kann man ein Array von String -Typ in ein Array von Objekten umwandeln?

Apr 07, 2025 pm 09:36 PM

VUE.JS Wie kann man ein Array von String -Typ in ein Array von Objekten umwandeln?

Apr 07, 2025 pm 09:36 PM

Zusammenfassung: Es gibt die folgenden Methoden zum Umwandeln von VUE.JS -String -Arrays in Objektarrays: Grundlegende Methode: Verwenden Sie die Kartenfunktion, um regelmäßige formatierte Daten zu entsprechen. Erweitertes Gameplay: Die Verwendung regulärer Ausdrücke kann komplexe Formate ausführen, müssen jedoch sorgfältig geschrieben und berücksichtigt werden. Leistungsoptimierung: In Betracht ziehen die große Datenmenge, asynchrone Operationen oder effiziente Datenverarbeitungsbibliotheken können verwendet werden. Best Practice: Clear Code -Stil, verwenden Sie sinnvolle variable Namen und Kommentare, um den Code präzise zu halten.

So stellen Sie die Zeitüberschreitung von Vue Axios fest

Apr 07, 2025 pm 10:03 PM

So stellen Sie die Zeitüberschreitung von Vue Axios fest

Apr 07, 2025 pm 10:03 PM

Um die Zeitüberschreitung für Vue Axios festzulegen, können wir eine Axios -Instanz erstellen und die Zeitleitungsoption angeben: in globalen Einstellungen: vue.Prototyp. $ Axios = axios.create ({Timeout: 5000}); In einer einzigen Anfrage: this. $ axios.get ('/api/user', {timeout: 10000}).

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineers (Plattformen) benötigen Kreise

Apr 08, 2025 pm 12:27 PM

Remote Senior Backend Engineer Job Vacant Company: Circle Standort: Remote-Büro-Jobtyp: Vollzeitgehalt: 130.000 bis 140.000 US-Dollar Stellenbeschreibung Nehmen Sie an der Forschung und Entwicklung von Mobilfunkanwendungen und öffentlichen API-bezogenen Funktionen, die den gesamten Lebenszyklus der Softwareentwicklung abdecken. Die Hauptaufgaben erledigen die Entwicklungsarbeit unabhängig von RubyonRails und arbeiten mit dem Front-End-Team von React/Redux/Relay zusammen. Erstellen Sie die Kernfunktionalität und -verbesserungen für Webanwendungen und arbeiten Sie eng mit Designer und Führung während des gesamten funktionalen Designprozesses zusammen. Fördern Sie positive Entwicklungsprozesse und priorisieren Sie die Iterationsgeschwindigkeit. Erfordert mehr als 6 Jahre komplexes Backend für Webanwendungen

So optimieren Sie die Datenbankleistung nach der MySQL -Installation

Apr 08, 2025 am 11:36 AM

So optimieren Sie die Datenbankleistung nach der MySQL -Installation

Apr 08, 2025 am 11:36 AM

Die MySQL -Leistungsoptimierung muss von drei Aspekten beginnen: Installationskonfiguration, Indexierung und Abfrageoptimierung, Überwachung und Abstimmung. 1. Nach der Installation müssen Sie die my.cnf -Datei entsprechend der Serverkonfiguration anpassen, z. 2. Erstellen Sie einen geeigneten Index, um übermäßige Indizes zu vermeiden und Abfrageanweisungen zu optimieren, z. B. den Befehl Erklärung zur Analyse des Ausführungsplans; 3. Verwenden Sie das eigene Überwachungstool von MySQL (ShowProcessList, Showstatus), um die Datenbankgesundheit zu überwachen und die Datenbank regelmäßig zu sichern und zu organisieren. Nur durch kontinuierliche Optimierung dieser Schritte kann die Leistung der MySQL -Datenbank verbessert werden.