Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Die „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!

Die „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!

Die „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!

Im Mai dieses Jahres kündigte MetaAI offiziell die Veröffentlichung des ultragroßen Modells OPT-175B an, das auf 175 Milliarden Parametern basiert und allen Communities kostenlos zur Verfügung steht.

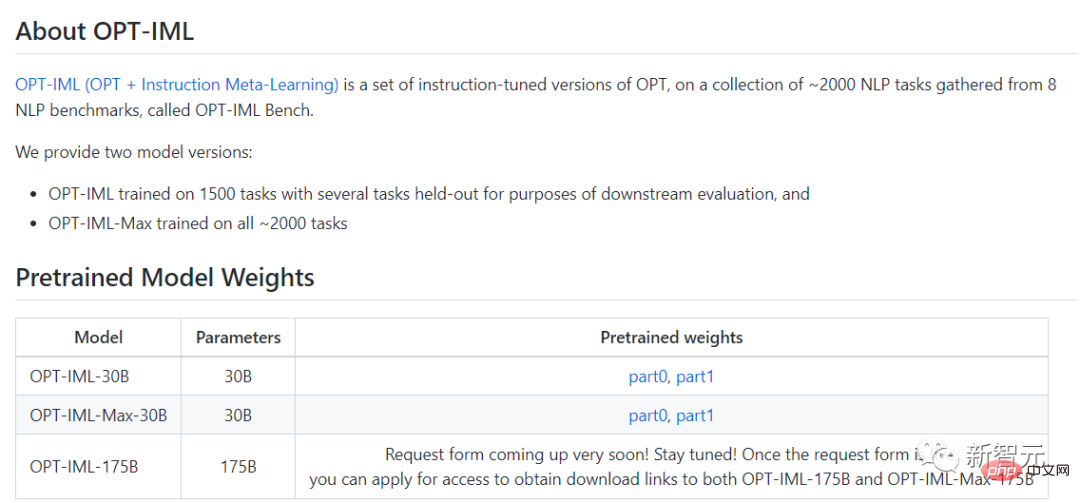

Am 22. Dezember wurde eine aktualisierte Version des Modells, OPT-IML (Open Pre-trained Transformer), offiziell eingeführt. Meta sagte, es sei „getestet worden“. 2.000 Sprachaufgaben mit 175 Milliarden Parametern werden auch für nichtkommerzielle Forschungszwecke frei verfügbar sein.

Werfen wir einen Blick auf die Leistung dieses aktualisierten OPT-IML.

Dieses Mal hat OPT-IML zwei Modellgrößen erstellt, 30B und 175B.

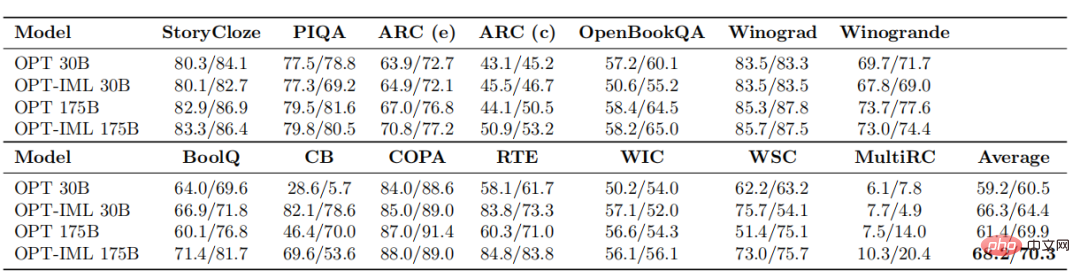

Im Vergleich zum alten OPT-Modell übertraf OPT-IML OPT im Durchschnitt bei 14 Standard-NLP-Bewertungsaufgaben.

Die beiden Modellgrößen sind bei der Null-Schuss-Lernaufgabe um 7 % besser und bei der 32-Schuss-Aufgabe um 4 % bzw. 0,4 % besser.

In dieser Studie beschreiben Forscher, wie sich eine zunehmende Modell- und Benchmarkgröße auf die Auswirkungen von Entscheidungen zur Befehlsoptimierung auf die Leistung nachgelagerter Aufgaben auswirkt.

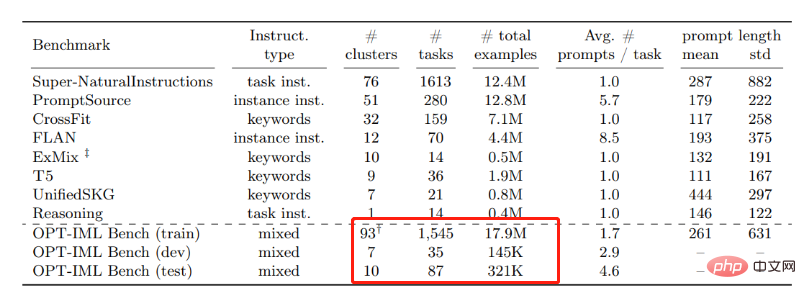

Zu diesem Zweck entwickelten sie OPT-IML Bench, einen ziemlich großen Instructional Meta-Learning (IML)-Benchmark mit 2000 NLP-Aufgaben, die auf aktuellen acht Benchmarks basieren in Aufgabenkategorien unterteilt.

Um OPT-IML 30B und 175B zu trainieren, wandten die Forscher zunächst OPT-IML aus der Perspektive des Frameworks an Es werden Einblicke in Entscheidungen zur Befehlsoptimierung für 30B bereitgestellt.

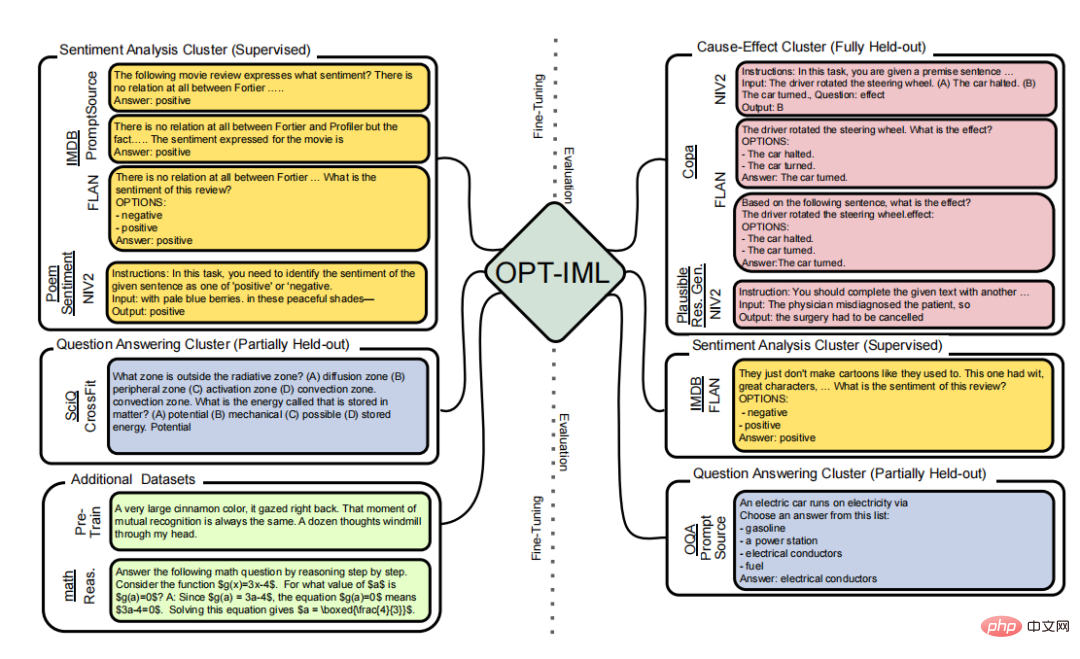

OPT-IML wird auf zwei Skalen anhand von vier Bewertungsbenchmarks (PromptSource, FLAN, Super-NaturalInstructions und UnifiedSKG) mit unterschiedlichen Zielen und Eingabeformaten für alle drei Generalisierungsfähigkeiten demonstriert.

Es übertrifft nicht nur OPT in allen Benchmarks deutlich, sondern übertrifft auch bestehende, für diesen spezifischen Benchmark optimierte Modelle auf sehr wettbewerbsfähige Weise.

Darüber hinaus ist OPT-IML Open Source und der Github-Link ist auch unten gepostet~

#🎜 🎜## 🎜🎜#

Github-Link: https://github.com/facebookresearch/metaseq/tree/main/projects/OPT-IML #🎜🎜 # Lassen Sie uns als Nächstes anhand des Artikels mehr über OPT-IML erfahren.

Forschungsmethode

Die instruktive Feinabstimmung großer Sprachmodelle ist geworden a Eine effektive Methode für die Fähigkeit zur Null-Schuss- und Wenig-Schuss-Generalisierung. In dieser Studie haben Meta-Forscher drei wichtige Ergänzungen zur Feinabstimmung des Unterrichts vorgenommen.

Zuerst stellten sie einen groß angelegten Benchmark zur Feinabstimmung von Anweisungen zusammen, der 2.000 NLP-Aufgaben aus einer Sammlung von acht Datensätzen enthielt, kategorisiert nach Aufgabentyp.

Forscher erstellten selektiv Bewertungssplits für diesen Benchmark, um drei verschiedene Arten von Modellverallgemeinerungsfähigkeiten zu testen:

Beinhaltet Aufgaben aus vollständig zurückgehaltenen Kategorien, zurückgehaltene Aufgaben aus gesehenen Typen und zurückgehaltene Instanzen aus gesehenen Aufgaben.

Feinabstimmung von Anweisungen

Die Feinabstimmung von Modellen, um sie mit Compliance-Anweisungen in Einklang zu bringen, ist eine der aktuellen Forschungsrichtungen im maschinellen Lernen.

Es gibt zwei Methoden zur Befehlsfeinabstimmung. Das eine konzentriert sich auf die Feinabstimmung von Modellen für eine Vielzahl von Aufgaben mithilfe von von Menschen kommentierten Anweisungen und Feedback. Das andere konzentriert sich auf das Hinzufügen von Anweisungen über Anmerkungen oder automatisch zu öffentlich zugänglichen Benchmarks und Datensätzen.

In dieser Studie konzentrierten sich Meta AI-Mitglieder auf die zweite Technik und stellten eine Reihe öffentlich zugänglicher Datensätze zusammen, die Methoden zur Verbesserung von OPT enthalten.

Während der Forschung schlugen Meta-Mitglieder eine ähnliche Skalierungsmethode unter Verwendung von 1836 Aufgaben aus vier Benchmarks vor. Während die Forscher schließlich den gesamten Test optimieren, um die Leistungsgrenzen anspruchsvoller externer Benchmarks wie MMLU und Big-Bench Hard (BBH) zu überschreiten, beschreiben sie die Gewichtungen verschiedener Strategien zur Befehlsoptimierung, die sich auf die nachgelagerte Leistung auswirken können.

Multi-Task-Lernen

Multi-Task-Lernen ist ein Ausdruck der anweisungsbasierten Feinabstimmung (MTL).

MTL ist ein beliebtes Paradigma, das die Generalisierungsleistung einer Aufgabe verbessern kann, wenn es mit ähnlichen Funktionen kombiniert wird, die vergleichbare Parameter oder Darstellungen teilen.

In den letzten Jahren wurde MTL auf zahlreiche NLP-Szenarien angewendet, wobei der Schwerpunkt hauptsächlich auf der Verbesserung der Leistung von Trainingsaufgaben oder neuen Domänen durch die Nutzung von Signalen relevanter Aktivitäten lag.

Im Gegensatz dazu hilft uns die anweisungsbasierte Feinabstimmung dabei, die Generalisierungsleistung bei noch nie dagewesenen Problemen zu verbessern. Dies geschieht durch die Anweisung, alle Aufgaben zu einem Konzept zusammenzufassen und sie gemeinsam zu trainieren, indem allen Aufgaben die Gewichtungen des Modells zugewiesen werden.

Was ist OPT?

Groß angelegte Sprachmodelle, Systeme zur Verarbeitung natürlicher Sprache mit über 100 Milliarden Parametern, haben die NLP- und KI-Forschung in den letzten Jahren verändert.

Diese Modelle wurden anhand einer Vielzahl unterschiedlicher Texte trainiert und haben überraschende neue Fähigkeiten unter Beweis gestellt, um kreative Texte zu generieren, grundlegende mathematische Probleme zu lösen, Fragen zum Leseverständnis zu beantworten und vieles mehr.

Während die Öffentlichkeit in einigen Fällen über kostenpflichtige APIs mit diesen Modellen interagieren kann, ist der vollständige Zugang zur Forschung immer noch auf eine Handvoll gut ausgestatteter Labore beschränkt.

Dieser eingeschränkte Zugriff schränkt die Fähigkeit der Forscher ein, zu verstehen, wie und warum diese großen Sprachmodelle funktionieren, und behindert den Fortschritt bei der Verbesserung ihrer Robustheit und der Abschwächung bekannter Probleme wie Voreingenommenheit.

Im Rahmen seines Engagements für offene Wissenschaft veröffentlichte Meta AI im Mai dieses Jahres Open Pretrained Transformer (OPT-175B), ein Modell mit 175 Milliarden Parametern, die auf öffentlichen Datensätzen trainiert wurden. Durch die Weitergabe dieses Modells hofft Meta AI, dies zu erreichen breitere Gemeinschaft beim Verständnis grundlegender Techniken rund um große Modelle.

Einfach ausgedrückt: Meta eröffnet der Öffentlichkeit den Zugang zu groß angelegten Sprachmodellen, die für die Forschung im Bereich der künstlichen Intelligenz verwendet werden, und demokratisiert so die künstliche Intelligenz für die Forschung im großen Maßstab.

Vergleich mit der alten Version

Laut der jetzt von Meta veröffentlichten IML-Version wurde sie verfeinert und schneidet bei Aufgaben in natürlicher Sprache besser ab als die alte Version von OPT.

Zu den typischen Sprachaufgaben gehören das Beantworten von Fragen, das Zusammenfassen von Texten und das Übersetzen.

Zur Feinabstimmung verwendeten die Forscher etwa 2.000 Aufgaben in natürlicher Sprache. Die Aufgaben sind in acht NLP-Benchmarks (OPT-IML Bench) unterteilt, die ebenfalls von den Forschern bereitgestellt werden.

Am Beispiel der 30B- und 175B-Modelle verbessert OPT-IML die Zero-Shot-Lerngenauigkeit im Vergleich zu OPT um etwa 6–7 %. In 32 Epochen zeigte das Modell mit 30 Milliarden Parametern eine deutliche Verbesserung der Genauigkeit und das Modell mit 175 Milliarden Parametern zeigte eine leichte Verbesserung.

Nach dem Vergleich stellte das Meta-Team fest, dass die Leistung von OPT-IML bei allen Benchmarks besser ist als die von OPT und in Bezug auf Zero-Shot und Fence-Shot wettbewerbsfähiger als andere auf Befehlsfeinabstimmung basierende Modelle ist Lerngenauigkeit.

Das obige ist der detaillierte Inhalt vonDie „aktualisierte Version' von OPT-IML, Metas großem Modell mit Hunderten Milliarden Parametern, ist da und das vollständige Modell und der Code werden veröffentlicht!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1375

1375

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Tutorial zur Lösung des Problems, dass nach dem Upgrade des Win10-Systems kein Zugriff auf das Internet möglich ist

Mar 27, 2024 pm 02:26 PM

Tutorial zur Lösung des Problems, dass nach dem Upgrade des Win10-Systems kein Zugriff auf das Internet möglich ist

Mar 27, 2024 pm 02:26 PM

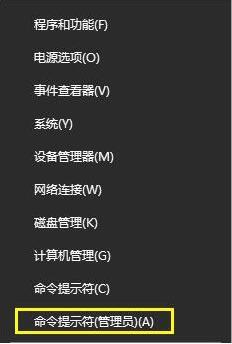

1. Öffnen Sie das Menü mit der Tastenkombination win+x und wählen Sie [Eingabeaufforderung (Administrator) (A)] aus, wie unten gezeigt: 2. Geben Sie nach dem Aufrufen der Eingabeaufforderungsschnittstelle den Befehl [ipconfig/flushdns] ein und drücken Sie die Eingabetaste , wie in der Abbildung unten gezeigt: 3. Geben Sie dann den Befehl [netshwinsockresetcatalog] ein und drücken Sie die Eingabetaste, wie in der Abbildung unten gezeigt: 4. Geben Sie schließlich den Befehl [netshintipreset] ein und drücken Sie die Eingabetaste. Starten Sie den Computer neu und Sie können auf das Internet zugreifen , wie in der folgenden Abbildung gezeigt:

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Xiaoyi wurde zu einem intelligenten Agenten! Die native Intelligenz von HarmonyOS NEXT Hongmeng eröffnet eine neue KI-Ära

Jun 22, 2024 am 01:56 AM

Xiaoyi wurde zu einem intelligenten Agenten! Die native Intelligenz von HarmonyOS NEXT Hongmeng eröffnet eine neue KI-Ära

Jun 22, 2024 am 01:56 AM

Am 21. Juni fand erneut die Huawei Developer Conference 2024 (HDC2024) in Songshan Lake, Dongguan, statt. Das Auffälligste an dieser Konferenz ist, dass HarmonyOSNEXT offiziell die Betaversion für Entwickler und Pionierbenutzer startet und die drei „königsbrechenden“ innovativen Funktionen von HarmonyOSNEXT in allen Szenarien, nativer Intelligenz und nativer Sicherheit umfassend demonstriert. Native Intelligenz von HarmonyOSNEXT: Beginn einer neuen KI-Ära Nach der Abkehr vom Android-Framework ist HarmonyOSNEXT zu einem wirklich unabhängigen Betriebssystem unabhängig von Android und iOS geworden, was als beispiellose Wiedergeburt bezeichnet werden kann. Unter den vielen neuen Funktionen ist native Intelligenz zweifellos die neue Funktion, die den Benutzern am besten intuitive Gefühle und Erfahrungsverbesserungen vermitteln kann.

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil