Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Ein europäisches Gesetz zur künstlichen Intelligenz steht kurz vor der Einführung, was Auswirkungen auf die globale Technologieregulierung haben könnte

Ein europäisches Gesetz zur künstlichen Intelligenz steht kurz vor der Einführung, was Auswirkungen auf die globale Technologieregulierung haben könnte

Ein europäisches Gesetz zur künstlichen Intelligenz steht kurz vor der Einführung, was Auswirkungen auf die globale Technologieregulierung haben könnte

Das Gesetz über künstliche Intelligenz zielt darauf ab, einen gemeinsamen regulatorischen und rechtlichen Rahmen für den Einsatz künstlicher Intelligenz zu schaffen, einschließlich der Art und Weise, wie sie entwickelt wird, wofür Unternehmen sie nutzen können und welche rechtlichen Konsequenzen sich aus der Nichteinhaltung der Anforderungen ergeben. Der Gesetzentwurf könnte Unternehmen dazu verpflichten, unter bestimmten Umständen eine Genehmigung einzuholen, bevor sie künstliche Intelligenz einführen, bestimmte als zu riskant erachtete Nutzungen künstlicher Intelligenz verbieten und eine öffentliche Liste anderer risikoreicher Nutzungen künstlicher Intelligenz erstellen.

In einem offiziellen Bericht über das Gesetz erklärte die Europäische Kommission, dass das Gesetz auf breiter Ebene darauf abzielt, das vertrauenswürdige Paradigma der künstlichen Intelligenz in der EU zu kodifizieren. Dieses Paradigma „erfordert, dass KI rechtlich, ethisch und technologisch stark ist und gleichzeitig demokratische Werte, Menschenrechte und Rechtsstaatlichkeit respektiert“.

Der vorgeschlagene Regulierungsrahmen für künstliche Intelligenz hat folgende Ziele:

1 Gewährleistung, dass auf dem EU-Markt eingesetzte und genutzte Systeme der künstlichen Intelligenz sicher sind und bestehende gesetzliche Grundrechte und EU-Werte respektieren;

2 Förderung von Investitionen und Innovationen im Bereich künstlicher Intelligenz;

3. Stärkung der Governance und wirksamen Durchsetzung bestehender Gesetze zu Grundrechten und Sicherheit für KI-Systeme; 4. Förderung der Vereinheitlichung der Marktentwicklung für künstliche Intelligenz; Marktdifferenzierung verhindern.

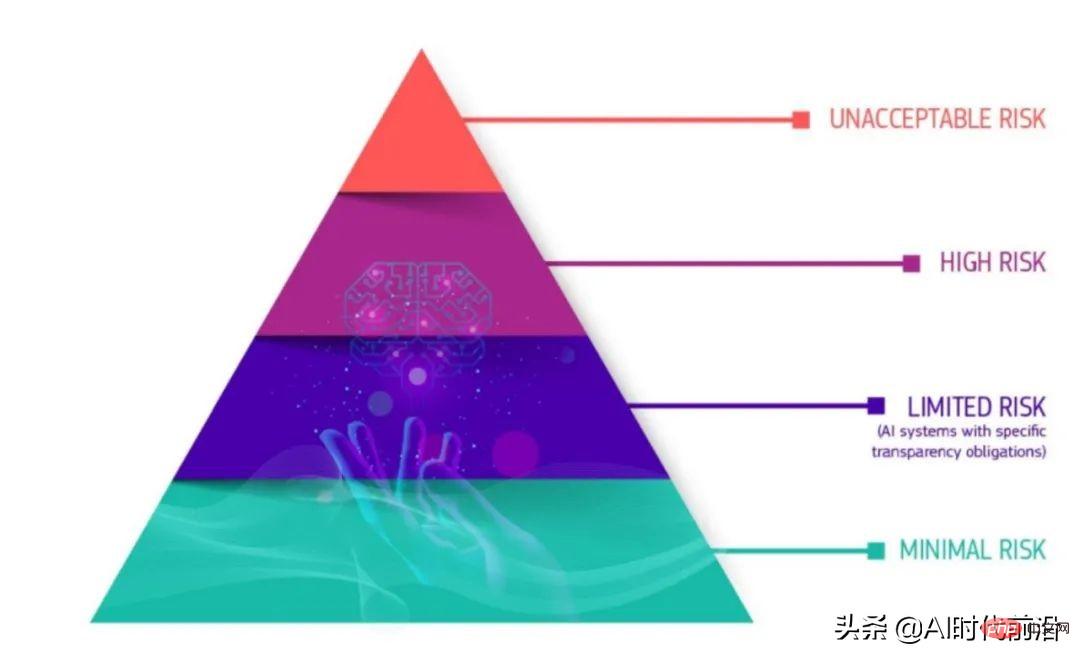

Während viele Details des neuen Gesetzes noch in der Schwebe sind, vor allem die Definition von KI, scheint der Kernfaktor das „Produktsicherheits-Framework“ zu sein, das zukünftige KI-Produkte in vier Sicherheitsstufenkategorien einteilt, die für alle Branchen gelten.

Laut dem von Maruritz Kop vom Stanford-Vienna Transatlantic Technology Law Forum zusammengestellten Bericht der Europäischen Kommission über das neue Gesetz aus dem Jahr 2021 ist das untere Ende der „Kritikalitätspyramide“ das System mit dem geringsten Risiko. KI-Anwendungen, die in diese Kategorie fallen, müssen nicht den Transparenzanforderungen entsprechen, die riskantere Systeme erfüllen müssen. In der Kategorie „begrenztes Risiko“ gibt es einige Transparenzanforderungen für KI-Systeme, wie zum Beispiel Chatbots.

——Der neue KI-Gesetzentwurf der EU unterteilt KI-Programme von unten nach oben in vier Kategorien: geringes Risiko, begrenztes Risiko, hohes Risiko und inakzeptables Risiko.

——Der neue KI-Gesetzentwurf der EU unterteilt KI-Programme von unten nach oben in vier Kategorien: geringes Risiko, begrenztes Risiko, hohes Risiko und inakzeptables Risiko.

In KI-Kategorien mit hohem Risiko und strengen Transparenzanforderungen wird die Aufsicht strenger sein. Zu den Hochrisikokategorien gehören laut Einleitung KI-Anwendungen in:

kritischer Infrastruktur, wie etwa im Transportwesen, die das Leben oder die Gesundheit von Menschen gefährden kann (wie etwa selbstfahrende Autos);- Bildung oder Berufsausbildung, die sich auf die persönliche Bildung auswirkt oder berufliche Leistungen (z. B. Prüfungsergebnisse);

- Sicherheitskomponenten von Produkten (z. B. robotergestützte Chirurgie);

- Beschäftigung, Mitarbeiterverwaltung, Selbstständigkeit (z. B. Lebensläufe, Klassifizierungssoftware für Lebensläufe); (z. B. Kredit-Scores);

- Strafverfolgungsanwendungsfälle (z. B. Beweiswürdigung);

- Einwanderung, Grenzverwaltung (einschließlich Prüfung der Echtheit von Reisepässen);

- Überwachungssysteme (z. B. biometrische Überwachung und Gesichtserkennung).

- Die vierte Kategorie an der Spitze sind Systeme der künstlichen Intelligenz mit „inakzeptablem Risiko“. Diese Apps sind grundsätzlich illegal, weil sie zu viele Risiken bergen. Beispiele für solche Anwendungen sind Systeme zur Verhaltensmanipulation von Personen oder „besonders gefährdeten Gruppen“, Social Scoring sowie biometrische Systeme in Echtzeit und aus der Ferne.

- Höhere Risikokategorien dürften im Mittelpunkt der Bemühungen vieler Unternehmen stehen, Transparenz und Compliance sicherzustellen. Der EU-Gesetzentwurf zur künstlichen Intelligenz wird Unternehmen dazu raten, vier Schritte zu unternehmen, bevor sie Produkte oder Dienste der künstlichen Intelligenz auf den Markt bringen, die in Hochrisikokategorien fallen.

- Eine Konformitätserklärung muss unterzeichnet werden und Hochrisiko-KI-Systeme müssen das CE-Zeichen tragen.

Das obige ist der detaillierte Inhalt vonEin europäisches Gesetz zur künstlichen Intelligenz steht kurz vor der Einführung, was Auswirkungen auf die globale Technologieregulierung haben könnte. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1371

1371

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

SOTA Performance, eine multimodale KI-Methode zur Vorhersage der Protein-Ligand-Affinität in Xiamen, kombiniert erstmals molekulare Oberflächeninformationen

Jul 17, 2024 pm 06:37 PM

Herausgeber |. KX Im Bereich der Arzneimittelforschung und -entwicklung ist die genaue und effektive Vorhersage der Bindungsaffinität von Proteinen und Liganden für das Arzneimittelscreening und die Arzneimitteloptimierung von entscheidender Bedeutung. Aktuelle Studien berücksichtigen jedoch nicht die wichtige Rolle molekularer Oberflächeninformationen bei Protein-Ligand-Wechselwirkungen. Auf dieser Grundlage schlugen Forscher der Universität Xiamen ein neuartiges Framework zur multimodalen Merkmalsextraktion (MFE) vor, das erstmals Informationen über Proteinoberfläche, 3D-Struktur und -Sequenz kombiniert und einen Kreuzaufmerksamkeitsmechanismus verwendet, um verschiedene Modalitäten zu vergleichen Ausrichtung. Experimentelle Ergebnisse zeigen, dass diese Methode bei der Vorhersage von Protein-Ligand-Bindungsaffinitäten Spitzenleistungen erbringt. Darüber hinaus belegen Ablationsstudien die Wirksamkeit und Notwendigkeit der Proteinoberflächeninformation und der multimodalen Merkmalsausrichtung innerhalb dieses Rahmens. Verwandte Forschungen beginnen mit „S

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

GlobalFoundries erschließt Märkte wie KI und erwirbt die Galliumnitrid-Technologie von Tagore Technology und zugehörige Teams

Jul 15, 2024 pm 12:21 PM

Laut Nachrichten dieser Website vom 5. Juli veröffentlichte GlobalFoundries am 1. Juli dieses Jahres eine Pressemitteilung, in der die Übernahme der Power-Galliumnitrid (GaN)-Technologie und des Portfolios an geistigem Eigentum von Tagore Technology angekündigt wurde, in der Hoffnung, seinen Marktanteil in den Bereichen Automobile und Internet auszubauen Anwendungsbereiche für Rechenzentren mit künstlicher Intelligenz, um höhere Effizienz und bessere Leistung zu erforschen. Da sich Technologien wie generative künstliche Intelligenz (GenerativeAI) in der digitalen Welt weiterentwickeln, ist Galliumnitrid (GaN) zu einer Schlüssellösung für nachhaltiges und effizientes Energiemanagement, insbesondere in Rechenzentren, geworden. Auf dieser Website wurde die offizielle Ankündigung zitiert, dass sich das Ingenieurteam von Tagore Technology im Rahmen dieser Übernahme mit GF zusammenschließen wird, um die Galliumnitrid-Technologie weiterzuentwickeln. G