Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Unter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!

Unter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!

Unter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!

Die boomende Entwicklung großformatiger visueller Transformer in den letzten Jahren hat die Leistungsgrenzen im Bereich Computer Vision verschoben. Vision Transformer-Modelle besiegen Faltungs-Neuronale Netze, indem sie die Anzahl der Modellparameter und Trainingsdaten erweitern. Forscher des Shanghai Artificial Intelligence Laboratory, der Tsinghua University, Nanda, SenseTime und Hong Kong Chinese haben die Lücken zwischen Faltungs-Neuronalen Netzen und visuellen Transformatoren zusammengefasst. Auf Betreiberebene mangelt es herkömmlichen CNNs-Betreibern an Fernabhängigkeiten und adaptiven räumlichen Aggregationsfähigkeiten; auf struktureller Ebene mangelt es traditionellen CNNs-Strukturen an fortschrittlichen Komponenten.

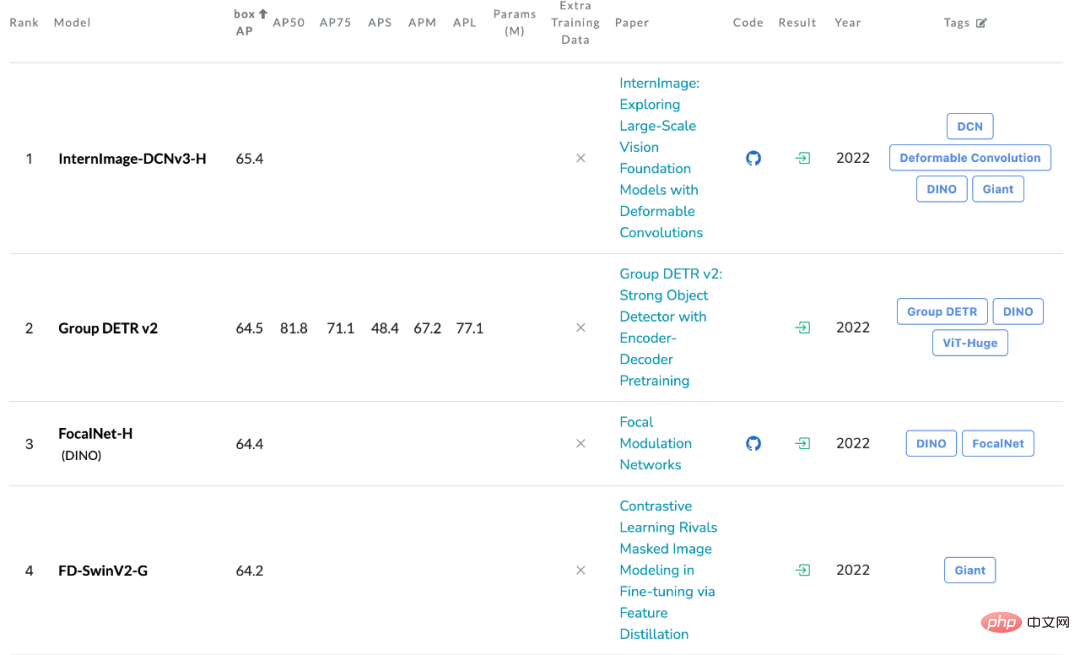

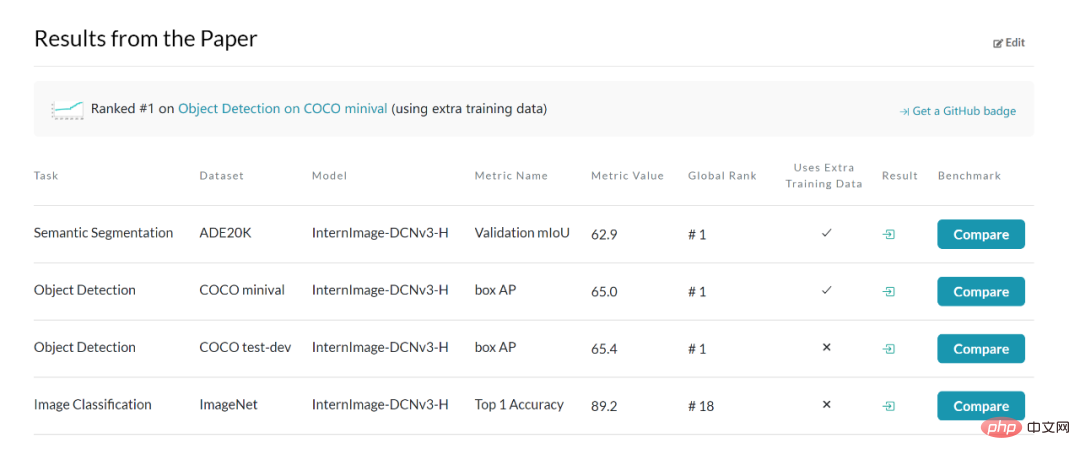

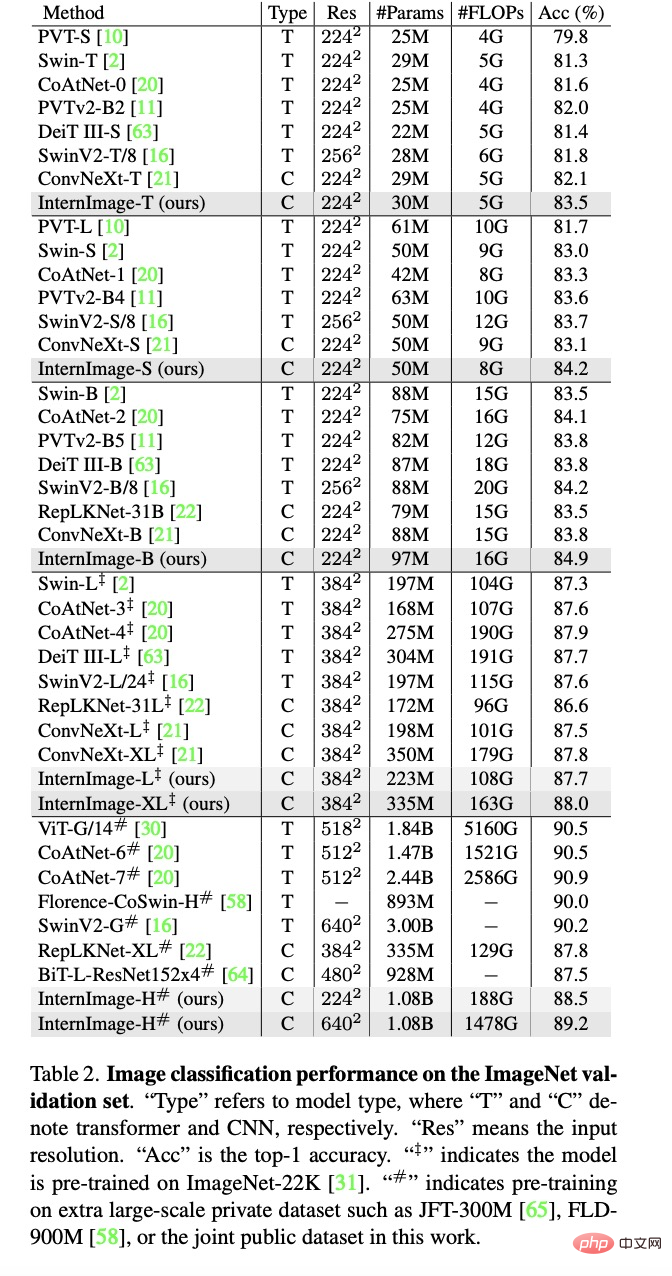

Angesichts der oben genannten technischen Probleme Forscher des Pujiang Laboratory, der Tsinghua-Universität und anderer Institutionen haben auf innovative Weise ein groß angelegtes Modell namens InternImage vorgeschlagen, das auf Faltungs-Neuronalen Netzen basiert und eine spärliche dynamische Faltung als Kernberechnungsuntereinheit verwendet , Erzielen einer adaptiven räumlichen Aggregation durch Eingabe relevanter Informationen als Bedingung. InternImage ermöglicht das Erlernen leistungsfähigerer und robusterer großräumiger Parametermuster aus umfangreichen Daten, indem es den strengen induktiven Bias herkömmlicher CNNs reduziert. Seine Wirksamkeit wurde bei visuellen Aufgaben wie Bildklassifizierung, Objekterkennung und semantischer Segmentierung überprüft. Es hat in anspruchsvollen Benchmark-Datensätzen wie ImageNet, COCO und ADE20K wettbewerbsfähige Ergebnisse erzielt. Auf der gleichen Parameterebene hat es die visuelle Transformer-Struktur übertroffen und eine neue Richtung für große Bildmodelle vorgegeben. ??

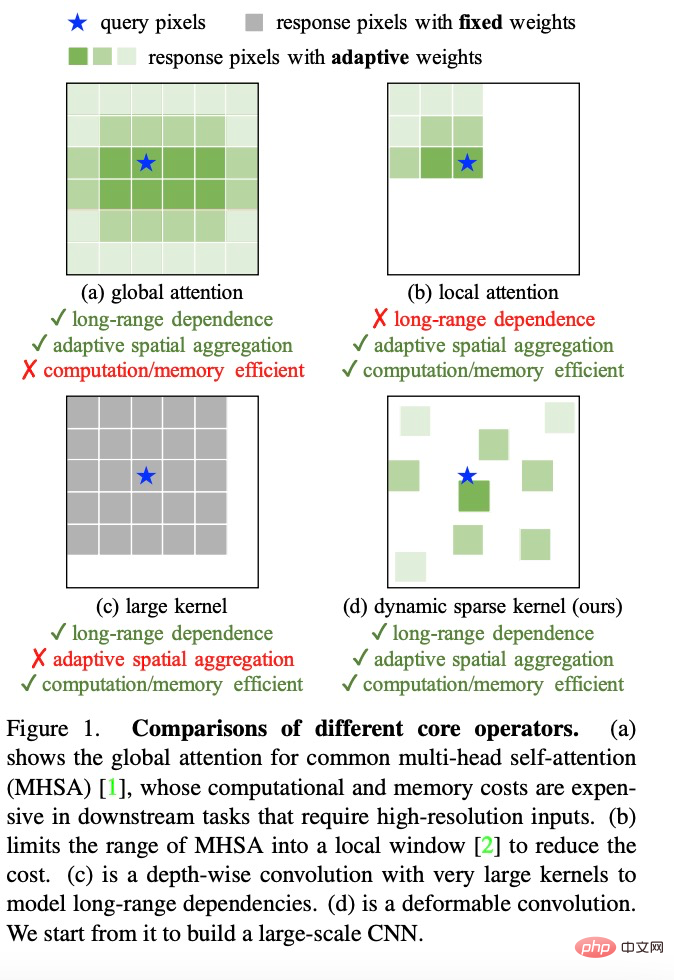

- Einschränkungen herkömmlicher Faltungs-Neuronaler NetzeDie Erweiterung des Modellmaßstabs ist eine wichtige Strategie zur Verbesserung der Qualität der Merkmalsdarstellung. Die Erweiterung der Anzahl der Modellparameter kann nicht nur effektiv verbessert werden die Repräsentationslernfähigkeit tiefer Modelle, sondern auch das Lernen und den Wissenserwerb aus massiven Daten. ViT und Swin Transformer haben das Tiefenmodell zum ersten Mal auf 2 Milliarden und 3 Milliarden Parameterebenen erweitert. Die Klassifizierungsgenauigkeit ihrer einzelnen Modelle im ImageNet-Datensatz überstieg ebenfalls 90 % und übertraf damit das traditionelle CNN-Netzwerk und kleine Modelle bei weitem. Durchbrechen des technischen Engpasses. Aufgrund des Mangels an Funktionen zur Modellierung von Fernabhängigkeiten und räumlichen Beziehungen können herkömmliche CNN-Modelle jedoch keine Erweiterungsmöglichkeiten im Modellmaßstab erreichen, die denen der Transformer-Struktur ähneln. Die Forscher fassten die Unterschiede zwischen dem traditionellen Faltungs-Neuronalen Netzwerk und dem visuellen Transformator zusammen:

- (1) Auf der Bedienerebene verfügt der Mehrkopf-Aufmerksamkeitsmechanismus des visuellen Transformators über Fernabhängigkeiten und adaptive räumliche Aggregationsfähigkeiten, was davon profitiert Von hier aus kann der visuelle Transformer aus massiven Daten leistungsfähigere und robustere Darstellungen lernen als das CNN-Netzwerk. (2) Aus Sicht der Modellarchitektur verfügt der visuelle Transformer zusätzlich zum Multi-Head-Aufmerksamkeitsmechanismus über fortgeschrittenere Module, die das CNN-Netzwerk nicht hat, wie z. B. Layer Normalization (LN), Feedforward-Neuronales Netzwerk FFN, GELU usw.

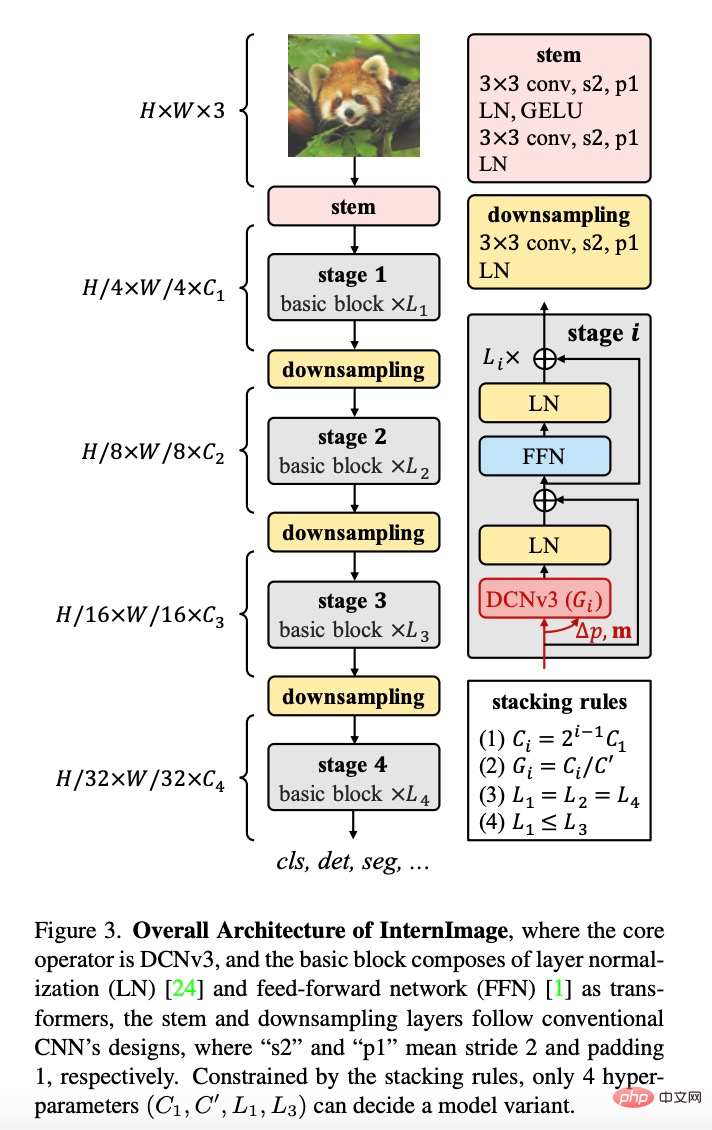

InternImage verbessert die Skalierbarkeit von Faltungsmodellen und lindert induktive Verzerrungen durch Neugestaltung von Operatoren und Modellstrukturen, einschließlich (1) DCNv3-Operator, basierend auf DCNv2-Operator Sub-führt gemeinsame Projektionsgewichte ein, Multi- Gruppenmechanismen und Sample-Point-Modulation. (2) Basismodul, das erweiterte Module als Basismoduleinheit für die Modellkonstruktion integriert. (3) Modulstapelregeln, die die Breite, Tiefe, Anzahl der Gruppen und andere Hyperparameter des Modells beim Erweitern des Modells standardisieren.

Diese Arbeit konzentriert sich auf den Aufbau eines CNN-Modells, das effizient auf große Parameter skaliert werden kann. Zunächst wird der verformbare Faltungsoperator DCNv2 neu gestaltet, um ihn an Abhängigkeiten über große Entfernungen anzupassen und die induktive Vorspannung abzuschwächen. Anschließend wird der angepasste Faltungsoperator mit erweiterten Komponenten kombiniert, um schließlich die Stapel- und Skalierungsregeln von Modulen zu erforschen und umzusetzen Der Aufbau eines Basismodells mit umfangreichen Parametern und leistungsstarken Darstellungen kann aus umfangreichen Daten gelernt werden.

Auf Operatorebene fasst diese Studie zunächst die Hauptunterschiede zwischen dem Faltungsoperator und anderen Mainstream-Operatoren zusammen. Die aktuellen Mainstream-Modelle der Transformer-Serie basieren hauptsächlich auf dem Multi-Head-Selbstaufmerksamkeitsmechanismus, um eine große Modellkonstruktion zu erreichen. Seine Operatoren verfügen über Fernabhängigkeiten, die ausreichen, um Verbindungsbeziehungen zwischen Fernmerkmalen aufzubauen, und verfügen auch über eine räumliche adaptive Aggregation Möglichkeiten, eine Beziehung auf Pixelebene zu erreichen. Dieser globale Aufmerksamkeitsmechanismus erfordert jedoch enorme Rechen- und Speicheranforderungen, was es schwierig macht, effizientes Training und schnelle Konvergenz zu erreichen. Ebenso fehlt den lokalen Aufmerksamkeitsmechanismen die Abhängigkeit von Merkmalen über große Entfernungen. Die dichte Faltung mit großem Kern verfügt nicht über die Fähigkeit zur räumlichen Aggregation, daher ist es schwierig, die natürliche induktive Tendenz der Faltung zu überwinden, was der Erweiterung des Modells nicht förderlich ist. Daher entwirft InternImage dynamische Faltungsoperatoren mit geringer Dichte, um globale Aufmerksamkeitseffekte zu erzielen, ohne zu viel Rechen- und Speicherressourcen zu verschwenden und so ein effizientes Training zu erreichen.

Basierend auf dem DCNv2-Operator hat der Forscher den DCNv3-Operator neu entworfen, angepasst und vorgeschlagen. Zu den spezifischen Verbesserungen gehören die folgenden Teile.

(1) Gemeinsames Projektionsgewicht. Ähnlich wie bei der herkömmlichen Faltung haben verschiedene Abtastpunkte in DCNv2 unabhängige Projektionsgewichte, sodass die Parametergröße linear mit der Gesamtzahl der Abtastpunkte zusammenhängt. Um die Parameter- und Speicherkomplexität zu reduzieren, greifen wir auf die Idee der trennbaren Faltung zurück und verwenden ortsunabhängige Gewichte, um die Gruppierungsgewichte zu ersetzen. Die Projektionsgewichte werden zwischen verschiedenen Abtastpunkten geteilt und alle Abhängigkeiten der Abtastposition bleiben erhalten.

(2) Führen Sie mehrere Gruppen von Mechanismen ein. Das Mehrgruppendesign wurde erstmals in der gruppierten Faltung eingeführt und wird häufig in der Multi-Head-Selbstaufmerksamkeit verwendet. Es kann mit adaptiver räumlicher Aggregation kombiniert werden, um die Funktionsvielfalt effektiv zu verbessern. Davon inspiriert teilten die Forscher den räumlichen Aggregationsprozess in mehrere Gruppen ein, und jede Gruppe verfügt über einen unabhängigen Stichprobenversatz. Seitdem weisen verschiedene Gruppen einer einzelnen DCNv3-Schicht unterschiedliche räumliche Aggregationsmuster auf, was zu einer reichen Funktionsvielfalt führt.

(3) Skalare Normalisierung der Abtastpunktmodulation. Um das Instabilitätsproblem bei der Erweiterung der Modellkapazität zu lindern, stellten die Forscher den Normalisierungsmodus für jede Probe auf Softmax-Normalisierung ein. Dadurch wird nicht nur der Trainingsprozess großer Modelle, sondern auch der Konstrukte stabiler ein Modell aller Stichprobenverbindungsbeziehungen.

Nach dem Erstellen des DCNv3-Operators besteht der nächste Schritt darin, die Gesamtdetails des Basismoduls und anderer Schichten zu standardisieren Anschließend wird InternImage erstellt, indem die Stapelstrategie dieser Grundmodule untersucht wird. Schließlich werden Modelle mit unterschiedlichen Parametermengen gemäß den Erweiterungsregeln des vorgeschlagenen Modells konstruiert.

Basismodul. Anders als die im herkömmlichen CNN weit verbreitete Engpassstruktur verwendet diese Studie ein Basismodul, das näher an ViTs liegt und mit fortschrittlicheren Komponenten ausgestattet ist, darunter GELU, Layer Normalization (LN) und Feed-Forward-Netzwerk (FFN), die sich bewährt haben effizienter bei einer Vielzahl von Sehaufgaben. Die Details des Basismoduls sind in der Abbildung oben dargestellt, wobei der Kernoperator DCNv3 ist, der den Sampling-Bias und die Modulationsskala vorhersagt, indem er die Eingabemerkmale durch eine leichte trennbare Faltung leitet. Befolgen Sie für andere Komponenten das gleiche Design wie bei einem normalen Transformator.

Stapelregeln. Um den Blockstapelprozess zu verdeutlichen, schlägt diese Studie zwei Modulstapelregeln vor. Die erste Regel ist die Anzahl der Kanäle in den letzten drei Stufen  , die durch die Anzahl der Kanäle in der ersten Stufe

, die durch die Anzahl der Kanäle in der ersten Stufe  bestimmt wird. Das heißt,

bestimmt wird. Das heißt,  Die zweite Regel ist, dass die Gruppennummer jedes Moduls der Anzahl der Kanäle in jeder Stufe entspricht, das heißt,

Die zweite Regel ist, dass die Gruppennummer jedes Moduls der Anzahl der Kanäle in jeder Stufe entspricht, das heißt,  Drittens ist der Stapelmodus auf „AABA“ festgelegt, d. Die Anzahl der Modulstapel in den Stufen 1, 2 und 4 ist gleich

Drittens ist der Stapelmodus auf „AABA“ festgelegt, d. Die Anzahl der Modulstapel in den Stufen 1, 2 und 4 ist gleich und nicht größer als in Stufe 3

und nicht größer als in Stufe 3  . Als Basis wird daher ein Modell mit einem Parametervolumen von 30M gewählt. Die spezifischen Parameter sind: Die Anzahl der Steam-Ausgangskanäle

. Als Basis wird daher ein Modell mit einem Parametervolumen von 30M gewählt. Die spezifischen Parameter sind: Die Anzahl der Steam-Ausgangskanäle beträgt 64; die Anzahl der Gruppen beträgt 1/16 der Anzahl der Eingangskanäle in jeder Stufe , Stufen 1, 2 und 4. Die Anzahl der Modulstapel

beträgt 64; die Anzahl der Gruppen beträgt 1/16 der Anzahl der Eingangskanäle in jeder Stufe , Stufen 1, 2 und 4. Die Anzahl der Modulstapel  beträgt 4, die Anzahl der Modulstapel

beträgt 4, die Anzahl der Modulstapel  in Stufe 3 beträgt 18 und die Modellparameter betragen 30 Millionen.

in Stufe 3 beträgt 18 und die Modellparameter betragen 30 Millionen.

Modellskalierungsregeln. Basierend auf dem optimalen Modell unter den oben genannten Einschränkungen normalisierte diese Studie zwei Skalierungsdimensionen des Netzwerkmodells: nämlich Tiefe D (Anzahl der Modulstapel) und Breite C (Anzahl der Kanäle) unter Verwendung der Einschränkungsfaktoren  und

und  entlang Der zusammengesetzte Koeffizient

entlang Der zusammengesetzte Koeffizient  skaliert die Tiefe und Breite, also

skaliert die Tiefe und Breite, also  , wobei

, wobei  Experimenten zufolge seine optimale Einstellung

Experimenten zufolge seine optimale Einstellung  ist.

ist.

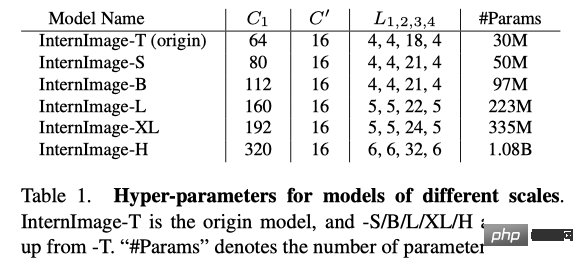

Dieser Regel folgend konstruierte diese Studie Modelle verschiedener Maßstäbe, nämlich InternImage-T, S, B, L, XL. Die spezifischen Parameter sind:

Objekterkennung

: Verwenden Sie das größte InternImage-H als Backbone-Netzwerk und verwenden Sie DINO als grundlegendes Erkennungsframework, trainieren Sie den DINO-Detektor vorab auf dem Objects365-Datensatz und führen Sie ihn dann aus es auf COCO Nehmen Sie Feineinstellungen vor. Das Modell erzielte bei der Zielerkennungsaufgabe ein optimales Ergebnis von 65,4 % und durchbrach damit die Leistungsgrenze der COCO-Zielerkennung. Semantische Segmentierung

FazitDiese Studie schlägt InternImage vor, ein neues groß angelegtes CNN-basiertes Basismodell, das leistungsstarke Darstellungen für vielseitige Sehaufgaben wie Bildklassifizierung, Objekterkennung und semantische Segmentierung bereitstellen kann. Die Forscher passten den flexiblen DCNv2-Operator an die Anforderungen des Basismodells an und entwickelten eine Reihe von Blockierungs-, Stapel- und Skalierungsregeln basierend auf dem Kernoperator. Umfangreiche Experimente zu Objekterkennungs- und semantischen Segmentierungs-Benchmarks haben bestätigt, dass InternImage eine gleichwertige oder bessere Leistung erzielen kann als gut gestaltete, groß angelegte visuelle Transformer, die auf großen Datenmengen trainiert wurden, was darauf hindeutet, dass CNN auch einen erheblichen Schritt im groß angelegten visuellen Basismodell darstellt Forschung wählen. Dennoch befinden sich groß angelegte CNNs noch in einem frühen Entwicklungsstadium, und die Forscher hoffen, dass InternImage als guter Ausgangspunkt dienen kann.

Das obige ist der detaillierte Inhalt vonUnter Verwendung von CNN als Basismodell erreicht die verformbare Faltung InternImage einen neuen Rekord bei der Erkennung und Segmentierung!. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

DualBEV: BEVFormer und BEVDet4D deutlich übertreffen, öffnen Sie das Buch!

Mar 21, 2024 pm 05:21 PM

In diesem Artikel wird das Problem der genauen Erkennung von Objekten aus verschiedenen Blickwinkeln (z. B. Perspektive und Vogelperspektive) beim autonomen Fahren untersucht, insbesondere wie die Transformation von Merkmalen aus der Perspektive (PV) in den Raum aus der Vogelperspektive (BEV) effektiv ist implementiert über das Modul Visual Transformation (VT). Bestehende Methoden lassen sich grob in zwei Strategien unterteilen: 2D-zu-3D- und 3D-zu-2D-Konvertierung. 2D-zu-3D-Methoden verbessern dichte 2D-Merkmale durch die Vorhersage von Tiefenwahrscheinlichkeiten, aber die inhärente Unsicherheit von Tiefenvorhersagen, insbesondere in entfernten Regionen, kann zu Ungenauigkeiten führen. Während 3D-zu-2D-Methoden normalerweise 3D-Abfragen verwenden, um 2D-Features abzutasten und die Aufmerksamkeitsgewichte der Korrespondenz zwischen 3D- und 2D-Features über einen Transformer zu lernen, erhöht sich die Rechen- und Bereitstellungszeit.