Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

ML-Forschung verlässt den Kreis im Jahr 2022: die beliebte Stable Diffusion, der Generalistenagent Gato, LeCun retweetet

ML-Forschung verlässt den Kreis im Jahr 2022: die beliebte Stable Diffusion, der Generalistenagent Gato, LeCun retweetet

ML-Forschung verlässt den Kreis im Jahr 2022: die beliebte Stable Diffusion, der Generalistenagent Gato, LeCun retweetet

2022 neigt sich dem Ende zu. In diesem Jahr entstand eine große Anzahl wertvoller Veröffentlichungen im Bereich des maschinellen Lernens, die einen tiefgreifenden Einfluss auf die Community des maschinellen Lernens hatten.

Heute hat Elvis S., ML- und NLP-Forscher, Produktmarketingmanager für Meta-KI-Technologie und Gründer von DAIR.AI, 12 aktuelle Veröffentlichungen zum Thema maschinelles Lernen im Jahr 2022 zusammengefasst. Der Beitrag ging viral und wurde vom Turing-Award-Gewinner Yann LeCun retweetet.

Als nächstes werfen wir einen Blick nacheinander.

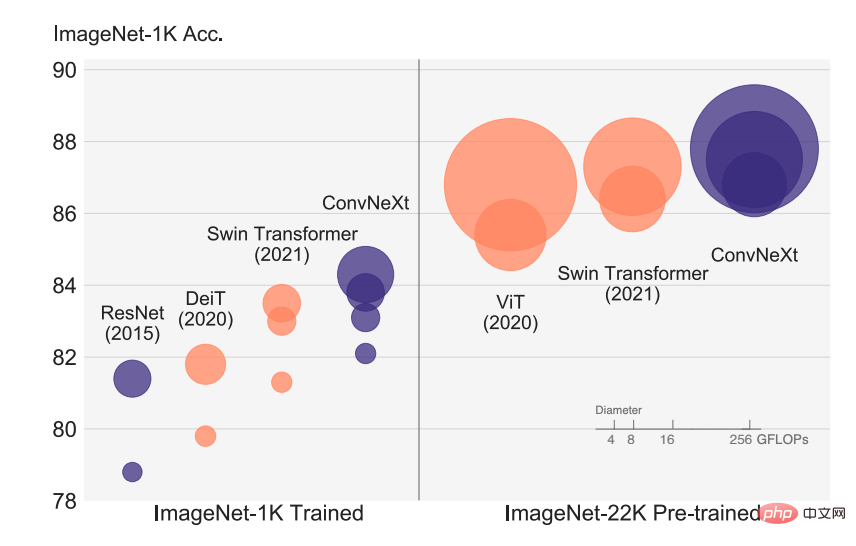

Papier 1: Ein ConvNet für die 2020er Jahre

Die rasante Entwicklung der visuellen Erkennung begann mit der Einführung von ViT, das das traditionelle ConvNet schnell ersetzte und zum SOTA-Bildklassifizierungsmodell wurde. Das ViT-Modell weist bei einer Reihe von Computer-Vision-Aufgaben viele Herausforderungen auf, darunter Zielerkennung, semantische Segmentierung usw. Daher schlugen einige Forscher den hierarchischen Swin Transformer vor und führten zuvor ConvNet wieder ein, wodurch Transformer tatsächlich als universelles visuelles Rückgrat einsetzbar war und bei verschiedenen visuellen Aufgaben eine hervorragende Leistung zeigte.

Die Wirksamkeit dieses Hybridansatzes beruht jedoch immer noch weitgehend auf den inhärenten Vorteilen von Transformer und nicht auf der induktiven Vorspannung, die der Faltung innewohnt. In diesem Artikel untersuchten Forscher von FAIR und UC Berkeley den Designraum erneut und testeten die Grenzen dessen, was reine ConvNets erreichen können. Die Forscher „aktualisierten“ das Standard-ResNet nach und nach zu einem visuellen Transformer-Design und entdeckten dabei mehrere Schlüsselkomponenten, die den Leistungsunterschied verursachten.

Papieradresse: https://arxiv.org/abs/2201.03545v2

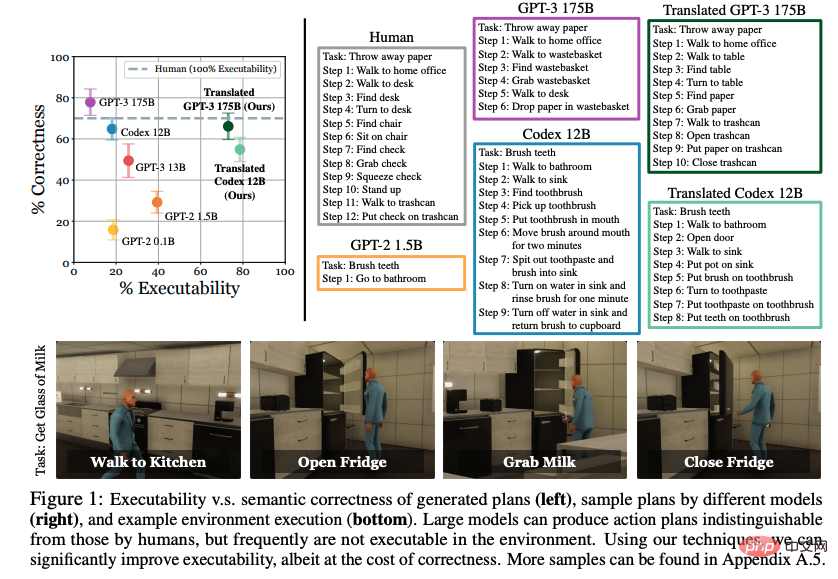

Papier 2: Sprachmodelle als Zero-Shot-Planer: Extraktion umsetzbaren Wissens für verkörperte Agenten

Kann das durch große Sprachmodelle (LLM) erlernte Weltwissen für Aktionen in interaktiven Umgebungen genutzt werden? In diesem Artikel untersuchen Forscher der UC Berkeley, der CMU und Google die Möglichkeit, natürliche Sprache als eine Reihe ausgewählter umsetzbarer Schritte auszudrücken. Frühere Arbeiten konzentrierten sich darauf, anhand explizit verteilter Beispiele zu lernen, wie man handelt. Überraschenderweise stellten sie jedoch fest, dass Aufgaben auf hoher Ebene ohne weiteres Training effektiv in die Planung auf mittlerer Ebene zerlegt werden können, wenn das vorab trainierte Sprachmodell groß genug ist und entsprechende Hinweise enthält. Allerdings lassen sich die von LLM entwickelten Pläne oft nicht genau auf akzeptable Maßnahmen abbilden.

Die von den Forschern vorgeschlagenen Schritte basieren auf vorhandenen Demonstrationen und wandeln Pläne semantisch in akzeptable Maßnahmen um. Auswertungen in einer VirtualHome-Umgebung zeigen, dass ihr vorgeschlagener Ansatz die Ausführbarkeit von LLM-Baselines deutlich verbessert. Die menschliche Bewertung offenbart einen Kompromiss zwischen Durchsetzbarkeit und Korrektheit, zeigt jedoch Anzeichen für die Möglichkeit, umsetzbares Wissen aus Sprachmodellen zu extrahieren.

Papieradresse: https://arxiv.org/abs/2201.07207v2

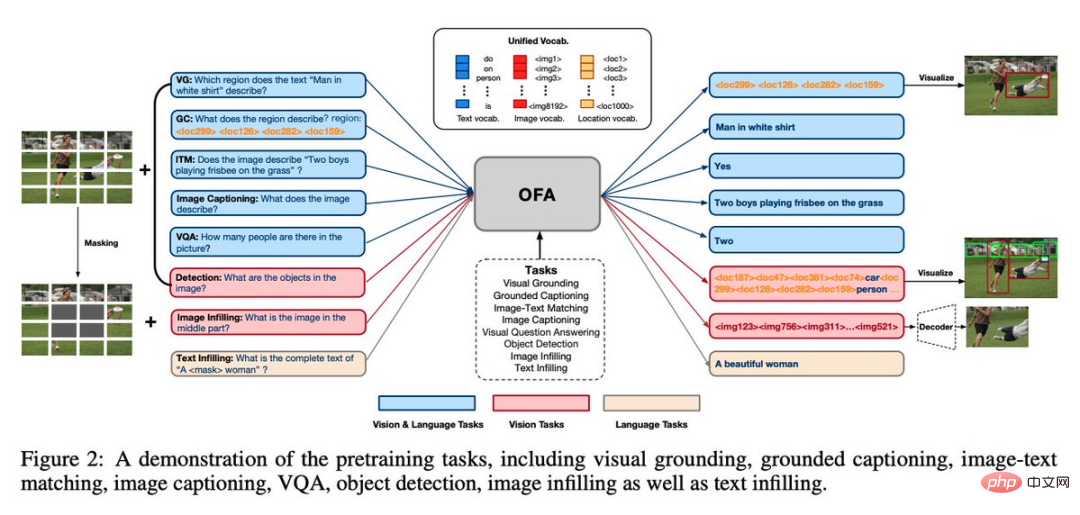

Papier 3: OFA: Vereinheitlichung von Architekturen, Aufgaben und Modalitäten durch einfaches Sequenz-zu-Sequenz-Lernen Framework

Dies ist das einheitliche multimodale Multitask-Modell-Framework OFA, das von der Alibaba Damo Academy ins Leben gerufen wurde. Es fasst die drei Merkmale zusammen, die in dieser Phase am besten für das allgemeine Modell geeignet sind, nämlich Modalitätsunabhängigkeit, Aufgabenunabhängigkeit und Aufgabenvielfalt. Dieses Papier wurde von ICML 2022 angenommen.

Im Bereich Grafik und Text repräsentiert OFA klassische Aufgaben wie visuelle Erdung, VQA, Bildunterschrift, Bildklassifizierung, Text-Bild-Generierung und Sprachmodellierung durch ein einheitliches seq2seq-Framework, wobei Eingabe und Ausgabe verschiedener Modalitäten zwischen Aufgaben geteilt werden , und Finetune konsistent mit dem Vortraining halten, ohne zusätzliche Parameterstrukturen hinzuzufügen.

Papieradresse: https://arxiv.org/abs/2202.03052v2

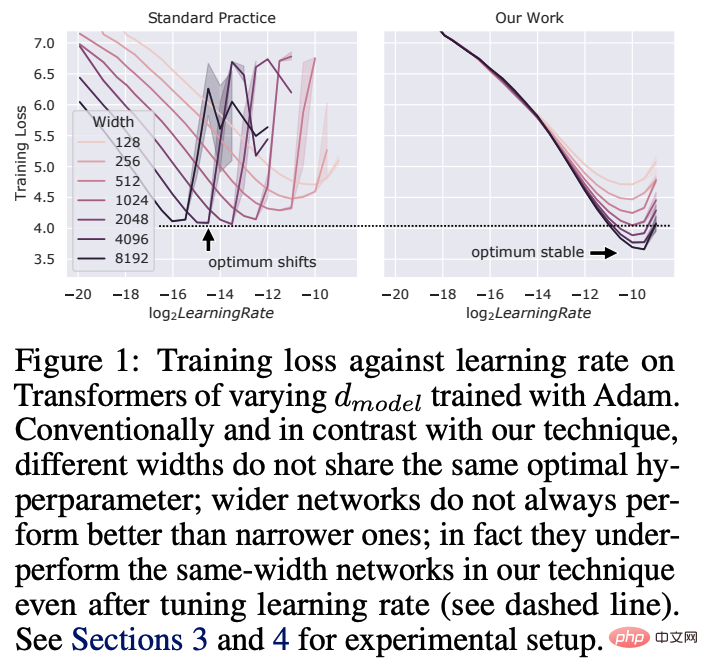

Papier 4: Tensorprogramme V: Tuning großer neuronaler Netze über Zero-Shot-Hyperparameterübertragung

In Deep Learning Hyperparameter (HP)-Tuning ist ein kostspieliger Prozess, insbesondere für neuronale Netze mit Milliarden von Parametern. In diesem Artikel zeigen Forscher von Microsoft und OpenAI, dass bei der kürzlich entdeckten Maximal Update Parametrization (muP) viele optimale HPs auch dann stabil bleiben, wenn sich die Modellgröße ändert.

Dies führte zu einem neuen HP-Tuning-Paradigma namens muTransfer, das darin besteht, das Zielmodell in muP zu parametrisieren, HP-Tuning nicht direkt an kleineren Modellen durchzuführen und diese im Zero-Shot auf das Modell in voller Größe zu migrieren, was auch bedeutet dass letzteres Modell überhaupt nicht direkt abgestimmt werden muss. Forscher verifizierten muTransfer auf Transformer und ResNet. Durch die Migration von einem 40-M-Parametermodell ist die Leistung beispielsweise besser als beim veröffentlichten 6,7-B-GPT-3-Modell, und das bei einem Optimierungsaufwand von nur 7 % der gesamten Kosten vor dem Training.

Papieradresse: https://arxiv.org/abs/2203.03466v2

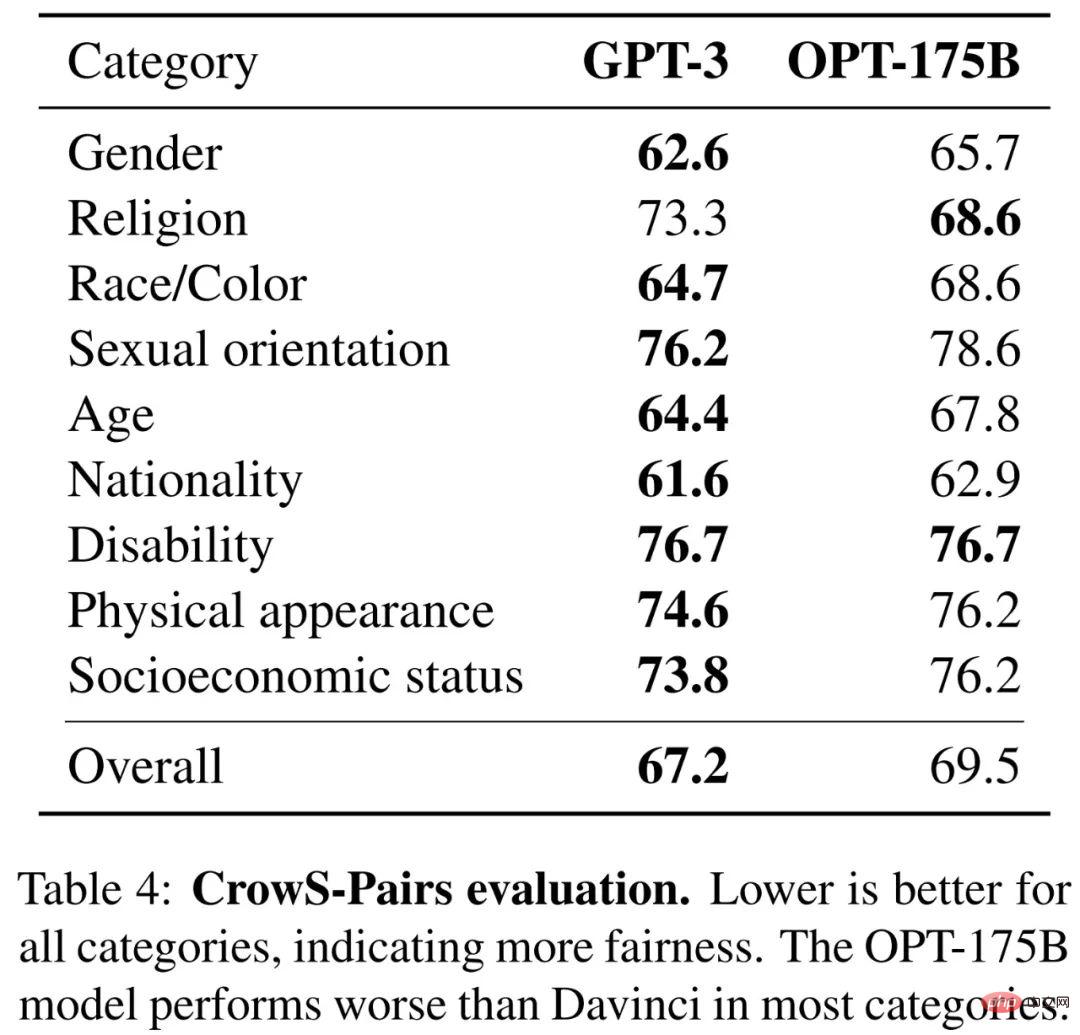

Papier 5: OPT: Open Pre-trained Transformer Language. Modelle

Groß Modelle gehen oft Durch Tausende von Rechentagen Training demonstrieren sie außergewöhnliche Fähigkeiten im Zero-Shot- und Fence-Shot-Lernen. Aufgrund ihres Rechenaufwands sind diese großen Modelle jedoch ohne ausreichende Finanzierung nur schwer zu reproduzieren. Für die wenigen Modelle, die über die API verfügbar sind, gibt es keinen Zugriff auf ihre vollständigen Modellgewichte, was die Untersuchung erschwert.

In diesem Artikel schlagen Meta-KI-Forscher Open Pre-trained Transformers (OPT) vor, einen Satz vorab trainierter Transformatormodelle nur für Decoder mit Parametern im Bereich von 125M bis 175B. Sie zeigten, dass OPT-175B eine mit GPT-3 vergleichbare Leistung erbringt, für die Entwicklung jedoch nur ein Siebtel des CO2-Fußabdrucks erforderlich ist.

... ing, Deepmind A Es wird ein einzelner „generalistischer“ Agent Gato konstruiert, der die Eigenschaften von Multimodalität, Multitask und Multiverkörperung aufweist.

Gato kann Atari-Spiele spielen, Untertitel für Bilder ausgeben, mit anderen chatten, Blöcke mit einem Roboterarm stapeln und vieles mehr. Darüber hinaus kann Gato je nach Kontext entscheiden, ob Text, gemeinsame Momente, Tastendrücke oder andere Token ausgegeben werden sollen.

Im Gegensatz zu den meisten Agenten, die Spiele spielen, kann Gato viele Spiele mit demselben Trainingsmodell spielen, ohne für jedes Spiel separat trainieren zu müssen.

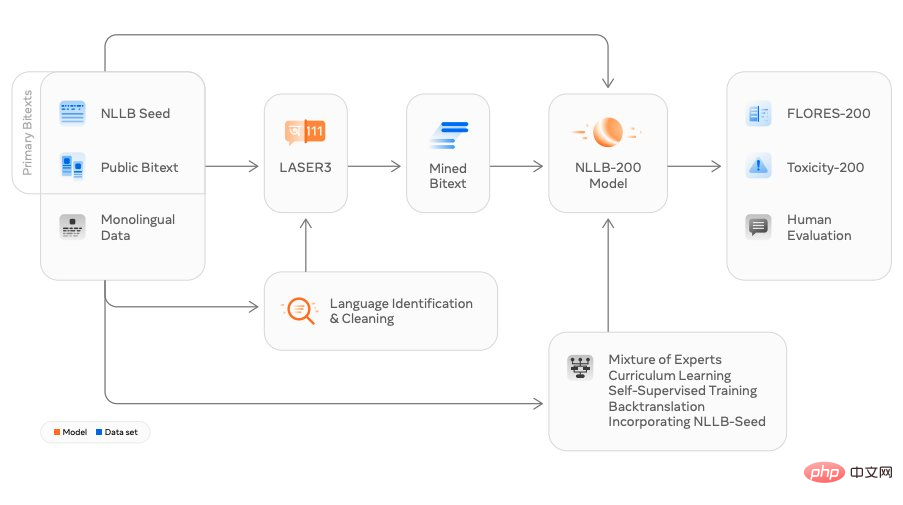

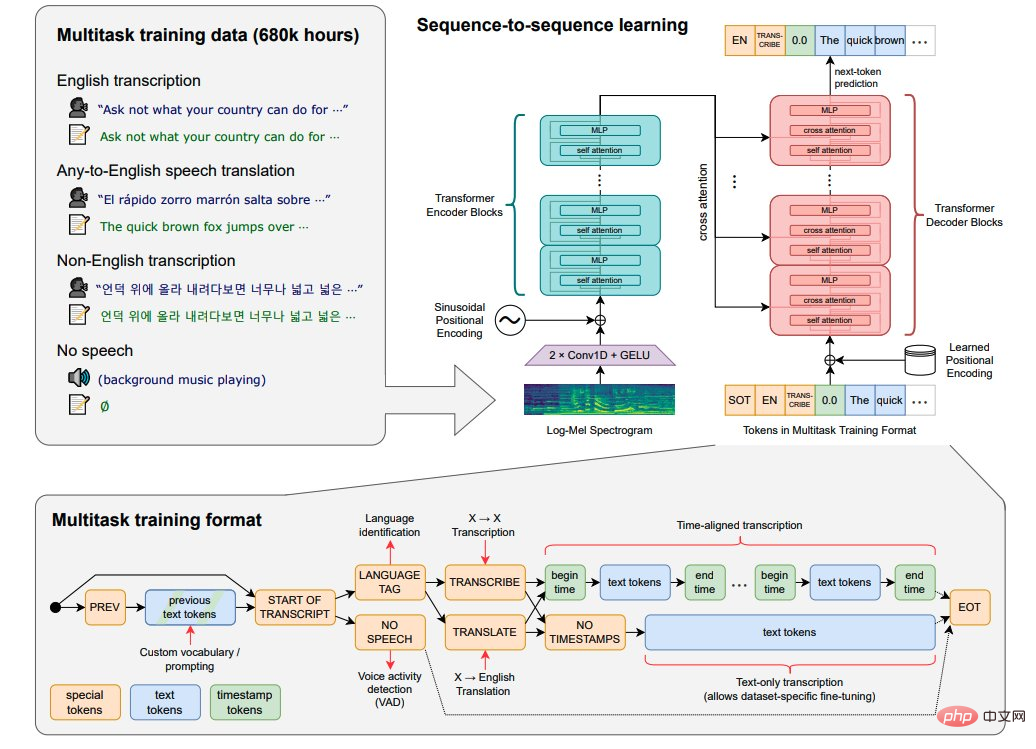

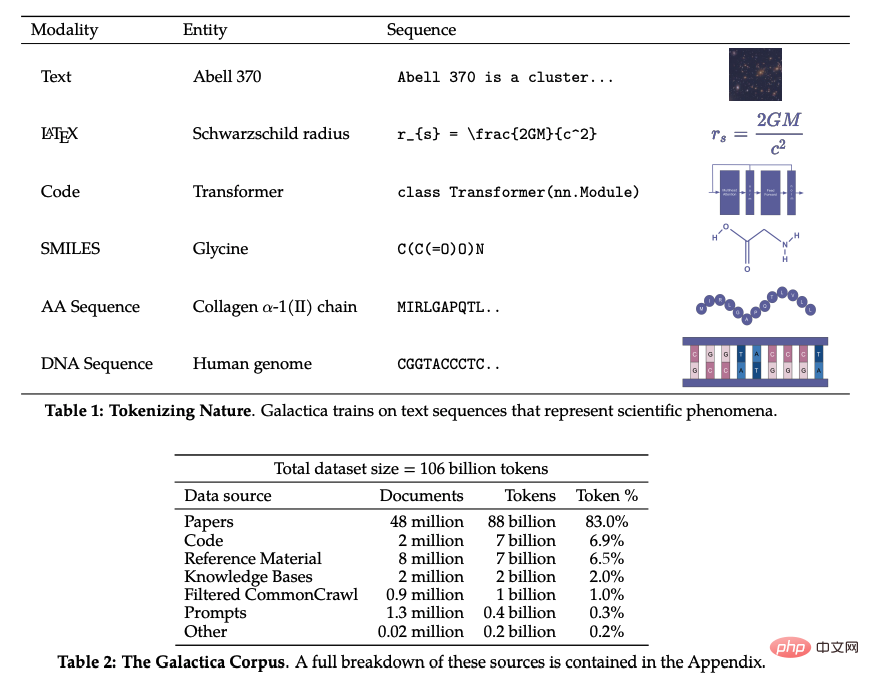

... Von Gu-Song-Forschern vorgeschlagen, entwickelt zu werden ein Deep-Learning-Sprachmodell namens Minerva, das quantitative mathematische Probleme durch schrittweises Denken lösen kann. Zu seinen Lösungen gehören numerische Berechnungen und symbolische Manipulationen, ohne auf externe Tools wie Taschenrechner angewiesen zu sein.Darüber hinaus kombiniert Minerva mehrere Techniken, darunter kleine Beispielaufforderungen, Gedankenverkettung, Notizblockaufforderungen und Mehrheitsentscheidungsprinzipien, um SOTA-Leistung bei MINT-Argumentationsaufgaben zu erreichen. Minerva basiert auf PaLM (Pathways Language Model) und wird anhand eines 118-GB-Datensatzes weiter trainiert. Der Datensatz stammt aus arXiv-Artikeln zu Technologie und Webseiten, die LaTeX, MathJax oder andere mathematische Ausdrücke verwenden zur weiteren Ausbildung. Das Bild unten zeigt ein Beispiel dafür, wie Minerva das Problem löst: Paper -Adresse: https://arxiv.org/abs/2206.14858 paper 8: Keine Sprache Zurückgelassen: Skalierung der menschzentrierten maschinellen Übersetzung Forscher von Meta AI haben das Übersetzungsmodell NLLB (No Language Left Behind) veröffentlicht, das wörtlich übersetzt „Keine Sprache kann zurückgelassen werden“ bedeutet und jede Übersetzung dazwischen unterstützen kann Über 200 Sprachen: Zusätzlich zur Übersetzung häufig verwendeter Sprachen wie Chinesisch, Englisch, Französisch und Japanisch kann NLLB auch viele Nischensprachen übersetzen, darunter Luganda, Urdu usw. Meta behauptet, dass dies das weltweit erste Design ist, das ein einziges Modell zur Übersetzung in mehrere Sprachen verwendet. Sie hoffen, dass dies mehr Menschen dabei helfen wird, auf sozialen Plattformen interaktiv zu interagieren und gleichzeitig das Benutzererlebnis zu verbessern Erfahrung. Papieradresse: https://arxiv.org/abs/2207.04672v3 Papier 9: Hochauflösende Bildsynthese mit latenten Diffusionsmodellen letzte Periode Stabile Diffusion ist in den letzten Jahren populär geworden und es gibt unzählige Studien zu dieser Technologie. Diese Forschung basiert auf dem CVPR 2022-Papier „High-Resolution Image Synthesis with Latent Diffusion Models“ von Forschern der Universität München und von Runway und wurde in Zusammenarbeit mit Teams wie Eleuther AI und LAION durchgeführt. Stable Diffusion kann auf einer Consumer-GPU mit 10 GB VRAM ausgeführt werden und in Sekundenschnelle ohne Vor- und Nachbearbeitung ein Bild mit 512 x 512 Pixeln erzeugen. In nur vier Monaten hat dieses Open-Source-Projekt 38.000 Sterne erhalten. Projektadresse: https://github.com/CompVis/stable-diffusion Stable Diffusion generierte Bildbeispielanzeige: Papier : Robuste Spracherkennung über Large-Scale Weak Supervision OpenAI veröffentlicht das Open-Source-Modell Whisper, das bei der englischen Spracherkennung nahe am menschlichen Niveau liegt und eine hohe Genauigkeit aufweist. Whisper ist ein automatisches Spracherkennungssystem (ASR, Automatic Speech Recognition), das von OpenAI trainiert wurde, indem es 680.000 Stunden 98 Sprachen und über mehrere Aufgaben überwachte Daten aus dem Internet sammelt. Zusätzlich zur Spracherkennung kann Whisper auch mehrere Sprachen transkribieren und diese Sprachen ins Englische übersetzen. Papieradresse: https://arxiv.org/abs/2212.04356 Papier 11: Make-A-Video: Text-to-Video-Generierung ohne Text-Video-Daten Von Meta KI-Forscher haben ein hochmodernes Text-zu-Video-Modell vorgeschlagen: Make-A-Video, das aus einer bestimmten Textaufforderung ein Video generieren kann. Make-A-Video hat drei Vorteile: (1) Es beschleunigt das Training von T2V-Modellen (Text-to-Video), ohne dass visuelle und multimodale Darstellungen von Grund auf erlernt werden müssen, (2) das ist nicht der Fall erfordern eine Paarung von Text-Video-Daten. (3) Das generierte Video erbt viele der Vorteile heutiger Bilderzeugungsmodelle. Diese Technologie wurde entwickelt, um die Text-zu-Video-Generierung zu erreichen und einzigartige Videos mit nur wenigen Wörtern oder Textzeilen zu erstellen. Das Bild unten zeigt einen Hund in Superheldenkleidung und einem roten Umhang, der in den Himmel fliegt: Papieradresse: https://arxiv.org/abs/2209.14792 Papier 12: Galactica: Ein großes Sprachmodell für die Wissenschaft Mit der Weiterentwicklung der Forschung in verschiedenen Fachgebieten sind wissenschaftliche Literatur und Daten explosionsartig angestiegen, was es akademischen Forschern immer mehr ermöglicht, nützliche Erkenntnisse aus großen Informationsmengen zu gewinnen schwierig. Normalerweise nutzen Menschen Suchmaschinen, um an wissenschaftliche Erkenntnisse zu gelangen, doch Suchmaschinen können wissenschaftliche Erkenntnisse nicht autonom organisieren. Kürzlich hat das Forschungsteam von Meta AI ein neues groß angelegtes Sprachmodell Galactica vorgeschlagen, das wissenschaftliche Erkenntnisse speichern, kombinieren und darüber nachdenken kann. Galactica kann einen Rezensionsbeitrag zusammenfassen, Enzyklopädieabfragen zu Einträgen generieren und sachkundige Antworten auf Fragen geben. Papieradresse: https://arxiv.org/abs/2211.09085

Das obige ist der detaillierte Inhalt vonML-Forschung verlässt den Kreis im Jahr 2022: die beliebte Stable Diffusion, der Generalistenagent Gato, LeCun retweetet. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1376

1376

52

52

15 empfohlene kostenlose Open-Source-Bildanmerkungstools

Mar 28, 2024 pm 01:21 PM

15 empfohlene kostenlose Open-Source-Bildanmerkungstools

Mar 28, 2024 pm 01:21 PM

Bei der Bildanmerkung handelt es sich um das Verknüpfen von Beschriftungen oder beschreibenden Informationen mit Bildern, um dem Bildinhalt eine tiefere Bedeutung und Erklärung zu verleihen. Dieser Prozess ist entscheidend für maschinelles Lernen, das dabei hilft, Sehmodelle zu trainieren, um einzelne Elemente in Bildern genauer zu identifizieren. Durch das Hinzufügen von Anmerkungen zu Bildern kann der Computer die Semantik und den Kontext hinter den Bildern verstehen und so den Bildinhalt besser verstehen und analysieren. Die Bildanmerkung hat ein breites Anwendungsspektrum und deckt viele Bereiche ab, z. B. Computer Vision, Verarbeitung natürlicher Sprache und Diagramm-Vision-Modelle. Sie verfügt über ein breites Anwendungsspektrum, z. B. zur Unterstützung von Fahrzeugen bei der Identifizierung von Hindernissen auf der Straße und bei der Erkennung und Diagnose von Krankheiten durch medizinische Bilderkennung. In diesem Artikel werden hauptsächlich einige bessere Open-Source- und kostenlose Bildanmerkungstools empfohlen. 1.Makesens

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In diesem Artikel erfahren Sie mehr über SHAP: Modellerklärung für maschinelles Lernen

Jun 01, 2024 am 10:58 AM

In den Bereichen maschinelles Lernen und Datenwissenschaft stand die Interpretierbarkeit von Modellen schon immer im Fokus von Forschern und Praktikern. Mit der weit verbreiteten Anwendung komplexer Modelle wie Deep Learning und Ensemble-Methoden ist das Verständnis des Entscheidungsprozesses des Modells besonders wichtig geworden. Explainable AI|XAI trägt dazu bei, Vertrauen in maschinelle Lernmodelle aufzubauen, indem es die Transparenz des Modells erhöht. Eine Verbesserung der Modelltransparenz kann durch Methoden wie den weit verbreiteten Einsatz mehrerer komplexer Modelle sowie der Entscheidungsprozesse zur Erläuterung der Modelle erreicht werden. Zu diesen Methoden gehören die Analyse der Merkmalsbedeutung, die Schätzung des Modellvorhersageintervalls, lokale Interpretierbarkeitsalgorithmen usw. Die Merkmalswichtigkeitsanalyse kann den Entscheidungsprozess des Modells erklären, indem sie den Grad des Einflusses des Modells auf die Eingabemerkmale bewertet. Schätzung des Modellvorhersageintervalls

Transparent! Eine ausführliche Analyse der Prinzipien der wichtigsten Modelle des maschinellen Lernens!

Apr 12, 2024 pm 05:55 PM

Transparent! Eine ausführliche Analyse der Prinzipien der wichtigsten Modelle des maschinellen Lernens!

Apr 12, 2024 pm 05:55 PM

Laienhaft ausgedrückt ist ein Modell für maschinelles Lernen eine mathematische Funktion, die Eingabedaten einer vorhergesagten Ausgabe zuordnet. Genauer gesagt ist ein Modell für maschinelles Lernen eine mathematische Funktion, die Modellparameter anpasst, indem sie aus Trainingsdaten lernt, um den Fehler zwischen der vorhergesagten Ausgabe und der wahren Bezeichnung zu minimieren. Beim maschinellen Lernen gibt es viele Modelle, z. B. logistische Regressionsmodelle, Entscheidungsbaummodelle, Support-Vektor-Maschinenmodelle usw. Jedes Modell verfügt über seine anwendbaren Datentypen und Problemtypen. Gleichzeitig gibt es viele Gemeinsamkeiten zwischen verschiedenen Modellen oder es gibt einen verborgenen Weg für die Modellentwicklung. Am Beispiel des konnektionistischen Perzeptrons können wir es durch Erhöhen der Anzahl verborgener Schichten des Perzeptrons in ein tiefes neuronales Netzwerk umwandeln. Wenn dem Perzeptron eine Kernelfunktion hinzugefügt wird, kann es in eine SVM umgewandelt werden. Dieses hier

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

Identifizieren Sie Über- und Unteranpassung anhand von Lernkurven

Apr 29, 2024 pm 06:50 PM

In diesem Artikel wird vorgestellt, wie Überanpassung und Unteranpassung in Modellen für maschinelles Lernen mithilfe von Lernkurven effektiv identifiziert werden können. Unteranpassung und Überanpassung 1. Überanpassung Wenn ein Modell mit den Daten übertrainiert ist, sodass es daraus Rauschen lernt, spricht man von einer Überanpassung des Modells. Ein überangepasstes Modell lernt jedes Beispiel so perfekt, dass es ein unsichtbares/neues Beispiel falsch klassifiziert. Für ein überangepasstes Modell erhalten wir einen perfekten/nahezu perfekten Trainingssatzwert und einen schrecklichen Validierungssatz-/Testwert. Leicht geändert: „Ursache der Überanpassung: Verwenden Sie ein komplexes Modell, um ein einfaches Problem zu lösen und Rauschen aus den Daten zu extrahieren. Weil ein kleiner Datensatz als Trainingssatz möglicherweise nicht die korrekte Darstellung aller Daten darstellt. 2. Unteranpassung Heru.“

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

Die Entwicklung der künstlichen Intelligenz in der Weltraumforschung und der Siedlungstechnik

Apr 29, 2024 pm 03:25 PM

In den 1950er Jahren wurde die künstliche Intelligenz (KI) geboren. Damals entdeckten Forscher, dass Maschinen menschenähnliche Aufgaben wie das Denken ausführen können. Später, in den 1960er Jahren, finanzierte das US-Verteidigungsministerium künstliche Intelligenz und richtete Labore für die weitere Entwicklung ein. Forscher finden Anwendungen für künstliche Intelligenz in vielen Bereichen, etwa bei der Erforschung des Weltraums und beim Überleben in extremen Umgebungen. Unter Weltraumforschung versteht man die Erforschung des Universums, das das gesamte Universum außerhalb der Erde umfasst. Der Weltraum wird als extreme Umgebung eingestuft, da sich seine Bedingungen von denen auf der Erde unterscheiden. Um im Weltraum zu überleben, müssen viele Faktoren berücksichtigt und Vorkehrungen getroffen werden. Wissenschaftler und Forscher glauben, dass die Erforschung des Weltraums und das Verständnis des aktuellen Zustands aller Dinge dazu beitragen können, die Funktionsweise des Universums zu verstehen und sich auf mögliche Umweltkrisen vorzubereiten

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Implementierung von Algorithmen für maschinelles Lernen in C++: Häufige Herausforderungen und Lösungen

Jun 03, 2024 pm 01:25 PM

Zu den häufigsten Herausforderungen, mit denen Algorithmen für maschinelles Lernen in C++ konfrontiert sind, gehören Speicherverwaltung, Multithreading, Leistungsoptimierung und Wartbarkeit. Zu den Lösungen gehören die Verwendung intelligenter Zeiger, moderner Threading-Bibliotheken, SIMD-Anweisungen und Bibliotheken von Drittanbietern sowie die Einhaltung von Codierungsstilrichtlinien und die Verwendung von Automatisierungstools. Praktische Fälle zeigen, wie man die Eigen-Bibliothek nutzt, um lineare Regressionsalgorithmen zu implementieren, den Speicher effektiv zu verwalten und leistungsstarke Matrixoperationen zu nutzen.

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Erklärbare KI: Erklären komplexer KI/ML-Modelle

Jun 03, 2024 pm 10:08 PM

Übersetzer |. Rezensiert von Li Rui |. Chonglou Modelle für künstliche Intelligenz (KI) und maschinelles Lernen (ML) werden heutzutage immer komplexer, und die von diesen Modellen erzeugten Ergebnisse sind eine Blackbox, die den Stakeholdern nicht erklärt werden kann. Explainable AI (XAI) zielt darauf ab, dieses Problem zu lösen, indem es Stakeholdern ermöglicht, die Funktionsweise dieser Modelle zu verstehen, sicherzustellen, dass sie verstehen, wie diese Modelle tatsächlich Entscheidungen treffen, und Transparenz in KI-Systemen, Vertrauen und Verantwortlichkeit zur Lösung dieses Problems gewährleistet. In diesem Artikel werden verschiedene Techniken der erklärbaren künstlichen Intelligenz (XAI) untersucht, um ihre zugrunde liegenden Prinzipien zu veranschaulichen. Mehrere Gründe, warum erklärbare KI von entscheidender Bedeutung ist. Vertrauen und Transparenz: Damit KI-Systeme allgemein akzeptiert und vertrauenswürdig sind, müssen Benutzer verstehen, wie Entscheidungen getroffen werden

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist