Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Stabile Diffusions-Probenahmegeschwindigkeit verdoppelt! Diffusionsmodell-Sampling-Algorithmus in nur 10 bis 25 Schritten

Stabile Diffusions-Probenahmegeschwindigkeit verdoppelt! Diffusionsmodell-Sampling-Algorithmus in nur 10 bis 25 Schritten

Stabile Diffusions-Probenahmegeschwindigkeit verdoppelt! Diffusionsmodell-Sampling-Algorithmus in nur 10 bis 25 Schritten

Apropos die einflussreichsten Entwicklungen im Bereich KI in diesem Jahr: Das explosive AI-Mapping ist definitiv eine davon. Designer müssen lediglich eine Textbeschreibung des Bildes eingeben und schon generiert die KI ein hochauflösendes Bild von extrem hoher Qualität. Das derzeit am weitesten verbreitete Modell ist das Open-Source-Modell Stable Diffusion von StabilityAI. Sobald das Modell Open-Source war, sorgte es für breite Diskussionen in der Community.

Das größte Problem bei der Verwendung des Diffusionsmodells ist jedoch seine extrem langsame Abtastgeschwindigkeit. Die Modellabtastung muss mit reinen Rauschbildern beginnen und Schritt für Schritt kontinuierlich entrauschen, um schließlich klare Bilder zu erhalten. Bei diesem Prozess muss das Modell mindestens 50 bis 100 Schritte nacheinander berechnen, um ein Bild mit höherer Qualität zu erhalten. Dies führt dazu, dass die zur Generierung eines Bildes erforderliche Zeit 50 bis 100 Mal so hoch ist wie bei anderen Modellen mit tiefer Generierung, was das Modell stark einschränkt . Bereitstellung und Implementierung.

Um das Sampling von Diffusionsmodellen zu beschleunigen, gehen viele Forscher von der Hardware-Optimierung aus. Beispielsweise verwendet Google die JAX-Sprache, um das Modell zu kompilieren und auszuführen es auf TPU und das OneFlow-Team [1 ] Mithilfe eines selbst entwickelten Compilers erreicht Stable Diffusion eine „Bildausgabe in einer Sekunde“. Diese Methoden basieren auf dem 50-stufigen Sampling-Algorithmus PNDM [2], dessen Sampling-Effekt stark abnimmt, wenn die Anzahl der Schritte reduziert wird.

Vor ein paar Tagen wurde dieser Rekord aktualisiert! Das offizielle Demo[3]-Update von Stable Diffusion zeigt, dass die Zeit zum Abtasten von 8 Bildern direkt von ursprünglich 8 Sekunden auf 4 Sekunden verkürzt wurde! Es ist doppelt so schnell!

Das OneFlow-Team basiert auf der selbst entwickelten Deep-Learning-Compiler-Technologie und reduziert den Sampling-Effekt nicht die bisherige „Bildausgabe in einer Sekunde“ zu „Bildausgabe in einer halben Sekunde“! Erhalten Sie ein hochauflösendes Bild in weniger als 0,5 Sekunden auf der GPU! Verwandte Arbeiten wurden in [1] veröffentlicht.

Tatsächlich kommt die treibende Kraft dieser Arbeiten vom DPM-Solver, der vom TSAIL-Team unter der Leitung von Professor Zhu Jun von der Tsinghua-Universität vorgeschlagen wurde, einem speziellen Modell für Diffusionsmodelle Entwickelter effizienter Löser: Dieser Algorithmus erfordert kein zusätzliches Training, eignet sich sowohl für zeitdiskrete als auch für zeitkontinuierliche Diffusionsmodelle, kann innerhalb von 20 bis 25 Schritten nahezu konvergieren und kann in nur 10 bis eine sehr hochwertige Stichprobe erhalten 15 Schritte. Bei stabiler Diffusion kann ein 25-stufiger DPM-Solver eine bessere Sampling-Qualität erzielen als ein 50-stufiger PNDM, sodass sich die Sampling-Geschwindigkeit direkt verdoppelt!

Projektlink:

- DPM-Solver: Ein schneller ODE-Löser für Diffusionsprobabilistik Modellabtastung in etwa 10 Schritten: https://arxiv.org/abs/2206.00927 (NeurIPS 2022 Oral)

- DPM-Solver++: Schneller Löser für die geführte Abtastung der Diffusion Wahrscheinlichkeitsmodelle: https://arxiv.org/abs/2211.01095

- Open-Source-Projektcode: https://github.com/LuChengTHU/dpm-solver#🎜 🎜 #

- Projekt-Online-Demo: https://huggingface.co/spaces/LuChengTHU/dpmsolver_sdm

wandelt das Diffusionsmodell das Bild schrittweise in Gaußsches Rauschen um, indem es einen Vorwärtsprozess definiert, der kontinuierlich Rauschen hinzufügt, und dann einen Rückwärtsprozess definiert, um das Gaußsche Rauschen schrittweise zu entrauschen Um ein klares Bild zu bekommen:

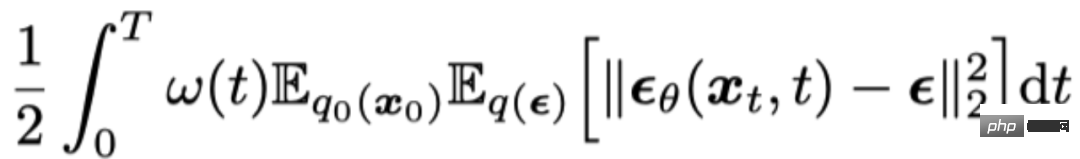

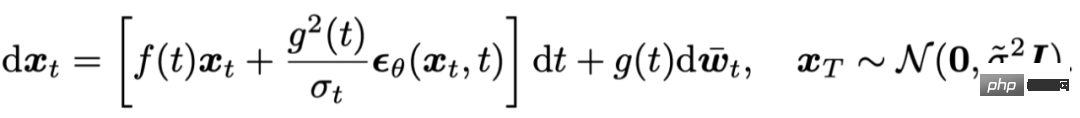

Während des Probenahmevorgangs kann die Diffusion verändert werden, je nachdem, ob zusätzliches Rauschen vorliegt Die hinzugefügten Modelle sind in zwei Kategorien unterteilt: Eine ist das Diffusions-Stochastische-Differentialgleichungsmodell (Diffusions-SDE) und die andere ist die Diffusions-Gewöhnliche-Differentialgleichung (Diffusions-ODE). Die Trainingszielfunktionen beider Modelle sind die gleichen, sie trainieren ein „Rauschenvorhersagenetzwerk“ durch Minimieren des mittleren quadratischen Fehlers mit Rauschen:

#🎜 🎜 #

#🎜 🎜 #

#🎜🎜 # Und in [4] wird bewiesen, dass DDPM[5] eine Diskretisierung erster Ordnung der obigen SDE ist.

#🎜🎜 # Und in [4] wird bewiesen, dass DDPM[5] eine Diskretisierung erster Ordnung der obigen SDE ist.

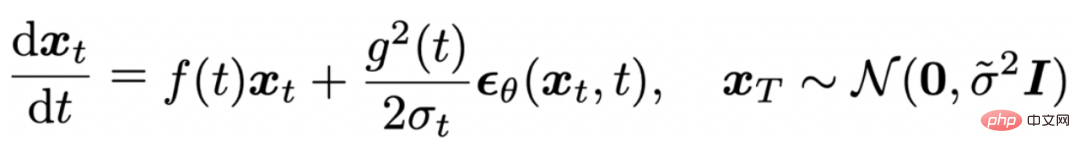

Der auf der Diffusions-ODE basierende Abtastprozess kann als Diskretisierung der folgenden gewöhnlichen Differentialgleichung angesehen werden:

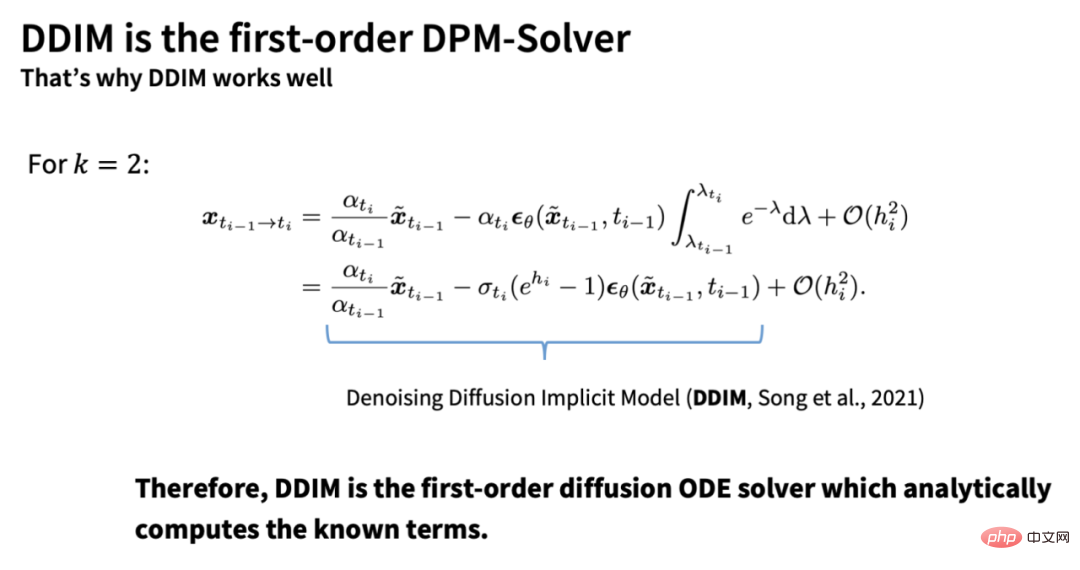

Und es wird in [6] bewiesen, dass DDIM[7] eine Diskretisierung erster Ordnung der obigen ODE ist.

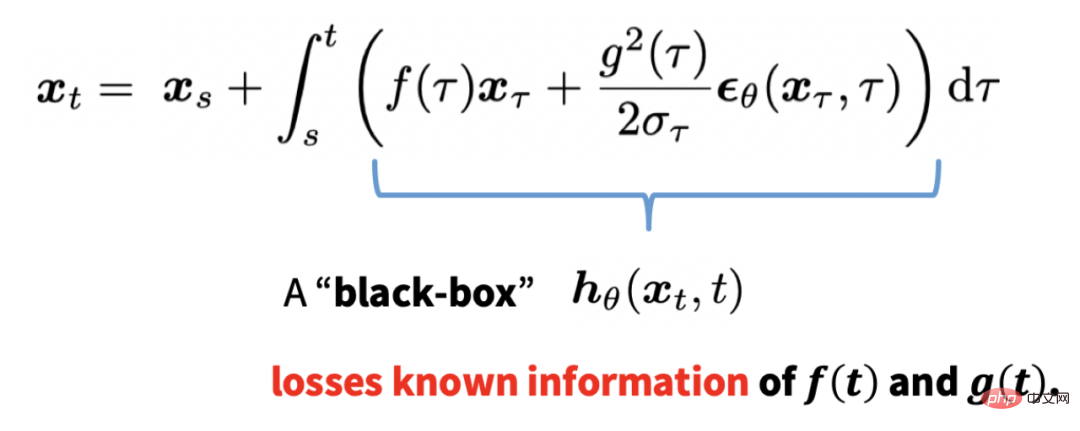

Allerdings konvergieren diese Diskretisierungsmethoden erster Ordnung extrem langsam, und die Abtastung des Diffusionsmodells erfordert normalerweise 100 bis 1000 serielle Berechnungen, um ein qualitativ hochwertiges Bild zu erhalten. Um das Sampling von Diffusionsmodellen zu beschleunigen, verwenden Forscher normalerweise Löser höherer Ordnung für Diffusions-ODE, um den Prozess zu beschleunigen, wie beispielsweise die klassische Runge-Kutta-Methode (RK45). Dies liegt daran, dass ODE keine zusätzliche Zufälligkeit mit sich bringt . Die Diskretisierungsschrittgröße kann relativ größer sein. Nachdem die Lösung zum Zeitpunkt s gegeben ist, basiert die Runge-Kutta-Methode auf der Diskretisierung des folgenden Integrals: ODE und in weniger als 50 Schritten ist es schwierig, zu konvergieren.

DPM-Solver: Ein speziell für Diffusionsmodelle entwickelter Löser

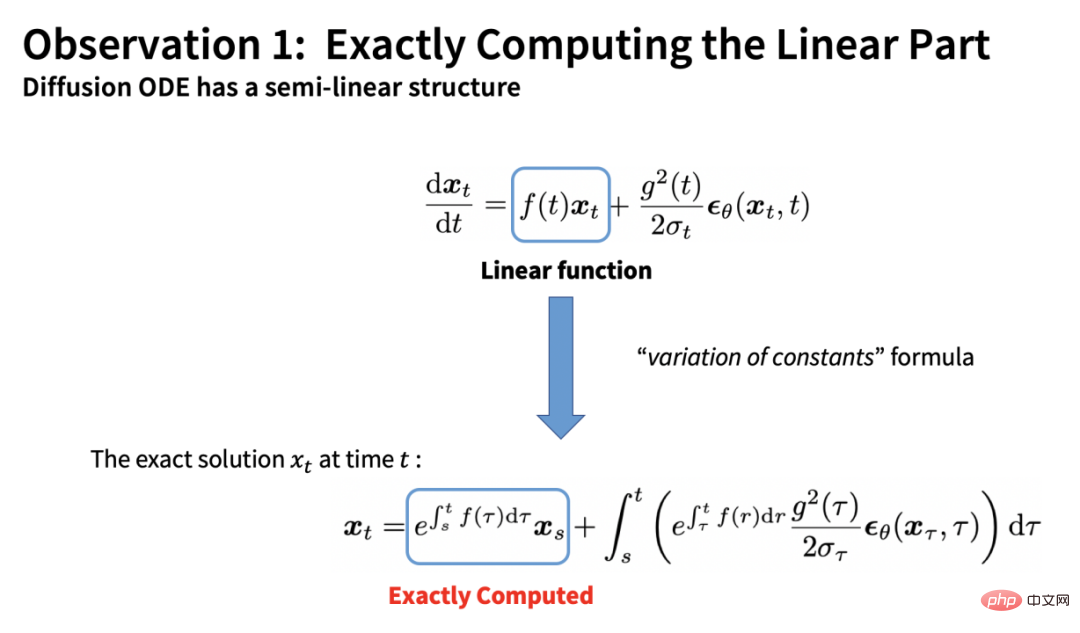

DPM-Solver basiert auf der semilinearen Struktur der Diffusions-ODE. Durch genaue und analytische Berechnung der linearen Terme in der ODE können wir Folgendes erhalten:

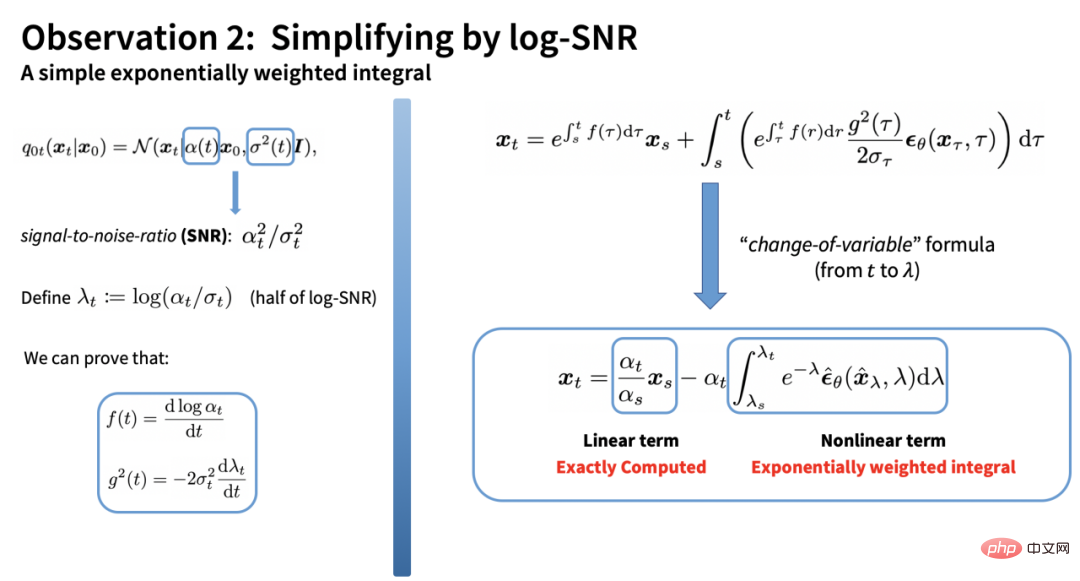

Der verbleibende Integralterm ist ein komplexes Integral bezüglich der Zeit. Der Antragsteller von DPM-Solver hat jedoch herausgefunden, dass dieses Integral durch Ändern von log-SNR (logarithmisches Signal-Rausch-Verhältnis) erhalten werden kann, um eine sehr einfache Form zu erhalten:

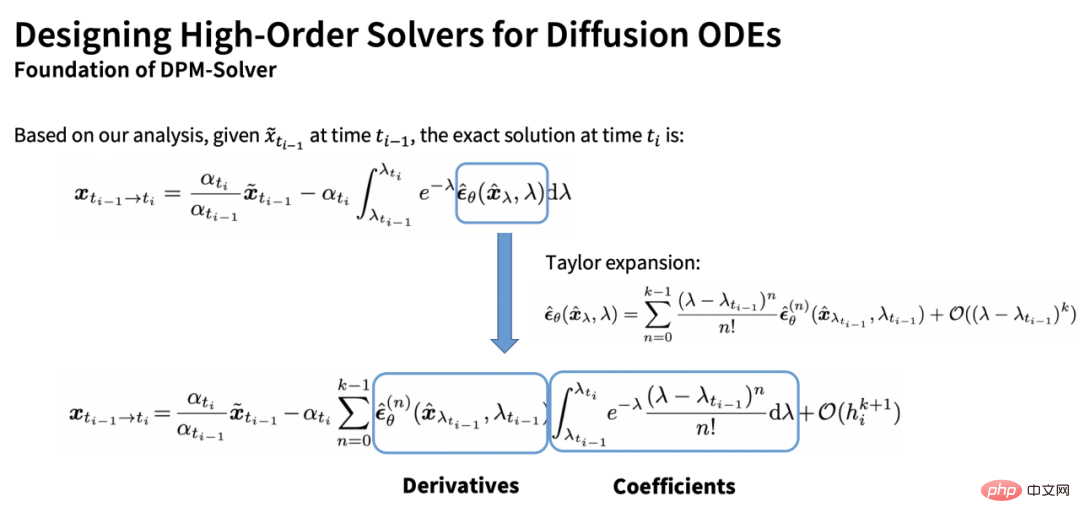

Das verbleibende Integral ist eine Funktion von Rauschen Exponentiell gewichtetes Integral des Vorhersagemodells. Durch die Taylor-Erweiterung des Rauschvorhersagemodells können wir eine Schätzung des Integrals erhalten:

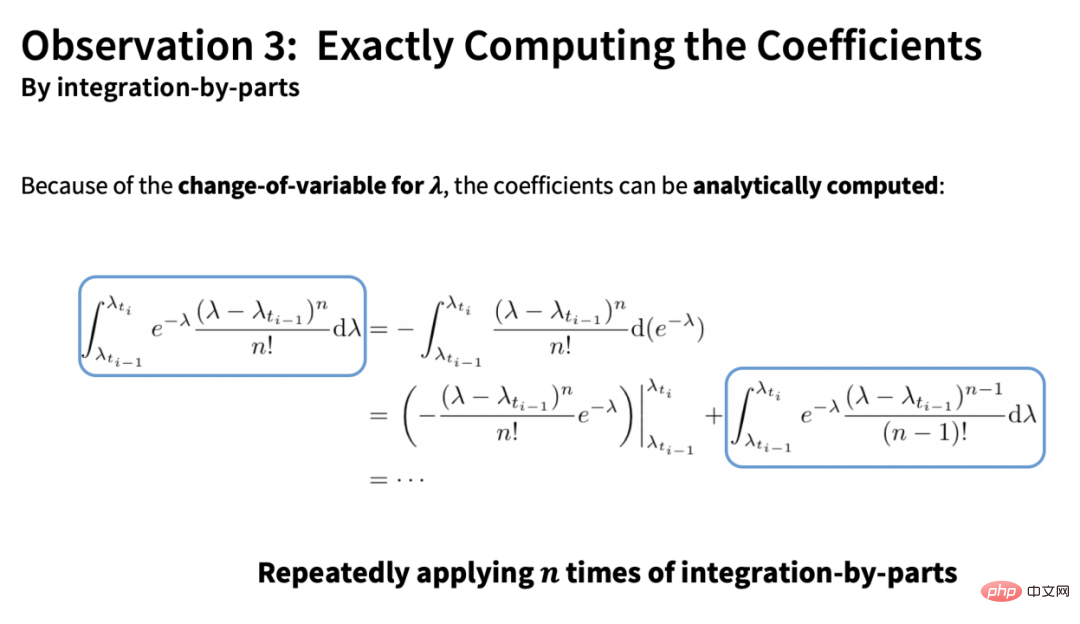

Diese Schätzung enthält zwei Elemente: eines ist der Gesamtableitungsteil (Vektor) und das andere ist der Koeffizient Teil (Skalar). Ein weiterer zentraler Beitrag von DPM-Solver besteht darin, dass der Koeffizient analytisch durch partielle Integration berechnet werden kann:

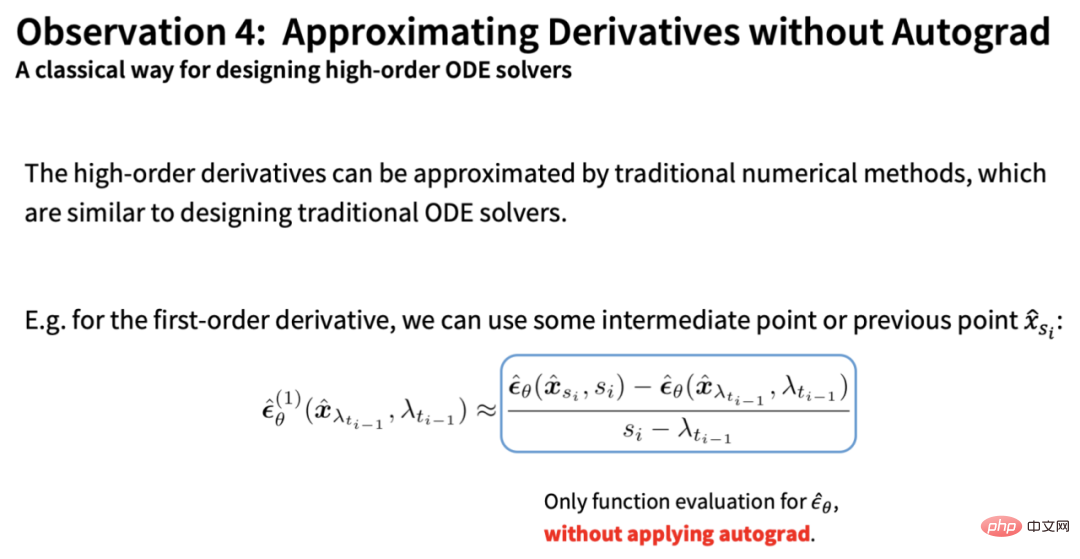

, während der verbleibende gesamte Ableitungsanteil durch numerische Methoden herkömmlicher ODE-Löser (ohne Ableitungsoperation) näherungsweise geschätzt werden kann. :

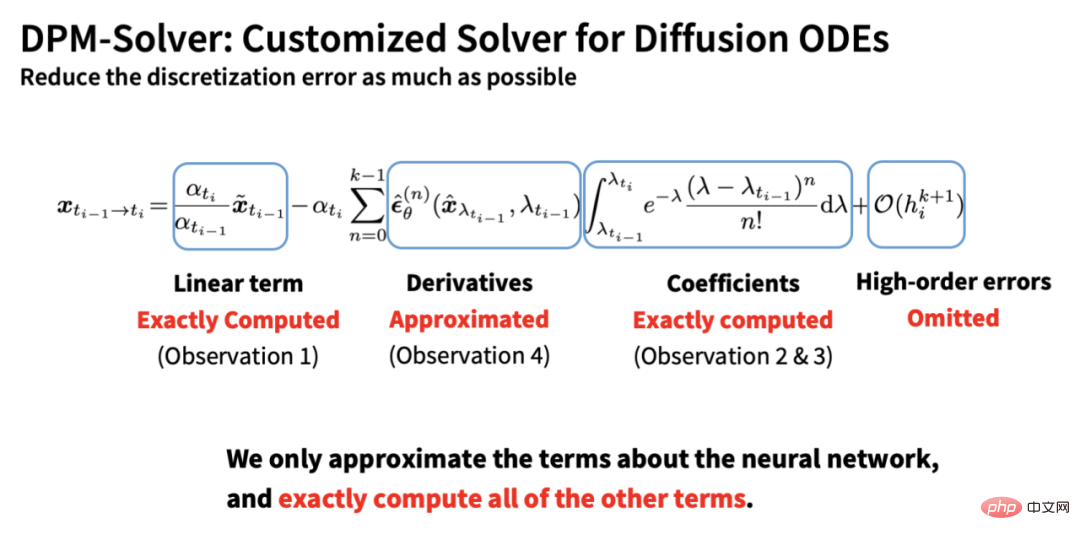

Basierend auf den oben genannten 4 Punkten berechnet DPM-Solver alle bekannten Elemente so genau wie möglich und nähert sich nur dem neuronalen Netzwerkteil an, wodurch der Diskretisierungsfehler minimiert wird:

Außerdem Basierend auf dieser Ableitung können wir feststellen, dass DDIM im Wesentlichen die Form erster Ordnung von DPM-Solver ist, was auch erklären kann, warum DDIM bei geringer Schrittzahl immer noch gute Beschleunigungseffekte erzielen kann:

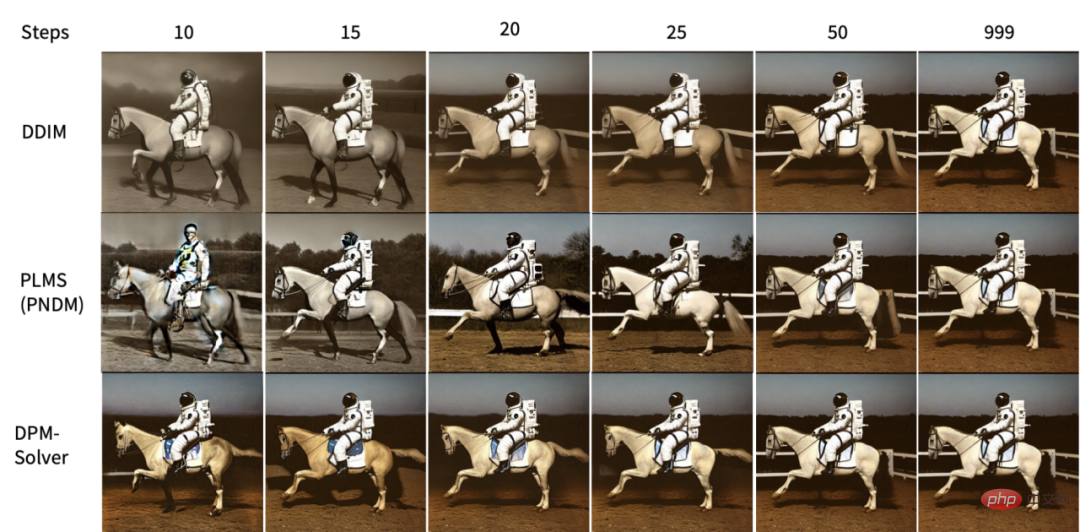

In Im Experiment erzielte DPM-Solver einen Beschleunigungseffekt, der weit über den anderer Sampling-Algorithmen hinausgeht, und er konvergierte nahezu in nur 15–20 Schritten:

Und die quantitativen Ergebnisse in der Arbeit zeigen, dass der durch DPM-Solver eingeführte zusätzliche Berechnungsaufwand völlig vernachlässigbar ist, d. h. der Beschleunigungseffekt auf die Anzahl der Schritte ist direkt proportional zum Beschleunigungseffekt auf die Zeit - daher basierend auf 25 Mit dem erweiterten DPM-Solver wird die Abtastgeschwindigkeit des Stable-Diffusion-Modells direkt verdoppelt! Die folgende Abbildung zeigt beispielsweise die Auswirkung verschiedener Abtastalgorithmen auf die stabile Diffusion, wenn sich die Anzahl der Schritte ändert. Es ist ersichtlich, dass DPM-Solver in 10 bis 15 Schritten eine Abtastung mit sehr hoher Qualität erzielen kann: # 🎜🎜##🎜 🎜#

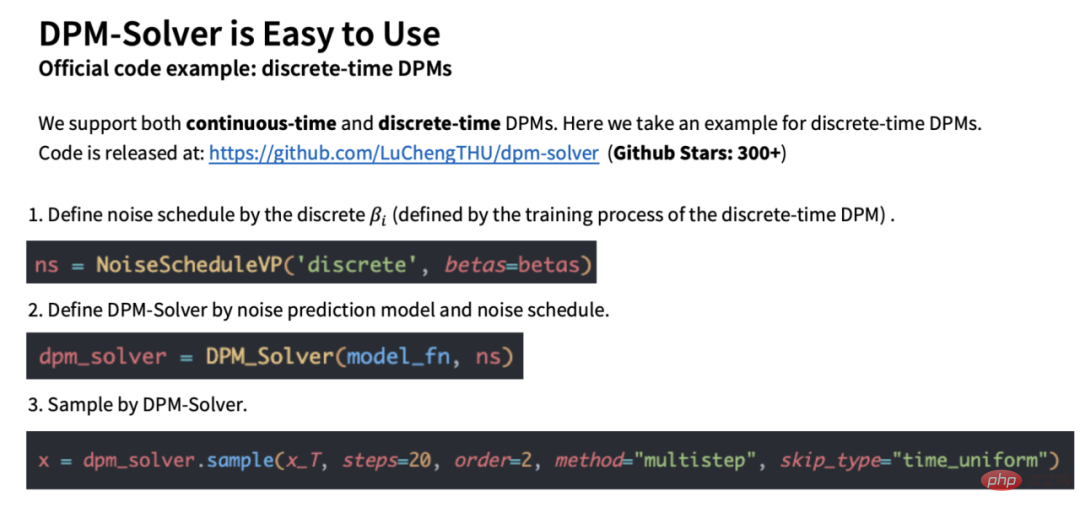

Verwendung von DPM-Solver

Verwendung von DPM-Solver

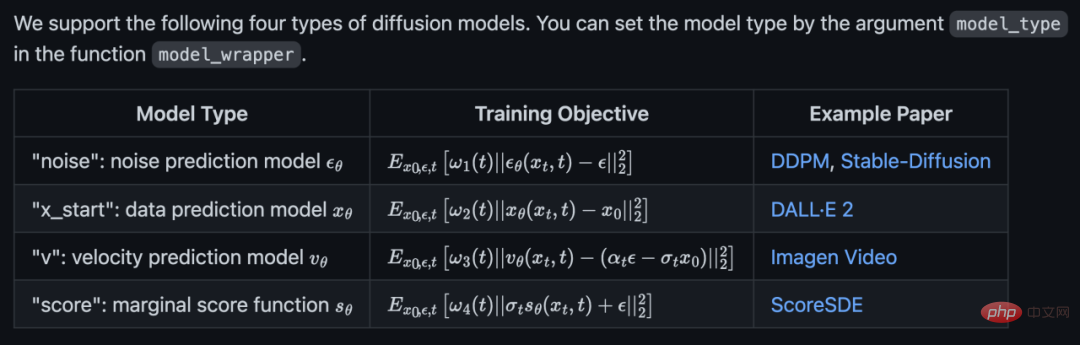

# 🎜🎜# Der offizielle Code unterstützt 4 Diffusionsmodelle:

Der offizielle Code unterstützt 4 Diffusionsmodelle:

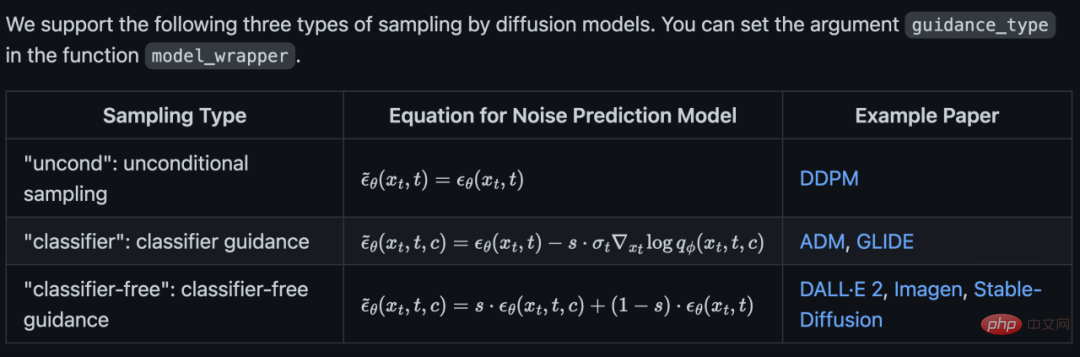

und unterstützt sie gleichzeitig bedingungslose Probenahme, Klassifikatorführung und klassifikatorfreie Führung:

und unterstützt sie gleichzeitig bedingungslose Probenahme, Klassifikatorführung und klassifikatorfreie Führung:

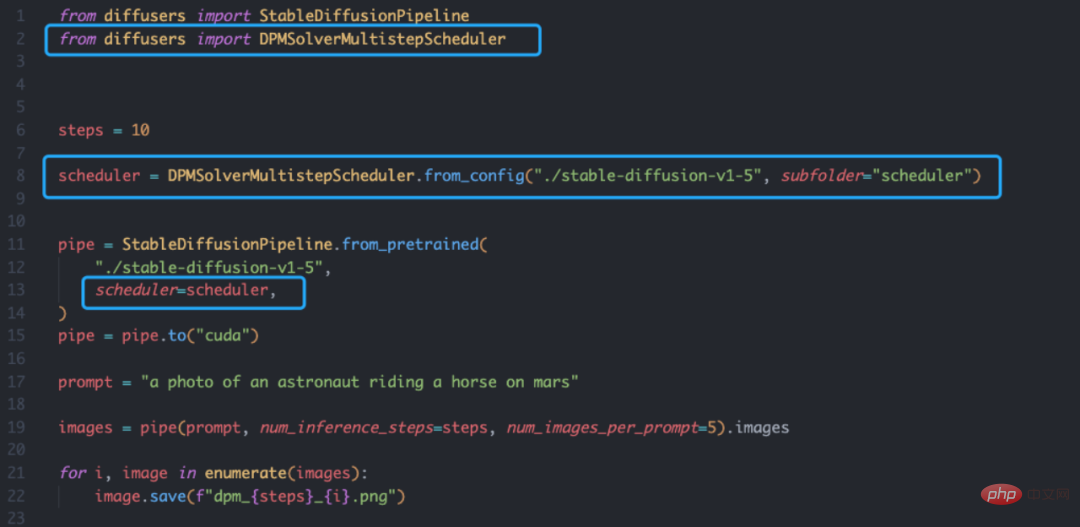

Der DPM-Solver basiert auf Auch die Diffusers-Bibliothek ist sehr einfach, man muss nur den Scheduler definieren:

Der DPM-Solver basiert auf Auch die Diffusers-Bibliothek ist sehr einfach, man muss nur den Scheduler definieren:

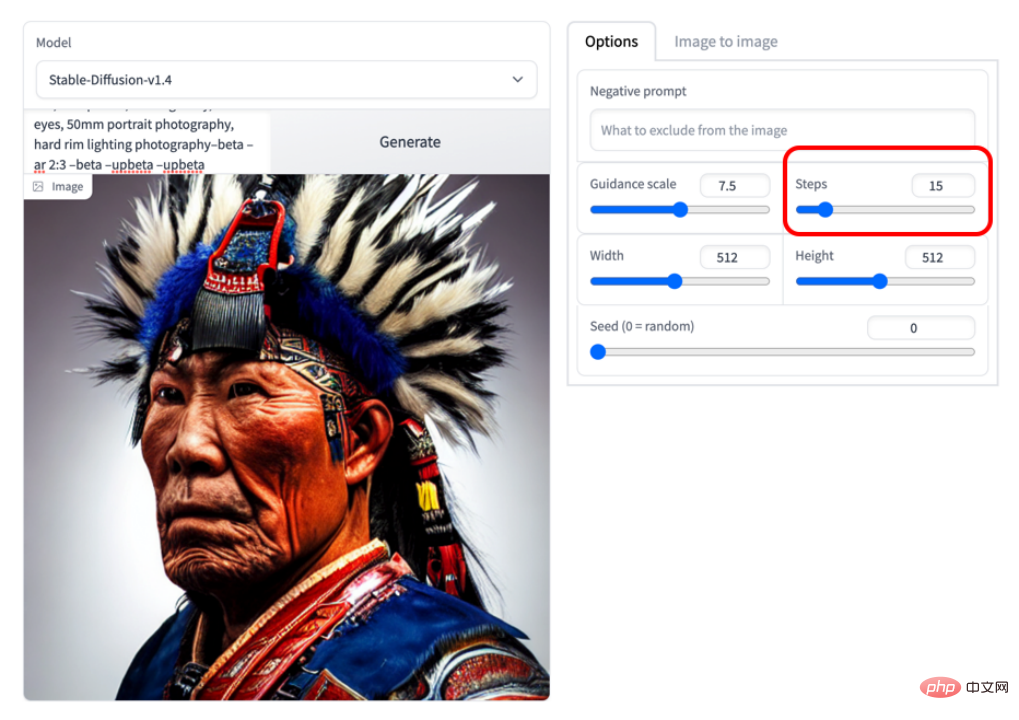

Außerdem das Autorenteam Bietet auch eine Online-Demo: https://huggingface.co/spaces/LuChengTHU/dpmsolver_sdm

Außerdem das Autorenteam Bietet auch eine Online-Demo: https://huggingface.co/spaces/LuChengTHU/dpmsolver_sdm

Das Bild unten ist ein Beispiel für 15 Schritte Die Bildqualität ist bereits sehr hoch:

#🎜🎜 #

Ich glaube, dass basierend auf DPM-Solver die Abtastgeschwindigkeit der Diffusion Modell wird kein Engpass mehr sein.

Über den Autor

DPM-Solver Der Erstautor des Artikels ist Dr. Lu Cheng vom TSAIL-Team der Tsinghua-Universität schreibt über das Diffusionsmodell auf Zhihu. Ich habe in der Diskussion, die derzeit über 2000 Likes hat, auch eine einführende Einführung in die Prinzipien des Diffusionsmodells geschrieben: https://www.zhihu.com/question/536012286/answer/2533146567#🎜 🎜##🎜 🎜#

Das TSAIL-Team der Tsinghua-Universität widmet sich seit langem der Theorie und Algorithmenforschung des Bayes'schen maschinellen Lernens Es wurden in Bayes'schen Modellen effiziente Algorithmen und probabilistische Programmierbibliotheken entwickelt. Ein weiterer Doktorand im Team, Bao Fan, schlug Analytic-DPM [8][9] vor, das eine einfache und überraschende analytische Form für den optimalen Mittelwert und die optimale Varianz des Diffusionsmodells lieferte, und gewann den ICLR 2022 Outstanding Paper Award. In Bezug auf die probabilistische Programmierung berichtete Machine Heart über die vom Team bereits 2017 veröffentlichte Deep Probabilistic Programming-Bibliothek „ZhuSuan“ (https://zhusuan.readthedocs.io/en/latest/) [10], was die früheste ist in der Welt. Eine der Programmierbibliotheken für tiefe Wahrscheinlichkeitsmodelle. Darüber hinaus ist es erwähnenswert, dass die beiden Hauptautoren des Diffusionswahrscheinlichkeitsmodells, Song Yang und Song Jiaming, beide als Studenten eine wissenschaftliche Forschungsausbildung unter der Leitung von Professor Zhu Jun erhielten und später an der Stanford University promovierten . Die Co-Autoren des Artikels, Zhou Yuhao, Chen Jianfei und Li Chongxuan, sind ebenfalls herausragende Doktoranden, die von der TSAIL-Gruppe ausgebildet wurden, und Chen Jianfei und Li Chongxuan lehren am Institut für Informatik in Tsinghua University bzw. der Hillhouse School of Artificial Intelligence der Renmin University.

Das obige ist der detaillierte Inhalt vonStabile Diffusions-Probenahmegeschwindigkeit verdoppelt! Diffusionsmodell-Sampling-Algorithmus in nur 10 bis 25 Schritten. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

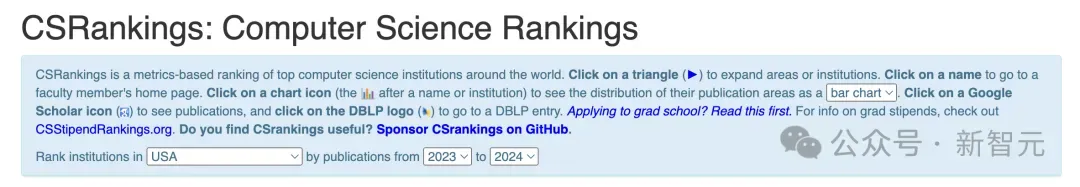

Die CSRankings National Computer Science Rankings 2024 sind veröffentlicht! CMU dominiert die Liste, MIT fällt aus den Top 5

Mar 25, 2024 pm 06:01 PM

Die CSRankings National Computer Science Rankings 2024 sind veröffentlicht! CMU dominiert die Liste, MIT fällt aus den Top 5

Mar 25, 2024 pm 06:01 PM

Die 2024CSRankings National Computer Science Major Rankings wurden gerade veröffentlicht! In diesem Jahr gehört die Carnegie Mellon University (CMU) im Ranking der besten CS-Universitäten in den Vereinigten Staaten zu den Besten des Landes und im Bereich CS, während die University of Illinois at Urbana-Champaign (UIUC) einen der besten Plätze belegt sechs Jahre in Folge den zweiten Platz belegt. Georgia Tech belegte den dritten Platz. Dann teilten sich die Stanford University, die University of California in San Diego, die University of Michigan und die University of Washington den vierten Platz weltweit. Es ist erwähnenswert, dass das Ranking des MIT zurückgegangen ist und aus den Top 5 herausgefallen ist. CSRankings ist ein globales Hochschulrankingprojekt im Bereich Informatik, das von Professor Emery Berger von der School of Computer and Information Sciences der University of Massachusetts Amherst initiiert wurde. Die Rangfolge erfolgt objektiv

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Das weltweit leistungsstärkste Open-Source-MoE-Modell ist da, mit chinesischen Fähigkeiten, die mit GPT-4 vergleichbar sind, und der Preis beträgt nur fast ein Prozent von GPT-4-Turbo

May 07, 2024 pm 04:13 PM

Stellen Sie sich ein Modell der künstlichen Intelligenz vor, das nicht nur die Fähigkeit besitzt, die traditionelle Datenverarbeitung zu übertreffen, sondern auch eine effizientere Leistung zu geringeren Kosten erzielt. Dies ist keine Science-Fiction, DeepSeek-V2[1], das weltweit leistungsstärkste Open-Source-MoE-Modell, ist da. DeepSeek-V2 ist ein leistungsstarkes MoE-Sprachmodell (Mix of Experts) mit den Merkmalen eines wirtschaftlichen Trainings und einer effizienten Inferenz. Es besteht aus 236B Parametern, von denen 21B zur Aktivierung jedes Markers verwendet werden. Im Vergleich zu DeepSeek67B bietet DeepSeek-V2 eine stärkere Leistung, spart gleichzeitig 42,5 % der Trainingskosten, reduziert den KV-Cache um 93,3 % und erhöht den maximalen Generierungsdurchsatz auf das 5,76-fache. DeepSeek ist ein Unternehmen, das sich mit allgemeiner künstlicher Intelligenz beschäftigt

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI untergräbt die mathematische Forschung! Der Gewinner der Fields-Medaille und der chinesisch-amerikanische Mathematiker führten 11 hochrangige Arbeiten an | Gefällt mir bei Terence Tao

Apr 09, 2024 am 11:52 AM

KI verändert tatsächlich die Mathematik. Vor kurzem hat Tao Zhexuan, der diesem Thema große Aufmerksamkeit gewidmet hat, die neueste Ausgabe des „Bulletin of the American Mathematical Society“ (Bulletin der American Mathematical Society) weitergeleitet. Zum Thema „Werden Maschinen die Mathematik verändern?“ äußerten viele Mathematiker ihre Meinung. Der gesamte Prozess war voller Funken, knallhart und aufregend. Der Autor verfügt über eine starke Besetzung, darunter der Fields-Medaillengewinner Akshay Venkatesh, der chinesische Mathematiker Zheng Lejun, der NYU-Informatiker Ernest Davis und viele andere bekannte Wissenschaftler der Branche. Die Welt der KI hat sich dramatisch verändert. Viele dieser Artikel wurden vor einem Jahr eingereicht.

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Google ist begeistert: JAX-Leistung übertrifft Pytorch und TensorFlow! Es könnte die schnellste Wahl für das GPU-Inferenztraining werden

Apr 01, 2024 pm 07:46 PM

Die von Google geförderte Leistung von JAX hat in jüngsten Benchmark-Tests die von Pytorch und TensorFlow übertroffen und belegt bei 7 Indikatoren den ersten Platz. Und der Test wurde nicht auf der TPU mit der besten JAX-Leistung durchgeführt. Obwohl unter Entwicklern Pytorch immer noch beliebter ist als Tensorflow. Aber in Zukunft werden möglicherweise mehr große Modelle auf Basis der JAX-Plattform trainiert und ausgeführt. Modelle Kürzlich hat das Keras-Team drei Backends (TensorFlow, JAX, PyTorch) mit der nativen PyTorch-Implementierung und Keras2 mit TensorFlow verglichen. Zunächst wählen sie eine Reihe von Mainstream-Inhalten aus

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Hallo, elektrischer Atlas! Der Boston Dynamics-Roboter erwacht wieder zum Leben, seltsame 180-Grad-Bewegungen machen Musk Angst

Apr 18, 2024 pm 07:58 PM

Boston Dynamics Atlas tritt offiziell in die Ära der Elektroroboter ein! Gestern hat sich der hydraulische Atlas einfach „unter Tränen“ von der Bühne der Geschichte zurückgezogen. Heute gab Boston Dynamics bekannt, dass der elektrische Atlas im Einsatz ist. Es scheint, dass Boston Dynamics im Bereich kommerzieller humanoider Roboter entschlossen ist, mit Tesla zu konkurrieren. Nach der Veröffentlichung des neuen Videos wurde es innerhalb von nur zehn Stunden bereits von mehr als einer Million Menschen angesehen. Die alten Leute gehen und neue Rollen entstehen. Das ist eine historische Notwendigkeit. Es besteht kein Zweifel, dass dieses Jahr das explosive Jahr der humanoiden Roboter ist. Netizens kommentierten: Die Weiterentwicklung der Roboter hat dazu geführt, dass die diesjährige Eröffnungsfeier wie Menschen aussieht, und der Freiheitsgrad ist weitaus größer als der von Menschen. Aber ist das wirklich kein Horrorfilm? Zu Beginn des Videos liegt Atlas ruhig auf dem Boden, scheinbar auf dem Rücken. Was folgt, ist atemberaubend

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

KAN, das MLP ersetzt, wurde durch Open-Source-Projekte auf Faltung erweitert

Jun 01, 2024 pm 10:03 PM

Anfang dieses Monats schlugen Forscher des MIT und anderer Institutionen eine vielversprechende Alternative zu MLP vor – KAN. KAN übertrifft MLP in Bezug auf Genauigkeit und Interpretierbarkeit. Und es kann MLP, das mit einer größeren Anzahl von Parametern ausgeführt wird, mit einer sehr kleinen Anzahl von Parametern übertreffen. Beispielsweise gaben die Autoren an, dass sie KAN nutzten, um die Ergebnisse von DeepMind mit einem kleineren Netzwerk und einem höheren Automatisierungsgrad zu reproduzieren. Konkret verfügt DeepMinds MLP über etwa 300.000 Parameter, während KAN nur etwa 200 Parameter hat. KAN hat eine starke mathematische Grundlage wie MLP und basiert auf dem universellen Approximationssatz, während KAN auf dem Kolmogorov-Arnold-Darstellungssatz basiert. Wie in der folgenden Abbildung gezeigt, hat KAN

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Tesla-Roboter arbeiten in Fabriken, Musk: Der Freiheitsgrad der Hände wird dieses Jahr 22 erreichen!

May 06, 2024 pm 04:13 PM

Das neueste Video von Teslas Roboter Optimus ist veröffentlicht und er kann bereits in der Fabrik arbeiten. Bei normaler Geschwindigkeit sortiert es Batterien (Teslas 4680-Batterien) so: Der Beamte hat auch veröffentlicht, wie es bei 20-facher Geschwindigkeit aussieht – auf einer kleinen „Workstation“, pflücken und pflücken und pflücken: Dieses Mal wird es freigegeben. Eines der Highlights Der Vorteil des Videos besteht darin, dass Optimus diese Arbeit in der Fabrik völlig autonom und ohne menschliches Eingreifen während des gesamten Prozesses erledigt. Und aus Sicht von Optimus kann es auch die krumme Batterie aufnehmen und platzieren, wobei der Schwerpunkt auf der automatischen Fehlerkorrektur liegt: In Bezug auf die Hand von Optimus gab der NVIDIA-Wissenschaftler Jim Fan eine hohe Bewertung ab: Die Hand von Optimus ist der fünffingrige Roboter der Welt am geschicktesten. Seine Hände sind nicht nur taktil

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

FisheyeDetNet: der erste Zielerkennungsalgorithmus basierend auf einer Fischaugenkamera

Apr 26, 2024 am 11:37 AM

Die Zielerkennung ist ein relativ ausgereiftes Problem in autonomen Fahrsystemen, wobei die Fußgängererkennung einer der ersten Algorithmen ist, die eingesetzt werden. In den meisten Arbeiten wurde eine sehr umfassende Recherche durchgeführt. Die Entfernungswahrnehmung mithilfe von Fischaugenkameras für die Rundumsicht ist jedoch relativ wenig untersucht. Aufgrund der großen radialen Verzerrung ist es schwierig, die standardmäßige Bounding-Box-Darstellung in Fischaugenkameras zu implementieren. Um die obige Beschreibung zu vereinfachen, untersuchen wir erweiterte Begrenzungsrahmen-, Ellipsen- und allgemeine Polygondesigns in Polar-/Winkeldarstellungen und definieren eine mIOU-Metrik für die Instanzsegmentierung, um diese Darstellungen zu analysieren. Das vorgeschlagene Modell „fisheyeDetNet“ mit polygonaler Form übertrifft andere Modelle und erreicht gleichzeitig 49,5 % mAP auf dem Valeo-Fisheye-Kameradatensatz für autonomes Fahren