Technologie-Peripheriegeräte

Technologie-Peripheriegeräte

KI

KI

Kontinuierliche Umkehrungen! DeepMind wurde vom russischen Team befragt: Wie können wir beweisen, dass neuronale Netze die physische Welt verstehen?

Kontinuierliche Umkehrungen! DeepMind wurde vom russischen Team befragt: Wie können wir beweisen, dass neuronale Netze die physische Welt verstehen?

Kontinuierliche Umkehrungen! DeepMind wurde vom russischen Team befragt: Wie können wir beweisen, dass neuronale Netze die physische Welt verstehen?

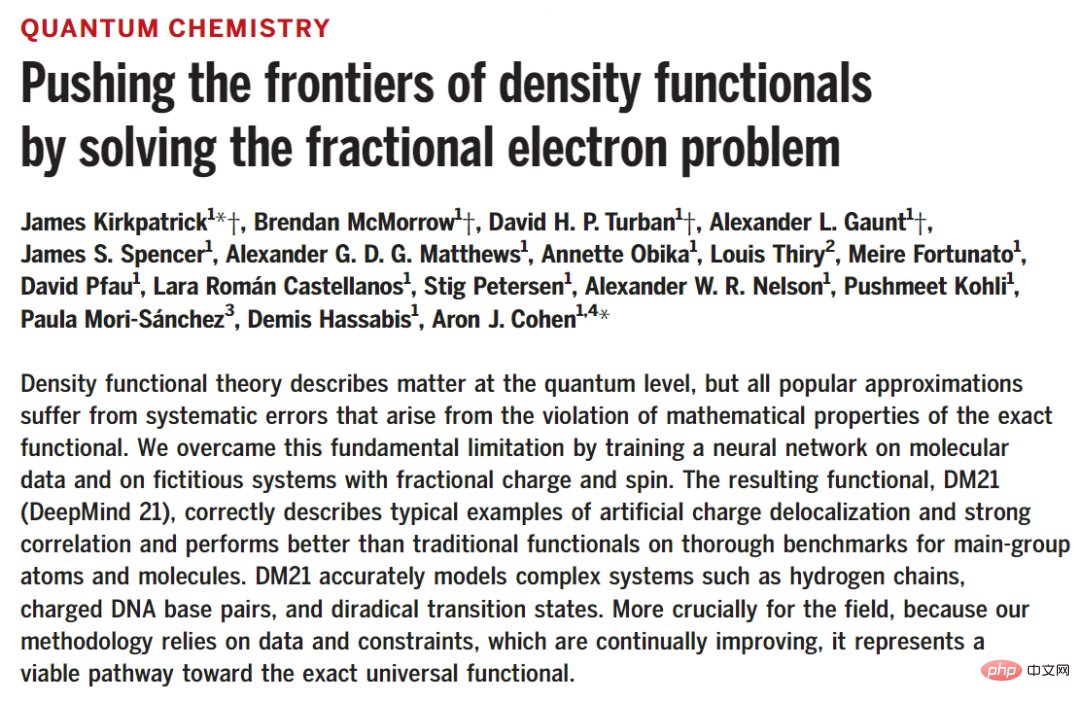

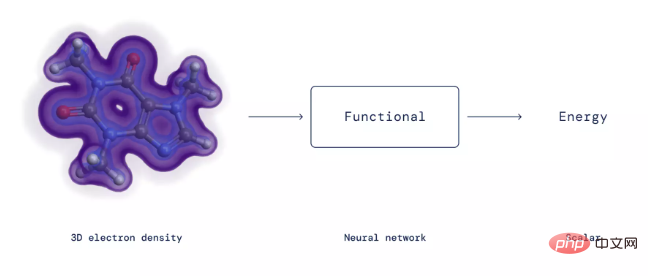

In der wissenschaftlichen Gemeinschaft gab es kürzlich eine weitere Kontroverse. Der Protagonist der Geschichte ist ein wissenschaftlicher Artikel, der im Dezember 2021 vom Forschungszentrum DeepMind in London veröffentlicht wurde. Forscher fanden heraus, dass neuronale Netze verwendet werden können, um genauere Elektronik als zuvor zu trainieren und zu bauen . Dichte- und Interaktionsdiagramme können systematische Fehler in der traditionellen Funktionaltheorie effektiv beheben.

Link zum Papier: https://www.science.org/doi/epdf/10.1126/science.abj6511

Das im Artikel vorgeschlagene DM21-Modell simuliert komplexe Systeme wie Wasserstoffstränge genau , geladene DNA-Basenpaare und binäre Übergangszustände. Für das Gebiet der Quantenchemie kann man sagen, dass sie einen praktikablen technischen Weg zu genauen universellen Funktionen eröffnet hat.

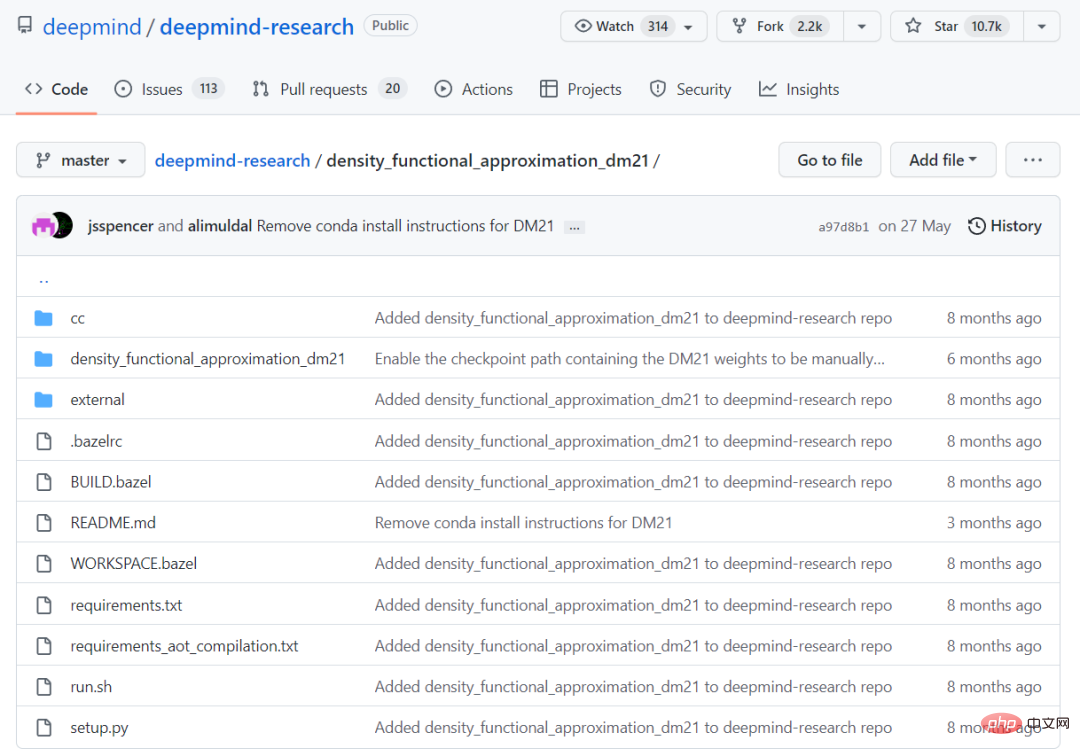

DeepMind-Forscher haben außerdem den Code des DM21-Modells veröffentlicht, um die Reproduktion durch Kollegen zu erleichtern.

Repository-Link: https://github.com/deepmind/deepmind-research

Logischerweise sind das Papier und der Code öffentlich und werden in Top-Zeitschriften veröffentlicht. Die experimentellen Ergebnisse und die Forschungsergebnisse sind grundsätzlich zuverlässig .

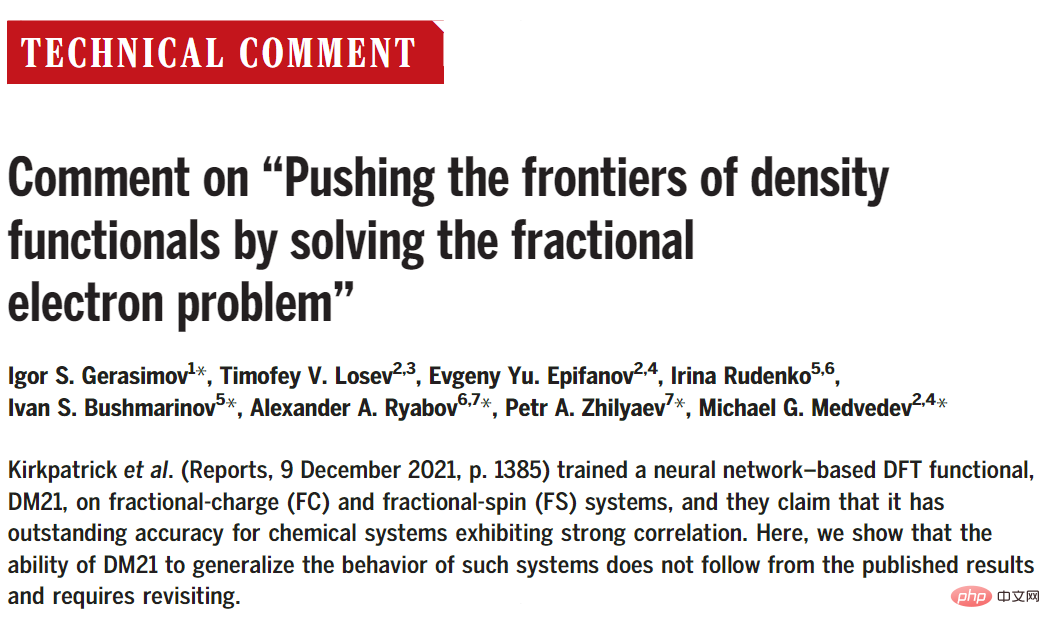

Aber acht Monate später veröffentlichten auch acht Forscher aus Russland und Südkorea eine wissenschaftliche Rezension in Science. Sie glaubten, dass es in der ursprünglichen Forschung von DeepMind ein Problem gab, das heißt, dass sich der Trainingssatz und der Testsatz überschneiden könnten. Teil , der zu falschen experimentellen Schlussfolgerungen führt.

Link zum Papier: https://www.science.org/doi/epdf/10.1126/science.abq3385

Wenn der Verdacht wahr ist, dann ist dieser DeepMind-Artikel als Major bekannt Technologische Durchbruch in der chemischen Industrie s Papier, die durch neuronale Netze erzielten Verbesserungen könnten auf Datenlecks zurückzuführen sein.

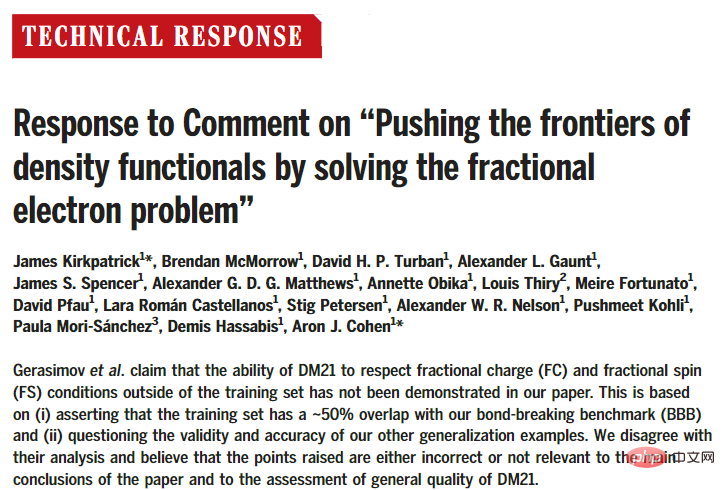

DeepMind reagierte jedoch auch schnell am selben Tag, an dem die Rezension veröffentlicht wurde, und schrieb sofort eine Antwort, um seinen Einwand und seine scharfe Verurteilung zum Ausdruck zu bringen: Die von ihnen geäußerten Ansichten seien entweder falsch oder nicht im Einklang mit den Hauptschlussfolgerungen des Papiers ihre Kommentare. Irrelevant für die Beurteilung der Gesamtqualität von DM21.

Link zum Papier: https://www.science.org/doi/epdf/10.1126/science.abq4282

Der berühmte Physiker Feynman sagte einmal: Wissenschaftler wollen einfach genauso schnell sein Beweisen Sie so gut wie möglich, dass Sie falsch liegen, denn nur so kommen Sie voran.

Obwohl das Ergebnis dieser Diskussion noch nicht abgeschlossen ist und das russische Team keine weiteren Gegenartikel veröffentlicht hat, könnte der Vorfall tiefgreifendere Auswirkungen auf die Forschung auf dem Gebiet der künstlichen Intelligenz haben: Wie kann man das beweisen? wurde trainiert. Versteht das neuronale Netzwerkmodell die Aufgabe wirklich, anstatt sich nur das Muster zu merken? Forschungsfragen

Chemie ist (sicher) die zentrale Wissenschaft des 21. Jahrhunderts, und die Entwicklung neuer Materialien mit bestimmten Eigenschaften, wie etwa die Erzeugung sauberer Elektrizität oder die Entwicklung von Hochtemperatur-Supraleitern, erfordert die Simulation von Elektronen auf Computern.Elektronen sind subatomare Teilchen, die steuern, wie sich Atome zu Molekülen verbinden. Sie sind auch für den Stromfluss in Festkörpern verantwortlich. Das Verständnis der Position von Elektronen innerhalb eines Moleküls kann einen großen Beitrag zur Erklärung seiner Struktur, Eigenschaften und Eigenschaften leisten Reaktivität.

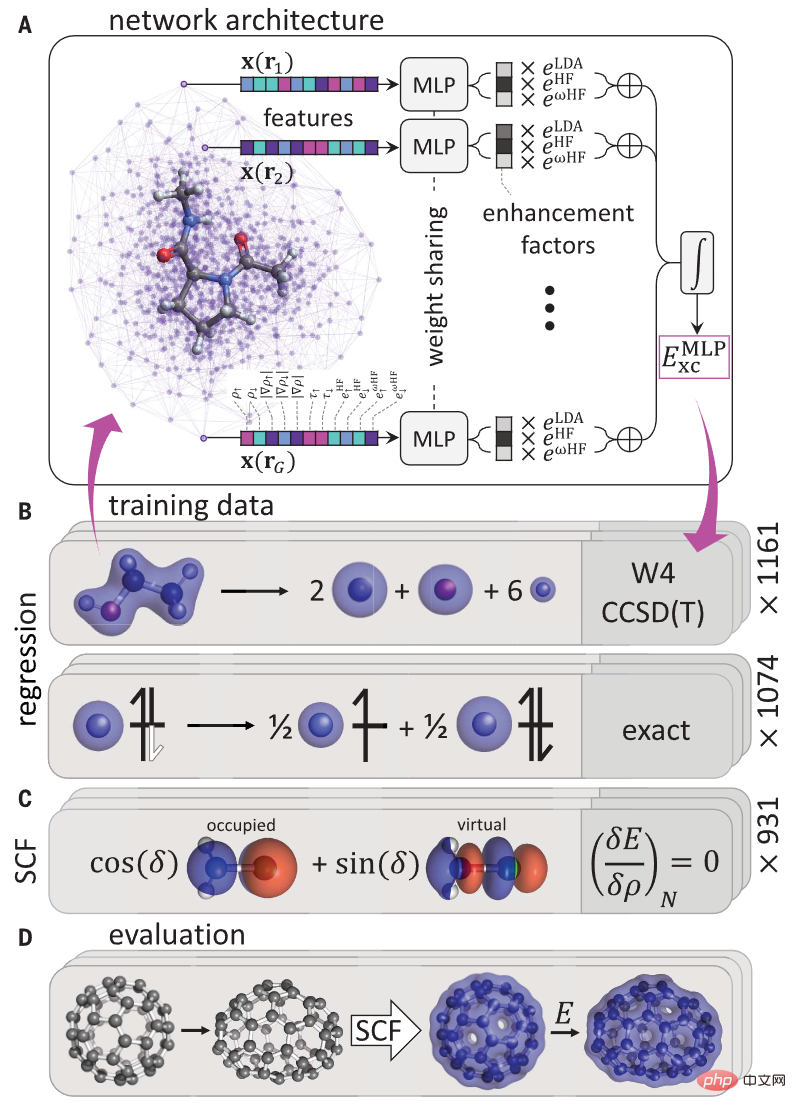

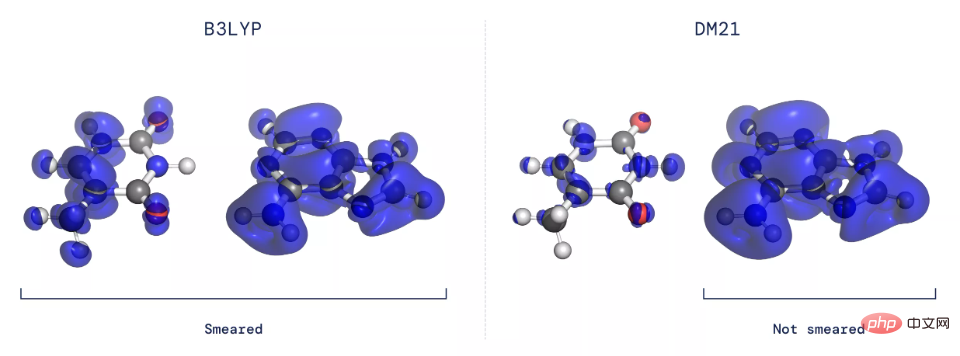

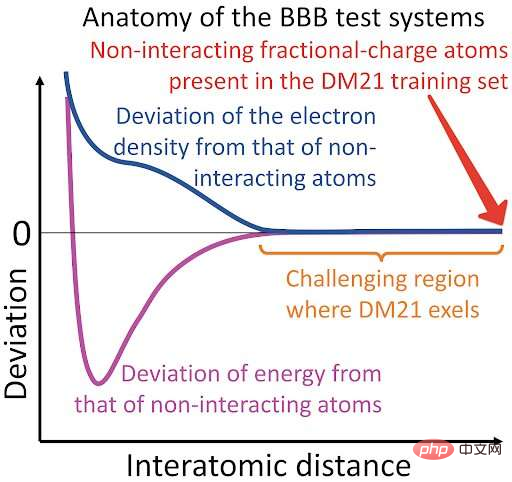

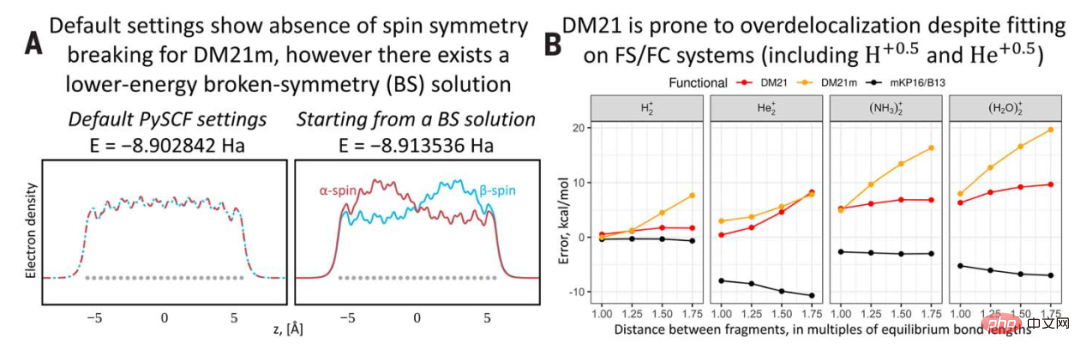

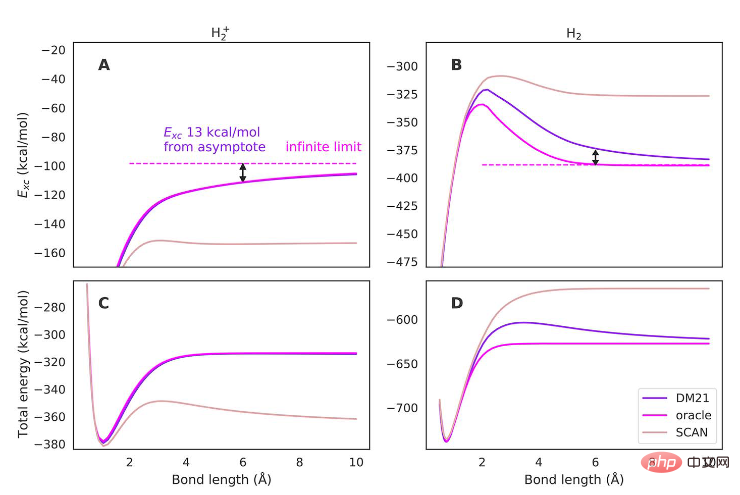

1926 schlug Schrödinger die Schrödinger-Gleichung vor, die das Quantenverhalten der Wellenfunktion korrekt beschreiben kann. Die Verwendung dieser Gleichung zur Vorhersage von Elektronen in einem Molekül reicht jedoch nicht aus, da sich alle Elektronen gegenseitig abstoßen und es notwendig ist, die Wahrscheinlichkeit der Position jedes Elektrons zu verfolgen, was selbst für eine kleine Anzahl von Elektronen eine sehr komplizierte Aufgabe ist. Ein großer Durchbruch gelang in den 1960er Jahren, als Pierre Hohenberg und Walter Kohn erkannten, dass es nicht nötig war, jeden Einzelnen zu verfolgen Elektronen. Stattdessen reicht es aus, die Wahrscheinlichkeit zu kennen, dass sich ein Elektron an jeder Position befindet (d. h. die Elektronendichte), um alle Wechselwirkungen genau zu berechnen. Nachdem er die obige Theorie bewiesen hatte, gewann Kohn den Nobelpreis für Chemie und schuf damit Dichtefunktionaltheorie (Dichtefunktionaltheorie, DFT) Obwohl DFT die Existenz einer Abbildung beweist, ist die genaue Art der Abbildung zwischen Elektronendichte und Wechselwirkungsenergie, das sogenannte Dichtefunktional, seit mehr als 50 Jahren unbekannt Jahren muss eine Näherungslösung durchgeführt werden. DFT ist im Wesentlichen eine Methode zur Lösung der Schrödinger-Gleichung, und ihre Genauigkeit hängt von ihrem Austauschkorrelationsteil ab. Obwohl die DFT ein gewisses Maß an Näherung erfordert, ist sie die einzige praktische Möglichkeit, zu untersuchen, wie und warum sich Materie auf mikroskopischer Ebene auf eine bestimmte Weise verhält, und ist daher zu einer der am weitesten verbreiteten Techniken in allen Bereichen der Wissenschaft geworden. Im Laufe der Jahre haben Forscher mehr als 400 Näherungsfunktionen mit unterschiedlichem Genauigkeitsgrad vorgeschlagen, aber alle diese Näherungen weisen systematische Fehler auf, weil sie nicht in der Lage sind, das Genaue zu erfassen funktional Bestimmte wichtige mathematische Eigenschaften. Wenn es darum geht, Näherungsfunktionen zu lernen, ist das nicht die Aufgabe neuronaler Netze? DeepMind wird auf molekularen Daten und einem fiktiven System mit fraktionierter Ladung und Spin trainiert. Ein neuronales Netzwerk DM 21 (DeepMind 21) hat erfolgreich ein Funktional ohne systematische Fehler gelernt, ist in der Lage, Delokalisierungsfehler (Delokalisierungsfehler) und das Aufbrechen der Spinsymmetrie (Spin-Symmetrie-Bruch) zu vermeiden, und kann ein breites Spektrum chemischer Reaktionskategorien besser beschreiben. Grundsätzlich ist jeder chemische und physikalische Prozess mit Ladungsbewegung anfällig für Delokalisierungsfehler. Der Prozess des Bindungsbruchs neigt dazu, die Spinsymmetrie zu brechen. Während Ladungsbewegungen und Bindungsbrüche im Mittelpunkt vieler wichtiger technischer Anwendungen stehen, können diese Probleme auch zu zahlreichen qualitativen Fehlern bei der Beschreibung der funktionellen Gruppen der einfachsten Moleküle wie Wasserstoff führen. Das Modell wird unter Verwendung eines mehrschichtigen Perzeptrons (MLP) erstellt und die Eingabe ist das besetzte Kohn- Schein (KS) Lokale und nichtlokale Merkmale von Umlaufbahnen. Die Zielfunktion enthält zwei: Eine ist der Regressionsverlust, der zum Erlernen der Austauschkorrelationsenergie selbst verwendet wird, und die andere dient dazu, sicherzustellen, dass die Funktionsableitung verwendet werden kann Nach dem Training wird das selbstkonsistente Feld (selbstkonsistentes Feld, SCF) als Gradienten-Regularisierungsterm berechnet. Für den Regressionsverlust verwendeten die Forscher einen Datensatz mit fester Dichte, der die Reaktanten und Produkte von 2235 Reaktionen darstellt, und trainierten das Netzwerk anhand dieser Dichten auf Reaktionsenergien mit hoher Genauigkeit, mit 1161 Trainingsreaktionen, die die Atomisierung, Ionisierung, Elektronenaffinität und intermolekularen Bindungsenergien kleiner H-Kr-Moleküle darstellen, und 1074 Reaktionen, die die Schlüssel-H-Ar-Atome, FC- und FS-Dichte darstellen. Das resultierende Modell DM21 ist nach dem Training in der Lage, auf allen Reaktionen des großen Hauptfamilien-Benchmarks selbstkonsistent zu laufen und so genauere Moleküldichten zu erzeugen. Wenn DeepMind DM21 trainiert, handelt es sich bei den verwendeten Daten um ein Teilladungssystem, beispielsweise ein Wasserstoffatom mit einem halben Elektron. Um die Überlegenheit von DM21 zu beweisen, führten die Forscher Tests an einem Satz gestreckter Dimere durch, dem so genannten Bond-Breaking-Benchmark-Satz (BBB). Beispielsweise haben zwei weit voneinander entfernte Wasserstoffatome insgesamt ein Elektron. Experimentelle Ergebnisse ergaben, dass das DM21-Funktional auf dem BBB-Testsatz eine hervorragende Leistung zeigte und alle bisher getesteten klassischen DFT-Funktionen und DM21m übertraf (dasselbe wie das DM21-Training, jedoch ohne Teilladungen im Trainingssatz). Dann behauptete DeepMind in der Arbeit: DM21 hat die physikalischen Prinzipien hinter dem Teilladungssystem verstanden. Aber wenn man genau hinschaut, wird man feststellen, dass in der BBB-Gruppe alle Dimere dem System in der Trainingsgruppe sehr ähnlich werden. Tatsächlich sind atomare Wechselwirkungen aufgrund der lokalisierten Natur elektroschwacher Wechselwirkungen nur über kurze Distanzen stark, jenseits dieser Distanzen verhalten sich die beiden Atome im Wesentlichen so, als würden sie nicht interagieren. Michael Medvedev, Forschungsgruppenleiter am Zelinsky-Institut für Organische Chemie der Russischen Akademie der Wissenschaften, erklärt, dass neuronale Netze in gewisser Weise wie Menschen sind, da sie es vorziehen, die richtige Antwort aus dem falschen Grund zu bekommen . Es ist also nicht schwer, ein neuronales Netzwerk zu trainieren, aber es ist schwer zu beweisen, dass es die Gesetze der Physik gelernt hat und nicht nur die richtigen Antworten auswendig gelernt hat. Daher ist der BBB-Testsatz kein geeigneter Testsatz: Er testet weder das DM21-Verständnis fraktionaler elektronischer Systeme, noch führt eine gründliche Analyse von vier anderen Beweisstücken für die DM21-Verarbeitung solcher Systeme zu schlüssigen Schlussfolgerungen: Nur die gute Genauigkeit des SIE4x4-Sets ist möglicherweise zuverlässig. Russische Forscher glauben auch, dass die Verwendung von Teilladungssystemen im Trainingssatz nicht die einzige Neuheit in der Arbeit von DeepMind ist. Ihre Idee, durch Trainingssätze physikalische Beschränkungen in neuronale Netze einzuführen, und die Methode, durch Training korrekter chemischer Potentiale physikalische Bedeutungen zu verleihen, könnte in Zukunft bei der Konstruktion von DFT-Funktionen neuronaler Netze weit verbreitet sein. Für Kommentar Die Behauptung des Papiers, dass die Fähigkeit von DM21, fraktionierte Ladungs- (FC) und fraktionierte Spin-(FS)-Bedingungen außerhalb des Trainingssatzes vorherzusagen, wird in dem Papier nicht demonstriert, das auf dem Trainingssatz mit dem basiert Der Bond-Breaking-Benchmark BBB weist eine Überlappung von etwa 50 % auf und es werden Schlussfolgerungen aus der Wirksamkeit und Genauigkeit anderer Verallgemeinerungsbeispiele gezogen. DeepMind ist mit dieser Analyse nicht einverstanden und ist der Ansicht, dass die angesprochenen Punkte entweder falsch oder für die Hauptschlussfolgerungen des Papiers und die Bewertung der Gesamtqualität von DM21 irrelevant sind, da die BBB nicht für das gezeigte FC- und FS-Verhalten verantwortlich ist im Papier Nur Beispiel. Die Überlappung zwischen dem Trainingssatz und dem Testsatz ist ein Forschungsthema, das beim maschinellen Lernen Aufmerksamkeit verdient: Gedächtnis bedeutet, dass ein Modell beim Testsatz bessere Leistungen erbringen kann, indem Beispiele im Trainingssatz kopiert werden. Gerasimov glaubt, dass das Verhalten von DM21 auf der BBB (die Dimere mit endlichem Abstand enthält) gut durch die Replikation der Ausgabe von FC- und FS-Systemen erklärt werden kann (d. h. Atome passen zu Dimeren bei unendlichen Trennungsgrenzen). Um zu beweisen, dass DM21 über den Trainingssatz hinaus verallgemeinert wird, betrachteten DeepMind-Forscher auch die prototypischen BHS-Beispiele von H2+ (kationisches Dimer) und H2 (neutrales Dimer) und kamen zu dem Schluss: Genau. Die Austauschkorrelationsfunktion ist nicht vorhanden -local; die Rückgabe eines konstanten gespeicherten Werts kann mit zunehmender Entfernung zu erheblichen Fehlern bei BBB-Vorhersagen führen.

Echtes SOTA oder Datenleck?

DeepMind Response

Das obige ist der detaillierte Inhalt vonKontinuierliche Umkehrungen! DeepMind wurde vom russischen Team befragt: Wie können wir beweisen, dass neuronale Netze die physische Welt verstehen?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Heiße KI -Werkzeuge

Undresser.AI Undress

KI-gestützte App zum Erstellen realistischer Aktfotos

AI Clothes Remover

Online-KI-Tool zum Entfernen von Kleidung aus Fotos.

Undress AI Tool

Ausziehbilder kostenlos

Clothoff.io

KI-Kleiderentferner

AI Hentai Generator

Erstellen Sie kostenlos Ai Hentai.

Heißer Artikel

Heiße Werkzeuge

Notepad++7.3.1

Einfach zu bedienender und kostenloser Code-Editor

SublimeText3 chinesische Version

Chinesische Version, sehr einfach zu bedienen

Senden Sie Studio 13.0.1

Leistungsstarke integrierte PHP-Entwicklungsumgebung

Dreamweaver CS6

Visuelle Webentwicklungstools

SublimeText3 Mac-Version

Codebearbeitungssoftware auf Gottesniveau (SublimeText3)

Heiße Themen

1382

1382

52

52

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Bytedance Cutting führt SVIP-Supermitgliedschaft ein: 499 Yuan für ein fortlaufendes Jahresabonnement, das eine Vielzahl von KI-Funktionen bietet

Jun 28, 2024 am 03:51 AM

Diese Seite berichtete am 27. Juni, dass Jianying eine von FaceMeng Technology, einer Tochtergesellschaft von ByteDance, entwickelte Videobearbeitungssoftware ist, die auf der Douyin-Plattform basiert und grundsätzlich kurze Videoinhalte für Benutzer der Plattform produziert Windows, MacOS und andere Betriebssysteme. Jianying kündigte offiziell die Aktualisierung seines Mitgliedschaftssystems an und führte ein neues SVIP ein, das eine Vielzahl von KI-Schwarztechnologien umfasst, wie z. B. intelligente Übersetzung, intelligente Hervorhebung, intelligente Verpackung, digitale menschliche Synthese usw. Preislich beträgt die monatliche Gebühr für das Clipping von SVIP 79 Yuan, die Jahresgebühr 599 Yuan (Hinweis auf dieser Website: entspricht 49,9 Yuan pro Monat), das fortlaufende Monatsabonnement beträgt 59 Yuan pro Monat und das fortlaufende Jahresabonnement beträgt 499 Yuan pro Jahr (entspricht 41,6 Yuan pro Monat). Darüber hinaus erklärte der Cut-Beamte auch, dass diejenigen, die den ursprünglichen VIP abonniert haben, das Benutzererlebnis verbessern sollen

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Kontexterweiterter KI-Codierungsassistent mit Rag und Sem-Rag

Jun 10, 2024 am 11:08 AM

Verbessern Sie die Produktivität, Effizienz und Genauigkeit der Entwickler, indem Sie eine abrufgestützte Generierung und ein semantisches Gedächtnis in KI-Codierungsassistenten integrieren. Übersetzt aus EnhancingAICodingAssistantswithContextUsingRAGandSEM-RAG, Autor JanakiramMSV. Obwohl grundlegende KI-Programmierassistenten natürlich hilfreich sind, können sie oft nicht die relevantesten und korrektesten Codevorschläge liefern, da sie auf einem allgemeinen Verständnis der Softwaresprache und den gängigsten Mustern beim Schreiben von Software basieren. Der von diesen Coding-Assistenten generierte Code eignet sich zur Lösung der von ihnen zu lösenden Probleme, entspricht jedoch häufig nicht den Coding-Standards, -Konventionen und -Stilen der einzelnen Teams. Dabei entstehen häufig Vorschläge, die geändert oder verfeinert werden müssen, damit der Code in die Anwendung übernommen wird

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Der DeepMind-Roboter spielt Tischtennis und seine Vor- und Rückhand rutschen in die Luft, wodurch menschliche Anfänger völlig besiegt werden

Aug 09, 2024 pm 04:01 PM

Aber vielleicht kann er den alten Mann im Park nicht besiegen? Die Olympischen Spiele in Paris sind in vollem Gange und Tischtennis hat viel Aufmerksamkeit erregt. Gleichzeitig haben Roboter auch beim Tischtennisspielen neue Durchbrüche erzielt. Gerade hat DeepMind den ersten lernenden Roboteragenten vorgeschlagen, der das Niveau menschlicher Amateurspieler im Tischtennis-Wettkampf erreichen kann. Papieradresse: https://arxiv.org/pdf/2408.03906 Wie gut ist der DeepMind-Roboter beim Tischtennisspielen? Vermutlich auf Augenhöhe mit menschlichen Amateurspielern: Sowohl Vorhand als auch Rückhand: Der Gegner nutzt unterschiedliche Spielstile, und auch der Roboter hält aus: Aufschlagannahme mit unterschiedlichem Spin: Allerdings scheint die Intensität des Spiels nicht so intensiv zu sein wie Der alte Mann im Park. Für Roboter, Tischtennis

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Kann LLM durch Feinabstimmung wirklich neue Dinge lernen: Die Einführung neuen Wissens kann dazu führen, dass das Modell mehr Halluzinationen hervorruft

Jun 11, 2024 pm 03:57 PM

Large Language Models (LLMs) werden auf riesigen Textdatenbanken trainiert und erwerben dort große Mengen an realem Wissen. Dieses Wissen wird in ihre Parameter eingebettet und kann dann bei Bedarf genutzt werden. Das Wissen über diese Modelle wird am Ende der Ausbildung „verdinglicht“. Am Ende des Vortrainings hört das Modell tatsächlich auf zu lernen. Richten Sie das Modell aus oder verfeinern Sie es, um zu erfahren, wie Sie dieses Wissen nutzen und natürlicher auf Benutzerfragen reagieren können. Aber manchmal reicht Modellwissen nicht aus, und obwohl das Modell über RAG auf externe Inhalte zugreifen kann, wird es als vorteilhaft angesehen, das Modell durch Feinabstimmung an neue Domänen anzupassen. Diese Feinabstimmung erfolgt mithilfe von Eingaben menschlicher Annotatoren oder anderer LLM-Kreationen, wobei das Modell auf zusätzliches Wissen aus der realen Welt trifft und dieses integriert

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Sieben coole technische Interviewfragen für GenAI und LLM

Jun 07, 2024 am 10:06 AM

Um mehr über AIGC zu erfahren, besuchen Sie bitte: 51CTOAI.x Community https://www.51cto.com/aigc/Translator|Jingyan Reviewer|Chonglou unterscheidet sich von der traditionellen Fragendatenbank, die überall im Internet zu sehen ist erfordert einen Blick über den Tellerrand hinaus. Large Language Models (LLMs) gewinnen in den Bereichen Datenwissenschaft, generative künstliche Intelligenz (GenAI) und künstliche Intelligenz zunehmend an Bedeutung. Diese komplexen Algorithmen verbessern die menschlichen Fähigkeiten, treiben Effizienz und Innovation in vielen Branchen voran und werden zum Schlüssel für Unternehmen, um wettbewerbsfähig zu bleiben. LLM hat ein breites Anwendungsspektrum und kann in Bereichen wie der Verarbeitung natürlicher Sprache, der Textgenerierung, der Spracherkennung und Empfehlungssystemen eingesetzt werden. Durch das Lernen aus großen Datenmengen ist LLM in der Lage, Text zu generieren

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Fünf Schulen des maschinellen Lernens, die Sie nicht kennen

Jun 05, 2024 pm 08:51 PM

Maschinelles Lernen ist ein wichtiger Zweig der künstlichen Intelligenz, der Computern die Möglichkeit gibt, aus Daten zu lernen und ihre Fähigkeiten zu verbessern, ohne explizit programmiert zu werden. Maschinelles Lernen hat ein breites Anwendungsspektrum in verschiedenen Bereichen, von der Bilderkennung und der Verarbeitung natürlicher Sprache bis hin zu Empfehlungssystemen und Betrugserkennung, und es verändert unsere Lebensweise. Im Bereich des maschinellen Lernens gibt es viele verschiedene Methoden und Theorien, von denen die fünf einflussreichsten Methoden als „Fünf Schulen des maschinellen Lernens“ bezeichnet werden. Die fünf Hauptschulen sind die symbolische Schule, die konnektionistische Schule, die evolutionäre Schule, die Bayes'sche Schule und die Analogieschule. 1. Der Symbolismus, auch Symbolismus genannt, betont die Verwendung von Symbolen zum logischen Denken und zum Ausdruck von Wissen. Diese Denkrichtung glaubt, dass Lernen ein Prozess der umgekehrten Schlussfolgerung durch das Vorhandene ist

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Um ein neues wissenschaftliches und komplexes Frage-Antwort-Benchmark- und Bewertungssystem für große Modelle bereitzustellen, haben UNSW, Argonne, die University of Chicago und andere Institutionen gemeinsam das SciQAG-Framework eingeführt

Jul 25, 2024 am 06:42 AM

Herausgeber | Der Frage-Antwort-Datensatz (QA) von ScienceAI spielt eine entscheidende Rolle bei der Förderung der Forschung zur Verarbeitung natürlicher Sprache (NLP). Hochwertige QS-Datensätze können nicht nur zur Feinabstimmung von Modellen verwendet werden, sondern auch effektiv die Fähigkeiten großer Sprachmodelle (LLMs) bewerten, insbesondere die Fähigkeit, wissenschaftliche Erkenntnisse zu verstehen und zu begründen. Obwohl es derzeit viele wissenschaftliche QS-Datensätze aus den Bereichen Medizin, Chemie, Biologie und anderen Bereichen gibt, weisen diese Datensätze immer noch einige Mängel auf. Erstens ist das Datenformular relativ einfach, die meisten davon sind Multiple-Choice-Fragen. Sie sind leicht auszuwerten, schränken jedoch den Antwortauswahlbereich des Modells ein und können die Fähigkeit des Modells zur Beantwortung wissenschaftlicher Fragen nicht vollständig testen. Im Gegensatz dazu offene Fragen und Antworten

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

AlphaFold 3 wird auf den Markt gebracht und sagt die Wechselwirkungen und Strukturen von Proteinen und allen Lebensmolekülen umfassend und mit weitaus größerer Genauigkeit als je zuvor voraus

Jul 16, 2024 am 12:08 AM

Herausgeber | Rettichhaut Seit der Veröffentlichung des leistungsstarken AlphaFold2 im Jahr 2021 verwenden Wissenschaftler Modelle zur Proteinstrukturvorhersage, um verschiedene Proteinstrukturen innerhalb von Zellen zu kartieren, Medikamente zu entdecken und eine „kosmische Karte“ jeder bekannten Proteininteraktion zu zeichnen. Gerade hat Google DeepMind das AlphaFold3-Modell veröffentlicht, das gemeinsame Strukturvorhersagen für Komplexe wie Proteine, Nukleinsäuren, kleine Moleküle, Ionen und modifizierte Reste durchführen kann. Die Genauigkeit von AlphaFold3 wurde im Vergleich zu vielen dedizierten Tools in der Vergangenheit (Protein-Ligand-Interaktion, Protein-Nukleinsäure-Interaktion, Antikörper-Antigen-Vorhersage) deutlich verbessert. Dies zeigt, dass dies innerhalb eines einzigen einheitlichen Deep-Learning-Frameworks möglich ist